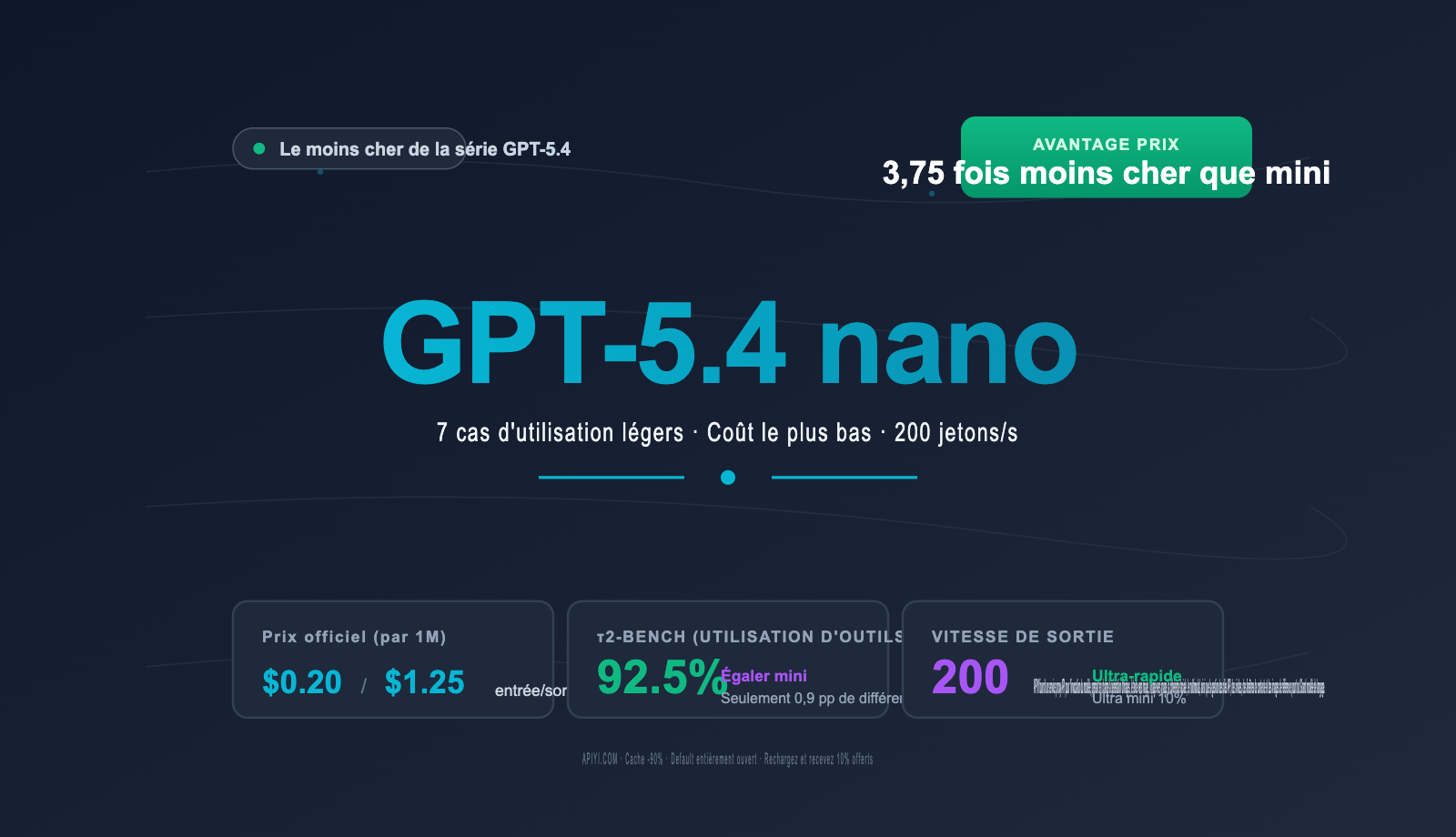

Note de l'auteur : Le modèle gpt-5.4-nano d'OpenAI, le plus abordable à $0,20/$1,25, affiche un score de 92,5 % au τ2-Bench, égalant presque le modèle mini. Cet article détaille les 7 cas d'usage idéaux pour le nano, quand privilégier le mini, et comment optimiser vos coûts avec une réduction de 90 % grâce à la mise en cache.

Si votre application dépasse les 10 000 invocations par jour, ou si vous sélectionnez un modèle pour des tâches à haut débit comme le service client, la classification ou le routage RAG, vous avez sans doute remarqué qu'OpenAI a placé la barre très bas avec la série GPT-5.4 : gpt-5.4-nano, à $0,20 en entrée / $1,25 en sortie pour 1M de jetons, soit un coût d'entrée 3,75 fois moins élevé que le 5.4-mini.

Ce n'est pas un simple "modèle au rabais". Les benchmarks publiés par OpenAI montrent que le nano atteint 92,5 % en invocation d'outils (τ2-Bench), frôlant les 93,4 % du mini. Pour les questions-réponses générales (GPQA Diamond), il obtient 82,8 %, soit seulement 5,2 points de moins que le mini. Pour une multitude de scénarios à "haut débit et faible complexité", le nano est la solution optimale.

Valeur ajoutée : Cet article explore 7 cas d'usage concrets, explique où le nano est "suffisant et plus économique", quand le mini est indispensable, et fournit des extraits de code ainsi que des estimations de coûts pour chaque scénario.

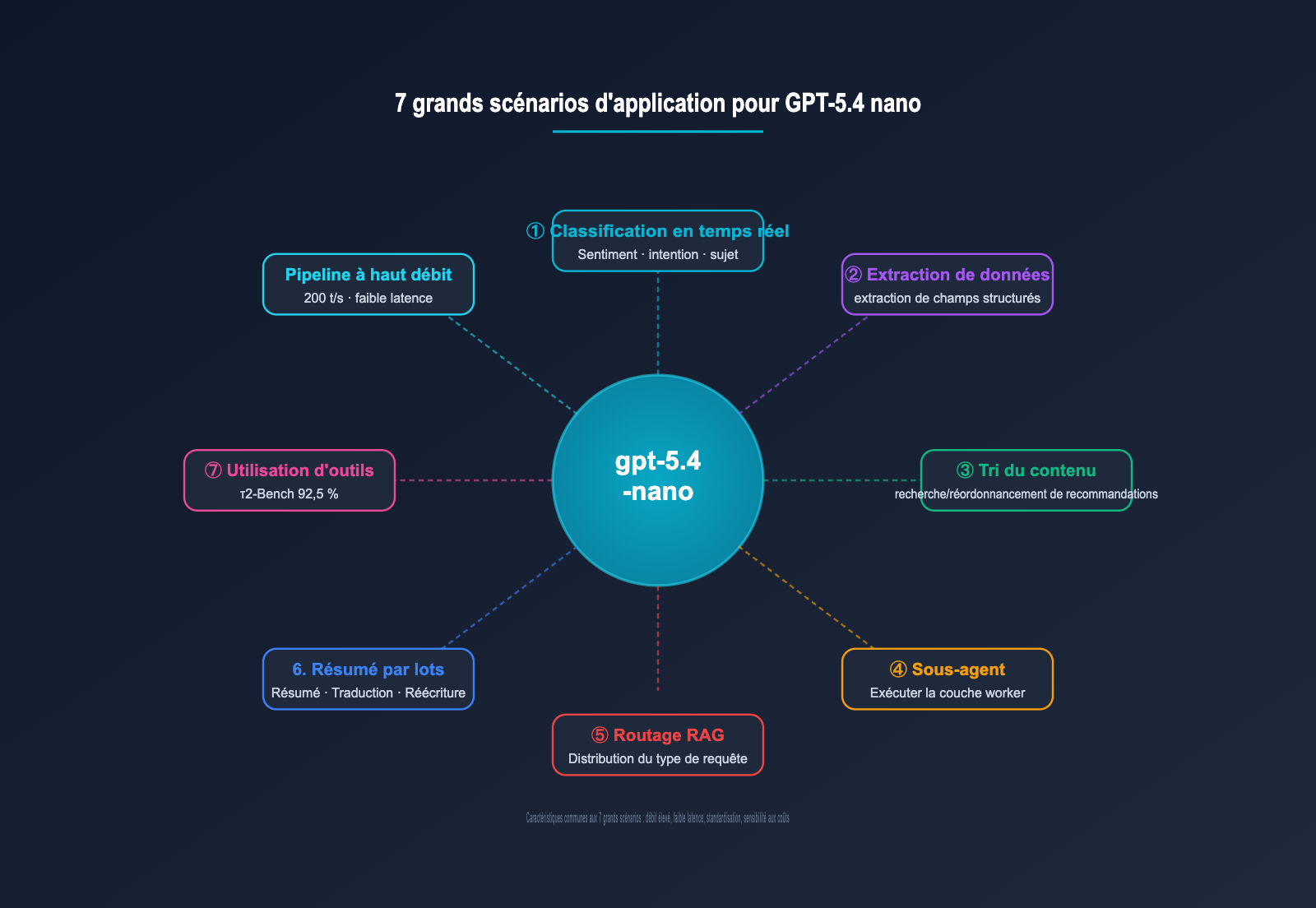

Points clés des cas d'usage de GPT-5.4 nano

| Point clé | Description | Valeur |

|---|---|---|

| Prix ultra-bas | $0,20 / $1,25 par 1M de jetons | 3,75x moins cher que le 5.4-mini |

| Cache -90 % | Entrée en cache à $0,02 / 1M | Quasi gratuit pour les contextes fréquents |

| Invocation d'outils | τ2-Bench 92,5 % vs mini 93,4 % | Suffisant pour la plupart des outils |

| Q&A performant | GPQA Diamond 82,8 % | Adapté aux FAQ et recherche de connaissances |

| Contexte 400K | 400K en entrée + 128K en sortie | Idéal pour le traitement de longs documents |

| Vitesse de pointe | ~200 t/s, 10 % plus rapide que le mini | Premier choix pour les pipelines à haut débit |

Comment déterminer le "seuil de suffisance" du GPT-5.4 nano

Pour savoir si le nano est suffisant, utilisez cette simple "règle des trois zones" :

Zone verte (utilisez le nano en toute confiance) : Invocation d'outils, extraction structurée, classification, Q&A, routage de contenu, traduction/résumé par lots — pour ces tâches, l'écart de performance avec le mini est inférieur à 10 points, rendant l'avantage tarifaire écrasant.

Zone jaune (évaluez avec prudence) : Raisonnement complexe en plusieurs étapes, orchestration d'agents à longue chaîne, génération de code — le score de 52,4 % au SWE-Bench Pro reste compétent, mais nous recommandons un test A/B avant de valider.

Zone rouge (utilisez le mini) : Computer Use (le nano plafonne à 39 % sur OSWorld), tâches longues dans le terminal (46,3 %), ou scénarios personnalisés nécessitant un fine-tuning — ici, le nano montre ses limites, privilégiez le mini ou la version standard.

Cas d'utilisation 1 du GPT-5.4 nano : Classification en temps réel

Description du scénario

La classification en temps réel est l'application la plus classique du modèle nano, incluant l'analyse de sentiment, la reconnaissance d'intention, l'étiquetage de sujets, le marquage pour la modération de contenu, etc. Pour ce type de tâche, chaque invocation du modèle ne nécessite généralement que quelques centaines de jetons en entrée et quelques dizaines en sortie, ce qui rend le système extrêmement sensible à la latence et aux coûts.

Exemple de code minimaliste

import openai

import json

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

def classify_intent(user_query: str) -> dict:

"""Classer l'intention de la requête utilisateur"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "Vous êtes un classificateur d'intentions. Retournez au format JSON: {intent, confidence, sub_category}"},

{"role": "user", "content": user_query}

],

response_format={"type": "json_object"}

)

return json.loads(response.choices[0].message.content)

# Utilisation

result = classify_intent("Je souhaite annuler ma commande de la semaine dernière")

# {"intent": "refund_request", "confidence": 0.95, "sub_category": "subscription_cancel"}

Estimation des coûts

| Échelle du scénario | Coût par requête | Coût journalier (100 000 requêtes) |

|---|---|---|

| Service client débutant(50 entrée + 20 sortie) | $0.000035 | $3.5 |

| SaaS de taille moyenne(200 entrée + 30 sortie) | $0.000078 | $7.8 |

| Niveau entreprise(500 entrée + 50 sortie) | $0.000163 | $16.3 |

💡 Conseil d'optimisation : Placez vos étiquettes de classification et vos exemples dans l'invite système (system prompt). Une fois la mise en cache activée, le coût d'entrée peut être réduit de 90 %. Lors d'une invocation du modèle via le service proxy API APIYI (apiyi.com), les remises sur la mise en cache sont entièrement synchronisées.

Cas d'utilisation 2 du GPT-5.4 nano : Extraction de données

Description du scénario

Extraire des champs structurés à partir de textes non structurés (CV, contrats, actualités, e-mails). C'est l'un des points forts du modèle nano : combiné avec les Structured Outputs (contraintes strictes via JSON Schema), il permet d'atteindre un taux de précision de format supérieur à 99 %.

Code pratique

from pydantic import BaseModel

from typing import Optional

class ContactInfo(BaseModel):

name: str

email: Optional[str]

phone: Optional[str]

company: Optional[str]

role: Optional[str]

def extract_contact(text: str) -> ContactInfo:

# Extraction des informations de contact, retourner null pour les champs manquants

response = client.beta.chat.completions.parse(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": "Extraire les informations de contact, retourner null pour les champs manquants"},

{"role": "user", "content": text}

],

response_format=ContactInfo

)

return response.choices[0].message.parsed

Liste des tâches d'extraction adaptées au modèle nano

- Extraction de champs clés de CV

- Reconnaissance numérique de factures/reçus

- Analyse de blocs de signature d'e-mail

- Reconnaissance d'entités nommées dans l'actualité (noms de personnes, lieux, organisations)

- Normalisation de données de formulaires

- Classification d'événements de journaux (logs)

Cas d'utilisation 3 de GPT-5.4 nano : Classement de contenu

Description du scénario

Réorganiser les résultats de recherche, les listes de recommandations ou les files d'attente de messages. Le faible coût de la version nano rend l'utilisation d'un Grand modèle de langage comme "reranker" (outil de réordonnancement) économiquement viable en production.

Exemple de code pour le réordonnancement

def rerank_documents(query: str, candidates: list[str], top_k: int = 5) -> list:

"""Réordonne les documents candidats en fonction de la pertinence par rapport à la requête"""

docs_text = "\n".join([f"[{i}] {doc[:300]}" for i, doc in enumerate(candidates)])

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{

"role": "user",

"content": f"""Classez les documents suivants par pertinence en fonction de la requête "{query}".

Documents :

{docs_text}

Retournez au format JSON : {{"ranking": [liste des indices des documents, du plus pertinent au moins pertinent]}}"""

}],

response_format={"type": "json_object"}

)

ranking = json.loads(response.choices[0].message.content)["ranking"]

return [candidates[i] for i in ranking[:top_k]]

🎯 Conseil d'utilisation : Le réordonnancement avec nano est plus précis qu'un reranker traditionnel combinant BM25 et recherche vectorielle, tout en coûtant seulement 27 % du prix de GPT-5.4-mini. Vous pouvez y accéder directement via APIYI (apiyi.com), sans aucune demande préalable pour le groupe par défaut.

Cas d'utilisation 4 de GPT-5.4 nano : Couche d'exécution pour Sub-agent

Description du scénario

Dans une architecture multi-agents, l'agent principal (généralement une version mini ou standard) se charge de la planification, tandis que le Sub-agent (l'exécutant) gère les appels d'outils spécifiques, les requêtes de données et les mises à jour d'état. Avec un score de 92,5 % sur τ2-Bench, le modèle nano est parfaitement capable d'assumer ce rôle d'exécutant.

Exemple de collaboration multi-agents

def execute_subtask(task: dict, available_tools: list) -> dict:

"""nano utilisé comme Sub-agent pour exécuter une sous-tâche"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": f"Tu es un exécutant. Outils disponibles : {available_tools}"},

{"role": "user", "content": f"Exécute la tâche : {task['description']}"}

],

tools=task.get("tools", []),

tool_choice="auto"

)

return {

"task_id": task["id"],

"result": response.choices[0].message.content,

"tool_calls": response.choices[0].message.tool_calls

}

# L'agent principal utilise mini, le Sub-agent utilise nano — économie de coûts de plus de 60 %

Cas d'utilisation 5 de GPT-5.4 nano : Couche de routage RAG

Description du scénario

Dans un système RAG, le modèle nano sert de « couche de routage » pour déterminer le type de requête (question technique / conseil avant-vente / retour produit / discussion informelle) et la distribuer aux processeurs appropriés. Cette conception permet de ne solliciter les modèles mini ou standard, plus coûteux, que lorsqu'ils sont réellement nécessaires.

Exemple de routage RAG

def route_query(query: str) -> str:

"""nano détermine le routage de la requête vers le processeur RAG approprié"""

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "system", "content": """Renvoie une étiquette de routage selon le type de requête :

- "technical_docs": recherche dans la documentation technique

- "product_faq": FAQ produit

- "code_help": aide au code

- "small_talk": discussion informelle (pas besoin de RAG)

- "complex_reasoning": raisonnement complexe (transférer vers le modèle mini/standard)"""},

{"role": "user", "content": query}

],

max_tokens=20

)

return response.choices[0].message.content.strip()

route = route_query(user_input)

if route == "complex_reasoning":

final_model = "gpt-5.4-mini" # Passage au modèle mini

else:

final_model = "gpt-5.4-nano" # Utilisation continue de nano

💰 Optimisation des coûts : Cette architecture combinant « routage nano + traitement mini/standard » permet généralement de réduire les coûts d'invocation globaux de 60 à 80 %. Vous pouvez basculer facilement entre les deux modèles avec la même clé API via APIYI (apiyi.com) en modifiant simplement le paramètre

model.

Cas d'utilisation 6 de GPT-5.4 nano : Résumé et traduction à haut débit

Description du scénario

Gestion du traitement par lots pour des tâches telles que le résumé d'actualités, la traduction de documents ou la réécriture de commentaires. Grâce à sa fenêtre de contexte de 400 000 jetons, nano peut traiter un document entier en une seule fois, pour un coût unitaire quasi négligeable.

Exemple d'API Batch

# Préparation des tâches par lots

batch_requests = []

for doc_id, content in documents.items():

batch_requests.append({

"custom_id": f"summary-{doc_id}",

"method": "POST",

"url": "/v1/chat/completions",

"body": {

"model": "gpt-5.4-nano",

"messages": [

{"role": "system", "content": "Résume le contenu suivant en 100 mots"},

{"role": "user", "content": content}

],

"max_tokens": 200

}

})

# Soumission via l'API Batch (même prix, mais n'utilise pas le quota en ligne)

batch = client.batches.create(

input_file_id=file_id,

endpoint="/v1/chat/completions",

completion_window="24h"

)

GPT-5.4 nano Cas d'utilisation 7 : Appel d'outils (Tool Use)

Description du scénario

Sur le benchmark τ2-Bench, le modèle nano atteint 92,5 %, égalant presque les 93,4 % du modèle mini. Pour les scénarios standard d'appel de fonction (function calling) tels que "consulter la météo, vérifier une commande ou parcourir des documents", le modèle nano est parfaitement compétent.

Exemple d'appel de fonction (Function Calling)

tools = [{

"type": "function",

"function": {

"name": "get_order_status",

"description": "Consulter le statut d'une commande",

"parameters": {

"type": "object",

"properties": {

"order_id": {"type": "string"}

},

"required": ["order_id"]

}

}

}]

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[{"role": "user", "content": "Quel est le statut de ma commande #12345 ?"}],

tools=tools,

tool_choice="auto"

)

# nano identifie précisément le besoin d'appeler get_order_status et extrait order_id="12345"

Détails tarifaires du GPT-5.4 nano

Structure tarifaire officielle

| Type de facturation | Prix (par 1M de jetons) | Remarques |

|---|---|---|

| Entrée | 0,20 $ | Tarif standard |

| Entrée en cache | 0,02 $ | 90 % de réduction |

| Sortie | 1,25 $ | Inclut les jetons de raisonnement |

| Batch API | 0,20 $ / 1,25 $ | Même prix, n'utilise pas le quota en ligne |

| Résidence des données | +10 % | Scénarios de conformité des données |

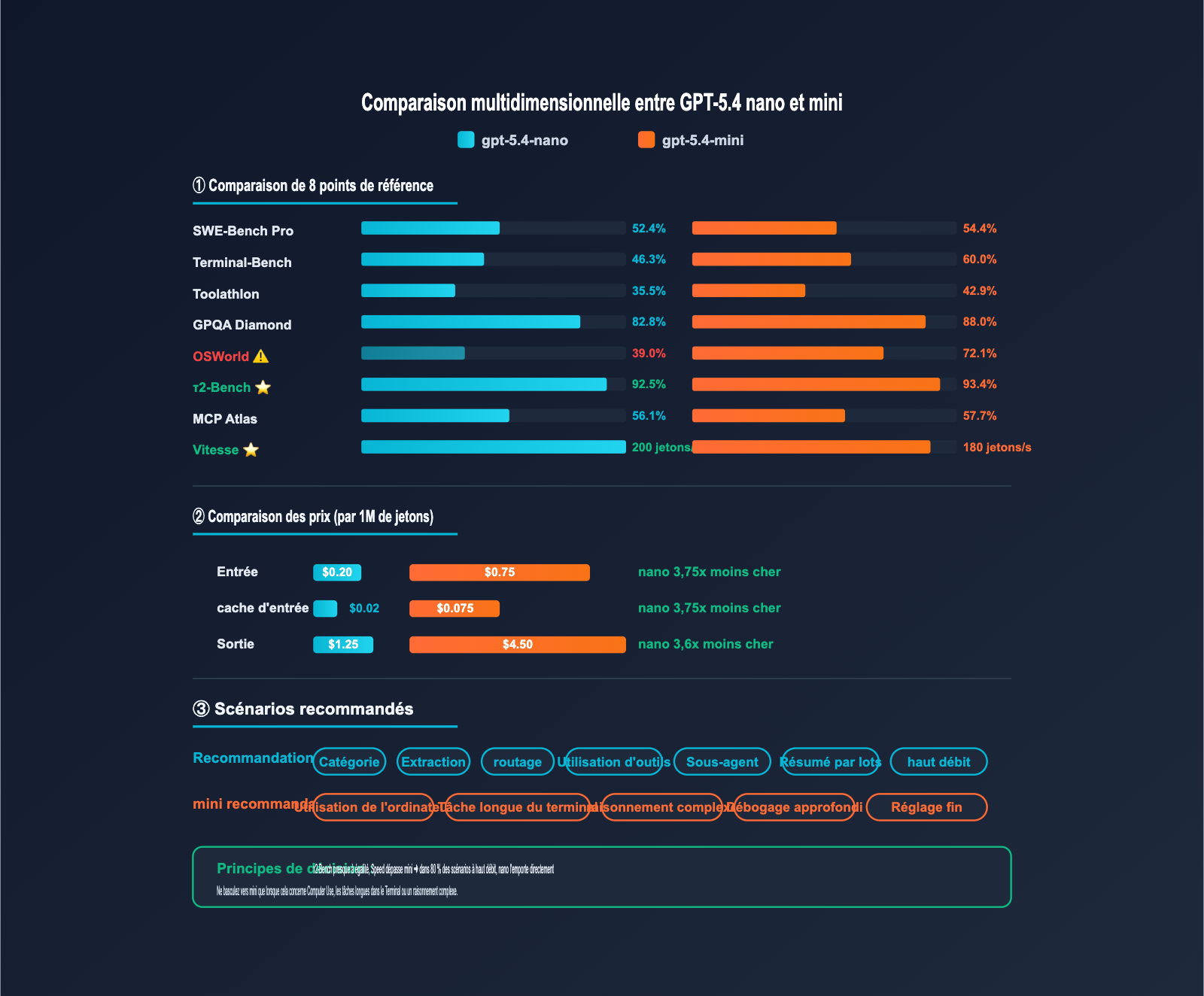

Comparaison des prix : nano vs mini

| Dimension | gpt-5.4-nano | gpt-5.4-mini | Ratio |

|---|---|---|---|

| Entrée | 0,20 $ | 0,75 $ | nano est 3,75x moins cher |

| Entrée en cache | 0,02 $ | 0,075 $ | nano est 3,75x moins cher |

| Sortie | 1,25 $ | 4,50 $ | nano est 3,6x moins cher |

| Vitesse de réponse | ~200 t/s | ~180 t/s | nano est ~10 % plus rapide |

| Contexte | 400K | 400K | Égalité |

| Sortie max | 128K | 128K | Égalité |

💰 Optimisation des coûts : Pour les scénarios à haut débit dépassant le million de requêtes par jour, l'écart de prix entre nano et mini peut représenter des milliers de dollars par mois. En passant par APIYI (apiyi.com), vous bénéficiez en plus de 10 % offerts pour tout rechargement de 100 $, ce qui équivaut à une remise de 15 % sur les tarifs officiels, pour une réduction totale pouvant atteindre 25 % par rapport au site officiel.

Comparaison complète : GPT-5.4 nano vs mini

| Dimension d'évaluation | gpt-5.4-nano | gpt-5.4-mini | Écart | nano est-il suffisant ? |

|---|---|---|---|---|

| SWE-Bench Pro | 52,4 % | 54,4 % | -2,0 pp | ✅ Presque identique |

| Terminal-Bench 2.0 | 46,3 % | 60,0 % | -13,7 pp | ⚠️ Utilisez mini pour les tâches longues |

| Toolathlon | 35,5 % | 42,9 % | -7,4 pp | ✅ Suffisant pour les tâches courantes |

| GPQA Diamond | 82,8 % | 88,0 % | -5,2 pp | ✅ Compétent pour les questions de connaissances |

| OSWorld-Verified | 39,0 % | 72,1 % | -33,1 pp | ❌ Utilisez mini pour le Computer Use |

| τ2-Bench (Tool Use) | 92,5 % | 93,4 % | -0,9 pp | ✅ Presque identique |

| MCP Atlas | 56,1 % | 57,7 % | -1,6 pp | ✅ Presque identique |

| Vitesse de réponse | ~200 t/s | ~180 t/s | +10 % | ✅ nano est plus rapide |

Conseils pour le choix du modèle

Privilégiez le modèle nano si :

- La tâche appartient à la "zone verte" (classification, extraction, tri, routage, utilisation d'outils, traitement par lots)

- Le volume d'appels est > 10 000/jour et vous êtes sensible aux coûts

- Vous avez besoin d'une latence de réponse inférieure à 1 seconde

- Il s'agit d'une couche d'exécution de sous-agents (agent principal en mini, agents travailleurs en nano)

Passez au modèle mini si :

- Vous utilisez le Computer Use (écart décisif sur OSWorld)

- Vous effectuez des tâches longues dans le terminal (> 10 étapes)

- Vous avez besoin d'un raisonnement complexe en plusieurs étapes ou d'un débogage de code approfondi

- La qualité de la tâche est plus importante que le coût

📊 Conseil d'arbitrage : Pour 80 % des scénarios à "haut débit et faible complexité", le rapport coût-efficacité du nano surpasse celui du mini. Vous pouvez comparer directement les performances des deux modèles sur vos tâches spécifiques via APIYI (apiyi.com) en modifiant simplement le paramètre

model.

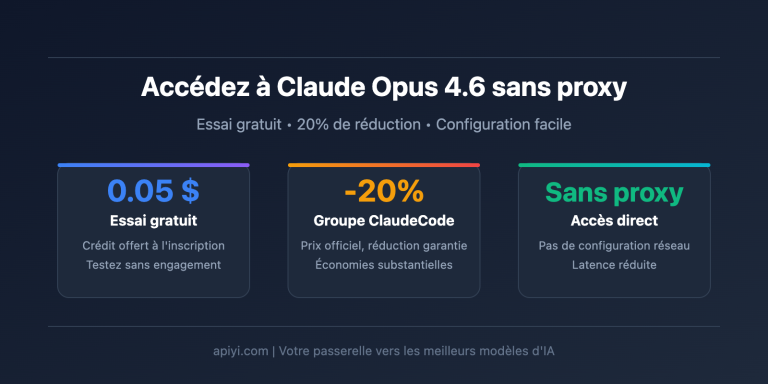

Instructions pour l'intégration de GPT-5.4 nano sur APIYI

Accès direct via le groupe Default

La plateforme APIYI applique la même stratégie d'ouverture pour GPT-5.4 nano et 5.4-mini :

- ✅ Groupe Default par défaut : Entièrement ouvert, disponible dès l'inscription pour les nouveaux utilisateurs.

- ✅ Groupe SVIP Premium : Entièrement ouvert, sans aucune restriction.

- ✅ Synchronisation des remises sur cache : Le tarif de 0,02 $ / 1M de tokens est pleinement applicable.

- ✅ Synchronisation Batch API : Les tâches par lots bénéficient du même tarif.

Comparaison des coûts : APIYI vs Site officiel

| Projet | Site officiel OpenAI | APIYI apiyi.com |

|---|---|---|

| Prix de base | 0,20 $ / 1,25 $ par 1M | 0,20 $ / 1,25 $ par 1M (même prix) |

| Remise sur cache | 0,02 $ / 1M (90 %) | 0,02 $ / 1M (synchronisation totale) |

| Bonus de recharge | Aucun | 100 $ rechargés = 10 $ offerts (10 %) |

| Coût réel | 100 % prix standard | Env. 90 % du prix standard (env. 15 % de remise) |

| Accès en Chine | VPN requis | Connexion directe, sans VPN |

| Méthodes de paiement | Carte bancaire internationale | Support RMB, Alipay, WeChat |

| Compatibilité SDK | Natif OpenAI | Entièrement compatible avec le SDK OpenAI |

| Recharge minimale | 5 $ | À partir de 1 $ |

💰 Optimisation des coûts : Pour les applications dépassant le million d'appels par mois, l'intégration de nano via APIYI apiyi.com permet de cumuler la remise sur cache avec les 15 % de réduction, offrant un coût global 25 à 35 % inférieur à un appel direct via le site officiel d'OpenAI.

Foire aux questions (FAQ)

Q1 : Qu’est-ce que gpt-5.4-nano ? Quelle est la différence principale avec gpt-5.4-mini ?

GPT-5.4-nano est le modèle léger le plus abordable et le plus rapide de la série OpenAI GPT-5.4 (0,20 $ / 1,25 $ par 1M de tokens), avec une vitesse de réponse d'environ 200 t/s. Différences clés avec le 5.4-mini : 1) Prix 3,6 à 3,75 fois moins élevé ; 2) Performances en Computer Use (OSWorld 39 % contre 72,1 %) et tâches longues dans le terminal (46,3 % contre 60 %) nettement plus faibles ; 3) Dans les autres scénarios (classification, extraction, utilisation d'outils, questions-réponses), l'écart est généralement inférieur à 10 points de pourcentage.

Q2 : À quels cas d’usage le modèle nano est-il le mieux adapté ? Lesquels nécessitent impérativement le mini ?

Adapté pour nano (zone verte) :

- Classification en temps réel (sentiment, intention, sujet)

- Extraction de données structurées

- Tri et réordonnancement de contenu

- Couche d'exécution de sous-agents

- Couche de routage RAG

- Résumé/traduction à haut débit

- Appel d'outils standardisés (τ2-Bench 92,5 %)

Scénarios nécessitant impérativement le mini (zone rouge) :

- Automatisation de bureau "Computer Use" (écart de 33 points sur OSWorld)

- Tâches longues dans le terminal (> 10 étapes)

- Raisonnement complexe en plusieurs étapes

- Scénarios nécessitant un Fine-tuning personnalisé

Q3 : Pourquoi le modèle nano n’est-il pas recommandé pour le « Computer Use » ?

Lors des tests OSWorld-Verified, le modèle nano n'a obtenu que 39,0 %, un score bien inférieur aux 72,1 % du mini. Cela signifie que le taux d'échec du nano est trop élevé pour les opérations de bureau en plusieurs étapes (ouvrir le navigateur → rechercher → cliquer → remplir un formulaire), l'empêchant de terminer la chaîne de tâches de manière stable. Si votre scénario nécessite le "Computer Use", choisissez directement le modèle mini ou la version standard 5.4.

Q4 : Comment activer la remise sur cache de 0,02 $/1M pour le modèle nano ?

Le mécanisme de cache d'OpenAI est automatique, aucun paramètre supplémentaire n'est requis. Lorsque le préfixe de l'invite (généralement le system prompt + le contexte partagé) est identique aux requêtes des 5 à 10 dernières minutes, le cache est automatiquement utilisé, bénéficiant d'une remise de 90 %.

Conseils d'optimisation :

- Placez le system prompt au tout début du tableau "messages".

- Faites suivre immédiatement par le contexte partagé (étiquettes de classification, définition de schéma).

- Placez la requête réelle de l'utilisateur à la fin.

- Maintenez une fréquence d'appel régulière (> 5 minutes, le cache expire).

Lors d'un appel via APIYI apiyi.com, la remise sur cache est parfaitement synchronisée avec celle du site officiel.

Q5 : Quelles sont les meilleures pratiques pour traiter des tâches par lots avec le modèle nano ?

Trois stratégies clés :

- Utiliser Batch API : Soumettez vos tâches par lots via l'interface

/v1/batches. Elles sont traitées sous 24 heures au même prix, sans consommer votre quota RPM en ligne. - Partager le system prompt : Utilisez les mêmes instructions pour toutes les tâches afin de déclencher la mise en cache.

- Définir un max_tokens raisonnable : Bien que la sortie du nano soit peu coûteuse, le cumul représente un coût ; fixez une limite raisonnable entre 50 et 500 tokens selon la tâche.

En soumettant des tâches Batch via APIYI apiyi.com, vous bénéficiez du bonus de 10 % sur la recharge, portant le coût réel à environ 85 % du tarif officiel.

Q6 : Comment appeler GPT-5.4 nano via APIYI ?

APIYI est entièrement compatible avec le SDK OpenAI, il suffit de trois étapes :

- Visitez APIYI apiyi.com pour créer un compte (aucune demande nécessaire, le groupe Default est directement disponible).

- Obtenez votre clé API.

- Modifiez l'URL de base (

base_url) dans votre code parhttps://vip.apiyi.com/v1et définissez le modèle surgpt-5.4-nano.

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[...]

)

Une recharge de 100 $ vous offre 10 $ supplémentaires, soit environ 15 % de remise par rapport au site officiel, avec synchronisation des remises sur cache.

Q7 : Quand le modèle nano est-il plus rentable que le mini ? Comment calculer cela ?

Formule de décision :

Condition de rentabilité nano = (Tolérance à la baisse de qualité) × (Volume d'appels) × (Différence de prix)

> (Gain de qualité apporté par le passage au mini)

Scénarios réels :

- Volume > 10K/jour : économie > 30 $/jour (1 000 $/mois)

- Volume > 100K/jour : économie > 300 $/jour (9 000 $/mois)

- Volume > 1M/jour : économie > 3 000 $/jour (90 000 $/mois)

Pour les tâches en zone verte (classification, extraction, utilisation d'outils), la perte de qualité du nano est généralement < 5 %, mais l'économie de coût est de 73 % (calcul pur sur un facteur de 3,6x). Le ROI global est presque toujours en faveur du nano.

Q8 : Quelles sont les limitations connues de GPT-5.4 nano ?

Limitations principales :

- Pas de support du "Computer Use" : Score OSWorld de 39 % trop bas, incapable d'automatiser le bureau de manière stable.

- Pas de support du Fine-tuning : Impossible d'affiner avec des jeux de données personnalisés.

- Pas de support d'entrée audio/vidéo : Uniquement texte + image.

- Tâches longues dans le terminal faibles : Terminal-Bench à 46,3 %, échec fréquent au-delà de 10 étapes.

- Capacités de raisonnement complexe limitées : GPQA à 82,8 % proche du mini, mais baisse significative sur des tâches très difficiles comme FrontierMath.

Solution alternative : En cas de blocage, basculez directement sur gpt-5.4-mini ou la version standard 5.4.

Points clés des scénarios d'application de GPT-5.4 nano

- Prix plancher : 0,20 $ / 1,25 $ par million de jetons, soit 3,6 à 3,75 fois moins cher que le 5.4-mini.

- Réduction de 90 % sur le cache : Entrée à partir de 0,02 $ / 1M, rendant les scénarios à contexte haute fréquence presque gratuits.

- 7 scénarios en zone verte : Classification, extraction, tri, sous-agent, routage, traitement par lots et utilisation d'outils (Tool Use).

- τ2-Bench 92,5 % : L'invocation d'outils est presque au niveau du mini ; suffisant pour plus de 90 % des scénarios d'appel de fonction (Function Calling).

- GPQA 82,8 % : Excellente capacité de réponse aux questions de connaissances générales, idéal pour les FAQ et la modération de contenu.

- Vitesse de 200 t/s : 10 % plus rapide que le mini, le choix privilégié pour les pipelines à haut débit.

- Alerte zone rouge : Pour l'utilisation de l'ordinateur (Computer Use) et les tâches longues dans le terminal, il est impératif de passer au modèle mini.

Résumé

Voici les points essentiels concernant les scénarios d'application de GPT-5.4 nano :

- Positionnement des scénarios : Le nano est le choix optimal pour les tâches à haut débit et à faible complexité. La classification en temps réel, l'extraction de données, les sous-agents, le routage RAG et le traitement par lots sont ses domaines de prédilection.

- Limites des capacités : Bien que ses performances sur τ2-Bench, GPQA et SWE-Bench Pro soient presque équivalentes à celles du mini, ses capacités pour l'utilisation de l'ordinateur (Computer Use) ou les tâches longues dans le terminal sont nettement plus limitées.

- Accès : Appelez-le directement via le groupe par défaut sur APIYI (apiyi.com). Les réductions sur le cache sont synchronisées et vous bénéficiez de 10 % offerts pour toute recharge de 100 $.

GPT-5.4 nano n'est pas un produit bas de gamme "capable de tout faire sans rien maîtriser", mais une arme légère optimisée par OpenAI pour les scénarios à haut débit et faible complexité. Si votre application correspond aux 7 scénarios en zone verte listés ici, le nano est presque toujours plus rentable que le mini. Toutefois, dès qu'il s'agit d'utilisation d'ordinateur ou de tâches terminales complexes, basculer vers le mini reste la décision la plus judicieuse.

Nous vous recommandons d'accéder rapidement à GPT-5.4 nano via la plateforme APIYI (apiyi.com) : le groupe par défaut ne nécessite aucune demande, les réductions de cache sont entièrement synchronisées, vous profitez d'un bonus de 10 % sur vos recharges et la connexion depuis la Chine est stable et directe.

延伸阅读 Related Articles

Si le GPT-5.4 nano API vous intéresse, nous vous recommandons de poursuivre votre lecture avec ces articles :

- 📘 Guide de mise à niveau de l'API GPT-5.4 mini – Découvrez les capacités et les cas d'usage du modèle mini de la gamme précédente.

- 📊 Analyse approfondie du mécanisme de mise en cache d'OpenAI : bonnes pratiques pour obtenir 90 % de réduction – Maîtrisez les techniques d'ingénierie pour optimiser la mise en cache.

- 🚀 Mise en pratique : construire une couche de routage RAG basée sur GPT-5.4 nano – Explorez l'architecture hybride « routage nano + traitement mini ».

📚 Références

-

Documentation officielle OpenAI GPT-5.4 nano : spécifications du modèle, tarification, exemples d'invocation

- Lien :

developers.openai.com/api/docs/models/gpt-5.4-nano - Description : Accédez aux paramètres techniques officiels les plus récents et les plus fiables.

- Lien :

-

Analyse comparative AI Cost Check Benchmark : évaluation multidimensionnelle nano vs mini

- Lien :

aicostcheck.com/blog/gpt-5-4-mini-nano-pricing-benchmarks - Description : Évaluation par un tiers, idéale pour comparer les différences de capacités.

- Lien :

-

Documentation d'accès APIYI pour GPT-5.4 nano : solutions d'invocation en Chine, explications sur le groupement, offres de recharge

- Lien :

docs.apiyi.com - Description : Guide pratique pour les développeurs souhaitant intégrer le modèle.

- Lien :

-

Page de tarification OpenAI : tableau complet des prix et explications sur le mécanisme de mise en cache

- Lien :

developers.openai.com/api/docs/pricing - Description : Normes de facturation les plus récentes pour tous les modèles.

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : N'hésitez pas à discuter de vos expériences avec GPT-5.4 nano dans la section commentaires. Pour plus de ressources sur l'intégration des modèles, consultez le centre de documentation APIYI sur docs.apiyi.com.