Note de l'auteur : le modèle seed-2-0-mini-260215 est le tout dernier modèle de la plateforme BytePlus et le pionnier de la série Seed 2.0, en attendant la sortie prochaine de Seed 2.0 Pro et Seed 2.0 Lite. Actuellement, Seed 2.0 Mini est déjà disponible sur APIYI au même prix que sur le site officiel. Pour toute recharge de 100 $, vous bénéficiez d'un bonus de 10 % minimum, ce qui peut représenter jusqu'à 20 % de réduction !

À propos de la série Seed, contexte de développement : comment déployer un modèle d'IA doté de capacités de compréhension et de raisonnement multimodaux dans un environnement de production à haute concurrence et faible latence, tout en maintenant les coûts d'inférence à un niveau extrêmement bas ? C'est le défi majeur auquel sont confrontés de nombreux développeurs en entreprise. Cet article détaille la méthode complète d'invocation de l'API pour le Seed 2.0 Mini (seed-2-0-mini-260215), afin de vous aider à maîtriser rapidement ce petit modèle haute performance optimisé pour les scénarios sensibles aux coûts.

Valeur ajoutée : À la fin de cet article, vous saurez configurer les 4 modes de raisonnement de Seed 2.0 Mini, exploiter sa fenêtre de contexte de 256K pour des tâches complexes et mettre en œuvre la solution au meilleur rapport qualité-prix pour vos projets réels.

Points clés de l'API Seed 2.0 Mini

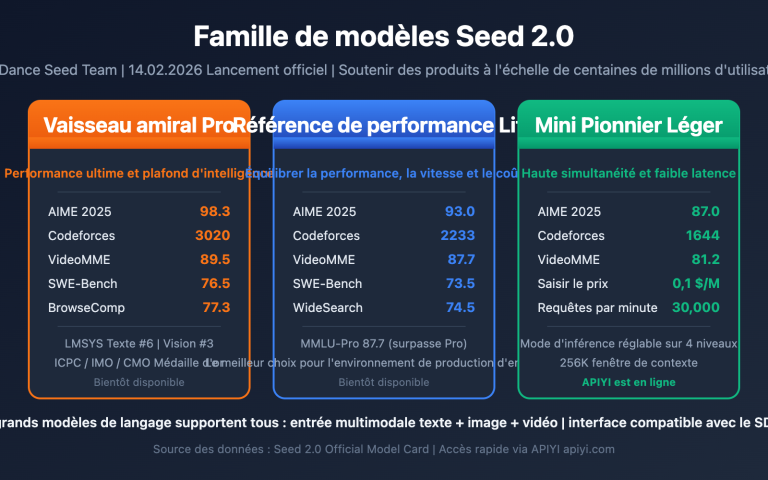

ByteDance a officiellement lancé la série de modèles Seed 2.0 le 14 février 2026, comprenant quatre variantes : Pro, Lite, Mini et Code. Parmi elles, Seed 2.0 Mini (ID du modèle : seed-2-0-mini-260215) est spécifiquement conçu pour les applications à faible latence, haute concurrence et sensibles aux coûts. C'est le membre le plus efficace de la famille Seed 2.0 en termes d'inférence.

| Points clés | Description | Avantages pour le développeur |

|---|---|---|

| 4 modes de raisonnement | Réglable sur minimal / low / medium / hi | Choisir la profondeur de raisonnement selon les besoins, contrôle précis des coûts |

| Fenêtre de contexte de 256K | Supporte les textes ultra-longs et les dialogues multi-tours | Traitement de documents longs, analyse de bases de code et autres scénarios complexes |

| Compréhension multimodale | Supporte l'analyse d'images, de vidéos et de documents | Un seul modèle pour couvrir les tâches textuelles et visuelles |

| Rapport qualité-prix extrême | Le mode non-réflexion ne consomme qu'environ 1/10 des tokens du mode réflexion | Réduction massive des coûts pour les tâches simples à haute fréquence |

| Stabilité de niveau entreprise | Réduction d'environ 40 % des modes anormaux par rapport à la génération précédente | Fiabilité considérablement accrue pour les scénarios ToB |

Détails des modes de raisonnement de Seed 2.0 Mini

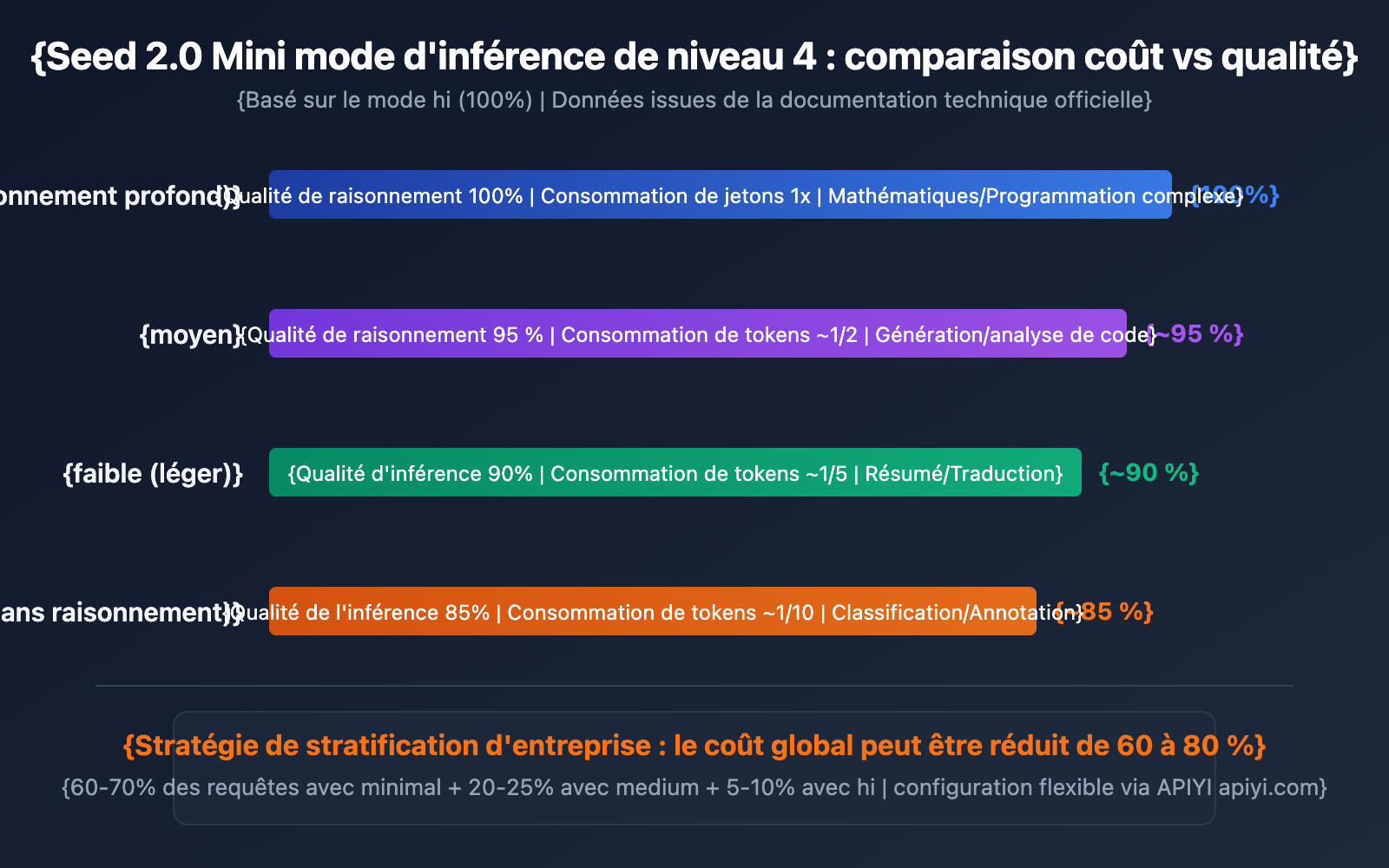

La caractéristique la plus marquante de Seed 2.0 Mini est son système de raisonnement réglable sur quatre niveaux via reasoning_effort. Les développeurs peuvent choisir la profondeur de raisonnement en fonction de la complexité de la tâche :

- minimal (sans raisonnement) : Ignore complètement le raisonnement par chaîne de pensée (CoT) et produit directement le résultat. Idéal pour l'étiquetage de classification, la conversion de format, le remplissage de modèles et autres tâches standardisées. Vitesse de réponse maximale, consommation de tokens minimale.

- low (raisonnement léger) : Effectue des déductions logiques simples. Adapté à l'extraction d'informations, aux questions-réponses simples, aux résumés de contenu et autres tâches de complexité moyenne.

- medium (raisonnement modéré) : Exécute un processus de raisonnement plus complet. Convient à la génération de code, à l'analyse de données, aux rapports commerciaux et autres tâches nécessitant une certaine profondeur logique.

- hi (raisonnement profond) : Active le raisonnement par chaîne de pensée complet, avec une performance proche de la pleine charge. Idéal pour les démonstrations mathématiques, la programmation complexe, le raisonnement multi-étapes et autres tâches de haute difficulté.

En mode minimal, la performance globale de Seed 2.0 Mini atteint environ 85 % de celle du mode réflexion, mais pour seulement environ 1/10 de la consommation de tokens. Cela signifie que dans les scénarios simples à haute fréquence, vous bénéficiez d'une efficacité économique exceptionnelle.

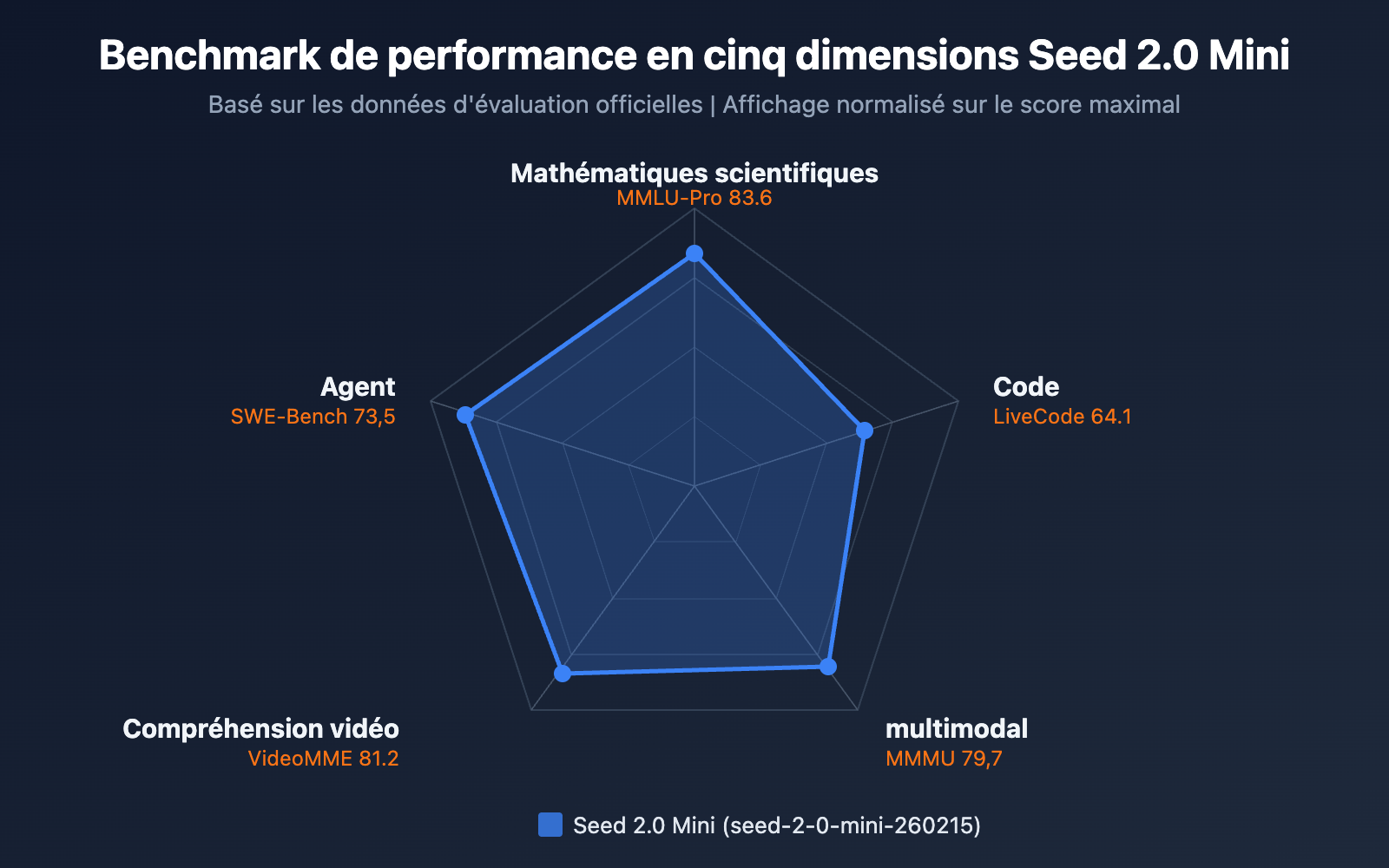

Benchmark de performance de l'API Seed 2.0 Mini

Bien que Seed 2.0 Mini soit la variante la plus légère de la gamme Seed 2.0, il affiche des performances impressionnantes dans plusieurs benchmarks, surpassant largement le petit modèle Seed 1.6 Flash de la génération précédente.

| Dimension d'évaluation | Élément d'évaluation | Seed 2.0 Mini | Seed 2.0 Pro | Description |

|---|---|---|---|---|

| Sciences et Mathématiques | MMLU-Pro | 83.6 | — | Benchmark de compréhension des connaissances |

| Sciences et Mathématiques | AIME 2025 | 87 | 98.3 | Raisonnement mathématique de compétition |

| Sciences et Mathématiques | MathVision | 78.1 | — | Raisonnement mathématique visuel |

| Capacités de codage | Codeforces | 1644 | 3020 | Classement en programmation compétitive |

| Capacités de codage | LiveCodeBench | 64.1 | — | Évaluation de programmation en temps réel |

| Multimodal | MathVista | 85.5 | — | Raisonnement mathématique visuel |

| Multimodal | MMMU | 79.7 | — | Compréhension multimodale |

| Compréhension vidéo | VideoMME | 81.2 | 89.5 | Analyse de contenu vidéo |

| Agent | SWE Bench | 73.5 | — | Tâches de génie logiciel |

| Agent | BrowseComp | 72.1 | — | Compréhension de la navigation web |

Comme le montrent les données de référence, Seed 2.0 Mini maintient l'efficacité d'inférence d'un petit modèle tout en affichant des indicateurs de capacités clés très proches de la version Pro. Particulièrement pour les tâches d'Agent (SWE Bench 73.5, BrowseComp 72.1) et la compréhension multimodale (MMMU 79.7), il est déjà pleinement capable de répondre aux besoins des applications d'entreprise.

🎯 Conseil technique : Lors du choix de votre variante Seed 2.0, le modèle Mini est l'option idéale pour le traitement par lots à haute fréquence. Nous vous suggérons d'effectuer des tests réels via la plateforme APIYI (apiyi.com) afin de comparer la latence et la qualité selon les différents modes d'inférence, et ainsi trouver la configuration la plus adaptée à vos besoins métier.

Prise en main rapide de l'API Seed 2.0 Mini

Exemple d'appel minimaliste

L'API Seed 2.0 Mini est compatible avec les spécifications de l'interface SDK d'OpenAI, ce qui rend son intégration extrêmement simple. Voici le code d'appel de base :

import openai

client = openai.OpenAI(

api_key="VOTRE_CLÉ_API",

base_url="https://api.apiyi.com/v1" # Utilisation de l'interface unifiée APIYI

)

# Dialogue textuel de base - Utilisation du mode de raisonnement 'minimal' pour une réponse ultra-rapide

response = client.chat.completions.create(

model="seed-2-0-mini-260215",

messages=[

{"role": "user", "content": "Résume en une phrase le principe fondamental de l'informatique quantique."}

],

extra_body={

"reasoning_effort": "minimal" # Optionnel : minimal / low / medium / hi

}

)

print(response.choices[0].message.content)

🚀 Démarrage rapide : Nous vous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour accéder rapidement à l'API Seed 2.0 Mini. Cette plateforme propose une interface compatible prête à l'emploi, sans configuration complexe. L'intégration se fait en 5 minutes et permet l'invocation unifiée de plusieurs modèles majeurs.

Configuration des 4 niveaux de mode d'inférence de l'API Seed 2.0 Mini

Différents scénarios métier nécessitent différentes profondeurs de raisonnement. L'exemple suivant montre comment basculer de manière flexible entre les modes d'inférence selon le type de tâche :

import openai

client = openai.OpenAI(

api_key="VOTRE_CLÉ_API",

base_url="https://api.apiyi.com/v1" # Interface unifiée APIYI

)

def call_seed_mini(prompt, reasoning_effort="medium", system_prompt=None):

"""Fonction d'appel générique Seed 2.0 Mini, supportant 4 niveaux de raisonnement"""

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

response = client.chat.completions.create(

model="seed-2-0-mini-260215",

messages=messages,

extra_body={"reasoning_effort": reasoning_effort}

)

return response.choices[0].message.content

# Scénario 1 : Classification de contenu - Utilisation du mode 'minimal', réponse ultra-rapide

category = call_seed_mini(

prompt="Classe le texte suivant dans l'une de ces catégories : Technologie / Finance / Sport / Divertissement\nTexte : La nouvelle génération de puces utilise un procédé de gravure en 3nm...",

reasoning_effort="minimal"

)

# Scénario 2 : Résumé de texte - Utilisation du mode 'low', raisonnement léger

summary = call_seed_mini(

prompt="Veuillez résumer les points clés de l'article suivant en 100 mots...",

reasoning_effort="low"

)

# Scénario 3 : Génération de code - Utilisation du mode 'medium', équilibre entre vitesse et qualité

code = call_seed_mini(

prompt="Implémente en Python un cache LRU avec support du temps d'expiration",

reasoning_effort="medium",

system_prompt="Tu es un ingénieur Python senior"

)

# Scénario 4 : Raisonnement complexe - Utilisation du mode 'hi', qualité de raisonnement maximale

analysis = call_seed_mini(

prompt="Analyse les données commerciales suivantes et propose 3 stratégies de croissance viables...",

reasoning_effort="hi"

)

Voir l’exemple complet d’appel multimodal

import openai

import base64

client = openai.OpenAI(

api_key="VOTRE_CLÉ_API",

base_url="https://api.apiyi.com/v1"

)

# Exemple de compréhension d'image - Seed 2.0 Mini supporte le multimodal texte-image

def analyze_image(image_url, question, reasoning_effort="medium"):

"""Utilisation de Seed 2.0 Mini pour l'analyse et la compréhension d'images"""

response = client.chat.completions.create(

model="seed-2-0-mini-260215",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": question},

{"type": "image_url", "image_url": {"url": image_url}}

]

}

],

extra_body={"reasoning_effort": reasoning_effort}

)

return response.choices[0].message.content

# Exemple d'analyse de document

result = analyze_image(

image_url="https://example.com/chart.png",

question="Veuillez analyser les tendances clés des données dans ce graphique",

reasoning_effort="medium"

)

print(result)

# Contrôle de la qualité visuelle par niveaux

# Seed 2.0 Mini propose trois niveaux de qualité visuelle : low / high / xhigh

response = client.chat.completions.create(

model="seed-2-0-mini-260215",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Veuillez décrire en détail toutes les informations contenues dans cette image à texte dense"},

{

"type": "image_url",

"image_url": {

"url": "https://example.com/dense-text.png",

"detail": "xhigh" # Optionnel : low / high / xhigh

}

}

]

}

],

extra_body={"reasoning_effort": "hi"}

)

Guide de sélection du mode d'inférence de l'API Seed 2.0 Mini

Choisir le bon mode d'inférence est essentiel pour tirer le meilleur parti de Seed 2.0 Mini. Voici une comparaison détaillée des différents modes et de leurs scénarios d'utilisation recommandés :

| Mode d'inférence | Consommation de Tokens | Vitesse de réponse | Qualité d'inférence | Scénarios recommandés |

|---|---|---|---|---|

| minimal | Env. 1/10 | Ultra-rapide | Env. 85% | Classification, conversion de format, remplissage de modèles, Q&R simples |

| low | Env. 1/5 | Rapide | Env. 90% | Extraction d'informations, résumé de contenu, tâches de traduction, nettoyage de données |

| medium | Env. 1/2 | Moyenne | Env. 95% | Génération de code, analyse de données, rapports commerciaux, documentation technique |

| hi | 1x (Référence) | Plus lente | 100% | Raisonnement mathématique, programmation complexe, logique multi-étapes, écriture créative |

Stratégie de sélection Seed 2.0 Mini pour les entreprises

Pour les applications professionnelles, nous recommandons d'adopter une stratégie d'appel par paliers afin de maximiser l'efficacité des coûts :

Premier palier — Tâches standardisées à haute fréquence (60-70 % des requêtes) :

Utilisez le mode minimal pour la modération de contenu, la classification de texte, l'analyse de sentiments ou l'extraction de mots-clés. Ces tâches ne nécessitent pas de raisonnement complexe ; la précision de 85 % du mode minimal est largement suffisante, tout en ne consommant qu'un dixième des tokens du mode hi.

Deuxième palier — Tâches de complexité moyenne (20-25 % des requêtes) :

Utilisez les modes low ou medium pour la génération de texte, les résumés de contenu ou la complétion de code simple. Ces tâches exigent une certaine rigueur logique, et le mode medium offre un excellent compromis entre qualité et coût.

Troisième palier — Tâches de haute complexité (5-10 % des requêtes) :

Utilisez le mode hi ou passez à Seed 2.0 Pro pour le raisonnement complexe, les démonstrations mathématiques ou la génération de code à grande échelle.

💰 Optimisation des coûts : Grâce à cette stratégie par paliers, une entreprise peut réduire ses coûts globaux d'inférence de 60 à 80 % tout en maintenant une qualité de service optimale. Nous vous recommandons d'effectuer des tests A/B via la plateforme APIYI (apiyi.com) pour comparer les performances des différents modes sur vos données réelles et trouver votre point d'équilibre idéal.

Comparaison de l'API Seed 2.0 Mini avec la génération précédente

Seed 2.0 Mini apporte des améliorations globales par rapport à Seed 1.6 Flash. Voici les points clés de cette évolution :

| Dimension de comparaison | Seed 2.0 Mini | Seed 1.6 Flash | Ampleur de l'amélioration |

|---|---|---|---|

| Reconnaissance de contenu | Amélioration notable | Référence | Très importante |

| Raisonnement | Dépasse Seed 1.6 Pro | Référence | Supérieur au niveau Pro |

| Capacités de codage | Amélioration nette | Référence | Répond aux besoins métier |

| Capacités d'Agent | Amélioration nette | Référence | Supporte les appels d'outils complexes |

| Modes d'anomalie | Réduction d'env. 40% | Référence | Moins de redondances et d'erreurs |

| Fenêtre de contexte | 256K | — | Support du contexte ultra-long |

| Modes d'inférence | 4 niveaux réglables | — | Nouvelle fonctionnalité |

| Niveaux de qualité visuelle | low / high / xhigh | — | Nouvelle fonctionnalité |

| Multimodal | Image + Vidéo + Document | Support limité | Renforcement complet |

Atouts majeurs de Seed 2.0 Mini pour le secteur B2B

Seed 2.0 Mini a été spécifiquement optimisé pour les applications en entreprise (ToB) :

- Modération d'images : Les capacités de reconnaissance pour les domaines B2B courants (audit d'images, classification, inspection vidéo) sont en nette progression, avec une baisse de 40 % des comportements anormaux.

- Sortie structurée : Le modèle atteint les standards professionnels en matière de compréhension image-texte et de sortie structurée haute fidélité, supportant l'utilisation forcée de JSON Schema.

- Contrôle de la qualité visuelle : Trois options de qualité d'image (low / high / xhigh) permettent d'ajuster le budget ressources. Le mode "high" par défaut améliore la cohérence des prédictions, tandis que le mode supérieur gère parfaitement les textes denses, les graphiques complexes et les scènes riches en détails.

- Traitement par lots : Optimisé pour les scénarios de génération massive à haute fréquence, il excelle dans les tâches de classification par lots, de modération de contenu et de génération légère.

FAQ sur l'API Seed 2.0 Mini

Q1 : Comment choisir le paramètre reasoning_effort pour Seed 2.0 Mini ?

Le principe fondamental pour choisir reasoning_effort est l'« adéquation à la tâche ». Pour les tâches standardisées comme la classification, l'étiquetage ou le formatage, le mode minimal suffit pour obtenir environ 85 % de précision, avec une consommation de tokens divisée par 10. Pour les tâches nécessitant une déduction logique comme la génération de code ou l'analyse de données, il est conseillé d'utiliser medium. Le mode hi n'est nécessaire que pour les scénarios complexes tels que les démonstrations mathématiques ou le raisonnement de haut niveau. Via la plateforme APIYI (apiyi.com), vous pouvez tester rapidement l'impact de ces différents modes pour trouver la configuration optimale.

Q2 : Quels types d’entrées multimodales Seed 2.0 Mini prend-il en charge ?

Seed 2.0 Mini est un modèle multimodal qui prend en charge le texte, l'image et la vidéo. Pour les images, il analyse les formats courants (PNG, JPEG, WebP, etc.) avec trois options de qualité visuelle : low, high et xhigh. Pour la vidéo, il excelle dans la compréhension et l'analyse de contenu avec un score VideoMME atteignant 81,2. Sur la plateforme APIYI (apiyi.com), vous pouvez utiliser une interface unique compatible OpenAI pour effectuer vos invocations du modèle sur toutes ces fonctionnalités multimodales, sans adaptation supplémentaire.

Q3 : Faut-il choisir Seed 2.0 Mini ou Seed 2.0 Pro ?

Leurs positionnements sont complémentaires : Mini se concentre sur les scénarios de traitement par lots à haute concurrence, faible latence et sensibles aux coûts. Pro, quant à lui, vise des capacités de raisonnement extrêmes (score AIME 2025 de 98,3 et classement Codeforces de 3020). Si votre application repose sur des tâches simples et fréquentes (comme la modération de contenu, l'étiquetage ou le nettoyage de données), choisir Mini réduira considérablement vos coûts. Si vous avez besoin de capacités de raisonnement de pointe (mathématiques complexes, programmation de haut niveau), optez pour Pro.

Q4 : Comment Seed 2.0 Mini gère-t-il le contrôle par paliers de la qualité visuelle ?

Le système de Seed 2.0 Mini propose 3 paliers : le mode low est idéal pour les aperçus rapides et la reconnaissance simple tout en consommant un minimum de ressources ; le mode high (par défaut) offre une meilleure cohérence de prédiction et une précision accrue ; enfin, le mode xhigh est spécialement conçu pour les textes denses, les graphiques complexes et les scènes riches en détails. Vous pouvez spécifier le palier souhaité dans le paramètre image_url.detail de votre requête API.

Q5 : Comment migrer une application GPT/Claude existante vers Seed 2.0 Mini ?

Seed 2.0 Mini est totalement compatible avec les spécifications du SDK OpenAI, ce qui rend le coût de migration extrêmement faible. Il vous suffit de modifier les paramètres base_url et model. Le paramètre supplémentaire reasoning_effort peut être transmis via extra_body, sans impacter la logique de votre interface actuelle. Pour les développeurs utilisant déjà la plateforme APIYI (apiyi.com), il suffit de changer le paramètre model par seed-2-0-mini-260215 pour une transition transparente.

Résumé et recommandations pour l'API Seed 2.0 Mini

Seed 2.0 Mini (ID du modèle : seed-2-0-mini-260215) est le grand modèle de langage phare de la série Seed 2.0 de ByteDance pour les scénarios à haute concurrence et à faible coût. Ses 4 modes de raisonnement permettent aux développeurs de contrôler précisément la profondeur de réflexion et le budget, tandis que sa fenêtre de contexte de 256K et ses capacités de compréhension multimodale le rendent particulièrement performant pour les applications d'entreprise. Par rapport à la génération précédente Seed 1.6 Flash, Seed 2.0 Mini progresse nettement en reconnaissance de contenu, en raisonnement logique et en capacités d'Agent, avec une réduction d'environ 40 % des modes d'erreur.

Nous vous recommandons de passer par APIYI (apiyi.com) pour accéder rapidement à l'API Seed 2.0 Mini. La plateforme propose une interface compatible OpenAI, supportant l'invocation unifiée et le basculement flexible entre plusieurs modèles majeurs, vous aidant ainsi à valider vos solutions techniques et à les déployer efficacement en production.

Ressources

-

Page officielle de ByteDance Seed 2.0 : Présentation du modèle et spécifications techniques

- Lien :

seed.bytedance.com/en/seed2 - Description : Contient des informations complètes sur la série de modèles Seed 2.0 et les données de benchmark.

- Lien :

-

Seed 2.0 Model Card : Livre blanc technique

- Lien :

github.com/ByteDance-Seed/Seed2.0 - Description : Contient des détails sur l'architecture du modèle, les méthodes d'entraînement et les données d'évaluation.

- Lien :

-

Liste des modèles Seed : Tous les modèles disponibles

- Lien :

seed.bytedance.com/en/models - Description : Comprend les spécifications de toute la gamme de modèles : Pro, Lite, Mini et Code.

- Lien :

Auteur : Équipe APIYI | Pour en savoir plus sur les astuces d'invocation du modèle API, visitez le blog technique d'APIYI sur apiyi.com