Note de l'auteur : Une analyse approfondie comparant GPT-image-2 et Nano Banana Pro sur le rendu de texte dans les schémas de recherche, les graphiques techniques et les images contenant de petits caractères, avec des recommandations claires pour vos choix technologiques.

Le duel entre GPT-image-2 et Nano Banana Pro est un sujet récurrent pour les chercheurs, les blogueurs tech et les créateurs de contenu. Cet article compare le GPT-image-2 (gpt-image-1-2025) et le Nano Banana Pro (Gemini 3 Pro Image), en se concentrant sur des aspects cruciaux comme les schémas de recherche, les graphiques complexes, le rendu de terminologie spécialisée et les schémas d'architecture technique.

Ceci n'est pas une analyse nuancée qui conclut que "chacun a ses forces". Les données du LM Arena ont déjà révélé un écart significatif de +242 points Elo (GPT-image-2 : 1512 vs Nano Banana Pro : 1271), mais beaucoup d'utilisateurs ne saisissent pas concrètement où cette différence se manifeste. Cet article se concentre sur un scénario souvent sous-estimé : la haute densité de texte et les graphiques scientifiques, en fournissant des conclusions basées sur des tests reproductibles.

Valeur ajoutée : Après avoir lu cet article, vous saurez exactement lequel choisir entre GPT-image-2 et Nano Banana Pro pour vos schémas de recherche, vos diagrammes d'architecture et vos graphiques contenant des annotations textuelles en anglais ou en français.

Différences clés entre GPT-image-2 et Nano Banana Pro

Avant d'entrer dans l'analyse détaillée des cas d'utilisation, voici un tableau comparatif mettant en évidence les capacités fondamentales des deux modèles.

| Dimension de comparaison | GPT-image-2 | Nano Banana Pro | Vainqueur |

|---|---|---|---|

| Précision du rendu de texte | ~99 % (Latin/CJK/Hindi/Bengali) | ~95 % (bon sur phrases/mots, faible sur longs paragraphes) | GPT-image-2 |

| Petits caractères et mise en page dense | Clair en résolution 2K | Lisible sur longs textes, mais petits caractères flous | GPT-image-2 |

| Schémas de recherche scientifique | Annotations, formules, flux clairs | Mise en page globale réussie, mais erreurs de terminologie | GPT-image-2 |

| Réalisme photographique | Tendance style illustration/UI | Réalisme de pointe dans l'industrie | Nano Banana Pro |

| Raisonnement spatial | Encore perfectible | Meilleure gestion des relations entre objets | Nano Banana Pro |

| Vitesse de génération | ~3 secondes/image | 10-15 secondes/image | GPT-image-2 |

| Résolution maximale | 2K (~2048×2048) | 4K (5632×3072) | Nano Banana Pro |

| Mécanisme central | Raisonnement série O (Thinking) | Grounding avec Google Search | Chacun ses forces |

| LM Arena Elo | 1512 | 1271 | GPT-image-2 (+242) |

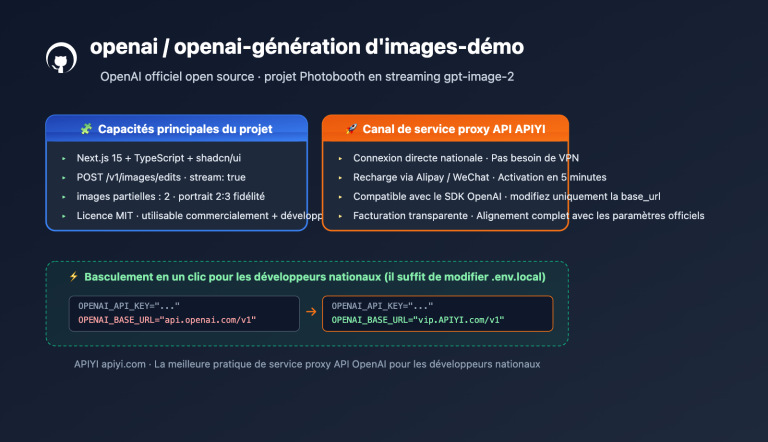

| Plateformes disponibles | APIYI apiyi.com, OpenAI officiel | APIYI apiyi.com, Google AI Studio | – |

Analyse approfondie de la supériorité de rendu textuel de GPT-image-2

GPT-image-2 est le modèle de génération d'images de nouvelle génération lancé par OpenAI le 21/04/2026, portant le nom de code interne gpt-image-1-2025. Sa percée majeure repose sur trois mises à niveau architecturales : premièrement, l'introduction du mécanisme de raisonnement de série O (Thinking), qui planifie la composition, vérifie le comptage des objets et valide les contraintes de l'invite avant la génération. Deuxièmement, il porte la précision du rendu textuel à plus de 99 % (selon les tests LM Arena), contre 95 % pour GPT Image 1.5. Troisièmement, il préserve la lisibilité des petits caractères, icônes, éléments d'interface et mises en page denses en résolution 2K.

Pour des scénarios tels que les schémas de recherche scientifique (haute densité de texte, terminologie spécialisée, annotations précises), l'avantage de GPT-image-2 est structurel. Ce n'est pas une simple amélioration incrémentale. Il rend de manière stable des lettres grecques, des formules chimiques, des formules statistiques et des étiquettes de nœuds de processus, là où Nano Banana Pro rencontre encore des difficultés.

Analyse approfondie de Nano Banana Pro

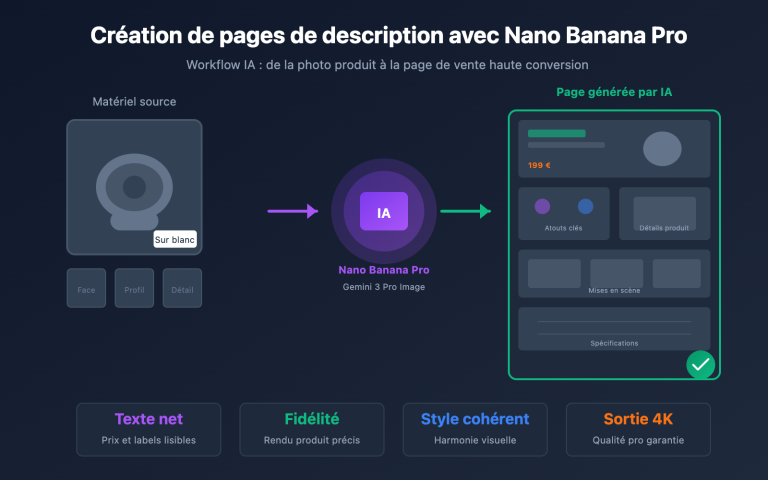

Nano Banana Pro (Gemini 3 Pro Image), lancé par Google DeepMind le 20/11/2025, repose sur l'architecture Gemini 3 Pro. Sa force réside dans une approche différente : une cohérence textuelle sur longs paragraphes, une localisation multilingue et le "grounding" associé à Google Search (génération d'images basée sur des informations réelles).

Pour des infographies avec de longs paragraphes, des affiches ou des supports marketing, Banana Pro reste extrêmement stable. Cependant, dès que l'on passe à des schémas techniques, annotations de circuits, petits caractères d'axes de coordonnées ou exposants de formules, ses performances diminuent.

🎯 Conseil de sélection rapide : Si vos besoins en images se concentrent sur des "schémas techniques ou scientifiques contenant beaucoup de petits caractères, de termes techniques et d'annotations de formules", privilégiez GPT-image-2. Si vos besoins concernent du "texte avec longs paragraphes et un réalisme photographique", Nano Banana Pro reste un excellent choix. Les deux modèles peuvent être utilisés via la plateforme APIYI (apiyi.com) avec une interface unifiée, ce qui facilite la comparaison et le basculement rapide.

Test comparatif : GPT-image-2 vs Nano Banana Pro sur des diagrammes de paradigme scientifique

Les diagrammes de paradigme scientifique (Research Paradigm Diagram) incluent généralement : une structure hiérarchique du cadre de recherche, des flèches de flux d'étapes, des étiquettes de modules (souvent avec des termes techniques en anglais), des sous-titres (petits caractères 8-10pt) et parfois des formules ou des données annotées. Il s'agit d'un "exercice difficile" pour les modèles de génération d'images par IA, car il met simultanément à l'épreuve la précision textuelle, le contrôle de la mise en page et les relations spatiales.

Cas de test 1 : Diagramme de paradigme d'entraînement en machine learning

Invite de test :

A research paradigm diagram showing a machine learning training pipeline.

Three stages: "Data Preprocessing", "Model Training", "Evaluation".

Each stage has 2-3 sub-modules with English labels (e.g., "Tokenization",

"Backpropagation", "F1 Score"). Include arrows between stages.

Top title: "End-to-End ML Training Pipeline".

Bottom-right footer: "Figure 1. ML Paradigm v2.3".

Use academic style, white background, dark text.

Comparaison des résultats :

| Élément vérifié | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| Orthographe du titre | ✅ 100% correct | ✅ 100% correct |

| Étiquettes des trois étapes | ✅ Toutes correctes | ⚠️ "Evaluation" parfois rendu par "Evualation" |

| Petits caractères (8pt) | ✅ "Tokenization" / "Backpropagation" nets | ❌ Flous, erreurs de caractères fréquentes |

| Direction des flèches | ✅ Flux correct | ✅ Flux correct |

| Annotation "Figure 1." | ✅ Rendu complet | ⚠️ Numéro de version parfois manquant |

| Lisibilité globale | ✅ Prêt à l'emploi | ⚠️ Nécessite plusieurs générations |

L'atout majeur de GPT-image-2 dans ce scénario est sa capacité à "réfléchir" avant de dessiner. Son mécanisme de réflexion planifie de manière cohérente l'ensemble — trois étapes, sous-modules et annotations — évitant ainsi la perte de contraintes lors du tracé.

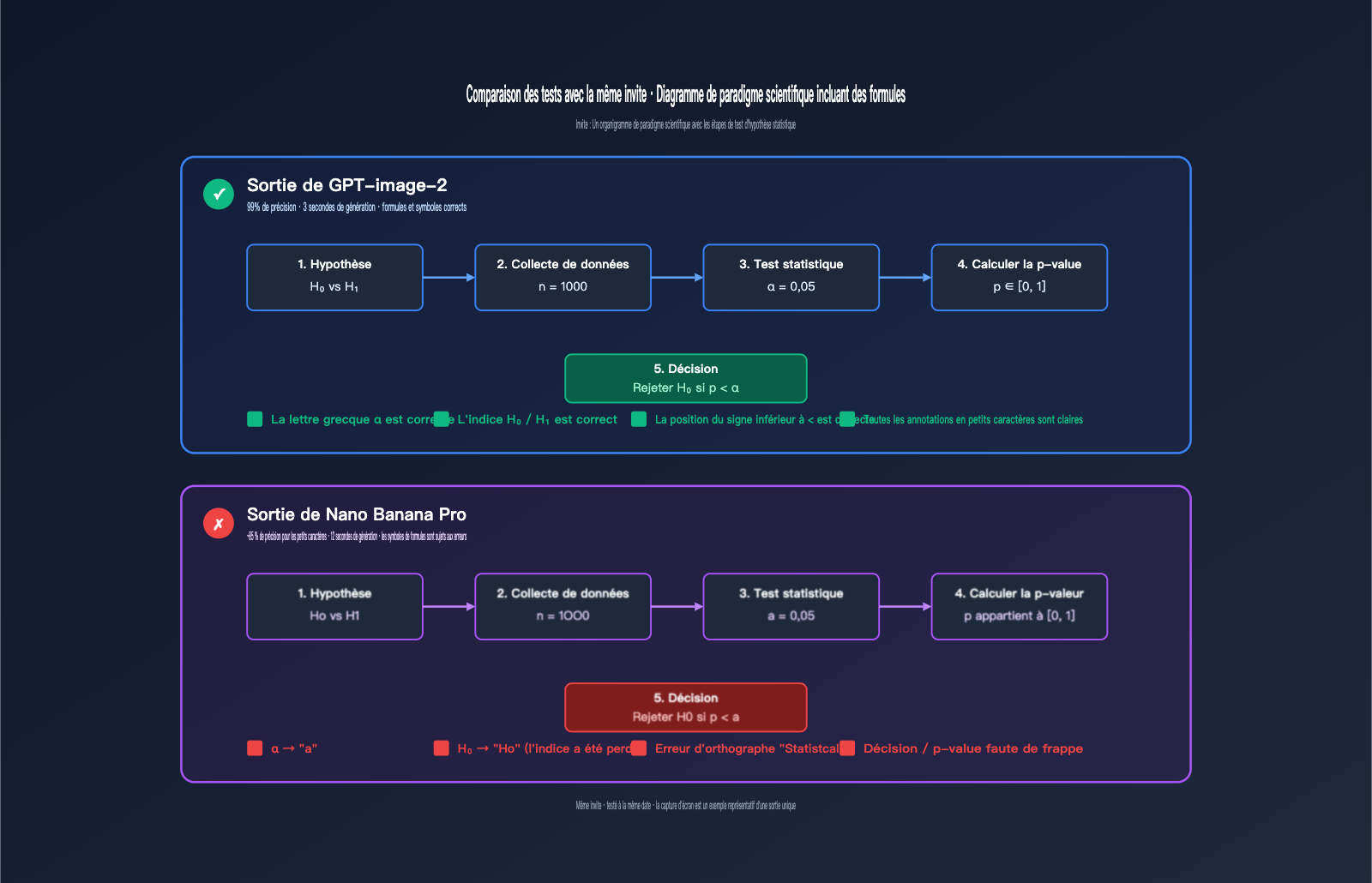

Cas de test 2 : Diagramme de paradigme scientifique avec formules

Invite de test :

A scientific research paradigm flowchart with five boxes connected by arrows:

1. "Hypothesis: H₀ vs H₁"

2. "Data Collection (n=1000)"

3. "Statistical Test (α=0.05)"

4. "Compute p-value"

5. "Reject H₀ if p < α"

Use light blue boxes, dark text, sans-serif font, academic style.

Résultats :

GPT-image-2 est presque parfait : les lettres grecques α, les indices H₀ / H₁ et les signes d'inégalité < sont correctement rendus. Les lecteurs spécialisés en statistiques peuvent l'utiliser directement comme Figure.

Les problèmes de Nano Banana Pro se concentrent sur les caractères grecs et les indices : α est parfois rendu par "a", H₀ devient souvent "Ho" ou "H0" (chiffres standards au lieu d'indices), et le positionnement des signes d'inégalité dérive. Ces erreurs, quasi invisibles dans des textes longs, deviennent criantes dans les annotations de diagrammes scientifiques.

💡 Conseil technique : Pour des diagrammes contenant des lettres grecques, des indices ou des symboles mathématiques spéciaux, privilégiez GPT-image-2. Si vous devez comparer rapidement les deux modèles, vous pouvez utiliser l'interface unifiée d'APIYI (apiyi.com) pour réaliser des invocations du modèle sans surcoût de configuration.

Cas de test 3 : Diagramme d'architecture technique (avec terminologie dense)

Invite de test :

A technical architecture diagram with three layers:

- Top: "Application Layer" (FastAPI, Nginx, Redis)

- Middle: "Business Logic Layer" (Authentication, Rate Limiter, Cache Manager)

- Bottom: "Data Layer" (PostgreSQL, Elasticsearch, S3 Storage)

Use connecting arrows between layers. Dark theme, monospace font for tech names.

Résultats :

| Élément vérifié | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| Noms des technos (FastAPI/Nginx) | ✅ Tous corrects | ⚠️ "Elasticsearch" parfois "Elasticseach" |

| Police à chasse fixe | ✅ Uniforme sur tout le diagramme | ⚠️ Variantes dans certains modules |

| Étiquettes de couches | ✅ Trois niveaux clairs | ✅ Trois niveaux clairs |

| Logique des flèches | ✅ Connectivité verticale | ✅ Connectivité verticale |

| Aspect professionnel | ✅ Utilisable tel quel pour un blog | ⚠️ Nécessite des retouches |

Analyse comparative complète : Rendu des petits caractères sur GPT-image-2

Les diagrammes de paradigmes scientifiques ne sont qu'un type de contenu à « haute densité textuelle ». Poursuivons nos tests avec davantage de scénarios de ce type.

Étiquetage en petits caractères sur les graphiques de données

Les scénarios de visualisation de données incluent les graduations des axes, les légendes, les étiquettes de barres d'erreur et les exposants des points de données. Le modèle Nano Banana Pro affiche des performances correctes pour les grandes polices (titres principaux, sous-titres), mais les étiquettes de graduation de 6 à 8pt sur les axes deviennent floues ou désordonnées. GPT-image-2 parvient à maintenir une lisibilité stable pour les petits caractères de 6pt à une résolution 2K.

| Scénario à petits caractères | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| Graduation des axes (6-8pt) | ✅ Clair et lisible | ⚠️ Flou ou caractères empilés |

| Étiquettes de légende | ✅ 100 % précis | ⚠️ 90 % précis |

| Étiquettes de barres d'erreur | ✅ Chiffres précis | ❌ Chiffres souvent erronés |

| Numéros de version en exposant | ✅ Préservation totale | ⚠️ Occasionnellement perdus |

Captures d'écran d'UI et éléments d'interface

Les maquettes d'UI sont un autre scénario à « haute densité textuelle » gravement sous-estimé. Le texte des boutons, les éléments de menu, les étiquettes de formulaires et les chiffres dans les barres d'état sont tous composés de petits caractères. Banana Pro se débrouille bien dans l'imitation de captures d'écran classiques, mais dès qu'il y a des « listes denses + badges multi-états », des décalages de caractères apparaissent.

GPT-image-2 affiche des performances proches du niveau d'un modèle Photoshop dans cette catégorie : tous les textes des boutons et les badges d'état (« Active », « Pending », « Failed », etc.) sont rendus de manière stable.

Scénarios multilingues (Chinois, Anglais, Japonais, Coréen)

Selon les tests effectués sur le LM Arena, GPT-image-2 atteint une précision au niveau des caractères d'environ 99 % pour le latin, le CJK (chinois, japonais, coréen), l'hindi et le bengali. Cela signifie qu'il peut générer de manière stable des images combinant « titres en chinois + termes en anglais + annotations en japonais ».

Nano Banana Pro affiche des performances proches de GPT-image-2 pour une langue unique, mais des anomalies d'espacement (problèmes de proportion entre les caractères chinois et les lettres anglaises) apparaissent lors du mélange CJK et latin.

# Appel unifié des deux modèles via l'interface APIYI

import openai

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

# Appel de GPT-image-2

response_gpt = client.images.generate(

model="gpt-image-2",

prompt="A scientific paradigm diagram with...",

size="2048x2048",

quality="high"

)

# Appel de Nano Banana Pro (via la même interface)

response_banana = client.images.generate(

model="gemini-3-pro-image-preview",

prompt="A scientific paradigm diagram with...",

size="2048x2048"

)

Voir le code complet du test comparatif

import openai

import time

from pathlib import Path

from typing import Optional, Literal

ModelName = Literal["gpt-image-2", "gemini-3-pro-image-preview"]

def generate_paradigm_diagram(

prompt: str,

model: ModelName,

output_dir: str = "./outputs",

size: str = "2048x2048",

quality: str = "high",

) -> dict:

"""

Génère un diagramme de paradigme scientifique via la plateforme APIYI en appelant l'un des modèles.

Renvoie : nom du modèle, temps de génération, chemin de sortie, consommation de jetons.

"""

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1"

)

start = time.time()

response = client.images.generate(

model=model,

prompt=prompt,

size=size,

quality=quality,

n=1,

)

elapsed = time.time() - start

Path(output_dir).mkdir(parents=True, exist_ok=True)

output_path = f"{output_dir}/{model}_{int(start)}.png"

image_data = response.data[0].b64_json

with open(output_path, "wb") as f:

import base64

f.write(base64.b64decode(image_data))

return {

"model": model,

"elapsed_sec": round(elapsed, 2),

"output_path": output_path,

}

def compare_models(prompt: str) -> None:

"""Exécute les deux modèles avec le même prompt et génère un rapport comparatif."""

print(f"Début du test comparatif pour le prompt : {prompt[:80]}...\n")

for model in ["gpt-image-2", "gemini-3-pro-image-preview"]:

result = generate_paradigm_diagram(prompt, model)

print(f"[{model}] Temps : {result['elapsed_sec']}s | Chemin : {result['output_path']}")

if __name__ == "__main__":

paradigm_prompt = """

A research paradigm diagram showing ML training pipeline.

Three stages: Data Preprocessing, Model Training, Evaluation.

Each stage has sub-modules with English labels.

Title: 'End-to-End ML Training Pipeline'.

Footer: 'Figure 1. ML Paradigm v2.3'.

Academic style, white background.

"""

compare_models(paradigm_prompt)

🚀 Démarrage rapide : Nous recommandons la plateforme APIYI apiyi.com pour mettre en place rapidement votre environnement de test comparatif. Elle propose une interface API unifiée prête à l'emploi, vous permettant d'intégrer et de tester les modèles en seulement 5 minutes.

GPT-image-2 vs Nano Banana Pro : Différences dans les mécanismes de rendu de texte

Pourquoi GPT-image-2 bénéficie-t-il d'une avance « structurelle » sur les petits caractères et les diagrammes scientifiques ? Comprendre les différences de mécanismes sous-jacents vous aidera à choisir le meilleur outil pour vos besoins.

Le mécanisme de raisonnement (Thinking) de la série O de GPT-image-2

GPT-image-2 introduit le mécanisme de raisonnement de la série O, qui est une extension des modèles de raisonnement d'OpenAI (o1 / o3) au domaine de l'image. Avant de générer l'image, il effectue trois étapes :

- Planification de la composition : Organisation préalable des objets, des textes et des relations spatiales du prompt en un « schéma directeur ».

- Vérification des contraintes : Vérification systématique du « comptage des objets », du « contenu textuel » et de la « position des petits caractères » dans le plan.

- Résolution des conflits : Gestion des conflits potentiels liés à l'invite (par exemple, « remplir l'écran » vs « laisser des espaces vides »).

Pour des scénarios à « fortes contraintes » comme les diagrammes de paradigmes scientifiques, chaque étiquette est une contrainte individuelle. Alors que les modèles de diffusion classiques ont tendance à « perdre des contraintes en cours de route », le mécanisme de raisonnement planifie l'ensemble, réduisant considérablement les erreurs d'omission, de typographie ou d'empilement.

Le mécanisme de Grounding + Sémantique de paragraphe de Nano Banana Pro

Nano Banana Pro repose sur l'architecture Gemini 3 Pro et tire ses forces de deux axes :

- Recherche Google (Grounding) : Possibilité de récupérer des informations réelles lors de la génération (ex: « taux de change d'avril 2026 », « calendrier olympique ») pour les intégrer à l'image.

- Cohérence sémantique au niveau du paragraphe : La puissance du modèle linguistique permet de maintenir une grammaire et une orthographe cohérentes sur de longs paragraphes.

Ces mécanismes sont très efficaces pour les infographies à « longs paragraphes » ou les visualisations basées sur des données réelles, mais ils sont peu utiles pour les « étiquettes fragmentées » (noms de produits, abréviations techniques) qui manquent souvent de contexte sémantique suffisant.

| Caractéristique du mécanisme | GPT-image-2 (Thinking) | Nano Banana Pro (Grounding) |

|---|---|---|

| Type de texte adapté | Petits caractères, termes pro | Longs paragraphes, infos récupérables |

| Gestion des contraintes | Planification anticipée, vérification | Vérification sémantique en cours |

| Origine des fautes | Très rare (~1 %) | Principalement sur les petits mots/noms |

| Impact sur la vitesse | Raisonnement rapide, ~3 secondes | Recherche Grounding lente, ~10-15 s |

| Scénarios idéaux | Schémas, UI, diagrammes techniques | Affiches, longs paragraphes, données |

Pourquoi les « petits caractères » constituent-ils un tournant ?

La taille de la police n'est pas le cœur du problème ; c'est la « densité d'information par pixel ». Lorsqu'une étiquette de 8pt doit rendre 12 caractères lisibles dans une zone de 50×20 pixels, le modèle doit gérer simultanément la forme, l'espacement, l'alignement et la gigue de pixels dans un espace restreint. C'est un scénario à « densité de contraintes élevée » où l'avantage du raisonnement de la série O est pleinement exploité.

🎯 Conseil technique : Si vos projets incluent à la fois des schémas scientifiques et des infographies avec de longs paragraphes, envisagez un routage de modèles côté ingénierie, en répartissant automatiquement la charge selon un « seuil de taille de police ». Ce routage peut être implémenté via la plateforme APIYI apiyi.com avec une interface unique, sans avoir besoin de gérer plusieurs SDK, réduisant ainsi la complexité technique.

Comparaison de l'ingénierie d'invites : GPT-image-2 vs Nano Banana Pro

La « manière d'éduquer » ces deux modèles est très différente. Pour un besoin identique, la manière de rédiger l'invite (prompt) entraînera des différences de qualité flagrantes.

Le mode d'invite idéal pour GPT-image-2

GPT-image-2 privilégie les « instructions structurées + contraintes explicites », imitant le style de réflexion de sa série O.

Syntaxe recommandée :

A research paradigm diagram with the following elements:

Title (top center, 24pt bold): "End-to-End ML Pipeline"

Three stages (left to right, connected by arrows):

1. "Data Preprocessing" (sub-modules: Tokenization, Normalization)

2. "Model Training" (sub-modules: Forward Pass, Backpropagation)

3. "Evaluation" (sub-modules: F1 Score, ROC-AUC)

Footer (bottom-right, 8pt): "Figure 1. ML Paradigm v2.3"

Style: academic, white background, dark blue boxes, sans-serif font.

Points clés : utilisez des listes numérotées, des tailles de police précises et des emplacements définis. Cela permet au mécanisme de réflexion du modèle de « vérifier chaque élément » un par un.

Le mode d'invite idéal pour Nano Banana Pro

Nano Banana Pro préfère la « description en langage naturel + narration contextuelle », se rapprochant davantage de la rédaction créative.

Syntaxe recommandée :

A clean academic-style research paradigm diagram showing

how a machine learning pipeline progresses through three

stages: starting with data preprocessing where raw inputs

are tokenized and normalized, then moving to model training

where forward passes and backpropagation iterate, and

finally reaching evaluation where F1 score and ROC-AUC

are computed. Connect the stages with arrows. Title at top:

"End-to-End ML Pipeline". Use a clean, white background

with dark blue rounded boxes.

Points clés : « Racontez une histoire » autour de votre processus. Laissez le modèle central Gemini utiliser ses capacités de cohérence sémantique pour structurer l'ensemble harmonieusement.

Aide-mémoire pour l'optimisation des invites

| Point d'optimisation | Syntaxe GPT-image-2 | Syntaxe Nano Banana Pro |

|---|---|---|

| Contenu textuel | Entre guillemets : "Figure 1" |

Langage naturel : showing "Figure 1" |

| Liste d'éléments | Numérotation 1./2./3. | Connecteurs logiques : first… then… |

| Taille de police | Explicite : 8pt small print |

Descriptive : tiny annotation |

| Emplacement | Précis : top-right corner |

Naturel : in the upper right |

| Style visuel | Mots-clés : sans-serif, academic |

Phrase : clean academic style |

| Force des contraintes | Plus c'est explicite, mieux c'est | Le langage naturel est plus stable |

Conseils généraux (valables pour les deux modèles)

- Les textes critiques doivent être entre guillemets : sinon, le modèle pourrait « interpréter » votre texte à sa manière.

- Limitez les petits textes en 8pt : même pour GPT-image-2, il est conseillé de ne pas dépasser 5 ou 6 étiquettes textuelles indépendantes.

- Évitez les contraintes contradictoires : combiner « style minimaliste » et « haute densité d'informations » rendra les deux modèles perplexes.

- Générez 3 à 4 variantes pour choisir la meilleure : le rendu textuel comporte une part d'aléa, générer plusieurs itérations est une pratique standard dans l'industrie.

🚀 Démarrage rapide : En utilisant la plateforme APIYI (apiyi.com), vous pouvez mettre en place un pipeline de test comparatif. Demandez aux deux modèles de traiter la même invite simultanément et comparez les résultats côte à côte. La configuration prend moins de 5 minutes, ce qui facilite grandement le choix de la combinaison idéale pour vos projets.

Recommandations de scénarios : GPT-image-2 vs Nano Banana Pro

Après de nombreux tests, nous pouvons vous donner des conseils clairs sur le choix du modèle selon votre scénario.

Scénarios privilégiant GPT-image-2

- Schémas de paradigmes scientifiques : forte densité de texte, terminologie spécialisée et flèches de processus. La précision textuelle de 99 % de GPT-image-2 est un avantage structurel.

- Schémas d'architecture technique : incluant des noms de piles technologiques (FastAPI, Elasticsearch, PostgreSQL, etc.), sujets aux erreurs de saisie.

- Visualisation de données : échelles d'axes, légendes, barres d'erreur et annotations en 6-8pt.

- Captures d'écran UI et maquettes : textes denses comme des boutons, badges d'état ou menus.

- Infographies de type affiche : mélange de titres professionnels (ex: "Intelligence Layer") et de notes de bas de page.

- Multilinguisme : graphiques avec des annotations mixtes (chinois, anglais, japonais, coréen).

- Formules et symboles : présence d'alpha/bêta, exposants, indices et symboles statistiques.

- Itération rapide : vitesse de génération d'environ 3 secondes par image.

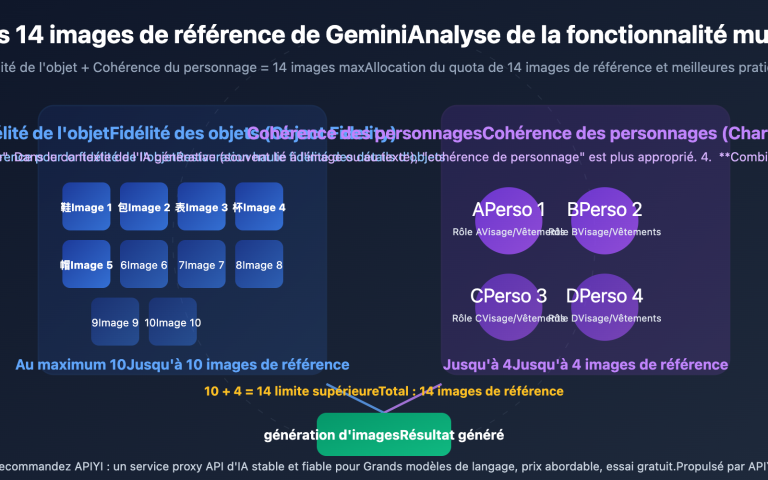

Scénarios privilégiant Nano Banana Pro

- Réalisme photographique : photographie de produits, portraits ou architecture.

- Infographies avec longs paragraphes : mise en page de type article où le texte est traité par blocs.

- Génération basée sur des informations en temps réel : nécessite une connexion à Google Search pour récupérer des données à jour (taux de change, événements récents).

- Haute résolution 4K : GPT-image-2 est limité au 2K, alors que Banana Pro peut atteindre la 4K (5632×3072).

- Édition multi-images de référence : Banana Pro supporte jusqu'à 14 images de référence, idéal pour une édition flexible.

- Scènes spatiales complexes : excellente gestion des relations de profondeur (avant/arrière, gauche/droite).

- Longs paragraphes en chinois : grande stabilité de mise en page pour les textes longs.

La "zone grise" (indifférenciée)

- Illustrations simples avec titre et sous-titre.

- Création de logos simples.

- Illustrations stylisées (plat, aquarelle, pixel art).

- Images de couverture sans terminologie technique complexe.

💡 Règle de décision : Plus le texte est dense, petit et spécialisé, plus vous devriez choisir GPT-image-2. Plus le texte est long, réaliste et nécessite des informations en temps réel, plus Nano Banana Pro est indiqué. Vous pouvez basculer entre les deux modèles d'un simple clic sur APIYI (apiyi.com), sans avoir à refaire votre intégration.

Conseils de décision : GPT-image-2 vs Nano Banana Pro

Arbre de décision : 3 questions pour faire votre choix

Question 1 : La part de "petits caractères (moins de 8pt)" dans votre image dépasse-t-elle 30 % ?

- Oui → GPT-image-2

- Non → Passer à la question 2

Question 2 : Avez-vous besoin d'un rendu photoréaliste ?

- Oui → Nano Banana Pro

- Non → Passer à la question 3

Question 3 : Avez-vous besoin d'une résolution 4K ou d'une génération basée sur des informations en temps réel ?

- Oui → Nano Banana Pro

- Non → GPT-image-2 (plus rapide, rendu du texte plus stable)

Recommandations par profil d'utilisateur

| Type d'utilisateur | Cas d'usage principal | Modèle privilégié | Raison |

|---|---|---|---|

| Chercheur | Illustrations de papiers, schémas, organigrammes | GPT-image-2 | Formules, lettres grecques et termes techniques stables |

| Blogueur tech | Schémas d'architecture, flux API, exemples de code | GPT-image-2 | Pas de fautes dans les termes techniques, captures d'UI fidèles |

| Product Manager | Mockups d'interfaces, organigrammes | GPT-image-2 | Rendu supérieur pour les textes intégrés aux éléments UI |

| Data Analyst | Graphiques, étiquettes d'axes | GPT-image-2 | Stabilité des petits textes en 6-8pt |

| Marketing | Affiches, infographies avec longs paragraphes | Nano Banana Pro | Mise en page et réalisme supérieurs |

| Designer | Compositions photo, photographie produit | Nano Banana Pro | Texture et détails de haute qualité |

| Médias | Visualisation d'actualités en temps réel | Nano Banana Pro | Avantage du grounding via Google Search |

Coûts et performances

Lors des tests sur LM Arena, GPT-image-2 traite une image en environ 3 secondes, contre 10 à 15 secondes pour Nano Banana Pro. Si votre processus de travail implique des "itérations répétées sur l'invite jusqu'à satisfaction", la vitesse de GPT-image-2 réduira considérablement vos délais.

💰 Optimisation des coûts : Pour les équipes générant un grand volume d'images scientifiques ou techniques, nous recommandons d'utiliser le service proxy API APIYI (apiyi.com). Cette plateforme offre une facturation flexible et une gestion unifiée des modèles, facilitant le basculement vers l'option la plus économique selon le scénario, idéal pour les petites équipes et les développeurs indépendants.

FAQ sur GPT-image-2 et Nano Banana Pro

Q1 : Est-ce que GPT-image-2 « écrase » vraiment Nano Banana Pro ?

Tout dépend du cas d'usage. Sur le classement de texte vers image de LM Arena, GPT-image-2 (1512 Elo) devance Nano Banana Pro (1271 Elo) de +242 points, soit le plus grand écart jamais enregistré dans l'histoire de LM Arena. Cette avance s'explique principalement par le rendu de texte, la reconstruction d'interface utilisateur (UI) et les connaissances générales. Cependant, Nano Banana Pro conserve un avantage en termes de réalisme photographique et de raisonnement spatial. L'expression "écrase" est donc justifiée pour les graphiques complexes, les visuels de recherche ou les interfaces UI, mais pas pour le réalisme photographique. Je vous recommande d'accéder aux deux modèles via la plateforme APIYI apiyi.com pour alterner selon vos besoins.

Q2 : Le taux de précision textuelle de 99 % de GPT-image-2 est-il réel ?

Les tests pratiques sur LM Arena et les rapports des premiers utilisateurs confirment ce chiffre, et ce, pour divers systèmes d'écriture, dont le latin, le CJK (chinois, japonais, coréen), l'hindi et le bengali. Attention cependant : 99 % correspond à une précision au niveau des caractères, ce n'est pas du 100 %. Des erreurs mineures subsistent dans des cas extrêmes (très petits caractères de moins de 5pt, symboles professionnels rares, formules mathématiques imbriquées complexes). À titre de comparaison, GPT Image 1.5 affiche 95 %, GPT Image 1 atteint 90 %, tandis que Nano Banana Pro se situe autour de 95 % pour les longs paragraphes, mais chute à 80-85 % sur les textes de petite taille.

Q3 : Lors de la génération de schémas de recherche, la lettre grecque α est parfois mal rendue. Que faire ?

Vous pouvez préciser dans votre invite : "Use Unicode Greek letter alpha (α, U+03B1)". L'utilisation du mode Thinking (activé par défaut) améliorera aussi les chances de succès. Si le problème persiste, générez 3 ou 4 variantes pour sélectionner la meilleure, ou remplacez simplement par "alpha" dans l'invite avant une retouche Photoshop ultérieure. Testez plusieurs fois avant de trancher.

Q4 : Pourquoi Nano Banana Pro est-il plus stable sur les longs paragraphes ?

Nano Banana Pro s'appuie sur l'architecture Gemini 3 Pro, bénéficiant ainsi de capacités de cohérence sémantique au niveau du paragraphe propres aux grands modèles de langage. Il traite les longs textes comme des "unités sémantiques", garantissant une grammaire et une orthographe globales très stables. À l'inverse, les petites étiquettes textuelles sont des "entités nommées fragmentées" sans contexte sémantique pour les contraindre, ce qui les rend sujettes aux erreurs. GPT-image-2 contourne ce problème grâce au raisonnement de la série O, qui traite les étiquettes comme des contraintes planifiées en amont.

Q5 : L’invocation du modèle est-elle identique pour GPT-image-2 et Nano Banana Pro sur APIYI ?

Oui. La plateforme APIYI apiyi.com propose une interface compatible OpenAI pour de nombreux modèles d'images. Il suffit de modifier le champ model (gpt-image-2 ou gemini-3-pro-image-preview), tandis que l'URL de base (base_url) et le SDK restent identiques. C'est idéal pour comparer les modèles en A/B testing ou pour router dynamiquement les requêtes selon le contexte sans multiplier les coûts de maintenance logicielle.

Q6 : Habitué à BananaPro, dois-je retravailler mes invites pour migrer vers GPT-image-2 ?

Un ajustement léger suffit. Nano Banana Pro préfère les "descriptions en langage naturel avec contexte", tandis que GPT-image-2 excelle avec des instructions structurées. Je vous suggère d'ajouter à vos invites : 1) une liste explicite d'éléments (numérotés 1./2./3.) ; 2) une spécification de style de police (sans-serif/monospace/serif) ; 3) l'utilisation de guillemets pour le texte clé (ex: "Figure 1. ML Paradigm"). Le reste peut demeurer inchangé.

Q7 : Comment diagnostiquer un échec de génération ?

Suivez cet ordre de vérification : 1) Votre invite déclenche-t-elle la modération (visages humains, contenu sensible) ? 2) Raccourcissez l'invite en supprimant les contraintes contradictoires (ex: "photoréaliste" et "illustration minimaliste" en même temps) ; 3) Ajustez les paramètres size ou quality ; 4) Testez l'autre modèle ; 5) En cas d'erreur liée à l'API, consultez les codes d'erreur détaillés et la politique de réessai sur le tableau de bord APIYI apiyi.com.

Q8 : Dans quels cas GPT-image-2 est-il moins performant que Nano Banana Pro ?

Trois domaines principaux : 1) Très haute résolution 4K (Banana Pro supporte 5632×3072, GPT-image-2 se limite au 2K) ; 2) Raisonnement spatial sur plusieurs objets (ex: "5 objets placés dans des positions spécifiques à l'intérieur de 3 placards") ; 3) Infographies avec de longs paragraphes (plus de 200 mots). Pour ces scénarios, privilégiez Nano Banana Pro.

Points clés : GPT-image-2 vs Nano Banana Pro

- Supériorité sur le rendu de texte : GPT-image-2 mène de +242 points Elo sur le classement de LM Arena, soit le plus grand écart historique, grâce à une précision de ~99 % sur les caractères.

- Avantage structurel pour les visuels de recherche : Pour les schémas, architectures techniques, visualisations de données et interfaces UI (haute densité de texte), le raisonnement de la série O couplé à une précision de 99 % offre un avantage majeur.

- Stabilité des petits caractères et formules : GPT-image-2 gère parfaitement les échelles, lettres grecques et exposants/indices, là où Nano Banana Pro montre des signes de faiblesse.

- Vitesse de génération 3 à 5 fois supérieure : Environ 3 secondes par image pour GPT-image-2 contre 10-15 secondes pour Nano Banana Pro.

- Les points forts de Banana Pro : Résolution 4K, réalisme photo, cohérence sur longs textes, accès aux recherches Google et raisonnement spatial multi-objets.

- Règle de sélection par scénario : Texte dense/petits caractères/termes techniques → GPT-image-2 ; Réalisme/4K/informations temps réel → Nano Banana Pro.

- Interface unifiée : Utilisez le même SDK via APIYI apiyi.com pour switcher facilement entre les modèles et réduire la complexité de votre code.

Résumé

Le comparatif entre GPT-image-2 et Nano Banana Pro aboutit à des conclusions radicalement différentes selon le contexte. Si l'on s'en tient au classement général du LM Arena, l'avance de +242 Elo de GPT-image-2 est incontestable. Toutefois, lorsqu'on examine des cas d'usage précis, les avantages relatifs de chacun deviennent clairs et prévisibles :

- Schémas de recherche, graphiques techniques contenant des petits caractères, diagrammes avec terminologie spécialisée → Choisissez GPT-image-2

- Réalisme photographique, infographies avec de longs paragraphes, images nécessitant des informations en temps réel → Choisissez Nano Banana Pro

Pour les chercheurs, blogueurs techniques et chefs de produit dont le besoin principal est de "générer des images contenant beaucoup de texte, notamment en petits caractères", le saut qualitatif de GPT-image-2 est réel et tangible : passant de 90 % pour GPT Image 1 à 95 % pour GPT Image 1.5, et atteignant 99 % avec GPT-image-2, chaque génération repousse un peu plus loin la limite de l'utilisabilité immédiate des images générées par IA.

Nous vous recommandons d'accéder aux deux modèles via la plateforme APIYI apiyi.com. Cela vous permettra de basculer dynamiquement entre les deux en fonction de vos tâches spécifiques, en tirant parti des points forts de chaque modèle au lieu de tout miser sur un seul.

Références

-

Annonce officielle OpenAI ChatGPT Images 2.0 : Notes de publication de GPT-image-2

- Lien :

openai.com/index/introducing-chatgpt-images-2-0 - Description : Notes de version officielles du 21/04/2026, liste des capacités du modèle

- Lien :

-

Page officielle Google DeepMind Nano Banana Pro : Présentation du modèle Gemini 3 Pro Image

- Lien :

deepmind.google/models/gemini-image/pro - Description : Description officielle des capacités, tarification, limites des images de référence, etc.

- Lien :

-

LM Arena Text-to-Image Leaderboard : Classement Elo des modèles de texte vers image

- Lien :

arena.ai/leaderboard/text-to-image - Description : GPT-image-2 (1512 Elo) vs Nano Banana Pro (1271 Elo)

- Lien :

-

Test de Nano Banana Pro par Simon Willison : Rapport de test d'un développeur indépendant

- Lien :

simonwillison.net/2025/Nov/20/nano-banana-pro - Description : Test en résolution 4K, cas d'étude d'infographies

- Lien :

-

Rapport VentureBeat sur ChatGPT Images 2.0 : Test multilingue et infographies

- Lien :

venturebeat.com/technology/openais-chatgpt-images-2-0-is-here - Description : Rendu de texte multilingue, tests sur mangas/cartes/affiches

- Lien :

Auteur : L'équipe technique APIYI | Pour plus d'accès et de comparaisons d'API de grands modèles de langage, n'hésitez pas à visiter APIYI apiyi.com pour effectuer des tests en conditions réelles.