作者注:深度對比 GPT-image-2 與 Nano Banana Pro 在科研範式圖、技術圖表、含小字圖片場景下的文字渲染能力,給出明確選型建議。

GPT-image-2 vs Nano Banana Pro 一直是科研工作者、技術博主、內容創作者關心的選擇。本文對比 GPT-image-2 (gpt-image-1-2025) 和 Nano Banana Pro (Gemini 3 Pro Image),從科研範式圖、含小字圖表、專業術語渲染、技術原理圖等維度給出明確建議。

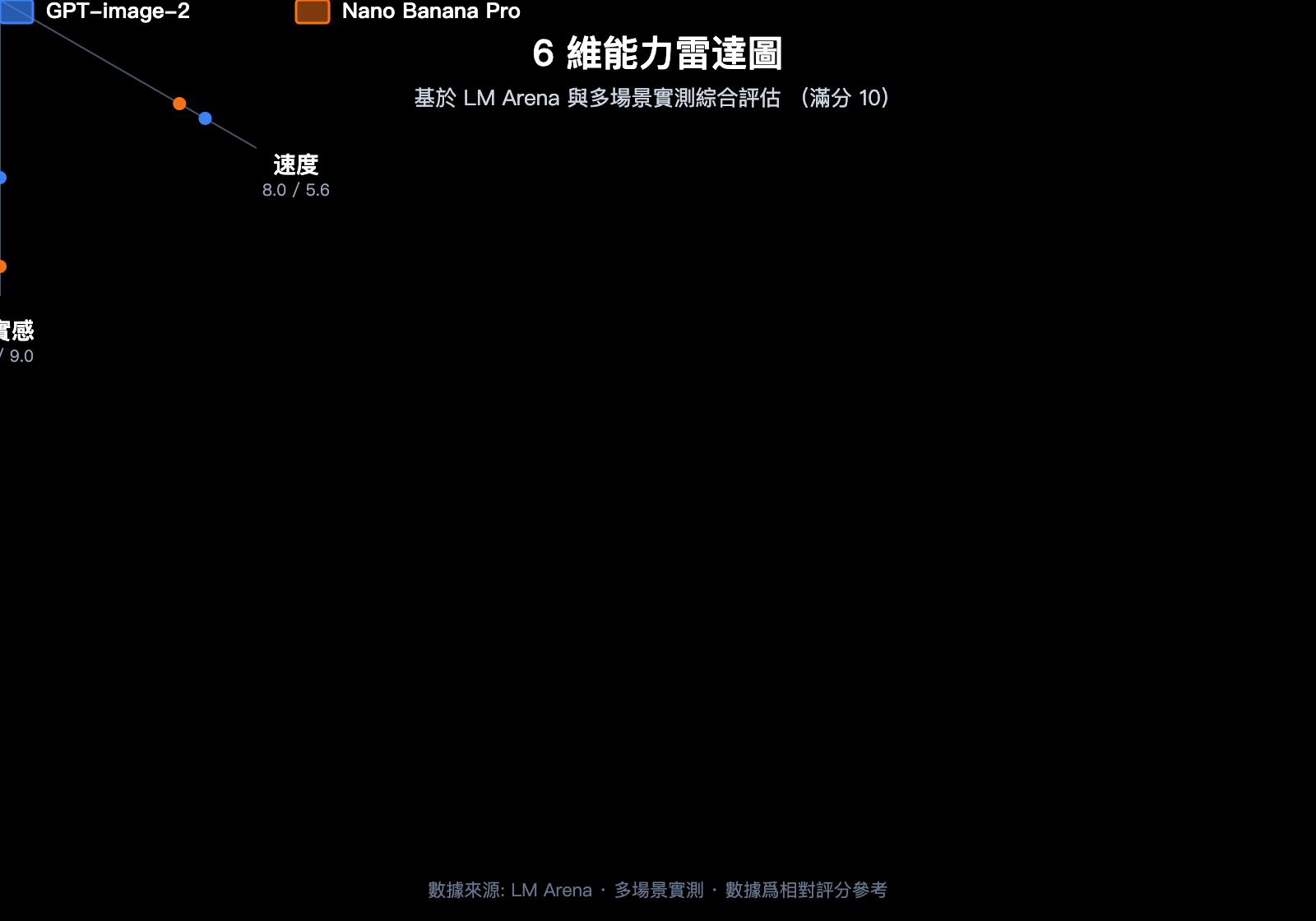

這不是一份"看起來各有千秋"的折中分析。LM Arena 數據已經給出 +242 Elo 分的明確差距 (GPT-image-2: 1512 vs Nano Banana Pro: 1271),但很多用戶並不清楚差距究竟體現在哪些場景。本文聚焦"高文字密度、科研圖表"這一長期被低估的核心場景,給出可復現的實測結論。

核心價值: 看完本文,你將明確在科研範式圖、技術架構圖、含中英文小字標註、專業術語圖表場景下,應該如何在 GPT-image-2 和 Nano Banana Pro 之間做出選擇。

GPT-image-2 vs Nano Banana Pro 核心差異

在深入分析具體場景之前,先用一張表呈現兩者在關鍵能力上的差異。

| 對比維度 | GPT-image-2 | Nano Banana Pro | 勝出 |

|---|---|---|---|

| 文字渲染準確率 | ~99% (Latin/CJK/Hindi/Bengali) | ~95% (短語/單詞強,長段落弱) | GPT-image-2 |

| 小字與密集排版 | 2K 分辨率下小字清晰 | 長段落可讀,但小字易模糊 | GPT-image-2 |

| 科研範式圖 | 標註、公式、流程清晰 | 整體佈局好,但術語易出錯 | GPT-image-2 |

| 照片級真實感 | 偏向插畫/UI 風格 | 業界領先級真實感 | Nano Banana Pro |

| 空間推理 | 仍有不足 | 多對象關係處理更穩 | Nano Banana Pro |

| 生成速度 | ~3 秒/張 | 10-15 秒/張 | GPT-image-2 |

| 最高分辨率 | 2K (~2048×2048) | 4K (5632×3072) | Nano Banana Pro |

| 核心機制 | O 系列推理 (Thinking) | Google Search Grounding | 各有特色 |

| LM Arena Elo | 1512 | 1271 | GPT-image-2 (+242) |

| 可用平臺 | API易 apiyi.com、OpenAI 官方 | API易 apiyi.com、Google AI Studio | – |

GPT-image-2 文字渲染優勢詳解

GPT-image-2 是 OpenAI 在 2026-04-21 發佈的下一代圖像生成模型,內部代號 gpt-image-1-2025。它最核心的突破來自三處架構升級:第一,引入 O 系列推理 (Thinking) 機制,在生成前先規劃構圖、覈對對象計數、校驗提示約束;第二,將文字渲染從 GPT Image 1.5 的 95% 準確率推到 99% 以上 (LM Arena 實測口徑);第三,在 2K 分辨率下保持小字、圖標、UI 元素、密集排版的可讀性。

對於科研範式圖這種"高文字密度+多專業術語+精確標註"的場景,GPT-image-2 的優勢是結構性的,不是"再多訓練一點就能趕上"的漸進改進。它能穩定渲染希臘字母、化學式、統計公式、流程節點標籤,而這正是 Nano Banana Pro 至今仍在掙扎的地方。

Nano Banana Pro 文字渲染優勢詳解

Nano Banana Pro (Gemini 3 Pro Image) 在 2025-11-20 由 Google DeepMind 發佈,基於 Gemini 3 Pro 主幹。它的優勢在另一條路徑上:長段落連貫文本、多語言本地化、配合 Google Search 進行的 grounding (基於真實信息的圖像生成)。

在長段落 infographic、海報、營銷素材這類"段落級文字+常規字號"的場景下,Banana Pro 仍然非常穩。但一旦切到科研範式圖、電路圖標註、座標軸小字、公式角標這類"高密度小字",它的表現就會落後。

🎯 快速選型建議: 如果你的圖像需求集中在"含大量小字、技術術語、公式標註的科研圖/技術圖",請優先選擇 GPT-image-2;如果需求是"長段落正文+攝影級真實感",Nano Banana Pro 仍是優秀選擇。兩個模型都可以通過 API易 apiyi.com 平臺用同一套接口調用,便於快速對比切換。

GPT-image-2 vs Nano Banana Pro 科研範式圖實測

科研範式圖 (Research Paradigm Diagram) 通常包含:研究框架的層級結構、階段流程箭頭、模塊標籤 (常含英文專業術語)、子說明文字 (8-10pt 小字)、有時還有公式或數據標註。這是 AI 生圖模型的"硬骨頭場景",因爲它同時考驗文字準確度、版式控制、空間關係。

實測案例 1:機器學習訓練範式圖

測試 Prompt:

A research paradigm diagram showing a machine learning training pipeline.

Three stages: "Data Preprocessing", "Model Training", "Evaluation".

Each stage has 2-3 sub-modules with English labels (e.g., "Tokenization",

"Backpropagation", "F1 Score"). Include arrows between stages.

Top title: "End-to-End ML Training Pipeline".

Bottom-right footer: "Figure 1. ML Paradigm v2.3".

Use academic style, white background, dark text.

實測結果對比:

| 檢查項 | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| 主標題拼寫 | ✅ 100% 正確 | ✅ 100% 正確 |

| 三階段標籤 | ✅ 全部正確 | ⚠️ "Evaluation" 偶爾渲染爲 "Evualation" |

| 子模塊小字 (8pt) | ✅ "Tokenization" / "Backpropagation" 清晰 | ❌ 小字模糊,易出現字符混淆 |

| 箭頭方向 | ✅ 階段流向正確 | ✅ 階段流向正確 |

| 角標 "Figure 1." | ✅ 完整渲染 | ⚠️ 偶爾丟失版本號 |

| 整體可讀性 | ✅ 直接可用 | ⚠️ 需多次重生成 |

GPT-image-2 在這個場景下的關鍵優勢是它會先"想清楚"再畫。Thinking 機制把"三階段+子模塊+小字標註"作爲約束統一規劃,避免了邊畫邊丟約束的問題。

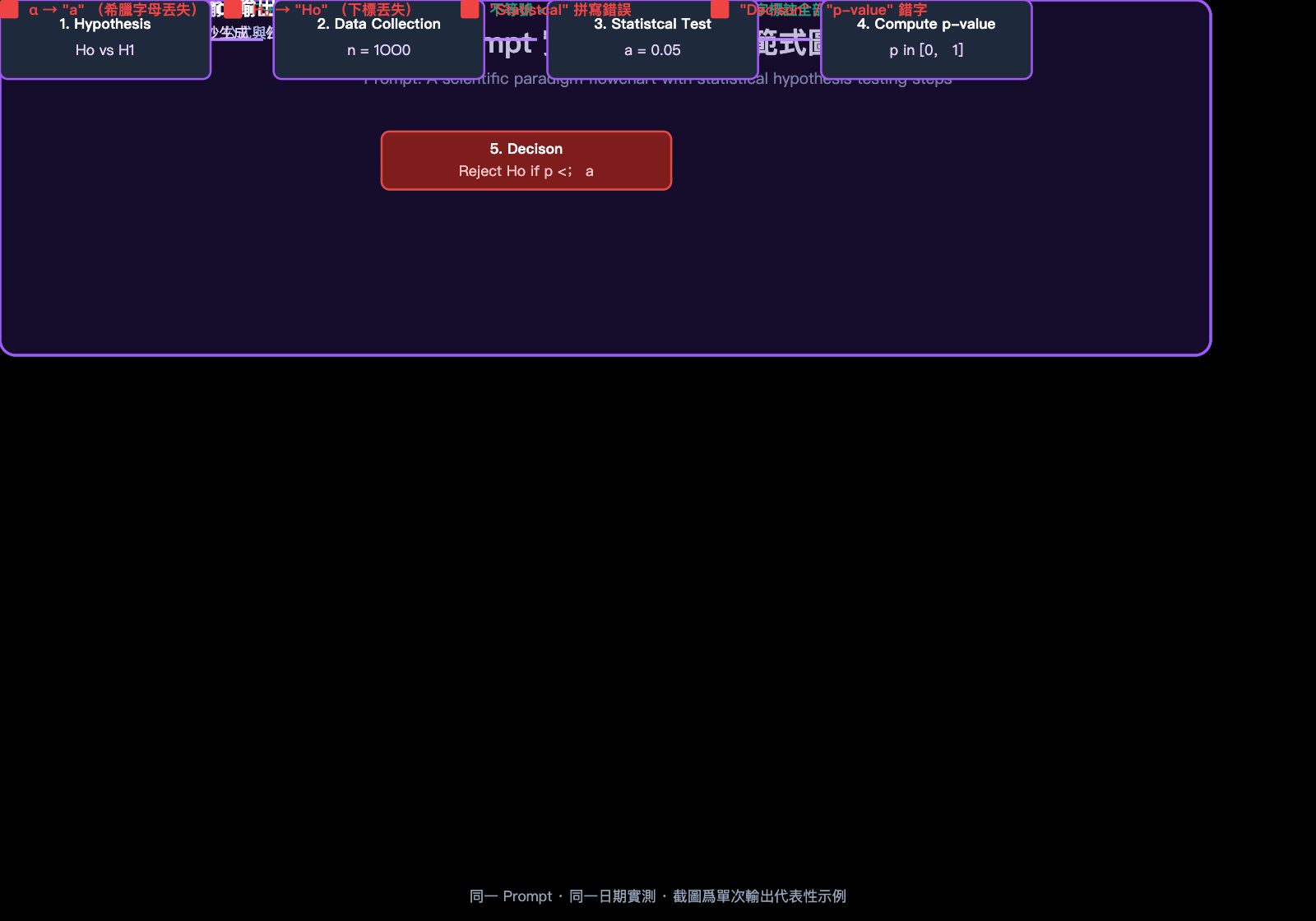

實測案例 2:科研流程範式圖含公式

測試 Prompt:

A scientific research paradigm flowchart with five boxes connected by arrows:

1. "Hypothesis: H₀ vs H₁"

2. "Data Collection (n=1000)"

3. "Statistical Test (α=0.05)"

4. "Compute p-value"

5. "Reject H₀ if p < α"

Use light blue boxes, dark text, sans-serif font, academic style.

實測結果:

GPT-image-2 幾乎完美:希臘字母 α、下標 H₀ / H₁、不等號 < 都正確渲染,統計學專業讀者可以直接拿來當 Figure 用。

Nano Banana Pro 的問題集中在希臘字母和下標:α 偶爾被渲染成 "a"、H₀ 經常變成 "Ho" 或 "H0" (普通數字而非下標)、不等號位置漂移。這些錯誤在長段落文本里幾乎不會出現,但在科研圖小字位置會暴露。

💡 技術建議: 對於含希臘字母、上下標、特殊數學符號的科研範式圖,建議使用 GPT-image-2。如果需要在同一項目中快速切換兩個模型對比效果,可通過 API易 apiyi.com 平臺用統一接口調用,節省切換成本。

實測案例 3:技術架構圖 (含密集英文術語)

測試 Prompt:

A technical architecture diagram with three layers:

- Top: "Application Layer" (FastAPI, Nginx, Redis)

- Middle: "Business Logic Layer" (Authentication, Rate Limiter, Cache Manager)

- Bottom: "Data Layer" (PostgreSQL, Elasticsearch, S3 Storage)

Use connecting arrows between layers. Dark theme, monospace font for tech names.

實測結果:

| 檢查項 | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| 技術棧名稱 (FastAPI/Nginx 等) | ✅ 全部正確 | ⚠️ "Elasticsearch" 偶變 "Elasticseach" |

| 等寬字體一致性 | ✅ 整圖統一 | ⚠️ 部分模塊變體 |

| 層級標籤 | ✅ 三層清晰 | ✅ 三層清晰 |

| 箭頭連接邏輯 | ✅ 上下貫通 | ✅ 上下貫通 |

| 整體專業感 | ✅ 可直接用於技術博客 | ⚠️ 需修圖後使用 |

GPT-image-2 小字渲染場景全面對比

科研範式圖只是"高文字密度"的一類。我們繼續把測試擴展到更多高文字密度場景。

數據圖表的小字標註

數據可視化場景包括座標軸刻度、圖例、誤差棒標籤、數據點角標。Nano Banana Pro 在大字號 (主標題、副標題) 上表現合格,但座標軸 6-8pt 的刻度標籤會模糊或錯亂。GPT-image-2 在 2K 分辨率下能穩定保持 6pt 小字的辨識度。

| 小字場景 | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| 座標軸刻度 (6-8pt) | ✅ 清晰可讀 | ⚠️ 模糊或字符堆疊 |

| 圖例標籤 | ✅ 100% 準確 | ⚠️ 90% 準確 |

| 誤差棒標註 | ✅ 數字精確 | ❌ 數字易亂 |

| 角標版本號 | ✅ 完整保留 | ⚠️ 偶爾丟失 |

UI 截圖與界面元素

UI mockup 是另一個被嚴重低估的"高文字密度"場景。按鈕文字、菜單項、表單標籤、狀態欄數字,全是小字。Banana Pro 在常規截圖模仿上不錯,但一旦有"密集列表+多狀態徽章",就會出現字符錯位。

GPT-image-2 在這一類場景裏的表現接近 Photoshop 模板水平:所有按鈕文字、狀態徽章 ("Active", "Pending", "Failed" 等) 都能穩定渲染。

多語言混合場景 (中英日韓)

GPT-image-2 在 LM Arena 實測口徑下,對 Latin、CJK (中日韓)、Hindi、Bengali 的字符級準確率都達到 ~99%。這意味着它可以穩定生成"中文標題+英文術語+日文註釋"的混排圖。

Nano Banana Pro 在單一語種上表現接近 GPT-image-2,但在 CJK 與 Latin 混排時會出現字距異常 (中文方塊字與英文比例失調)。

# 通過 API易 統一接口調用兩種模型快速對比

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# 調用 GPT-image-2

response_gpt = client.images.generate(

model="gpt-image-2",

prompt="A scientific paradigm diagram with...",

size="2048x2048",

quality="high"

)

# 調用 Nano Banana Pro (同一套接口)

response_banana = client.images.generate(

model="gemini-3-pro-image-preview",

prompt="A scientific paradigm diagram with...",

size="2048x2048"

)

查看完整對比測試代碼

import openai

import time

from pathlib import Path

from typing import Optional, Literal

ModelName = Literal["gpt-image-2", "gemini-3-pro-image-preview"]

def generate_paradigm_diagram(

prompt: str,

model: ModelName,

output_dir: str = "./outputs",

size: str = "2048x2048",

quality: str = "high",

) -> dict:

"""

通過 API易 平臺調用任一模型生成科研範式圖。

返回包含: 模型名、生成耗時、輸出路徑、Token 用量。

"""

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

start = time.time()

response = client.images.generate(

model=model,

prompt=prompt,

size=size,

quality=quality,

n=1,

)

elapsed = time.time() - start

Path(output_dir).mkdir(parents=True, exist_ok=True)

output_path = f"{output_dir}/{model}_{int(start)}.png"

image_data = response.data[0].b64_json

with open(output_path, "wb") as f:

import base64

f.write(base64.b64decode(image_data))

return {

"model": model,

"elapsed_sec": round(elapsed, 2),

"output_path": output_path,

}

def compare_models(prompt: str) -> None:

"""對同一 Prompt 同時跑兩個模型,輸出對比報告。"""

print(f"開始對比測試 Prompt: {prompt[:80]}...\n")

for model in ["gpt-image-2", "gemini-3-pro-image-preview"]:

result = generate_paradigm_diagram(prompt, model)

print(f"[{model}] 耗時: {result['elapsed_sec']}s | 路徑: {result['output_path']}")

if __name__ == "__main__":

paradigm_prompt = """

A research paradigm diagram showing ML training pipeline.

Three stages: Data Preprocessing, Model Training, Evaluation.

Each stage has sub-modules with English labels.

Title: 'End-to-End ML Training Pipeline'.

Footer: 'Figure 1. ML Paradigm v2.3'.

Academic style, white background.

"""

compare_models(paradigm_prompt)

🚀 快速開始: 推薦使用 API易 apiyi.com 平臺快速搭建對比測試環境。該平臺提供開箱即用的統一 API 接口,5 分鐘即可完成兩個模型的接入和並排測試。

GPT-image-2 vs Nano Banana Pro 文字渲染機制差異

爲什麼 GPT-image-2 在小字和科研圖上能形成"結構性"領先?理解兩個模型的底層機制差異,有助於你爲不同任務選擇最合適的工具。

GPT-image-2 的 O 系列推理 (Thinking) 機制

GPT-image-2 引入了 O 系列推理機制——這是 OpenAI 推理模型 (o1 / o3) 在圖像領域的延伸。它在生成圖像之前會先做三件事:

- 構圖規劃: 把 prompt 裏的對象、文字、空間關係預先組織成一個"佈局藍圖"

- 約束覈驗: 逐一覈對"對象計數"、"文字內容"、"小字位置"是否被規划進去

- 衝突解決: 處理潛在的提示衝突 (例如"佔滿畫面"vs"留白")

對於科研範式圖這種"約束密集"的場景,每個小字標籤都是一個獨立約束。普通擴散模型在生成過程中容易"邊畫邊丟約束",而推理機制把所有約束作爲整體規劃,顯著降低了"漏字、錯字、字符堆疊"的概率。

Nano Banana Pro 的 Grounding + 段落語義機制

Nano Banana Pro 基於 Gemini 3 Pro 主幹,它的優勢來自兩個不同方向:

- Google Search Grounding: 在生成時可以檢索真實信息 (例如"2026 年 4 月的最新匯率"、"奧運會賽程"),把可檢索數據嵌入圖像

- 段落級語義連貫: 強語言模型能力讓長段落保持語法和拼寫一致

這兩個機制對"長段落 infographic"和"基於真實數據的可視化"非常友好,但對"碎片化小字標籤"幫助不大——小字標籤往往是命名實體 (產品名、術語縮寫),沒有充分的語義上下文。

| 機制特徵 | GPT-image-2 (Thinking) | Nano Banana Pro (Grounding) |

|---|---|---|

| 適用文本類型 | 碎片化小字、專業術語 | 長段落、可檢索信息 |

| 約束處理方式 | 提前規劃,統一覈驗 | 邊生成邊語義檢查 |

| 錯字根源 | 極少 (~1%) | 主要在小字、專有名詞 |

| 速度影響 | 推理快,~3 秒 | Grounding 檢索拖慢,~10-15 秒 |

| 最適合場景 | 科研圖、UI、技術圖 | 海報、長段落、實時數據圖 |

爲什麼"小字"是分水嶺

字號大小不是問題的本質,問題的本質是"信息密度 / 像素"。當一個 8pt 標籤需要在 50×20 像素區域內畫清楚 12 個字符,模型需要在極小空間裏同時處理字形、間距、對齊、像素抖動。這是一個"高約束密度"場景,O 系列推理的優勢在這裏被完全放大。

🎯 技術建議: 如果你的項目同時涉及科研圖和長段落 infographic,建議在工程側做模型路由——按"字號閾值"自動分流到不同模型。這套路由可以通過 API易 apiyi.com 平臺一套接口實現,無需對接兩套 SDK,降低工程複雜度。

GPT-image-2 vs Nano Banana Pro Prompt 工程對比

兩個模型的"調教方式"也不一樣。同樣的需求,prompt 寫法不同會帶來明顯的質量差異。

GPT-image-2 友好的 Prompt 模式

GPT-image-2 偏好"結構化指令 + 顯式約束",模仿它的 O 系列推理風格。

推薦寫法:

A research paradigm diagram with the following elements:

Title (top center, 24pt bold): "End-to-End ML Pipeline"

Three stages (left to right, connected by arrows):

1. "Data Preprocessing" (sub-modules: Tokenization, Normalization)

2. "Model Training" (sub-modules: Forward Pass, Backpropagation)

3. "Evaluation" (sub-modules: F1 Score, ROC-AUC)

Footer (bottom-right, 8pt): "Figure 1. ML Paradigm v2.3"

Style: academic, white background, dark blue boxes, sans-serif font.

關鍵點:用編號列表、明確字號、明確位置,讓 Thinking 機制可以"逐項覈驗"。

Nano Banana Pro 友好的 Prompt 模式

Nano Banana Pro 偏好"自然語言描述 + 上下文敘事",更接近創作型寫作。

推薦寫法:

A clean academic-style research paradigm diagram showing

how a machine learning pipeline progresses through three

stages: starting with data preprocessing where raw inputs

are tokenized and normalized, then moving to model training

where forward passes and backpropagation iterate, and

finally reaching evaluation where F1 score and ROC-AUC

are computed. Connect the stages with arrows. Title at top:

"End-to-End ML Pipeline". Use a clean, white background

with dark blue rounded boxes.

關鍵點:把流程"講故事",讓 Gemini 主幹模型用語義連貫能力把整體感處理好。

Prompt 調優速查表

| 優化點 | GPT-image-2 寫法 | Nano Banana Pro 寫法 |

|---|---|---|

| 文字內容 | 用引號包裹: "Figure 1" |

自然語言: showing "Figure 1" |

| 元素列表 | 編號 1./2./3. | 自然連接詞: first… then… |

| 字號指定 | 顯式: 8pt small print |

描述: tiny annotation |

| 位置指定 | 精確: top-right corner |

自然: in the upper right |

| 風格指定 | 關鍵詞: sans-serif, academic |

句式: clean academic style |

| 約束強度 | 越顯式越好 | 自然語言更穩 |

通用技巧 (兩個模型都適用)

- 關鍵文字必須用引號包裹: 否則模型可能"意譯"你的文字

- 8pt 小字儘量少: 即使是 GPT-image-2,也建議不超過 5-6 個獨立小字標籤

- 避免衝突約束: "極簡風" + "信息密集"會讓兩個模型都困惑

- 生成 3-4 張取最佳: 文字渲染本身有概率性,多生成幾張是行業標準做法

🚀 快速開始: 通過 API易 apiyi.com 平臺搭建對比測試管線,可以在同一個 prompt 上一次性請求兩個模型並並排展示輸出,5 分鐘內完成搭建,便於快速找到最適合自己業務的模型組合。

GPT-image-2 vs Nano Banana Pro 場景推薦

經過多輪實測,我們可以給出明確的場景級選型建議。

優先選擇 GPT-image-2 的場景

- 科研範式圖: 高密度小字+專業術語+流程箭頭,GPT-image-2 的 Thinking 機制和 99% 文字準確率是結構性優勢

- 技術架構圖: 含技術棧名稱 (FastAPI/Elasticsearch/PostgreSQL 等易拼錯的英文專有名詞)

- 數據可視化: 座標軸刻度、圖例、誤差棒、角標等 6-8pt 小字

- UI 截圖與 mockup: 按鈕文字、狀態徽章、菜單項等密集 UI 文字

- infographic 海報: "Intelligence Layer" 這類專業標題+小字註腳的混排

- 多語言混排: 中英日韓混合標註的圖表

- 公式與符號: 含 α/β/H₀/p-value 等希臘字母、上下標、統計符號

- 快速迭代: ~3 秒/張的生成速度便於反覆調優

優先選擇 Nano Banana Pro 的場景

- 照片級真實感: 產品攝影、人像、建築攝影等高真實度需求

- 長段落 infographic: 文章式排版,文字以段落爲單位 (而非小字標籤)

- 基於實時信息的生成: 需要 Google Search grounding 抓取最新數據 (如最新匯率、最新事件)

- 4K 高分辨率: GPT-image-2 當前最高 2K,Banana Pro 可達 4K (5632×3072)

- 多參考圖編輯: Banana Pro 支持最多 14 張參考圖,編輯場景更靈活

- 空間關係複雜場景: 多對象的前後/左右/上下空間關係,Banana Pro 仍有優勢

- 大段中文段落: 中文長段落 (而非小字標籤) 的排版穩定性

兩者皆可的"中間地帶"

- 單一主標題+副標題的常規配圖

- 簡單 logo 設計

- 風格化插畫 (扁平/水彩/像素風)

- 不含專業術語的封面圖

💡 場景化決策原則: 文字越密、字號越小、術語越專業,越要選 GPT-image-2;文字越長、需要真實感、需要實時信息,越要選 Nano Banana Pro。兩個模型都可在 API易 apiyi.com 平臺一鍵切換,無需重複對接。

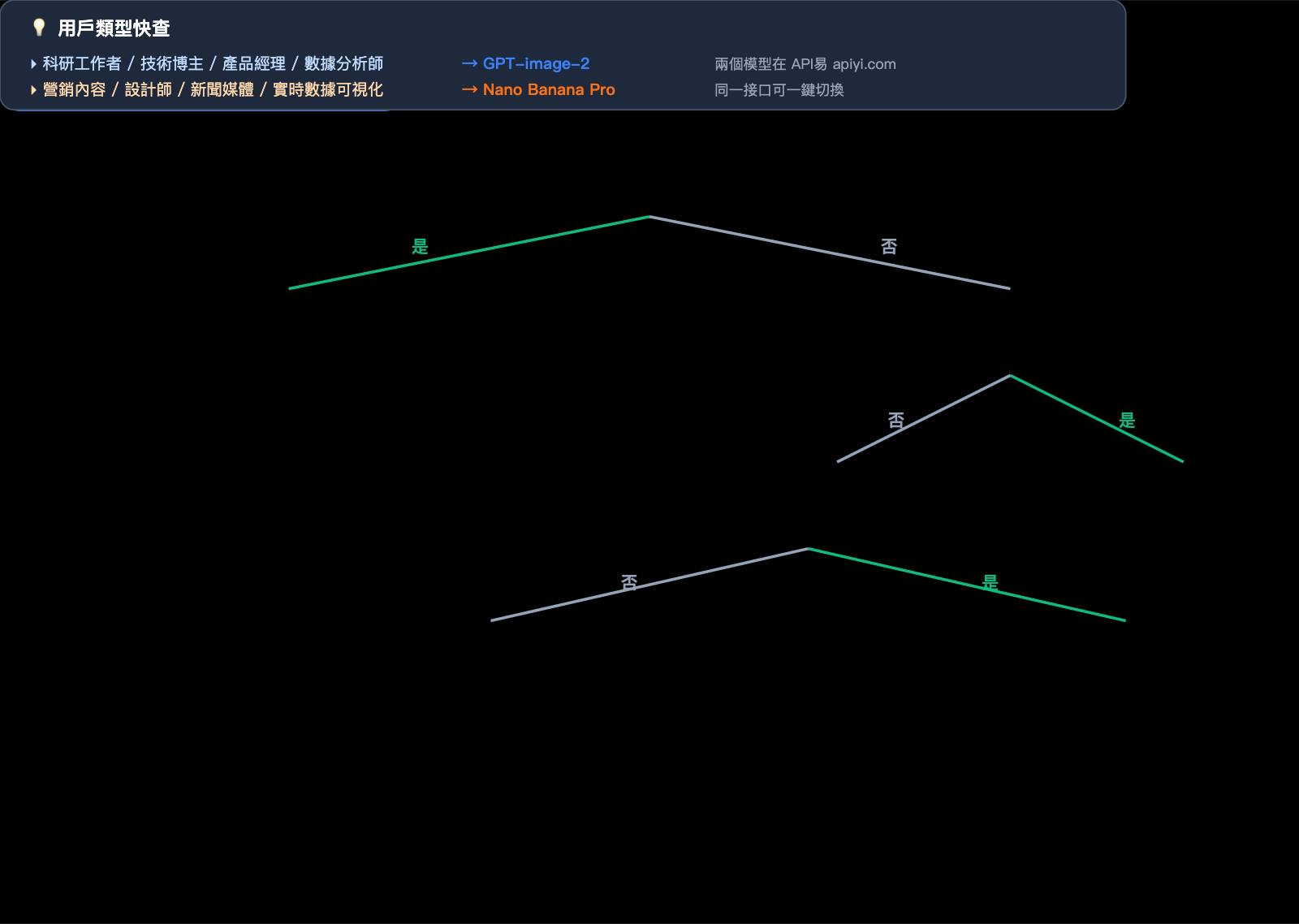

GPT-image-2 vs Nano Banana Pro 決策建議

決策樹:3 個問題決定選哪個

問題 1: 你的圖裏"小字 (8pt 以下)"佔比超過 30% 嗎?

- 是 → GPT-image-2

- 否 → 進入問題 2

問題 2: 你需要照片級真實感嗎?

- 是 → Nano Banana Pro

- 否 → 進入問題 3

問題 3: 你需要 4K 分辨率或基於實時信息生成嗎?

- 是 → Nano Banana Pro

- 否 → GPT-image-2 (速度更快、文字更穩)

不同用戶羣體的推薦

| 用戶類型 | 主要場景 | 首選模型 | 理由 |

|---|---|---|---|

| 科研工作者 | 論文配圖、範式圖、流程圖 | GPT-image-2 | 公式、希臘字母、專業術語穩定 |

| 技術博主 | 架構圖、API 流程圖、代碼示意圖 | GPT-image-2 | 技術名詞無錯拼,UI 截圖逼真 |

| 產品經理 | 產品截圖 mockup、流程圖 | GPT-image-2 | UI 元素文字渲染優勢明顯 |

| 數據分析師 | 圖表小字、座標軸標註 | GPT-image-2 | 6-8pt 小字穩定 |

| 營銷內容 | 海報、長段落 infographic | Nano Banana Pro | 長段落排版+真實感更強 |

| 設計師 | 照片合成、產品攝影 | Nano Banana Pro | 真實感和細節質感領先 |

| 新聞媒體 | 實時信息可視化 | Nano Banana Pro | Google Search grounding 優勢 |

成本與速度考量

GPT-image-2 在 LM Arena 實測中單張約 3 秒,Nano Banana Pro 通常 10-15 秒。如果你的工作流是"反覆迭代調整 prompt 直到滿意",GPT-image-2 的速度優勢能顯著縮短迭代週期。

💰 成本優化: 對於需要大批量生成科研圖/技術圖的團隊,建議通過 API易 apiyi.com 平臺調用兩個模型。該平臺提供靈活的計費方式和多模型統一管理,便於按場景切換最經濟的模型,適合中小團隊和個人開發者。

GPT-image-2 vs Nano Banana Pro 常見問題

Q1: GPT-image-2 真的能”吊打” Nano Banana Pro 嗎?

要看場景。在 LM Arena 文生圖榜單上,GPT-image-2 (1512 Elo) 比 Nano Banana Pro (1271 Elo) 高 +242 分,是 LM Arena 歷史上最大的領先差距。但這一差距主要來自文字渲染、UI 重構、世界知識等維度。在照片級真實感、空間推理上,Nano Banana Pro 仍有優勢。所以"吊打"的說法在"含小字圖、科研圖、UI 圖"場景下成立,在"攝影級真實感"場景下不成立。建議通過 API易 apiyi.com 平臺同時接入兩個模型,按場景切換。

Q2: GPT-image-2 的 99% 文字準確率是真的嗎?

LM Arena 實測和早期測試者報告確認了這一數據,且適用於 Latin、中日韓 (CJK)、Hindi、Bengali 等多種文字體系。但要注意"99%"是字符級準確率,不是 100%。在極端場景 (5pt 以下超小字、罕見專業符號、複雜數學公式嵌套) 仍有少量錯誤。對比之下,GPT Image 1.5 是 95%、GPT Image 1 是 90%、Nano Banana Pro 在長段落場景接近 95%、在小字場景下降到約 80-85%。

Q3: 我用 GPT-image-2 生成科研範式圖時,希臘字母 α 還是會偶爾出錯怎麼辦?

可以在 prompt 裏明確寫 "Use Unicode Greek letter alpha (α, U+03B1)" 這種提示,配合 Thinking 模式 (默認開啓) 命中率會更高。如果仍出錯,建議生成 3-4 張取最佳,或在 prompt 裏改成英文 "alpha"+後期 PS 替換。多次實驗後再決定。

Q4: 爲什麼 Nano Banana Pro 長段落文字反而更穩?

Nano Banana Pro 基於 Gemini 3 Pro 主幹,受益於強語言模型的"段落級語義連貫"能力。它把長段落當作"語義單元"來處理,整體語法和拼寫很穩。但小字標籤是"碎片化命名實體",沒有語義上下文做約束,所以容易出錯。GPT-image-2 通過 O 系列推理把"小字標籤作爲約束"提前規劃,繞開了這個問題。

Q5: GPT-image-2 和 Nano Banana Pro 在 API易 平臺調用方式一樣嗎?

是的。API易 apiyi.com 平臺爲多種主流圖像模型提供統一的 OpenAI-Compatible 接口,僅需更換 model 字段 (gpt-image-2 或 gemini-3-pro-image-preview) 即可切換,base_url 和 SDK 調用方式保持一致。這對需要做 A/B 對比、按場景路由模型的項目特別友好,避免維護多套 SDK 的成本。

Q6: 我以前用 BananaPro 習慣了,遷到 GPT-image-2 需要重新調 prompt 嗎?

需要小幅調整,但成本不大。Nano Banana Pro 偏好"自然語言描述+上下文",GPT-image-2 在結構化指令下表現更好。建議在 prompt 里加入:1) 明確的元素列表 (用 1./2./3. 編號);2) 字體風格指定 (sans-serif/monospace/serif);3) 關鍵文字用引號包裹 (例如 "Figure 1. ML Paradigm")。其他描述風格保持不變即可。

Q7: 兩個模型都生成失敗時怎麼排查?

按以下順序排查:1) 檢查 prompt 是否觸發內容審覈 (人物面部、敏感內容);2) 縮短 prompt,去掉衝突約束 ("photorealistic" 同時要 "minimalist illustration");3) 調整 size/quality 參數;4) 切到另一個模型試試;5) 如果是 API 報錯,可在 API易 apiyi.com 控制檯查看詳細錯誤碼和重試策略。

Q8: 哪些場景下 GPT-image-2 也會輸給 Nano Banana Pro?

主要三類:1) 4K 超高分辨率 (Banana Pro 支持 5632×3072,GPT-image-2 最高 2K);2) 多對象空間推理 (例如"5 個物品在 3 個櫃子裏的特定位置");3) 超長段落 infographic (200 字以上段落連貫排版)。這些場景建議直接選 Nano Banana Pro。

GPT-image-2 vs Nano Banana Pro Key Takeaways

- 文字渲染斷崖式領先: GPT-image-2 在 LM Arena 文生圖榜單 +242 Elo 分領先 Nano Banana Pro,是 LM Arena 歷史最大差距,主要來自 ~99% 字符級文字準確率

- 科研圖場景結構性優勢: 在科研範式圖、技術架構圖、數據可視化、UI mockup 等"高文字密度"場景,GPT-image-2 的 O 系列推理 + 99% 準確率構成結構性優勢

- 小字與公式穩定: 6-8pt 座標軸刻度、希臘字母、上下標、統計符號在 GPT-image-2 下穩定渲染,Nano Banana Pro 在這些細節上仍易出錯

- 生成速度領先 3-5 倍: GPT-image-2 單張約 3 秒,Nano Banana Pro 單張 10-15 秒,對快速迭代場景是巨大優勢

- Banana Pro 仍有專屬優勢: 4K 分辨率、照片級真實感、長段落連貫文本、Google Search grounding、多對象空間推理是其繼續領先的領域

- 場景化選型原則: 文字越密/字號越小/術語越專業 → GPT-image-2;需要真實感/4K/實時信息 → Nano Banana Pro

- 統一接口降低切換成本: 通過 API易 apiyi.com 平臺可用同一套 SDK 切換兩個模型,便於按場景路由,避免維護多套對接代碼

總結

GPT-image-2 vs Nano Banana Pro 這個對比,在不同場景下會得到完全不同的結論。如果只看 LM Arena 整體榜單,GPT-image-2 +242 Elo 的領先確實"吊打"。但深入到具體場景,兩者的相對優勢是清晰且可預測的:

- 科研範式圖、含小字的技術圖、含專業術語的圖表 → 選 GPT-image-2

- 照片級真實感、長段落 infographic、需要實時信息的圖 → 選 Nano Banana Pro

對於以"作圖含大量文字、特別是小字" 爲核心需求的科研工作者、技術博主、產品經理,GPT-image-2 的能力躍遷是真實且可感的:從 GPT Image 1 的 90% 到 GPT Image 1.5 的 95% 再到 GPT-image-2 的 99%,每一代都把"AI 生成的圖能不能直接用"的邊界往前推了一大步。

推薦通過 API易 apiyi.com 平臺同時接入兩個模型,根據具體任務類型動態切換,把每個模型用在它最擅長的場景,而不是把所有需求都押在一個模型上。

參考資料

-

OpenAI ChatGPT Images 2.0 官方公告: GPT-image-2 發佈說明

- 鏈接:

openai.com/index/introducing-chatgpt-images-2-0 - 說明: 官方 2026-04-21 發佈說明、模型能力清單

- 鏈接:

-

Google DeepMind Nano Banana Pro 官方頁: Gemini 3 Pro Image 模型說明

- 鏈接:

deepmind.google/models/gemini-image/pro - 說明: 官方能力描述、定價、參考圖數量等

- 鏈接:

-

LM Arena Text-to-Image Leaderboard: 文生圖模型 Elo 排行

- 鏈接:

arena.ai/leaderboard/text-to-image - 說明: GPT-image-2 1512 Elo vs Nano Banana Pro 1271 Elo

- 鏈接:

-

Simon Willison Nano Banana Pro 實測: 獨立開發者實測報告

- 鏈接:

simonwillison.net/2025/Nov/20/nano-banana-pro - 說明: 4K 分辨率實測、infographic 案例

- 鏈接:

-

VentureBeat ChatGPT Images 2.0 報道: 多語言 + infographic 測評

- 鏈接:

venturebeat.com/technology/openais-chatgpt-images-2-0-is-here - 說明: 多語種文字渲染、漫畫/地圖/海報實測

- 鏈接:

作者: APIYI 技術團隊 | 更多 AI 大模型 API 接入與對比,歡迎訪問 API易 apiyi.com 進行實際測試。