Si vous souhaitez qu'OpenClaw puisse invoquer directement le modèle d'image le plus performant d'OpenAI, gpt-image-2, quelle serait votre première idée ? La plupart des gens penseraient immédiatement à ouvrir leur éditeur, écrire un script Python avec requests.post(...), puis l'encapsuler dans une fonction utilitaire pour l'Agent.

Ce n'est pas impossible, mais cette approche vous expose immédiatement à quatre problèmes :

- Vous devez gérer l'upload des images de référence en

multipart/form-data. - Vous devez implémenter la logique de réessai, de timeout et de limitation de débit (429).

- Vous devez écrire une encapsulation différente pour chaque scénario (texte vers image, image vers image, masques, traitement par lots).

- À chaque changement de client OpenClaw (ou Claude Code, Cursor), vous devez tout réintégrer.

En 2026, la réponse a changé : n'écrivez plus de code, installez simplement un Skill.

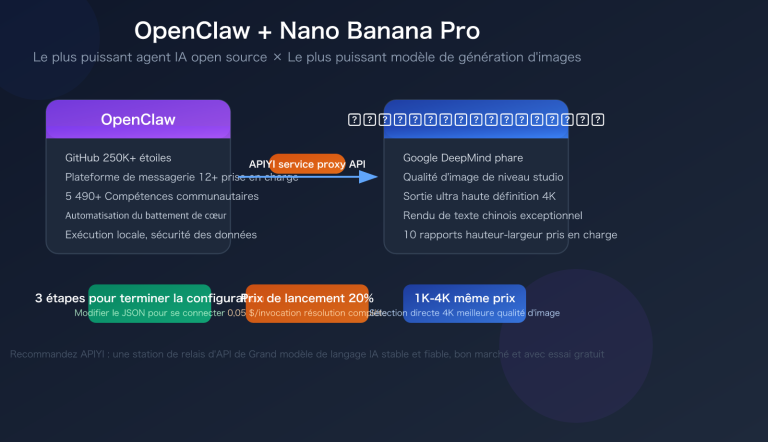

OpenClaw prend en charge un écosystème complet de Skills — le registre ClawHub compte actuellement plus de 5 700 Skills contribués par la communauté. Cet article présente les deux Skills officiels gpt-image-2 contribués par l'équipe APIYI au dépôt expert-skills-hub :

apiyi-gpt-image-2-gen(flux direct / contrôle précis, recommandé)apiyi-gpt-image-2-all-gen(flux inverse / mode économique)

L'installation d'un Skill se fait en une seule ligne de commande, la configuration de la clé API nécessite juste un export, et vous pouvez ensuite demander directement dans OpenClaw : "Aide-moi à générer une image produit d'une tasse en céramique en 4K". L'Agent sélectionnera automatiquement le Skill, remplira les paramètres et enregistrera le fichier.

En suivant ce tutoriel sur l'intégration de gpt-image-2 dans OpenClaw, vous obtiendrez :

- Une comparaison claire entre "écrire du code" et "installer un Skill", pour comprendre pourquoi cette dernière option est supérieure.

- Deux Skills officiels prêts à l'emploi, couvrant les besoins de haute qualité et de traitement économique par lots.

- Un exemple minimal opérationnel en 5 étapes (pour Node.js et Python).

- Trois commandes pratiques (affiche 4K / synthèse d'images de référence / croquis par lots).

- La méthode pour réutiliser la même suite de Skills dans Claude Code et Cursor.

I. Pourquoi les Skills sont la solution optimale pour intégrer gpt-image-2 dans OpenClaw

1.1 Le système de Skills d'OpenClaw : la méthode standard pour booster votre Agent

OpenClaw est un assistant IA open source multiplateforme (dépôt GitHub github.com/openclaw/openclaw). Son objectif n'est pas d'être "juste une autre fenêtre de chat", mais de fournir à l'Agent une boîte à outils composable. L'unité de base de cette boîte à outils est appelée Skill.

Un Skill est essentiellement :

skill-package/

├── SKILL.md # Indique à l'Agent ce que fait ce Skill

├── scripts/

│ ├── generate_image.js # Runtime Node.js

│ └── generate_image.py # Runtime Python

└── requirements.txt / package.json

Lorsque vous demandez "Aide-moi à dessiner une tasse de café", OpenClaw va :

- Scanner le résumé

SKILL.mdde tous les Skills installés. - Déterminer que

apiyi-gpt-image-2-genest le plus adapté pour la "génération d'images". - Extraire les paramètres de votre langage naturel (dimensions, qualité, format de sortie).

- Appeler le

generate_image.js/pycorrespondant. - Vous renvoyer le chemin de l'image générée.

Tout le processus se fait sans écrire de code, sans configurer de routage et sans manipuler de SDK. C'est l'avantage majeur de l'écosystème OpenClaw par rapport au mode traditionnel de "création de plugins".

1.2 Écrire du code vs Installer un Skill : un tableau comparatif

| Dimension | Code HTTP manuel | Installation de Skill officiel |

|---|---|---|

| Coût de démarrage | 30 minutes minimum | 1 ligne de commande, 30 secondes |

| Détails HTTP | Gestion manuelle du multipart, réessais, timeouts | Encapsulé dans le Skill |

| Upload image de réf. | Encodage base64 manuel | Transmission directe du chemin de fichier |

| Runtimes multiples | Soit Node, soit Python | Node.js + Python inclus |

| Perception Agent | Description d'outil à rédiger soi-même | SKILL.md inclus |

| Multi-client | Réintégration à chaque changement | Compatible Claude Code / Cursor / OpenClaw |

| Mise à jour | Suivi manuel des API OpenAI | npx skills update en un clic |

| Changement de ligne | Modification du code | Modification des variables d'environnement |

En d'autres termes, écrire du code fait de vous un ouvrier de la colle qui passe son temps à maintenir ses scripts, tandis qu'installer un Skill délègue cette maintenance à l'auteur du Skill.

1.3 Répartition des tâches entre les deux Skills : choisir le bon outil

L'équipe APIYI a contribué deux Skills pour gpt-image-2 au dépôt expert-skills-hub, destinés à des scénarios totalement différents :

| Nom du Skill | Alias du modèle | Positionnement | Modèle de prix | Meilleur scénario |

|---|---|---|---|---|

apiyi-gpt-image-2-gen |

gpt-image-2 |

Flux direct / Contrôle précis | Facturation au token | Affiches, photos produits, couvertures, 4K |

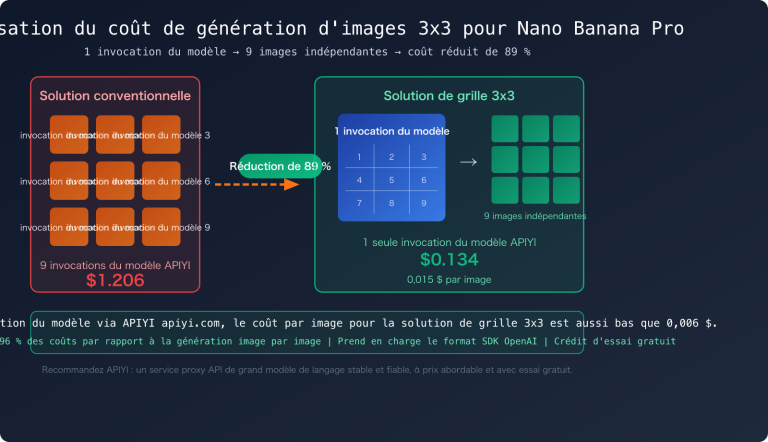

apiyi-gpt-image-2-all-gen |

gpt-image-2-all |

Flux inverse / Mode économique | Fixe $0.03/image | Concepts par lots, prompt chinois, exploration |

Les deux Skills partagent la même APIYI_API_KEY et utilisent la passerelle APIYI en backend. Vous pouvez installer les deux simultanément, permettant à l'Agent OpenClaw de choisir automatiquement selon le contexte : génération d'affiche via le flux direct, création de 100 variantes via le flux économique.

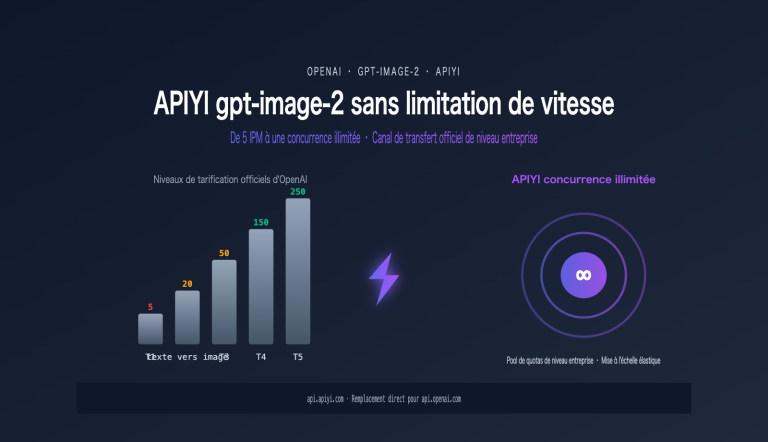

1.4 Backend : Les trois lignes APIYI apiyi.com

Les requêtes HTTP des deux Skills sont dirigées par défaut vers api.apiyi.com, le site principal d'APIYI.

🎯 Conseil de ligne : Pour les environnements de production, nous recommandons de basculer la

APIYI_BASE_URLd'OpenClaw vers la ligne haute performancevip.apiyi.comd'APIYI, surtout pour les traitements par lots. Le site principalapi.apiyi.comest idéal pour les appels unitaires, la ligne VIPvip.apiyi.comest adaptée aux files d'attente massives ou nocturnes, etb.apiyi.comsert de secours automatique (fallback). Les trois lignes partagent la même clé, il suffit de modifier une variable d'environnement pour basculer.

二、 5 minutes pour intégrer OpenClaw à gpt-image-2

2.1 Vérification de l'environnement

Avant d'intégrer OpenClaw à gpt-image-2, assurez-vous que votre environnement est prêt :

| Élément | Exigence | Commande de vérification |

|---|---|---|

| OpenClaw installé | Dernière version | openclaw --version |

| Node.js | 18+ | node --version |

| Python | 3.10+ (optionnel) | python3 --version |

| npx | Inclus avec Node | npx --version |

| Réseau | Accès à github.com et api.apiyi.com | curl -I api.apiyi.com |

| Clé API APIYI | Obtenue via la console api.apiyi.com |

Préfixe sk- |

⚠️ Attention : Si la commande

npx skillsest introuvable dans votre version d'OpenClaw, mettez à jour vers la dernière version (openclaw update). La CLI Skills est une capacité essentielle de l'écosystème OpenClaw 2026, absente des anciennes versions.

2.2 Étape 1 : Installer le Skill en une commande

Ouvrez votre terminal et installez le Skill correspondant à votre usage. Nous recommandons d'installer les deux :

# Transfert direct (recommandé pour un usage quotidien)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub \

--skill apiyi-gpt-image-2-gen

# Transfert inversé (idéal pour le traitement par lots / invites en chinois)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub \

--skill apiyi-gpt-image-2-all-gen

Une fois la commande terminée, le Skill sera placé dans le répertoire par défaut d'OpenClaw (généralement ~/.openclaw/skills/). Vous pouvez vérifier l'installation avec :

npx skills list

# Sortie attendue :

# - apiyi-gpt-image-2-gen ✓ installé

# - apiyi-gpt-image-2-all-gen ✓ installé

2.3 Étape 2 : Configurer la clé API

L'intégration d'OpenClaw avec gpt-image-2 ne nécessite qu'une seule variable d'environnement :

# macOS / Linux

export APIYI_API_KEY="sk-votre-cle-ici"

# Windows PowerShell

$env:APIYI_API_KEY = "sk-votre-cle-ici"

Il est conseillé d'ajouter cette ligne à votre ~/.zshrc ou ~/.bashrc pour la rendre permanente.

🎯 Obtenir une clé : Visitez APIYI sur

apiyi.com, inscrivez-vous, puis accédez à la console → API Keys → Créer une clé. Nous vous conseillons d'activer la limite d'utilisation et de définir un plafond quotidien (ex: 50 ¥) pour la clé utilisée par OpenClaw afin d'éviter toute consommation excessive accidentelle.

Optionnel : bascule entre trois lignes si vous avez besoin d'une haute concurrence pour des traitements par lots :

export APIYI_BASE_URL="https://vip.apiyi.com/v1" # Ligne VIP

# ou

export APIYI_BASE_URL="https://b.apiyi.com/v1" # Ligne de secours

Par défaut, le système utilise https://api.apiyi.com/v1.

2.4 Étape 3 : Générer votre première image (Node.js)

Le Skill inclut des scripts d'exemple. Voici la commande de vérification la plus simple :

cd ~/.openclaw/skills/apiyi-gpt-image-2-gen

node scripts/generate_image.js \

-p "Une affiche minimaliste avec le texte 'HELLO 2026' centré" \

-s "1024x1024" \

-q "medium" \

-o "png" \

-f "./hello_2026.png"

Après environ 20 à 40 secondes, le terminal affichera :

✔ Image générée : ./hello_2026.png (1024x1024, png, 312 Ko)

Ouvrez hello_2026.png ; vous devriez voir une affiche minimaliste avec le texte "HELLO 2026" bien net. Si le texte est lisible, cela signifie que toute la chaîne (OpenClaw Skill → APIYI api.apiyi.com → OpenAI gpt-image-2) est opérationnelle.

2.5 Étape 4 : Générer votre première image (Version Python)

Si votre projet utilise la stack Python, le même Skill inclut également un script Python :

cd ~/.openclaw/skills/apiyi-gpt-image-2-gen

python3 scripts/generate_image.py \

-p "Une affiche minimaliste avec le texte 'HELLO 2026' centré" \

-s "1024x1024" \

-q "medium" \

-o "png" \

-f "./hello_2026.png"

Les paramètres sont identiques à la version Node.js, avec les cinq options courtes -p/-s/-q/-o/-f ou leurs équivalents longs (--prompt/--size/--quality/--output-format/--filename).

💡 Pas besoin de changer d'environnement : La présence des deux scripts dans le même package Skill signifie que vous pouvez utiliser Node (pour le frontend) et Python (pour la science des données) dans le même projet. Le Skill d'intégration d'OpenClaw avec gpt-image-2 traite les deux langages sur un pied d'égalité.

2.6 Étape 5 : Appel en langage naturel dans OpenClaw

La CLI ci-dessus sert uniquement à vérifier le Skill. L'usage réel consiste à laisser OpenClaw effectuer l'invocation du modèle de manière autonome. Une fois OpenClaw lancé, donnez simplement votre instruction en langage naturel :

Utilisateur : Aide-moi à générer une image de tasse à thé en céramique en 4K avec gpt-image-2,

lumière douce du matin, fond sobre, format PNG, enregistrer dans ./output/tea_cup.png

OpenClaw : Très bien, j'utilise le Skill apiyi-gpt-image-2-gen pour traiter cette demande.

Paramètres : size=3840x2160, quality=high, output-format=png

Génération en cours...

✔ Terminé : ./output/tea_cup.png (3840x2160, 2.4 Mo)

La couche de raisonnement d'OpenClaw va :

- Identifier le type de tâche = génération d'images.

- Comparer le

SKILL.mddes deux Skills et choisirapiyi-gpt-image-2-gen(car l'utilisateur demande du 4K + PNG). - Traduire "4K" en

3840x2160et intégrer "lumière douce du matin" dans l'invite. - Exécuter

generate_image.jset renvoyer le chemin du fichier.

Vous n'avez prononcé qu'une seule phrase, sans écrire une ligne de code Python ou Node. C'est là toute la valeur de l'intégration d'OpenClaw avec gpt-image-2 via les Skills.

III. Aide-mémoire des paramètres pour l'invocation de gpt-image-2 avec OpenClaw

3.1 Skill de transfert direct : apiyi-gpt-image-2-gen

Il s'agit du mode contrôle précis, recommandé par défaut. Voici le tableau complet des paramètres :

| Option | Option longue | Plage de valeurs | Défaut | Description |

|---|---|---|---|---|

-p |

--prompt |

Texte | Obligatoire | Description de l'image, mélange de mots-clés anglais/français recommandé |

-s |

--size |

LARGEURxHAUTEUR |

1024x1024 |

Multiple de 16, jusqu'à 3840x3840 |

-q |

--quality |

low/medium/high/auto | auto |

high pour les affiches, low pour les croquis |

-o |

--output-format |

png/jpeg/webp | png |

png requis pour un fond transparent |

-c |

--output-compression |

0-100 | 85 |

S'applique uniquement à jpeg/webp |

-i |

--input-image |

Chemin (répétable) | Aucun | Jusqu'à 5 images de référence |

-m |

--mask |

Chemin | Aucun | Masque noir et blanc, blanc = zone à éditer |

-f |

--filename |

Chemin | ./output.png |

Fichier de sortie |

Tailles courantes :

| Usage | Taille recommandée |

|---|---|

| Story Instagram/WeChat | 1080x1080 |

| Portrait Xiaohongshu | 1080x1440 |

| Couverture Bilibili | 1920x1080 |

| Bannière de blog | 1600x900 |

| Affiche 4K | 3840x2160 |

| Bannière longue | 2400x800 |

| Fond d'écran mobile | 1170x2532 |

3.2 Skill de transfert inversé : apiyi-gpt-image-2-all-gen

Il s'agit du mode économique par lot, facturé environ 0,03 $ par image. Paramètres simplifiés :

| Option | Option longue | Plage de valeurs | Description |

|---|---|---|---|

-p |

--prompt |

Texte | Description, taille/ratio à inclure dans le texte |

-r |

--response-format |

url / b64_json | url (lien CDN 24h) ou b64_json (Base64) |

-i |

--input-image |

Chemin (répétable) | Jusqu'à 5 images de référence |

-f |

--filename |

Chemin | Fichier de sortie (téléchargement auto en mode url) |

Le Skill inversé n'expose pas -s/-q/-o, car le modèle sous-jacent est conversationnel ; la taille doit être spécifiée dans l'invite :

# Exemple correct

-p "Générer un fond d'écran horizontal 16:9, paysage urbain cyberpunk nocturne, néons"

# Exemple incorrect (le mode inversé ne supporte pas -s)

-p "Paysage urbain cyberpunk" -s "1920x1080" # ❌

3.3 Trois commandes pratiques

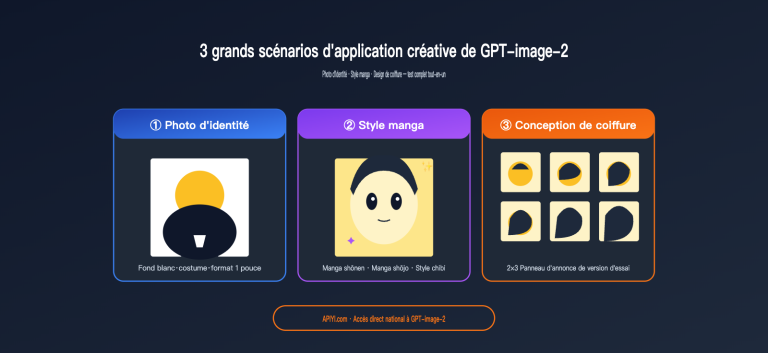

Pratique 1 : Affiche de film 4K (Transfert direct)

node scripts/generate_image.js \

-p "Cinematic poster for sci-fi novel 'NEON HORIZON', \

dark blue and magenta gradient sky, lone silhouette on cliff, \

bold serif title centered at top, subtle tagline bottom, \

35mm film grain" \

-s "3840x5760" \

-q "high" \

-o "png" \

-f "./poster_neon_horizon.png"

- Format portrait 2:3 en 4K

quality=highpour assurer la netteté du texte- Temps de génération : 3 à 5 minutes (dépend fortement de la qualité)

Pratique 2 : Retouche locale avec masque (Direct + Image + Masque)

node scripts/generate_image.js \

-p "Replace the background with luxurious white marble countertop, \

soft natural window light from the left, \

keep product subject pixel-stable" \

-i "./coffee_cup.png" \

-m "./coffee_cup_mask.png" \

-s "2048x2048" \

-q "high" \

-f "./coffee_cup_marble.png"

- Pixels blancs = arrière-plan à remplacer

- Pixels noirs = objet (stabilité des pixels garantie)

- gpt-image-2 préserve la forme de l'objet

Pratique 3 : Concepts par lots (Inversé + boucle)

# 100 concepts de vêtements, 0,03 $ par image, coût total env. 3 $

for i in $(seq 1 100); do

node scripts/generate_image.js \

-p "Design de personnage cyberpunk #${i}, hanfu revisité, tons néon, portrait complet" \

-r "url" \

-f "./concepts/concept_${i}.png"

done

- Le Skill inversé gère mieux les invites en français

- Le mode

-r urltélécharge automatiquement les fichiers en local - Pour les lots, utilisez

APIYI_BASE_URL=https://vip.apiyi.com/v1

IV. Combinaisons avancées pour OpenClaw et gpt-image-2

4.1 Laisser l'Agent choisir le Skill

Une fois les deux Skills installés, OpenClaw choisit automatiquement selon votre demande. Pour plus de précision, utilisez des signaux dans vos invites :

| Votre demande | Tendance de l'Agent |

|---|---|

| "Haute qualité", "4K", "Affiche", "Commercial" | Direct apiyi-gpt-image-2-gen |

| "Croquis", "Lot", "Concept", "Français" | Inversé apiyi-gpt-image-2-all-gen |

| "Générer 10 images pour voir" | Inversé (économique) |

| "Changer le fond avec un masque" | Direct (le masque n'est pas supporté en inversé) |

| "Coût fixe 0,03 $ par image" | Inversé |

🎯 Astuce d'invite : Utilisez des termes comme "contrôle précis" ou "lot économique" pour que l'Agent sélectionne le bon Skill à 100 %.

4.2 Chaîne de Skills : Génération → OCR → Traduction

Les Skills peuvent être enchaînés par l'Agent. Exemple : "Générer une affiche avec un slogan en anglais, puis traduire le slogan en japonais" :

Utilisateur : Génère une affiche minimaliste avec le slogan "Less is more",

puis génère la même version avec le slogan en japonais

OpenClaw :

Étape 1 : apiyi-gpt-image-2-gen (version anglaise)

→ ./en_poster.png

Étape 2 : apiyi-gpt-image-2-gen (version japonaise, avec en_poster.png en référence)

-i ./en_poster.png

-p "Même mise en page, remplacer le texte par 'より少なく、より豊かに'"

→ ./jp_poster.png

4.3 Intégration CI/CD

Les scripts étant des CLI standards, ils s'intègrent parfaitement dans vos pipelines :

# .github/workflows/generate-og-image.yml

name: Generate OG image on release

on:

release:

types: [published]

jobs:

og-image:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v4

- uses: actions/setup-node@v4

with: { node-version: '20' }

- run: npx skills add https://github.com/wuchubuzai2018/expert-skills-hub --skill apiyi-gpt-image-2-gen

- env:

APIYI_API_KEY: ${{ secrets.APIYI_API_KEY }}

run: |

node ~/.openclaw/skills/apiyi-gpt-image-2-gen/scripts/generate_image.js \

-p "Image de couverture pour la release ${{ github.event.release.tag_name }}" \

-s "1200x630" \

-q "high" \

-f "./og-image.png"

- uses: actions/upload-artifact@v4

with: { name: og-image, path: ./og-image.png }

4.4 Réutilisation dans Claude Code et Cursor

Les Skills apiyi-gpt-image-2-gen et apiyi-gpt-image-2-all-gen respectent les standards ouverts :

| Client | Support | Note |

|---|---|---|

| OpenClaw | ✅ | Scénario principal |

| Claude Code | ✅ | Placer dans ~/.claude/skills/ |

| Cursor | ✅ | Référence via fichier Rules |

| Windsurf | ✅ | Compatible avec la norme Skill |

| Agent personnalisé | ⚠️ | Nécessite un adaptateur de Tool |

"Une installation, réutilisation multi-clients" : vos capacités de génération d'images vous suivent partout.

V. FAQ sur l'intégration d'OpenClaw avec gpt-image-2

Q1 : npx skills add renvoie "command not found" ?

Assurez-vous qu'OpenClaw est à jour (openclaw update), car les anciennes versions ne disposent pas du CLI Skills. Si l'erreur persiste, vous pouvez cloner manuellement le dépôt dans le répertoire ~/.openclaw/skills/ en guise de solution de secours.

Q2 : Le script indique "APIYI_API_KEY is not set" ?

Vérifiez ces trois points :

echo $APIYI_API_KEYpour voir si la variable a été exportée correctement.- Vérifiez que votre clé commence bien par le préfixe

sk-. - Si vous venez de l'ajouter à

~/.zshrc, ouvrez un nouveau terminal pour appliquer les changements.

Q3 : Comment basculer vers la ligne à haute concurrence vip.apiyi.com ?

Deux options :

# Option 1 : Variable d'environnement globale

export APIYI_BASE_URL="https://vip.apiyi.com/v1"

# Option 2 : Préfixe pour un appel unique

APIYI_BASE_URL="https://vip.apiyi.com/v1" node scripts/generate_image.js ...

Il en va de même pour le domaine de secours : b.apiyi.com. Les trois domaines partagent la même clé. En cas d'instabilité sur le site principal, basculer manuellement vers le VIP permet généralement un rétablissement immédiat. Pour plus de détails, consultez le guide de basculement de ligne dans la documentation officielle d'APIYI sur docs.apiyi.com.

Q4 : Comment choisir entre le mode "inverse" et "direct" ?

Référez-vous à ce tableau décisionnel :

| Si vous avez besoin de… | Choisir |

|---|---|

Contrôle précis de la résolution (ex: 1920x1080) |

Direct |

| Utiliser un masque pour l'inpainting | Direct |

| Affiches haute qualité 4K et plus | Direct |

| Traitement par lots (50+ images) | Inverse |

| Prompt en chinois prédominant | Inverse |

| Coûts prévisibles (0,03 $ par image) | Inverse |

La méthode la plus simple : installez les deux et laissez l'agent OpenClaw choisir automatiquement en fonction de votre langage naturel.

Q5 : Est-ce compatible avec Claude Code ?

Oui. Il suffit de créer un lien symbolique ou de copier le package Skill de ~/.openclaw/skills/ vers ~/.claude/skills/. Claude Code reconnaîtra automatiquement le fichier SKILL.md et l'enregistrera comme outil appelable. La même APIYI_API_KEY sera utilisée.

Q6 : Les Skills sont-ils sécurisés ?

La prudence est de mise dans l'écosystème communautaire. En février 2026, 341 Skills malveillants ont été détectés sur ClawHub, distribuant le malware Atomic Stealer. Nos recommandations :

- N'installez que des Skills provenant de dépôts de confiance (le dépôt

wuchubuzai2018/expert-skills-hubmentionné ici est la source officielle d'APIYI). - Après l'installation, examinez le contenu de

SKILL.mdet des scripts, en prêtant une attention particulière aux commandescurl | bashou aux connexions vers des domaines inconnus. - Utilisez

npx skills inspect <nom-du-skill>pour voir quelles adresses réseau le Skill sollicite.

Tous les appels des Skills officiels d'APIYI sont dirigés uniquement vers *.apiyi.com, ce qui permet un audit de sécurité fiable.

Q7 : Que faire si la génération 4K est lente ?

- C'est normal. Une génération

quality=highen3840x2160prend environ 3 à 5 minutes. - Ajoutez une protection contre les délais d'attente (timeout) dans vos scripts (ex:

timeout 360 node ...sous Bash). - Pour une prévisualisation rapide, générez d'abord un brouillon en

size=2048x1152 quality=medium, puis passez en 4K une fois le résultat validé.

Q8 : Comment surveiller les coûts ?

Activez les "Alertes de budget quotidien" et les "Statistiques par clé" dans la console APIYI sur apiyi.com. En définissant un plafond pour la clé dédiée à OpenClaw, vous pouvez suivre la consommation et limiter les pertes en cas d'imprévu.

VI. Conclusion sur l'intégration d'OpenClaw avec gpt-image-2

Avec le recul, la meilleure approche pour l'intégration d'OpenClaw avec gpt-image-2 en 2026 est passée du "codage manuel" à "l'installation de Skills". Les raisons sont simples :

- Plus rapide : Deux commandes (

npx skills add+export KEY) suffisent en 30 secondes. - Plus stable : Les détails HTTP, les stratégies de réessai et la validation des paramètres sont encapsulés dans le Skill, avec des mises à jour gérées par l'auteur.

- Plus polyvalent : Le même Skill est utilisable dans OpenClaw, Claude Code et Cursor.

- Plus intelligent : L'agent comprend le fichier

SKILL.mdet décide lui-même quand et quel outil utiliser.

Les deux Skills fournis par APIYI, apiyi-gpt-image-2-gen (contrôle précis) et apiyi-gpt-image-2-all-gen (traitement économique par lots), couvrent parfaitement les scénarios les plus courants. Les installer simultanément est le point de départ idéal : que ce soit pour une affiche 4K ou 100 ébauches conceptuelles, l'agent OpenClaw choisira automatiquement le bon Skill.

🎯 Conseils de mise en œuvre : Commencez par demander une clé de test sur

apiyi.com(avec une limite quotidienne de 20 à 50 ¥), puis suivez les 5 étapes de la section §2 pour valider un exemple minimal. Une fois la connexion établie, testez les affiches 4K et l'inpainting avec masque selon la section §3. En cas d'instabilité, basculez votreAPIYI_BASE_URLversvip.apiyi.comoub.apiyi.com. Pour des combinaisons de Skills plus complexes ou des exemples CI/CD, consultez la section dédiée aux Skills dans la documentation officielledocs.apiyi.com.

Vous disposez désormais d'une solution complète et réutilisable pour l'intégration d'OpenClaw avec gpt-image-2. La seule chose qu'il vous reste à faire est de rayer définitivement "écrire un outil d'appel d'image" de votre liste de tâches : laissez les Skills s'en charger.

Auteur : Équipe technique APIYI

Ressources associées :

- Dépôt des Skills : github.com/wuchubuzai2018/expert-skills-hub

- Page d'accueil OpenClaw : github.com/openclaw/openclaw

- Site officiel APIYI : apiyi.com

- Documentation APIYI : docs.apiyi.com

- Site principal APIYI : api.apiyi.com (secours : vip.apiyi.com / b.apiyi.com)