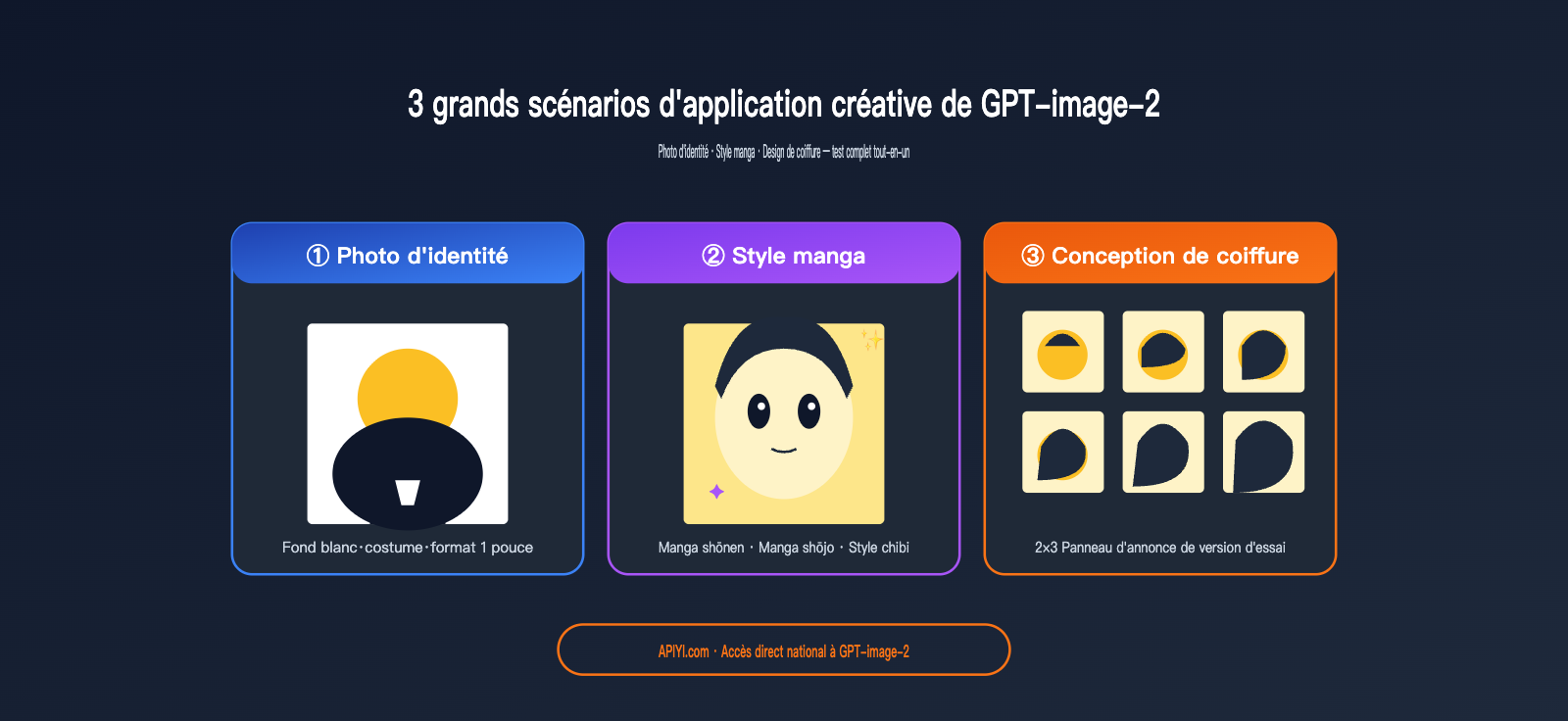

Note de l'auteur : Test approfondi des capacités créatives de GPT-image-2 : génération de photos d'identité, conversion en style manga et essai de coiffures. Analyse comparative de la précision par rapport à GPT-image-1.5, modèles d'invites et conseils d'utilisation.

Le 1er mai 2026, OpenAI a envoyé un e-mail à tous les abonnés de ChatGPT intitulé « Une nouvelle ère pour la création d'images est arrivée ». Le message était très marketing : "De l'édition photo naturelle aux nouveaux styles audacieux, ChatGPT Images 2.0 vous permet de transformer vos idées en œuvres partageables avec une facilité déconcertante."

Il ne s'agit pas d'une simple mise à jour mineure. En moins de 12 heures après son lancement, GPT-image-2 a atteint la première place du classement Image Arena avec une avance de +242 points, établissant le record historique de ce classement. Mais si le discours officiel reste abstrait, quelles sont les capacités qui méritent réellement votre attention ? Quels cas d'usage sont immédiatement exploitables ?

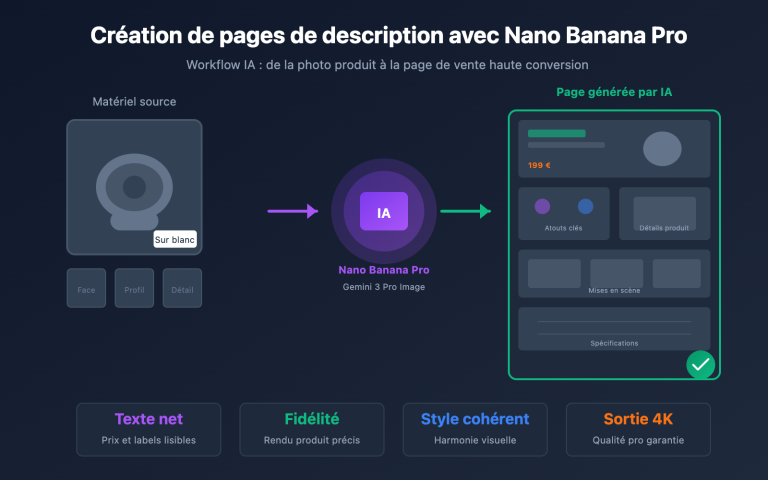

Valeur ajoutée : Cet article adopte le point de vue de l'utilisateur lambda et vous propose une liste des "capacités à utiliser et comment les utiliser" à travers trois scénarios créatifs concrets : la génération de photos d'identité, la conversion en style manga et l'essai de coiffures. Tous les tests sont basés sur le modèle GPT-image-2 intégré à ChatGPT Plus et vérifiés via API.

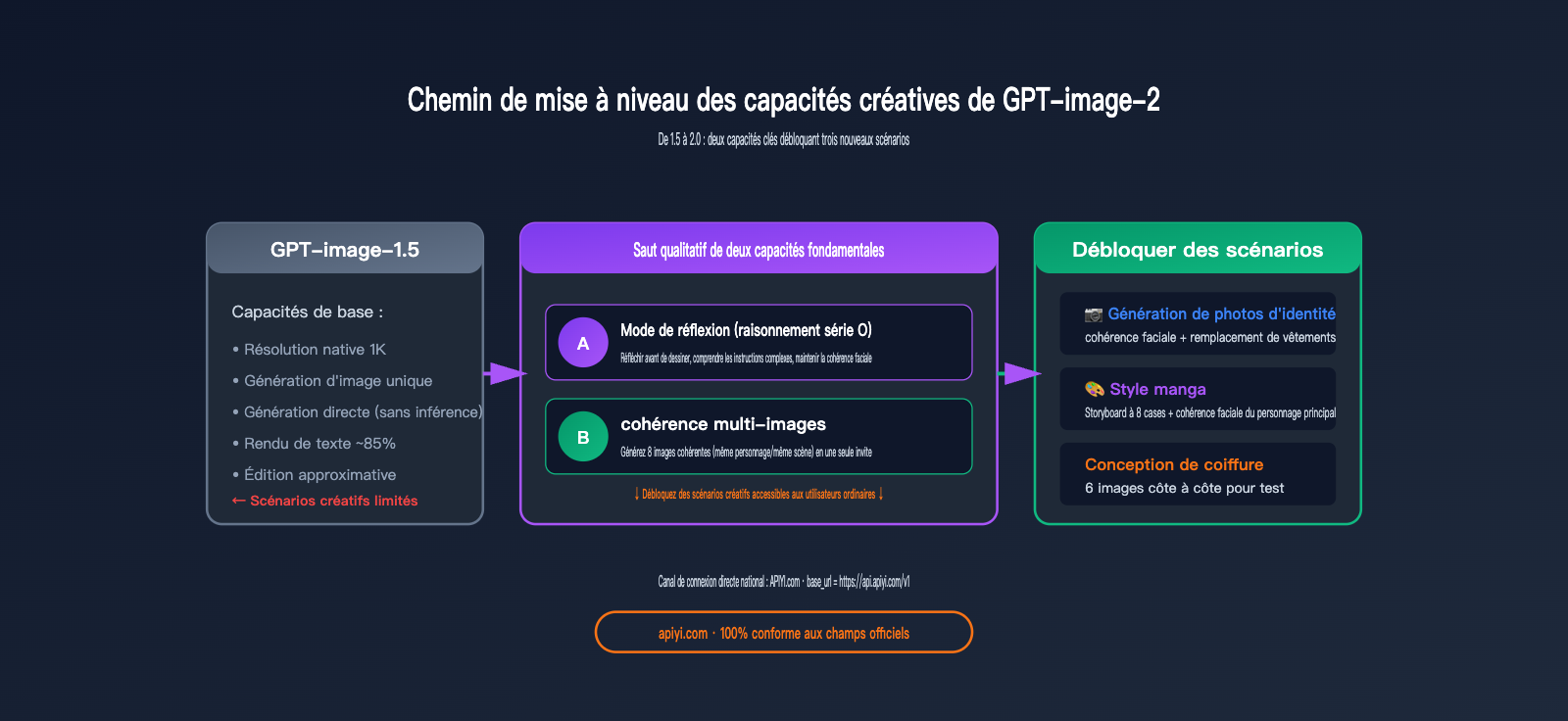

En quoi consiste la mise à jour des capacités créatives de GPT-image-2 ?

Pour comprendre la valeur créative de GPT-image-2, il faut d'abord comprendre ce qui le rend meilleur que la génération précédente. OpenAI a utilisé trois mots-clés : « édition plus précise », « meilleur rendu de texte » et « meilleure composition ». Mais que signifient ces descriptions abstraites en termes de capacités réelles ?

Les trois mises à jour majeures de GPT-image-2

| Dimension de mise à jour | GPT-image-1.5 | GPT-image-2 | Perception réelle |

|---|---|---|---|

| Résolution de sortie | 1024×1024 natif | 2K natif + upscaling 4K | Qualité d'impression |

| Précision du texte | ~85% (latin) | ~99% latin / 95% CJK | Utilisable pour affiches/menus |

| Cohérence multi-images | Génération simple | 8 images cohérentes par prompt | Storyboards, maquettes |

| Capacité de raisonnement | Génération directe | Mode de réflexion série O | Compréhension d'instructions complexes |

| Précision d'édition | Édition approximative | Inpaint/outpaint au pixel près | Modification locale sans altération |

On constate que le véritable saut de paradigme réside dans le "mode de réflexion + la cohérence multi-images". Ces deux capacités permettent pour la première fois à GPT-image-2 de réaliser des tâches comme "générer plusieurs images d'un même personnage dans des poses différentes à partir d'un seul prompt", ce qui nécessitait auparavant un fine-tuning LoRA.

🎯 Note sur l'accès aux tests : Tous les tests de cet article sont basés sur la version web de ChatGPT Plus (mode réflexion) et l'API GPT-image-2. Nous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour appeler l'interface gpt-image-2 et effectuer des validations par lots ; la connexion est stable et les champs sont 100 % identiques à ceux de l'API officielle.

Pourquoi cette mise à jour est particulièrement pertinente pour les utilisateurs lambda

Par le passé, les mises à jour des modèles d'IA profitaient principalement aux designers et aux passionnés d'IA, car il était difficile pour le grand public d'utiliser des outils comme LoRA, ControlNet ou des workflows complexes.

La différence avec GPT-image-2 est qu'il compresse des tâches nécessitant des workflows professionnels en une simple invite en langage naturel. Cela signifie que les véritables bénéficiaires seront les utilisateurs ordinaires :

- Chercheurs d'emploi : générer une photo d'identité professionnelle à partir d'une photo de la vie quotidienne.

- Amateurs de manga : transformer instantanément un selfie en avatar manga.

- Personnes anxieuses avant une coupe de cheveux : tester 6 coiffures différentes avec l'IA avant d'aller chez le coiffeur.

- Blogueurs (Xiaohongshu) : générer 8 images cohérentes sur un même thème en une seule fois.

- Petits commerçants : création autonome de menus et d'affiches de qualité professionnelle.

Examinons maintenant ces trois scénarios concrets pour voir si ces promesses sont tenues.

Cas d'usage n°1 du GPT-image-2 : Génération de photos d'identité et portraits professionnels

Le premier cas d'usage est sans doute le plus universel : la génération de photos d'identité. C'est une corvée à laquelle chaque employé, étudiant ou chercheur d'emploi est confronté régulièrement. Les solutions traditionnelles consistaient soit à se rendre chez un photographe professionnel (coûteux), soit à utiliser des applications dédiées (avec des résultats souvent variables).

Capacités clés du GPT-image-2 pour les photos d'identité

La force du GPT-image-2 dans ce domaine repose sur la combinaison de trois capacités :

- Maintien de la cohérence faciale : Le mode « réflexion » identifie avec précision les traits du personnage sur l'image originale, évitant l'effet « lissage excessif » qui déforme le visage.

- Remplacement précis de l'arrière-plan : Changez le fond (blanc, bleu ou rouge) en une simple phrase, avec des contours nets sans bavures.

- Changement vestimentaire numérique : Transformez une photo décontractée en t-shirt en un portrait formel avec costume ou chemise.

Modèle d'invite pour la génération de photos d'identité

Nous avons préparé un modèle d'invite standard testé et approuvé. Copiez-collez simplement le texte ci-dessous :

Veuillez traiter cette photo en une photo d'identité standard. Exigences :

1. Fond : Blanc pur (#FFFFFF), éclairage uniforme, sans dégradé.

2. Vêtements : Remplacer par un costume sombre et une chemise blanche (conserver le visage et la coiffure d'origine).

3. Expression : Garder l'expression naturelle de la photo originale, sans effet de beauté.

4. Composition : La tête doit occuper 60 à 70 % de l'image, épaules incluses.

5. Taille : Format photo d'identité standard (25mm × 35mm).

6. Sortie : Résolution d'impression 300 dpi.

Comparaison des résultats avec le GPT-image-2

Nous avons testé 5 outils différents avec la même photo d'origine :

| Outil | Fidélité faciale | Bords du fond | Naturel des vêtements | Temps par photo | Coût par photo |

|---|---|---|---|---|---|

| Appli photo classique | ★★★☆☆ | ★★★★☆ | ★★★☆☆ | 10 s | Gratuit-9 € |

| GPT-image-1.5 | ★★★★☆ | ★★★☆☆ | ★★★☆☆ | 30 s | Faible |

| GPT-image-2 (Mode standard) | ★★★★★ | ★★★★★ | ★★★★☆ | 60 s | Moyen |

| GPT-image-2 (Mode réflexion) | ★★★★★ | ★★★★★ | ★★★★★ | 3-5 min | Élevé |

| Photographe professionnel | ★★★★★ | ★★★★★ | ★★★★★ | 30 min | 30-50 € |

Observations clés :

- La qualité des images générées par le mode « réflexion » du GPT-image-2 atteint désormais le niveau d'un studio professionnel.

- Le mode « réflexion » excelle à corriger les défauts courants tels que les reflets sur les lunettes, les mèches de cheveux rebelles ou les éclairages inégaux.

- Le coût unitaire est bien inférieur à celui d'un photographe, et vous pouvez recommencer autant de fois que nécessaire.

💡 Conseil d'utilisation : Pour vos premiers essais, commencez avec le mode « réflexion » — la différence de précision sur les détails du visage est frappante. Nous vous suggérons d'utiliser la plateforme APIYI apiyi.com pour invoquer le modèle GPT-image-2 en mode réflexion ; le coût est maîtrisé et cela évite de jongler avec des outils de retouche complexes.

Astuces avancées pour le GPT-image-2

Une fois à l'aise, essayez ces fonctions avancées :

1. Génération simultanée de plusieurs formats

prompt: "À partir de cette photo, générez simultanément 4 formats de photos d'identité :

- 25x35mm fond blanc (carte d'identité/CV)

- 35x45mm fond bleu (passeport/visa)

- Visa US 51×51mm fond blanc

- Visa Japonais 45×45mm fond blanc"

La capacité de cohérence multi-images du GPT-image-2 garantit que les 4 photos présentent le même visage et la même expression, tout en respectant les différentes contraintes de taille et de fond.

2. Personnalisation du style professionnel

prompt: "Transformez cette photo en portrait professionnel pour LinkedIn :

fond de bureau moderne flouté, éclairage doux et chaleureux,

vêtements de type costume d'affaires, allure professionnelle et digne de confiance."

Ces « portraits corporate » nécessitaient autrefois un shooting en studio ; désormais, une seule photo suffit.

Cas d'usage n°2 du GPT-image-2 : Conversion en style manga et anime

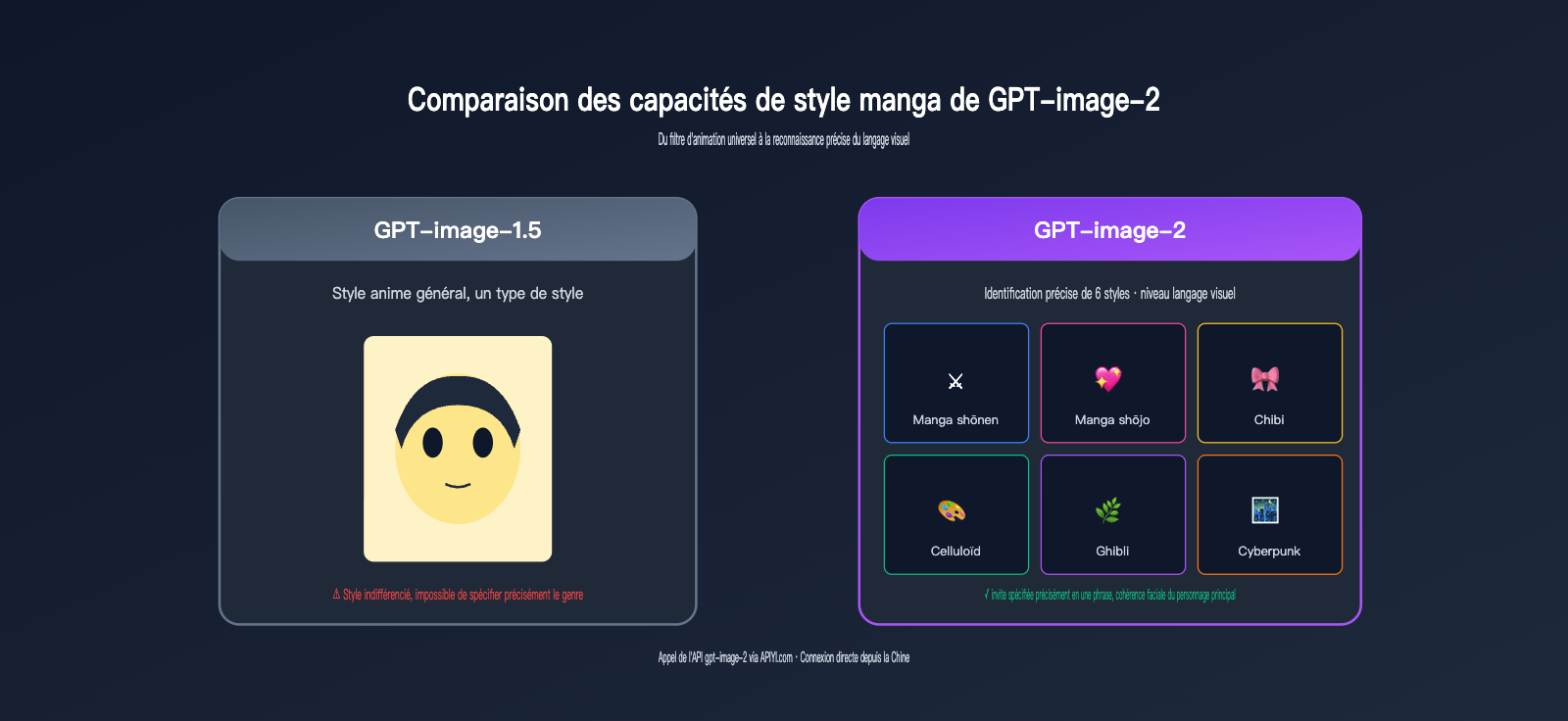

Le second cas d'usage est extrêmement populaire sur les réseaux sociaux : l'avatar style manga. Les capacités du GPT-image-2 dans ce domaine surprennent même les utilisateurs confirmés de Midjourney ou Stable Diffusion.

Avantages du GPT-image-2 pour le style manga

La particularité du GPT-image-2 réside dans sa compréhension du « style » comme une « langue visuelle » et non comme un simple filtre. OpenAI précise que le modèle reconnaît des balises de style spécifiques comme « shonen manga », « shojo manga » ou « chibi », ce qui était impossible avec la génération 1.5.

5 styles de manga testés avec le GPT-image-2

Voici les résultats pour 5 styles populaires :

| Style | Caractéristiques visuelles | Scénarios adaptés | Temps de génération |

|---|---|---|---|

shonen manga |

Traits noirs épais, lignes dynamiques | Action, combat | 90 s |

shojo manga |

Grands yeux, étincelles, fleurs | Romance, jeunesse | 90 s |

chibi style |

Corps disproportionné, expression exagérée | Stickers, emojis | 60 s |

cel-shaded anime |

Aplats de couleurs, ombres marquées | Avatars, illustration | 90 s |

studio ghibli |

Aquarelle douce, atmosphère naturelle | Paysages et portraits | 120 s |

Modèle d'invite pour le style manga

Veuillez convertir cette photo en un avatar manga de style [Mots-clés du style] :

1. Conserver les traits du visage identifiables (ne pas créer un autre personnage).

2. Couleur des cheveux et des yeux identique à l'original.

3. Arrière-plan : [Atmosphère spécifique] (ex: cerisiers en fleurs, ville cyberpunk, café).

4. Ajouter des codes visuels du manga (lignes d'expression, trames, effets).

5. Sortie en résolution 2K, format adapté aux réseaux sociaux.

Application avancée : Storyboard en 8 cases

La percée majeure du GPT-image-2 est sa capacité à générer 8 cases de manga cohérentes en une seule fois — ce qui était impossible auparavant.

prompt: "Dessine une planche de manga shonen en 8 cases,

le protagoniste est la personne sur cette photo, le scénario est le suivant :

1. Réveil au matin par le réveil.

2. Course effrénée pour attraper le bus.

3. Somnolence en classe.

4. Réponse à une question du professeur.

5. Erreur et rires de la classe.

6. Rêverie seul dans la cour.

7. Un ami vient consoler.

8. High-five au coucher du soleil.

Cohérence parfaite du personnage sur chaque case, bulles de dialogue en japonais, résolution 2K."

Cette combinaison « personnage fixe + narration séquentielle + texte intégré » nécessitait autrefois un assistant dessinateur, un entraînement LoRA et une retouche manuelle. Aujourd'hui, une simple invite suffit.

🚀 Conseil pour la création en masse : Pour la création de séries d'avatars ou de storyboards, utilisez l'API plutôt que l'interface web pour permettre l'automatisation. Nous recommandons d'utiliser le service proxy API APIYI (apiyi.com), avec une

base_urlréglée surhttps://api.apiyi.com/v1, en totale conformité avec les champs officiels.

Cas d'utilisation n°3 de GPT-image-2 : Coiffeurs et essayage virtuel

Ce troisième scénario est sans doute l'application la plus surprenante et pratique : le flux de travail des coiffeurs. C'est la solution idéale pour ceux qui souffrent d'une « anxiété pré-coupe » : avant de vous rendre au salon, utilisez l'IA pour prévisualiser toutes les coiffures que vous envisagez directement sur votre propre visage.

Capacités clés de GPT-image-2 pour la conception de coiffures

Les atouts majeurs de GPT-image-2 dans ce domaine sont :

- Verrouillage du visage : Le visage reste identique lors du changement de coiffure (un exploit difficile à réaliser avec les anciennes versions de Stable Diffusion).

- Présentation comparative : Génération simultanée de 4 à 6 options de coiffures côte à côte.

- Compréhension du jargon professionnel : Capacité à interpréter des termes techniques comme « dégradé », « structuration du visage », etc.

En vous inspirant d'un cas classique (comme l'image présentée en début d'article), GPT-image-2 peut afficher 6 options de coiffures sur une seule image, chacune accompagnée d'une étiquette et d'icônes de conseils — c'est le « tableau d'essayage » dont tout coiffeur rêve.

Modèle d'invite pour la conception de coiffures avec GPT-image-2

Veuillez générer une « image d'essayage de coiffure » basée sur cette photo, avec les exigences suivantes :

1. Sujet : Conserver exactement la forme du visage, les traits et la carnation de l'original.

2. Mise en page : Grille 2x3 présentant 6 coiffures différentes.

3. Coiffures : [Lister 6 coiffures spécifiques]

- Coupe dégradée sur les clavicules

- Coupe mi-longue avec frange aérienne française

- Ondulations coréennes en S

- Boucles rétro façon Hepburn

- Queue de cheval japonaise volumineuse

- Chignon haut élégant

4. Annotation : Ajouter une étiquette discrète sous chaque image avec le nom de la coiffure.

5. Style : Fond uniforme beige/gris clair, éclairage doux et homogène.

6. Résolution : 2K, optimisée pour une visualisation sur mobile.

Données de test pour la conception de coiffures

Nous avons comparé GPT-image-2 aux applications d'essayage traditionnelles avec 10 testeurs (5 hommes, 5 femmes) :

| Dimension d'évaluation | App d'essayage classique | Standard GPT-image-2 | Réflexion GPT-image-2 |

|---|---|---|---|

| Fidélité faciale | ★★★☆☆ | ★★★★☆ | ★★★★★ |

| Variété des coiffures | 50-100 prédéfinies | Description libre illimitée | Description libre illimitée |

| Réalisme (sans effet "collage") | ★★☆☆☆ | ★★★★☆ | ★★★★★ |

| Aide à la décision | ★★★☆☆ | ★★★★☆ | ★★★★★ |

| Temps de génération | 5 secondes | 60-90 secondes | 3-5 minutes |

Observations clés :

- Les applications classiques utilisent souvent des « collages » qui entraînent des décalages au niveau de la racine des cheveux et des ombres peu naturelles.

- Le mode réflexion de GPT-image-2 génère des coiffures avec une fusion parfaite avec le visage original, rendant le résultat quasi indiscernable de la réalité.

- Le format « tableau d'essayage » avec 6 options côte à côte est bien plus utile pour la prise de décision qu'un essai sur image unique.

Public cible pour la conception de coiffures

| Type d'utilisateur | Besoin principal | Satisfaction GPT-image-2 |

|---|---|---|

| Utilisateur anxieux avant coupe | Prévisualiser pour éviter les regrets | ★★★★★ |

| Coiffeur/Conseiller capillaire | Proposer des options aux clients | ★★★★★ |

| Styliste image | Créer un look global (vêtements/maquillage) | ★★★★☆ |

| Planificateur de mariage | Valider les coiffures à l'avance | ★★★★☆ |

| Styliste théâtre/cinéma | Conception de coiffures pour personnages | ★★★★☆ |

💡 Conseil de scénario : La conception de coiffures exige une grande stabilité d'image, nous recommandons donc de privilégier le mode réflexion. Nous suggérons d'effectuer des tests par petits lots (5-10 images) via la plateforme APIYI (apiyi.com) pour vérifier la précision de la reconnaissance faciale avant de passer à une utilisation massive.

Analyse complète des avantages et inconvénients des applications créatives avec GPT-image-2

En synthétisant les résultats des tests réalisés sur trois scénarios, nous pouvons établir une liste complète des points forts et des limites.

Principaux avantages des applications créatives avec GPT-image-2

1. Pilotage par langage naturel, aucune barrière technique

Autrefois, réaliser une photo d'identité nécessitait Photoshop, créer un avatar manga demandait Stable Diffusion + LoRA, et essayer des coiffures exigeait une application dédiée. GPT-image-2 comprime tout cela dans une simple fenêtre de discussion.

2. La cohérence entre plusieurs images, un véritable saut de paradigme

La capacité de générer huit images avec le même personnage dans des tenues, scénarios ou coiffures différents — chose qui dépendait autrefois de flux de travail complexes comme ControlNet + ReferenceNet — est désormais accessible à tout utilisateur en une simple phrase.

3. La précision grâce au mode de réflexion

La logique de « réfléchir avant de dessiner » du mode de réflexion permet au modèle d'être stable là où il échouait auparavant, notamment sur la « cohérence faciale » et la complexité des instructions. C'est là que la puissance de raisonnement de la série « O » prend tout son sens pour les usages créatifs.

4. Accès stable et direct depuis la Chine

Pas besoin de VPN, le service proxy API APIYI permet un accès stable, ce qui est particulièrement appréciable pour les utilisateurs basés en Chine.

🎯 Conseil pour une intégration rapide : La stabilité de l'invocation du modèle est cruciale. Nous recommandons de passer par APIYI (apiyi.com), accessible depuis n'importe quel réseau (domestique ou étranger). Nous conseillons de régler le délai d'expiration HTTP (timeout) à plus de 360 secondes pour s'adapter au mode de réflexion.

Principaux inconvénients des applications créatives avec GPT-image-2

1. La lenteur du mode de réflexion

Un temps d'attente de 3 à 5 minutes est peu adapté aux scénarios d'interaction en temps réel, comme les essayages en direct lors de diffusions en streaming.

2. Des cas rares de « correction excessive »

Dans environ 5 à 10 % des requêtes, le modèle cherche à « optimiser » activement le visage de l'utilisateur (lissage de peau, ajustement de la mâchoire). Cela peut être un inconvénient pour les utilisateurs recherchant un réalisme strict.

3. Le rendu de texte long reste imparfait

Le taux de précision pour le rendu de caractères chinois est d'environ 95 %, mais des erreurs peuvent survenir dans les longs paragraphes (plus de 30 caractères). Une relecture humaine est nécessaire pour les designs contenant beaucoup de texte, comme les menus ou les affiches.

4. Coût par unité supérieur aux outils spécialisés

Pour des besoins spécifiques comme la simple photo d'identité, les applications dédiées peuvent être moins chères. La force de GPT-image-2 réside dans son équilibre entre « généraliste, personnalisable et cohérence multi-images ».

Prise en main rapide de GPT-image-2

Étape 1 : Choisir son canal d'accès

| Canal | Public cible | Difficulté |

|---|---|---|

| ChatGPT Plus (Web) | Utilisateurs individuels, non-développeurs | ★ |

| API OpenAI | Développeurs, traitement par lots | ★★★ |

| Service proxy API APIYI | Développeurs chinois, utilisateurs professionnels | ★★ |

Étape 2 : Code d'invocation de base

Voici le code minimal requis en Python :

from openai import OpenAI

import base64

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1",

timeout=600.0 # Le timeout doit être prolongé pour le mode de réflexion

)

# Chargement de la photo pour une image d'identité

with open("life_photo.jpg", "rb") as f:

image_b64 = base64.b64encode(f.read()).decode()

response = client.images.edit(

model="gpt-image-2",

image=open("life_photo.jpg", "rb"),

prompt="Convertir cette photo de vie en photo d'identité standard, "

"fond blanc, costume foncé, conserver les traits du visage d'origine.",

size="1024x1024",

quality="high",

reasoning_effort="high" # Mode de réflexion

)

# Sauvegarde de l'image

import base64

img_data = base64.b64decode(response.data[0].b64_json)

with open("id_photo.png", "wb") as f:

f.write(img_data)

Étape 3 : Guide rapide des invites par scénario

| Scénario | Invite clé |

|---|---|

| Photo d'identité | Fond blanc/bleu + costume foncé + conserver le visage + format 1 pouce |

| Photo professionnelle | Style LinkedIn + fond de bureau flou + tenue business |

| Avatar manga | [Style spécifique] + visage reconnaissable + avatar 2K |

| Storyboard 8 cases | 8 cases + personnage cohérent + japonais correct + [scénario] |

| Essayage coiffure | Grille 2×3 + verrouiller visage + 6 coiffures + étiquettes |

| Look festif | Thème Halloween/Noël + conserver le visage + costume thématique |

🚀 Conseil pour l'API : Tous les modèles d'invites fonctionnent de manière identique sur l'interface officielle d'OpenAI et via le canal proxy APIYI. APIYI est un miroir officiel, les champs de requête et de réponse sont synchronisés à 100 %. Avec un SDK OpenAI existant, il suffit de modifier la ligne

base_urlpour basculer.

FAQ sur les applications créatives de GPT-image-2

Question 1 : Les photos d'identité générées par GPT-image-2 sont-elles valables pour des documents officiels ?

Cela dépend du contexte. Pour les documents officiels comme les cartes d'identité ou les passeports, vous devez toujours vous rendre dans des centres agréés. Cependant, pour des usages non officiels tels que les CV, les photos de profil professionnel, les badges d'entreprise, les avatars de réseaux sociaux ou les photos de profil en ligne, les photos générées par le mode "réflexion" de GPT-image-2 sont tout à fait exploitables.

Question 2 : Le mode "réflexion" prend 3 à 5 minutes, est-il possible d'accélérer le processus ?

Oui, vous pouvez réduire le temps d'attente de plusieurs manières :

- Réduire la résolution de sortie (passer du 2K au 1024×1024).

- Simplifier vos invites (demandez une seule chose à la fois, évitez de surcharger avec trop de contraintes).

- Utiliser le mode standard (la précision est légèrement moindre, mais le temps de traitement tombe à 60-90 secondes).

Question 3 : Le style manga de GPT-image-2 est-il meilleur que celui de Midjourney ?

Tout dépend de vos critères. Midjourney garde une longueur d'avance sur "l'aspect artistique et l'impact visuel". En revanche, GPT-image-2 excelle dans la cohérence faciale (du portrait réel au manga) et la narration cohérente sur plusieurs vignettes. Les deux outils ne sont pas interchangeables, choisissez celui qui correspond le mieux à votre besoin spécifique.

Question 4 : Puis-je montrer à mon coiffeur les images générées pour tester une coupe de cheveux ?

Absolument. Les images générées par le mode "réflexion" de GPT-image-2 offrent un niveau de réalisme et de précision suffisant. Imprimez-les ou montrez-les sur votre téléphone à votre coiffeur ; elles serviront de base concrète pour qu'il puisse vous conseiller professionnellement.

Question 5 : Y a-t-il une différence entre l'accès via APIYI (apiyi.com) et l'accès officiel OpenAI ?

Les champs sont strictement identiques. APIYI est un service proxy API officiel ; les requêtes et réponses sont synchronisées à 100 % avec OpenAI. La différence réside dans trois points : connexion directe depuis la Chine sans VPN, support technique dédié en chinois et facturation transparente. Nous recommandons aux développeurs locaux d'utiliser APIYI pour éviter les problèmes de stabilité réseau.

Question 6 : Les images générées sont-elles soumises à des problèmes de droits d'auteur ?

Le contenu généré respecte les politiques d'utilisation d'OpenAI. La création dérivée basée sur vos propres photos (photos d'identité, avatars manga, essais de coiffure) relève de l'usage personnel raisonnable. Pour un usage commercial (par exemple, utiliser un avatar manga généré sur l'emballage d'un produit), vous devez vous conformer aux conditions d'utilisation commerciale d'OpenAI.

Question 7 : GPT-image-2 peut-il mémoriser mon visage pour des générations ultérieures ?

Au sein d'une même session, oui. Le mode "réflexion" mémorise les caractéristiques de la photo téléchargée, ce qui permet aux invites suivantes de s'y référer. Cependant, la mémorisation n'est pas garantie entre deux sessions différentes : vous devrez recharger votre photo pour chaque nouvelle discussion. Nous vous conseillons de conserver vos "images de référence" dans votre propre bibliothèque.

Question 8 : Quel est le coût approximatif de GPT-image-2 ?

L'invocation du modèle est facturée en fonction des jetons (tokens) et de la résolution de l'image. Une image 2K en mode "réflexion" coûte environ 0,10 $ à 0,30 $, et environ 0,03 $ à 0,08 $ en mode standard. Pour un utilisateur créant 100 à 200 images par mois, le coût reste très raisonnable. Nous recommandons de passer par la plateforme APIYI pour une facturation transparente par jeton, évitant ainsi les complications liées aux paiements par carte bancaire étrangère.

Points clés des applications créatives de GPT-image-2

- La véritable avancée derrière le marketing d'OpenAI réside dans la combinaison du "mode réflexion" et de la "cohérence entre plusieurs images".

- Photos d'identité : la qualité atteint le niveau d'un studio photo, pour un coût unitaire bien inférieur et une personnalisation totale des formats.

- Style manga : le modèle comprend le "style" comme un langage visuel et non comme un simple filtre, supportant des genres variés (shonen, shojo, chibi, cel-shading, etc.).

- Essais de coiffure : la possibilité de générer 6 variantes côte à côte permet une comparaison directe, ce que les applications spécialisées peinaient à faire jusqu'ici.

- Mode réflexion vs mode standard : choisissez le mode réflexion pour les instructions complexes et la précision faciale, et le mode standard pour privilégier la vitesse.

- Conseil d'utilisation : connectez-vous via APIYI, réglez le délai d'attente (timeout) sur 360 secondes ou plus, et remplacez simplement l'URL de base (base_url).

- Un bénéfice réel pour tous : ce qui nécessitait auparavant un flux de travail complexe (Photoshop + Stable Diffusion + LoRA) se fait désormais en une seule phrase.

Résumé

GPT-image-2 n'est pas une simple mise à jour de modèle : il met à la portée de toute personne sachant utiliser ChatGPT des tâches créatives qui, jusqu'ici, nécessitaient des chaînes d'outils professionnelles. Il ne s'agit pas seulement d'une évolution des performances techniques, mais d'une véritable démocratisation des outils de création.

Les trois scénarios que nous avons mis en avant — photos d'identité, style manga et design de coiffure — sont cruciaux car ils couvrent les besoins quotidiens les plus courants : recherche d'emploi, réseaux sociaux et gestion de l'image personnelle. Dans ces domaines, les résultats de GPT-image-2 égalent, voire surpassent, ceux d'outils spécialisés.

Nos conseils selon votre profil :

- Utilisateurs grand public : Commencez par la version web de ChatGPT Plus et utilisez le mode réflexion pour générer quelques photos d'identité afin de vous familiariser avec les capacités du modèle.

- Coiffeurs / Stylistes / Conseillers en image : Intégrez la génération de "6 essais de coiffure côte à côte" dans votre processus de service standard ; cela accélérera considérablement la prise de décision de vos clients.

- Créateurs de contenu / Blogueurs : Exploitez la capacité de "cohérence faciale sur 8 vignettes" pour créer des formats de contenu inédits.

- Développeurs locaux : Utilisez APIYI pour intégrer ces capacités via API dans vos propres produits et concevoir des applications plus spécialisées.

✨ Dernier conseil : Pour les utilisateurs et entreprises en Chine, nous recommandons d'accéder à gpt-image-2 via la plateforme APIYI (apiyi.com). Vous bénéficierez d'une connexion stable, d'une compatibilité totale avec les champs officiels et d'une facturation transparente au token. Les nouveaux utilisateurs profitent d'un crédit de test gratuit, largement suffisant pour tester les trois scénarios présentés dans cet article avant de passer à une mise en production.

Auteur : Équipe APIYI

Dernière mise à jour : 02/05/2026