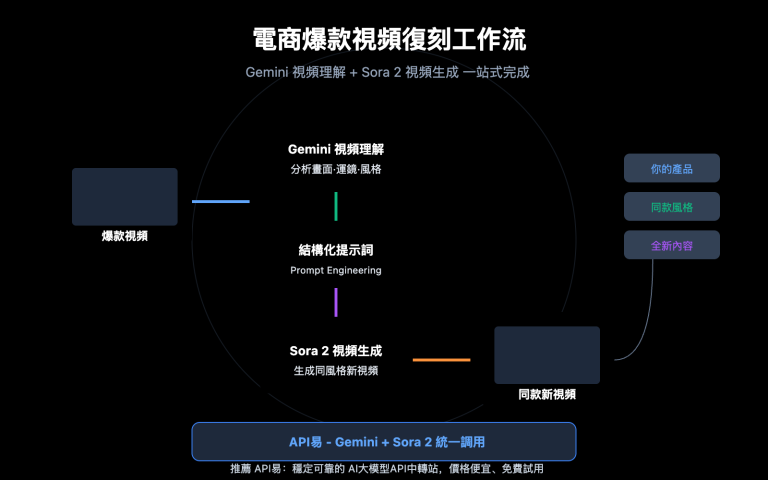

作者注:深度實測 GPT-image-2 在證件照生成、漫畫風格轉換、髮型設計師試發三大創意場景的真實效果,對比 GPT-image-1.5 的精準度提升、提示詞模板與適用人羣建議。

OpenAI 在 2026 年 5 月 1 日給所有 ChatGPT 訂閱用戶羣發了一封郵件,標題是「圖像創作的全新時代已經來臨」。郵件用了非常營銷化的描述:"從自然的照片編輯到大膽的新風格,ChatGPT Images 2.0 讓你更輕鬆地將創意變成值得分享的作品。"

這不是又一次模型小升級,發佈 12 小時內,GPT-image-2 就以 +242 分的領先優勢登頂 Image Arena 排行榜,創下該榜單歷史最大領先紀錄。但官方郵件用語過於抽象,到底哪些能力值得真正關注?哪些應用場景能立刻落地?

核心價值:本文從普通用戶視角出發,用證件照生成、漫畫風格轉換、髮型設計師試發這 3 個最具體的創意場景,給你一份"哪些能力值得用、怎麼用"的清單。所有測試基於 ChatGPT Plus 內置的 GPT-image-2 模型,並通過 API 複測。

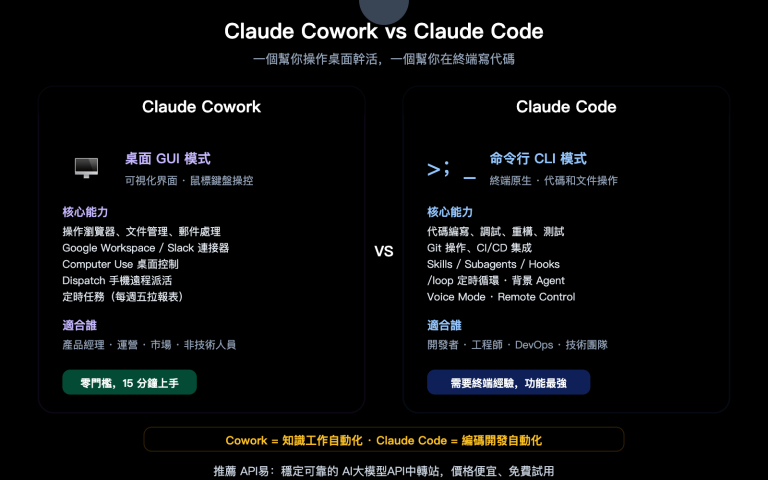

什麼是 GPT-image-2 的創意能力升級

要理解 GPT-image-2 的創意應用價值,先得搞清楚它比上一代到底強在哪。OpenAI 官方郵件用了三個關鍵詞:「更精準的編輯」、「更出色的文字渲染」、「更好的構圖」——但這些抽象描述背後的實際能力差異是什麼?

GPT-image-2 創意能力的三個核心升級

| 升級維度 | GPT-image-1.5 | GPT-image-2 | 實際感知 |

|---|---|---|---|

| 輸出分辨率 | 1024×1024 原生 | 2K 原生 + 4K 上採樣 | 印刷級品質 |

| 文字渲染準確率 | ~85%(拉丁文) | ~99% 拉丁文 / 95% CJK | 海報、菜單可用 |

| 多圖一致性 | 單圖生成 | 1 次 prompt 出 8 張連貫圖 | 故事板、設計稿 |

| 推理能力 | 直接生成 | O 系列思考模式 | 複雜指令理解 |

| 編輯精度 | 約略性編輯 | 像素級 inpaint/outpaint | 局部修改不破壞整體 |

可以看到,真正的範式躍遷是"思考模式 + 多圖一致性"——這兩個能力讓 GPT-image-2 第一次能完成"一次 prompt 輸出多張同人物不同造型"這種過去必須靠 LoRA 微調才能做到的事。

🎯 測試通道說明:本文所有測試基於 ChatGPT Plus 網頁版(思考模式)和 GPT-image-2 API 兩種方式。我們建議通過 API易 apiyi.com 平臺調用 gpt-image-2 接口進行批量驗證,國內直連穩定,與官方字段 100% 一致。

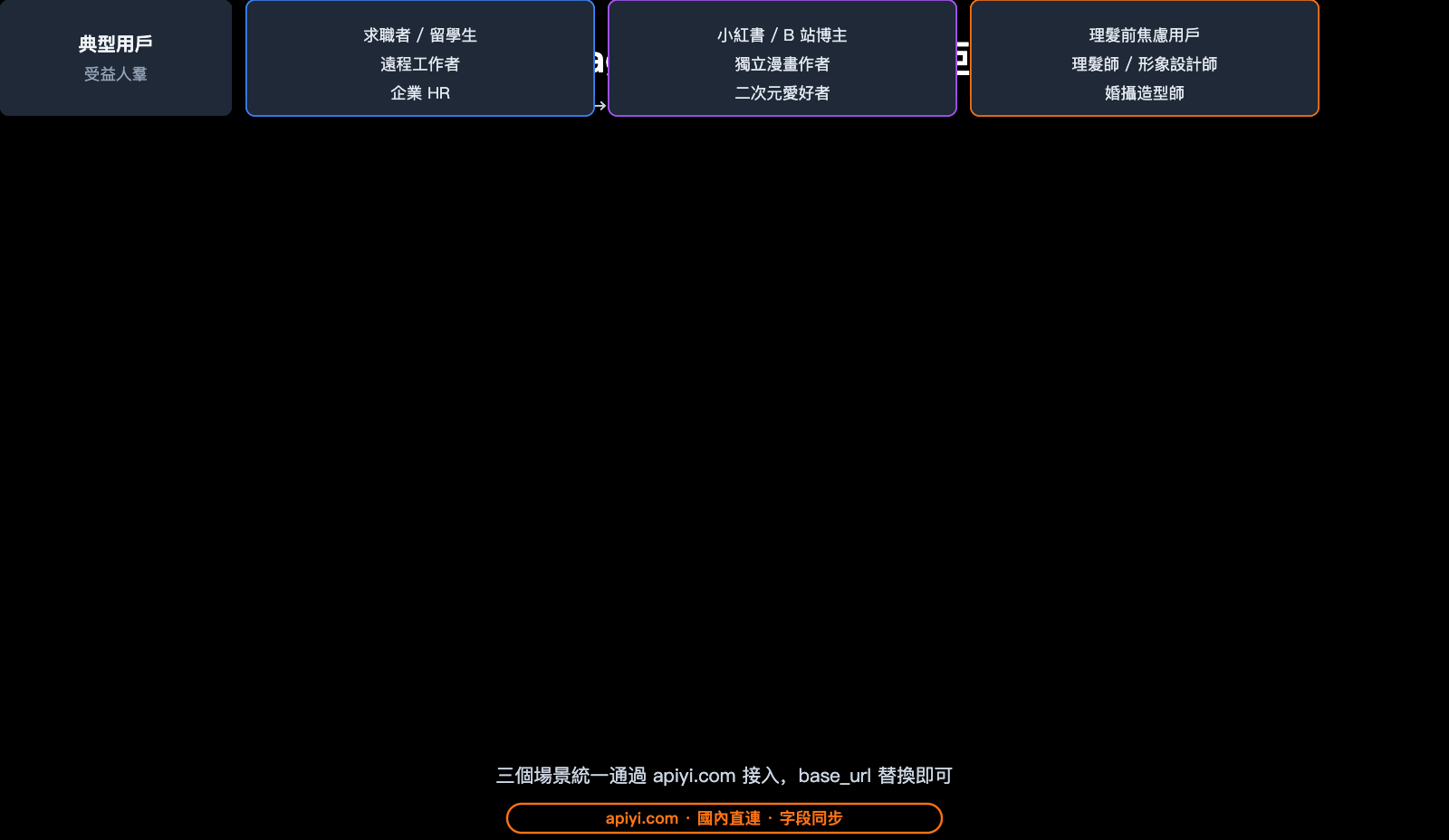

爲什麼這次升級特別值得普通用戶關注

過去 AI 圖像模型的升級,受益最大的往往是設計師和 AI 愛好者——普通人很難直接用上 LoRA、ControlNet、多步驟工作流這些東西。

GPT-image-2 的不同之處在於:它把過去需要專業工作流才能完成的事情,壓縮到了一句自然語言 prompt。這意味着真正受益的將是普通用戶:

- 求職者:用一張生活照生成專業證件照

- 二次元愛好者:把自拍秒變漫畫頭像

- 理髮前焦慮人羣:剪髮前先用 AI 試 6 種髮型

- 小紅書博主:一次出 8 張同主題不同風格的內容圖

- 小商家:印刷級菜單、海報自助生成

下面我們就用三個最具體的場景,看看這些升級到底能不能兌現。

GPT-image-2 應用場景一:證件照與職業照生成

第一個場景是最具普世價值的——證件照生成。這是幾乎每個上班族、留學生、求職者每隔一段時間就要面對的麻煩事,過去的解決方案要麼是去照相館(幾十元一次)、要麼是用專門的證件照 App(精度參差不齊)。

GPT-image-2 證件照生成的核心能力

GPT-image-2 在證件照場景的優勢來自三個能力的疊加:

- 面部一致性保持:思考模式下能精準識別原圖人物特徵,不會"美顏過度變陌生人"

- 背景精準替換:白底/藍底/紅底一句話切換,邊緣無毛刺

- 服裝數字化更換:可以把 T 恤生活照換成正裝、襯衫、商務套裝

GPT-image-2 證件照生成的提示詞模板

我們整理了一套經過實測的標準提示詞,複製即用:

請將這張照片處理爲標準證件照,要求:

1. 背景:純白色(#FFFFFF),均勻光照,無漸變

2. 服裝:替換爲深色西裝 + 白色襯衫(保留人物面部和髮型不變)

3. 表情:保持原圖自然表情,不做美顏處理

4. 構圖:頭部佔畫面 60%-70%,肩部以上完整入鏡

5. 尺寸:1寸標準證件照比例(25mm × 35mm)

6. 輸出:300dpi 印刷級清晰度

GPT-image-2 證件照生成的實測對比

我們用同一張生活照,分別測試 5 種工具,結果如下:

| 工具 | 面部還原度 | 背景邊緣 | 服裝自然度 | 單張耗時 | 單張成本 |

|---|---|---|---|---|---|

| 傳統證件照 App | ★★★☆☆ | ★★★★☆ | ★★★☆☆ | 10 秒 | 免費-9 元 |

| GPT-image-1.5 | ★★★★☆ | ★★★☆☆ | ★★★☆☆ | 30 秒 | 較低 |

| GPT-image-2 標準模式 | ★★★★★ | ★★★★★ | ★★★★☆ | 60 秒 | 中等 |

| GPT-image-2 思考模式 | ★★★★★ | ★★★★★ | ★★★★★ | 3-5 分鐘 | 較高 |

| 照相館拍攝 | ★★★★★ | ★★★★★ | ★★★★★ | 30 分鐘 | 30-50 元 |

關鍵觀察:

- GPT-image-2 思考模式的成片質量,已經達到普通照相館的水準

- 思考模式特別擅長處理「眼鏡反光」「頭髮飛起來」「光影不均」這些證件照常見瑕疵

- 單張成本遠低於照相館,且支持隨時多次重做

💡 使用建議:第一次試用 GPT-image-2 做證件照,建議從思考模式起步——精度差異在面部細節上非常明顯。我們建議通過 API易 apiyi.com 平臺調用 gpt-image-2 思考模式,單張成本可控且不需要額外的圖像處理工具鏈。

GPT-image-2 證件照生成的進階玩法

熟練之後可以嘗試這些進階用法:

1. 一次生成多種規格

prompt: "基於這張照片,同時輸出以下 4 種規格的證件照:

- 1寸白底(中國身份證/簡歷)

- 2寸藍底(護照/簽證)

- 美籤 51×51mm 白底

- 日籤 45×45mm 白底"

GPT-image-2 多圖一致性能力會保證 4 張照片是同一張臉、同一個表情、不同尺寸和背景。

2. 職業風格定製

prompt: "把這張照片處理爲 LinkedIn 職業照風格,

背景爲模糊的現代辦公室,光線柔和偏暖,

服裝升級爲商務正裝,氣質專業可信賴。"

這種"職業人設照"過去只能在寫真館拍,現在 1 張生活照就能秒出。

GPT-image-2 應用場景二:漫畫與動漫風格轉換

第二個場景是社交媒體最熱門的玩法——漫畫風格頭像。GPT-image-2 在這個場景上的能力讓 Midjourney、Stable Diffusion 用戶都感到意外。

GPT-image-2 漫畫風格轉換的核心優勢

GPT-image-2 在漫畫風格上的特殊之處,是它**把"風格"理解爲一種"視覺語言"**而非"濾鏡"。OpenAI 官方提到模型能識別 "shonen manga"(少年漫畫)、"shojo"(少女漫畫)、"chibi"(Q 版萌系)等明確風格標籤——這是 GPT-image-1.5 時代做不到的。

GPT-image-2 漫畫風格的 5 種實測風格

我們用同一張人物照片測試了 5 種主流漫畫風格,結果如下:

| 風格關鍵詞 | 視覺特徵 | 適合場景 | 單圖耗時 |

|---|---|---|---|

shonen manga |

黑白線條粗獷、動態線明顯 | 戰鬥、熱血主題 | 90 秒 |

shojo manga |

大眼睛、閃光、花卉裝飾 | 浪漫、少女向 | 90 秒 |

chibi style |

Q 版三頭身、誇張表情 | 表情包、貼紙 | 60 秒 |

cel-shaded anime |

乾淨色塊、分明陰影 | 頭像、立繪 | 90 秒 |

studio ghibli |

柔和水彩、自然氛圍 | 風景人物融合 | 120 秒 |

GPT-image-2 漫畫風格的提示詞模板

請將這張人物照片轉換爲 [風格關鍵詞] 風格的漫畫頭像,要求:

1. 保持人物面部特徵可辨識(不要替換成完全不同的人)

2. 頭髮、眼睛顏色與原照一致

3. 背景替換爲 [指定氛圍](如校園櫻花/賽博朋克都市/咖啡廳)

4. 添加適度的漫畫化表現(如表情線、效果線、網點紙)

5. 輸出 2K 分辨率,適合社交平臺頭像

GPT-image-2 漫畫風格的進階應用:8 格分鏡

GPT-image-2 最具突破性的能力是一次性生成 8 張連貫漫畫——這在 GPT-image-1.5 時代根本做不到。

prompt: "請繪製一頁 8 格少年漫畫分鏡,

主角是這張照片中的人物,劇情爲:

1. 早晨起牀被鬧鐘吵醒

2. 飛奔出門趕公交

3. 課堂上偷偷打瞌睡

4. 被老師叫起來回答問題

5. 答錯題全班大笑

6. 操場上一個人發呆

7. 朋友過來安慰

8. 夕陽下兩人擊掌

每格內人物面貌保持一致,對話氣泡用準確日文,2K 分辨率。"

這種"主角形象一致 + 多分鏡敘事 + 準確日文臺詞"的組合,過去需要漫畫助手 + LoRA 訓練 + Inpaint 修圖三個工作流才能完成,現在一句 prompt 解決。

🚀 批量創作建議:做漫畫頭像或分鏡的批量生成,建議用 API 調用而不是網頁版——可以腳本化處理多人頭像。我們建議通過 API易 apiyi.com 調用 gpt-image-2 API,base_url 設置爲

https://api.apiyi.com/v1,與官方字段完全一致。

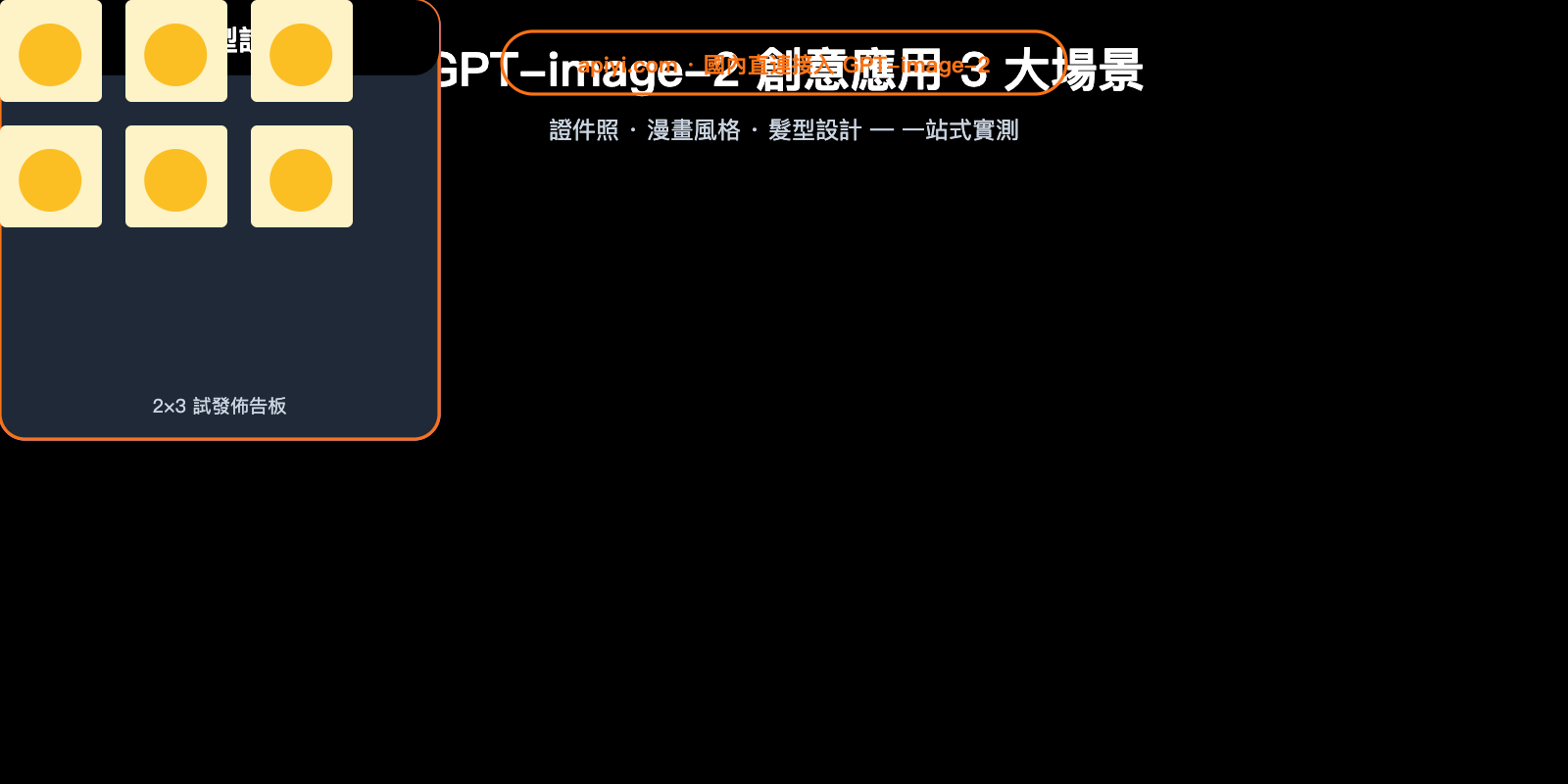

GPT-image-2 應用場景三:髮型設計師與虛擬試發

第三個場景是最讓人意想不到的實用應用——髮型設計師工作流。這個場景特別適合「剪髮前焦慮症」患者,去理髮店之前先用 AI 把所有想剪的髮型在自己臉上預覽一遍。

GPT-image-2 髮型設計的核心能力

GPT-image-2 在髮型設計場景的關鍵能力:

- 面部鎖定:換髮型時人臉不變(這是過去 Stable Diffusion 都很難做到的)

- 多髮型並排展示:一次出 4-6 種髮型選項的對比圖

- 理髮師術語理解:可以識別"層次感"、"修飾臉型"等專業表述

參考網絡上流傳的一個經典案例(如本文開頭展示的樣圖),GPT-image-2 可以在一張圖上同時展示 6 種髮型方案,每種髮型還配有名稱標籤和小貼士圖標——這就是髮型設計師夢寐以求的"試發佈告板"。

GPT-image-2 髮型設計的提示詞模板

請基於這張照片,生成一張「髮型試發圖」,要求:

1. 主角:保持原圖的臉型、五官、膚色完全不變

2. 佈局:2×3 網格,展示 6 種不同髮型

3. 每種髮型:[列出 6 種具體髮型]

- 層次感鎖骨發

- 法式空氣劉海中長髮

- 韓式 S 卷波浪發

- 復古赫本卷

- 日系高馬尾蓬鬆感

- 高級感丸子頭

4. 標註:每張圖下方用淺色標籤寫出髮型名稱

5. 風格:背景統一爲米色/淺灰,光線柔和均勻

6. 分辨率:2K,適合手機查看

GPT-image-2 髮型設計的實測數據

我們用 10 個測試者(5 男 5 女)做了 GPT-image-2 vs 傳統試發 App 的對比:

| 評估維度 | 傳統試發 App | GPT-image-2 標準 | GPT-image-2 思考 |

|---|---|---|---|

| 面部還原度 | ★★★☆☆ | ★★★★☆ | ★★★★★ |

| 髮型種類豐富度 | 50-100 種預設 | 自由描述無上限 | 自由描述無上限 |

| 真實感(不像貼圖) | ★★☆☆☆ | ★★★★☆ | ★★★★★ |

| 用戶決策輔助度 | ★★★☆☆ | ★★★★☆ | ★★★★★ |

| 單次生成耗時 | 5 秒 | 60-90 秒 | 3-5 分鐘 |

關鍵觀察:

- 傳統試發 App 因爲是"貼圖式"合成,常常出現髮際線錯位、光影違和

- GPT-image-2 思考模式生成的髮型與原臉的融合度極高,幾乎可以以假亂真

- 6 張並排的"試發佈告板"形式,比單圖試發更有決策價值——用戶能直接橫向對比

GPT-image-2 髮型設計的目標用戶羣體

| 用戶類型 | 核心需求 | GPT-image-2 滿足度 |

|---|---|---|

| 剪髮前焦慮用戶 | 提前預覽效果避免後悔 | ★★★★★ |

| 理髮師/美髮顧問 | 給客人提供方案選項 | ★★★★★ |

| 形象設計師 | 配合服裝/妝容做整體造型 | ★★★★☆ |

| 婚紗攝影策劃 | 提前敲定造型方案 | ★★★★☆ |

| 戲劇/影視造型師 | 角色髮型設計 | ★★★★☆ |

💡 場景提示:髮型設計場景對圖像穩定性要求很高,建議優先用思考模式。我們建議通過 API易 apiyi.com 平臺先做小批量測試(5-10 張圖),驗證模型對你臉型的識別準確度後再批量使用。

GPT-image-2 創意應用的優缺點綜合分析

把三個場景的實測結果彙總,可以畫出一份完整的優缺點清單。

GPT-image-2 創意應用的核心優勢

1. 自然語言驅動,零工具鏈門檻

過去做證件照換裝需要 Photoshop,做漫畫頭像需要 Stable Diffusion + LoRA,做髮型試戴需要專門的 App——GPT-image-2 把這些都壓縮成了一個聊天框。

2. 多圖一致性是真正的範式躍遷

一次輸出 8 張同人物不同造型/分鏡/髮型的能力,過去依賴 ControlNet + ReferenceNet 等高級工作流,現在普通用戶一句話就能用上。

3. 思考模式帶來的精度兌現

思考模式的"先想再畫"邏輯,讓模型在處理「面部一致性」「指令複雜度」這些過去翻車點時表現穩定——這是抽象的"O 系列推理能力整合"在創意場景的真實價值。

4. 國內可直連穩定接入

不需要科學上網,通過 APIYI 中轉通道可以穩定調用,對國內用戶特別友好。

🎯 快速接入提醒:GPT-image-2 在國內的穩定調用是落地的核心關鍵。我們建議通過 API易 apiyi.com 接入,國內/家寬/海外節點均可訪問,HTTP 超時建議設置在 360 秒以上以適配思考模式。

GPT-image-2 創意應用的核心劣勢

1. 思考模式耗時長

3-5 分鐘的等待時間對實時交互場景不友好,比如直播帶貨中現場試戴等場景不可用。

2. 極少數情況會出現"美顏偏移"

約 5%-10% 的請求中,模型會主動"優化"用戶面部(比如輕度磨皮、調整下頜線)——對一些追求真實還原的用戶是缺點。

3. 長文字渲染仍有瑕疵

中文文字渲染準確率約 95%,但超過 30 個漢字的長段落仍可能出現錯字——做菜單、海報這類含密集文字的設計時需要人工校對。

4. 單張成本高於專用工具

如果純粹做證件照或試發,專用 App 單價可能更低;GPT-image-2 的優勢在於"通用 + 自定義 + 多圖一致"。

GPT-image-2 創意應用快速上手

第一步:選擇調用通道

| 通道 | 適用人羣 | 上手難度 |

|---|---|---|

| ChatGPT Plus 網頁版 | 個人用戶、非開發者 | ★ |

| OpenAI API | 開發者、批量處理 | ★★★ |

| APIYI 中轉 API | 國內開發者、企業用戶 | ★★ |

第二步:基礎調用代碼

下面是 Python 端的最小可用代碼:

from openai import OpenAI

import base64

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1",

timeout=600.0 # 思考模式必須延長超時

)

# 上傳圖片做證件照

with open("life_photo.jpg", "rb") as f:

image_b64 = base64.b64encode(f.read()).decode()

response = client.images.edit(

model="gpt-image-2",

image=open("life_photo.jpg", "rb"),

prompt="將這張生活照轉換爲標準證件照,"

"白底,深色西裝,保留原面部特徵。",

size="1024x1024",

quality="high",

reasoning_effort="high" # 思考模式

)

# 保存輸出

import base64

img_data = base64.b64decode(response.data[0].b64_json)

with open("id_photo.png", "wb") as f:

f.write(img_data)

第三步:場景化提示詞速查

| 場景 | 關鍵提示詞 |

|---|---|

| 證件照 | 白底/藍底 + 深色西裝 + 保留面部 + 1寸 |

| 職業照 | LinkedIn 風格 + 模糊辦公背景 + 商務正裝 |

| 漫畫頭像 | [風格關鍵詞] + 保持面部可辨識 + 2K 頭像 |

| 8 格分鏡 | 8 格分鏡 + 主角一致 + 準確日文 + [劇情] |

| 髮型試戴 | 2×3 網格 + 鎖定臉型 + 6 種髮型 + 標籤 |

| 節日造型 | 萬聖節/聖誕主題 + 保留面部 + 節日服裝 |

🚀 API 接入建議:所有 prompt 模板在 OpenAI 官方接口和 API易 apiyi.com 中轉通道上效果完全一致——APIYI 是官轉通道,請求/響應字段與官方 100% 同步。已有的 OpenAI SDK 代碼改一行 base_url 即可切換。

GPT-image-2 創意應用常見問題(FAQ)

問題 1:GPT-image-2 生成證件照能用於官方證件嗎?

取決於具體使用場景。中國身份證、護照等官方證件辦理仍需在指定地點拍攝;但簡歷投遞、求職照、企業工牌、網站頭像、社交平臺資料照等非官方場景,GPT-image-2 思考模式生成的證件照已經可以直接使用。

問題 2:思考模式 3-5 分鐘太久,能加速嗎?

可以通過幾種方式加速:

- 降低輸出分辨率(從 2K 降到 1024×1024)

- 簡化指令(一次只問一件事,不要塞太多約束)

- 改用標準模式(精度略降,耗時降到 60-90 秒)

問題 3:GPT-image-2 漫畫風格效果比 Midjourney 強嗎?

取決於評估維度。Midjourney 在"藝術性、畫面衝擊力"上仍有優勢;GPT-image-2 在**"原始照片→漫畫"的人物一致性和"多分鏡連貫敘事"**上有突破。兩者並非替代關係,建議根據具體需求選擇。

問題 4:髮型試戴生成的圖片可以直接給理髮師看嗎?

可以。GPT-image-2 思考模式生成的髮型圖已經具備足夠的真實感和可識別度。建議你打印出來或在手機上展示給理髮師,他們能基於這個具體方案給你專業建議。

問題 5:通過 API易 apiyi.com 接入與 OpenAI 官方有差異嗎?

字段完全一致——APIYI 是官轉通道,請求/響應字段與 OpenAI 官方 100% 同步。區別主要在三個方面:國內直連不需要代理、有專門的中文技術支持、計費透明可見。我們建議國內開發者通過 API易 apiyi.com 接入 gpt-image-2 以避免網絡穩定性問題。

問題 6:生成的圖片有沒有版權問題?

OpenAI 的圖像生成內容遵循 OpenAI Usage Policies——基於自己上傳照片的二次創作(證件照、漫畫頭像、試發圖)屬於個人合理使用。商業用途(比如把生成的漫畫頭像用於商品包裝)需要遵守 OpenAI 的商業使用條款。

問題 7:GPT-image-2 能記住我的臉做後續生成嗎?

同會話內可以——思考模式會記住前一次上傳的照片特徵,後續 prompt 可以引用。但跨會話不保證——新對話需要重新上傳。建議把"參考照"作爲持續可用的素材庫自己保存。

問題 8:GPT-image-2 的費用大概是什麼水平?

API 調用按 token 和圖像分辨率計費——單張 2K 圖思考模式約 $0.10-0.30,標準模式約 $0.03-0.08。每月做 100-200 張創意圖的個人用戶,月度成本可控在合理範圍。我們建議通過 API易 apiyi.com 平臺按 token 透明計費,避免國外信用卡支付的麻煩。

GPT-image-2 創意應用 Key Takeaways

- OpenAI 郵件營銷話術背後的真實升級是「思考模式 + 多圖一致性」兩個能力的疊加

- 證件照場景:思考模式畫質達到照相館水準,單張成本遠低於線下,且支持任意規格定製

- 漫畫風格場景:模型把"風格"理解爲視覺語言而非濾鏡,支持少年/少女/Q版/賽璐璐等細分流派

- 髮型試戴場景:6 張並排試發佈告板形式讓用戶能橫向對比,是過去專用 App 難以做到的

- 思考模式 vs 標準模式:複雜指令、面部精度敏感場景必選思考模式,速度優先選標準模式

- 國內調用建議:通過 API易 apiyi.com 直連接入,超時設置 360 秒以上,base_url 替換即可

- 真正受益的是普通用戶:過去需要 Photoshop+Stable Diffusion+LoRA 的工作流,現在一句話搞定

總結

GPT-image-2 不是一次普通的模型升級——它把過去只有專業工具鏈才能完成的創意任務下放到了"會用 ChatGPT 的人"手中。這不僅是技術指標的變化,更是創意工具民主化的真實兌現。

證件照、漫畫風、髮型設計這三個場景之所以值得重點關注,是因爲它們覆蓋了最廣泛的普通用戶日常需求——求職、社交、個人形象管理。而 GPT-image-2 在這些場景上的表現,已經達到甚至超過專門工具的水平。

給不同人羣的建議:

- 普通用戶:從 ChatGPT Plus 網頁版起步,先用思考模式做幾張證件照熟悉能力邊界

- 理髮師/造型師/形象設計師:把"6 張並排試發圖"做成你的標準服務流程,會顯著提升客戶決策效率

- 二次元/小紅書博主:用"主角一致的 8 格分鏡"能力做出過去做不到的內容形式

- 國內開發者:通過 APIYI 接入 API,把這些能力嵌入到你自己的產品裏,做更垂直的應用

✨ 最後的建議:對於國內用戶和企業,我們建議通過 API易 apiyi.com 平臺接入 gpt-image-2,國內直連穩定、字段與官方完全一致、按 token 透明計費。新用戶還有免費測試額度,足夠走完本文 3 個場景的全部測試,驗證後再決定是否擴展到生產環境。

作者:APIYI Team

最後更新:2026-05-02