Muchos diseñadores y desarrolladores que utilizan gpt-image-2 suelen hacer la misma pregunta: ¿Se pueden generar archivos PSD con capas directamente? La respuesta tiene dos vertientes: la versión web de ChatGPT puede lograr la edición por capas gracias a su integración con Adobe Photoshop, mientras que la API de gpt-image-2, por sí sola, solo puede generar formatos convencionales como PNG, JPEG o WEBP.

En este artículo, aclararemos los límites reales de la capacidad de gpt-image-2 para generar archivos PSD y te ofreceremos 3 flujos de trabajo prácticos para que elijas la ruta más adecuada según tus necesidades. Tanto si eres un creador individual como un desarrollador de equipos, aquí encontrarás la solución que buscas.

Conceptos clave sobre la salida PSD de gpt-image-2

Antes de empezar, debemos aclarar un hecho fundamental: gpt-image-2 es un modelo de generación de imágenes, no un software de edición de imágenes. Por sí mismo, no tiene la capacidad de generar "archivos con capas"; cualquier salida en formato PSD requiere el uso de herramientas externas.

Diferencias esenciales en las capacidades de salida

La definición oficial de OpenAI sobre los formatos de salida de la serie gpt-image es muy clara: el modelo solo admite 3 formatos de imagen rasterizada:

| Formato de salida | Extensión de archivo | ¿Tiene capas? | Canal alfa | Escenario típico |

|---|---|---|---|---|

| PNG | .png |

❌ No | ✅ Sí | Formato predeterminado, ideal para recursos con fondo transparente |

| JPEG | .jpg |

❌ No | ❌ No | Tamaño de archivo pequeño, ideal para fotografías |

| WEBP | .webp |

❌ No | ✅ Sí | Formato web moderno, buen equilibrio entre tamaño y calidad |

| PSD | .psd |

✅ Sí | ✅ Sí | La API no lo admite, requiere postprocesamiento |

🎯 Conclusión clave: La API de gpt-image-2 solo acepta los valores

png,jpegywebpa través del parámetrooutput_format. No existe ningún parámetro que permita obtener directamente un archivo PSD. Si necesitas realizar invocaciones estables de gpt-image-2 en proyectos empresariales, puedes integrarlo a través del servicio proxy de API APIYI (apiyi.com), que es compatible con las especificaciones de la interfaz oficial de OpenAI y admite todos los parámetros de los tres formatos de salida mencionados.

Por qué la API no puede generar PSD directamente

PSD es un formato de capas propietario de Adobe Photoshop que contiene capas, máscaras, modos de fusión, capas de ajuste y otras estructuras complejas. Para generar un PSD real, no se necesita un modelo de generación de imágenes, sino un motor de edición de imágenes. Es por eso que:

- API de gpt-image-2: Genera una imagen rasterizada plana de una sola vez; no comprende el concepto de "capas".

- ChatGPT (versión web): Gracias a la integración con la aplicación Adobe Photoshop, el proceso de creación de capas es realizado efectivamente por Photoshop.

Ambos pertenecen a sistemas completamente distintos, los cuales explicaremos por separado a continuación.

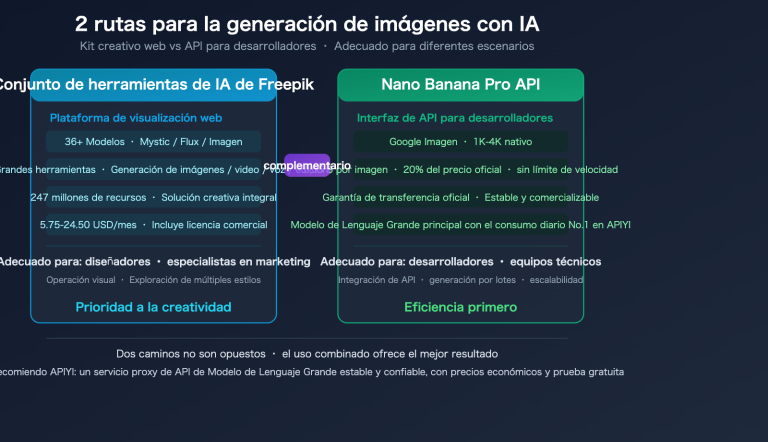

Comparativa de 3 soluciones para la salida PSD de gpt-image-2

Para satisfacer la necesidad de "necesito un archivo PSD", existen actualmente 3 rutas viables, cada una adecuada para diferentes escenarios. La siguiente tabla compara sus características principales:

| Solución | Método de implementación | Capas reales en PSD | Nivel de automatización | Público objetivo |

|---|---|---|---|---|

| Solución A: Integración ChatGPT + Photoshop | Invocación de plugin de Adobe en web | ✅ Sí | Semi-automático | Diseñadores individuales, necesidades ligeras |

| Solución B: Generación por API + Conversión manual en PS | Generar PNG vía API, luego importar a PS | ⚠️ Pseudo-capas (capa única) | Totalmente manual | Desarrolladores que requieren generación masiva |

| Solución C: Generación por API + Herramienta de capas de terceros | Separar capas con scripts/IA tras generar | ✅ Sí (estimación algorítmica) | Totalmente automático | Escenarios de ingeniería, flujos de trabajo |

🎯 Recomendación: Si solo necesitas una o dos imágenes con capas ocasionalmente, la Solución A es la más sencilla. Si necesitas integrar capacidades de generación de imágenes en tu producto, usar la API de gpt-image-2 a través de APIYI (apiyi.com) con una integración backend (Solución B o C) es la opción más controlable.

Solución A: Implementación de salida PSD mediante ChatGPT Web + Integración con Photoshop

Esta es una capacidad lanzada oficialmente por OpenAI en diciembre de 2025. Adobe colaboró con OpenAI para integrar Adobe Photoshop, Adobe Express y Adobe Acrobat en ChatGPT, permitiendo que 800 millones de usuarios utilicen funciones de edición profesional directamente en el chat.

Pasos para activar Photoshop para ChatGPT

La clave de todo el proceso es que ChatGPT actúa como un "Agente integral", distribuyendo la intención del lenguaje natural del usuario a gpt-image-2 para generar la imagen y luego entregándola a Adobe Photoshop para el procesamiento de capas.

Entrada del usuario → ChatGPT analiza la intención

├─ Invoca gpt-image-2 para generar la imagen base

└─ Invoca la aplicación Photoshop para procesar las capas

↓

Salida de archivo PSD descargable

Flujo de trabajo detallado:

- Inicia sesión en la versión web de ChatGPT (chatgpt.com) y confirma que tu cuenta se ha actualizado a la versión que incluye funciones de imagen.

- En el cuadro de entrada, haz clic en "+" → "Más" → selecciona la aplicación "Adobe Photoshop".

- Introduce una indicación, por ejemplo:

Usa Adobe Photoshop para generarme una ilustración de una ciudad nocturna y separa el personaje en primer plano, los edificios en plano medio y el cielo en el fondo en capas diferentes. - ChatGPT llamará automáticamente a gpt-image-2 para generar la imagen base.

- Inmediatamente después, invocará la aplicación Photoshop para realizar las operaciones de separación de capas, ajuste y mezcla.

- Una vez finalizado, haz clic en el botón de descarga dentro del chat para obtener el archivo PSD con capas.

Alcance de las capacidades de Photoshop para ChatGPT

La documentación oficial de ayuda de Adobe enumera las operaciones principales admitidas por la versión integrada:

| Tipo de operación | ¿Soportado? | Descripción |

|---|---|---|

| Ajuste de áreas locales | ✅ | Puede ajustar brillo y contraste en partes específicas |

| Efectos creativos | ✅ | Filtros integrados como Glitch, Glow, etc. |

| Desenfoque/Reemplazo de fondo | ✅ | Implementado mediante Adobe Firefly |

| Separación de capas | ✅ | Separa sujeto, primer plano y fondo |

| Máscaras y selecciones | ⚠️ Parcial | Para selecciones complejas, se recomienda la versión de escritorio |

| Objetos inteligentes | ❌ | No permite crear objetos inteligentes editables |

| Modos de fusión avanzados | ❌ | Solo admite modos de fusión básicos |

🎯 Nota sobre capacidades: Photoshop dentro de ChatGPT es adecuado para ediciones ligeras; las capacidades completas siguen estando en la versión de escritorio. Si necesitas generar PSDs de forma frecuente o masiva, conectar directamente a la API de gpt-image-2 a través de APIYI (apiyi.com) para obtener PNGs y luego entregarlos al Photoshop de escritorio es un flujo de trabajo más eficiente.

Limitaciones de la Solución A

Aunque la experiencia de integración entre ChatGPT y Photoshop es fluida, tiene varias limitaciones estrictas que debes conocer:

- No se puede invocar mediante API: Es una capacidad limitada a la versión web; no existe una interfaz API pública para replicar este flujo de trabajo en tus propios programas.

- Velocidad de generación lenta: La generación única más el procesamiento de capas suele tardar entre 60 y 120 segundos.

- Baja controlabilidad: La cantidad de capas, los nombres y el orden son decididos por ChatGPT, no acepta restricciones forzadas mediante la indicación.

- Límites de cuota: Los usuarios gratuitos tienen un número limitado de llamadas diarias, y los usuarios Plus también tienen un tope.

Estas limitaciones determinan que la Solución A sea adecuada para la "exploración de inspiración" y "creaciones únicas", pero no para entornos de producción estables.

Opción B: API de gpt-image-2 + conversión manual a PSD en Photoshop

Si tu necesidad es "generar imágenes en lote mediante programación y luego filtrarlas manualmente para convertirlas a PSD", la Opción B es la elección más directa. Esta ruta desacopla completamente la generación por IA del procesamiento de capas.

Ejemplo minimalista de invocación de la API de gpt-image-2

A continuación, el código mínimo ejecutable para generar imágenes mediante la API, utilizando una interfaz compatible con OpenAI:

import requests

import base64

response = requests.post(

"https://api.apiyi.com/v1/images/generations",

headers={"Authorization": "Bearer YOUR_API_KEY"},

json={

"model": "gpt-image-2",

"prompt": "Ciudad cyberpunk de noche, luces de neón, calle lluviosa",

"size": "1024x1024",

"quality": "high",

"output_format": "png"

}

)

data = response.json()["data"][0]

image_bytes = base64.b64decode(data["b64_json"])

with open("output.png", "wb") as f:

f.write(image_bytes)

📦 Ejemplo completo en Python (incluye manejo de errores y explicación de parámetros)

import os

import base64

import requests

from typing import Optional

def generate_image(

prompt: str,

output_path: str,

size: str = "1024x1024",

quality: str = "high",

output_format: str = "png",

background: Optional[str] = None

) -> dict:

"""

Invoca a gpt-image-2 para generar una imagen

Args:

prompt: descripción de la imagen

output_path: ruta del archivo de salida

size: 1024x1024 / 1024x1536 / 1536x1024

quality: low / medium / high

output_format: png / jpeg / webp

background: transparent / opaque (solo para png/webp)

"""

api_key = os.getenv("APIYI_API_KEY")

if not api_key:

raise ValueError("Por favor, configura la variable de entorno APIYI_API_KEY")

payload = {

"model": "gpt-image-2",

"prompt": prompt,

"size": size,

"quality": quality,

"output_format": output_format,

}

if background:

payload["background"] = background

response = requests.post(

"https://api.apiyi.com/v1/images/generations",

headers={

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

},

json=payload,

timeout=180

)

response.raise_for_status()

result = response.json()

image_data = result["data"][0]["b64_json"]

with open(output_path, "wb") as f:

f.write(base64.b64decode(image_data))

return {

"path": output_path,

"usage": result.get("usage", {}),

"size": size

}

if __name__ == "__main__":

info = generate_image(

prompt="Una ilustración de ciudad futurista, preparada para un póster publicitario de producto",

output_path="hero.png",

size="1536x1024",

quality="high",

background="transparent"

)

print(f"Generación exitosa: {info}")

🎯 Consejo de integración: Al usar APIYI (apiyi.com) para invocar a gpt-image-2, solo necesitas reemplazar la URL oficial de OpenAI

api.openai.comporapi.apiyi.com. El resto de los parámetros son totalmente compatibles y admiteoutput_formatpara configurar la salida en png, jpeg o webp.

Importar PNG a Photoshop y convertir a PSD

Una vez obtenido el PNG de la API, el flujo estándar para convertirlo a PSD en Photoshop es:

- Abre el archivo PNG en la versión de escritorio de Photoshop (

Archivo → Abrir). - La imagen aparecerá como una sola capa, generalmente etiquetada como "Fondo".

- Haz doble clic en la capa para desbloquearla y convertirla en una capa editable.

- Separa el sujeto según sea necesario:

- Usa la Herramienta de selección de objetos para identificar automáticamente el sujeto.

- Usa el Relleno generativo para volver a dibujar el fondo.

- Usa los Canales Alfa para extraer áreas transparentes.

- Guarda como PSD:

Archivo → Guardar como → Photoshop (.PSD).

Capacidad real de separación de capas en la Opción B

Ten en cuenta que, al convertir directamente de PNG a PSD, por defecto solo tendrás 1 capa. Para obtener un PSD con capas reales, debes realizar un trabajo adicional de separación. Las prácticas comunes incluyen:

| Método de separación | Complejidad operativa | Calidad de capas |

|---|---|---|

| Selección manual + duplicar capa | Alta | Muy alta |

| Herramientas de recorte por IA (Remove.bg) | Baja | Media |

| Selección de objetos en Photoshop + Relleno generativo | Media | Alta |

| Estimación de profundidad con filtros neuronales | Baja | Media (pseudo-3D) |

Consejos de ingeniería de indicaciones (Prompt) para generar PSD con gpt-image-2

Para maximizar la eficiencia de la separación en la Opción B, debes considerar la posibilidad de separar capas desde la fase de la indicación. Aquí tienes una plantilla de indicación validada:

[Sujeto]: Un póster publicitario de producto, el sujeto es una zapatilla deportiva futurista

[Requisitos de composición]:

- Sujeto centrado, ocupando el 60% del área de la imagen

- Fondo de color sólido o degradado simple, para facilitar el recorte posterior

- Diferencia de color clara y separación de profundidad entre el sujeto y el fondo

- No incluir elementos similares al sujeto en el fondo

[Parámetros de salida]:

- Resolución: 1536x1024

- Fondo: transparent (si es compatible)

- Estilo: Calidad de fotografía comercial

Este estilo de indicación hace que el PNG generado sea más "amigable" para la separación posterior, mejorando significativamente la tasa de precisión de las herramientas de recorte.

| Palabra clave en la indicación | Impacto en la separación |

|---|---|

pure background / solid color background |

Bordes de recorte más limpios |

clear subject separation |

Límites claros entre sujeto y fondo |

centered composition |

Facilita la detección automática del sujeto |

studio lighting |

Reduce sombras proyectadas, disminuye errores |

no overlapping elements |

Evita que las capas se oculten entre sí |

🎯 Mejora de eficiencia: Al conectarte a gpt-image-2 a través de APIYI (apiyi.com), puedes utilizar plantillas de indicación a nivel de sistema para preestablecer estas restricciones, asegurando que todas las imágenes generadas por el equipo sean compatibles con el flujo de trabajo de PSD.

Opción C: API + Herramientas de terceros para automatizar la salida a PSD

Para escenarios de producción (como la generación automática de materiales de comercio electrónico o líneas de montaje publicitarias), la operación manual en Photoshop no es viable. Aquí es donde se deben introducir herramientas de separación automatizadas.

Arquitectura del flujo de trabajo automatizado

[Indicación del usuario]

↓

[Generación de imagen original vía API gpt-image-2]

↓

[Modelo de segmentación semántica para identificar áreas] (ej. SAM, Florence)

↓

[Generación de canales Alfa para cada capa]

↓

[Escritura a PSD mediante psd-tools / photoshop-python-api]

↓

[Salida de archivo PSD con múltiples capas]

Toda la línea de producción puede implementarse mediante código, sin necesidad de abrir el cliente de Photoshop.

Combinación de herramientas clave

| Herramienta | Función | Recomendación |

|---|---|---|

| psd-tools (Python) | Lectura/escritura de estructura PSD | ⭐⭐⭐⭐⭐ |

| Pillow | Procesamiento básico de imágenes | ⭐⭐⭐⭐⭐ |

| SAM (Segment Anything) | Segmentación semántica de Meta | ⭐⭐⭐⭐⭐ |

| rembg | Recorte con un clic, eliminación de fondo | ⭐⭐⭐⭐ |

| MiDaS | Estimación de profundidad, separación de planos | ⭐⭐⭐⭐ |

| Photopea API | Edición de PSD en línea | ⭐⭐⭐ |

Código de ejemplo para separación automatizada

from psd_tools import PSDImage

from psd_tools.api.layers import PixelLayer

from PIL import Image

from rembg import remove

original = Image.open("gpt_image_2_output.png")

foreground = remove(original)

background = Image.new("RGBA", original.size, (255, 255, 255, 0))

psd = PSDImage.new(mode="RGBA", size=original.size)

psd.append(PixelLayer.frompil(background, psd, "Background"))

psd.append(PixelLayer.frompil(foreground, psd, "Foreground"))

psd.save("layered_output.psd")

🎯 Sugerencia de ingeniería: En entornos de producción, se recomienda encapsular el proceso de "invocar gpt-image-2 → recortar → escribir PSD" como un microservicio. La invocación de la API de gpt-image-2 a través de APIYI (apiyi.com) admite alta concurrencia y facturación estable, ideal como capacidad base para flujos de trabajo de imagen.

Consideraciones de la Opción C

- La calidad de las capas depende del modelo de segmentación: SAM es más preciso que rembg, pero tiene un mayor costo de inferencia.

- Compatibilidad con PSD: Los PSD generados por psd-tools funcionan bien en las versiones principales de Photoshop, aunque en versiones muy antiguas podrían perderse metadatos.

- Costo computacional en lotes: Ejecutar el modelo de segmentación para cada imagen aumentará significativamente los costos de GPU.

- Las soluciones híbridas son más realistas: Una opción es generar la imagen mediante API + separación de fondo simple + un pequeño retoque manual.

Avanzado: Código práctico para separación por múltiples roles

Cuando necesites colocar múltiples objetos semánticos, como personas, productos y texto, en capas independientes, puedes combinar SAM (Segment Anything Model) para realizar una segmentación más precisa:

📦 Ejemplo completo de separación por múltiples objetos semánticos con SAM + psd-tools

import torch

import numpy as np

from PIL import Image

from segment_anything import SamPredictor, sam_model_registry

from psd_tools import PSDImage

from psd_tools.api.layers import PixelLayer

def gpt_image_to_layered_psd(image_path: str, output_psd: str, points: list):

"""

Divide el PNG de salida de gpt-image-2 en un PSD con capas de objetos semánticos

Args:

image_path: ruta del PNG generado por gpt-image-2

output_psd: ruta del archivo PSD de salida

points: lista de puntos centrales de los objetos a segmentar [(x, y, etiqueta), ...]

"""

image = Image.open(image_path).convert("RGBA")

image_np = np.array(image)

sam = sam_model_registry["vit_h"](checkpoint="sam_vit_h.pth")

sam.to("cuda" if torch.cuda.is_available() else "cpu")

predictor = SamPredictor(sam)

predictor.set_image(image_np[:, :, :3])

psd = PSDImage.new(mode="RGBA", size=image.size)

for idx, (x, y, label) in enumerate(points):

masks, scores, _ = predictor.predict(

point_coords=np.array([[x, y]]),

point_labels=np.array([1]),

multimask_output=False

)

mask = masks[0]

layer_array = image_np.copy()

layer_array[~mask] = [0, 0, 0, 0]

layer_image = Image.fromarray(layer_array, "RGBA")

psd.append(PixelLayer.frompil(layer_image, psd, label))

background_array = image_np.copy()

background_image = Image.fromarray(background_array, "RGBA")

background_layer = PixelLayer.frompil(background_image, psd, "Background")

psd.insert(0, background_layer)

psd.save(output_psd)

print(f"✅ PSD con múltiples capas generado: {output_psd}")

if __name__ == "__main__":

gpt_image_to_layered_psd(

image_path="gpt_image_2_poster.png",

output_psd="layered_poster.psd",

points=[

(512, 400, "Sujeto"),

(200, 600, "ProductoIzquierda"),

(800, 600, "ProductoDerecha"),

]

)

A través de este proceso, un póster generado por gpt-image-2 puede dividirse en un PSD de 3 a 5 capas reales, donde cada capa puede editarse de forma independiente en Photoshop.

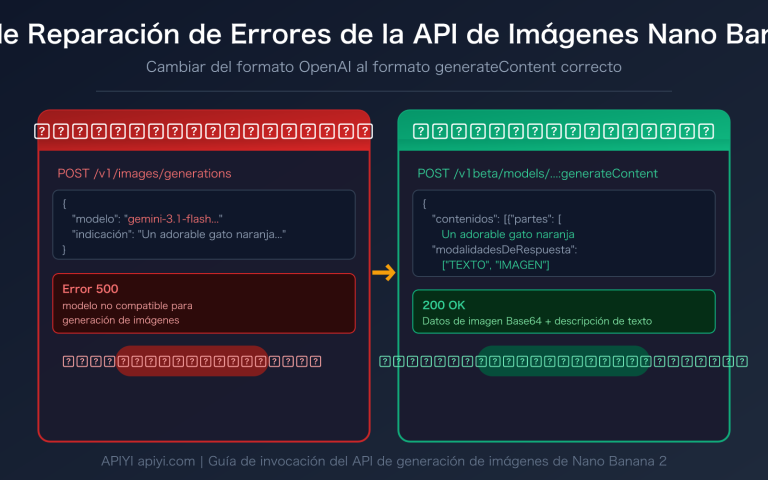

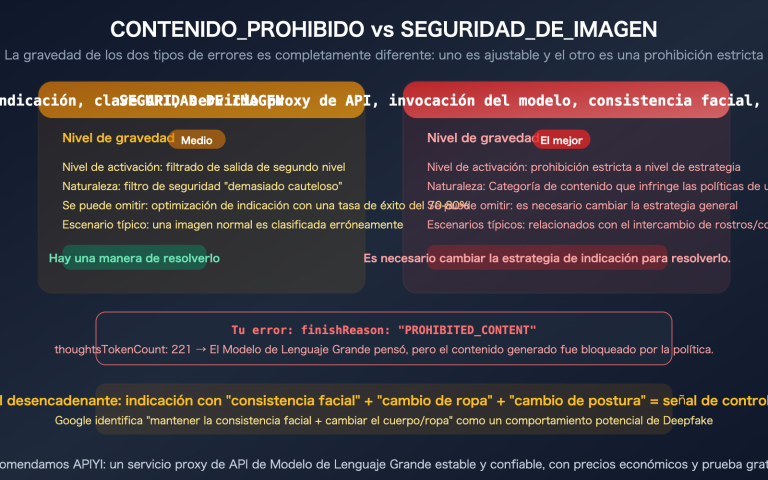

Manejo de errores y resolución de problemas

En escenarios de ingeniería, tanto la invocación de gpt-image-2 como la separación posterior pueden fallar. La siguiente tabla resume los problemas frecuentes y cómo abordarlos:

| Fenómeno | Causa raíz | Solución |

|---|---|---|

La API devuelve invalid output_format |

Se pasó un valor no admitido como psd |

Usar solo png/jpeg/webp |

El campo b64_json está vacío |

Interceptado por el filtro de contenido | Optimizar la indicación, evitar descripciones sensibles |

| Bordes dentados tras el recorte | Precisión insuficiente del modelo de segmentación | Usar SAM + posprocesamiento de suavizado de bordes |

| El PSD no abre en Photoshop | Metadatos de escritura incompletos en psd-tools | Actualizar psd-tools a la versión 1.9+ |

| Capas desalineadas tras la separación | Canales RGBA no alineados | Unificar el tamaño del lienzo antes de escribir |

| Velocidad de invocación lenta | Limitación de tasa por alta concurrencia | Usar el enrutamiento multicanal de APIYI (apiyi.com) |

🎯 Consejo de estabilidad: En entornos de producción, se recomienda añadir lógica de reintento y degradación en la capa de invocación de la API. Las solicitudes enviadas a través de APIYI (apiyi.com) identificarán automáticamente las respuestas de limitación de tasa de OpenAI y admitirán un cambio inteligente, reduciendo la tasa de fallos en tareas por lotes.

Preguntas frecuentes sobre la salida PSD de gpt-image-2

A continuación, resolvemos las dudas más frecuentes que surgen durante el uso práctico de esta herramienta.

Q1: ¿Es cierto que la API de gpt-image-2 no puede exportar directamente a PSD?

Confirmado, no puede. La documentación oficial de OpenAI limita explícitamente los valores del parámetro output_format a png, jpeg y webp. Cualquier servicio que afirme que su "API exporta directamente a PSD" está, en esencia, ejecutando un proceso de separación de capas en sus propios servidores (la "Solución C") y empaquetando el resultado como un archivo PSD. Esto no es una capacidad nativa del modelo gpt-image-2.

🎯 Aclaración: Si deseas integrar de forma estable el gpt-image-2 oficial, puedes utilizar servicios proxy de API compatibles con la interfaz de OpenAI, como APIYI (apiyi.com). Esto garantiza que el comportamiento de los parámetros sea idéntico al de OpenAI, evitando "modificaciones" no deseadas por capas intermedias.

Q2: ¿Son reales las capas del PSD que genera la versión web de ChatGPT?

Sí, son reales. Esto se debe a que, detrás de escena, se está ejecutando una aplicación real de Adobe Photoshop que realiza las operaciones de edición, generando un PSD que contiene capas, máscaras y efectos reales. Sin embargo, no puedes controlar con precisión la cantidad ni el nombre de las capas; en la mayoría de los casos, obtendrás entre 3 y 5 capas (fondo, sujeto, primer plano, capas de ajuste, etc.).

Q3: ¿Hay diferencias en el formato de salida entre gpt-image-2 y gpt-image-2-all?

Existen diferencias sutiles. gpt-image-2-all utiliza el canal inverso equivalente a la versión web de ChatGPT, por lo que el campo b64_json devuelto incluye el prefijo data:image/png;base64,. Por otro lado, gpt-image-2 se conecta directamente a la API de imágenes de OpenAI y devuelve una cadena base64 pura sin prefijo. Ninguno de los dos admite la salida PSD, pero el código de procesamiento de cadenas subyacente debe tratarse de forma distinta.

Q4: Si solo necesito un PNG con fondo transparente, ¿ya no necesito PSD?

Para muchos escenarios, es correcto. La API de gpt-image-2 admite el parámetro background: "transparent", generando directamente un PNG con fondo transparente, lo cual es ideal para:

- Recorte de productos para comercio electrónico.

- Logos, iconos y materiales de pegatinas.

- Elementos de interfaz de usuario (UI).

Solo cuando necesites realizar ajustes por capas en partes que no son el sujeto principal, será necesario recurrir a un flujo de trabajo con PSD.

Q5: ¿Cómo controlar los costos de la generación masiva de PSD?

Los costos se componen principalmente de tres partes:

| Ítem de costo | Parte de la API gpt-image-2 | Parte de post-procesamiento |

|---|---|---|

| Costo por unidad | ~$0.03 – $0.20/imagen | Potencia de GPU para recorte ~$0.001 |

| Tiempo | 60-120 segundos | 5-30 segundos |

| Estabilidad | Sujeto a límites de OpenAI | Potencia de cómputo propia controlable |

🎯 Estrategia de ahorro: Para escenarios de gran volumen, se recomienda realizar la separación de capas solo en las imágenes candidatas de alta calidad. Primero, utiliza parámetros de baja calidad (

quality=low) en gpt-image-2 para generar una vista previa rápida, verifica el consumo a través de la facturación unificada de APIYI (apiyi.com) y, una vez satisfecho, regenera con calidad alta para entrar en la línea de producción de capas.

Q6: ¿Se puede usar gpt-image-2 para editar directamente un archivo PSD existente?

No. La interfaz de edición de imágenes de gpt-image-2 solo acepta entradas en formato PNG/JPEG/WEBP y no puede reconocer la estructura de capas interna de un PSD. Si deseas "volver a dibujar con IA una capa específica de un PSD", el procedimiento estándar es:

- Exportar esa capa desde Photoshop como PNG (con canal Alfa).

- Usar la interfaz de edición de gpt-image-2 junto con una máscara para el redibujado.

- Importar el resultado de vuelta al PSD original como una nueva capa.

Casos prácticos de la industria con gpt-image-2 y salida PSD

Diferentes industrias tienen demandas muy distintas para la salida PSD; la elección de la solución depende del escenario de negocio. A continuación, presentamos 3 flujos de trabajo típicos.

Caso 1: Producción masiva de carteles de productos para comercio electrónico

Un equipo de comercio electrónico transfronterizo necesita generar más de 300 carteles de productos al día. El requisito es: una capa para el producto, una para el fondo y una para el texto, facilitando que el equipo de operaciones reemplace el texto rápidamente según el mercado.

Diseño del flujo de trabajo:

- Tras subir el producto, el equipo de operaciones completa las palabras clave de venta en el backend.

- Se invoca la API de gpt-image-2 para generar la imagen principal (

output_format=png,background=transparent). - Se utiliza rembg para confirmar los bordes del recorte.

- Se utiliza psd-tools para generar una estructura de 3 capas:

- Capa 1: Sujeto del producto (fondo transparente).

- Capa 2: Fondo de escena generado por IA.

- Capa 3: Capa de texto de marcador de posición.

- El diseñador solo necesita modificar la capa de texto en el PSD para publicar.

Beneficio de eficiencia: El tiempo de producción por cartel se reduce de 30 minutos a 2 minutos; el diseñador solo realiza la revisión final.

🎯 Selección de escenario: Para escenarios repetitivos de alto volumen, la combinación de la interfaz gpt-image-2 de APIYI (apiyi.com) con planes de facturación empresarial permite costos predecibles y una capacidad de producción escalable.

Caso 2: Prototipado rápido de activos de UI para juegos

El equipo de arte de juegos necesita una gran cantidad de activos de UI de "marcador de posición" (botones, iconos, banners, etc.) durante la fase de prototipado, con el requisito de que estén en formato PSD para su posterior refinamiento.

Diseño del flujo de trabajo:

gpt-image-2 genera la base visual

↓

SAM segmenta automáticamente la forma del sujeto

↓

Exportación de múltiples PNG (marco, icono, brillo, etc.)

↓

psd-tools integra todo en un PSD con capas

↓

El artista refina la versión final en PS

| Tipo de activo | Salida gpt-image-2 | Acción de post-procesamiento | Capas finales |

|---|---|---|---|

| Botón | PNG transparente | Recorte de estados (default/hover/pressed) | 3 |

| Icono | PNG transparente | Separación de brillo/sombra | 2-4 |

| Banner | PNG RGB | Separación de sujeto/fondo/efectos de luz | 3-5 |

| Tarjeta | PNG RGB | Separación de borde/fondo/etiqueta | 3-4 |

Caso 3: Versiones multilingües de contenido de marketing

El equipo de publicidad necesita adaptar una imagen principal a 10 versiones de idiomas diferentes. El requisito central es que la capa de texto sea independiente y la capa de imagen sea fija.

Operación clave:

- Usar gpt-image-2 para generar una imagen principal "sin texto" (especificar claramente en el prompt

no text,no letters). - Crear marcadores de posición para las capas de texto mediante psd-tools.

- Posteriormente, solo es necesario modificar la capa de texto para exportar las 10 versiones de idioma.

La ventaja de este flujo es que: la imagen principal se genera una sola vez y la capa de texto es totalmente controlable, evitando errores ortográficos comunes cuando la IA genera texto en múltiples idiomas.

🎯 Recordatorio sobre multilingüismo: gpt-image-2 es relativamente fiable generando texto en inglés, pero tiende a cometer errores al generar chino, japonés o coreano. Se recomienda que, al llamar a gpt-image-2 a través de APIYI (apiyi.com), excluyas explícitamente el texto en el prompt y gestiones el texto de forma unificada mediante capas de texto en el PSD.

Caso 4: Asistencia en guiones gráficos para cómics e ilustraciones

Los ilustradores suelen usar gpt-image-2 para generar inspiración de bocetos durante la creación de guiones gráficos, para luego refinarlos en Photoshop. Este flujo mixto de "inspiración por IA + refinamiento humano" requiere una estructura de capas más detallada.

Esquema de capas típico:

- Capa de boceto: Salida original de gpt-image-2, conservada como capa de referencia inferior.

- Capa de trazo: Dibujo de líneas basado en el boceto.

- Capa de color base: Relleno de bloques de color.

- Capa de sombra: Definición de áreas oscuras.

- Capa de brillo: Detalles de luz.

- Capa de efectos: Elementos decorativos.

Puntos clave de operación:

1. gpt-image-2 genera una composición vertical de 1024x1536.

2. En Photoshop, establecer esta imagen como Capa 0 (bloqueada y no editable).

3. Crear 5-6 capas vacías encima para dibujar.

4. Guardar como PSD al finalizar para archivar.

Este proceso convierte el boceto de la IA en un activo sobre el cual se puede seguir trabajando, en lugar de ser solo una imagen desechable.

Comparativa de gpt-image-2 frente a otros formatos de imagen

Para entender mejor el lugar que ocupa el formato PSD en tu flujo de trabajo, vamos a realizar una comparativa horizontal con otros formatos de salida comunes.

| Formato | Tamaño de archivo | Facilidad de edición | Compatibilidad | Ideal para postprocesado de gpt-image-2 |

|---|---|---|---|---|

| PNG | Medio | Baja (plano) | ✅ Excelente | ⭐⭐⭐⭐⭐ Predeterminado |

| JPEG | Pequeño | Muy baja | ✅ Excelente | ⭐⭐⭐ Solo para vista previa |

| WEBP | Pequeño | Baja | ⚠️ Enfocado a Web | ⭐⭐⭐ Ideal para Web |

| PSD | Grande | ✅ Muy alta | ⚠️ Ecosistema Adobe | ⭐⭐⭐⭐ Requiere postprocesado |

| TIFF | Muy grande | Media | ✅ Enfocado a impresión | ⭐⭐ Escenarios de impresión |

| SVG | Pequeño | ✅ Muy alta (vectorial) | ✅ Web/Impresión | ❌ No soportado por gpt-image-2 |

Como puedes ver en esta tabla, el valor principal del PSD es su "facilidad de edición", algo difícil de reemplazar con otros formatos. Si no necesitas realizar ediciones posteriores, el formato PNG suele ser la opción más adecuada.

Resumen de mejores prácticas para la salida PSD en gpt-image-2

Volviendo a la pregunta inicial: ¿Cómo exportar archivos PSD desde gpt-image-2? Tras analizarlo a fondo, podemos resumir la conclusión principal en tres puntos:

- La ruta de la API no permite exportar PSD directamente: La API de gpt-image-2 solo admite formatos de mapa de bits (PNG / JPEG / WEBP); este es el límite de capacidad del modelo.

- La versión web de ChatGPT puede exportar PSD con capas reales mediante Photoshop: La aplicación Adobe Photoshop se encarga del procesamiento de capas, lo cual es ideal para las necesidades ligeras de diseñadores individuales.

- Los escenarios de ingeniería requieren una solución combinada de "generación por API + postprocesado": Utiliza herramientas como SAM o rembg para separar capas automáticamente y

psd-toolspara escribir el archivo, logrando así una automatización por lotes.

| Perfil de usuario | Solución recomendada | Combinación de herramientas |

|---|---|---|

| Diseñador individual | Solución A | Integración de ChatGPT + Photoshop |

| Equipos pequeños | Solución B | API de gpt-image-2 + Photoshop de escritorio (manual) |

| Desarrolladores empresariales | Solución C | API de gpt-image-2 + Pipeline de capas automatizado |

🎯 Recomendación final: Primero prueba la integración con Photoshop en la versión web de ChatGPT para entender el flujo de trabajo de las capas antes de decidir si construir un pipeline de API. Si decides realizar una integración a nivel de ingeniería, puedes acceder a gpt-image-2 de forma unificada a través de APIYI (apiyi.com). Esta plataforma ofrece interfaces compatibles con OpenAI accesibles desde China, garantizando estabilidad de nivel empresarial y transparencia en la facturación.

Esperamos que esta guía completa sobre la salida PSD en gpt-image-2 te ayude a evitar complicaciones. La verdadera dificultad de generar archivos PSD con gpt-image-2 no reside en la API, sino en elegir el flujo de trabajo adecuado. Al seleccionar la solución A, B o C según tu volumen de trabajo, presupuesto y necesidades de automatización, generalmente podrás tener el proceso completo funcionando en una semana.

Autor: Equipo técnico de APIYI | apiyi.com — Plataforma de servicio proxy de API para Modelos de Lenguaje Grande de nivel empresarial