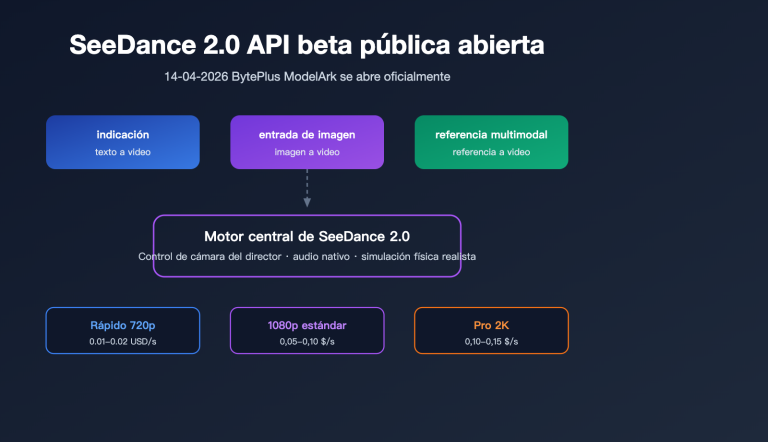

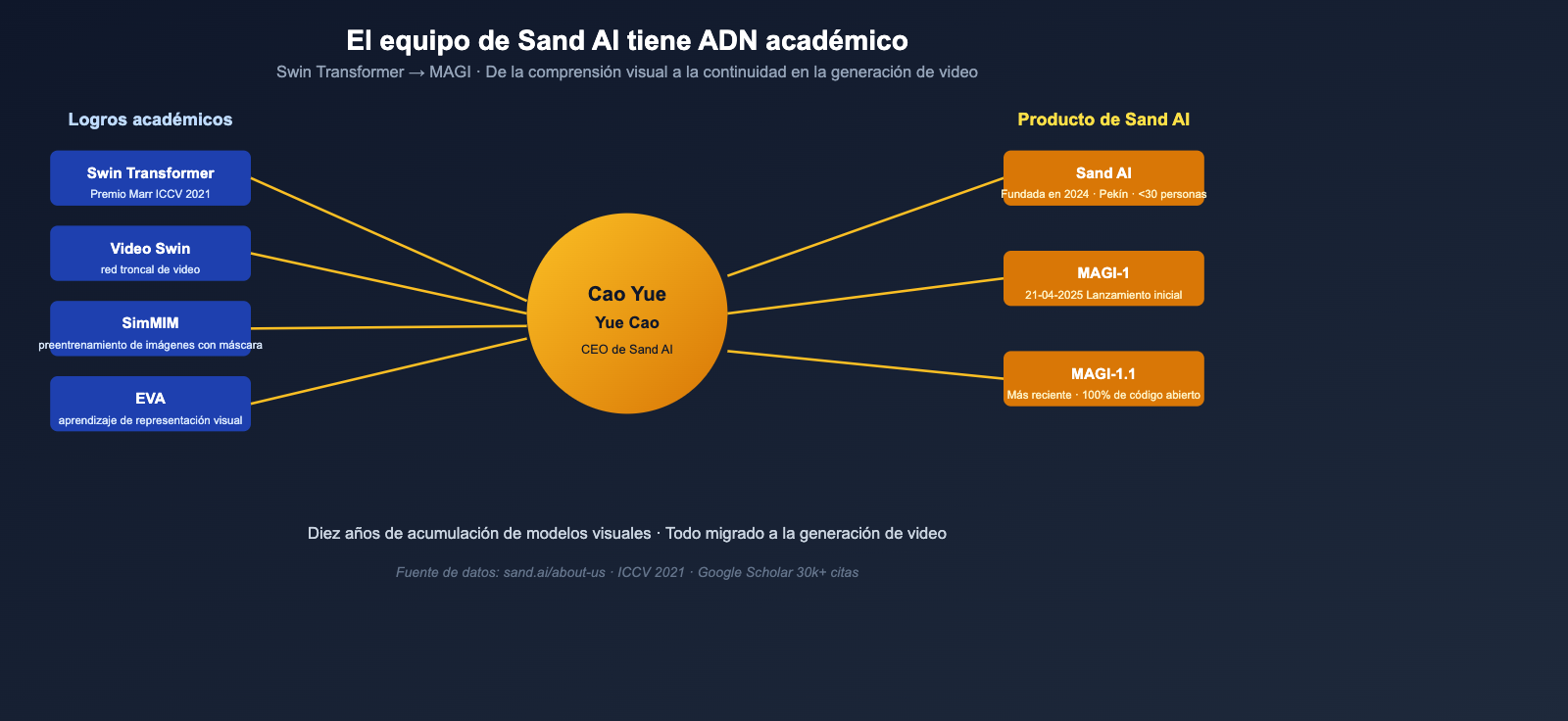

Si últimamente has visto repetirse el nombre Sand AI en Hugging Face, GitHub o en la comunidad de IA en inglés, y sientes curiosidad por el lanzamiento de MAGI-1 / MAGI-1.1, este artículo es para ti. A diferencia de muchos "equipos de modelos de video que surgen de la nada", Sand AI tiene un origen técnico muy sólido: su CEO, Cao Yue, es el autor principal de Swin Transformer, un artículo que ganó el premio al mejor trabajo (Marr Prize) en ICCV 2021, cuenta con más de 30,000 citas en Google Scholar y es ampliamente utilizado por gigantes como Microsoft Office 365, Azure, TikTok y Kuaishou. En otras palabras, Sand AI no es un equipo improvisado, sino el resultado de los años de experiencia en modelos visuales del equipo original de Swin Transformer aplicados ahora a la generación de video.

Lo que más entusiasma a la comunidad internacional es que Sand AI no solo ha creado un modelo de generación de video competitivo, sino que ha decidido abrirlo por completo: el conjunto completo de pesos de MAGI-1, el código y las herramientas de inferencia están disponibles bajo licencia Apache 2.0 en GitHub y Hugging Face. En esta ola de "modelos de video nacionales de código abierto" de 2025-2026, Sand AI es uno de los pocos equipos que ha logrado implementar y liberar la nueva ruta de la "generación de video autorregresiva". Este artículo abordará qué es Sand AI a través de seis dimensiones: antecedentes de la empresa, trayectoria del fundador, arquitectura técnica de MAGI, estrategia de código abierto y público objetivo.

Resumen de información clave de Sand AI

Antes de profundizar, hemos resumido todos los hechos clave sobre "qué es Sand AI" en una sola tabla.

| Dimensión | Información pública de Sand AI |

|---|---|

| Nombre en inglés | Sand AI (sitio web sand.ai) |

| Antecedentes | Fundada por el autor principal de Swin Transformer, Cao Yue |

| Ubicación | Pekín, China |

| Tamaño del equipo | Menos de 30 personas, edad promedio menor a 30 años |

| Misión | "Impulsar la IA para beneficiar a todos", abrazar el código abierto y la colaboración abierta |

| CEO | Cao Yue (Yue Cao), ex responsable del centro de investigación de modelos visuales de la Academia de IA de Pekín (BAAI) |

| Producto insignia | Modelo de generación de video autorregresivo MAGI / MAGI-1 / MAGI-1.1 |

| Lanzamiento inicial | 21 de abril de 2025 (MAGI-1) |

| Versión más reciente | MAGI-1.1 (100% código abierto) |

| Especificaciones | Versiones de 24B y 4.5B parámetros |

| Licencia | Apache 2.0, GitHub SandAI-org/MAGI-1 + Hugging Face sand-ai/MAGI-1 |

| Innovación central | Combinación de autorregresión + difusión (Autoregressive Denoising Diffusion) |

| Acceso Web | magi.sand.ai/app/projects |

| Plataforma API | platform.sand.ai/docs |

| Principales competidores | Series Wan, HunyuanVideo, Hailuo, Sora, etc. |

🎯 Consejo de comprensión rápida: Si solo quieres recordar a Sand AI con una frase, puedes decir: "Es una startup de código abierto que ha trasladado la experiencia en modelado visual de Swin Transformer a la generación de video". Si quieres probar ahora mismo las diferencias entre la serie MAGI y otros modelos de video, te sugerimos usar primero una plataforma unificada como APIYI (apiyi.com) para ejecutar modelos maduros como Sora 2, Veo 3.1 o Kling, y luego descargar MAGI-1.1 desde sand.ai o Hugging Face para comparar; así notarás de inmediato las diferencias de la "ruta autorregresiva".

Antecedentes y ADN del equipo de Sand AI

Para entender por qué Sand AI ha logrado desarrollar un modelo de video competitivo desde el primer día, es fundamental analizar los antecedentes de su equipo.

Fundador: Cao Yue, el padre de Swin Transformer

El CEO de Sand AI, Cao Yue (Yue Cao), es un nombre muy conocido tanto en el ecosistema de IA de China como en el ámbito académico internacional. Su trayectoria profesional se resume en los siguientes puntos clave:

| Periodo | Experiencia |

|---|---|

| 2019-2022 | Investigador sénior en Microsoft Research Asia, autor principal de Swin Transformer |

| 2021 | Swin Transformer gana el premio al mejor artículo (Marr Prize) en ICCV 2021 |

| 2022-2023 | Cofundador de Lightyear AI, posteriormente adquirida por Meituan |

| 2023-2024 | Director del Centro de Investigación de Modelos Visuales de la Academia de Inteligencia Artificial de Beijing (BAAI), enfocado en modelos visuales fundamentales y modelos de lenguaje grandes multimodales |

| 2024-presente | Fundador de Sand AI, ejerce como CEO |

La influencia de Swin Transformer sigue vigente: el artículo ha sido citado más de 30,000 veces en Google Scholar y se aplica ampliamente en las cadenas de procesamiento de comprensión visual de productos como Microsoft Office 365, Azure Cognitive Service, TikTok y Kuaishou. También fue el trabajo precursor de Video Swin Transformer; en cierto sentido, el propio Cao Yue representa la continuidad en la ruta técnica que va "de la comprensión visual a la generación de video".

Tamaño del equipo: Un "equipo de élite" de menos de 30 personas

La estructura de Sand AI difiere enormemente de la mayoría de las empresas de modelos de lenguaje grandes: en total suman menos de 30 personas, abarcando las áreas de producto, marketing, ingeniería e investigación, con una edad media del equipo central inferior a los 30 años. Esta estructura de equipo pequeño es inusual en la ola de startups de IA de los últimos años, pero implica:

- Cadenas de decisión cortas y una velocidad de iteración rápida;

- Una alta integración entre ingeniería e investigación, donde las innovaciones a nivel de artículo científico se convierten directamente en productos;

- Ausencia de los "muros departamentales" típicos de las grandes empresas; 3 personas son suficientes para poner en marcha una nueva cadena de procesos.

Este ADN "pequeño pero sólido" es la razón fundamental por la que Sand AI pudo presentar un modelo de alta madurez como MAGI-1 en abril de 2025.

Misión de la empresa y actitud hacia el código abierto

En su página "sobre nosotros", Sand AI define su misión como: "Advance AI to benefit everyone (Impulsar la IA para beneficiar a todos)", y declara explícitamente su intención de "adoptar el código abierto, promover el progreso a través de la colaboración abierta y hacer que la IA de vanguardia esté disponible para todos". Esto no es solo un eslogan de marketing: los modelos MAGI-1 y MAGI-1.1 lanzados posteriormente por Sand AI son de código abierto bajo la licencia Apache 2.0, publicando pesos, código de inferencia y versiones destiladas en GitHub y Hugging Face. Esta postura de código abierto es extremadamente audaz en el sector actual de la generación de video.

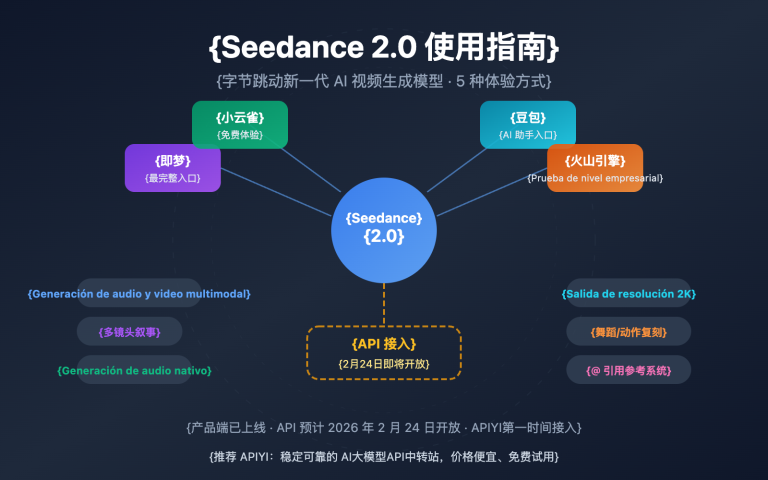

MAGI, el producto estrella de Sand AI: Un nuevo paradigma en la generación de video autorregresiva

Una vez analizado el equipo, pasamos al plato fuerte: la serie MAGI, el producto estrella de Sand AI. Su ruta técnica presenta una diferencia fundamental con respecto a soluciones convencionales como Sora, Kling, Veo o HunyuanVideo: no es un modelo de difusión puro que "genera todo el video de una sola vez", sino que combina la "autorregresión" con la "difusión" para generar el video por bloques (chunks).

Datos clave de MAGI

| Dimensión | MAGI / MAGI-1 / MAGI-1.1 |

|---|---|

| Lanzamiento inicial | 21 de abril de 2025 |

| Versión más reciente | MAGI-1.1 (100% código abierto) |

| Especificaciones de parámetros | 24B (versión completa) + 4.5B (versión ligera) |

| Versiones destiladas | 4.5B Distill + Distill+Quant (lanzadas el 26 de mayo de 2025) |

| Licencia de código abierto | Apache 2.0 |

| Repositorio | github.com/SandAI-org/MAGI-1 / huggingface.co/sand-ai/MAGI-1 |

| Duración de generación de video | Actualmente 1-10 segundos, admite extensión infinita |

| Fotogramas por segmento | 24 fotogramas por chunk, eliminación de ruido conjunta |

| Capacidad de concurrencia | Procesa hasta 4 chunks simultáneamente |

| Tiempo de generación | Generalmente 1-2 minutos para obtener resultados |

| Estilos admitidos | Video realista + estilo 3D semicaricaturizado |

| Capacidad de control | Control de línea de tiempo a nivel de segundo + indicaciones (prompting) por bloque |

| Comprensión física | Liderazgo significativo en la continuación de video en el benchmark Physics-IQ |

| Posicionamiento de rendimiento | SOTA en código abierto, superior a Wan-2.1 / HunyuanVideo, supera a Hailuo (cerrado) |

Autorregresión + Difusión: ¿Por qué es un nuevo paradigma?

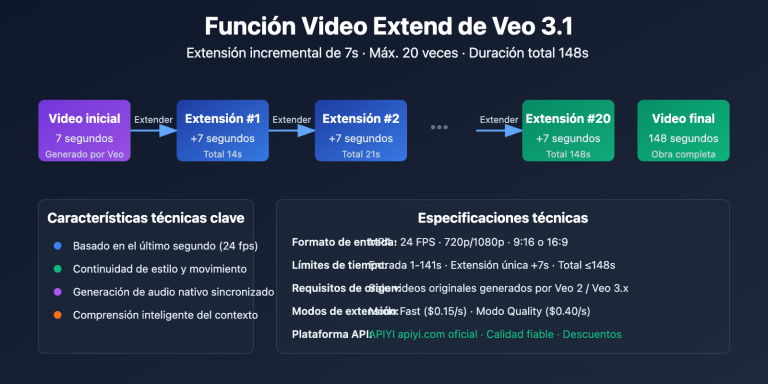

Los modelos de difusión de video convencionales (Sora, Veo, Kling, etc.) suelen tomar todo el video como un tensor para eliminar el ruido de una sola vez. Este método es potente en cuanto a calidad de imagen, pero tiene dos defectos inherentes:

- Difícil de extender infinitamente: la duración del video que el modelo puede generar de una sola vez está limitada por la memoria de video (VRAM) y la latencia durante la inferencia;

- Consistencia física débil: al generar todo el video de una vez, falta la cadena causal de "inferir el siguiente fotograma basándose en el anterior".

La ruta elegida por MAGI consiste en dividir el video en chunks de 24 fotogramas, realizando la eliminación de ruido por difusión dentro de cada chunk, mientras que entre los chunks se sigue una restricción causal autorregresiva. Esto significa que:

- ¿Quieres un video más largo? Simplemente continúa la autorregresión hacia adelante, en teoría no hay límite; esta es la razón por la que el sitio web de sand.ai enfatiza las "capacidades de extensión de video infinito".

- ¿Quieres una física más realista? Cada fotograma se basa en los fotogramas generados anteriormente, lo que le otorga una ventaja estructural en benchmarks de predicción física como Physics-IQ.

- ¿Quieres un control más preciso? Puedes proporcionar una indicación (prompt) separada para cada chunk, creando un efecto de "dirección por segmentos".

Este diseño ha demostrado un rendimiento sobresaliente en las pruebas internas de Sand AI: superó a competidores fuertes como Wan-2.1 y HunyuanVideo entre los modelos de código abierto, y también superó a Hailuo en comparaciones con modelos cerrados, siendo "significativamente superior a todos los modelos existentes" en el benchmark Physics-IQ.

Innovaciones de ingeniería en la arquitectura de MAGI

Para que la ruta de autorregresión + difusión sea realmente funcional, Sand AI incorporó una serie de modificaciones arquitectónicas en MAGI:

| Módulo | Función |

|---|---|

| Block-Causal Attention | Permite conexiones causales entre chunks, evitando la fuga de información futura |

| Parallel Attention Block | Mejora la eficiencia del paralelismo dentro de un solo chunk |

| QK-Norm + GQA | Estabiliza el entrenamiento + reduce la carga de KV Cache |

| Sandwich Normalization in FFN | Estabiliza aún más el entrenamiento de modelos grandes |

| SwiGLU | Mejora la capacidad de expresión no lineal |

| Softcap Modulation | Controla los valores extremos de la distribución de atención |

| Transformer-based VAE | Velocidad de decodificación más rápida |

Aunque ninguna de estas innovaciones por sí sola se considera un "avance revolucionario", al combinarlas, MAGI-1 logra poseer cuatro capacidades que a menudo son difíciles de equilibrar simultáneamente: video largo, física sólida, controlabilidad y escalabilidad.

🎯 Sugerencia de selección de arquitectura: Si tu proyecto requiere "continuación de video largo" o "controlabilidad a nivel de planos", el paradigma de autorregresión + difusión de MAGI merece ser considerado. Antes de que ofrezca una API comercial oficial, puedes utilizar modelos ya comercializados como Sora 2, Veo 3.1 o Kling 3.0 en APIYI (apiyi.com) para completar el prototipo de tu producto, y migrar sin problemas una vez que la API comercial de MAGI esté madura.

Cómo entrega Sand AI el modelo MAGI a los desarrolladores

No basta con tener un modelo potente; Sand AI ha diseñado su ruta de entrega de forma muy técnica. Desde usuarios comunes hasta desarrolladores e investigadores, sand.ai ofrece tres puntos de entrada distintos.

Tres formas de utilizar MAGI

| Entrada | Dirección | Público objetivo |

|---|---|---|

| Aplicación Web | magi.sand.ai/app/projects |

Creadores de contenido / usuarios comunes, para generar imágenes directamente en el navegador |

| Plataforma API | platform.sand.ai/docs |

Desarrolladores que desean integrar MAGI en sus propios productos |

| Repositorio de código abierto | github.com/SandAI-org/MAGI-1 + huggingface.co/sand-ai/MAGI-1 |

Investigadores / equipos de autodespliegue que necesitan ejecutar los pesos localmente |

Estas tres vías cubren todo el espectro de necesidades, desde la "generación sin código hasta la integración de ingeniería y la autogestión completa". En comparación con aquellos equipos que "solo publican artículos sin pesos" o "solo ofrecen una demo sin código abierto", el enfoque de Sand AI es mucho más exhaustivo.

El significado técnico de las versiones 24B y 4.5B

El hecho de que MAGI-1 ofrezca especificaciones de 24B y 4.5B parámetros demuestra que Sand AI busca satisfacer a dos tipos de usuarios:

- Versión completa de 24B: Orientada a investigadores y empresas con abundantes recursos de GPU que buscan la máxima calidad de imagen.

- Versión destilada de 4.5B: Orientada a equipos de despliegue de ingeniería que buscan un equilibrio entre coste y latencia. En mayo, se añadió la versión Distill+Quant, que comprime aún más el uso de memoria de video (VRAM).

Este ritmo de lanzamiento de "modelo dual (alto y bajo rendimiento) + destilación continua" es prácticamente la estrategia más madura para los Modelos de Lenguaje Grande de código abierto en 2025-2026. En este aspecto, Sand AI se mantiene a la par de grandes referentes del código abierto como Mistral y Qwen.

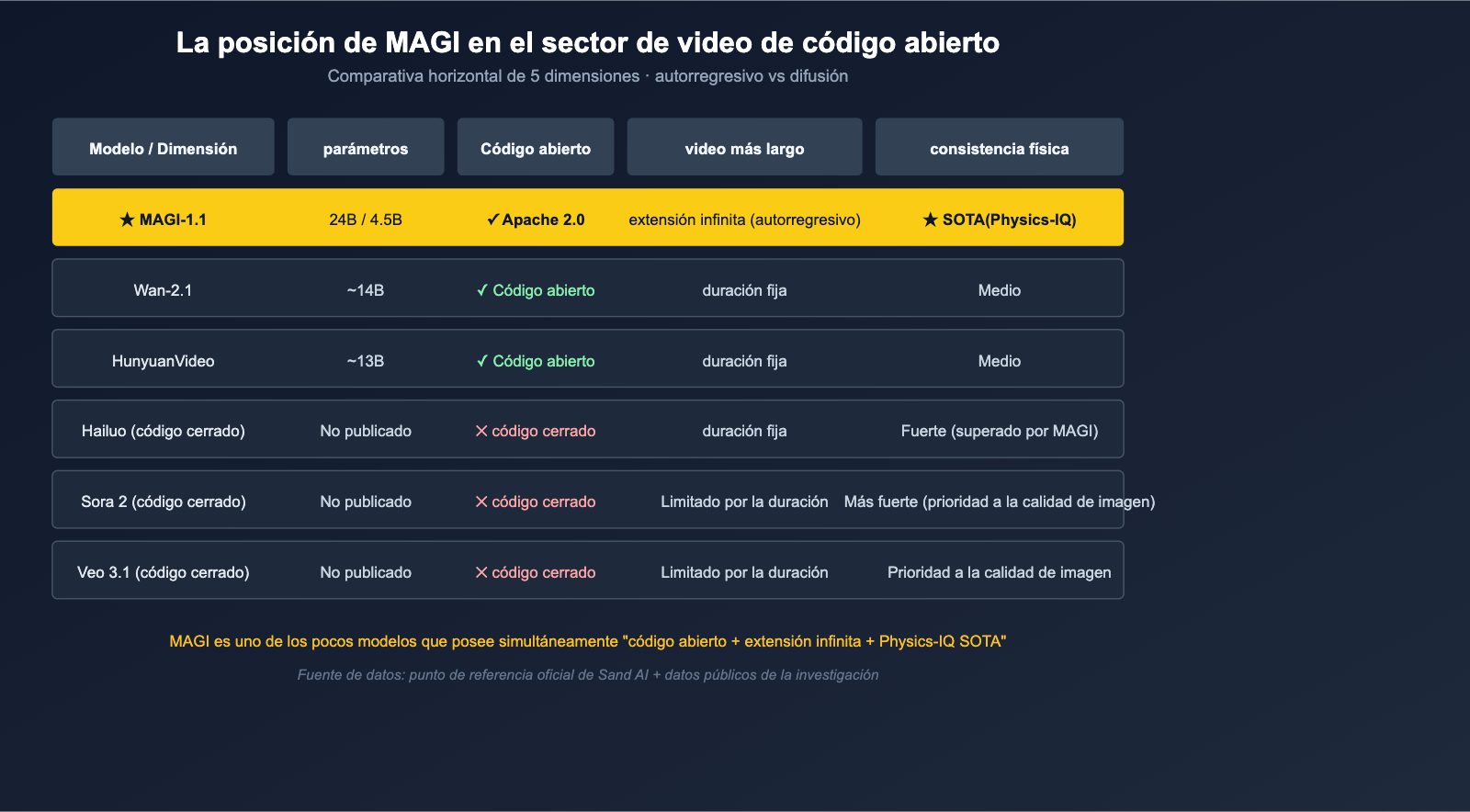

La posición y las lecciones de Sand AI en el sector de la generación de video

Al conectar los antecedentes, el producto y la ruta de entrega, la posición de Sand AI en el sector de la generación de video en 2026 queda bastante clara.

Por qué merece la pena prestarle atención

| Perspectiva | Valor diferencial de Sand AI |

|---|---|

| Profundidad académica | ADN del equipo de Swin Transformer, con innovación continua en la arquitectura de red |

| Elección de ruta | La combinación de autorregresivo + difusión es un tercer camino poco transitado, no una simple réplica de Sora |

| Nivel de apertura | Apache 2.0 + pesos + código + versiones destiladas, todo público |

| Formato de producto | Tres entradas completas: Web, API y autogestión |

| Comprensión física | El estándar Physics-IQ es significativamente superior, ideal para contenido educativo, científico y de divulgación |

| Video largo | La ruta autorregresiva permite de forma natural una extensión infinita |

Tres lecciones para la industria

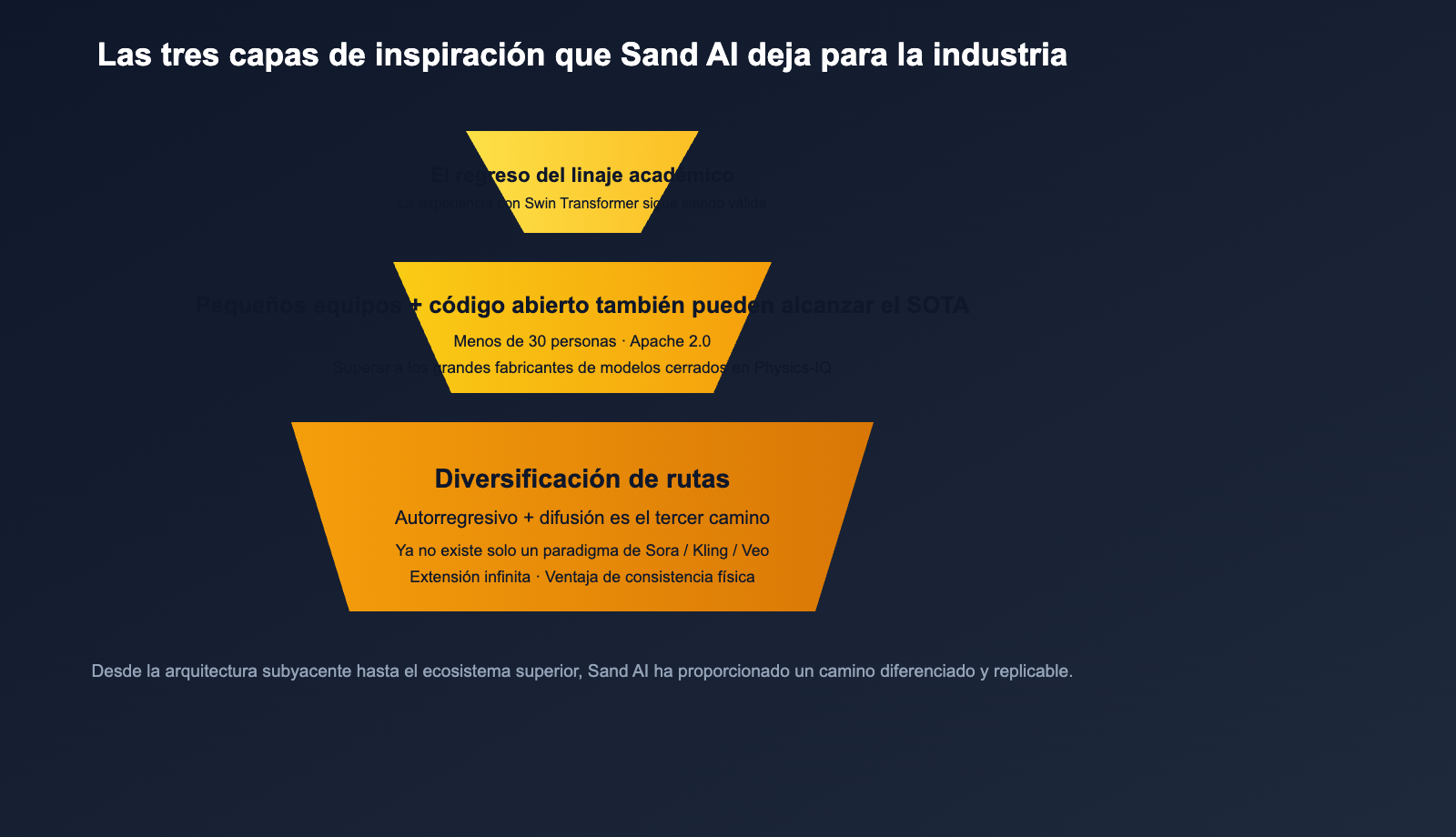

El rápido ascenso de Sand AI deja al menos tres lecciones para todo el sector de la generación de video:

- Diversificación de rutas: Además de Sora, Veo o Kling, el camino de "autorregresivo + difusión" es viable y tiene ventajas estructurales en la consistencia física.

- Los equipos pequeños y el código abierto también pueden alcanzar el SOTA: Con menos de 30 personas y bajo licencia Apache 2.0, es posible superar a muchos grandes fabricantes de modelos cerrados en Physics-IQ.

- El retorno del linaje académico: La experiencia de entrenamiento en "modelos visuales clásicos" como Swin Transformer sigue teniendo un valor de continuidad muy fuerte en la era de la generación de video.

Estos tres puntos son una referencia directa para los equipos que quieran entrar en la generación de video en 2026: no necesitas 1000 tarjetas H100 para crear un modelo decente, pero sí necesitas una cultura de ingeniería que "entienda la arquitectura, se atreva a abrir el código y se esfuerce en la consistencia física".

🎯 Sugerencia de integración de ecosistema: Para los equipos que deseen incorporar modelos de video "abiertos y cerrados" en sus productos, recomendamos gestionar Sora 2, Veo 3.1, Kling 3.0 y MAGI-1 bajo una interfaz unificada. Mientras la API comercial de MAGI no se abra a gran escala, se puede utilizar APIYI (apiyi.com) para integrar modelos de video ya comercializados y validar el flujo de negocio, mientras se espera a que platform.sand.ai de Sand AI se abra aún más.

¿Para quién es Sand AI y para quién no?

Volvamos a una pregunta muy práctica: ¿Deberías usar MAGI de Sand AI ahora mismo? La respuesta depende de tus necesidades específicas en cuanto a la generación de vídeo.

¿Para quién es ideal?

| Perfil | Razón |

|---|---|

| Investigadores / Autores de artículos | Código abierto completo + nuevo paradigma autorregresivo, ideal para trabajo académico. |

| Equipos de autohospedaje / despliegue privado | Licencia Apache 2.0 + versión destilada de 4.5B, permite ejecutar pesos localmente. |

| Divulgadores científicos / Creadores educativos | Liderazgo en Physics-IQ, excelente consistencia física. |

| Necesidad de vídeos de larga duración | La ruta autorregresiva permite de forma natural una extensión infinita. |

| Productos de "generación controlable a nivel de plano" | Soporta línea de tiempo por segundos + indicación por fragmentos (chunk-wise). |

| Ecosistema de contenido IA en chino | Equipo con sede en Pekín, excelente soporte para indicaciones en chino. |

¿Para quién no es tan recomendable?

| Perfil | Razón |

|---|---|

| Usuarios sin conocimientos de código que solo quieren "resultados rápidos" | La experiencia de usuario (UX) de productos maduros como Sora 2 o Kling sigue siendo más ligera. |

| Equipos pequeños que no desean realizar despliegue propio | La API comercial platform.sand.ai aún está en proceso de mejora constante. |

| Necesidad de calidad 4K + larga duración + audio (nivel cinematográfico) | Su enfoque actual sigue siendo más hacia la investigación/creatividad que hacia la postproducción cinematográfica. |

| Usuarios de nivel de aplicación que no se preocupan por la "licencia de pesos" | Es más sencillo usar directamente una API de código cerrado. |

🎯 Consejo de prueba: Si tu objetivo es "ver resultados de inmediato", te sugerimos visitar magi.sand.ai para probar la aplicación web sin necesidad de iniciar sesión o con un registro rápido. Si deseas comparar las diferencias reales entre Sand AI y otros modelos de vídeo, puedes usar el servicio proxy de API APIYI (apiyi.com) para invocar Sora 2, Veo 3.1 o Kling 3.0, usando el mismo conjunto de indicaciones para comparar resultados y determinar si la ruta autorregresiva de MAGI realmente se adapta mejor a tu negocio.

Preguntas frecuentes sobre Sand AI

P1: ¿Qué es Sand AI? ¿Es del mismo tipo que Stability AI o Midjourney?

Sand AI es una startup de IA fundada en Pekín, China, por Cao Yue, autor principal de Swin Transformer, con un equipo central de menos de 30 personas. A diferencia de Stability AI (enfocada en imágenes) o Midjourney (modelo de suscripción cerrado), Sand AI se centra en la generación de vídeo y ha optado por una ruta de código abierto completo (Apache 2.0). Su producto estrella son los modelos de generación de vídeo autorregresivos MAGI-1 / MAGI-1.1.

P2: ¿Cuál es la diferencia fundamental entre MAGI-1 y Sora, Kling o Veo?

La mayor diferencia radica en la ruta técnica: mientras que modelos principales como Sora, Veo o Kling generan el vídeo completo de una sola vez, MAGI divide el vídeo en fragmentos (chunks) de 24 fotogramas; dentro de cada fragmento se realiza la eliminación de ruido por difusión, y entre fragmentos se utiliza una conexión causal autorregresiva. Este paradigma otorga a MAGI una ventaja estructural en cuanto a la "extensión infinita de vídeo" y la "consistencia física". De hecho, la propia Sand.ai ha mostrado resultados significativamente superiores en el benchmark Physics-IQ.

P3: ¿Es MAGI-1 realmente de código abierto? ¿Se puede usar comercialmente?

Sí. MAGI-1 y MAGI-1.1 se distribuyen bajo la licencia Apache 2.0 en GitHub (SandAI-org/MAGI-1) y Hugging Face (sand-ai/MAGI-1), incluyendo código, pesos y herramientas de inferencia. Apache 2.0 es una licencia muy amigable que permite el uso comercial, la modificación y la creación de derivados de código cerrado, siempre que se mantenga el aviso de copyright. Esto significa que puedes integrar MAGI-1 en tus propios productos o realizar un entrenamiento adicional basado en él.

P4: ¿Qué hardware necesito para ejecutar MAGI-1 localmente?

La versión completa de MAGI-1 tiene 24B de parámetros, por lo que la inferencia local requiere GPUs profesionales con múltiples tarjetas. Si tu presupuesto de hardware es limitado, te recomendamos usar la versión destilada de 4.5B o la versión destilada + cuantizada lanzada por Sand AI en mayo de 2025; los requisitos de VRAM disminuyen significativamente, permitiendo su ejecución en una sola GPU de consumo de gama alta. Si solo quieres "ver los resultados", te sugerimos usar la aplicación web en magi.sand.ai sin necesidad de configuración local.

P5: ¿Tiene Sand AI una API comercial? ¿Cómo se compara con Sora o Kling?

La plataforma de API comercial de Sand AI, platform.sand.ai, ya está disponible, pero su madurez en el ecosistema aún está alcanzando a modelos ya comercializados como Sora o Kling. Si estás desarrollando un producto de generación de vídeo que requiere "disponibilidad inmediata, cuotas suficientes y soporte para indicaciones en chino", te sugerimos utilizar primero una plataforma de transferencia unificada como APIYI (apiyi.com) para invocar modelos ya comercializados como Sora 2, Veo 3.1 o Kling 3.0 para validar tu negocio, mientras sigues de cerca el ritmo de apertura de la API de Sand AI para realizar una sustitución o integración paralela en el momento adecuado.

P6: ¿Vale la pena seguir a Sand AI?

Definitivamente. Por dos razones: primero, el linaje académico del equipo de Swin Transformer sugiere que las futuras iteraciones de MAGI probablemente seguirán innovando a nivel de arquitectura, en lugar de simplemente acumular datos; segundo, Sand AI ha elegido una ruta diferenciada de "autorregresión + difusión + código abierto completo". Si esta estrategia tiene éxito, influirá en la elección de paradigmas para todo el sector de generación de vídeo de código abierto en 2026-2027. Tanto si eres investigador, desarrollador de productos o creador de contenido, te recomendamos añadir a sand.ai a tu lista de seguimiento constante.

Resumen: ¿Cuál es la respuesta definitiva sobre Sand AI?

Volviendo a la pregunta inicial: "¿Qué es Sand AI?", ahora podemos ofrecer una respuesta bastante completa: Sand AI es una startup de IA con un equipo de menos de 30 personas, fundada en Pekín por Cao Yue, autor principal del Swin Transformer. Su producto estrella es el modelo de generación de video autorregresivo de código abierto MAGI-1 / MAGI-1.1, que ha logrado resultados superiores a la mayoría de los modelos de código abierto y a algunos cerrados en benchmarks de consistencia física como Physics-IQ, además de publicar todo el conjunto de pesos y código bajo la licencia Apache 2.0 en GitHub y Hugging Face. Es un "caballo negro" en la generación de video con un "ADN académico sólido, una ruta técnica innovadora y un compromiso total con el código abierto".

Para desarrolladores e investigadores, el verdadero significado de Sand AI no es que "haya aparecido un modelo de video más", sino que proporciona una ruta diferenciada y replicable para todo el sector de la generación de video: sin depender de una potencia de cómputo masiva, sin encerrarse en ecosistemas cerrados y sin bombardeos de marketing, sino basándose en fundamentos académicos, innovación arquitectónica y código abierto completo. Si el sector de la generación de video antes de 2025 estaba dominado casi exclusivamente por Sora, la aparición de Sand AI abre la posibilidad de que, en 2026, el ecosistema de video de código abierto demuestre que "los equipos pequeños también pueden alcanzar el SOTA".

🎯 Recomendación final: Si quieres seguir de cerca los avances de Sand AI y MAGI, te sugerimos hacer tres cosas: 1) Sigue las actualizaciones de sand.ai y de la organización

sand-aien Hugging Face; 2) Prueba tus necesidades reales en la aplicación web magi.sand.ai para obtener una primera impresión directa; 3) Integra MAGI junto con otros modelos comerciales como Sora 2, Veo 3.1 o Kling 3.0 en una plataforma unificada como APIYI (apiyi.com) para realizar una comparativa horizontal y determinar su valor real para tu negocio basándote en tus propios criterios. Una vez completado este proceso, la respuesta sobre si Sand AI merece ser incluida en tu stack de herramientas de generación de video surgirá de forma natural.

Autor: Equipo APIYI | Enfocados en la implementación de Modelos de Lenguaje Grande y el ecosistema de código abierto. Para más evaluaciones de modelos de video y multimodales, visita APIYI en apiyi.com.