Recientemente, varios desarrolladores han encontrado el siguiente mensaje de error al invocar la API de Gemini:

{

"error": {

"code": 503,

"message": "This model is currently experiencing high demand. Spikes in demand are usually temporary. Please try again later.",

"status": "UNAVAILABLE"

}

}

En español sencillo, significa: este modelo es tan popular ahora que los servidores no pueden soportarlo, por favor, inténtalo de nuevo más tarde.

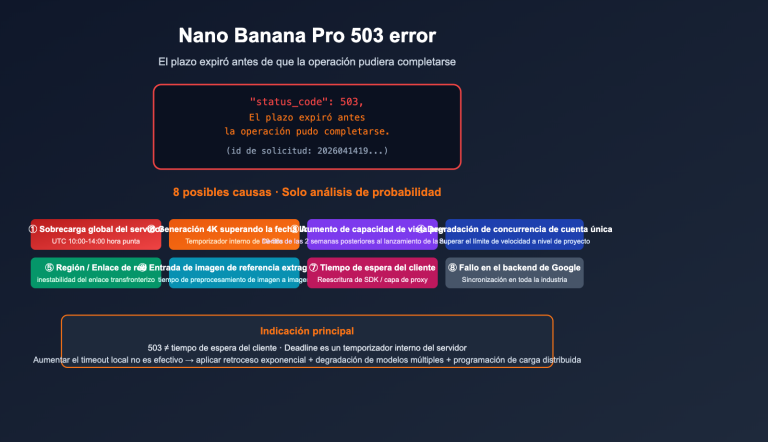

Este problema es especialmente grave en los nuevos modelos Gemini 3.1 Pro Preview y Gemini 3.1 Flash Image Preview (Nano Banana 2). Este artículo explicará a fondo la naturaleza de este error, sus diferencias con otros errores comunes y 5 soluciones probadas y efectivas.

Valor clave: Al leer este artículo, comprenderás con precisión la causa raíz del error 503 de alta demanda, dominarás 5 soluciones directamente aplicables y ya no te quedarás atascado en el progreso de tu desarrollo debido a este error.

¿Qué significa realmente el error 503 de alta demanda de la API de Gemini?

Para entender este problema, usemos una analogía sencilla:

Imagina que los servidores de Gemini de Google son un restaurante de moda. Normalmente, el negocio va bien y hay suficientes asientos. De repente, un día se vuelve viral (se lanza un nuevo modelo) y gente de toda la ciudad acude a hacer cola. La capacidad del restaurante es limitada; una vez que está lleno, está lleno. En ese momento, cuando llegas a la puerta, el camarero te dirá: "Lo siento, ahora mismo hay demasiada gente, la hora pico suele ser temporal, por favor, vuelva más tarde."

Esa es la esencia de This model is currently experiencing high demand (Este modelo está experimentando una alta demanda en este momento): no es que tu código tenga un problema, ni que tu clave API tenga un problema, es que la capacidad de cómputo de los servidores de Google es insuficiente.

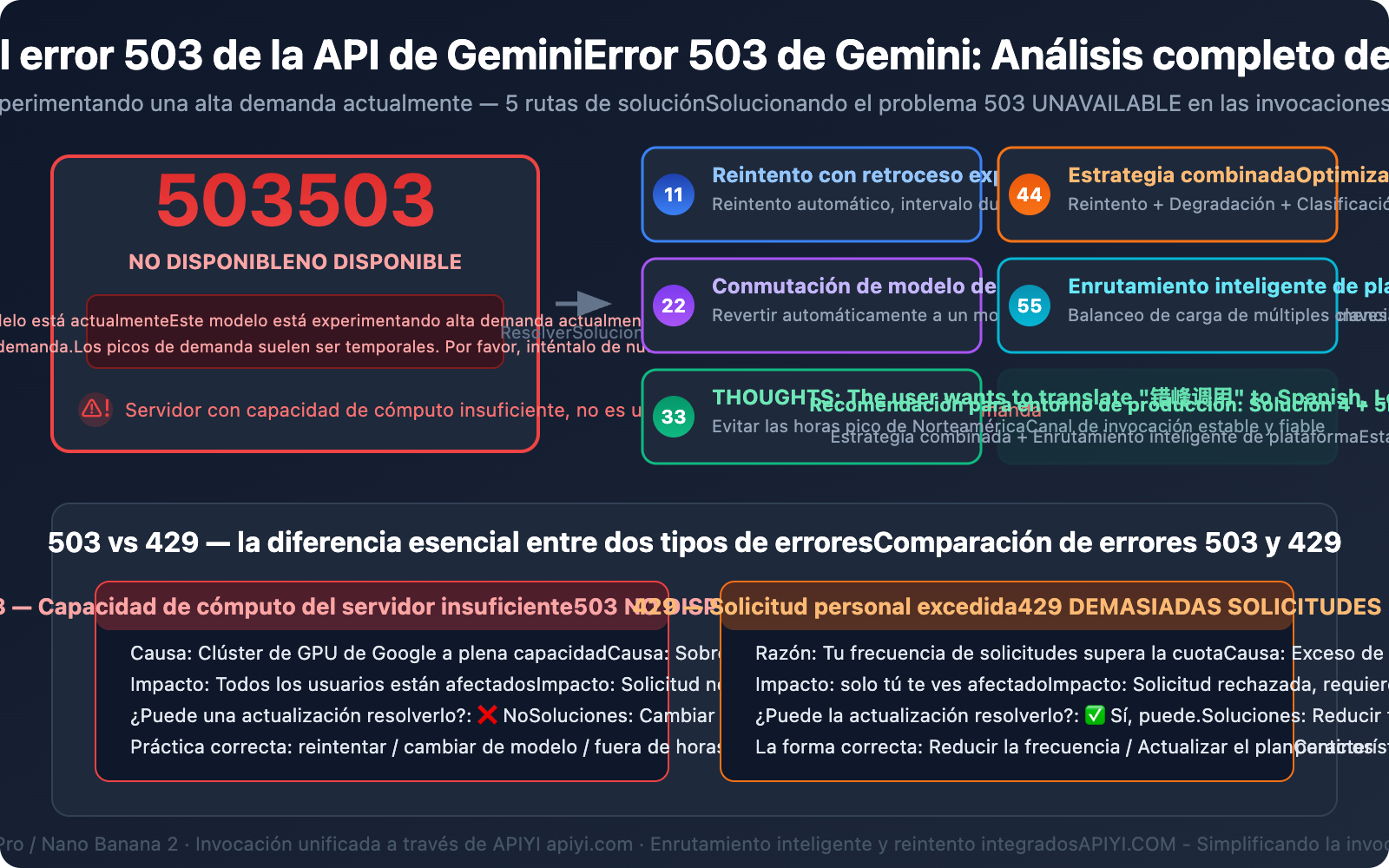

3 hechos clave sobre el error 503 de Gemini

| Hecho | Descripción | Impacto |

|---|---|---|

| Problema del servidor | El 503 indica capacidad insuficiente del servidor de Google, no está relacionado con tu código o configuración | Actualizar a un plan de pago no lo resuelve |

| Afecta a todos los usuarios | Usuarios gratuitos, de pago y clientes empresariales lo experimentan | No es un problema que se "resuelva pagando" |

| Suele ser temporal | Aproximadamente el 70% de los errores 503 durante las horas pico se recuperan solos en 60 minutos | Requiere un mecanismo de reintento, no una corrección de código |

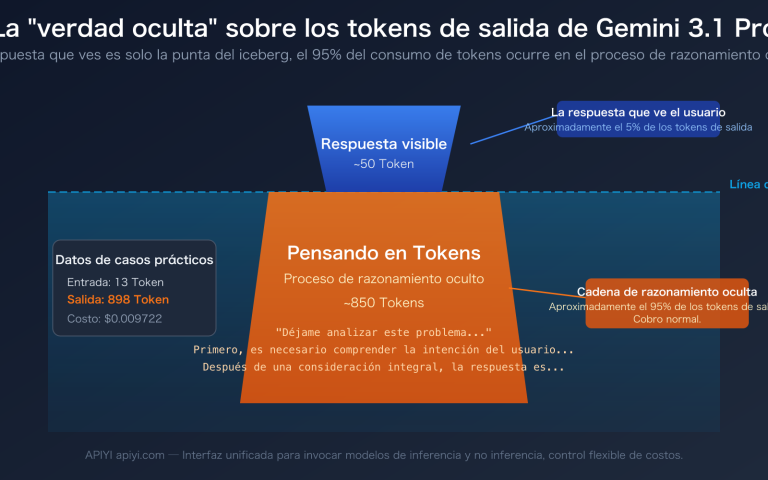

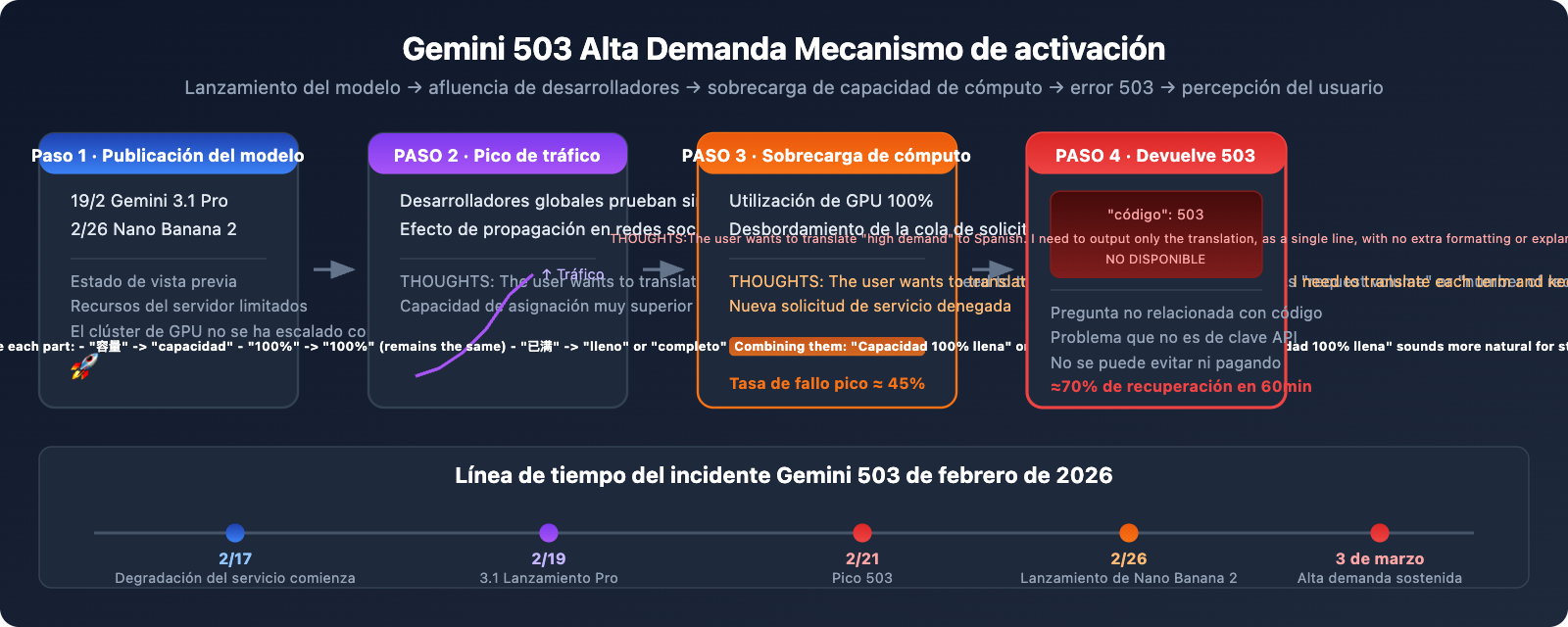

¿Por qué Gemini 3.1 Pro y Nano Banana 2 son particularmente propensos al error 503?

El brote de errores 503 en febrero de 2026 tiene una cronología clara:

- 19 de febrero: Google lanza Gemini 3.1 Pro Preview, y una gran cantidad de desarrolladores acuden a probarlo.

- 26 de febrero: Se lanza Nano Banana 2 (

gemini-3.1-flash-image-preview), lo que provoca un aumento masivo en la demanda de generación de imágenes. - 17-21 de febrero: StatusGator registra advertencias continuas de degradación del servicio de Gemini durante toda una semana.

- Tasa de fallos del 45% en horas pico: Los datos de la comunidad muestran que la tasa de fallos de las solicitudes se acerca a la mitad durante las horas pico.

Causa raíz: Los nuevos modelos acaban de ser lanzados, y la capacidad de cómputo (clústeres de GPU) asignada por Google aún no se ha escalado según la demanda. Los recursos del servidor para modelos en estado Preview son inherentemente limitados, y cuando desarrolladores de todo el mundo se lanzan a probarlos simultáneamente, se produce una situación de oferta y demanda desequilibrada.

Diferencia esencial entre Gemini 503 High Demand y 429 Rate Limit

Muchos desarrolladores confunden 503 y 429, pero las causas de estos dos errores son completamente diferentes, y sus soluciones también lo son. Confundir la dirección solo llevará a un esfuerzo inútil.

| Dimensión de comparación | 503 High Demand | 429 Rate Limit |

|---|---|---|

| Mensaje de error | "This model is currently experiencing high demand" | "Resource has been exhausted" |

| Causa fundamental | Capacidad de cómputo insuficiente del servidor de Google | Tu frecuencia de solicitudes personal ha excedido el límite |

| Alcance del impacto | Todos los usuarios se ven afectados | Solo tú te ves afectado |

| ¿Se resuelve con una actualización? | ❌ Actualizar el plan de pago no lo resuelve | ✅ Actualizar a Tier 1 puede resolverlo |

| ¿Es efectiva la reintentar? | ✅ Esperar un momento suele restaurarlo | ❌ Si no reduces la frecuencia, seguirá dando error |

| Características del período pico | Frecuente durante el horario laboral de Norteamérica (9AM-5PM PT) | Independiente del horario, error al exceder el límite |

| Solución fundamental | Reintentos + modelo de respaldo + evitar horas pico | Reducir la frecuencia de solicitudes o actualizar el plan |

Método de juicio rápido

- Si ves 503 → Es un problema de Google, espera un poco o cambia de modelo

- Si ves 429 → Tus solicitudes son demasiado rápidas, ve más lento o actualiza tu plan

🎯 Consejo técnico: En entornos de producción, manejar simultáneamente los errores 503 y 429 es una habilidad fundamental en la integración de API. Al invocar modelos de la serie Gemini a través de la plataforma APIYI apiyi.com, la plataforma incorpora mecanismos inteligentes de reintento y balanceo de carga, lo que puede reducir significativamente la frecuencia de errores 503 percibida por el usuario final.

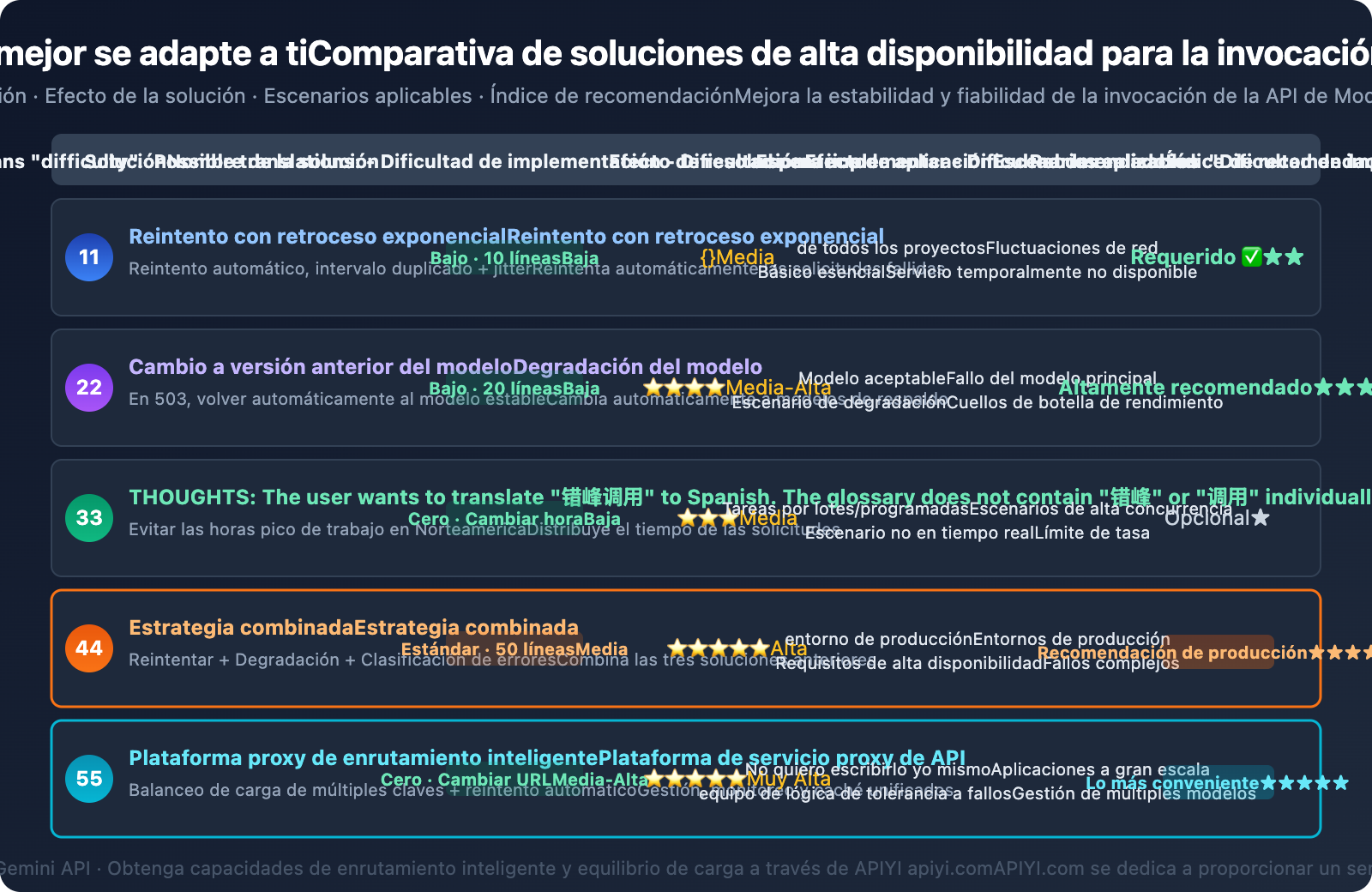

Solución uno: Reintentos con retroceso exponencial (lo más básico)

Dado que 503 significa "vuelve a intentarlo en un momento", la respuesta más directa es el reintento automático. Pero no se puede reintentar sin pensar; es necesario usar una estrategia de "retroceso exponencial", duplicando el intervalo de cada reintento para evitar agravar la presión sobre el servidor.

Código de reintento con retroceso exponencial para Gemini 503

import openai

import time

import random

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Interfaz unificada de APIYI

)

def call_gemini_with_retry(messages, model="gemini-3.1-pro-preview", max_retries=5):

"""Invocación de la API de Gemini con retroceso exponencial"""

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=messages

)

return response

except openai.APIStatusError as e:

if e.status_code == 503:

# Retroceso exponencial: 2s, 4s, 8s, 16s, 32s + fluctuación aleatoria

wait_time = (2 ** attempt) + random.uniform(0, 1)

print(f"⏳ 503 High Demand - Reintento #{attempt+1}, esperando {wait_time:.1f}s...")

time.sleep(wait_time)

elif e.status_code == 429:

# Límite de tasa 429: esperar más tiempo

wait_time = 60 + random.uniform(0, 10)

print(f"🚫 429 Rate Limit - Esperando {wait_time:.1f}s...")

time.sleep(wait_time)

else:

raise # Otros errores se lanzan directamente

raise Exception(f"Falló después de {max_retries} reintentos")

# Ejemplo de uso

response = call_gemini_with_retry(

messages=[{"role": "user", "content": "Hello, Gemini!"}]

)

print(response.choices[0].message.content)

Parámetros clave para el reintento con retroceso exponencial

| Parámetro | Valor recomendado | Descripción |

|---|---|---|

| Número máximo de reintentos | 5 veces | Más de 5 veces suele indicar que no es un problema temporal |

| Espera inicial | 2 segundos | Demasiado corto agravará la presión del servidor |

| Factor de retroceso | 2x | Se duplica cada vez: 2s → 4s → 8s → 16s → 32s |

| Fluctuación aleatoria | 0-1 segundo | Evita que muchos clientes reintenten al mismo tiempo |

| Espera máxima | 32 segundos | Más de 32 segundos debería activar una solución alternativa |

💡 Consejo práctico: La fluctuación aleatoria (jitter) es muy importante. Si todos los clientes reintentan exactamente después de 2 segundos, se producirá un "efecto de estampida" (thundering herd) — todas las solicitudes volverán a inundar el servidor al mismo tiempo, lo que resultará en otra ronda de 503. Añadir una fluctuación aleatoria puede dispersar las solicitudes de reintento.

Solución dos: Degradación del modelo / Cambio automático a modelo de respaldo

Cuando Gemini 3.1 Pro Preview devuelve un 503 de forma persistente, la solución más práctica es cambiar automáticamente a un modelo de respaldo más estable.

Estrategia de degradación del modelo Gemini 503

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# Cadena de degradación del modelo: prioriza el más potente, degrada si falla

FALLBACK_MODELS = [

"gemini-3.1-pro-preview", # Preferido: el más nuevo y potente

"gemini-3.0-pro", # Opción 1: Pro de la generación anterior, más estable

"gemini-2.5-flash-image-preview", # Opción 2: Versión Flash, rápida

"gemini-2.5-flash", # Último recurso: el Flash más estable

]

def call_with_fallback(messages):

"""Invocación de API con degradación del modelo"""

for model in FALLBACK_MODELS:

try:

response = client.chat.completions.create(

model=model,

messages=messages

)

if model != FALLBACK_MODELS[0]:

print(f"⚠️ Degradado al modelo de respaldo: {model}")

return response

except openai.APIStatusError as e:

if e.status_code in (503, 429):

print(f"❌ {model} devolvió {e.status_code}, intentando con el siguiente modelo...")

continue

raise

raise Exception("Todos los modelos no están disponibles")

response = call_with_fallback(

messages=[{"role": "user", "content": "Analiza los cuellos de botella de rendimiento en este código"}]

)

Clasificación de estabilidad de los modelos Gemini

| Modelo | Estabilidad | Frecuencia de 503 | Escenario adecuado |

|---|---|---|---|

gemini-2.5-flash |

⭐⭐⭐⭐⭐ | Muy baja | Último recurso para entornos de producción de alta disponibilidad |

gemini-3.0-pro |

⭐⭐⭐⭐ | Baja | Escenarios estables que requieren capacidades Pro |

gemini-2.5-flash-image-preview |

⭐⭐⭐ | Media | Alternativa para generación de imágenes |

gemini-3.1-pro-preview |

⭐⭐ | Alta | Requiere las últimas capacidades, pero acepta fallos ocasionales |

gemini-3.1-flash-image-preview |

⭐⭐ | Alta | Generación de imágenes Nano Banana 2 |

🚀 Inicio rápido: A través de la plataforma APIYI apiyi.com, puedes invocar todos los modelos de la tabla anterior con una sola clave API. El cambio de modelo solo requiere modificar el parámetro

model, sin necesidad de reconfigurar la autenticación. Implementar una cadena de degradación de modelos en el código es muy conveniente.

Solución tres: Invocación en horas valle (solución de costo cero)

La alta demanda que provoca errores 503 tiene patrones horarios claros. Los datos de la comunidad muestran:

- Pico (9AM-5PM PT): Tasa de fallo de aproximadamente 45%

- Valle (2AM-7AM PT): Tasa de fallo inferior al 5%

Convertido a hora de Beijing:

| Franja horaria (hora de Beijing) | Hora del Pacífico equivalente | Frecuencia de Gemini 503 | Recomendación |

|---|---|---|---|

| 1:00 AM – 10:00 AM | 9AM-6PM PT (día anterior) | 🔴 Pico | Evitar o usar modelo de respaldo |

| 10:00 AM – 3:00 PM | 6PM-11PM PT (día anterior) | 🟡 Media | Invocar con mecanismo de reintento |

| 3:00 PM – 11:00 PM | 11PM-7AM PT | 🟢 Valle | Mejor ventana de invocación |

| 11:00 PM – 1:00 AM | 7AM-9AM PT | 🟡 Media | Comienza a aumentar |

Escenarios adecuados para la invocación en horas valle

- Procesamiento de datos por lotes: Tareas que no requieren respuesta en tiempo real, programarlas para las horas valle.

- Tareas programadas: Configurar trabajos cron para que se ejecuten en las horas valle.

- Generación de contenido: Escenarios donde artículos, imágenes, etc., pueden generarse con antelación y publicarse con retraso.

Solución cuatro: Estrategia combinada (recomendada para entornos de producción)

En entornos de producción reales, una única solución a menudo no es suficiente. Se recomienda combinar las 3 soluciones anteriores:

Esquema de invocación de la API de Gemini de nivel de producción

import openai

import time

import random

from datetime import datetime

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

FALLBACK_MODELS = [

"gemini-3.1-pro-preview",

"gemini-3.0-pro",

"gemini-2.5-flash",

]

def smart_gemini_call(messages, max_retries=3):

"""

Invocación de la API de Gemini de nivel de producción

Estrategia: reintento con retroceso exponencial + degradación del modelo + clasificación de errores

"""

for model in FALLBACK_MODELS:

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=messages,

timeout=30

)

return response, model

except openai.APIStatusError as e:

if e.status_code == 503:

if attempt < max_retries - 1:

wait = (2 ** attempt) + random.uniform(0, 1)

print(f"⏳ {model} 503 - Reintento {attempt+1}/{max_retries}, esperando {wait:.1f}s")

time.sleep(wait)

else:

print(f"⚠️ {model} 503 persistente, degradando al siguiente modelo")

break # Salir del reintento, cambiar de modelo

elif e.status_code == 429:

wait = 60

print(f"🚫 {model} 429 Límite de tasa - Esperando {wait}s")

time.sleep(wait)

else:

raise

except openai.APITimeoutError:

print(f"⏰ {model} Solicitud agotada, intentando con el siguiente modelo")

break

raise Exception("Todos los modelos y reintentos fallaron, por favor, verifica la red o inténtalo de nuevo más tarde")

# Uso

response, used_model = smart_gemini_call(

messages=[{"role": "user", "content": "Hola"}]

)

print(f"✅ Modelo usado: {used_model}")

print(response.choices[0].message.content)

Ver la encapsulación completa de nivel de producción (incluye registro, monitoreo, caché)

import openai

import time

import random

import hashlib

import json

import logging

from datetime import datetime

from functools import lru_cache

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger("gemini_client")

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# Caché simple de solicitudes

_cache = {}

def get_cache_key(messages, model):

"""Genera la clave de caché para la solicitud"""

content = json.dumps(messages, sort_keys=True) + model

return hashlib.md5(content.encode()).hexdigest()

def gemini_call_production(

messages,

models=None,

max_retries=3,

cache_ttl=3600,

enable_cache=True

):

"""

Encapsulación de la invocación de la API de Gemini de nivel de producción

Características:

- Reintento con retroceso exponencial (maneja 503)

- Degradación automática del modelo

- Caché de respuestas (reduce solicitudes duplicadas)

- Registro estructurado

"""

if models is None:

models = ["gemini-3.1-pro-preview", "gemini-3.0-pro", "gemini-2.5-flash"]

# Comprobar caché

if enable_cache:

cache_key = get_cache_key(messages, models[0])

if cache_key in _cache:

cached_time, cached_response = _cache[cache_key]

if time.time() - cached_time < cache_ttl:

logger.info("Caché acertado, omitiendo la invocación de la API")

return cached_response, "cache"

errors = []

for model in models:

for attempt in range(max_retries):

try:

start_time = time.time()

response = client.chat.completions.create(

model=model,

messages=messages,

timeout=30

)

elapsed = time.time() - start_time

logger.info(f"Éxito | model={model} | Tiempo={elapsed:.2f}s")

# Escribir en caché

if enable_cache:

_cache[cache_key] = (time.time(), response)

return response, model

except openai.APIStatusError as e:

errors.append(f"{model}:{e.status_code}")

if e.status_code == 503:

if attempt < max_retries - 1:

wait = (2 ** attempt) + random.uniform(0, 1)

logger.warning(f"503 | model={model} | reintento={attempt+1} | espera={wait:.1f}s")

time.sleep(wait)

else:

logger.warning(f"503 persistente | model={model} | degradando al siguiente modelo")

break

elif e.status_code == 429:

logger.warning(f"429 Límite de tasa | model={model}")

time.sleep(60)

else:

raise

except Exception as e:

logger.error(f"Excepción | model={model} | error={e}")

break

raise Exception(f"Todos fallaron: {errors}")

Solución cinco: Usar el enrutamiento inteligente de una plataforma proxy

Cuando no quieres implementar tú mismo la compleja lógica de reintentos y degradación que mencionamos, hay una opción más sencilla: usar una plataforma de servicio proxy de API con capacidades de enrutamiento inteligente.

Cómo una plataforma proxy resuelve el problema Gemini 503

Una plataforma de servicio proxy de API profesional suele ofrecer:

- Rotación de múltiples claves: La plataforma gestiona varias claves API de Google y cambia automáticamente cuando una clave individual alcanza su límite de tasa.

- Reintentos inteligentes: La plataforma implementa reintentos con retroceso exponencial de forma transparente para el desarrollador.

- Balanceo de carga: Distribuye las solicitudes entre múltiples cuentas y regiones de Google.

- Detección de fallos: Cuando detecta que la frecuencia de errores 503 de un Modelo de Lenguaje Grande aumenta, reduce automáticamente la proporción de solicitudes asignadas a ese modelo.

🎯 Consejo técnico: La plataforma APIYI (apiyi.com) ofrece las capacidades de enrutamiento inteligente mencionadas para los modelos de la serie Gemini. Al usar la interfaz compatible con OpenAI para la invocación del modelo, la plataforma gestiona automáticamente los reintentos de 503 y el balanceo de carga de múltiples claves en el backend, liberando a los desarrolladores de implementar lógicas de tolerancia a fallos complejas.

Ejemplo de código minimalista para la solución con plataforma proxy

import openai

# Usando la plataforma proxy APIYI, la plataforma se encarga del manejo de errores 503

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# Así de simple, no necesitas manejar los 503 tú mismo

response = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "你好"}]

)

print(response.choices[0].message.content)

Proceso completo de resolución de errores de la API de Gemini

Cuando encuentres errores en la API de Gemini, sigue este proceso para identificar rápidamente el problema:

Primer paso: Revisa el código de error

| Código de error | Mensaje de error | Tipo | Acción inmediata |

|---|---|---|---|

| 503 | "high demand" / "overloaded" | Capacidad insuficiente del servidor | Esperar y reintentar o cambiar de modelo |

| 429 | "resource exhausted" | Límite de tasa personal | Reduce la frecuencia de las solicitudes o actualiza tu plan |

| 400 | "invalid request" | Parámetros de solicitud incorrectos | Verifica el formato y los parámetros de la solicitud |

| 401 | "unauthorized" | Fallo de autenticación | Revisa tu clave API |

| 500 | "internal error" | Error interno del servidor | Esperar y reintentar |

Segundo paso: Distingue entre 503 y 429

- Si varias claves API fallan → 503, es un problema del servidor de Google.

- Si solo tu clave falla → 429, es un problema de tu límite personal.

Tercer paso: Elige la solución correspondiente

- 503: Reintentos con retroceso exponencial → Degradación del modelo → Invocación en horas de menor demanda

- 429: Reduce la frecuencia de las solicitudes → Habilita la facturación para actualizar a Tier 1 (la capa gratuita es de 5-15 RPM, Tier 1 es de 150-300 RPM)

Preguntas Frecuentes

P1: ¿Por qué sigo encontrando el error 503 High Demand aunque haya pagado?

El error 503 no tiene absolutamente nada que ver con si has pagado o no. El 503 es un problema de capacidad insuficiente en los servidores de Google, y lo experimentarás seas un usuario gratuito o un cliente empresarial. Esto es diferente del límite de tasa 429: el 429 sí se puede resolver actualizando tu plan, pero el 503 no. Si te encuentras con un 503, se recomienda usar reintentos con retroceso exponencial o cambiar a una versión de Modelo de Lenguaje Grande más estable. Al invocar el modelo a través de la plataforma APIYI (apiyi.com), puedes aprovechar el balanceo de carga con múltiples claves para reducir la frecuencia percibida del 503.

P2: ¿Cuándo se resolverá el error 503 de Gemini 3.1 Pro Preview?

Según la experiencia histórica, el pico de errores 503 después del lanzamiento de un nuevo Modelo de Lenguaje Grande suele durar de 1 a 3 semanas, y mejora significativamente a medida que Google aumenta gradualmente su capacidad. Gemini 3.0 Pro también experimentó una oleada similar de 503 cuando se lanzó, y ahora es muy estable. Mientras esperas, se recomienda implementar una estrategia de degradación del modelo, para que en caso de un 503, se retroceda automáticamente a gemini-3.0-pro o gemini-2.5-flash.

P3: ¿Son «high demand» y «model is overloaded» el mismo error?

Esencialmente, son diferentes formas de expresar el mismo problema. Tanto "This model is currently experiencing high demand" como "The model is overloaded" son códigos de estado 503 y ambos indican que la capacidad de los servidores de Google es insuficiente. El primero es más común en las versiones más recientes de la API, mientras que el segundo aparecía más en las versiones anteriores. La forma de manejarlos es idéntica.

P4: ¿Hay alguna forma de saber de antemano si la API de Gemini dará un 503?

No hay una advertencia oficial anticipada. Sin embargo, puedes prestar atención a varias señales: (1) Las 1-2 semanas posteriores al lanzamiento de un nuevo Modelo de Lenguaje Grande por parte de Google son un período de alto riesgo; (2) La frecuencia del 503 es mayor durante el horario laboral de Norteamérica (desde la madrugada hasta la mañana, hora de Pekín); (3) Los foros de la comunidad discuss.ai.google.dev suelen tener comentarios en tiempo real. Se recomienda mantener siempre la lógica de reintentos y degradación en tu código, en lugar de añadirla solo cuando surja un problema. La plataforma APIYI (apiyi.com) ofrece monitoreo del estado de disponibilidad del modelo, lo que puede ayudarte a anticipar estos problemas.

P5: ¿Debería manejar los errores 503 y 429 simultáneamente en mi código?

Absolutamente. En un entorno de producción, te encontrarás tanto con 503 como con 429. Las estrategias de manejo son diferentes, pero igualmente importantes. Para el 503, usa reintentos con retroceso exponencial + degradación del modelo; para el 429, usa la reducción de la frecuencia de solicitudes + cola de limitación de tasa. El código de la "Estrategia Cuatro: Estrategia Combinada" de este artículo maneja ambos errores simultáneamente y puede usarse directamente en un entorno de producción.

Resumen

La esencia del error 503 This model is currently experiencing high demand es muy simple: la capacidad de los servidores de Google es temporalmente insuficiente. Especialmente con Modelos de Lenguaje Grande nuevos como Gemini 3.1 Pro Preview y Nano Banana 2, es casi inevitable encontrarse con este problema en la fase de lanzamiento inicial.

5 soluciones según la prioridad recomendada:

- Reintentos con retroceso exponencial — Lo más básico, todo proyecto debería incluirlo.

- Cadena de degradación del modelo — Cambia automáticamente a un Modelo de Lenguaje Grande más estable en caso de un 503.

- Invocación del modelo en horas valle — Programa tareas no en tiempo real para períodos de baja demanda.

- Estrategia combinada — Recomendada para entornos de producción: reintentos + degradación + clasificación de errores.

- Enrutamiento inteligente de la plataforma de servicio proxy de API — La opción más sencilla, la plataforma se encarga de la lógica de tolerancia a fallos.

Independientemente de la solución que elijas, el principio fundamental es: el 503 no es tu culpa, pero necesitas manejarlo con elegancia. Se recomienda integrar rápidamente los modelos de la serie Gemini a través de APIYI (apiyi.com) para disfrutar de su enrutamiento inteligente y capacidades de reintento integradas.

Recursos

-

Foro de Desarrolladores de Google AI – Discusiones sobre el error 503

- Enlace:

discuss.ai.google.dev - Descripción: Discusiones de la comunidad y respuestas oficiales sobre el error 503 de la API de Gemini.

- Enlace:

-

API de Google Gemini – Documentación de Límites de Tasa

- Enlace:

ai.google.dev/gemini-api/docs/rate-limits - Descripción: Reglas oficiales de limitación de tasa y descripción de las cuotas por Tier.

- Enlace:

-

API de Google Gemini – Guía de Solución de Problemas

- Enlace:

ai.google.dev/gemini-api/docs/troubleshooting - Descripción: Guía oficial para la resolución de errores.

- Enlace:

📝 Autor: Equipo de APIYI | Para consultas técnicas y acceso a la API, visita apiyi.com