最近不少開發者在調用 Gemini API 時遇到了這樣一段報錯信息:

{

"error": {

"code": 503,

"message": "This model is currently experiencing high demand. Spikes in demand are usually temporary. Please try again later.",

"status": "UNAVAILABLE"

}

}

翻譯成大白話就是:這個模型現在太火了,服務器扛不住了,你過一會兒再來試試。

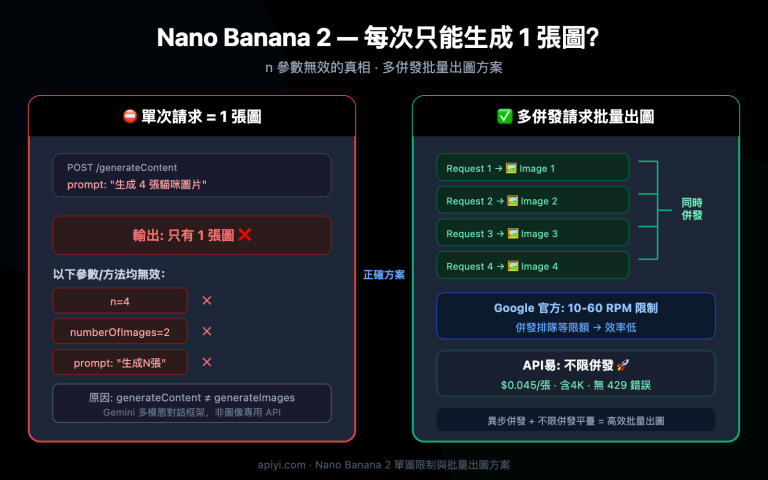

這個問題在 Gemini 3.1 Pro Preview 和 Gemini 3.1 Flash Image Preview(Nano Banana 2) 這兩個新模型上尤其嚴重。本文將徹底講清楚這個錯誤的本質、與其他常見錯誤的區別,以及 5 種實測有效的解決方案。

核心價值: 讀完本文,你將準確理解 503 high demand 報錯的根因,掌握 5 種可直接落地的解決方案,不再因爲這個錯誤卡住開發進度。

Gemini API 503 High Demand 報錯到底是什麼意思

先用一個通俗的比喻來理解這個問題:

想象 Google 的 Gemini 服務器是一家網紅餐廳。平時生意不錯,座位夠用。突然某天上了熱搜(新模型發佈),全城的人都湧過來排隊。餐廳容量就那麼大,坐滿了就是坐滿了。這時候你到門口,服務員會跟你說:"不好意思,現在人太多了,高峯期通常是暫時的,請您過一會兒再來。"

這就是 This model is currently experiencing high demand 的本質——不是你的代碼有問題,不是你的 API Key 有問題,是 Google 那邊的服務器算力不夠用了。

Gemini 503 報錯的 3 個關鍵事實

| 事實 | 說明 | 影響 |

|---|---|---|

| 服務端問題 | 503 是 Google 服務器容量不足,與你的代碼和配置無關 | 升級付費套餐也不能解決 |

| 所有用戶受影響 | 免費用戶、付費用戶、企業客戶都會遇到 | 不是"充錢就能解決"的問題 |

| 通常是暫時的 | 高峯期約 70% 的 503 錯誤在 60 分鐘內自行恢復 | 需要重試機制而非代碼修復 |

爲什麼 Gemini 3.1 Pro 和 Nano Banana 2 特別容易 503

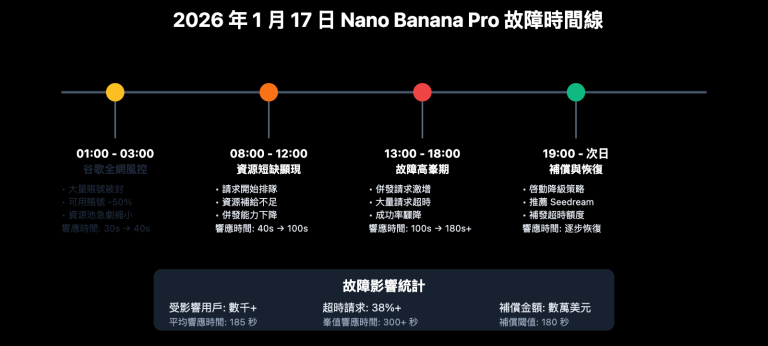

2026 年 2 月的 503 爆發有明確的時間線:

- 2 月 19 日: Google 發佈 Gemini 3.1 Pro Preview,大量開發者湧入測試

- 2 月 26 日: Nano Banana 2(

gemini-3.1-flash-image-preview)發佈,圖像生成需求激增 - 2 月 17-21 日: StatusGator 連續記錄了一整週的 Gemini 服務降級警告

- 高峯期失敗率約 45%: 社區數據顯示高峯時段請求失敗率接近一半

根本原因: 新模型剛上線,Google 分配的算力(GPU 集羣)還沒有按需擴容。Preview 狀態的模型服務器資源本來就有限,再遇上全球開發者同時湧入測試,就會出現供不應求的局面。

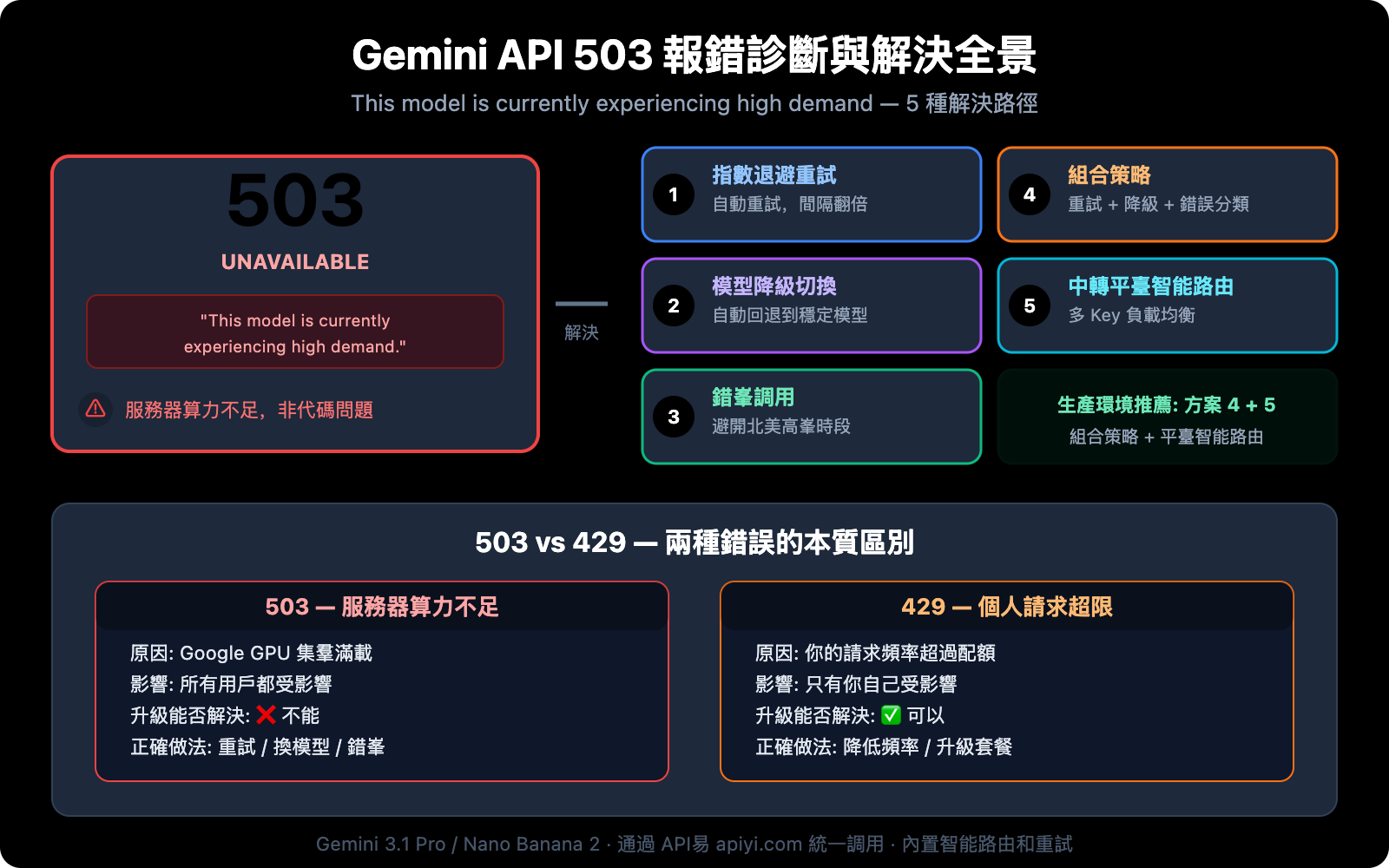

Gemini 503 High Demand 與 429 限流的本質區別

很多開發者會把 503 和 429 搞混,但這兩個錯誤的原因完全不同,解決方案也完全不同。搞錯了方向只會白費力氣。

| 對比維度 | 503 High Demand | 429 Rate Limit |

|---|---|---|

| 錯誤信息 | "This model is currently experiencing high demand" | "Resource has been exhausted" |

| 本質原因 | Google 服務器算力不足 | 你個人的請求頻率超限 |

| 影響範圍 | 所有用戶都受影響 | 只有你自己受影響 |

| 升級能否解決 | ❌ 升級付費套餐無法解決 | ✅ 升級到 Tier 1 可解決 |

| 重試是否有效 | ✅ 等一會兒通常能恢復 | ❌ 不降低頻率會持續報錯 |

| 高峯期特徵 | 北美工作時間(9AM-5PM PT)頻發 | 與時段無關,超限就報錯 |

| 根本解法 | 重試 + 備用模型 + 錯峯 | 降低請求頻率或升級套餐 |

一句話判斷方法

- 看到 503 → Google 的問題,等一等或換個模型

- 看到 429 → 你自己請求太快了,慢一點或升級套餐

🎯 技術建議: 在生產環境中同時處理 503 和 429 兩種錯誤是 API 集成的基本功。通過 API易 apiyi.com 平臺調用 Gemini 系列模型,平臺內置了智能重試和負載均衡機制,可以顯著降低終端用戶感知到的 503 錯誤頻率。

解決方案一:指數退避重試(最基礎)

既然 503 意味着"過一會兒再來",那最直接的應對就是自動重試。但不能無腦重試——需要用「指數退避」策略,每次重試間隔翻倍,避免加劇服務器壓力。

Gemini 503 指數退避重試代碼

import openai

import time

import random

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # API易 統一接口

)

def call_gemini_with_retry(messages, model="gemini-3.1-pro-preview", max_retries=5):

"""帶指數退避的 Gemini API 調用"""

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=messages

)

return response

except openai.APIStatusError as e:

if e.status_code == 503:

# 指數退避: 2s, 4s, 8s, 16s, 32s + 隨機抖動

wait_time = (2 ** attempt) + random.uniform(0, 1)

print(f"⏳ 503 High Demand - 第{attempt+1}次重試,等待 {wait_time:.1f}s...")

time.sleep(wait_time)

elif e.status_code == 429:

# 429 限流:等待更久

wait_time = 60 + random.uniform(0, 10)

print(f"🚫 429 Rate Limit - 等待 {wait_time:.1f}s...")

time.sleep(wait_time)

else:

raise # 其他錯誤直接拋出

raise Exception(f"重試 {max_retries} 次後仍然失敗")

# 使用示例

response = call_gemini_with_retry(

messages=[{"role": "user", "content": "Hello, Gemini!"}]

)

print(response.choices[0].message.content)

指數退避重試的核心參數

| 參數 | 建議值 | 說明 |

|---|---|---|

| 最大重試次數 | 5 次 | 超過 5 次基本說明不是暫時性問題 |

| 初始等待 | 2 秒 | 太短會加劇服務器壓力 |

| 退避倍數 | 2x | 每次翻倍: 2s → 4s → 8s → 16s → 32s |

| 隨機抖動 | 0-1 秒 | 避免大量客戶端同時重試 |

| 最長等待 | 32 秒 | 超過 32 秒應該切換備用方案 |

💡 實用提示: 隨機抖動(jitter)非常重要。如果所有客戶端都精確地在 2 秒後重試,會造成"驚羣效應"——所有請求同時再次湧向服務器,導致下一輪又是 503。加上隨機抖動可以把重試請求分散開。

解決方案二:模型降級/備用模型自動切換

當 Gemini 3.1 Pro Preview 持續 503 時,最實用的方案是自動切換到更穩定的備用模型。

Gemini 503 模型降級策略

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# 模型降級鏈: 優先用最強的,不行就降級

FALLBACK_MODELS = [

"gemini-3.1-pro-preview", # 首選: 最新最強

"gemini-3.0-pro", # 備選1: 上一代 Pro,更穩定

"gemini-2.5-flash-image-preview", # 備選2: Flash 版本,速度快

"gemini-2.5-flash", # 兜底: 最穩定的 Flash

]

def call_with_fallback(messages):

"""帶模型降級的 API 調用"""

for model in FALLBACK_MODELS:

try:

response = client.chat.completions.create(

model=model,

messages=messages

)

if model != FALLBACK_MODELS[0]:

print(f"⚠️ 已降級到備用模型: {model}")

return response

except openai.APIStatusError as e:

if e.status_code in (503, 429):

print(f"❌ {model} 返回 {e.status_code},嘗試下一個模型...")

continue

raise

raise Exception("所有模型均不可用")

response = call_with_fallback(

messages=[{"role": "user", "content": "分析這段代碼的性能瓶頸"}]

)

Gemini 模型穩定性排名

| 模型 | 穩定性 | 503 頻率 | 適合場景 |

|---|---|---|---|

gemini-2.5-flash |

⭐⭐⭐⭐⭐ | 極低 | 高可用生產環境兜底 |

gemini-3.0-pro |

⭐⭐⭐⭐ | 低 | 需要 Pro 能力的穩定場景 |

gemini-2.5-flash-image-preview |

⭐⭐⭐ | 中等 | 圖片生成備選 |

gemini-3.1-pro-preview |

⭐⭐ | 較高 | 需要最新能力但可接受偶發失敗 |

gemini-3.1-flash-image-preview |

⭐⭐ | 較高 | Nano Banana 2 圖片生成 |

🚀 快速開始: 通過 API易 apiyi.com 平臺可以一個 API Key 調用上表所有模型,模型切換隻需修改 model 參數,無需重新配置認證。在代碼中實現模型降級鏈非常方便。

解決方案三:錯峯調用(零成本方案)

503 high demand 有明顯的時段規律。社區數據顯示:

- 高峯期 (9AM-5PM PT): 失敗率約 45%

- 低谷期 (2AM-7AM PT): 失敗率低於 5%

換算成北京時間:

| 時段(北京時間) | 對應太平洋時間 | Gemini 503 頻率 | 建議 |

|---|---|---|---|

| 凌晨 1:00 – 上午 10:00 | 9AM-6PM PT (前一天) | 🔴 高峯 | 避開或使用備用模型 |

| 上午 10:00 – 下午 3:00 | 6PM-11PM PT (前一天) | 🟡 中等 | 帶重試機制調用 |

| 下午 3:00 – 晚上 11:00 | 11PM-7AM PT | 🟢 低谷 | 最佳調用窗口 |

| 晚上 11:00 – 凌晨 1:00 | 7AM-9AM PT | 🟡 中等 | 開始升溫 |

錯峯調用適合的場景

- 批量數據處理: 不需要實時響應的任務,安排在低谷時段運行

- 定時任務: 設置 cron job 在低谷時段執行

- 內容生成: 文章、圖片等可以提前生成、延遲發佈的場景

解決方案四:組合策略(生產環境推薦)

實際生產環境中,單一方案往往不夠。推薦將前 3 種方案組合使用:

生產級 Gemini API 調用方案

import openai

import time

import random

from datetime import datetime

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

FALLBACK_MODELS = [

"gemini-3.1-pro-preview",

"gemini-3.0-pro",

"gemini-2.5-flash",

]

def smart_gemini_call(messages, max_retries=3):

"""

生產級 Gemini API 調用

策略: 指數退避重試 + 模型降級 + 錯誤分類

"""

for model in FALLBACK_MODELS:

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=messages,

timeout=30

)

return response, model

except openai.APIStatusError as e:

if e.status_code == 503:

if attempt < max_retries - 1:

wait = (2 ** attempt) + random.uniform(0, 1)

print(f"⏳ {model} 503 - 重試 {attempt+1}/{max_retries},等 {wait:.1f}s")

time.sleep(wait)

else:

print(f"⚠️ {model} 持續 503,降級到下一個模型")

break # 跳出重試,切換模型

elif e.status_code == 429:

wait = 60

print(f"🚫 {model} 429 限流 - 等待 {wait}s")

time.sleep(wait)

else:

raise

except openai.APITimeoutError:

print(f"⏰ {model} 請求超時,嘗試下一個模型")

break

raise Exception("所有模型和重試均失敗,請檢查網絡或稍後再試")

# 使用

response, used_model = smart_gemini_call(

messages=[{"role": "user", "content": "你好"}]

)

print(f"✅ 使用模型: {used_model}")

print(response.choices[0].message.content)

查看完整的生產級封裝(含日誌、監控、緩存)

import openai

import time

import random

import hashlib

import json

import logging

from datetime import datetime

from functools import lru_cache

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger("gemini_client")

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# 簡單的請求緩存

_cache = {}

def get_cache_key(messages, model):

"""生成請求的緩存鍵"""

content = json.dumps(messages, sort_keys=True) + model

return hashlib.md5(content.encode()).hexdigest()

def gemini_call_production(

messages,

models=None,

max_retries=3,

cache_ttl=3600,

enable_cache=True

):

"""

生產級 Gemini API 調用封裝

特性:

- 指數退避重試(處理 503)

- 模型自動降級

- 響應緩存(減少重複請求)

- 結構化日誌

"""

if models is None:

models = ["gemini-3.1-pro-preview", "gemini-3.0-pro", "gemini-2.5-flash"]

# 檢查緩存

if enable_cache:

cache_key = get_cache_key(messages, models[0])

if cache_key in _cache:

cached_time, cached_response = _cache[cache_key]

if time.time() - cached_time < cache_ttl:

logger.info("命中緩存,跳過 API 調用")

return cached_response, "cache"

errors = []

for model in models:

for attempt in range(max_retries):

try:

start_time = time.time()

response = client.chat.completions.create(

model=model,

messages=messages,

timeout=30

)

elapsed = time.time() - start_time

logger.info(f"成功 | model={model} | 耗時={elapsed:.2f}s")

# 寫入緩存

if enable_cache:

_cache[cache_key] = (time.time(), response)

return response, model

except openai.APIStatusError as e:

errors.append(f"{model}:{e.status_code}")

if e.status_code == 503:

if attempt < max_retries - 1:

wait = (2 ** attempt) + random.uniform(0, 1)

logger.warning(f"503 | model={model} | retry={attempt+1} | wait={wait:.1f}s")

time.sleep(wait)

else:

logger.warning(f"503 持續 | model={model} | 降級到下一模型")

break

elif e.status_code == 429:

logger.warning(f"429 限流 | model={model}")

time.sleep(60)

else:

raise

except Exception as e:

logger.error(f"異常 | model={model} | error={e}")

break

raise Exception(f"全部失敗: {errors}")

解決方案五:使用中轉平臺的智能路由

當你不想自己實現上述複雜的重試和降級邏輯時,還有一個更省事的選擇——使用自帶智能路由能力的 API 中轉平臺。

中轉平臺如何解決 Gemini 503 問題

專業的 API 中轉平臺通常具備:

- 多 Key 輪詢: 平臺持有多個 Google API Key,單個 Key 被限流時自動切換

- 智能重試: 平臺層面實現了指數退避重試,對開發者透明

- 負載均衡: 將請求分散到多個 Google 賬號和區域

- 故障感知: 檢測到某個模型 503 頻率升高時,自動降低該模型的請求分配比例

🎯 技術建議: API易 apiyi.com 平臺對 Gemini 系列模型提供了上述智能路由能力。使用 OpenAI 兼容接口調用,平臺在後端自動處理 503 重試和多 Key 負載均衡,開發者無需自己實現複雜的容錯邏輯。

中轉平臺方案的代碼極簡示例

import openai

# 使用 API易 中轉平臺,503 處理由平臺負責

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# 就這麼簡單,不需要自己處理 503

response = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "你好"}]

)

print(response.choices[0].message.content)

Gemini API 報錯完整排查流程

遇到 Gemini API 報錯時,按照以下流程快速定位問題:

第一步:看錯誤碼

| 錯誤碼 | 錯誤信息 | 類型 | 立即行動 |

|---|---|---|---|

| 503 | "high demand" / "overloaded" | 服務端算力不足 | 等待重試或切換模型 |

| 429 | "resource exhausted" | 個人限流 | 降低請求頻率或升級套餐 |

| 400 | "invalid request" | 請求參數錯誤 | 檢查請求格式和參數 |

| 401 | "unauthorized" | 認證失敗 | 檢查 API Key |

| 500 | "internal error" | 服務端內部錯誤 | 等待重試 |

第二步:區分 503 還是 429

- 多個 API Key 都報錯 → 503,是 Google 服務器的問題

- 只有你的 Key 報錯 → 429,是你個人的限額問題

第三步:選擇對應方案

- 503: 指數退避重試 → 模型降級 → 錯峯調用

- 429: 降低請求頻率 → 啓用計費升級到 Tier 1(免費層 5-15 RPM,Tier 1 是 150-300 RPM)

常見問題

Q1: 爲什麼我付費了還是遇到 503 High Demand?

503 和你是否付費完全無關。503 是 Google 服務器算力不足的問題,不管你是免費用戶還是企業客戶都會遇到。這跟 429 限流不同——429 確實可以通過升級套餐來解決,但 503 不行。遇到 503 建議使用指數退避重試或切換到更穩定的模型版本。通過 API易 apiyi.com 平臺調用可以利用多 Key 負載均衡降低 503 的感知頻率。

Q2: Gemini 3.1 Pro Preview 的 503 什麼時候能好?

根據歷史經驗,新模型發佈後的 503 高峯通常持續 1-3 周,隨着 Google 逐步擴容會明顯改善。Gemini 3.0 Pro 剛發佈時也經歷過類似的 503 潮,現在已經非常穩定。在等待期間建議實現模型降級策略,503 時自動回退到 gemini-3.0-pro 或 gemini-2.5-flash。

Q3: “high demand” 和 “model is overloaded” 是同一個錯誤嗎?

本質上是同一個問題的不同措辭。"This model is currently experiencing high demand" 和 "The model is overloaded" 都是 503 狀態碼,都表示 Google 服務器算力不足。前者在較新的 API 版本中更常見,後者在早期版本中出現更多。處理方式完全相同。

Q4: 有沒有辦法提前知道 Gemini API 會不會 503?

沒有官方的提前預警。但你可以關注幾個信號:(1) Google 剛發佈新模型後的 1-2 周是高危期;(2) 北美工作時間(北京時間凌晨到上午)503 頻率更高;(3) 社區論壇 discuss.ai.google.dev 通常會有實時反饋。建議在代碼中始終保留重試和降級邏輯,而不是等遇到問題才臨時加。API易 apiyi.com 平臺提供了模型可用性狀態監控,可以幫助你提前感知。

Q5: 我應該在代碼裏同時處理 503 和 429 嗎?

必須的。生產環境中 503 和 429 都會遇到,處理策略不同但同樣重要。503 用指數退避重試 + 模型降級,429 用降低請求頻率 + 限流排隊。本文的「方案四:組合策略」代碼同時處理了這兩種錯誤,可以直接用於生產環境。

總結

This model is currently experiencing high demand 這個 503 報錯的本質非常簡單——Google 的服務器算力暫時不夠用了。尤其是 Gemini 3.1 Pro Preview、Nano Banana 2 這類新模型,剛上線階段幾乎必然會遇到。

5 種解決方案按推薦優先級:

- 指數退避重試 — 最基礎,每個項目都應該有

- 模型降級鏈 — 503 時自動切換到更穩定的模型

- 錯峯調用 — 非實時任務安排在低谷時段

- 組合策略 — 生產環境推薦,重試 + 降級 + 錯誤分類

- 中轉平臺智能路由 — 最省事,平臺處理容錯邏輯

不管選哪種方案,核心原則是:503 不是你的錯,但你需要優雅地處理它。推薦通過 API易 apiyi.com 快速集成 Gemini 系列模型,享受內置的智能路由和重試能力。

參考資料

-

Google AI Developers Forum – 503 Error Discussions

- 鏈接:

discuss.ai.google.dev - 說明: Gemini API 503 錯誤的社區討論和官方回覆

- 鏈接:

-

Google Gemini API – Rate Limits Documentation

- 鏈接:

ai.google.dev/gemini-api/docs/rate-limits - 說明: 官方限流規則和各 Tier 配額說明

- 鏈接:

-

Google Gemini API – Troubleshooting Guide

- 鏈接:

ai.google.dev/gemini-api/docs/troubleshooting - 說明: 官方錯誤排查指南

- 鏈接:

📝 作者: APIYI Team | 技術交流和 API 接入請訪問 apiyi.com