واجه العديد من المطورين مؤخرًا رسالة الخطأ التالية عند استدعاء Gemini API:

{

"error": {

"code": 503,

"message": "This model is currently experiencing high demand. Spikes in demand are usually temporary. Please try again later.",

"status": "UNAVAILABLE"

}

}

بصراحة، هذا يعني أن النموذج يحظى بشعبية كبيرة حاليًا، والخوادم لا تستطيع تلبية الطلب، لذا يرجى المحاولة مرة أخرى لاحقًا.

تتفاقم هذه المشكلة بشكل خاص في النموذجين الجديدين Gemini 3.1 Pro Preview و Gemini 3.1 Flash Image Preview (Nano Banana 2). ستوضح هذه المقالة بشكل شامل جوهر هذا الخطأ، والاختلافات بينه وبين الأخطاء الشائعة الأخرى، بالإضافة إلى 5 حلول مجربة وفعالة.

القيمة الأساسية: بعد قراءة هذه المقالة، ستفهم بدقة الأسباب الجذرية لخطأ 503 بسبب ارتفاع الطلب، وستتقن 5 حلول قابلة للتطبيق مباشرة، ولن تتعطل عملية تطويرك بسبب هذا الخطأ بعد الآن.

ما هو معنى خطأ Gemini API 503 High Demand بالضبط؟

دعنا نفهم هذه المشكلة بمثال بسيط:

تخيل أن خوادم Google Gemini هي مطعم مشهور جدًا. عادةً ما يكون العمل جيدًا والمقاعد كافية. فجأة، في أحد الأيام، أصبح المطعم تريند (إطلاق نموذج جديد)، وتدفق جميع سكان المدينة للوقوف في الطابور. سعة المطعم محدودة، وعندما يمتلئ، يمتلئ. في هذه الحالة، عندما تصل إلى الباب، سيقول لك النادل: "عذرًا، يوجد الكثير من الناس الآن، فترة الذروة عادة ما تكون مؤقتة، يرجى المحاولة مرة أخرى لاحقًا."

هذا هو جوهر رسالة This model is currently experiencing high demand – ليست مشكلتك في الكود، وليست مشكلتك في مفتاح API، بل إن سعة الحوسبة على خوادم Google غير كافية.

3 حقائق أساسية حول خطأ Gemini 503

| الحقيقة | الشرح | التأثير |

|---|---|---|

| مشكلة من جانب الخادم | الخطأ 503 يعني أن سعة خوادم Google غير كافية، ولا علاقة له بكودك أو إعداداتك. | الترقية إلى خطة مدفوعة لن تحل المشكلة. |

| جميع المستخدمين يتأثرون | يواجهها المستخدمون المجانيون والمدفوعون وعملاء الشركات. | ليست مشكلة "يمكن حلها بالدفع". |

| عادةً ما تكون مؤقتة | خلال فترات الذروة، يتعافى حوالي 70% من أخطاء 503 تلقائيًا في غضون 60 دقيقة. | تتطلب آلية إعادة المحاولة بدلاً من إصلاح الكود. |

لماذا نموذج Gemini 3.1 Pro و Nano Banana 2 عرضة بشكل خاص لخطأ 503؟

كان لظهور أخطاء 503 في فبراير 2026 جدول زمني واضح:

- 19 فبراير: أطلقت Google نموذج Gemini 3.1 Pro Preview، وتدفق عدد كبير من المطورين لاختباره.

- 26 فبراير: تم إطلاق Nano Banana 2 (

gemini-3.1-flash-image-preview)، مما أدى إلى زيادة هائلة في الطلب على توليد الصور. - 17-21 فبراير: سجلت StatusGator تحذيرات متتالية لتدهور خدمة Gemini لمدة أسبوع كامل.

- معدل فشل يبلغ حوالي 45% في أوقات الذروة: تظهر بيانات المجتمع أن معدل فشل الطلبات في أوقات الذروة يقترب من النصف.

السبب الجذري: بعد إطلاق النماذج الجديدة مباشرة، لم يتم توسيع سعة الحوسبة المخصصة من Google (مجموعات وحدات معالجة الرسوميات) حسب الطلب. موارد خوادم النماذج في حالة Preview محدودة بطبيعتها، وعندما يتزامن ذلك مع تدفق المطورين العالميين للاختبار، ينشأ وضع تتجاوز فيه الطلبات العرض.

الفرق الجوهري بين Gemini 503 High Demand و 429 Rate Limit

يخلط العديد من المطورين بين الخطأين 503 و 429، لكن أسباب هذين الخطأين مختلفة تمامًا، وحلولهما مختلفة تمامًا. الخلط بينهما سيؤدي فقط إلى إهدار الجهد.

| معيار المقارنة | 503 High Demand | 429 Rate Limit |

|---|---|---|

| رسالة الخطأ | "This model is currently experiencing high demand" | "Resource has been exhausted" |

| السبب الجوهري | نقص قدرة معالجة خوادم Google | تجاوز معدل طلباتك الشخصية للحد المسموح به |

| نطاق التأثير | يتأثر جميع المستخدمين | تتأثر أنت فقط |

| هل يمكن للترقية أن تحل المشكلة؟ | ❌ ترقية الباقة المدفوعة لا تحل المشكلة | ✅ الترقية إلى الفئة 1 (Tier 1) يمكن أن تحل المشكلة |

| هل إعادة المحاولة فعالة؟ | ✅ الانتظار قليلًا عادة ما يعيد الأمور لطبيعتها | ❌ عدم خفض التردد سيؤدي إلى استمرار الأخطاء |

| خصائص أوقات الذروة | يتكرر بكثرة خلال ساعات العمل في أمريكا الشمالية (9 صباحًا – 5 مساءً بتوقيت المحيط الهادئ) | لا يرتبط بالوقت، يظهر الخطأ بمجرد تجاوز الحد |

| الحل الجذري | إعادة المحاولة + نموذج احتياطي + العمل خارج أوقات الذروة | خفض معدل الطلبات أو ترقية الباقة |

طريقة الحكم بعبارة واحدة

- عند رؤية 503 ← مشكلة من Google، انتظر قليلًا أو غيّر النموذج

- عند رؤية 429 ← طلباتك سريعة جدًا، أبطئ قليلًا أو قم بترقية الباقة

🎯 نصيحة تقنية: التعامل مع خطأي 503 و 429 في آن واحد ضمن بيئة الإنتاج هو مهارة أساسية في دمج واجهات برمجة التطبيقات (API). من خلال منصة APIYI apiyi.com لاستدعاء نماذج سلسلة Gemini، تتضمن المنصة آليات ذكية لإعادة المحاولة وموازنة التحميل، مما يقلل بشكل كبير من تكرار أخطاء 503 التي يلاحظها المستخدم النهائي.

الحل الأول: إعادة المحاولة بالتراجع الأسي (الأساسي)

بما أن الخطأ 503 يعني "حاول مرة أخرى بعد قليل"، فإن الاستجابة الأكثر مباشرة هي إعادة المحاولة التلقائية. ولكن لا يمكن إعادة المحاولة بشكل عشوائي – بل يجب استخدام استراتيجية "التراجع الأسي"، حيث يتضاعف الفاصل الزمني لكل محاولة، لتجنب زيادة الضغط على الخادم.

كود إعادة المحاولة بالتراجع الأسي لـ Gemini 503

import openai

import time

import random

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # واجهة APIYI الموحدة

)

def call_gemini_with_retry(messages, model="gemini-3.1-pro-preview", max_retries=5):

"""استدعاء Gemini API مع تراجع أسي"""

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=messages

)

return response

except openai.APIStatusError as e:

if e.status_code == 503:

# تراجع أسي: 2 ث، 4 ث، 8 ث، 16 ث، 32 ث + اهتزاز عشوائي

wait_time = (2 ** attempt) + random.uniform(0, 1)

print(f"⏳ 503 طلب مرتفع - إعادة المحاولة رقم {attempt+1}، انتظار {wait_time:.1f} ثانية...")

time.sleep(wait_time)

elif e.status_code == 429:

# 429 تجاوز الحد الأقصى: انتظر وقتًا أطول

wait_time = 60 + random.uniform(0, 10)

print(f"🚫 429 تجاوز الحد الأقصى للطلبات - انتظار {wait_time:.1f} ثانية...")

time.sleep(wait_time)

else:

raise # أخطاء أخرى يتم طرحها مباشرة

raise Exception(f"فشل بعد {max_retries} محاولات")

# مثال على الاستخدام

response = call_gemini_with_retry(

messages=[{"role": "user", "content": "Hello, Gemini!"}]

)

print(response.choices[0].message.content)

المعلمات الأساسية لإعادة المحاولة بالتراجع الأسي

| المعلمة | القيمة المقترحة | الوصف |

|---|---|---|

| الحد الأقصى لعدد المحاولات | 5 مرات | تجاوز 5 مرات يشير عادة إلى أن المشكلة ليست مؤقتة |

| الانتظار الأولي | 2 ثانية | قصير جدًا سيزيد من ضغط الخادم |

| عامل التراجع | 2x | يتضاعف في كل مرة: 2 ث → 4 ث → 8 ث → 16 ث → 32 ث |

| الاهتزاز العشوائي | 0-1 ثانية | لتجنب قيام عدد كبير من العملاء بإعادة المحاولة في نفس الوقت |

| أقصى فترة انتظار | 32 ثانية | تجاوز 32 ثانية يعني أنه يجب التبديل إلى حل بديل |

💡 نصيحة عملية: الاهتزاز العشوائي (jitter) مهم جدًا. إذا قامت جميع العملاء بإعادة المحاولة بدقة بعد ثانيتين، فسيؤدي ذلك إلى "تأثير القطيع" – حيث تتدفق جميع الطلبات مرة أخرى إلى الخادم في نفس الوقت، مما يؤدي إلى ظهور الخطأ 503 مرة أخرى في الجولة التالية. إضافة اهتزاز عشوائي يمكن أن يوزع طلبات إعادة المحاولة.

الحل الثاني: تخفيض مستوى النموذج / التبديل التلقائي إلى نموذج احتياطي

عندما يستمر Gemini 3.1 Pro Preview في إرجاع الخطأ 503، فإن الحل الأكثر عملية هو التبديل التلقائي إلى نموذج احتياطي أكثر استقرارًا.

استراتيجية تخفيض مستوى النموذج لخطأ Gemini 503

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# سلسلة تخفيض مستوى النموذج: الأولوية للأقوى، ثم التخفيض إذا فشل

FALLBACK_MODELS = [

"gemini-3.1-pro-preview", # المفضل: الأحدث والأقوى

"gemini-3.0-pro", # البديل 1: الجيل السابق من Pro، أكثر استقرارًا

"gemini-2.5-flash-image-preview", # البديل 2: إصدار Flash، سريع

"gemini-2.5-flash", # الحل الأخير: Flash الأكثر استقرارًا

]

def call_with_fallback(messages):

"""استدعاء API مع تخفيض مستوى النموذج"""

for model in FALLBACK_MODELS:

try:

response = client.chat.completions.create(

model=model,

messages=messages

)

if model != FALLBACK_MODELS[0]:

print(f"⚠️ تم تخفيض المستوى إلى النموذج الاحتياطي: {model}")

return response

except openai.APIStatusError as e:

if e.status_code in (503, 429):

print(f"❌ {model} أرجع {e.status_code}، محاولة النموذج التالي...")

continue

raise

raise Exception("جميع النماذج غير متاحة")

response = call_with_fallback(

messages=[{"role": "user", "content": "حلل عنق الزجاجة في أداء هذا الكود"}]

)

ترتيب استقرار نماذج Gemini

| النموذج | الاستقرار | تكرار الخطأ 503 | السيناريوهات المناسبة |

|---|---|---|---|

gemini-2.5-flash |

⭐⭐⭐⭐⭐ | منخفض جدًا | حل أخير لبيئات الإنتاج عالية التوفر |

gemini-3.0-pro |

⭐⭐⭐⭐ | منخفض | السيناريوهات المستقرة التي تتطلب قدرات Pro |

gemini-2.5-flash-image-preview |

⭐⭐⭐ | متوسط | بديل لتوليد الصور |

gemini-3.1-pro-preview |

⭐⭐ | مرتفع نسبيًا | يتطلب أحدث القدرات ولكنه يقبل الفشل العرضي |

gemini-3.1-flash-image-preview |

⭐⭐ | مرتفع نسبيًا | توليد الصور Nano Banana 2 |

🚀 ابدأ سريعًا: من خلال منصة APIYI apiyi.com، يمكنك استدعاء جميع النماذج المذكورة في الجدول أعلاه باستخدام مفتاح API واحد. يتطلب تبديل النموذج فقط تعديل معلمة model، دون الحاجة إلى إعادة تكوين المصادقة. من السهل جدًا تطبيق سلسلة تخفيض مستوى النموذج في الكود.

الحل الثالث: الاستدعاء خارج أوقات الذروة (حل بدون تكلفة)

الطلب المرتفع الذي يسبب الخطأ 503 يتبع أنماطًا زمنية واضحة. تُظهر بيانات المجتمع:

- فترة الذروة (9 صباحًا – 5 مساءً بتوقيت المحيط الهادئ): معدل الفشل حوالي 45%

- فترة الركود (2 صباحًا – 7 صباحًا بتوقيت المحيط الهادئ): معدل الفشل أقل من 5%

بالتحويل إلى توقيت بكين:

| الفترة (توقيت بكين) | ما يعادلها بتوقيت المحيط الهادئ | تكرار خطأ Gemini 503 | التوصية |

|---|---|---|---|

| 1:00 صباحًا – 10:00 صباحًا | 9 صباحًا – 6 مساءً بتوقيت المحيط الهادئ (اليوم السابق) | 🔴 ذروة | تجنب أو استخدم نموذجًا احتياطيًا |

| 10:00 صباحًا – 3:00 مساءً | 6 مساءً – 11 مساءً بتوقيت المحيط الهادئ (اليوم السابق) | 🟡 متوسط | استدعاء مع آلية إعادة المحاولة |

| 3:00 مساءً – 11:00 مساءً | 11 مساءً – 7 صباحًا بتوقيت المحيط الهادئ | 🟢 ركود | أفضل نافذة للاستدعاء |

| 11:00 مساءً – 1:00 صباحًا | 7 صباحًا – 9 صباحًا بتوقيت المحيط الهادئ | 🟡 متوسط | تبدأ في الارتفاع |

السيناريوهات المناسبة للاستدعاء خارج أوقات الذروة

- معالجة البيانات المجمعة: المهام التي لا تتطلب استجابة فورية، يمكن جدولتها للتشغيل خلال فترات الركود

- المهام المجدولة: إعداد cron job للتنفيذ خلال فترات الركود

- توليد المحتوى: سيناريوهات مثل المقالات والصور التي يمكن توليدها مسبقًا ونشرها لاحقًا

الحل الرابع: استراتيجية مجمعة (موصى بها لبيئة الإنتاج)

في بيئات الإنتاج الفعلية، غالبًا ما يكون الحل الفردي غير كافٍ. يوصى بدمج الحلول الثلاثة السابقة:

استدعاء Gemini API على مستوى الإنتاج

import openai

import time

import random

from datetime import datetime

client = openai.OpenAI(

api_key="YOUR_API_KEY", # مفتاح API الخاص بك

base_url="https://api.apiyi.com/v1"

)

FALLBACK_MODELS = [

"gemini-3.1-pro-preview",

"gemini-3.0-pro",

"gemini-2.5-flash",

]

def smart_gemini_call(messages, max_retries=3):

"""

استدعاء Gemini API على مستوى الإنتاج

الاستراتيجية: إعادة محاولة مع تراجع أُسي + تخفيض مستوى النموذج + تصنيف الأخطاء

"""

for model in FALLBACK_MODELS:

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=messages,

timeout=30

)

return response, model

except openai.APIStatusError as e:

if e.status_code == 503:

if attempt < max_retries - 1:

wait = (2 ** attempt) + random.uniform(0, 1)

print(f"⏳ {model} 503 - إعادة المحاولة {attempt+1}/{max_retries}، انتظر {wait:.1f}s")

time.sleep(wait)

else:

print(f"⚠️ {model} مستمر 503، تخفيض إلى النموذج التالي")

break # الخروج من إعادة المحاولة، التبديل إلى نموذج آخر

elif e.status_code == 429:

wait = 60

print(f"🚫 {model} 429 تجاوز الحد الأقصى - انتظار {wait}s")

time.sleep(wait)

else:

raise

except openai.APITimeoutError:

print(f"⏰ {model} انتهت مهلة الطلب، محاولة النموذج التالي")

break

raise Exception("فشلت جميع النماذج وإعادة المحاولات، يرجى التحقق من الشبكة أو المحاولة لاحقًا")

# الاستخدام

response, used_model = smart_gemini_call(

messages=[{"role": "user", "content": "مرحباً"}]

)

print(f"✅ النموذج المستخدم: {used_model}")

print(response.choices[0].message.content)

عرض التغليف الكامل على مستوى الإنتاج (يتضمن السجلات والمراقبة والتخزين المؤقت)

import openai

import time

import random

import hashlib

import json

import logging

from datetime import datetime

from functools import lru_cache

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger("gemini_client")

client = openai.OpenAI(

api_key="YOUR_API_KEY", # مفتاح API الخاص بك

base_url="https://api.apiyi.com/v1"

)

# تخزين مؤقت بسيط للطلبات

_cache = {}

def get_cache_key(messages, model):

"""إنشاء مفتاح التخزين المؤقت للطلب"""

content = json.dumps(messages, sort_keys=True) + model

return hashlib.md5(content.encode()).hexdigest()

def gemini_call_production(

messages,

models=None,

max_retries=3,

cache_ttl=3600,

enable_cache=True

):

"""

تغليف استدعاء Gemini API على مستوى الإنتاج

الميزات:

- إعادة محاولة مع تراجع أُسي (للتعامل مع 503)

- تخفيض مستوى النموذج تلقائيًا

- تخزين مؤقت للاستجابة (لتقليل الطلبات المتكررة)

- تسجيل منظم

"""

if models is None:

models = ["gemini-3.1-pro-preview", "gemini-3.0-pro", "gemini-2.5-flash"]

# التحقق من التخزين المؤقت

if enable_cache:

cache_key = get_cache_key(messages, models[0])

if cache_key in _cache:

cached_time, cached_response = _cache[cache_key]

if time.time() - cached_time < cache_ttl:

logger.info("تم العثور في التخزين المؤقت، تخطي استدعاء API")

return cached_response, "cache"

errors = []

for model in models:

for attempt in range(max_retries):

try:

start_time = time.time()

response = client.chat.completions.create(

model=model,

messages=messages,

timeout=30

)

elapsed = time.time() - start_time

logger.info(f"نجاح | model={model} | المدة={elapsed:.2f}s")

# الكتابة إلى التخزين المؤقت

if enable_cache:

_cache[cache_key] = (time.time(), response)

return response, model

except openai.APIStatusError as e:

errors.append(f"{model}:{e.status_code}")

if e.status_code == 503:

if attempt < max_retries - 1:

wait = (2 ** attempt) + random.uniform(0, 1)

logger.warning(f"503 | model={model} | retry={attempt+1} | wait={wait:.1f}s")

time.sleep(wait)

else:

logger.warning(f"503 مستمر | model={model} | تخفيض إلى النموذج التالي")

break

elif e.status_code == 429:

logger.warning(f"429 تجاوز الحد الأقصى | model={model}")

time.sleep(60)

else:

raise

except Exception as e:

logger.error(f"استثناء | model={model} | error={e}")

break

raise Exception(f"فشل الكل: {errors}")

الحل الخامس: استخدام التوجيه الذكي لمنصات وكيل API

عندما لا ترغب في تطبيق منطق إعادة المحاولة والتراجع المعقد المذكور أعلاه بنفسك، هناك خيار أسهل: استخدام منصة وكيل API ذات قدرات توجيه ذكية مدمجة.

كيف تحل منصات وكيل API مشكلة Gemini 503

تتميز منصات وكيل API الاحترافية عادةً بما يلي:

- استخدام مفاتيح متعددة بالتناوب: تحتفظ المنصة بالعديد من مفاتيح Google API، وتتحول تلقائيًا عند تجاوز حد مفتاح واحد.

- إعادة محاولة ذكية: يتم تطبيق إعادة المحاولة بأسلوب التراجع الأسي على مستوى المنصة، وهو شفاف للمطورين.

- موازنة التحميل: توزيع الطلبات على حسابات ومناطق Google متعددة.

- استشعار الأعطال: عند اكتشاف زيادة في تكرار الخطأ 503 لنموذج معين، يتم تقليل نسبة تخصيص الطلبات لهذا النموذج تلقائيًا.

🎯 نصيحة تقنية: توفر منصة APIYI apiyi.com قدرات التوجيه الذكي المذكورة أعلاه لنماذج سلسلة Gemini. باستخدام واجهة متوافقة مع OpenAI، تتعامل المنصة تلقائيًا مع إعادة محاولة 503 وموازنة التحميل للمفاتيح المتعددة في الخلفية، مما يلغي حاجة المطورين لتطبيق منطق معقد لتحمل الأخطاء بأنفسهم.

مثال مبسط للغاية لرمز برمجي باستخدام حل منصة وكيل API

import openai

# باستخدام منصة وكيل APIYI، المنصة مسؤولة عن معالجة أخطاء 503

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# الأمر بهذه البساطة، لا حاجة لمعالجة أخطاء 503 بنفسك

response = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "你好"}]

)

print(response.choices[0].message.content)

عملية استكشاف الأخطاء وإصلاحها الكاملة لأخطاء Gemini API

عند مواجهة أخطاء في Gemini API، اتبع العملية التالية لتحديد المشكلة بسرعة:

الخطوة الأولى: فحص رمز الخطأ

| رمز الخطأ | رسالة الخطأ | النوع | الإجراء الفوري |

|---|---|---|---|

| 503 | "high demand" / "overloaded" | نقص قدرة الخادم | انتظر لإعادة المحاولة أو قم بتبديل النموذج |

| 429 | "resource exhausted" | تجاوز الحد الشخصي | قلل تكرار الطلبات أو قم بترقية الباقة |

| 400 | "invalid request" | خطأ في معلمات الطلب | تحقق من تنسيق الطلب ومعلماته |

| 401 | "unauthorized" | فشل المصادقة | تحقق من مفتاح API |

| 500 | "internal error" | خطأ داخلي في الخادم | انتظر لإعادة المحاولة |

الخطوة الثانية: التمييز بين 503 و 429

- إذا كانت جميع مفاتيح API المتعددة تُبلغ عن خطأ → 503، فهذه مشكلة في خادم Google.

- إذا كان مفتاحك فقط هو الذي يُبلغ عن خطأ → 429، فهذه مشكلة تتعلق بحدودك الشخصية.

الخطوة الثالثة: اختيار الحل المناسب

- 503: إعادة محاولة بأسلوب التراجع الأسي → تراجع النموذج → الاستدعاء خارج أوقات الذروة.

- 429: تقليل تكرار الطلبات → تفعيل الفوترة للترقية إلى المستوى 1 (الطبقة المجانية 5-15 طلبًا في الدقيقة، المستوى 1 هو 150-300 طلبًا في الدقيقة).

أسئلة شائعة

س1: لماذا أواجه خطأ 503 High Demand على الرغم من أنني مشترك مدفوع؟

خطأ 503 لا علاقة له بكونك مشتركًا مدفوعًا أم لا. إن 503 هي مشكلة تتعلق بنقص قدرة معالجة خوادم Google، وسيواجهها كل من المستخدمين المجانيين وعملاء الشركات. يختلف هذا عن تحديد المعدل 429 – فبينما يمكن حل 429 عن طريق ترقية الباقة، لا يمكن حل 503 بهذه الطريقة. عند مواجهة 503، يُنصح باستخدام إعادة المحاولة بالأسلوب الأسي (exponential backoff retry) أو التبديل إلى إصدار نموذج أكثر استقرارًا. يمكن أن يؤدي الاستدعاء عبر منصة APIYI apiyi.com إلى تقليل تكرار ظهور 503 من خلال الاستفادة من موازنة التحميل متعددة المفاتيح (multi-key load balancing).

س2: متى سيتحسن خطأ 503 في Gemini 3.1 Pro Preview؟

وفقًا للتجربة التاريخية، تستمر ذروة أخطاء 503 بعد إطلاق نموذج جديد عادةً من أسبوع إلى ثلاثة أسابيع، وستتحسن بشكل ملحوظ مع توسيع Google لقدراتها تدريجيًا. لقد مر Gemini 3.0 Pro أيضًا بموجة مماثلة من أخطاء 503 عند إطلاقه، وهو الآن مستقر جدًا. خلال فترة الانتظار، يُنصح بتطبيق استراتيجية تخفيض مستوى النموذج (model degradation)، بحيث يتم الرجوع تلقائيًا إلى gemini-3.0-pro أو gemini-2.5-flash عند حدوث خطأ 503.

س3: هل “high demand” و “model is overloaded” نفس الخطأ؟

إنهما في الأساس تعبيران مختلفان عن نفس المشكلة. كلا العبارتين "This model is currently experiencing high demand" و "The model is overloaded" تشيران إلى رمز الحالة 503، وكلاهما يعنيان أن قدرة معالجة خوادم Google غير كافية. الأولى أكثر شيوعًا في إصدارات API الأحدث، بينما تظهر الثانية بشكل أكبر في الإصدارات المبكرة. طريقة المعالجة هي نفسها تمامًا.

س4: هل هناك طريقة لمعرفة ما إذا كان Gemini API سيواجه خطأ 503 مسبقًا؟

لا يوجد تحذير رسمي مسبق. ولكن يمكنك الانتباه إلى عدة إشارات: (1) الأسابيع 1-2 بعد إطلاق Google لنموذج جديد هي فترة عالية الخطورة؛ (2) تكون أخطاء 503 أكثر تكرارًا خلال ساعات العمل في أمريكا الشمالية (من منتصف الليل حتى الصباح بتوقيت بكين)؛ (3) غالبًا ما يقدم منتدى المجتمع discuss.ai.google.dev ملاحظات فورية. يُنصح دائمًا بالاحتفاظ بمنطق إعادة المحاولة وتخفيض المستوى في التعليمات البرمجية، بدلاً من إضافته مؤقتًا عند مواجهة مشكلة. توفر منصة APIYI apiyi.com مراقبة لحالة توفر النموذج، مما يمكن أن يساعدك على الاستشعار المسبق.

س5: هل يجب أن أتعامل مع 503 و 429 في التعليمات البرمجية الخاصة بي في نفس الوقت؟

بالتأكيد. في بيئات الإنتاج، ستواجه كلا الخطأين 503 و 429، وتختلف استراتيجيات المعالجة ولكنها بنفس القدر من الأهمية. يُستخدم لـ 503 إعادة المحاولة بالأسلوب الأسي + تخفيض مستوى النموذج، بينما يُستخدم لـ 429 تقليل تكرار الطلبات + تحديد المعدل في قائمة الانتظار. تتعامل التعليمات البرمجية في "الخطة الرابعة: الاستراتيجية المدمجة" من هذه المقالة مع كلا الخطأين في نفس الوقت، ويمكن استخدامها مباشرة في بيئات الإنتاج.

ملخص

جوهر خطأ 503 This model is currently experiencing high demand بسيط للغاية – قدرة معالجة خوادم Google غير كافية مؤقتًا. خاصة النماذج الجديدة مثل Gemini 3.1 Pro Preview و Nano Banana 2، فمن شبه المؤكد أن تواجه هذه المشكلة في مرحلة الإطلاق الأولية.

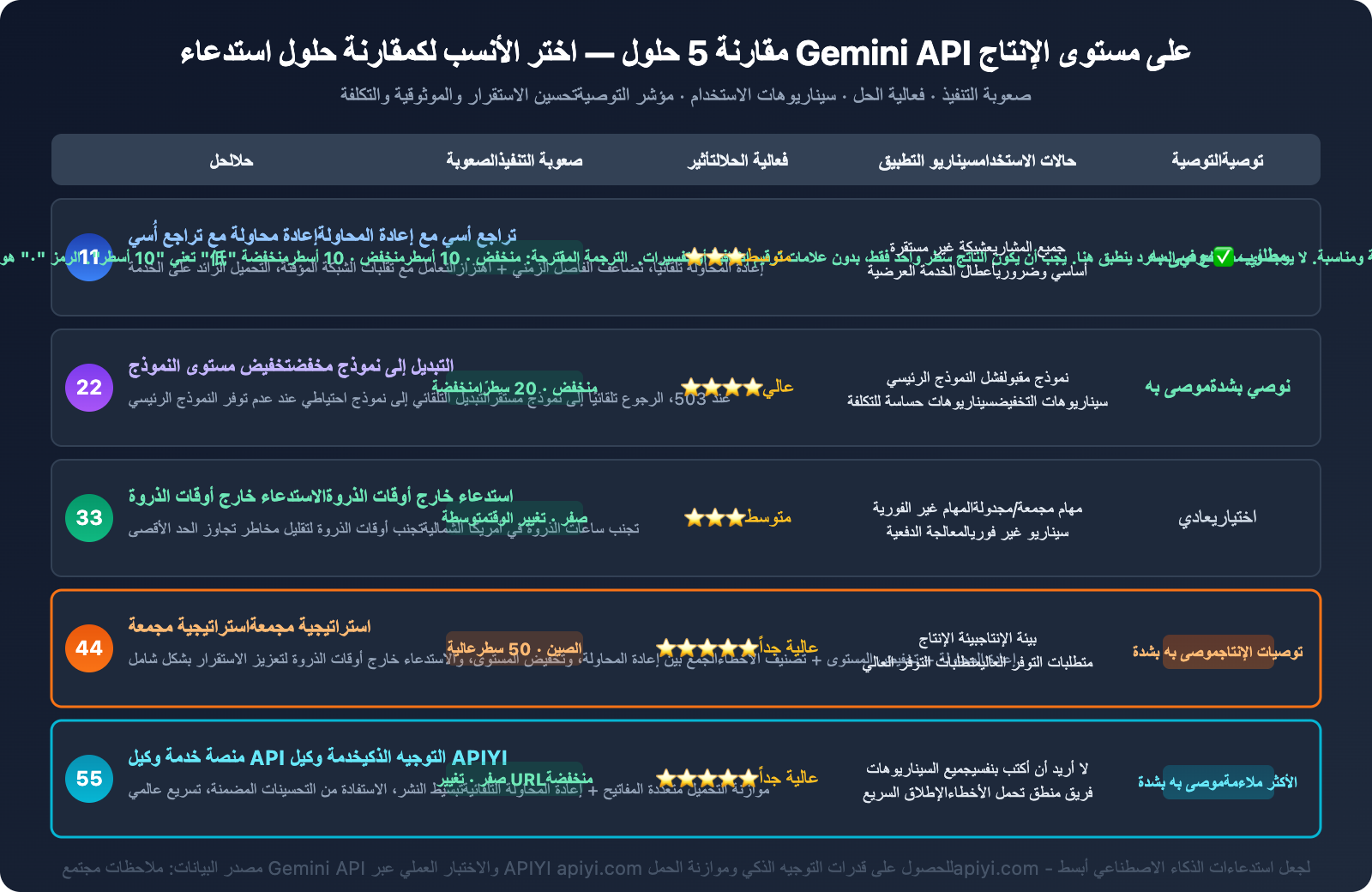

5 حلول مرتبة حسب الأولوية الموصى بها:

- إعادة المحاولة بالأسلوب الأسي (Exponential Backoff Retry) — الحل الأساسي، يجب أن يكون موجودًا في كل مشروع.

- سلسلة تخفيض مستوى النموذج (Model Degradation Chain) — التبديل التلقائي إلى نموذج أكثر استقرارًا عند حدوث 503.

- الاستدعاء خارج أوقات الذروة (Off-Peak Calling) — جدولة المهام غير الفورية في أوقات الانخفاض.

- الاستراتيجية المدمجة (Combined Strategy) — موصى بها لبيئات الإنتاج، إعادة المحاولة + تخفيض المستوى + تصنيف الأخطاء.

- التوجيه الذكي لمنصة الوكيل (Proxy Platform Smart Routing) — الأسهل، حيث تتولى المنصة معالجة منطق التسامح مع الأخطاء.

بغض النظر عن الحل الذي تختاره، المبدأ الأساسي هو: خطأ 503 ليس خطأك، ولكنك بحاجة إلى التعامل معه بأناقة. نوصي بالدمج السريع لسلسلة نماذج Gemini عبر APIYI apiyi.com للاستمتاع بقدرات التوجيه الذكي وإعادة المحاولة المدمجة.

المراجع

-

منتدى مطوري Google AI – مناقشات خطأ 503

- الرابط:

discuss.ai.google.dev - الوصف: مناقشات مجتمعية وردود رسمية حول خطأ 503 في Gemini API

- الرابط:

-

واجهة برمجة تطبيقات Google Gemini – وثائق حدود المعدل

- الرابط:

ai.google.dev/gemini-api/docs/rate-limits - الوصف: القواعد الرسمية لتحديد المعدل وشرح حصص كل مستوى (Tier)

- الرابط:

-

واجهة برمجة تطبيقات Google Gemini – دليل استكشاف الأخطاء وإصلاحها

- الرابط:

ai.google.dev/gemini-api/docs/troubleshooting - الوصف: الدليل الرسمي لاستكشاف الأخطاء وإصلاحها

- الرابط:

📝 المؤلف: فريق APIYI | للتواصل التقني وربط API، يرجى زيارة apiyi.com