ComfyUI hat sich als Open-Source-Tool für die Bild- und Videogenerierung zur bevorzugten Plattform für AI-Creator entwickelt. Mit der Einführung des Bildmodells Nano Banana Pro durch Google und des Videomodells Sora-2 durch OpenAI stellen sich viele Nutzer eine zentrale Frage: Können diese hochmodernen Modelle in ComfyUI integriert werden? Und wie sieht die einfachste Konfiguration aus?

In diesem Artikel beantworten wir diese Fragen im Detail und bieten Ihnen vollständige Integrationslösungen – von offiziellen Knoten bis hin zu API-Plattformen von Drittanbietern –, damit Sie die enorme Leistungsfähigkeit von Nano Banana Pro und Sora-2 schnell in ComfyUI nutzen können.

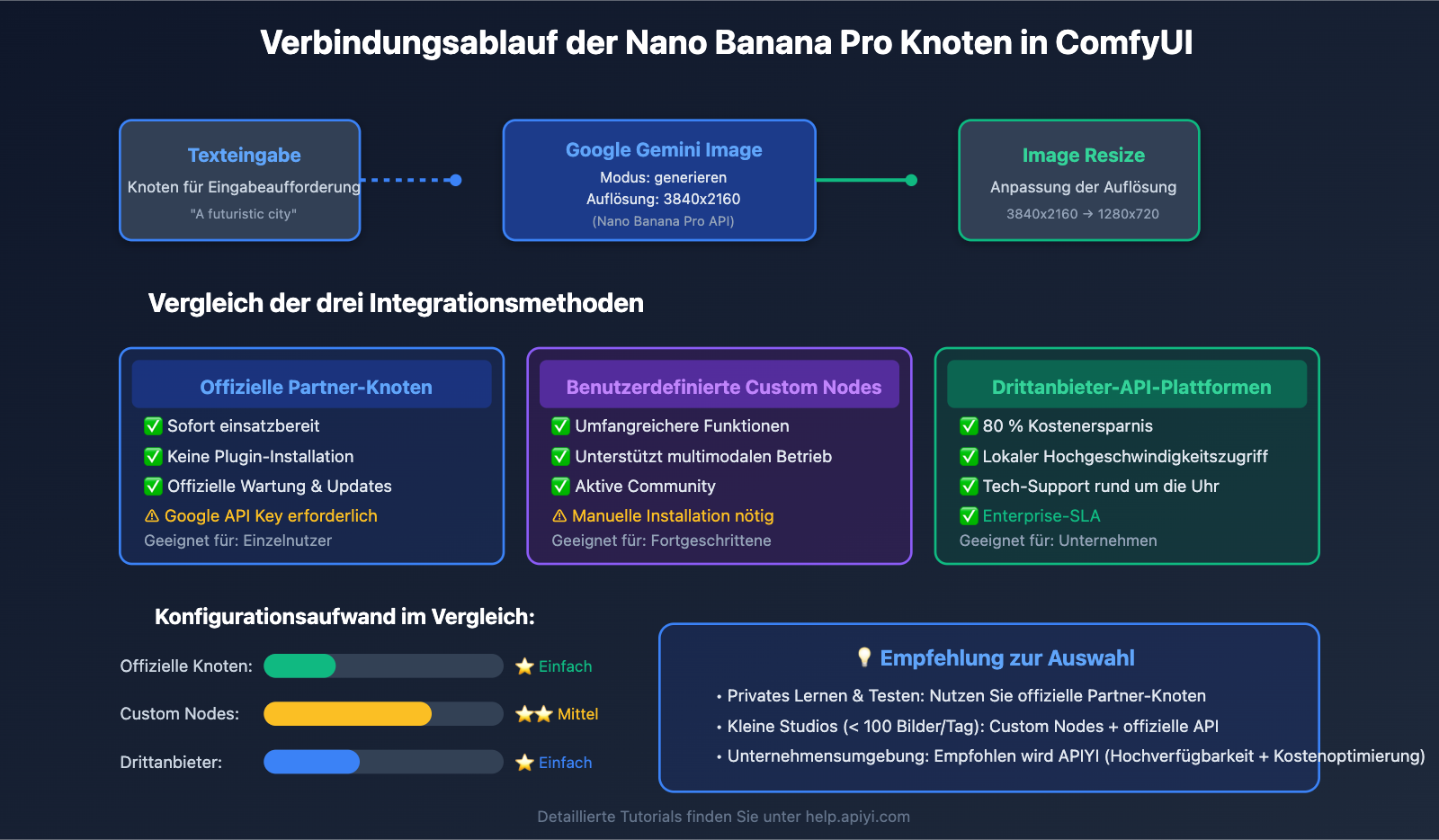

I. Drei Wege zur Einbindung der Nano Banana Pro API in ComfyUI

Nano Banana Pro ist das Flaggschiff-Bildgenerierungsmodell von Google DeepMind. Es unterstützt 4K-Auflösung, mehrsprachiges Text-Rendering und eine hohe Konsistenz der Charaktere. Basierend auf der offiziellen Dokumentation und Community-Erfahrungen gibt es drei Hauptwege für die Integration in ComfyUI:

1.1 Offizielle ComfyUI Partner Nodes (Empfohlen für Einsteiger)

Dies ist die einfachste Methode, da keine zusätzlichen Plugins installiert werden müssen. ComfyUI hat Nano Banana Pro bereits als nativen API-Knoten integriert.

Schritte:

# Schritt 1: ComfyUI auf die Nightly-Version aktualisieren

cd ComfyUI

git pull origin main

python main.py

# Schritt 2: In der ComfyUI-Benutzeroberfläche

# 1. Doppelklick auf eine leere Stelle im Workspace

# 2. Nach dem Knoten "Google Gemini Image" suchen

# 3. Den Knoten in den Workflow ziehen

Knoten-Parameter:

| Parameter | Erforderlich | Beschreibung | Beispielwert |

|---|---|---|---|

api_key |

✅ | Google AI Studio API-Schlüssel | AIzaSyC... |

prompt |

✅ | Text-Eingabeaufforderung | "A futuristic city at sunset" |

mode |

✅ | Generierungsmodus | generate / edit / style_transfer |

resolution |

❌ | Ausgabeauflösung | 1024x1024 / 1280x720 |

aspect_ratio |

❌ | Seitenverhältnis | 16:9 / 4:3 / 1:1 |

Vorteile: Sofort einsatzbereit, keine Server- oder Proxy-Konfiguration nötig.

Einschränkungen: Erfordert einen Google AI Studio API-Schlüssel; in manchen Regionen ist der Zugriff eingeschränkt.

🎯 Konfigurationsempfehlung: Für Einzelnutzer und kleine Tests empfehlen wir die offiziellen Partner Nodes. Für stabilere Dienste auf Enterprise-Niveau können hochverfügbare API-Schnittstellen über die Plattform APIYI (apiyi.com) bezogen werden. Diese verwendet das native Google-Format, sodass kein Code geändert werden muss, bei gleichzeitiger Kostenreduzierung um 80 %.

1.2 Custom Nodes (Für fortgeschrittene Nutzer)

Die GitHub-Community bietet Open-Source-Custom-Nodes für "ComfyUI-NanoBanano" an, die mehr erweiterte Funktionen unterstützen.

Installationsschritte:

# In das Verzeichnis für Custom Nodes wechseln

cd ComfyUI/custom_nodes

# Repository klonen

git clone https://github.com/ShmuelRonen/ComfyUI-NanoBanano.git

# Abhängigkeiten installieren

cd ComfyUI-NanoBanano

pip install -r requirements.txt

# ComfyUI neu starten

Unterstützte Modi:

| Modus | Funktionsbeschreibung | Anwendungsszenario |

|---|---|---|

generate |

Text-zu-Bild | Komplette Neuerstellung von Bildern |

edit |

Bildbearbeitung | Lokale Änderungen an bestehenden Bildern |

style_transfer |

Stilübertragung | Stil eines Bildes auf ein anderes anwenden |

object_insertion |

Objekt einfügen | Präzises Einfügen neuer Elemente in ein Bild |

Vorteile: Größerer Funktionsumfang, unterstützt multimodale Operationen.

Einschränkungen: Manuelle Wartung und Updates der Plugins erforderlich.

1.3 Drittanbieter-API-Plattformen (Enterprise-Lösung)

Für Unternehmenskunden, die hohe Parallelität, niedrige Latenz und Kostenoptimierung benötigen, bieten Drittanbieter-Plattformen die beste Lösung.

Kernvorteile im Vergleich:

| Dimension | Google Offizielle API | Drittanbieter (z. B. APIYI) |

|---|---|---|

| API-Format | Google AI Studio nativ | Kompatibel mit nativem Google-Format |

| Code-Migration | Keine Änderung nötig | Nur zwei Parameter anpassen |

| Kosten | Standardpreis | Ca. 80 % günstiger |

| Verfügbarkeit | Abhängig von Google-Servern | Hochgeschwindigkeitszugriff, 99,9 % SLA |

| Technischer Support | Community-Support | 24/7 Experten-Team |

Konfigurationsbeispiel (am Beispiel von APIYI):

# Ursprüngliche Google-Konfiguration

api_endpoint = "https://generativelanguage.googleapis.com/v1beta/models/gemini-2.0-flash-exp:generateImage"

api_key = "IHR_GOOGLE_API_SCHLÜSSEL"

# Wechsel zur APIYI-Plattform (nur diese zwei Zeilen ändern)

api_endpoint = "https://api.apiyi.com/v1/models/gemini-2.0-flash-exp:generateImage"

api_key = "IHR_APIYI_API_SCHLÜSSEL" # Erhältlich unter apiyi.com

🎯 Empfehlung für Unternehmen: Wenn Ihr Team Bildgenerierungsaufgaben in ComfyUI massenhaft verarbeiten muss, empfehlen wir den Zugriff auf die Nano Banana Pro API über APIYI (apiyi.com). Die Plattform bietet dedizierte Beschleunigungskanäle und ein Pay-as-you-go-Modell, das sich ideal für Produktionsumgebungen mit mehr als 1.000 generierten Bildern pro Tag eignet.

2. Sora-2 Videomodell-Integration in ComfyUI: Machbarkeitsanalyse und Konfigurationslösungen

Auf die Kernfrage des Kunden "Is it possible to use this video model in comfyUI?" lautet die Antwort: Ja, aber die Einbindung muss über API-Nodes erfolgen.

2.1 Technische Grundlagen der Sora-2 Integration in ComfyUI

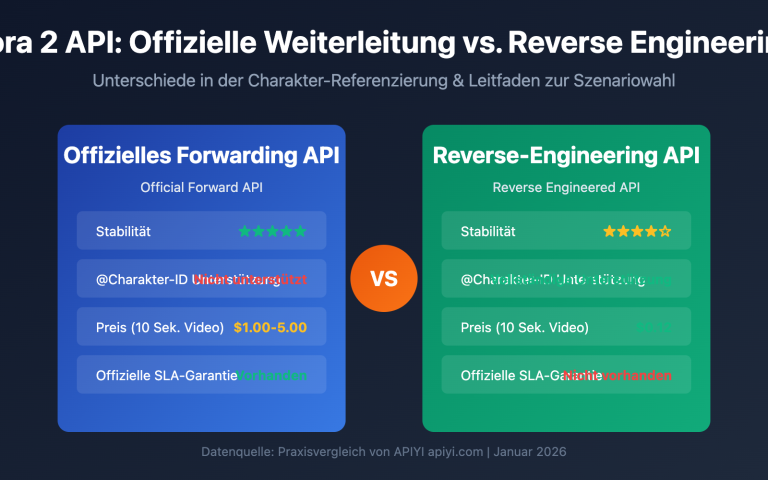

Sora-2 ist das Videogenerationsmodell der zweiten Generation von OpenAI. Im Gegensatz zu Bildmodellen kann Sora-2 nicht lokal bereitgestellt werden, wie man es von Stable Diffusion kennt. Die Einbindung in ComfyUI muss über einen der folgenden zwei Wege erfolgen:

| Integrationsmethode | Technische Umsetzung | Ressourcenbedarf | Machbarkeit |

|---|---|---|---|

| Lokales Laden des Modells | Download der Weights auf den lokalen Rechner | GPU-VRAM > 80GB | ❌ Nicht machbar (OpenAI ist nicht Open-Source) |

| API-Node-Aufruf | Aufruf der Remote-API via HTTP-Request | Nur Internetverbindung und API-Key erforderlich | ✅ Machbar (offiziell empfohlen) |

| Open-Source-Alternativen | Nutzung von Modellen wie Open-Sora | GPU-VRAM ≥ 16GB | ✅ Machbar (eingeschränkter Funktionsumfang) |

Fazit: Sora-2 muss über API-Nodes in ComfyUI eingebunden werden; eine lokale Modellbereitstellung wird nicht unterstützt.

2.2 Offizielle Konfigurationsanleitung für Sora-2 API-Nodes

Das ComfyUI-Team hat bereits offizielle Sora-2 Partner-Nodes veröffentlicht, die sowohl Text-to-Video als auch Image-to-Video unterstützen.

Installationsschritte:

# Schritt 1: Sicherstellen, dass die ComfyUI-Version ≥ v0.2.6 ist

cd ComfyUI

git pull origin main

# Schritt 2: Sora-2 Node zum Workflow hinzufügen

# 1. Doppelklick auf die leere Arbeitsfläche

# 2. Suche nach "OpenAI Sora" oder "Sora-2-i2v"

# 3. Input-Nodes verbinden (Eingabeaufforderung oder Referenzbild)

Parameterkonfiguration für Sora-2 Pro Nodes:

| Parametername | Datentyp | Beschreibung | Empfohlener Wert |

|---|---|---|---|

prompt |

String | Eingabeaufforderung zur Videobeschreibung | "A drone shot of a coastal city" |

resolution |

Enum | Videoauflösung | 1280x720 / 720x1280 |

duration |

Integer | Videodauer (Sekunden) | 5-20 Sekunden |

input_image |

Image | Referenzbild (i2v-Modus) | Muss exakt der Auflösung entsprechen |

api_key |

String | OpenAI API-Key | sk-proj-... |

Wichtige Hinweise:

- ⚠️ Auflösungsanpassung: Im Image-to-Video-Modus muss das Eingabebild exakt mit der gewählten Videoauflösung übereinstimmen, sonst tritt ein Fehler auf.

- ⚠️ Kostenkontrolle: Sora-2 Pro wird pro Sekunde abgerechnet; ein 20-sekündiges Video kostet etwa 0,50 bis 1,00 USD.

- ⚠️ API-Kontingente: OpenAI beschränkt die täglichen Aufrufe für neue Konten; eine Erhöhung des Limits sollte frühzeitig beantragt werden.

2.3 Sora-2 API-Nodes von Drittanbietern (Siray-Lösung)

Neben den offiziellen Nodes bietet die Community erweiterte Versionen wie die "Sora-2 Custom Nodes" an.

Eigenschaften der Siray OpenAI Sora-2-i2v Nodes:

# Siray Custom Nodes installieren

cd ComfyUI/custom_nodes

git clone https://github.com/siray-comfyui/openai-sora-2.git

pip install -r openai-sora-2/requirements.txt

Erweiterte Funktionen:

| Funktionsmodul | Offizielle Nodes | Siray Nodes | Erläuterung der Vorteile |

|---|---|---|---|

| Batch-Videogenerierung | ❌ | ✅ | Unterstützt automatische Warteschlangen |

| Audiosynchronisation | ❌ | ✅ | Gleichzeitige Generierung von Hintergrundmusik |

| Fortschrittsanzeige | ❌ | ✅ | Echtzeit-Anzeige des Generierungsfortschritts |

| Lokaler Cache | ❌ | ✅ | Reduziert doppelte API-Aufrufe |

🎯 Workflow-Empfehlung: Für Teams, die große Mengen an Marketingvideos erstellen müssen, empfehlen wir den Aufbau eines automatisierten Workflows durch die Kombination von ComfyUI-Preprocessing-Nodes und der Sora-2 API. Über die Plattform APIYI (apiyi.com) erhalten Sie stabilere Sora-2 API-Schnittstellen, die besonders für Massengenerierungen geeignet sind und spezielles Queue-Management sowie Kostenoptimierungspläne bieten.

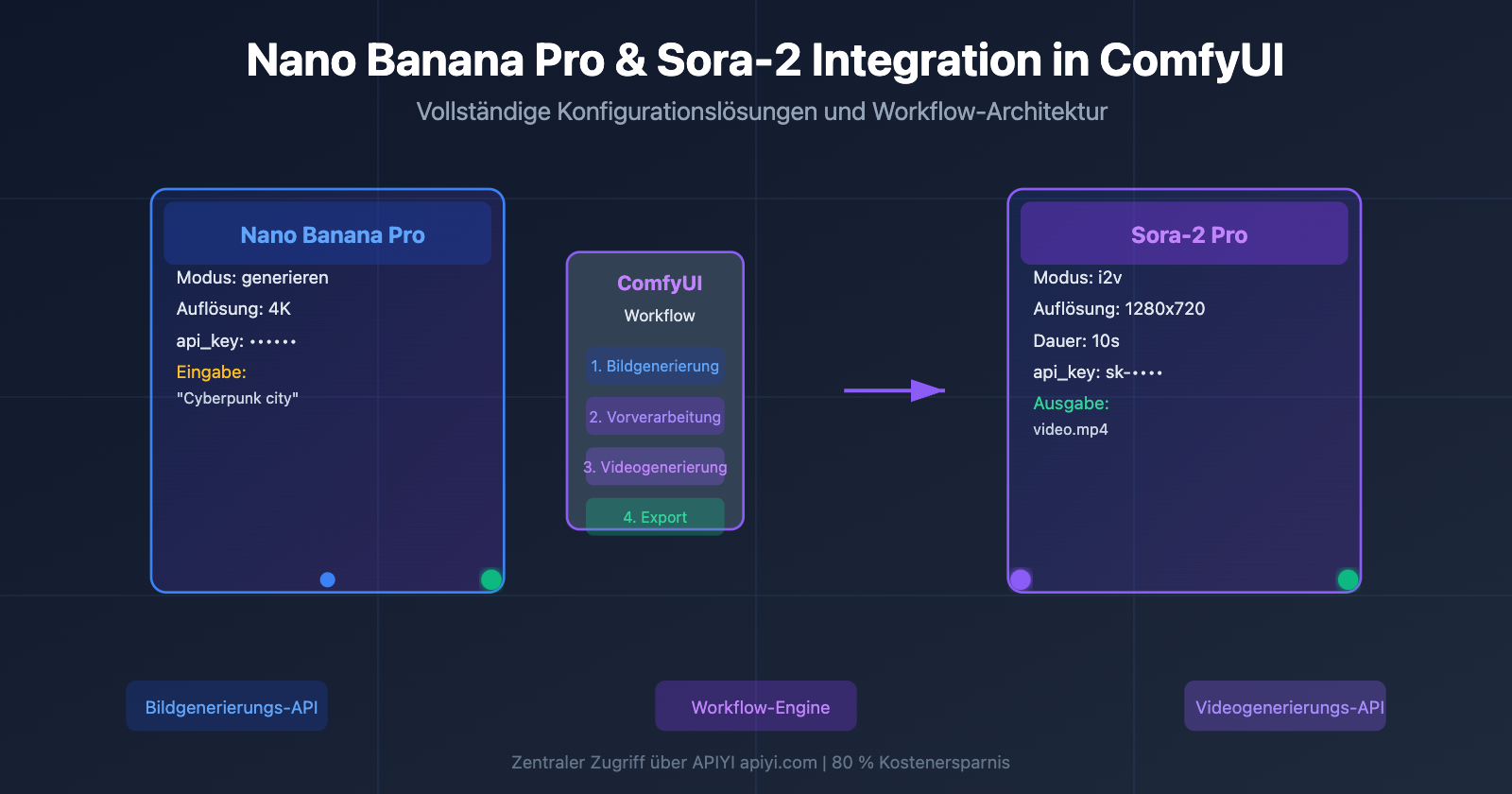

3. Best Practices für hybride Workflows mit Nano Banana Pro und Sora-2

Die Stärke von ComfyUI liegt in der Möglichkeit, mehrere KI-Modelle zu komplexen Workflows zu verketten. Hier ist ein typischer Image-to-Video Erstellungsprozess:

3.1 Design der hybriden Workflow-Architektur

Flussdiagramm:

[Text-Eingabeaufforderung]

↓

[Nano Banana Pro-Knoten] → Erzeugt hochwertiges Cover-Bild (4K)

↓

[Bild-Vorverarbeitungsknoten] → Auflösung auf 1280x720 anpassen

↓

[Sora-2 i2v-Knoten] → Wandelt Bild in 10-Sekunden-Video um

↓

[Video-Nachbearbeitungsknoten] → Übergänge und Soundeffekte hinzufügen

↓

[Endgültige Ausgabe] → MP4-Videodatei

Beispiel für Knoten-Konfiguration:

| Workflow-Phase | Verwendetes Modell | Schlüsselparameter | Verarbeitungszeit |

|---|---|---|---|

| 1. Bilderzeugung | Nano Banana Pro | resolution=3840x2160, mode=generate |

8-15 Sek. |

| 2. Auflösungsanpassung | ComfyUI intern | target_size=1280x720, resize_mode=crop |

< 1 Sek. |

| 3. Videoerzeugung | Sora-2 Pro | duration=10, motion_intensity=medium |

60-120 Sek. |

| 4. Video-Export | FFmpeg-Knoten | codec=h264, bitrate=5000k |

5-10 Sek. |

3.2 Beispiel für den tatsächlichen Workflow-Code

Minimalistische ComfyUI Workflow JSON (Kernknoten):

{

"nodes": [

{

"id": 1,

"type": "TextInput",

"properties": {

"text": "A cyberpunk city with neon lights and flying cars"

}

},

{

"id": 2,

"type": "GoogleGeminiImage",

"properties": {

"api_key": "YOUR_API_KEY",

"prompt": "@1.text",

"resolution": "3840x2160"

}

},

{

"id": 3,

"type": "ImageResize",

"properties": {

"input": "@2.output",

"target_size": "1280x720"

}

},

{

"id": 4,

"type": "OpenAISora2",

"properties": {

"api_key": "YOUR_OPENAI_KEY",

"input_image": "@3.output",

"duration": 10

}

}

]

}

Klicken, um die vollständige Workflow-Konfiguration anzuzeigen (einschließlich fortgeschrittener Parameter)

{

"version": "1.0",

"workflow_name": "Nano_Banana_to_Sora2_Video",

"nodes": [

{

"id": 1,

"type": "TextInput",

"properties": {

"text": "A cyberpunk city with neon lights and flying cars",

"negative_prompt": "blurry, low quality, distorted"

}

},

{

"id": 2,

"type": "GoogleGeminiImage",

"properties": {

"api_key": "YOUR_API_KEY",

"api_endpoint": "https://api.apiyi.com/v1/models/gemini-2.0-flash-exp:generateImage",

"prompt": "@1.text",

"negative_prompt": "@1.negative_prompt",

"resolution": "3840x2160",

"aspect_ratio": "16:9",

"guidance_scale": 7.5,

"num_inference_steps": 30

}

},

{

"id": 3,

"type": "ImageResize",

"properties": {

"input": "@2.output",

"target_size": "1280x720",

"resize_mode": "crop_center",

"interpolation": "lanczos"

}

},

{

"id": 4,

"type": "OpenAISora2Pro",

"properties": {

"api_key": "YOUR_OPENAI_KEY",

"input_image": "@3.output",

"prompt": "@1.text",

"duration": 10,

"resolution": "1280x720",

"motion_intensity": "medium",

"camera_motion": "pan_right",

"frame_rate": 30

}

},

{

"id": 5,

"type": "VideoExport",

"properties": {

"input": "@4.output",

"format": "mp4",

"codec": "h264",

"bitrate": "5000k",

"output_path": "./outputs/final_video.mp4"

}

}

],

"connections": [

{"from": 1, "to": 2, "type": "text"},

{"from": 2, "to": 3, "type": "image"},

{"from": 3, "to": 4, "type": "image"},

{"from": 4, "to": 5, "type": "video"}

]

}

🎯 Tipp zur Leistungsoptimierung: Bei der Verarbeitung von Stapelaufgaben empfiehlt es sich, die API-Aufrufe für Nano Banana Pro und Sora-2 in verschiedene Warteschlangen zu trennen. Über die Lastverteilungsfunktion der APIYI (apiyi.com) Plattform lässt sich eine parallele Verarbeitung von Bilderzeugung und Videoerzeugung realisieren, was die Effizienz des gesamten Workflows um etwa 40 % steigert.

Vier, Häufig gestellte Fragen (FAQ)

Q1: Können Nano Banana Pro und Sora-2 vollständig lokal ausgeführt werden?

Nano Banana Pro: ❌ Keine lokale Bereitstellung möglich, muss über API-Aufrufe erfolgen.

Sora-2: ❌ Keine lokale Bereitstellung möglich, OpenAI hat die Modellgewichte nicht als Open Source veröffentlicht.

Alternative: Sie können Open-Source-Modelle wie Stable Diffusion (Bild) und Open-Sora (Video) für den lokalen Betrieb verwenden.

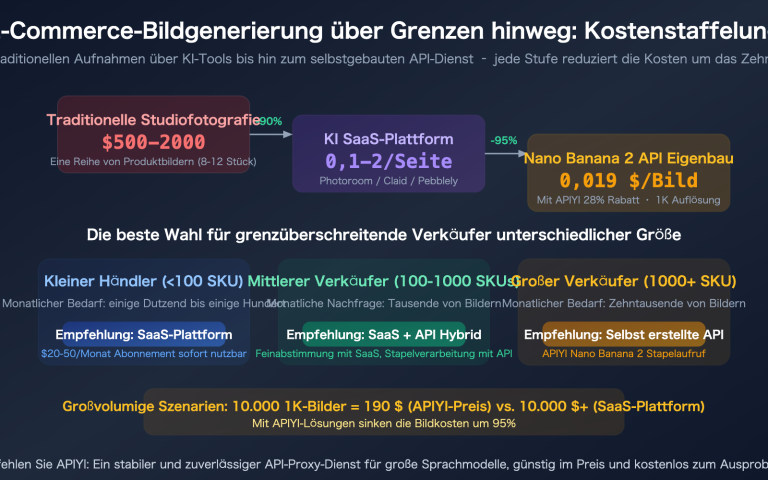

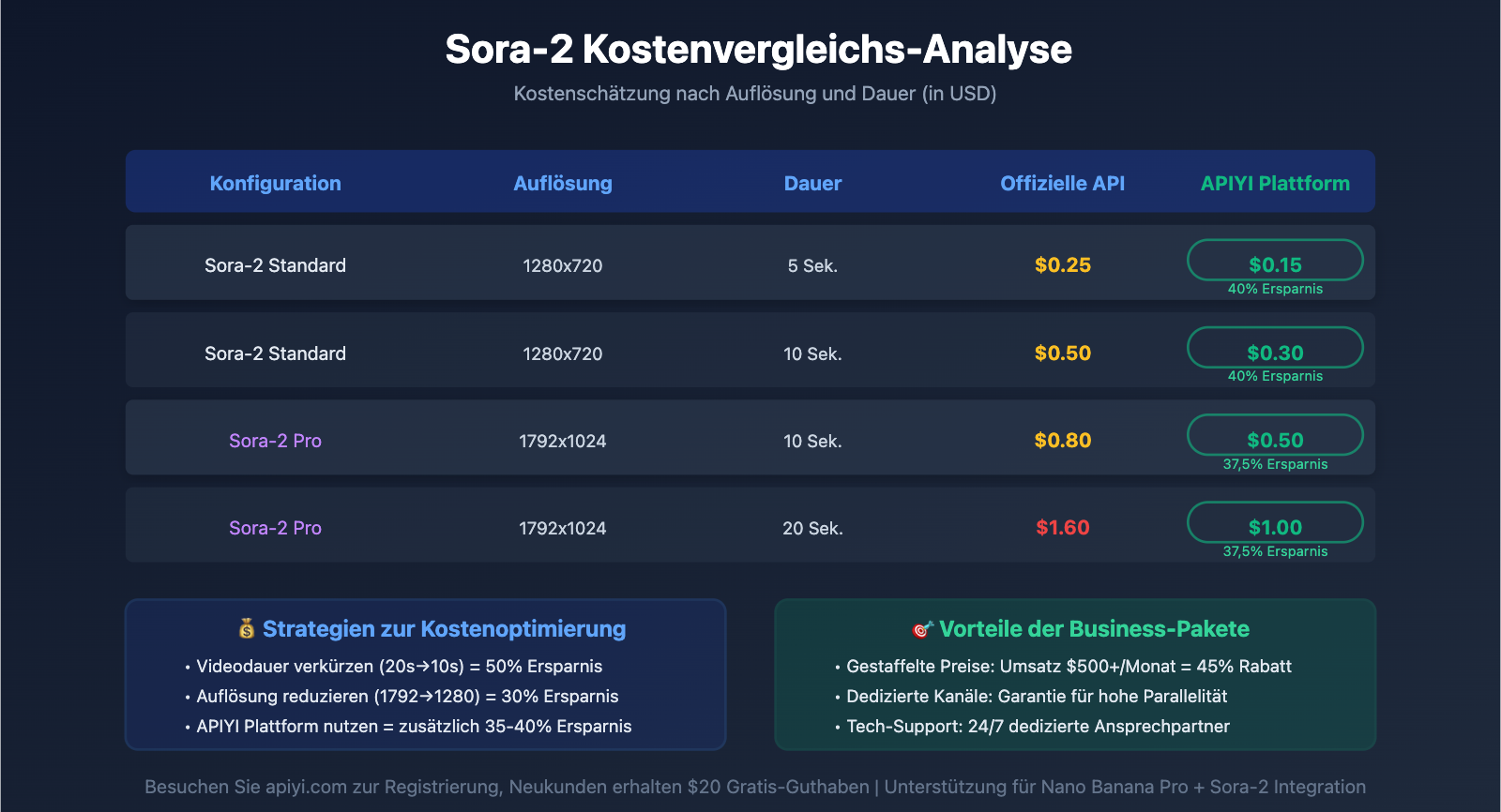

Q2: Wie lassen sich die Kosten für Sora-2 API-Aufrufe senken?

| Optimierungsstrategie | Kostensenkung | Implementierungsschwierigkeit |

|---|---|---|

| Videodauer verkürzen (10 Sek. → 5 Sek.) | 50% | ⭐ Einfach |

| Niedrige Auflösung verwenden (720p → 480p) | 30% | ⭐ Einfach |

| Stapelaufrufe für Rabatte nutzen | 15-20% | ⭐⭐ Mittel |

| Drittanbieter-API-Plattformen nutzen | 20-40% | ⭐⭐ Mittel |

🎯 Empfehlung zum Kostenmanagement: Für Nutzer mit einem monatlichen Verbrauch von über 500 USD empfehlen wir die Buchung eines Unternehmenstarifs über die APIYI (apiyi.com) Plattform. Die Plattform bietet gestaffelte Preise und Vorauszahlungsrabatte sowie eine einheitliche Abrechnungsverwaltung für Nano Banana Pro und Sora-2, was die Finanzprozesse vereinfacht.

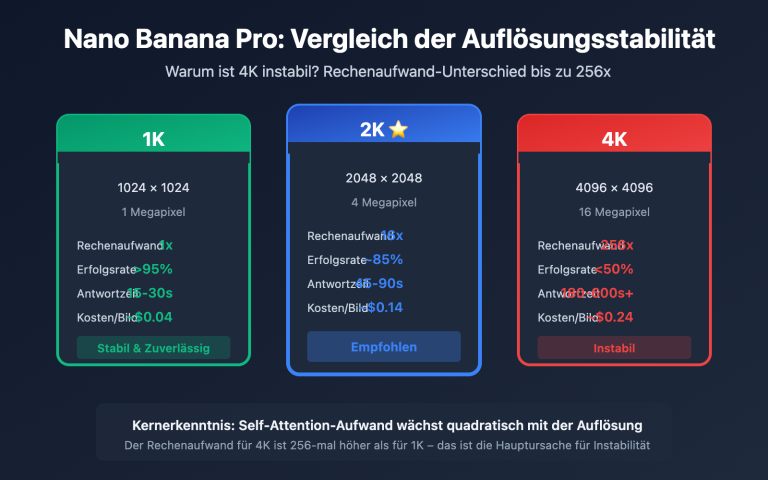

Q3: Ist die Videoauflösung von Sora-2 in ComfyUI begrenzt?

Sora-2 Standard-Version:

- ✅ Unterstützt: 720×1280, 1280×720

- ❌ Nicht unterstützt: 1080p, 4K

Sora-2 Pro-Version:

- ✅ Unterstützt: 720×1280, 1280×720, 1024×1792, 1792×1024

- ❌ Nicht unterstützt: Benutzerdefinierte Auflösungen

Lösung: Verwenden Sie die Super-Resolution-Knoten von ComfyUI (wie ESRGAN), um 720p-Videos auf 1080p oder 4K hochzuskalieren.

Q4: Wie wird das von Nano Banana Pro erzeugte Bild automatisch an Sora-2 weitergegeben?

Innerhalb des ComfyUI-Workflows müssen Sie auf folgende Kernpunkte achten:

# FEHLERBEISPIEL: Eine direkte Verbindung führt zu Auflösungskonflikten

[Nano Banana Pro] → [Sora-2 i2v] # ❌ Kann Fehlermeldungen verursachen

# RICHTIGES BEISPIEL: Zwischenschalten eines Knotens zur Auflösungskonvertierung

[Nano Banana Pro] → [Image Resize] → [Sora-2 i2v] # ✅ Empfohlen

Tabelle zur Auflösungsanpassung:

| Nano Banana Pro Ausgabe | Anpassung erforderlich | Sora-2 Eingangsanforderung |

|---|---|---|

| 3840×2160 (4K) | ✅ Resize | 1280×720 |

| 1920×1080 (1080p) | ✅ Crop+Resize | 1280×720 |

| 1280×720 (720p) | ❌ Direkt verwendbar | 1280×720 |

Q5: Welche ComfyUI-Versionen unterstützen diese neuen Modelle?

| Modell | Mindestversion ComfyUI | Empfohlene Version | Bezugsquelle |

|---|---|---|---|

| Nano Banana Pro (Offizieller Knoten) | v0.2.3 | v0.2.7+ (nightly) | git pull origin main |

| Sora-2 (Offizieller Knoten) | v0.2.6 | v0.2.8+ (nightly) | Wie oben |

| Benutzerdefinierte Knoten | Keine Einschränkung | Neueste Stable-Version | Manuelle Plugin-Installation |

5. Fazit und Empfehlungen zur Auswahl

5.1 Rückblick auf die Kernfragen

F: Was ist die einfachste Konfiguration, um die Nano Banana Pro API in ComfyUI einzubinden?

A: Verwenden Sie die offiziellen Partner Nodes. Es sind nur drei Schritte nötig:

- Aktualisieren Sie ComfyUI auf die Nightly-Version.

- Suchen und fügen Sie den Node „Google Gemini Image“ hinzu.

- Geben Sie Ihren API-Key und die Eingabeaufforderung ein – fertig.

F: Kann das Sora-2 Videomodell in ComfyUI eingebunden werden?

A: Ja, aber dies muss über API-Nodes erfolgen; eine lokale Modellbereitstellung wird nicht unterstützt. Sowohl offizielle als auch Drittanbieter stellen bereits fertige Sora-2 Custom Nodes bereit.

5.2 Empfehlungen für verschiedene Szenarien

| Anwendungsszenario | Empfohlene Lösung | Begründung |

|---|---|---|

| Persönliches Lernen & Testen | Offizielle Partner Nodes | Kostenloses Kontingent, einfache Konfiguration |

| Kleine Studios (<100 Bilder/Tag) | Custom Nodes + Offizielle API | Umfangreiche Funktionen, kontrollierbare Kosten |

| Unternehmens-Produktionsumgebungen | Drittanbieter-API-Plattformen (z. B. APIYI) | Hohe Verfügbarkeit, Kostenoptimierung, technischer Support |

| Offline-Bereitstellung / Private Cloud | Open-Source-Alternativen (Stable Diffusion + Open-Sora) | Datensicherheit, keine Netzwerkabhängigkeit |

🎯 Abschließende Empfehlung: Für Nutzer, die sowohl Nano Banana Pro als auch Sora-2 verwenden möchten, empfehlen wir die zentrale Verwaltung der API-Aufrufe über die Plattform APIYI (apiyi.com). Die Plattform ermöglicht den Zugriff auf beide Modelle mit nur einem API-Key, vereinfacht das Key-Management und bietet ein einheitliches Monitoring-Dashboard sowie Tools zur Kostenanalyse. Besuchen Sie apiyi.com, um ein Konto zu registrieren – Neukunden erhalten ein kostenloses Guthaben im Wert von 20 $, um ihre Workflows zu testen.

5.3 Weitere Lernressourcen

Offizielle Dokumentation:

- ComfyUI Offizielle Dokumentation: docs.comfy.org/tutorials/partner-nodes

- Nano Banana Pro API Referenz: ai.google.dev/gemini-api

- Sora-2 API Dokumentation: platform.openai.com/docs/guides/sora

Community-Ressourcen:

- ComfyUI Workflow-Sharing: comfyui.org/workflows

- GitHub Sammlung von Custom Nodes: github.com/ComfyUI-Workflow/awesome-comfyui

Video-Tutorials:

- „ComfyUI Nano Banana Pro – Komplettes Tutorial“ – YouTube

- „Sora-2 API Nodes Praxis-Demo“ – Bilibili

Durch die detaillierten Erläuterungen in diesem Artikel haben Sie nun das nötige Wissen erworben, um Nano Banana Pro und Sora-2 in ComfyUI zu integrieren. Egal, ob Sie sich für die Einfachheit der offiziellen Nodes, die Flexibilität von Custom Nodes oder die Enterprise-Services von Drittanbietern entscheiden – Sie können die Lösung wählen, die am besten zu Ihren Anforderungen passt.

Öffnen Sie jetzt ComfyUI und starten Sie Ihre kreative Reise mit KI!

Leseempfehlungen:

- „ComfyUI Leitfaden für Fortgeschrittene: Erstellung automatisierter Workflows zur Videogenerierung“

- „Nano Banana Pro vs. Midjourney: Vergleich von Bildgenerierungsmodellen auf Unternehmensebene“

- „Sora-2 API Kostenoptimierungsstrategien: So senken Sie die Kosten für die Videogenerierung um 70 %“