Das Hochladen von Zehntausenden von Excel-Zeilen in ein AI-Tool führt oft zu einer Fehlermeldung wie „Guthaben unzureichend“ – obwohl das Konto eigentlich gedeckt ist. Dies ist ein häufiges Problem beim Verarbeiten großer Excel-Datenmengen mit AI und liegt an der doppelten Einschränkung durch den Token-Vorabzug und das begrenzte Kontextfenster.

Kernwert: Nach dem Lesen dieses Artikels werden Sie genau verstehen, warum große Excel-Dateien Fehler verursachen, wie man Zehntausende von Datenzeilen korrekt mit AI analysiert und welche Lösung am kostengünstigsten und effizientesten ist.

<!-- Error response bubble -->

<rect x="0" y="58" width="256" height="84" rx="9" fill="#2d0808" stroke="#ef4444" stroke-width="1.5"/>

<text x="128" y="80" font-family="'PingFang SC',sans-serif" font-size="13" font-weight="bold" fill="#ef4444" text-anchor="middle">❌ Fehler 402Fehler: Guthaben unzureichend</text>

<text x="128" y="100" font-family="monospace" font-size="10" fill="#fca5a5" text-anchor="middle">Unzureichendes GuthabenError Code: INSUFFICIENT_FUNDS</text>

<text x="128" y="116" font-family="'PingFang SC',sans-serif" font-size="10" fill="#fca5a5" text-anchor="middle">Guthaben unzureichend, bitte nach dem Aufladen erneut versuchenIhr Kontoguthaben reicht für diese Anfrage nicht aus.</text>

<text x="128" y="132" font-family="'PingFang SC',sans-serif" font-size="9" fill="#94a3b8" text-anchor="middle">(Einbehalten $9,00 · Guthaben $5,20)(oder Kontextfenster-Limit überschritten)</text>

<!-- AI avatar -->

<circle cx="268" cy="100" r="10" fill="#991b1b"/>

<text x="268" y="105" font-family="sans-serif" font-size="11" fill="#fecaca" text-anchor="middle">🤖AI</text>

<!-- Confused user thought -->

<rect x="40" y="158" width="218" height="50" rx="9" fill="#0f2028"/>

<text x="149" y="178" font-family="'PingFang SC',sans-serif" font-size="10" fill="#7dd3fc" text-anchor="middle">😕 Aber ich habe doch Guthaben auf meinem Konto!Seltsam, ich habe doch noch Guthaben auf meinem Konto?</text>

<text x="149" y="196" font-family="'PingFang SC',sans-serif" font-size="10" fill="#7dd3fc" text-anchor="middle">Warum steht da, dass das Guthaben nicht ausreicht?Warum dieser Fehler?</text>

<circle cx="28" cy="183" r="10" fill="#1d4ed8"/>

<text x="28" y="188" font-family="sans-serif" font-size="11" fill="#ffffff" text-anchor="middle">👤Benutzer</text>

Warum führt das Hochladen großer Excel-Dateien zu einer „unzureichenden Deckung“?

Viele Nutzer sind verwirrt, wenn sie zum ersten Mal auf dieses Problem stoßen: Das Kontoguthaben ist offensichtlich ausreichend, warum gibt die Schnittstelle trotzdem einen Fehler wegen unzureichender Deckung zurück?

Hier ist es wichtig, einen Schlüsselmechanismus der AI-API zu verstehen: den Token-Vorauszahlungsmechanismus.

Detaillierte Erklärung des Token-Vorauszahlungsmechanismus

Wenn Sie in AI-Clients wie Cherry Studio oder Chatbox eine Datei hochladen und eine Anfrage senden, wartet die API-Schnittstelle nicht, bis die Antwort generiert ist, bevor sie die Gebühren abzieht. Im Moment des Absendens der Anfrage schätzt sie im Voraus die maximale Anzahl der Tokens, die diese Anfrage voraussichtlich verbrauchen wird, und „friert“ (zieht im Voraus ab) den entsprechenden Betrag vorübergehend vom Kontoguthaben ein.

Dieser Vorauszahlungsprozess läuft grob wie folgt ab:

- Benutzer lädt Excel-Datei hoch → Client konvertiert den Dateiinhalt in reinen Text

- Der reine Text wird vollständig in die Eingabeaufforderung (Dialog-Kontext) eingefügt

- Die API berechnet die Anzahl der Eingabe-Tokens + schätzt die maximale Anzahl der Ausgabe-Tokens

- Systemprüfung: Vorauszahlungsbetrag > Kontoguthaben → Rückgabe des Fehlers „unzureichende Deckung“

Im Wesentlichen liegt es also nicht daran, dass Sie „kein Geld“ haben, sondern daran, dass der vorauszahlbare Betrag dieser Anfrage zu hoch ist und Ihr aktuelles Kontoguthaben übersteigt.

Grundlegende Unterschiede zwischen AI-Clients und ChatGPT

Viele Leute haben das Missverständnis, dass das Hochladen einer Excel-Datei in Cherry Studio dasselbe ist wie das Hochladen einer Datei in ChatGPT.

Tatsächlich ist es völlig anders:

| Vergleichskriterium | Cherry Studio / Chatbox | ChatGPT (Code Interpreter) |

|---|---|---|

| Dateiverarbeitung | Umwandlung in Text, vollständig in den Kontext eingefügt | Codeausführung in einer Sandbox-Umgebung zur Verarbeitung |

| Token-Verbrauch | Dateigröße entspricht direkt dem Token-Verbrauch | Belegt keine Dialog-Kontext-Tokens |

| Geeignete Dateigröße | Empfohlen bis zu 100 Zeilen | Unterstützt größere Dateien (offizielles Limit ca. 512 MB) |

| Datenanalysefähigkeit | Nur Textverständnis, keine Codeausführung möglich | Kann Python direkt zur Statistik ausführen |

| API-Zugriffsmethode | Aufruf über API-Schlüssel, Abrechnung nach Token | ChatGPT Plus Abonnementmodell |

🎯 Wichtige Erkenntnis: Bei der Verwendung eines API-Proxy-Dienstes (wie APIYI apiyi.com) zum Aufrufen von AI erfolgt der Dateiupload über einen Drittanbieter-Client. Alle Dateiinhalte werden in Text-Tokens umgewandelt und an das Modell übermittelt. Dies unterscheidet sich grundlegend vom offiziellen Dateiverarbeitungs-Sandbox-Mechanismus von ChatGPT.

Wie viele Tokens verbraucht eine große Excel-Datei wirklich?

Bevor wir Lösungen diskutieren, verschaffen wir uns ein intuitives Verständnis des Token-Verbrauchs.

Grundlagen der Token-Umrechnung

| Inhaltstyp | Token-Schätzung |

|---|---|

| 1 englisches Wort | ca. 1-2 Tokens |

| 1 englisches Zeichen | ca. 0,25 Tokens (4 Zeichen = 1 Token) |

| 1 chinesisches Schriftzeichen | ca. 1-2 Tokens |

| 1 Datum (z.B. 2024-01-15) | ca. 5 Tokens |

| 1 Zahl (z.B. 12345.67) | ca. 3-4 Tokens |

| 1 Zeile Excel-Daten (10 Spalten) | ca. 30-80 Tokens |

Berechnung anhand eines praktischen Beispiels

Nehmen wir ein reales Szenario, das ein Benutzer erlebt hat:

Datei A: 60.000 Zeilen × 10 Spalten Prozess-Effizienzdaten

Schätzung: 60.000 Zeilen × 10 Spalten × durchschnittlich 5 Tokens/Zelle

= 60.000 × 50

= 3.000.000 Tokens (ca. 3 Millionen Tokens!)

Datei B: 40.000 Zeilen × 8 Spalten Geschäftsdaten

Schätzung: 40.000 Zeilen × 8 Spalten × durchschnittlich 5 Tokens/Zelle

= 40.000 × 40

= 1.600.000 Tokens (ca. 1,6 Millionen Tokens)

Kontextfenster und Kosten der verschiedenen Modelle im Vergleich

| Modell | Kontextfenster | Eingabepreis ($/1M Tokens) | Kosten für die Verarbeitung von 3 Millionen Tokens |

|---|---|---|---|

| GPT-4o | 128K Tokens | $2.50 | Kann nicht verarbeitet werden (Limit überschritten) |

| Claude 3.5 Sonnet | 200K Tokens | $3.00 | Kann nicht verarbeitet werden (Limit überschritten) |

| Gemini 1.5 Pro | 1M Tokens | $1.25 | Kann nicht verarbeitet werden (Limit überschritten) |

| Gemini 1.5 Pro 2.0 | 2M Tokens | $1.25 | ca. $3.75/Anfrage |

💡 Es ist ersichtlich, dass die Kontextfenster der meisten Modelle 60.000 Zeilen Excel-Daten überhaupt nicht aufnehmen können. Selbst wenn man ein Gemini-Modell mit 2M Kontextfenster verwendet, kostet jede Anfrage etwa 3,75 US-Dollar.

4 richtige Lösungen für die AI-Verarbeitung großer Excel-Datenmengen

Nachdem wir die Grundursachen verstanden haben, stellen wir Ihnen im Folgenden 4 praxiserprobte Lösungen vor, sortiert nach Empfehlungsgrad.

<line x1="0" y1="56" x2="194" y2="56" stroke="#059669" stroke-width="1" opacity="0.5"/>

<text x="0" y="74" font-size="11" font-weight="bold" fill="#34d399">Arbeitsschritte</text>

<rect x="0" y="80" width="194" height="18" rx="4" fill="#022c22"/>

<text x="8" y="93" font-size="9.5" fill="#6ee7b7">① Extrahieren Sie 10 Zeilen Beispieldaten für die KI</text>

<rect x="0" y="102" width="194" height="18" rx="4" fill="#022c22"/>

<text x="8" y="115" font-size="9.5" fill="#6ee7b7">AI versteht die Struktur, generiert Analyse-Skripte</text>

<rect x="0" y="124" width="194" height="18" rx="4" fill="#022c22"/>

<text x="8" y="137" font-size="9.5" fill="#6ee7b7">③ Skript lokal ausführen, um die Gesamtdaten zu verarbeiten</text>

<line x1="0" y1="152" x2="194" y2="152" stroke="#059669" stroke-width="1" opacity="0.5"/>

<text x="0" y="170" font-size="11" font-weight="bold" fill="#34d399">Anwendungsbereiche</text>

<text x="0" y="186" font-size="10" fill="#a7f3d0">Datenmenge > 10.000 Zeilen</text>

<text x="0" y="200" font-size="10" fill="#a7f3d0">Statistische Analyse / Berichtserstellung</text>

<rect x="0" y="214" width="194" height="26" rx="6" fill="#065f46" stroke="#10b981" stroke-width="1.5"/>

<text x="97" y="231" font-size="11" font-weight="bold" fill="#34d399" text-anchor="middle">Token Verbrauch: < 2,000</text>

<line x1="0" y1="56" x2="194" y2="56" stroke="#3b82f6" stroke-width="1" opacity="0.5"/>

<text x="0" y="74" font-size="11" font-weight="bold" fill="#93c5fd">Vorgehensweise</text>

<rect x="0" y="80" width="194" height="18" rx="4" fill="#1e3a5f"/>

<text x="8" y="93" font-size="9.5" fill="#93c5fd">① Zeilenweise in mehrere Unterdateien aufteilen</text>

<rect x="0" y="102" width="194" height="18" rx="4" fill="#1e3a5f"/>

<text x="8" y="115" font-size="9.5" fill="#93c5fd">② Die API zyklisch aufrufen, um jede Charge zu verarbeiten</text>

<rect x="0" y="124" width="194" height="18" rx="4" fill="#1e3a5f"/>

<text x="8" y="137" font-size="9.5" fill="#93c5fd">③ Ergebnisse aller Chargen zusammenfassen</text>

<line x1="0" y1="152" x2="194" y2="152" stroke="#3b82f6" stroke-width="1" opacity="0.5"/>

<text x="0" y="170" font-size="11" font-weight="bold" fill="#93c5fd">Anwendungsfälle</text>

<text x="0" y="186" font-size="10" fill="#bfdbfe">5.000-20.000 Zeilen Daten</text>

<text x="0" y="200" font-size="10" fill="#bfdbfe">Zeilenweise Klassifizierung / Sentimentanalyse</text>

<rect x="0" y="214" width="194" height="26" rx="6" fill="#1e3a5f" stroke="#3b82f6" stroke-width="1.5"/>

<text x="97" y="231" font-size="11" font-weight="bold" fill="#93c5fd" text-anchor="middle">Gesamtkosten ca. $0.5-1.5</text>

<line x1="0" y1="56" x2="194" y2="56" stroke="#a855f7" stroke-width="1" opacity="0.5"/>

<text x="0" y="74" font-size="11" font-weight="bold" fill="#d8b4fe">Arbeitsschritte</text>

<rect x="0" y="80" width="194" height="18" rx="4" fill="#3b0764"/>

<text x="8" y="93" font-size="9.5" fill="#d8b4fe">① Excel Pivot-Tabelle zur Aggregationsstatistik</text>

<rect x="0" y="102" width="194" height="18" rx="4" fill="#3b0764"/>

<text x="8" y="115" font-size="9.5" fill="#d8b4fe">② Zusammenfassende Daten (Dutzende Zeilen) für die KI</text>

<rect x="0" y="124" width="194" height="18" rx="4" fill="#3b0764"/>

<text x="8" y="137" font-size="9.5" fill="#d8b4fe">③ KI schreibt Analyseberichte und Erkenntnisse</text>

<line x1="0" y1="152" x2="194" y2="152" stroke="#a855f7" stroke-width="1" opacity="0.5"/>

<text x="0" y="170" font-size="11" font-weight="bold" fill="#d8b4fe">Anwendungsfälle</text>

<text x="0" y="186" font-size="10" fill="#e9d5ff">Ein Gesamttrendanalysebericht wird benötigt.</text>

<text x="0" y="200" font-size="10" fill="#e9d5ff">Die Rohdaten müssen nicht zeilenweise verstanden werden.</text>

<rect x="0" y="214" width="194" height="26" rx="6" fill="#3b0764" stroke="#a855f7" stroke-width="1.5"/>

<text x="97" y="231" font-size="11" font-weight="bold" fill="#d8b4fe" text-anchor="middle">Token Verbrauch: sehr gering</text>

<line x1="0" y1="56" x2="194" y2="56" stroke="#f97316" stroke-width="1" opacity="0.5"/>

<text x="0" y="74" font-size="11" font-weight="bold" fill="#fdba74">Modellempfehlung</text>

<rect x="0" y="80" width="194" height="18" rx="4" fill="#431407"/>

<text x="8" y="93" font-size="9.5" fill="#fdba74">Gemini 2.0 Flash (1M ctx)</text>

<rect x="0" y="102" width="194" height="18" rx="4" fill="#431407"/>

<text x="8" y="115" font-size="9.5" fill="#fdba74">Gemini 1.5 Pro (1M Kontextfenster)</text>

<rect x="0" y="124" width="194" height="18" rx="4" fill="#431407"/>

<text x="8" y="137" font-size="9.5" fill="#fdba74">Claude 3.5 Sonnet (200K)</text>

<line x1="0" y1="152" x2="194" y2="152" stroke="#f97316" stroke-width="1" opacity="0.5"/>

<text x="0" y="170" font-size="11" font-weight="bold" fill="#fdba74">Anwendungsbereiche</text>

<text x="0" y="186" font-size="10" fill="#fed7aa">Datenmenge < 5000 Zeilen</text>

<text x="0" y="200" font-size="10" fill="#fed7aa">kann höhere API-Kosten tragen</text>

<rect x="0" y="214" width="194" height="26" rx="6" fill="#431407" stroke="#f97316" stroke-width="1.5"/>

<text x="97" y="231" font-size="11" font-weight="bold" fill="#fdba74" text-anchor="middle">Kosten: $1-5 / Mal</text>

Lösung A (Sehr empfehlenswert): Beispieldaten + AI Skript schreiben lassen

Kernidee: Die AI verarbeitet nicht direkt die gesamten Daten, sondern versteht die Datenstruktur und generiert dann ein Verarbeitungsskript, das lokal ausgeführt wird.

Schritte:

Schritt 1: Beispieldaten extrahieren (10 Zeilen genügen)

import pandas as pd

# Die ersten 10 Zeilen als Beispiel lesen (inkl. Header)

df_sample = pd.read_excel("your_data.xlsx", nrows=10)

# Als Textformat ausgeben, um es einfach der AI zu kopieren

print(df_sample.to_string())

print("\n--- Datenübersicht ---")

print(f"Gesamtzeilen: {len(pd.read_excel('your_data.xlsx'))}")

print(f"Spaltennamen: {list(df_sample.columns)}")

print(f"Datentypen:\n{df_sample.dtypes}")

Schritt 2: Beispieldaten und Anforderungen an die AI senden

Beispiel-Eingabeaufforderung:

Hier sind die ersten 10 Zeilen meiner Excel-Daten und eine Strukturbeschreibung:

[Ausgabe des vorherigen Schritts hier einfügen]

Die Gesamtdaten umfassen 60.000 Zeilen. Ich muss Folgendes analysieren:

1. Prozessabschlussrate nach Abteilung

2. Prozessknoten finden, deren durchschnittliche Bearbeitungszeit 2 Stunden überschreitet

3. Wöchentlichen Trendbericht erstellen

Bitte schreiben Sie mir ein Python-Skript, das die vollständigen Daten liest und die Analyseergebnisse ausgibt.

Schritt 3: Das von der AI generierte Skript lokal ausführen

Die AI versteht die Feldbedeutungen anhand Ihrer 10 Beispieldatenzeilen und generiert ein vollständiges Analyseskript. Sie führen dieses Skript lokal aus, um die gesamten 60.000 Zeilen Daten zu verarbeiten. Der gesamte Prozess erfordert keine weiteren Modellaufrufe, was zu null Token-Verbrauch führt.

Vorteile der Lösung:

- Extrem geringer Token-Verbrauch (nur 10 Beispieldatenzeilen ≈ wenige hundert Tokens)

- Lokales Skript kann wiederholt ausgeführt werden; bei Datenaktualisierung einfach neu starten

- Ideal für Szenarien, in denen regelmäßig ähnliche Daten verarbeitet werden müssen

🎯 Empfohlenes Tool: Verwenden Sie auf APIYI apiyi.com Claude 3.5 Sonnet oder GPT-4o, um Datenverarbeitungsskripte zu generieren. Diese Modelle sind hervorragend für Code-Generierungsaufgaben geeignet, und ein einzelner Aufruf verbraucht in der Regel nicht mehr als 2000 Tokens, was die Kosten extrem niedrig hält.

Lösung B: Daten stapelweise verarbeiten

Anwendungsbereich: Wenn die Datenmenge zwischen 5.000 und 20.000 Zeilen liegt und die AI jede Zeile verstehen muss (z. B. für Sentimentanalyse, Textklassifizierung).

Schritte:

import pandas as pd

def process_in_batches(file_path, batch_size=500):

"""Verarbeitet große Excel-Dateien in Batches"""

df = pd.read_excel(file_path)

total_rows = len(df)

results = []

for start in range(0, total_rows, batch_size):

end = min(start + batch_size, total_rows)

batch = df.iloc[start:end]

# Konvertiert diesen Batch von Daten in CSV-Text zur Verarbeitung durch die AI

batch_text = batch.to_csv(index=False)

print(f"Verarbeite Zeilen {start+1}-{end} (von insgesamt {total_rows} Zeilen)")

# Hier AI API aufrufen, um batch_text zu verarbeiten

# result = call_ai_api(batch_text)

# results.append(result)

return results

Jeder Batch von 500 Zeilen verbraucht etwa 25.000-40.000 Tokens. Die Gesamtkosten für die Verarbeitung von 60.000 Zeilen mit GPT-4o mini belaufen sich auf etwa 0,5-1,5 US-Dollar.

Hinweise:

- Nach jeder Batch-Verarbeitung müssen die Ergebnisse zusammengeführt werden; achten Sie auf die statistische Genauigkeit über die Batches hinweg.

- Die Stapelverarbeitung kann zeilenübergreifende Beziehungen verlieren und eignet sich daher für zeilenunabhängige Aufgaben.

Lösung C: Daten vorverarbeiten und dann hochladen

Anwendungsbereich: Wenn die AI allgemeine Trends analysieren und Analyseberichte schreiben soll, aber nicht jede einzelne Rohdatenzeile sehen muss.

Schritte:

Schritt 1: Datenzusammenfassung mit Excel-Pivot-Tabellen oder Python erstellen

import pandas as pd

df = pd.read_excel("data.xlsx")

# Generiert zusammenfassende Statistiken

summary = {

"总行数": len(df), # Gesamtzeilenanzahl

"时间范围": f"{df['日期'].min()} 至 {df['日期'].max()}", # Zeitraum

"按部门统计": df.groupby('部门')['完成率'].mean().to_dict(), # Statistik nach Abteilung

"按月趋势": df.groupby(df['日期'].dt.month)['处理时长'].mean().to_dict(), # Monatlicher Trend

"异常数据数量": len(df[df['处理时长'] > 120]) # Anzahl der Anomalien

}

# Konvertiert die Zusammenfassung in strukturierten Text zur Erstellung eines Analyseberichts durch die AI

## 4. Wie Sie vermeiden, erneut in die Falle zu tappen

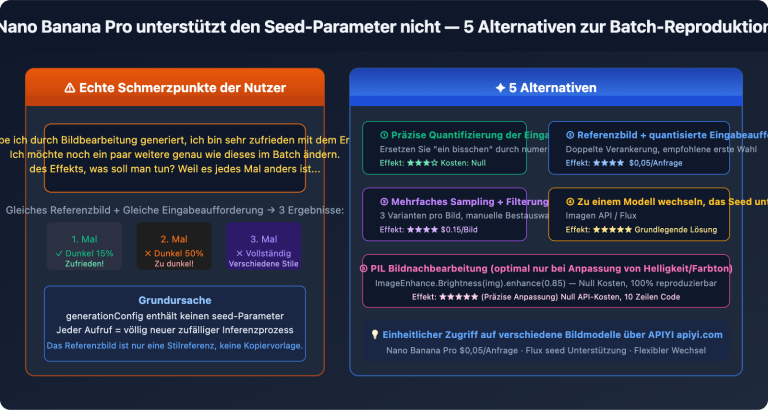

Nachdem Sie die oben genannten Lösungen verstanden haben, folgen nun einige Best Practices für den täglichen Umgang mit KI bei der Datenverarbeitung.

<svg viewBox="0 0 840 460" xmlns="http://www.w3.org/2000/svg" style="width:100%;height:auto;display:block;margin:1.5rem 0;border-radius:14px;">

<defs>

<linearGradient id="cpBg" x1="0%" y1="0%" x2="100%" y2="100%">

<stop offset="0%" stop-color="#0f172a"/>

<stop offset="100%" stop-color="#1e293b"/>

</linearGradient>

<linearGradient id="cpRedPanel" x1="0%" y1="0%" x2="100%" y2="100%">

<stop offset="0%" stop-color="#1a0505"/>

<stop offset="100%" stop-color="#2d0808"/>

</linearGradient>

<linearGradient id="cpGreenPanel" x1="0%" y1="0%" x2="100%" y2="100%">

<stop offset="0%" stop-color="#021a0d"/>

<stop offset="100%" stop-color="#022c22"/>

</linearGradient>

<linearGradient id="cpRedBar" x1="0%" y1="0%" x2="100%" y2="0%">

<stop offset="0%" stop-color="#991b1b"/>

<stop offset="100%" stop-color="#dc2626"/>

</linearGradient>

<linearGradient id="cpGreenBar" x1="0%" y1="0%" x2="100%" y2="0%">

<stop offset="0%" stop-color="#065f46"/>

<stop offset="100%" stop-color="#059669"/>

</linearGradient>

</defs>

<!-- Background -->

<rect width="840" height="460" fill="url(#cpBg)" rx="14"/>

<!-- Title -->

<text x="420" y="38" font-family="'PingFang SC','Microsoft YaHei',sans-serif" font-size="19" font-weight="bold" fill="#f1f5f9" text-anchor="middle">KI-Datenverarbeitungsszenarien: Häufige Fehler und Best Practices Direktes Hochladen großer Dateien vs. Beispieldaten + Skript: Vergleich von Wirkung und Kosten</text>

<text x="420" y="58" font-family="'PingFang SC','Microsoft YaHei',sans-serif" font-size="12" fill="#64748b" text-anchor="middle">Wie man kostspielige, ineffiziente Modellaufrufe vermeidet Vergleich der tatsächlichen Ergebnisse zweier Methoden bei der Analyse von ebenfalls 60.000 Zeilen Prozessdaten</text>

<!-- Divider line center -->

<line x1="420" y1="74" x2="420" y2="390" stroke="#334155" stroke-width="1.5" stroke-dasharray="6,4"/>

<rect x="398" y="204" width="44" height="24" rx="6" fill="#1e293b" stroke="#475569" stroke-width="1"/>

<text x="420" y="220" font-family="sans-serif" font-size="11" font-weight="bold" fill="#64748b" text-anchor="middle">Vergleich VS</text>

<!-- ===== LEFT: Wrong approach ===== -->

<rect x="16" y="74" width="388" height="316" rx="10" fill="url(#cpRedPanel)" stroke="#ef4444" stroke-width="1.5"/>

<!-- Header -->

<rect x="16" y="74" width="388" height="44" rx="10" fill="#7f1d1d"/>

<rect x="16" y="104" width="388" height="14" fill="#7f1d1d"/>

<text x="210" y="94" font-family="'PingFang SC',sans-serif" font-size="14" font-weight="bold" fill="#fecaca" text-anchor="middle">❌ Falscher Ansatz: Direkter Upload aller Daten ❌ Falsche Vorgehensweise: Direkter Upload der gesamten Excel-Datei</text>

<text x="210" y="111" font-family="'PingFang SC',sans-serif" font-size="10" fill="#fca5a5" text-anchor="middle">Hohe Kosten, geringe Effizienz, ungenaue Ergebnisse Cherry Studio / Chatbox direkt 60.000 Zeilen Daten hochladen</text>

<!-- Wrong steps flow -->

<g transform="translate(28, 128)" font-family="'PingFang SC',sans-serif">

<!-- Step 1 -->

<rect x="0" y="0" width="364" height="38" rx="7" fill="#2d1414" stroke="#ef4444" stroke-width="1"/>

<text x="22" y="14" font-size="11" font-weight="bold" fill="#fca5a5">Schritt 1: Daten vorbereiten 📂 Hochladen process_data.xlsx (60.000 Zeilen, 8 MB)</text>

<text x="22" y="30" font-size="10" fill="#ef4444">Alle Daten (z.B. 100MB Excel) in Text umwandeln Alle Dateiinhalte in Klartext umwandeln → in die Eingabeaufforderung einfügen</text>

<!-- Arrow -->

<line x1="182" y1="38" x2="182" y2="52" stroke="#ef4444" stroke-width="1.5" stroke-dasharray="4,3"/>

<polygon points="176,50 188,50 182,56" fill="#ef4444"/>

<!-- Step 2 -->

<rect x="0" y="56" width="364" height="38" rx="7" fill="#2d1414" stroke="#ef4444" stroke-width="1"/>

<text x="22" y="70" font-size="11" font-weight="bold" fill="#fca5a5">Schritt 2: Daten hochladen 📊 Token-Anzahl explodiert: ≈ 3 Millionen Tokens</text>

<text x="22" y="86" font-size="10" fill="#ef4444">Alle Textdaten auf einmal in das KI-Modell hochladen 60.000 Zeilen × 10 Spalten × 5 Tokens ≈ 3.000.000 Tokens</text>

<!-- Arrow -->

<line x1="182" y1="94" x2="182" y2="108" stroke="#ef4444" stroke-width="1.5" stroke-dasharray="4,3"/>

<polygon points="176,106 188,106 182,112" fill="#ef4444"/>

<!-- Step 3 -->

<rect x="0" y="112" width="364" height="38" rx="7" fill="#3d0808" stroke="#dc2626" stroke-width="2"/>

<text x="22" y="126" font-size="12" font-weight="bold" fill="#ff6b6b">Schritt 3: KI-Analyse abwarten 💥 API-Fehler 402: Guthaben unzureichend</text>

<text x="22" y="142" font-size="10" fill="#fca5a5">Modell verarbeitet große Datenmengen, langsame Reaktion, fehleranfällig Vorgemerkt $9,00 > Kontostand $5,20 → Anfrage fehlgeschlagen</text>

<!-- Problem stats -->

<rect x="0" y="162" width="174" height="54" rx="7" fill="#1a0505" stroke="#ef4444" stroke-width="1"/>

<text x="87" y="180" font-size="10" fill="#fca5a5" text-anchor="middle">Fehlerrate Token-Verbrauch</text>

<text x="87" y="202" font-size="22" font-weight="bold" fill="#ef4444" text-anchor="middle">Hoch 3 Millionen</text>

<rect x="186" y="162" width="178" height="54" rx="7" fill="#1a0505" stroke="#ef4444" stroke-width="1"/>

<text x="275" y="180" font-size="10" fill="#fca5a5" text-anchor="middle">Antwortzeit Analyseergebnis</text>

<text x="275" y="202" font-size="18" font-weight="bold" fill="#ef4444" text-anchor="middle">Mehrere Minuten ❌ Kann nicht abgeschlossen werden</text>

<!-- Cost label -->

<rect x="0" y="228" width="364" height="28" rx="6" fill="#2d0808" stroke="#dc2626" stroke-width="1.5"/>

<text x="182" y="246" font-size="12" font-weight="bold" fill="#ff6b6b" text-anchor="middle">Gesamtkosten: Sehr hoch Geschätzte Kosten: $7.5+ · und überschreitet die Kontextfenster-Obergrenze</text>

</g>

<!-- ===== RIGHT: Correct approach ===== -->

<rect x="436" y="74" width="388" height="316" rx="10" fill="url(#cpGreenPanel)" stroke="#10b981" stroke-width="1.5"/>

<!-- Header -->

<rect x="436" y="74" width="388" height="44" rx="10" fill="#065f46"/>

<rect x="436" y="104" width="388" height="14" fill="#065f46"/>

<text x="630" y="94" font-family="'PingFang SC',sans-serif" font-size="14" font-weight="bold" fill="#d1fae5" text-anchor="middle">✅ Best Practice: Stichprobe + Skript, Stapelverarbeitung ✅ Richtige Vorgehensweise: Beispieldaten + AI schreibt Skripte</text>

<text x="630" y="111" font-family="'PingFang SC',sans-serif" font-size="10" fill="#6ee7b7" text-anchor="middle">Niedrige Kosten, hohe Effizienz, genaue Ergebnisse Gib der KI nur 10 Zeilen Beispiele, damit sie ein Verarbeitungsskript generiert.</text>

<!-- Correct steps flow -->

<g transform="translate(448, 128)" font-family="'PingFang SC',sans-serif">

<!-- Step 1 -->

<rect x="0" y="0" width="364" height="38" rx="7" fill="#022c22" stroke="#10b981" stroke-width="1"/>

<text x="22" y="14" font-size="11" font-weight="bold" fill="#6ee7b7">Schritt 1: Beispieldaten vorbereiten 📋 Erste 10 Zeilen Beispiele extrahieren + Feldbeschreibungen</text>

<text x="22" y="30" font-size="10" fill="#34d399">Kleine Menge Beispieldaten (z.B. 1MB Excel) in Text umwandeln df.head(10).to_string() → In die KI kopieren</text>

<!-- Arrow -->

<line x1="182" y1="38" x2="182" y2="52" stroke="#10b981" stroke-width="1.5" stroke-dasharray="4,3"/>

<polygon points="176,50 188,50 182,56" fill="#10b981"/>

<!-- Step 2 -->

<rect x="0" y="56" width="364" height="38" rx="7" fill="#022c22" stroke="#10b981" stroke-width="1"/>

<text x="22" y="70" font-size="11" font-weight="bold" fill="#6ee7b7">Schritt 2: Skript generieren KI versteht Strukturen, generiert Analyse-Python-Skripte</text>

<text x="22" y="86" font-size="10" fill="#34d399">Beispieldaten hochladen, KI generiert Verarbeitungsskript Verbraucht ca. 1.500-2.000 Tokens für die Skriptgenerierung</text>

<!-- Arrow -->

<line x1="182" y1="94" x2="182" y2="108" stroke="#10b981" stroke-width="1.5" stroke-dasharray="4,3"/>

<polygon points="176,106 188,106 182,112" fill="#10b981"/>

<!-- Step 3 -->

<rect x="0" y="112" width="364" height="38" rx="7" fill="#064e3b" stroke="#059669" stroke-width="2"/>

<text x="22" y="126" font-size="12" font-weight="bold" fill="#34d399">Schritt 3: Skript lokal ausführen 🚀 Skript lokal ausführen, um die gesamten 60.000 Datenzeilen zu verarbeiten</text>

<text x="22" y="142" font-size="10" fill="#a7f3d0">Alle Daten lokal mit dem Skript verarbeiten, effizient und präzise Das Skript wird lokal ausgeführt, die Ergebnisse werden in analysis.xlsx gespeichert.</text>

<!-- Success stats -->

<rect x="0" y="162" width="174" height="54" rx="7" fill="#021a0d" stroke="#10b981" stroke-width="1"/>

<text x="87" y="180" font-size="10" fill="#6ee7b7" text-anchor="middle">Fehlerrate Token-Verbrauch</text>

<text x="87" y="202" font-size="22" font-weight="bold" fill="#34d399" text-anchor="middle">Niedrig ca. 2000</text>

<rect x="186" y="162" width="178" height="54" rx="7" fill="#021a0d" stroke="#10b981" stroke-width="1"/>

<text x="275" y="180" font-size="10" fill="#6ee7b7" text-anchor="middle">Antwortzeit Analyseergebnis</text>

<text x="275" y="202" font-size="18" font-weight="bold" fill="#34d399" text-anchor="middle">Wenige Sekunden ✅ Vollständig und genau</text>

<!-- Cost label -->

<rect x="0" y="228" width="364" height="28" rx="6" fill="#064e3b" stroke="#059669" stroke-width="1.5"/>

<text x="182" y="246" font-size="12" font-weight="bold" fill="#34d399" text-anchor="middle">Gesamtkosten: Extrem niedrig Tatsächliche Kosten: < 0,01 $ · Das Skript kann wiederholt verwendet werden</text>

</g>

<!-- ===== BOTTOM COMPARISON BAR ===== -->

<rect x="16" y="400" width="808" height="50" rx="10" fill="#0f172a" stroke="#1e293b" stroke-width="1"/>

<!-- Label -->

<text x="56" y="420" font-family="'PingFang SC',sans-serif" font-size="11" fill="#64748b">Kostenvergleich Kostenvergleich</text>

<!-- Wrong bar -->

<rect x="56" y="428" width="480" height="14" rx="4" fill="url(#cpRedBar)"/>

<text x="544" y="440" font-family="'PingFang SC',sans-serif" font-size="10" fill="#ef4444">Sehr hoch $7.5+ (und fehlgeschlagen)</text>

<!-- Correct bar -->

<rect x="56" y="428" width="2" height="14" rx="2" fill="url(#cpGreenBar)"/>

<!-- The tiny green bar to contrast (logarithmic scale) -->

<!-- Draw label separately -->

<rect x="616" y="424" width="190" height="22" rx="6" fill="#064e3b" stroke="#059669" stroke-width="1"/>

<text x="711" y="439" font-family="'PingFang SC',sans-serif" font-size="11" font-weight="bold" fill="#34d399" text-anchor="middle">Extrem niedrig Korrekte Vorgehensweise: < $0.01 ✅</text>

<!-- Savings callout -->

<rect x="300" y="392" width="240" height="24" rx="7" fill="#1e2d1a" stroke="#10b981" stroke-width="1.5"/>

<text x="420" y="408" font-family="'PingFang SC',sans-serif" font-size="11" font-weight="bold" fill="#34d399" text-anchor="middle">Kostenersparnis 99%+ Plan A spart 99,9% der API-Kosten</text>

</svg>

### Token-Schätzung vor der Nutzung

Bevor Sie Dateien hochladen, können Sie die Token-Menge schnell wie folgt schätzen:

```python

import pandas as pd

def estimate_tokens(file_path):

"""Schätzt grob die Token-Anzahl eines Excel-Dokuments nach der Umwandlung in Text."""

df = pd.read_excel(file_path)

# Daten in CSV-Text umwandeln

csv_text = df.to_csv(index=False)

# Grobe Schätzung: ca. 4 Zeichen/Token für Englisch, ca. 1.5 Zeichen/Token für Chinesisch

char_count = len(csv_text)

estimated_tokens = char_count / 3.5 # Durchschnitt für gemischten chinesischen und englischen Text

print(f"Dateizeilen: {len(df)}")

print(f"Dateispalten: {len(df.columns)}")

print(f"CSV-Zeichenanzahl: {char_count:,}")

print(f"Geschätzte Token-Anzahl: {estimated_tokens:,.0f}")

print(f"Geschätzte Kosten (berechnet mit GPT-4o, $2.5/1M): ${estimated_tokens/1_000_000*2.5:.4f}")

if estimated_tokens > 100_000:

print("⚠️ Warnung: Die Token-Menge überschreitet 100.000. Es wird empfohlen, Lösung A (Stichprobe + Skript) zu verwenden.")

estimate_tokens("your_data.xlsx")

Häufige Fehler und ihre Lösungen

| Fehlerphänomen | Grundursache | Lösung |

|---|---|---|

| "Guthaben unzureichend" gemeldet, obwohl Guthaben vorhanden ist | Vorababzug von Tokens übersteigt das Kontoguthaben | Guthaben aufladen oder Lösung A/C verwenden |

| Sehr langsame Antwort oder Timeout | Zu viele Eingabe-Tokens, lange Inferenzzeit | Eingabedatenmenge reduzieren |

| Ungenaue KI-Analyseergebnisse | Zu große Datenmenge, "Lost-in-the-Middle"-Effekt | Daten vereinfachen, Stapelverarbeitung verwenden |

| Schnittstelle meldet "context length exceeded" | Maximales Kontextfenster des Modells überschritten | Großes Sprachmodell mit größerem Kontextfenster verwenden oder Stapelverarbeitung |

| Jedes Mal extrem hohe Kosten | Wiederholtes Hochladen großer Datenmengen | Wiederverwendbares lokales Skript mit Lösung A generieren |

V. Praxisbeispiel: Analyse von 60.000 Zeilen Prozessdaten

Im Folgenden wird ein vollständiger Geschäftsfall demonstriert, der den gesamten Prozess von der Problemstellung bis zur Lösung aufzeigt.

Hintergrund: Das Betriebsteam verfügt über 60.000 Zeilen Prozessleistungsdaten, die Felder wie Abteilung, Prozessname, Startzeit, Endzeit, Bearbeiter und Abschlussstatus enthalten. Ziel ist es, die KI analysieren zu lassen, welche Prozessknoten die geringste Effizienz aufweisen.

Schritt 1: Stichprobenentnahme

import pandas as pd

# Die ersten 10 Zeilen lesen

df = pd.read_excel("process_data.xlsx", nrows=10)

print("=== Datenstichprobe (erste 10 Zeilen) ===")

print(df.to_string())

print("\n=== Felddefinitionen ===")

for col in df.columns:

print(f"- {col}: {df[col].dtype}, Beispielwert: {df[col].iloc[0]}")

Schritt 2: An die KI senden, um ein Analyseskript zu erhalten

Senden Sie die obige Ausgabe an die KI und fügen Sie die Anforderungsbeschreibung hinzu:

Hier ist die Struktur und eine 10-zeilige Stichprobe meiner Excel-Prozessdaten:

[Ausgabe hier einfügen]

Anforderungen:

1. Berechne die durchschnittliche Bearbeitungszeit für jeden "Prozessnamen" (Endzeit - Startzeit).

2. Ermittle die Prozessabschlussrate pro Abteilung (Anteil der "Abgeschlossen"-Status).

3. Finde die 10 Prozesse mit der längsten durchschnittlichen Bearbeitungszeit und gib sie als Tabelle aus.

4. Speichere die Ergebnisse in analysis_result.xlsx.

Bitte schreibe ein vollständiges, lauffähiges Python-Skript.

Schritt 3: Skript lokal ausführen

Die KI generiert ein Analyseskript, das dem folgenden ähnelt (vereinfachte Beispielversion):

import pandas as pd

# Vollständige Daten lesen

df = pd.read_excel("process_data.xlsx")

# Bearbeitungszeit (Minuten) berechnen

df['处理时长_分钟'] = (

pd.to_datetime(df['结束时间']) - pd.to_datetime(df['开始时间'])

).dt.total_seconds() / 60

# Durchschnittliche Zeit pro Prozess statistisch erfassen

process_avg = (

df.groupby('流程名称')['处理时长_分钟']

.agg(['mean', 'count'])

.rename(columns={'mean': '平均时长', 'count': '总次数'})

.sort_values('平均时长', ascending=False)

)

# Abschlussrate pro Abteilung statistisch erfassen

dept_completion = (

df.groupby('部门')['完成状态']

.apply(lambda x: (x == '完成').mean() * 100)

.round(2)

.rename('完成率%')

)

# Top 10 der langsamsten Prozesse ausgeben

print("=== Die 10 zeitaufwendigsten Prozessknoten ===")

print(process_avg.head(10).to_string())

# Ergebnisse speichern

with pd.ExcelWriter("analysis_result.xlsx") as writer:

process_avg.to_excel(writer, sheet_name="流程效率分析")

dept_completion.to_excel(writer, sheet_name="部门完成率")

print("\n✅ Analyseergebnisse wurden in analysis_result.xlsx gespeichert")

Token-Verbrauchsvergleich für den gesamten Prozess:

| Methode | Token-Verbrauch | Geschätzte Kosten (GPT-4o) | Analysequalität |

|---|---|---|---|

| Direkter Upload von 60.000 Zeilen | ~3 Mio. Tokens | $7.5+ und überschreitet das Kontextfenster | Nicht durchführbar |

| Ansatz A (Stichprobe + Skript) | ~2.000 Tokens | < $0.01 | Vollständig und präzise |

🎯 Kostenvergleich: Der Verbrauch von Ansatz A beträgt weniger als 0,1 % des direkten Uploads, und die Analyseergebnisse sind genauer und wiederverwendbar. Es wird empfohlen, GPT-4o oder Claude 3.5 Sonnet über den API-Proxy-Dienst APIYI (apiiyi.com) aufzurufen, um Datenverarbeitungsskripte zu generieren. Die Ergebnisse sind hervorragend und die Kosten extrem niedrig.

VI. Häufig gestellte Fragen (FAQ)

F1: Ich habe keine Python-Grundkenntnisse, kann ich diesen Ansatz trotzdem verwenden?

Absolut. Der Kern von Ansatz A ist: "Lass die KI das Skript schreiben, du führst es aus." Du musst lediglich:

- Python installieren (offizielle Website: python.org, einfach "Weiter, Weiter" klicken)

- Pandas installieren: Gib im Terminal

pip install pandas openpyxlein - Stichprobendaten an die KI übergeben → KI generiert Skript → Als

.py-Datei speichern → Doppelklicken zum Ausführen

Für Benutzer, die mit der Kommandozeile nicht vertraut sind, kann auch Jupyter Notebook (im Anaconda-Installationspaket enthalten) verwendet werden, was intuitiver ist.

💡 Auf APIYI (apiiyi.com) können Sie auch die integrierte Code-Interpreter-Funktion nutzen, um die KI das Skript direkt generieren und die Skriptlogik überprüfen zu lassen, was die Debugging-Zeit reduziert.

F2: Gibt es neben Python noch andere Möglichkeiten, Big Data zu verarbeiten?

Ja, die folgenden Methoden sind nach Benutzerfreundlichkeit geordnet:

- Integrierte Excel-Funktionen: Pivot-Tabellen + Power Query, keine Programmierung erforderlich, geeignet für aggregierte Statistiken.

- Python pandas: Am flexibelsten, hohe Verarbeitungseffizienz, empfohlen für fortgeschrittene Benutzer.

- Microsoft Copilot (Excel-Add-in): Direkte KI-Analyse im Excel, hat aber immer noch Zeilenbeschränkungen.

- Professionelle Datenanalyse-Tools: Tableau, Power BI verbinden Datenquellen, starke Big-Data-Verarbeitungsfähigkeiten.

F3: Wie hoch sollte das Kontoguthaben sein, um Fehler bei der Vorauszahlung zu vermeiden?

Das hängt von Ihrem täglichen Nutzungsszenario ab. Generell wird empfohlen:

- Normale Chat-Benutzer: Guthaben von $5-20 beibehalten

- Datenverarbeitungsbenutzer (gelegentlicher Dateiupload): Guthaben von $20-50 beibehalten

- Häufige API-Aufrufe: Automatische Aufladung einrichten oder Guthaben von $100+ beibehalten

🎯 Guthabenverwaltung: Im APIYI (apiiyi.com) Kontrollpanel können Sie die Token-Verbrauchsdetails einsehen und Nutzungsalarme einrichten, um Geschäftsunterbrechungen durch unzureichendes Guthaben zu vermeiden. Die Plattform unterstützt bedarfsgerechte Aufladungen ohne Mindestverbrauchsanforderungen.

F4: Meine Daten enthalten sensible Informationen. Kann ich Stichprobendaten an die KI senden?

Die vernünftige Vorgehensweise ist:

- Vor der Übergabe an die KI anonymisieren: Ersetzen Sie sensible Felder wie Namen, Telefonnummern und Ausweisnummern durch Beispielwerte (z. B. "Zhang San" → "Benutzer A").

- Nur Feldnamen und Datentypen angeben: Keine konkreten Werte übermitteln, sondern der KI nur die Feldstruktur und Datentypen mitteilen.

- Lokale Modelllösung: Verwenden Sie Ollama, um ein lokales Modell (z. B. Qwen2.5) auszuführen, sodass die Daten den lokalen Rechner nicht verlassen.

Zusammenfassung

Der häufigste Fehler bei der KI-Verarbeitung großer Excel-Datenmengen ist das direkte Hochladen der gesamten Datei, was zu einer Token-Explosion, API-Fehlern und unkontrollierbaren Kosten führt. Der Kern der Lösung ist einfach:

Lassen Sie die KI „Beispiele ansehen und Skripte schreiben“, anstatt „alles anzusehen und Berechnungen durchzuführen“.

Übersicht der Anwendungsfälle für die vier Lösungsansätze:

| Szenario | Empfohlene Lösung | Schwierigkeit |

|---|---|---|

| Datenmenge > 10.000 Zeilen, statistische Analyse erforderlich | Lösung A: Stichprobe + Skript | ⭐⭐ (Python-Ausführung erforderlich) |

| Datenmenge 5.000-20.000 Zeilen, zeilenweises Verständnis erforderlich | Lösung B: Stapelverarbeitung | ⭐⭐⭐ (API-Aufruf erforderlich) |

| Nur Trendbericht erforderlich, keine zeilenweise Analyse | Lösung C: Vorverarbeitete Zusammenfassung | ⭐ (Mit Excel möglich) |

| Datenmenge < 5.000 Zeilen, höhere Kosten tragbar | Lösung D: Modelle mit großem Kontextfenster | ⭐ (Direktes Hochladen) |

Probieren Sie Lösung A jetzt aus: Extrahieren Sie die ersten 10 Zeilen Ihrer Excel-Datei, wählen Sie auf APIYI apiyi.com GPT-4o oder Claude 3.5 Sonnet, teilen Sie der KI Ihre Analyseanforderungen mit und lassen Sie sie ein Verarbeitungsskript generieren – die meisten Datenanalyseaufgaben können für weniger als 0,01 $ erledigt werden.

🎯 Schnellstart: Besuchen Sie APIYI apiyi.com, registrieren Sie sich und erleben Sie eine Vielzahl gängiger Modelle. Es unterstützt die einheitliche Modellaufrufe von OpenAI, Claude, Gemini und anderen, wird nach tatsächlichem Verbrauch abgerechnet, ohne monatliche Gebühren oder Mindestverbrauch. Ideal für Geschäftsteams und Einzelnutzer zur Bewältigung verschiedener Datenanalyseaufgaben.

Dieser Artikel wurde vom APIYI-Technikteam zusammengestellt und basiert auf echtem Nutzerfeedback und praktischen Erfahrungen. Bei Fragen oder Anregungen kontaktieren Sie uns gerne über apiyi.com.