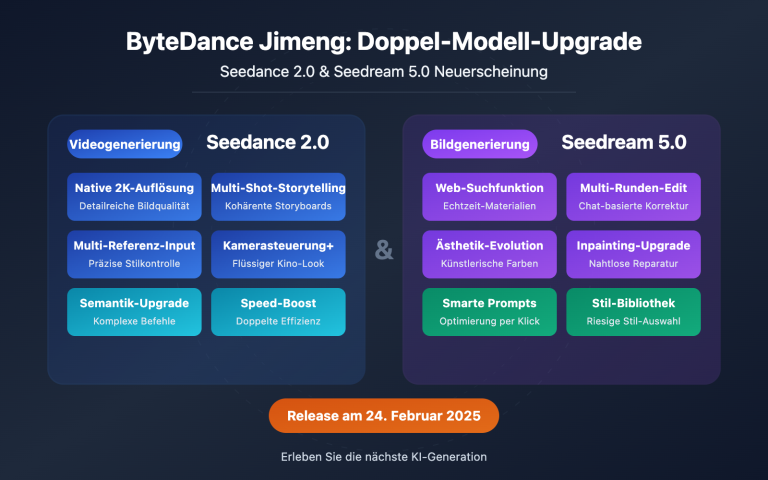

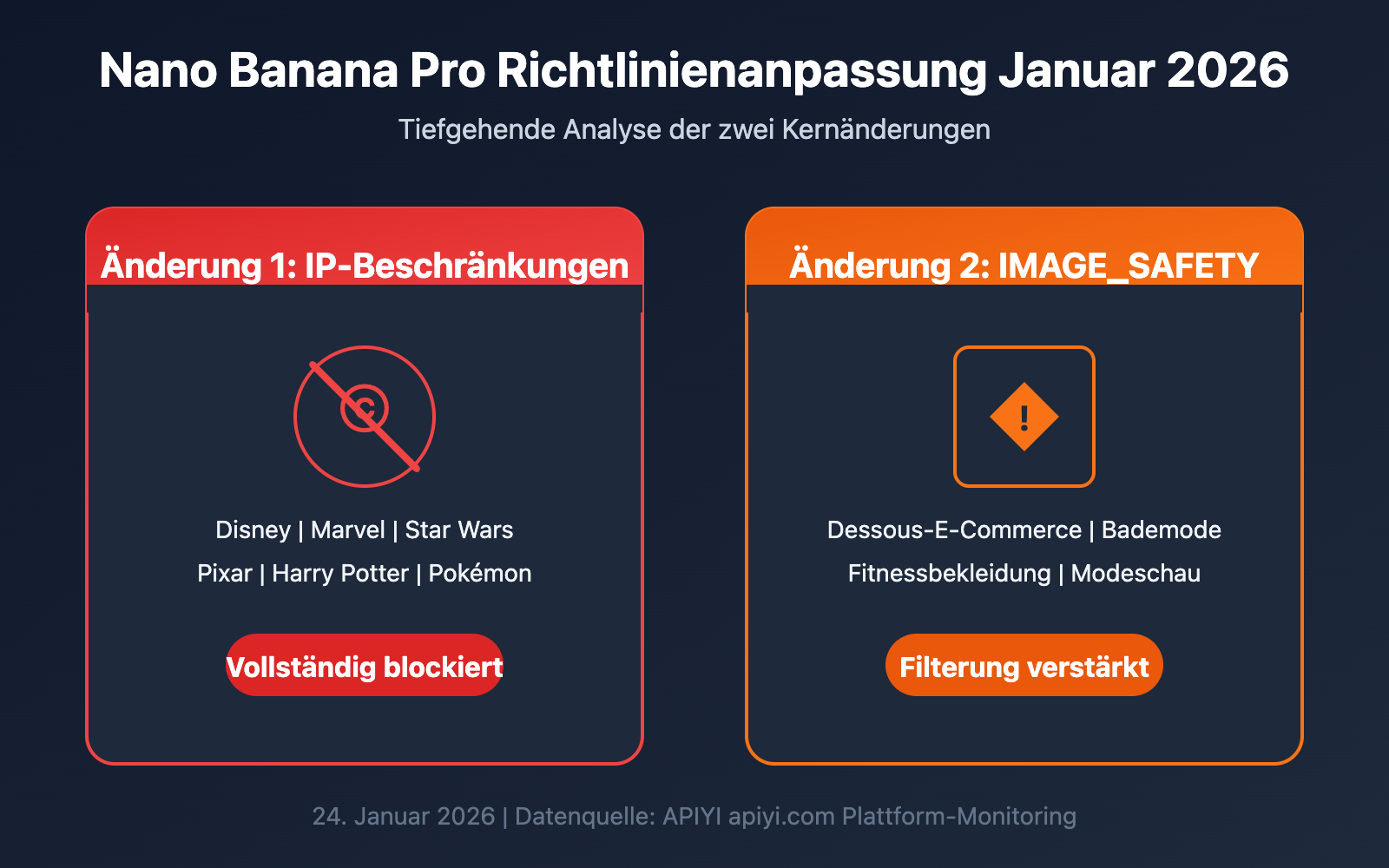

Googles KI-Bildgenerierungsdienst Nano Banana Pro hat Ende Januar 2026 (etwa um den 24. Januar) wichtige Richtlinienanpassungen vorgenommen. Insbesondere die deutliche Verschärfung der IMAGE_SAFETY-Filterung und die strikten Einschränkungen für bekannte IP-Charaktere haben in der Entwickler-Community für großes Aufsehen gesorgt. In diesem Artikel analysieren wir diese Entwicklungen im Detail, um Entwicklern zu helfen, die Hintergründe der Richtlinienänderungen zu verstehen und Lösungen zu finden.

Kernwert: Verstehen Sie in 3 Minuten die Kerninhalte, Hintergründe und praktischen Auswirkungen der Richtlinienanpassung von Nano Banana Pro und meistern Sie 5 Strategien für den Umgang damit.

Nano Banana Pro Richtlinienanpassung: Die Kerninfos

Ereignis-Quick-View

| Information | Details |

|---|---|

| Zeitpunkt | Um den 24. Januar 2026 |

| Anbieter | Google (Nano Banana Pro / Imagen-Serie) |

| Kernänderungen | IMAGE_SAFETY-Filterung verschärft + Einschränkung bekannter IPs |

| Auswirkungen | Alle Entwickler und Anwendungen, die die Nano Banana Pro API nutzen |

| Offizielle Erklärung | Verstoß gegen die Google Generative AI Prohibited Use Policy |

Die 2 Kernänderungen im Detail

Änderung 1: Generierung bekannter IP-Charaktere eingeschränkt

Phänomenbeschreibung:

Beim Versuch, Bilder zu generieren, die bekannte Markencharaktere enthalten (wie Disney, Marvel, Star Wars usw.), lehnt das System die Anfrage ab. IP-bezogene Inhalte, die zuvor problemlos generiert werden konnten, lösen nun Urheberrechtsschutzmechanismen aus.

Betroffene IP-Bereiche:

| IP-Kategorie | Beispielhafte Werke | Grad der Einschränkung |

|---|---|---|

| Disney-Klassiker | Die Eiskönigin, Der König der Löwen, Arielle | Vollständig eingeschränkt |

| Marvel-Universum | Deadpool, Guardians of the Galaxy, Iron Man | Vollständig eingeschränkt |

| Star Wars | Charaktere der gesamten Serie | Vollständig eingeschränkt |

| Pixar Animation | Toy Story, Findet Nemo | Vollständig eingeschränkt |

| Andere bekannte IPs | Harry Potter, Pokémon usw. | Teilweise eingeschränkt |

Beispiel für eine Fehlermeldung:

{

"finishReason": "SAFETY",

"finishMessage": "The image was filtered because it may contain copyrighted characters or content."

}

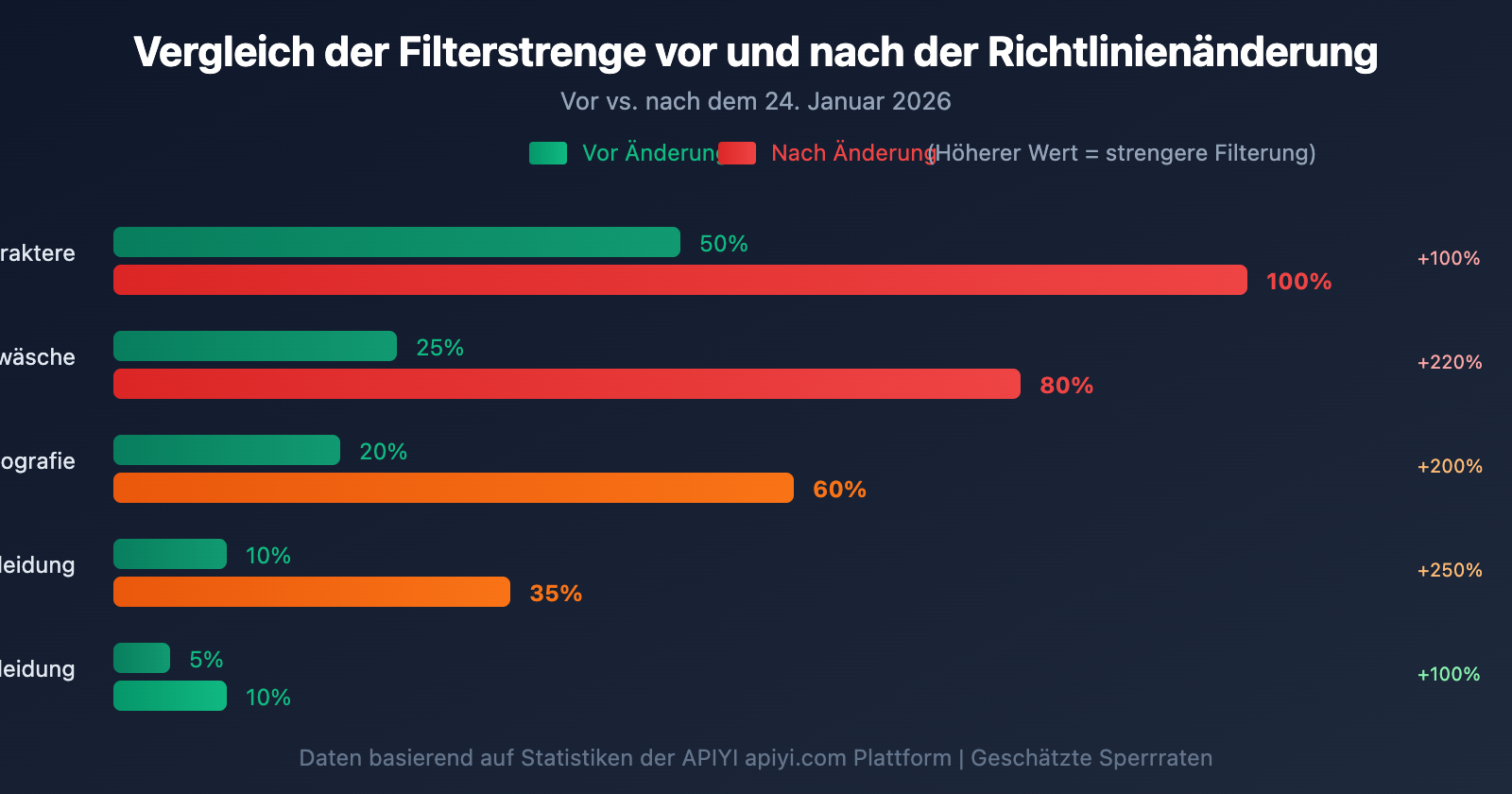

Änderung 2: IMAGE_SAFETY-Inhaltsfilterung verschärft

Phänomenbeschreibung:

Die Sicherheitsüberprüfung von Inhalten ist deutlich strenger geworden. Zuvor konforme Inhalte (wie E-Commerce-Produktbilder oder Modefotografie) können nun eine IMAGE_SAFETY-Blockierung auslösen.

Typische Fehlerrückgabe:

{

"finishReason": "IMAGE_SAFETY",

"finishMessage": "Unable to show the generated image. The image was filtered out because it violated Google's Generative AI Prohibited Use policy. You will not be charged for blocked images. Try rephrasing the prompt. If you think this was an error, send feedback.",

"safetyInfo": {

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"blocked": true

}

}

Betroffene Szenarien:

| Szenario | Vorheriger Status | Aktueller Status | Schweregrad |

|---|---|---|---|

| Dessous-E-Commerce-Bilder | Normale Generierung | Häufige Blockierung | Hoch |

| Bademoden-Fotografie | Normale Generierung | Teilweise Blockierung | Mittel-Hoch |

| Fitness-Sportbekleidung | Normale Generierung | Gelegentliche Blockierung | Mittel |

| Enganliegende Sportkleidung | Normale Generierung | Gelegentliche Blockierung | Mittel |

| Normale Bekleidungspräsentation | Normale Generierung | Weitgehend normal | Niedrig |

Analyse des Hintergrunds der Richtlinienänderung bei Nano Banana Pro

Vorangetrieben durch Urheberrechtsklagen von Disney

Im Dezember 2025 schickte Disney eine Abmahnung (Cease and Desist Letter) an Google und warf dem Unternehmen „massive Urheberrechtsverletzungen“ in seinen KI-Bildgenerierungsdiensten vor.

Kernpunkte der Vorwürfe von Disney:

| Inhalt der Anschuldigung | Detaillierte Erläuterung |

|---|---|

| Ausmaß der Verletzung | „massive scale“ (massiv) |

| Betroffene Produkte | Veo, Imagen, Nano Banana usw. |

| Art der Verletzung | Erzeugung „pristiner“ (gestochen scharfer) Bilder von Disney-Charakteren |

| Betroffene IPs | Star Wars, Marvel, Die Eiskönigin, Der König der Löwen usw. |

Disney führte in dem Schreiben Beweise an, wonach Nutzer durch einfache Eingabeaufforderungen Bilder ihrer geschützten Charaktere generieren konnten. Disney vertritt die Ansicht, dass Google „intentionally amplifying the scope of its infringement“ (den Umfang seiner Rechtsverletzungen vorsätzlich vergrößert).

🎯 Hintergrundinformation: Interessanterweise kündigte Disney zeitgleich mit den Vorwürfen gegen Google eine 1-Milliarde-Dollar-Kooperation mit OpenAI an, um die Nutzung seiner Charaktere auf der Sora-Videoplattform zu lizenzieren. Dies verdeutlicht, dass Disney nicht generell gegen KI-Generierung ist, sondern eine formelle Lizenzierung und Gewinnbeteiligung fordert.

Zunehmender Druck zur Einhaltung von Compliance-Vorgaben

Neben Disney hat auch eine Gruppe visueller Künstler Urheberrechtsklagen gegen Google eingereicht. Sie werfen dem Unternehmen vor, das Imagen-Modell ohne Genehmigung mit ihren Werken trainiert zu haben. Dieser rechtliche Druck hat Google dazu veranlasst, die Inhaltsfilterung proaktiv zu verstärken.

Anpassungen auf Google-Richtlinienebene

Im Dezember 2024 aktualisierte Google seine „Generative AI Prohibited Use Policy“ und verbot ausdrücklich:

- Die Generierung von Inhalten, die geistiges Eigentum Dritter verletzen

- Die Verwendung personenbezogener Daten oder biometrischer Merkmale ohne Zustimmung

- Die Erstellung von Deepfake-Inhalten

- Die Erzeugung von nicht einvernehmlichen intimen Bildern

Die aktuelle Richtlinienänderung bei Nano Banana Pro ist die konkrete Umsetzung dieser Richtlinien auf Produktebene.

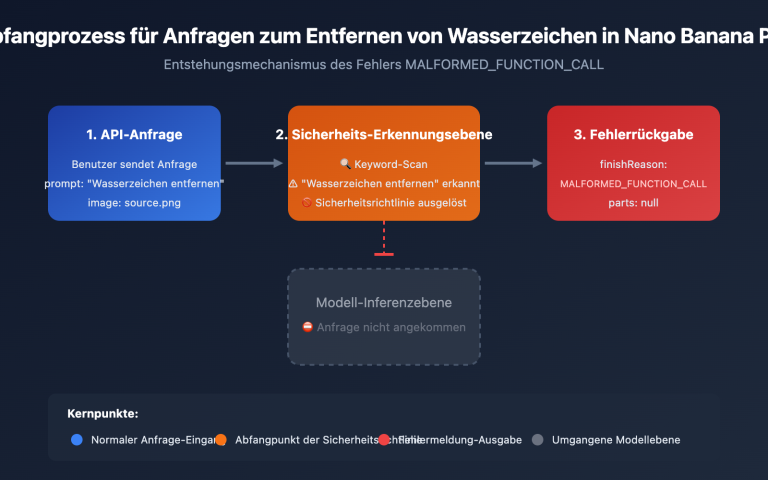

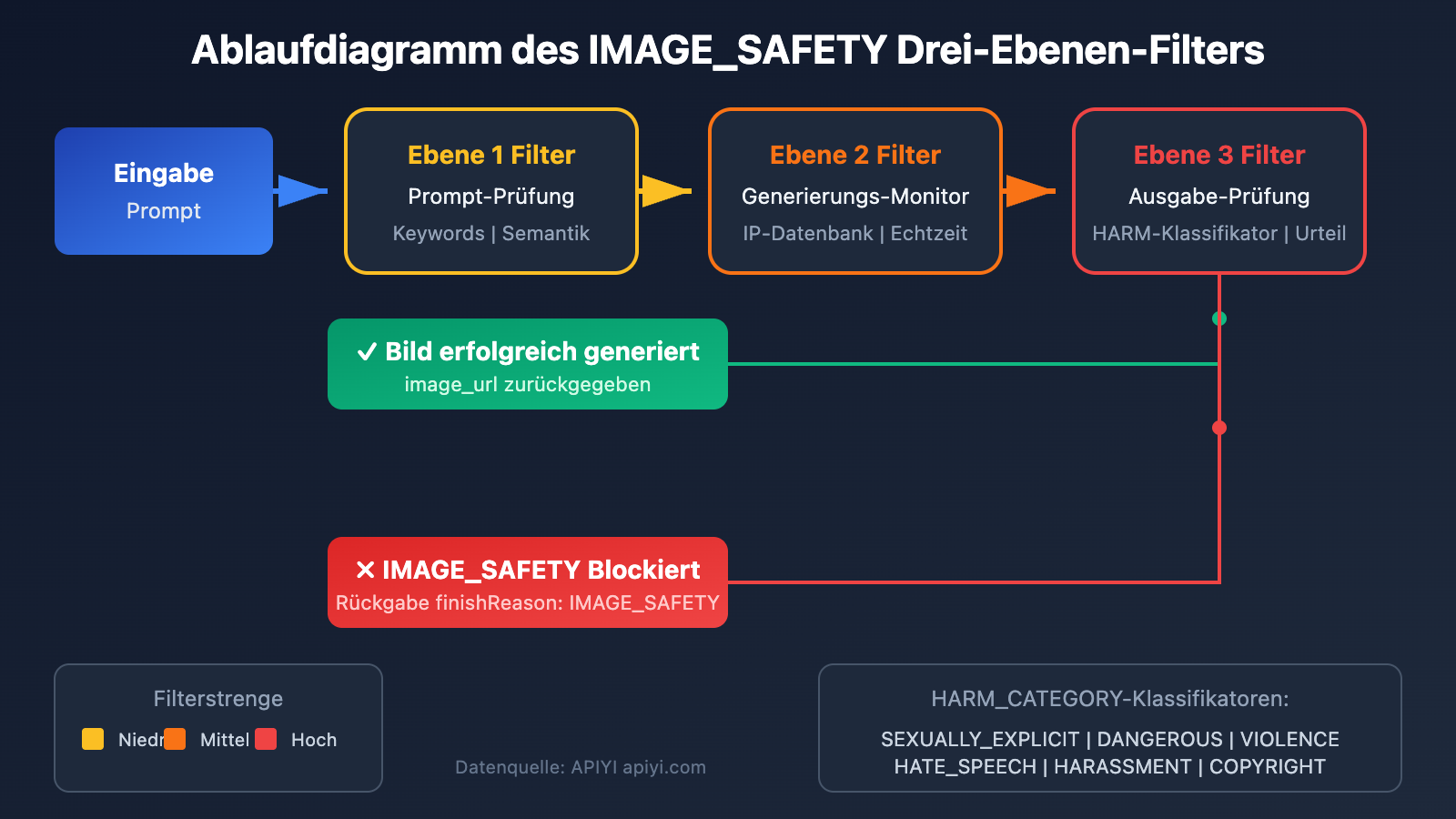

Analyse des IMAGE_SAFETY-Filtermechanismus von Nano Banana Pro

Funktionsweise des Filters

Das Sicherheitsfiltersystem von Nano Banana Pro verwendet einen mehrstufigen Überprüfungsmechanismus:

Ebene 1: Prüfung der Eingabeaufforderung

- Analyse der vom Nutzer eingegebenen Eingabeaufforderung

- Erkennung sensibler Schlüsselwörter und semantischer Absichten

- Identifizierung potenzieller urheberrechtlich relevanter Beschreibungen

Ebene 2: Überwachung des Generierungsprozesses

- Echtzeit-Erkennung von Merkmalen im entstehenden Bild

- Abgleich mit Datenbanken bekannter IP-Merkmale

- Bewertung des Sicherheits-Scores für Inhalte

Ebene 3: Ausgangsprüfung

- Umfassender Scan des fertigen Bildes

- Anwendung von HARM_CATEGORY-Klassifikatoren

- Entscheidung über Freigabe oder Sperrung

Erläuterung der Filterkategorien

| Kategorie-Code | Kategorie-Name | Trigger-Szenario | Strengegrad |

|---|---|---|---|

HARM_CATEGORY_SEXUALLY_EXPLICIT |

Sexuell explizite Inhalte | Freizügige Kleidung, intime Posen | Sehr streng |

HARM_CATEGORY_DANGEROUS_CONTENT |

Gefährliche Inhalte | Waffen, Gewaltszenen | Streng |

HARM_CATEGORY_HATE_SPEECH |

Hassrede | Diskriminierende Inhalte | Streng |

HARM_CATEGORY_HARASSMENT |

Belästigung | Gezielte Angriffe | Streng |

HARM_CATEGORY_VIOLENCE |

Gewalt | Blutige, verletzende Szenen | Streng |

COPYRIGHT_INFRINGEMENT |

Urheberrechtsverletzung | Bekannte IP-Charaktere | Sehr streng |

Warum werden auch rechtmäßige Inhalte blockiert?

In Entwicklerforen gibt es massenhaft Feedback: Warum werden reguläre E-Commerce-Produktbilder für Unterwäsche von IMAGE_SAFETY blockiert?

Ursachenanalyse:

- Überanpassung der Sicherheitsmodelle: Um sicherzustellen, dass kein Regelverstoß übersehen wird, neigen die Sicherheitsmodelle dazu, im Zweifelsfall lieber zu viel als zu wenig zu sperren.

- Mangelnde Kontextbeurteilung: Das System hat Schwierigkeiten, den Unterschied zwischen einem „E-Commerce-Produktbild“ und „unangemessenem Inhalt“ zu erkennen.

- Verschärfung der globalen Strategie: Aufgrund des rechtlichen Drucks hat Google sich entschieden, die allgemeinen Filterschwellen anzuheben.

- Black-Box-Entscheidungen: Nutzer erfahren nicht, welche spezifische Regel genau ausgelöst wurde.

💡 Technischer Einblick: Durch die Log-Analyse-Funktionen der APIYI apiyi.com Plattform können Entwickler die spezifischen Gründe für blockierte Anfragen besser verstehen, was bei der Optimierung der Strategien für Eingabeaufforderungen hilft.

Auswirkungen der Richtlinienänderungen von Nano Banana Pro auf Entwickler

Direkte Auswirkungen

| Einflussbereich | Konkrete Auswirkungen | Schweregrad |

|---|---|---|

| IP-bezogene Anwendungen | Fan-Art-Erstellungstools und Dienste für Fan-Illustrationen sind direkt unbrauchbar | Kritisch |

| E-Commerce-Produktbilder | Bildgenerierung für Unterwäsche- und Bademoden-Kategorien blockiert | Schwerwiegend |

| Modefotografie | Einige Szenen der Kleidungspräsentation werden fälschlicherweise blockiert | Mittel |

| Kreatives Design | Kreationen, die auf Stilen bekannter Charaktere basieren, sind eingeschränkt | Mittel |

| Allgemeine Nutzung | Relativ geringe Auswirkungen | Geringfügig |

Auswirkungen auf Geschäftsebene

Für die E-Commerce-Branche:

- KI-Lösungen für Produktbilder im Modebereich müssen angepasst werden.

- Auswirkungen auf Unterwäsche- und Bademoden-Kategorien sind am deutlichsten.

- Eine Rückkehr zu traditioneller Fotografie oder der Wechsel zu anderen Diensten könnte erforderlich sein.

Für Content-Ersteller:

- Sekundärkreationen und die Generierung von Fan-Art sind eingeschränkt.

- Mehr Originaldesign statt IP-Anleihen ist erforderlich.

- Die kreative Freiheit ist gesunken.

Für Entwickler von KI-Anwendungen:

- Es muss mehr Fehlerbehandlungslogik in die Produkte integriert werden.

- Die Nutzererfahrung könnte durch häufige Blockaden sinken.

- Die Einführung von Backup-Bildgenerierungsdiensten könnte notwendig werden.

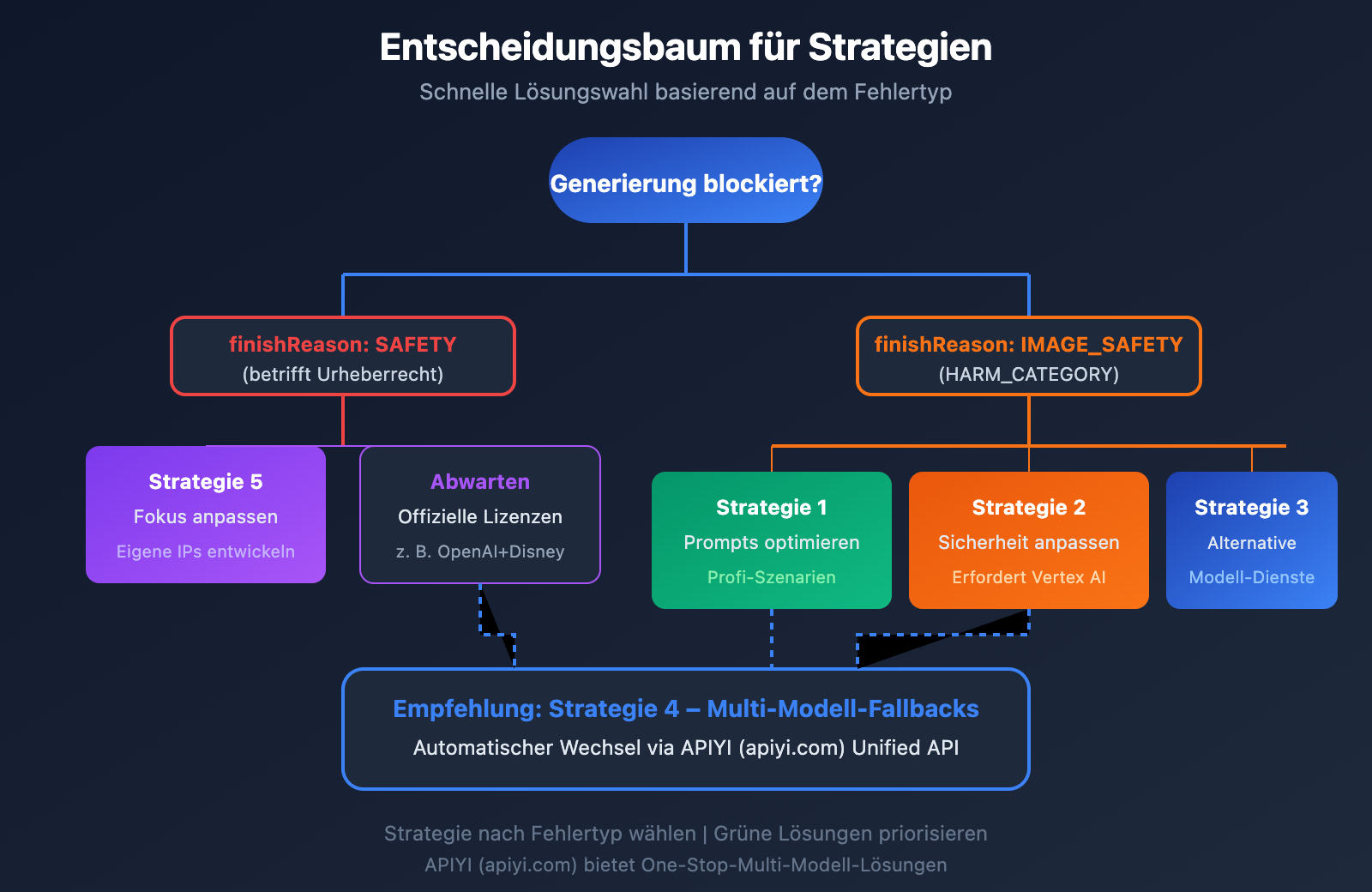

5 Strategien zur Bewältigung der Richtlinienänderungen von Nano Banana Pro

Strategie 1: Optimierung der Eingabeaufforderungen

Gegen fälschliche Blockaden durch IMAGE_SAFETY können Sie versuchen, die Formulierungen Ihrer Eingabeaufforderung anzupassen:

# Vor der Optimierung – wird leicht blockiert

prompt_before = "model wearing lace bra, fashion photography"

# Nach der Optimierung – geringeres Risiko von Fehlinterpretationen

prompt_after = "fashion catalog photo, model in elegant intimate apparel, professional studio lighting, clean background"

Optimierungstechniken:

| Technik | Erklärung | Beispiel |

|---|---|---|

| Professionellen Kontext hinzufügen | Kommerzielle, professionelle Nutzung betonen | "e-commerce product photo" |

| Indirekte Formulierungen verwenden | Direkte Beschreibungen vermeiden | "intimate apparel" statt "bra" |

| Umgebungsbeschreibung ergänzen | Lässt den Inhalt seriöser erscheinen | "professional studio setting" |

| Verwendungszweck klären | Compliance-Absicht zeigen | "for fashion catalog" |

Strategie 2: Anpassung der Sicherheitsfilter-Einstellungen

Wenn Sie die Vertex AI-Version von Imagen verwenden, können Sie versuchen, die Schwellenwerte für den Sicherheitsfilter anzupassen:

from google.cloud import aiplatform

from vertexai.preview.vision_models import ImageGenerationModel

# Sicherheitseinstellungen anpassen

safety_settings = {

"HARM_CATEGORY_SEXUALLY_EXPLICIT": "BLOCK_ONLY_HIGH",

"HARM_CATEGORY_DANGEROUS_CONTENT": "BLOCK_ONLY_HIGH",

}

model = ImageGenerationModel.from_pretrained("imagen-3.0")

response = model.generate_images(

prompt="your prompt here",

safety_filter_level="block_only_high" # Filtersensibilität verringern

)

⚠️ Hinweis: In der kostenlosen Version von AI Studio können die Sicherheitseinstellungen nicht angepasst werden; hierfür ist die kostenpflichtige Vertex AI-Version erforderlich.

Strategie 3: Nutzung alternativer Bildgenerierungsdienste

Wenn Nano Banana Pro nicht geeignet ist, können andere Bildgenerierungsdienste in Betracht gezogen werden:

| Dienst | Vorteile | Anwendungsbereich | APIYI-Unterstützung |

|---|---|---|---|

| DALL-E 3 | Hohe Kreativität, gute Compliance | Kreatives Design, Illustrationen | ✅ |

| Midjourney | Exzellenter künstlerischer Stil | Kunstwerke, Konzeptgrafiken | ✅ |

| Stable Diffusion | Flexibel und kontrollierbar | Maßgeschneiderte Anforderungen | ✅ |

| Flux | Schnell, kosteneffizient | Massengenerierung | ✅ |

🚀 Schneller Wechsel: Über die Plattform APIYI (apiyi.com) können Entwickler eine einheitliche API-Schnittstelle nutzen, um verschiedene Bildgenerierungsmodelle aufzurufen und ohne Code-Änderungen schnell zu wechseln. Wenn ein Dienst blockiert ist, kann nahtlos auf einen Backup-Dienst umgeschaltet werden.

Strategie 4: Implementierung eines Multi-Modell-Fallback-Mechanismus

Implementieren Sie in Ihrer Anwendung eine automatische Downgrade-Logik:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Verwendung der einheitlichen APIYI-Schnittstelle

)

def generate_image_with_fallback(prompt, models=None):

"""Bildgenerierungsfunktion mit Fehlertoleranz"""

if models is None:

models = ["nano-banana-pro", "dall-e-3", "flux-schnell"]

for model in models:

try:

response = client.images.generate(

model=model,

prompt=prompt,

size="1024x1024"

)

return {

"success": True,

"model_used": model,

"image_url": response.data[0].url

}

except Exception as e:

error_msg = str(e)

if "IMAGE_SAFETY" in error_msg or "SAFETY" in error_msg:

print(f"{model} wurde durch Sicherheitsfilter blockiert, versuche nächstes Modell...")

continue

else:

print(f"{model} Aufruf fehlgeschlagen: {error_msg}")

continue

return {"success": False, "error": "Keines der Modelle konnte diesen Inhalt generieren"}

# Anwendungsbeispiel

result = generate_image_with_fallback("fashion product photography, elegant dress")

Vollständigen Fehlertoleranz-Code anzeigen (inkl. Retries und Logging)

import openai

import time

import logging

from typing import Optional, List, Dict, Any

# Konfiguration des Loggings

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Verwendung der einheitlichen APIYI-Schnittstelle

)

class ImageGenerationService:

"""Bildgenerierungsdienst mit Fehlertoleranz und Retries"""

DEFAULT_MODELS = ["nano-banana-pro", "dall-e-3", "flux-schnell", "sd-xl"]

def __init__(self, models: Optional[List[str]] = None, max_retries: int = 2):

self.models = models or self.DEFAULT_MODELS

self.max_retries = max_retries

self.stats = {"success": 0, "safety_blocked": 0, "errors": 0}

def generate(self, prompt: str, size: str = "1024x1024") -> Dict[str, Any]:

"""Bilder generieren mit automatischem Fallback-Modellwechsel"""

for model in self.models:

for attempt in range(self.max_retries):

try:

logger.info(f"Versuche Bildgenerierung mit {model} (Versuch {attempt + 1})")

response = client.images.generate(

model=model,

prompt=prompt,

size=size

)

self.stats["success"] += 1

logger.info(f"✅ Bild mit {model} erfolgreich generiert")

return {

"success": True,

"model_used": model,

"image_url": response.data[0].url,

"attempts": attempt + 1

}

except Exception as e:

error_msg = str(e)

if "IMAGE_SAFETY" in error_msg or "SAFETY" in error_msg:

self.stats["safety_blocked"] += 1

logger.warning(f"⚠️ {model} wurde durch Sicherheitsfilter blockiert")

break # Bei Sicherheitsblockade kein Retry, direkt Modell wechseln

elif "rate_limit" in error_msg.lower():

logger.warning(f"⏳ {model} Rate-Limit erreicht, warte auf Retry...")

time.sleep(2 ** attempt) # Exponentieller Backoff

continue

else:

self.stats["errors"] += 1

logger.error(f"❌ Aufruf von {model} fehlgeschlagen: {error_msg}")

break

return {

"success": False,

"error": "Keines der Modelle konnte diesen Inhalt generieren",

"stats": self.stats

}

def get_stats(self) -> Dict[str, int]:

"""Statistiken abrufen"""

return self.stats

# Anwendungsbeispiel

service = ImageGenerationService()

result = service.generate("professional fashion photography, model in elegant evening dress")

if result["success"]:

print(f"Generierung erfolgreich! Verwendetes Modell: {result['model_used']}")

print(f"Bild-URL: {result['image_url']}")

else:

print(f"Generierung fehlgeschlagen: {result['error']}")

Strategie 5: Anpassung der Geschäftsstrategie

Für Anwendungen, die stark von bekannten IPs abhängen, könnte eine grundlegende Anpassung der Geschäftsausrichtung erforderlich sein:

| Ursprüngliches Geschäft | Anpassungsrichtung | Machbarkeit |

|---|---|---|

| Generierung von Disney-Charakterbildern | Eigene Charaktere erstellen, eigene IPs entwickeln | Mittel- bis langfristig |

| Tools für IP-Sekundärkreationen | Fokus auf Stil-Nachahmung (ohne spezifische Charaktere) | Kurzfristig machbar |

| Generierung von Fan-Art | Auf offizielle Lizenzkanäle warten (z. B. Kooperation OpenAI + Disney) | Abwarten |

Häufig gestellte Fragen (FAQ)

Q1: Warum funktioniert die Generierung von Inhalten, die früher möglich waren, plötzlich nicht mehr?

Google hat Ende Januar 2026 Richtlinienanpassungen für Nano Banana Pro vorgenommen, primär unter dem Druck rechtlicher Auseinandersetzungen wie den Urheberrechtsklagen von Disney. Die Filter-Schwellenwerte für IMAGE_SAFETY wurden deutlich angehoben, was dazu führen kann, dass auch zuvor konforme Inhalte fälschlicherweise blockiert werden. Wir empfehlen, über die Plattform APIYI (apiyi.com) verschiedene Modelle zu testen, um die passende Alternative für Ihr Geschäftsszenario zu finden.

Q2: Was tun, wenn E-Commerce-Produktbilder von Unterwäsche blockiert werden?

Versuchen Sie zunächst, die Eingabeaufforderung zu optimieren, indem Sie professionelle Beschreibungen wie „e-commerce product photo“ oder „professional catalog“ hinzufügen. Falls die Blockierung bestehen bleibt, raten wir zum Wechsel auf andere Bildgenerierungsdienste wie DALL-E 3 oder Flux. Die APIYI-Plattform (apiyi.com) unterstützt den Aufruf verschiedener Modelle über eine einheitliche Schnittstelle, was einen schnellen Wechsel und Tests ermöglicht.

Q3: Ist es erlaubt, Inhalte „im Stil eines bestimmten Charakters“ zu generieren?

Die Beschreibung „im Stil von“ ist meist weniger anfällig für Urheberrechtsfilter als die direkte Nennung von Charakternamen, birgt aber dennoch Risiken. Es wird empfohlen, abstraktere Beschreibungen zu verwenden, zum Beispiel „colorful cartoon princess style“ anstatt „Elsa from Frozen style“. Der sicherste Weg ist die Erstellung von Inhalten, die vollständig auf originellen Konzepten basieren.

Q4: Ist diese Richtlinienänderung dauerhaft?

Nach aktuellem Stand ist davon auszugehen, dass die Einschränkungen zum Schutz bekannter IPs (geistiges Eigentum) aufgrund rechtlicher Compliance-Anforderungen bestehen bleiben. Das Problem der Fehlklassifizierungen bei IMAGE_SAFETY könnte sich jedoch in künftigen Versionen verbessern. Im Google-Entwicklerforum gibt es bereits entsprechendes Feedback, und die Verantwortlichen haben erklärt, Rückmeldungen zu sammeln. Es empfiehlt sich, die offiziellen Update-Logs zu verfolgen.

Q5: Wie unterscheide ich zwischen einem Urheberrechtsproblem und einem Inhaltssicherheitsproblem?

Achten Sie auf die Fehlermeldung: Wenn der finishReason auf SAFETY steht und die Meldung Begriffe wie „copyrighted“ oder „trademarked“ enthält, handelt es sich um ein Urheberrechtsproblem. Wenn der finishReason hingegen IMAGE_SAFETY lautet und die safetyInfo.category Kategorien wie HARM_CATEGORY_SEXUALLY_EXPLICIT anzeigt, liegt ein Problem mit der Inhaltssicherheit vor. Die Strategien zur Bewältigung unterscheiden sich in beiden Fällen.

Branchenauswirkungen der Nano Banana Pro Richtlinienänderung

Auswirkungen auf die KI-Bildgenerierungsbranche

Diese Richtlinienänderung markiert einen wichtigen Wendepunkt für die KI-Bildgenerierungsbranche:

| Trend | Erläuterung |

|---|---|

| Urheberrechts-Compliance wird Standard | Große KI-Dienste werden den Urheberrechtsschutz verstärken; dies ist dem rechtlichen Umfeld geschuldet. |

| Inhaltsmoderation wird kontinuierlich verschärft | Um rechtliche Risiken zu vermeiden, neigen Dienstleister dazu, die Filter-Schwellenwerte zu erhöhen. |

| Lizenzpartnerschaften werden zum Mainstream | Das Kooperationsmodell zwischen Disney und OpenAI könnte zum Branchenvorbild werden. |

| Originalinhalte rücken in den Fokus | Anwendungen, die auf der Nutzung fremder IPs basieren, stehen vor größeren Herausforderungen. |

Auswirkungen auf das Entwickler-Ökosystem

- Multi-Modell-Strategie wird zur Notwendigkeit: Man kann sich nicht mehr auf einen einzigen Bildgenerierungsdienst verlassen.

- Fehlertoleranz-Mechanismen müssen gestärkt werden: Anwendungen müssen in der Lage sein, fehlgeschlagene Generierungen elegant zu handhaben.

- Compliance-Bewusstsein muss steigen: Entwickler müssen Urheberrechte und Sicherheitsgrenzen für Inhalte besser verstehen.

💡 Empfehlung für die Entwicklung: Wir empfehlen Entwicklern, über eine einheitliche Schnittstellenplattform wie APIYI (apiyi.com) auf verschiedene Bildgenerierungsdienste zuzugreifen. Dies senkt das Risiko einer Abhängigkeit von einem einzelnen Dienst und ermöglicht einen flexiblen Wechsel zum optimalen Modell je nach Szenario.

Zusammenfassung

Die Richtlinienänderung von Nano Banana Pro im Januar 2026 bringt zwei zentrale Veränderungen mit sich: Die Einschränkung bei der Generierung bekannter IPs und eine Verschärfung der IMAGE_SAFETY-Filterung. Hintergrund sind der rechtliche Druck durch Urheberrechtsinhaber wie Disney sowie das Bestreben von Google, die Compliance-Standards proaktiv zu erhöhen.

Wichtige Eckpunkte im Überblick:

| Punkt | Inhalt |

|---|---|

| Veränderung 1 | Bekannte IP-Charaktere (z. B. von Disney) können nicht mehr generiert werden. |

| Veränderung 2 | Die Sicherheitsfilterung für Inhalte wurde deutlich verschärft; teils werden regelkonforme Inhalte fälschlicherweise blockiert. |

| Hintergrund | Urheberrechtsklagen von Disney + allgemeiner Compliance-Druck in der Branche. |

| Strategien | Optimierung der Eingabeaufforderungen (Prompts), Anpassung der Sicherheitseinstellungen, Nutzung von Backup-Diensten, Etablierung von Fehlertoleranz-Mechanismen, Anpassung der Geschäftsrichtung. |

Für Entwickler ist es am pragmatischsten, diese Veränderungen zu akzeptieren und sich aktiv anzupassen. Wir empfehlen, über APIYI (apiyi.com) schnell verschiedene Bildgenerierungsmodelle zu testen, um die beste Lösung für das eigene Geschäftsszenario zu finden. Die Plattform bietet eine einheitliche API-Schnittstelle und unterstützt den Wechsel zwischen verschiedenen Modellen mit nur einem Klick – eine effektive Absicherung gegen Richtlinienänderungen einzelner Anbieter.

Referenzen:

-

Google Generative AI Prohibited Use Policy: Offizielles Dokument zur Nutzungsrichtlinie

- Link:

policies.google.com/terms/generative-ai/use-policy

- Link:

-

Vertex AI Imagen Sicherheitsfilter-Dokumentation: Leitfaden zur Konfiguration der Sicherheitseinstellungen

- Link:

docs.cloud.google.com/vertex-ai/generative-ai/docs/image/responsible-ai-imagen

- Link:

-

Google AI Developers Forum: Nano Banana Pro IMAGE_SAFETY Diskussions-Thread

- Link:

discuss.ai.google.dev/t/nano-banana-pro-suddenly-blocking-non-nsfw-ecommerce-underwear-images-with-image-safety-error/113109

- Link:

-

Disney vs. Google Berichterstattung: Disney sendet Unterlassungserklärung an Google

- Quelle: Hollywood Reporter, The Wrap (Dezember 2025)

📝 Autor: APIYI Team

📅 Veröffentlichungsdatum: 26. Januar 2026

🔗 Technischer Support: APIYI (apiyi.com) – Ihre One-Stop-Plattform für KI-Modell-API-Dienste