Anmerkung des Autors: Eine tiefgehende Analyse der Modelle MiniMax-M2.7 und M2.7-highspeed hinsichtlich ihrer Kernkompetenzen, Leistungsbenchmarks und API-Integration, um Entwicklern den Zugang zu KI-Fähigkeiten auf Spitzenniveau zu minimalen Kosten zu ermöglichen.

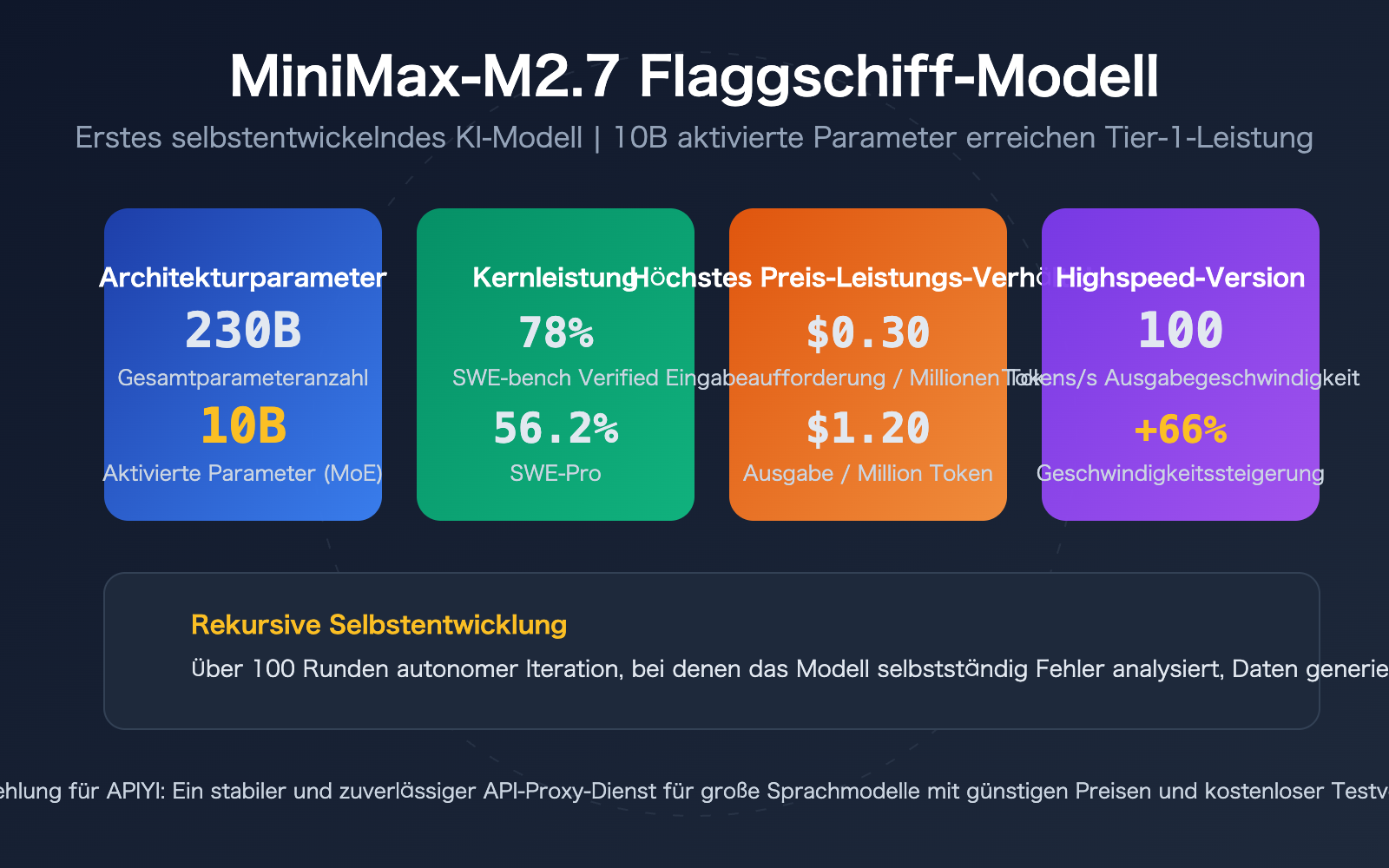

MiniMax hat am 18. März 2026 das Spitzenmodell MiniMax-M2.7 veröffentlicht – das erste KI-Modell, das aktiv an seiner eigenen Evolution mitwirkt. Mit nur 10B aktiven Parametern erreicht es eine Tier-1-Leistung auf Augenhöhe mit Claude Opus 4.6 und GPT-5, bei einem Preis, der nur 1/50 gängiger Spitzenmodelle beträgt. Die zeitgleich veröffentlichte Version MiniMax-M2.7-highspeed steigert die Ausgabegeschwindigkeit um 66 % auf 100 tps.

Kernnutzen: Anhand echter Benchmark-Daten und Integrationsanleitungen erfahren Sie, ob MiniMax-M2.7 das derzeit kosteneffizienteste Spitzenmodell für Ihre Anforderungen ist.

Kernpunkte zu MiniMax-M2.7

| Punkt | Beschreibung | Nutzen |

|---|---|---|

| 230B Gesamtparameter / 10B aktiv | Sparse Mixture-of-Experts (MoE) Architektur, nur 10B Parameter pro Inferenz | Spitzenleistung + extrem niedrige Inferenzkosten |

| Rekursive Selbstevaluation | Das Modell optimiert seinen Trainingsprozess autonom in über 100 Iterationen | 30 % Leistungssteigerung ohne menschliches Eingreifen |

| SWE-bench 78 % | Software-Engineering-Benchmark übertrifft Opus 4.6 (55 %) deutlich | Erste Wahl für Programmierung und technische Aufgaben |

| Preis nur 1/50 von Opus | Input $0,30/M, Output $1,20/M Token | Massive Kostensenkung bei Unternehmensbereitstellungen |

Detaillierte technische Architektur von MiniMax-M2.7

MiniMax-M2.7 nutzt eine Sparse Mixture-of-Experts (MoE) Transformer-Architektur mit insgesamt 230B Parametern, wobei pro Token lediglich 10B Parameter aktiviert werden. Dieses Design macht M2.7 zum kompaktesten Modell seiner Leistungsklasse – es erzielt mit minimalen Rechenressourcen eine Tier-1-Performance auf dem Niveau von Claude Opus 4.6 und GPT-5.

Das Kontextfenster umfasst 205K Token (ca. 307 DIN-A4-Seiten) und unterstützt Szenarien wie die Analyse langer Dokumente oder das Verständnis großer Codebasen. Im Artificial Analysis Intelligence Index belegt M2.7 mit der vollen Punktzahl von 50 den ersten Platz unter 136 vergleichbaren Modellen.

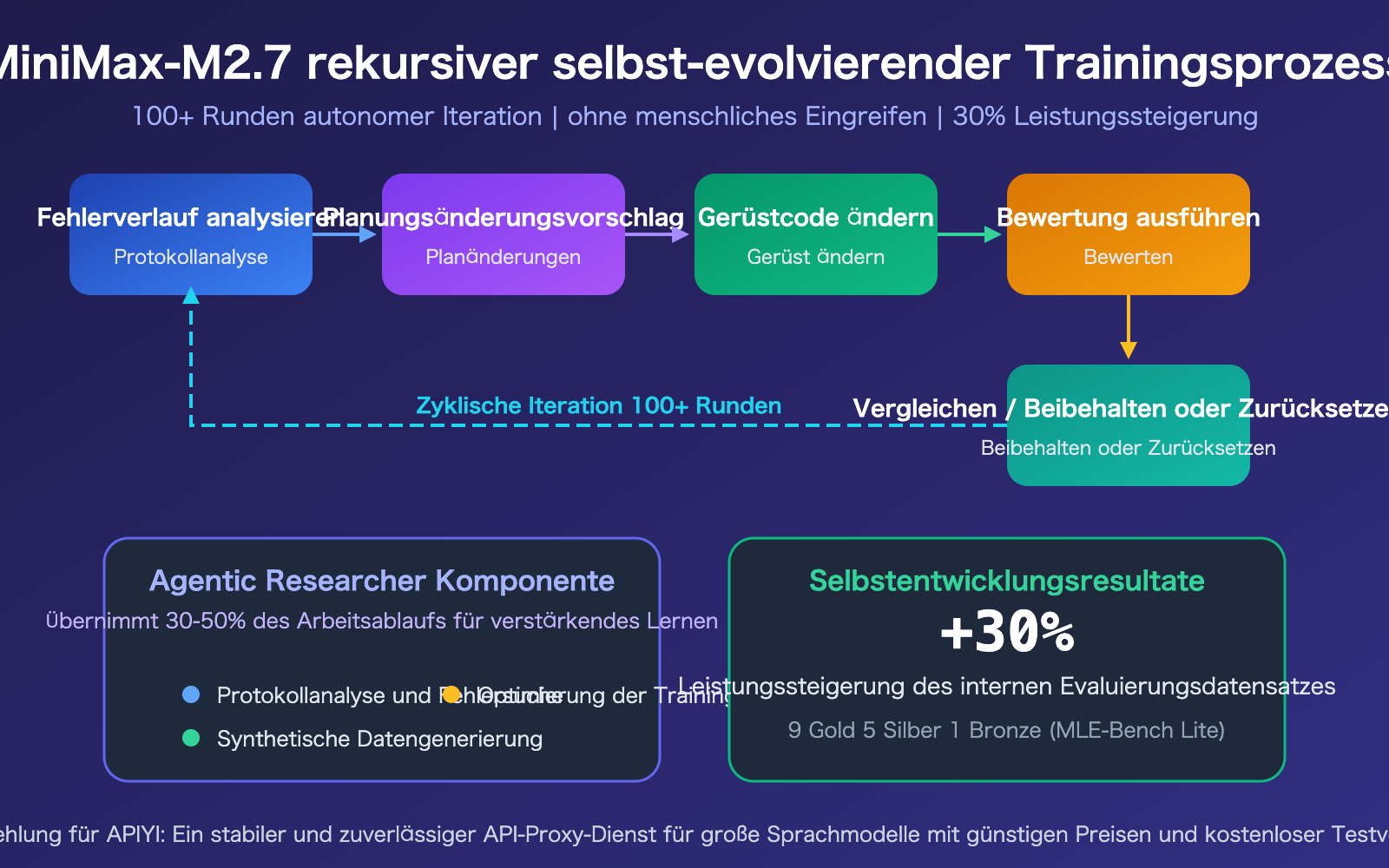

Der rekursive Selbstevaluationsmechanismus von MiniMax-M2.7

Die „rekursive Selbstevaluation“ ist das bahnbrechendste technische Merkmal von M2.7. Während des Trainings durchläuft das Modell autonom einen vollständigen iterativen Zyklus: Analyse von Fehlerverläufen → Planung von Korrekturen → Anpassung des Trainings-Gerüsts → Durchführung von Bewertungen → Ergebnisvergleich → Entscheidung über Beibehaltung oder Rücknahme. Dieser Prozess wurde über 100 Mal vollkommen eigenständig durchlaufen.

Die Kernkomponente „Agentic Researcher“ übernimmt 30–50 % des Workflows für das verstärkende Lernen (Reinforcement Learning), einschließlich Log-Analyse und Debugging, Generierung synthetischer Daten sowie Optimierung der Trainingsumgebung. Dies führte zu einer Leistungssteigerung von 30 % ohne menschliches Zutun.

MiniMax-M2.7 Leistungs-Benchmarks und Modellvergleich

MiniMax-M2.7 Benchmark-Ergebnisse

| Benchmark | M2.7 Score | Claude Opus 4.6 | GPT-5 Serie | Anmerkung |

|---|---|---|---|---|

| SWE-bench Verified | 78% | 55% | — | Software-Engineering-Praxis, deutlich führend |

| SWE-Pro | 56,2% | ~57% | 56,2% (Codex) | Nahe am Flaggschiff-Niveau |

| VIBE-Pro | 55,6% | — | — | End-to-End-Projektabwicklung |

| Terminal Bench 2 | 57,0% | — | — | Komplexe technische Systeme |

| MLE-Bench Lite | 66,6% | 75,7% | 71,2% (5.4) | ML-Wettbewerbe, 9 Gold, 5 Silber, 1 Bronze |

| GDPval-AA ELO | 1495 | — | — | Platz 1 bei Büro-Produktivität |

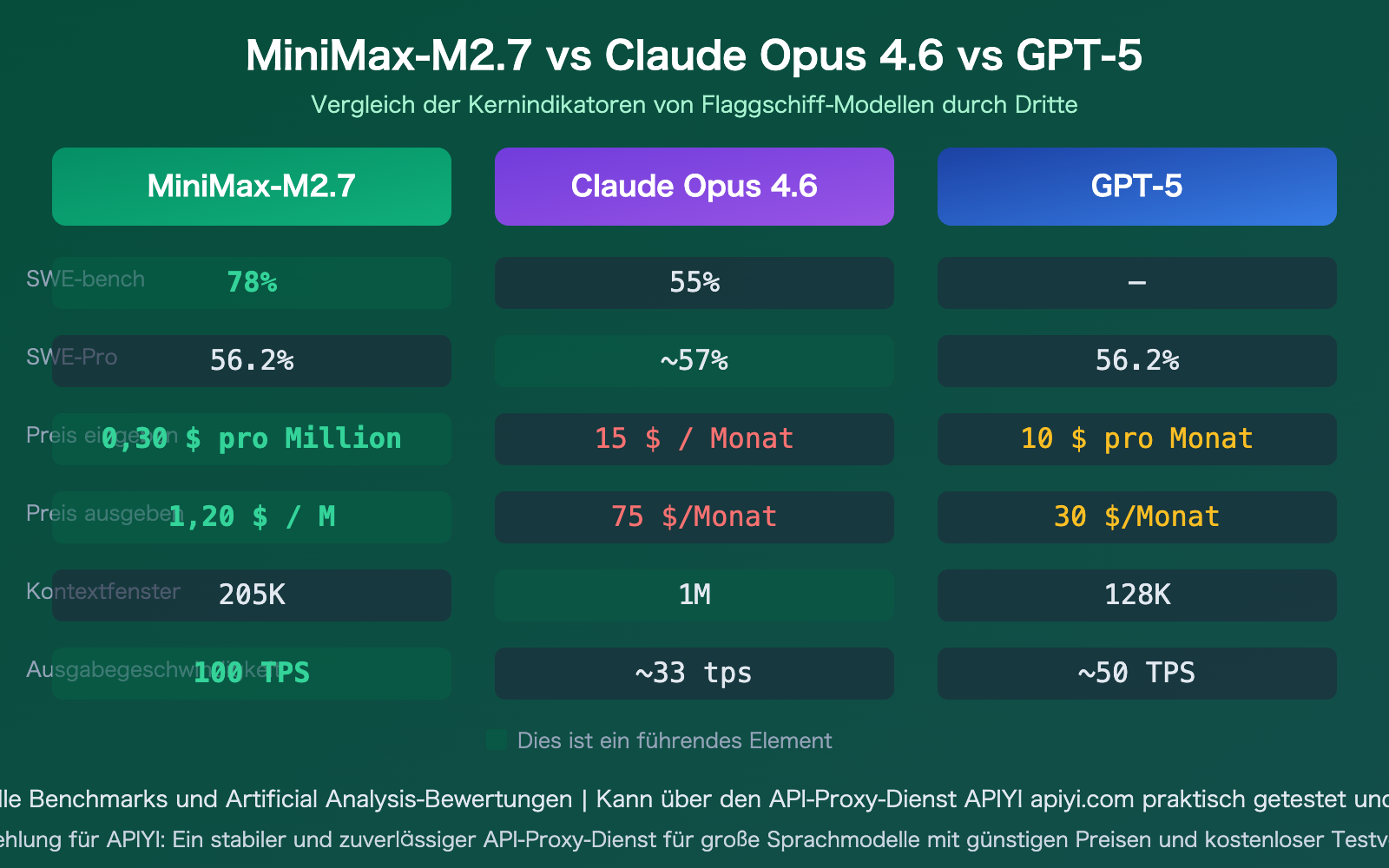

MiniMax-M2.7 Preisvergleich

Die Preisstrategie von M2.7 ist äußerst aggressiv; bei nahezu identischer Leistung liegen die Kosten nur bei einem Bruchteil der führenden Flaggschiff-Modelle:

| Metrik | MiniMax-M2.7 | Claude Opus 4.6 | GPT-5 | Kostenfaktor |

|---|---|---|---|---|

| Eingabepreis | $0,30/M | $15/M | $10/M | 50x / 33x günstiger |

| Ausgabepreis | $1,20/M | $75/M | $30/M | 62x / 25x günstiger |

| Kontextfenster | 205K | 1M | 128K | Dazwischen liegend |

| Aktive Parameter | 10B | — | — | Kleinstes Tier-1-Modell |

🎯 Empfehlung: MiniMax-M2.7 überzeugt bei Programmier- und Engineering-Aufgaben mit einem exzellenten Preis-Leistungs-Verhältnis. Wir empfehlen den schnellen Zugriff über die Plattform APIYI apiyi.com, die eine einheitliche Schnittstelle für Modellaufrufe von MiniMax-M2.7 und M2.7-highspeed bietet und den direkten Vergleich mit anderen Flaggschiff-Modellen erleichtert.

MiniMax-M2.7-highspeed: Die High-Speed-Variante im Detail

MiniMax-M2.7-highspeed ist die leistungsoptimierte Version der M2.7-Flaggschiff-Serie. Sie liefert identische Ergebnisse wie die Standardversion – das Intelligenzniveau ist gleich, doch die Highspeed-Version wurde speziell für latenzkritische Anwendungen entwickelt.

Kernvorteile von MiniMax-M2.7-highspeed

- Ausgabegeschwindigkeit: Erreicht 100 Tokens/s, eine Steigerung von 66 % gegenüber der Standardversion

- Sub-Sekunden-Latenz: Optimierte Zeit bis zum ersten Token (Time-to-First-Token), ideal für Echtzeit-Interaktionen

- Verbesserte Inferenz-Architektur: Die zugrunde liegende Inferenz-Engine ist spezialisiert optimiert, keine einfache Quantisierungs-Degradierung

- Ergebniskonsistenz: Liefert exakt die gleichen Ergebnisse wie die Standardversion, ohne Einbußen bei der Intelligenz

Einsatzgebiete für MiniMax-M2.7-highspeed

| Szenario | Anmerkung | Warum highspeed? |

|---|---|---|

| Interaktive Programmier-Assistenten | Echtzeit-Code-Vervollständigung und Refactoring in der IDE | Sub-Sekunden-Reaktion verbessert das Coding-Erlebnis |

| Echtzeit-Agenten-Schleifen | Mehrstufige Inferenz-Ausführung in Agent-Loops | Reduziert Wartezeiten pro Schritt, beschleunigt den Gesamtprozess |

| Durchsatzstarke Unternehmens-Pipelines | Batch-Dokumentenverarbeitung, Datenextraktion | 100 tps verkürzen die Bearbeitungszeit massiv |

| Online-Kundensysteme | Echtzeit-Dialoge und Problemlösung | Schnelle Reaktion für den Nutzer nicht wahrnehmbar |

Hinweis: Wenn Ihre Anwendung strenge Anforderungen an die Reaktionsgeschwindigkeit stellt, ist MiniMax-M2.7-highspeed eine der schnellsten Optionen unter den Flaggschiff-Modellen. Über APIYI apiyi.com können Sie dieses Modell direkt ansteuern.

Schnelleinstieg in die MiniMax-M2.7 API

Minimalbeispiel

Hier ist der einfachste Code, um MiniMax-M2.7 über die APIYI-Plattform aufzurufen – er ist in nur 10 Zeilen einsatzbereit:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="MiniMax-M2.7",

messages=[{"role": "user", "content": "Analysiere die Leistungsengpässe dieses Codes und gib Optimierungsvorschläge"}]

)

print(response.choices[0].message.content)

Vollständige Implementierung anzeigen (inkl. Wechsel zur Highspeed-Version)

import openai

from typing import Optional

def call_minimax_m27(

prompt: str,

model: str = "MiniMax-M2.7",

system_prompt: Optional[str] = None,

max_tokens: int = 2000,

use_highspeed: bool = False

) -> str:

"""

Aufruf von MiniMax-M2.7 oder M2.7-highspeed

Args:

prompt: Benutzereingabe

model: Modellname

system_prompt: System-Eingabeaufforderung

max_tokens: Maximale Anzahl der Ausgabe-Token

use_highspeed: Ob die Highspeed-Version verwendet werden soll

"""

if use_highspeed:

model = "MiniMax-M2.7-highspeed"

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

response = client.chat.completions.create(

model=model,

messages=messages,

max_tokens=max_tokens

)

return response.choices[0].message.content

# Aufruf der Standardversion

result = call_minimax_m27(

prompt="Implementiere einen effizienten LRU-Cache in Python",

system_prompt="Du bist ein erfahrener Python-Entwickler"

)

# Aufruf der Highspeed-Version (geeignet für Echtzeitszenarien)

fast_result = call_minimax_m27(

prompt="Erkläre kurz die Funktion dieses Codes",

use_highspeed=True

)

Tipp: Holen Sie sich kostenloses Testguthaben über APIYI (apiyi.com), um die Leistung von MiniMax-M2.7 schnell in Ihren Geschäftsszenarien zu validieren. Die Plattform unterstützt den einfachen Wechsel zwischen der Standard- und der Highspeed-Version.

Vergleich von MiniMax-M2.7 mit Konkurrenzmodellen

| Lösung | Hauptmerkmale | Anwendungsbereiche | Preis-Leistungs-Verhältnis |

|---|---|---|---|

| MiniMax-M2.7 | 10B aktive Parameter, SWE-bench 78% | Programmierung, Agent-Workflows, Großskalierung | Exzellent ($0,30/$1,20) |

| M2.7-highspeed | 100 tps, 66% Geschwindigkeitsvorteil | Echtzeit-Interaktion, IDE-Integration, Agent-Loop | Exzellent + Schnell |

| Claude Opus 4.6 | 1M Kontextfenster, stärkste Gesamtleistung | Lange Dokumente, komplexe Schlussfolgerungen, Allrounder | Mittel ($15/$75) |

| GPT-5 | Reifes Ökosystem, multimodale Unterstützung | Allgemeine Szenarien, multimodale Anwendungen | Mittel ($10/$30) |

Hinweis zum Vergleich: Die oben genannten Daten stammen aus offiziellen Benchmarks und Drittanbieter-Bewertungen von Artificial Analysis. Sie können diese über die APIYI-Plattform (apiyi.com) selbst vergleichen und validieren.

Häufig gestellte Fragen

Q1: Gibt es Unterschiede in den Ergebnissen zwischen MiniMax-M2.7 und M2.7-highspeed?

Die Ausgabe ist bei beiden identisch. Die highspeed-Version erreicht durch eine Optimierung der Inferenz-Engine eine schnellere Token-Generierung (100 tps), ohne dabei die Intelligenz oder die Qualität der Ausgabe zu beeinträchtigen. Wenn Ihr Anwendungsfall nicht latenzkritisch ist, können Sie problemlos die Standardversion verwenden.

Q2: Bedeutet die „rekursive Selbstevolution“ von MiniMax-M2.7, dass sich das Modell ständig verändert?

Nein. Die rekursive Selbstevolution ist eine technische Methode, die MiniMax während der Trainingsphase einsetzt – das Modell hat den Trainingsprozess und die Parameter autonom iterativ optimiert. Sobald das Modell veröffentlicht ist, sind die Gewichte fixiert. Über die API erhalten Sie daher stets stabile und konsistente Ergebnisse.

Q3: Wie kann ich MiniMax-M2.7 schnell testen?

Wir empfehlen die Nutzung einer API-Aggregationsplattform, die mehrere Modelle unterstützt:

- Besuchen Sie APIYI unter apiyi.com und registrieren Sie ein Konto.

- Erhalten Sie Ihren API-Schlüssel und ein kostenloses Guthaben.

- Nutzen Sie die Codebeispiele in diesem Artikel für eine schnelle Validierung.

- Wechseln Sie einfach den

model-Parameter, um zwischen der Standard- und der highspeed-Version umzuschalten.

Fazit

Die wichtigsten Punkte für den Modellaufruf von MiniMax-M2.7:

- Hervorragendes Preis-Leistungs-Verhältnis: 10B aktive Parameter erreichen Tier-1-Leistung bei nur 1/50 der Kosten von Opus – die erste Wahl für groß angelegte Implementierungen.

- Herausragende Programmierfähigkeiten: Mit 78 % bei SWE-bench Verified liegt es weit vor der Konkurrenz und überzeugt bei Software-Engineering-Aufgaben.

- highspeed-Version: Die Ausgabegeschwindigkeit von 100 tps eignet sich ideal für Echtzeit-Interaktionen und Agenten-Schleifen, bei identischer Intelligenz wie die Standardversion.

Für Entwickler und Unternehmenskunden, die Wert auf Effizienz legen, ist MiniMax-M2.7 eines der derzeit bemerkenswertesten Flaggschiff-Modelle auf dem Markt.

Wir empfehlen die schnelle Validierung über APIYI (apiyi.com). Die Plattform bietet ein kostenloses Guthaben, eine einheitliche Schnittstelle für verschiedene Modelle und ermöglicht den nahtlosen Wechsel zwischen der Standard- und highspeed-Version von MiniMax-M2.7.

📚 Referenzmaterialien

-

Offizielle Veröffentlichung von MiniMax M2.7: Details zur Modellarchitektur und zur Selbstentwicklungstechnologie

- Link:

minimax.io/news/minimax-m27-en - Beschreibung: Offizieller technischer Blog mit Benchmarks und Architekturdetails

- Link:

-

MiniMax M2.7 Modellseite: Technische Spezifikationen und API-Dokumentation

- Link:

minimax.io/models/text/m27 - Beschreibung: Modellparameter, Preisgestaltung und Integrationsmöglichkeiten

- Link:

-

Artificial Analysis Bewertung: Unabhängige Leistungsbewertung durch Dritte

- Link:

artificialanalysis.ai/models/minimax-m2-7 - Beschreibung: Unabhängige Bewertungsdaten zu Geschwindigkeit und Intelligenzindex

- Link:

-

APIYI-Plattformdokumentation: Schnelle Integration von MiniMax-M2.7

- Link:

docs.apiyi.com - Beschreibung: Erhalt des API-Schlüssels, Modellliste und Beispiele für den Modellaufruf

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren. Weitere Informationen finden Sie im APIYI-Dokumentationszentrum unter docs.apiyi.com