Примечание автора: Глубокий разбор ключевых возможностей, показателей производительности и способов подключения API для моделей MiniMax-M2.7 и M2.7-highspeed, которые помогут разработчикам получить флагманские возможности ИИ с минимальными затратами.

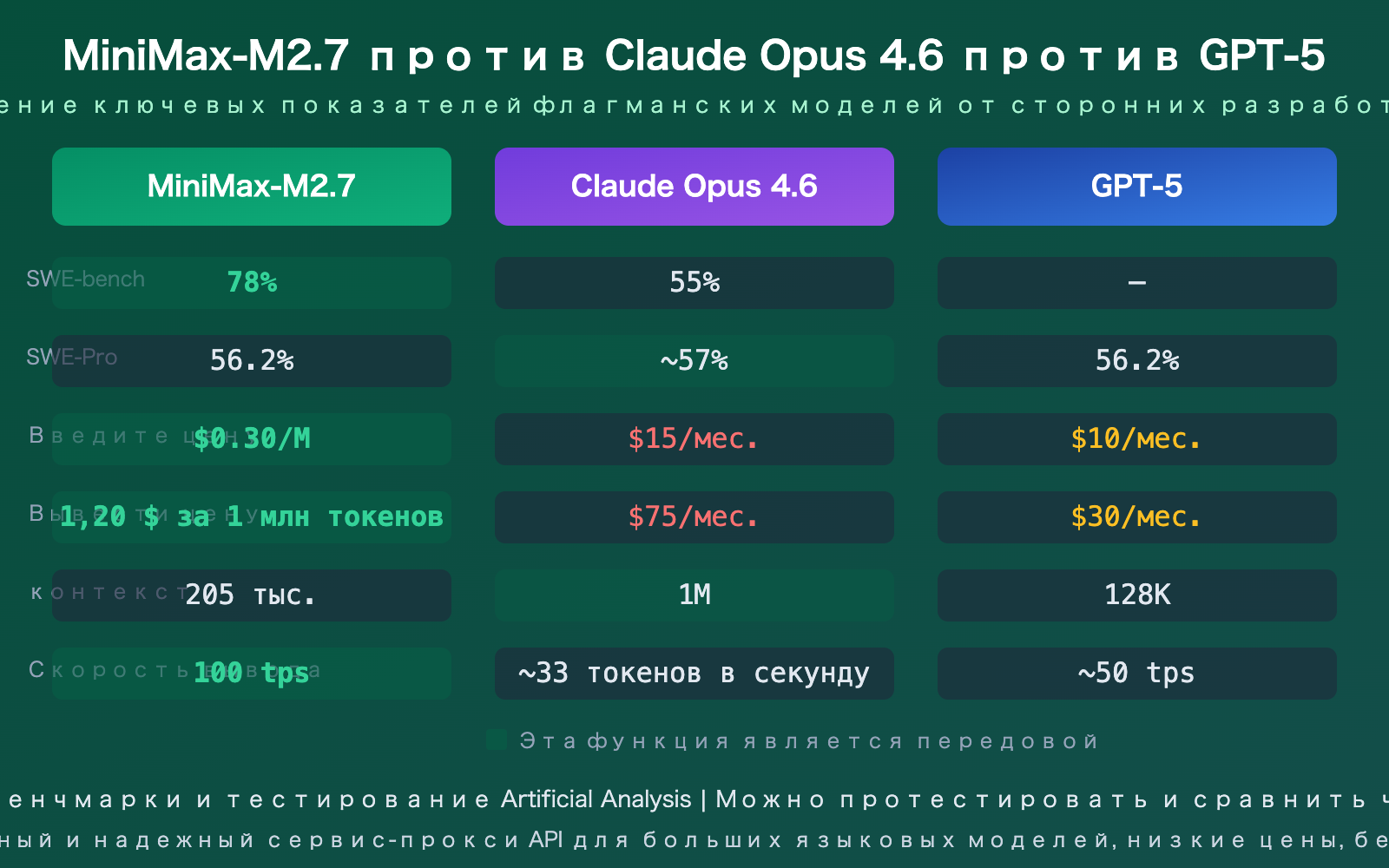

18 марта 2026 года компания MiniMax представила флагманскую большую языковую модель MiniMax-M2.7 — первую модель, которая самостоятельно участвует в процессе собственной эволюции. Используя всего 10 млрд активных параметров, она достигла уровня производительности Tier-1, сопоставимого с Claude Opus 4.6 и GPT-5, при этом её стоимость в 50 раз ниже, чем у основных флагманов. Одновременно была выпущена версия MiniMax-M2.7-highspeed, которая увеличивает скорость вывода на 66%, достигая 100 токенов в секунду (tps).

Ключевая ценность: С помощью реальных данных тестирования и руководства по интеграции мы поможем вам определить, является ли MiniMax-M2.7 лучшим выбором флагманской модели по соотношению цены и качества на сегодняшний день.

Основные характеристики MiniMax-M2.7

| Характеристика | Описание | Преимущество |

|---|---|---|

| 230B общих / 10B активных параметров | Архитектура MoE (смесь экспертов), при каждом выводе активируется только 10 млрд параметров | Флагманская производительность + низкая стоимость вывода |

| Рекурсивное самообучение | Модель самостоятельно выполнила 100+ итераций для оптимизации процесса обучения | Повышение производительности на 30% без участия человека |

| SWE-bench 78% | Значительно опережает Opus 4.6 (55%) в инженерных задачах | Лучший выбор для программирования и разработки |

| Цена в 50 раз ниже Opus | Вход $0.30/млн, выход $1.20/млн токенов | Резкое снижение затрат на корпоративное развертывание |

Подробный разбор архитектуры MiniMax-M2.7

MiniMax-M2.7 использует архитектуру разреженной смеси экспертов (Sparse Mixture-of-Experts) Transformer. Общее количество параметров составляет 230 млрд, но для каждого токена активируется только 10 млрд. Такая конструкция делает M2.7 самой компактной моделью в своем классе, обеспечивая производительность уровня Tier-1 (наравне с Claude Opus 4.6 и GPT-5) при минимальных вычислительных затратах.

Контекстное окно составляет 205 тыс. токенов (около 307 страниц формата A4), что позволяет анализировать длинные документы и понимать крупные кодовые базы. В рейтинге Artificial Analysis Intelligence Index модель M2.7 заняла первое место среди 136 аналогичных моделей, набрав 50 баллов из 50.

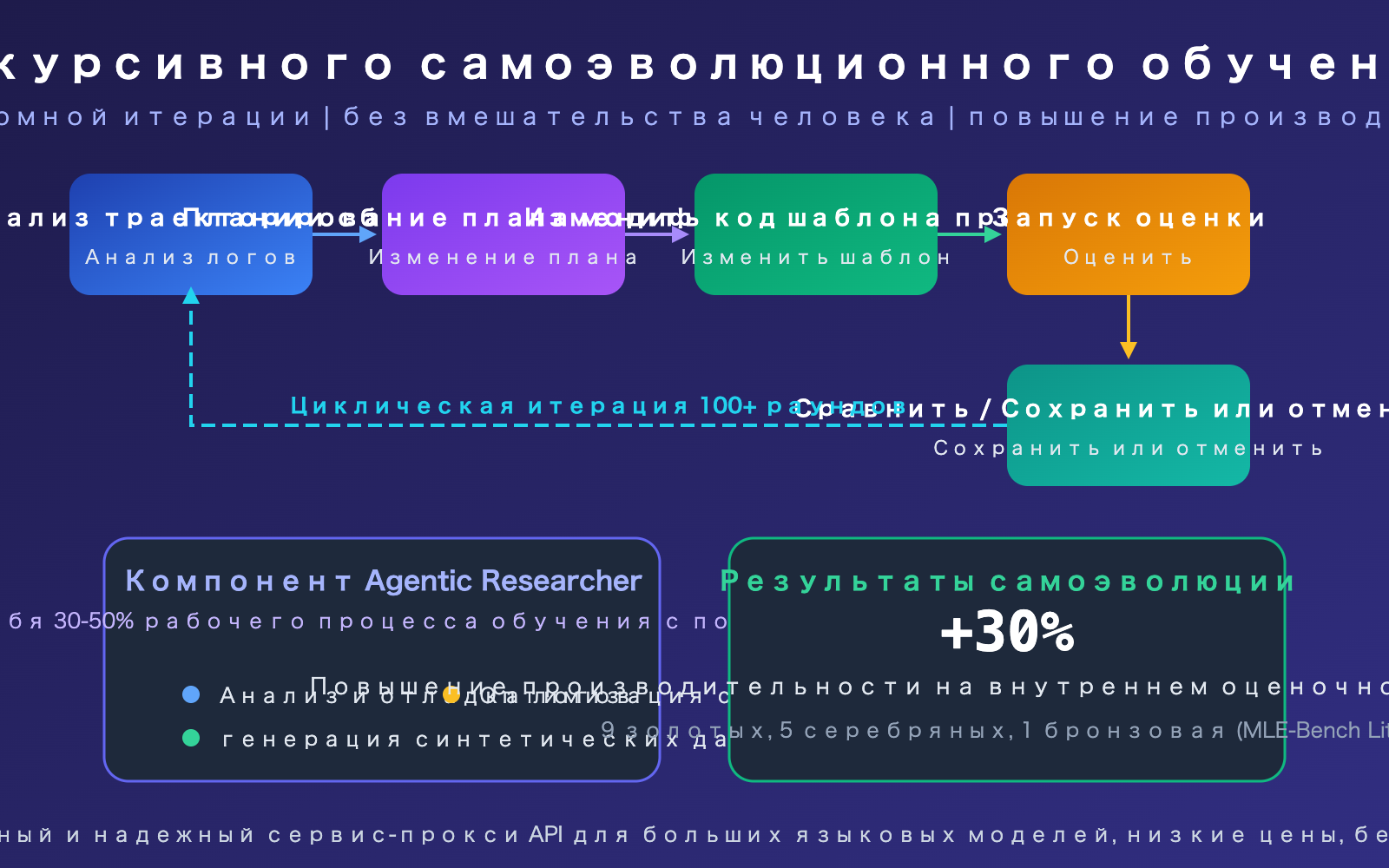

Механизм рекурсивного самообучения MiniMax-M2.7

«Рекурсивное самообучение» — самая инновационная техническая особенность M2.7. В процессе обучения модель самостоятельно выполняет полный итерационный цикл: анализ неудачных попыток → планирование изменений → модификация кода обучения → запуск оценки → сравнение результатов → принятие решения о сохранении или откате. Этот процесс автономно прошел более 100 итераций.

Ключевой компонент «Agentic Researcher» взял на себя 30–50% задач обучения с подкреплением, включая анализ логов, отладку, генерацию синтетических данных и оптимизацию среды обучения. В итоге удалось добиться повышения производительности на 30% без вмешательства человека.

Сравнительный анализ производительности MiniMax-M2.7

Результаты бенчмарков MiniMax-M2.7

| Бенчмарк | M2.7 Score | Claude Opus 4.6 | GPT-5 Series | Примечание |

|---|---|---|---|---|

| SWE-bench Verified | 78% | 55% | — | Практическая разработка ПО, значительный отрыв |

| SWE-Pro | 56.2% | ~57% | 56.2% (Codex) | Уровень флагманских моделей |

| VIBE-Pro | 55.6% | — | — | Сдача проектов «под ключ» |

| Terminal Bench 2 | 57.0% | — | — | Сложные инженерные системы |

| MLE-Bench Lite | 66.6% | 75.7% | 71.2% (5.4) | ML-соревнования, 9 золотых, 5 серебряных, 1 бронзовая медаль |

| GDPval-AA ELO | 1495 | — | — | №1 в офисной продуктивности |

Сравнение цен MiniMax-M2.7

Ценовая стратегия M2.7 выглядит крайне агрессивно: при практически идентичном уровне производительности стоимость использования в десятки раз ниже, чем у ведущих флагманских моделей:

| Показатель | MiniMax-M2.7 | Claude Opus 4.6 | GPT-5 | Разница (во сколько раз) |

|---|---|---|---|---|

| Цена на вход | $0.30/M | $15/M | $10/M | в 50x / 33x дешевле |

| Цена на выход | $1.20/M | $75/M | $30/M | в 62x / 25x дешевле |

| Контекстное окно | 205K | 1M | 128K | Среднее значение |

| Активные параметры | 10B | — | — | Самая компактная модель Tier-1 |

🎯 Совет по выбору: MiniMax-M2.7 отлично справляется с задачами программирования и инженерии, предлагая выдающееся соотношение цены и качества. Рекомендуем протестировать модель через платформу APIYI (apiyi.com). Она поддерживает унифицированный интерфейс для вызова MiniMax-M2.7 и M2.7-highspeed, что позволяет легко сравнивать их с другими флагманскими моделями в реальных условиях.

Обзор высокоскоростной версии MiniMax-M2.7-highspeed

MiniMax-M2.7-highspeed — это оптимизированная по производительности версия флагманской серии M2.7. Она выдает абсолютно идентичные результаты, что и стандартная версия — уровень интеллекта моделей совпадает, однако версия highspeed специально разработана для сценариев, чувствительных к задержкам.

Ключевые преимущества MiniMax-M2.7-highspeed

- Скорость генерации: достигает 100 токенов/с, что на 66% быстрее стандартной версии

- Субсекундная задержка: оптимизировано время отклика первого токена, идеально для интерактивных приложений

- Улучшенная архитектура вывода: движок вывода оптимизирован на низком уровне, это не просто упрощенная квантованная версия

- Идентичность результатов: выдает точно такие же ответы, как и стандартная версия, без ущерба для качества

Сценарии использования MiniMax-M2.7-highspeed

| Сценарий | Описание | Почему стоит выбрать highspeed |

|---|---|---|

| Интерактивные помощники по коду | Автодополнение и рефакторинг в IDE в реальном времени | Мгновенный отклик улучшает опыт написания кода |

| Циклы агентов (Agent Loop) | Многошаговое рассуждение и выполнение действий | Сокращает время ожидания каждого шага, ускоряя процесс |

| Корпоративные конвейеры | Пакетная обработка документов, извлечение данных | 100 tps значительно сокращают время выполнения задач |

| Системы онлайн-поддержки | Диалоги в реальном времени и ответы на вопросы | Быстрый отклик, незаметный для пользователя |

Совет: Если ваше приложение предъявляет строгие требования к скорости отклика, MiniMax-M2.7-highspeed — один из самых быстрых вариантов среди флагманских моделей на текущий момент. Вы можете вызвать эту модель напрямую через APIYI (apiyi.com).

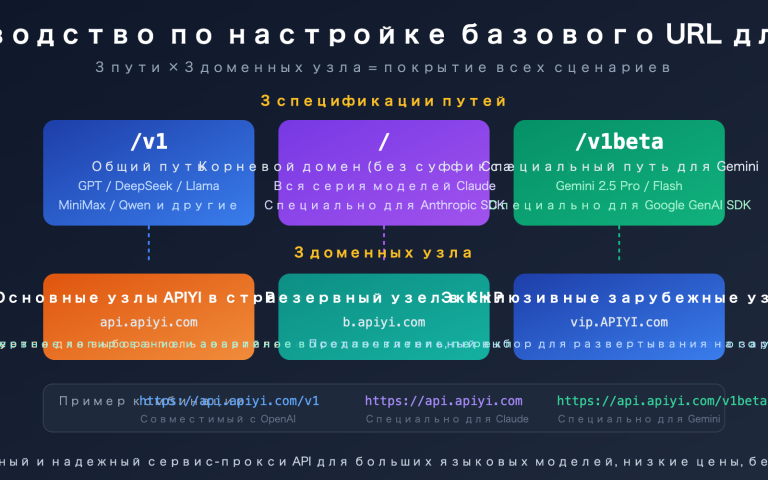

Быстрый старт с API MiniMax-M2.7

Минималистичный пример

Вот самый простой код для вызова MiniMax-M2.7 через платформу APIYI — для запуска достаточно 10 строк:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="MiniMax-M2.7",

messages=[{"role": "user", "content": "Проанализируй узкие места производительности в этом коде и дай рекомендации по оптимизации"}]

)

print(response.choices[0].message.content)

Посмотреть полный код (включая переключение на версию highspeed)

import openai

from typing import Optional

def call_minimax_m27(

prompt: str,

model: str = "MiniMax-M2.7",

system_prompt: Optional[str] = None,

max_tokens: int = 2000,

use_highspeed: bool = False

) -> str:

"""

Вызов MiniMax-M2.7 или M2.7-highspeed

Args:

prompt: ввод пользователя

model: название модели

system_prompt: системный промпт

max_tokens: максимальное количество токенов на выходе

use_highspeed: использовать ли версию highspeed

"""

if use_highspeed:

model = "MiniMax-M2.7-highspeed"

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

response = client.chat.completions.create(

model=model,

messages=messages,

max_tokens=max_tokens

)

return response.choices[0].message.content

# Вызов стандартной версии

result = call_minimax_m27(

prompt="Реализуй эффективный LRU-кэш на Python",

system_prompt="Ты опытный Python-разработчик"

)

# Вызов версии highspeed (подходит для сценариев реального времени)

fast_result = call_minimax_m27(

prompt="Быстро объясни, что делает этот код",

use_highspeed=True

)

Совет: Получите бесплатные тестовые лимиты на платформе APIYI (apiyi.com), чтобы быстро проверить работу MiniMax-M2.7 в ваших задачах. Платформа поддерживает переключение между стандартной версией и highspeed в один клик.

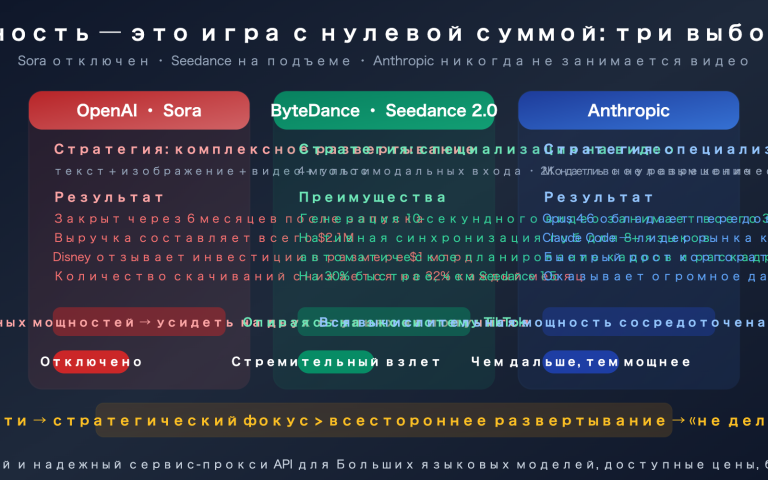

Сравнение MiniMax-M2.7 с моделями конкурентов

| Модель | Основные характеристики | Сценарии использования | Соотношение цена/качество |

|---|---|---|---|

| MiniMax-M2.7 | 10B активных параметров, SWE-bench 78% | Программирование, Agent-воркфлоу, масштабное развертывание | Очень высокое ($0.30/$1.20) |

| M2.7-highspeed | 100 tps, прирост скорости 66% | Интерактив в реальном времени, IDE, Agent Loop | Очень высокое + скорость |

| Claude Opus 4.6 | Контекстное окно 1M, мощная логика | Длинные документы, сложные рассуждения, универсальные задачи | Среднее ($15/$75) |

| GPT-5 | Зрелая экосистема, мультимодальность | Общие задачи, мультимодальные приложения | Среднее ($10/$30) |

Примечание к сравнению: Данные основаны на официальных бенчмарках и независимом тестировании Artificial Analysis. Вы можете провести собственную проверку на платформе APIYI (apiyi.com).

Часто задаваемые вопросы

Q1: Есть ли разница в результатах между MiniMax-M2.7 и M2.7-highspeed?

Результаты генерации абсолютно идентичны. Версия highspeed использует оптимизированный движок логического вывода для достижения более высокой скорости генерации токенов (100 tps), при этом интеллект модели и качество ответов остаются прежними. Если ваш сценарий не чувствителен к задержкам, можно смело использовать стандартную версию.

Q2: Означает ли «рекурсивная самоэволюция» MiniMax-M2.7, что модель будет постоянно меняться?

Нет. Рекурсивная самоэволюция — это метод, который MiniMax применяет на этапе обучения: модель самостоятельно итеративно оптимизировала процесс обучения и параметры. После выпуска веса модели фиксируются. При вызове API вы будете получать стабильные и предсказуемые результаты.

Q3: Как быстро начать тестирование MiniMax-M2.7?

Рекомендуем использовать платформу агрегации API, поддерживающую множество моделей:

- Перейдите на APIYI (apiyi.com) и зарегистрируйте аккаунт.

- Получите API-ключ и бесплатные лимиты.

- Используйте примеры кода из этой статьи для быстрой проверки.

- Просто меняйте параметр

model, чтобы переключаться между стандартной и highspeed версиями.

Итоги

Ключевые моменты при работе с API MiniMax-M2.7:

- Исключительное соотношение цены и качества: 10 млрд активных параметров обеспечивают производительность уровня Tier-1 при цене в 50 раз ниже, чем у Opus, что делает модель отличным выбором для масштабного развертывания.

- Выдающиеся навыки программирования: показатель 78% в SWE-bench Verified значительно опережает конкурентов, что гарантирует превосходные результаты в задачах разработки ПО.

- Версия highspeed: скорость генерации 100 tps идеально подходит для интерактивных сценариев в реальном времени и циклов работы агентов, при этом уровень интеллекта полностью соответствует стандартной версии.

Для разработчиков и корпоративных пользователей, стремящихся к эффективности, MiniMax-M2.7 является одной из самых интересных флагманских моделей на рынке.

Рекомендуем протестировать возможности через APIYI (apiyi.com) — платформа предоставляет бесплатные лимиты, единый интерфейс для множества моделей и позволяет переключаться между стандартной и highspeed версиями MiniMax-M2.7 в один клик.

📚 Справочные материалы

-

Официальный анонс MiniMax M2.7: Подробности об архитектуре модели и технологии самообучения

- Ссылка:

minimax.io/news/minimax-m27-en - Описание: Официальный технический блог с результатами бенчмарков и деталями архитектуры.

- Ссылка:

-

Страница модели MiniMax M2.7: Технические спецификации и API-документация

- Ссылка:

minimax.io/models/text/m27 - Описание: Параметры модели, ценообразование и способы подключения.

- Ссылка:

-

Обзор от Artificial Analysis: Независимое тестирование производительности

- Ссылка:

artificialanalysis.ai/models/minimax-m2-7 - Описание: Данные независимых тестов скорости и интеллектуальных показателей.

- Ссылка:

-

Документация платформы APIYI: Быстрый старт с MiniMax-M2.7

- Ссылка:

docs.apiyi.com - Описание: Получение API-ключа, список моделей и примеры вызова модели.

- Ссылка:

Автор: Техническая команда APIYI

Техническое обсуждение: Приглашаем к дискуссии в комментариях. Дополнительные материалы доступны в документации APIYI по адресу docs.apiyi.com.