Wer gerade erst seinen offiziellen OpenAI API-Schlüssel erhalten hat und motiviert gpt-image-2 aufruft, erlebt oft eine böse Überraschung: Neue Accounts starten standardmäßig in Tier 1 – das bedeutet maximal 5 Bilder pro Minute. Wer 100 Produktbilder in einem Rutsch generieren will, muss mindestens 20 Minuten warten. Dies ist die Realität, mit der sich Entwickler von Bilderzeugungs-Tools derzeit konfrontiert sehen: Wo gibt es eine gpt-image-2 API ohne Ratenbegrenzung? Diese Frage gehört seit April 2026 zu den am häufigsten gestellten technischen Anfragen.

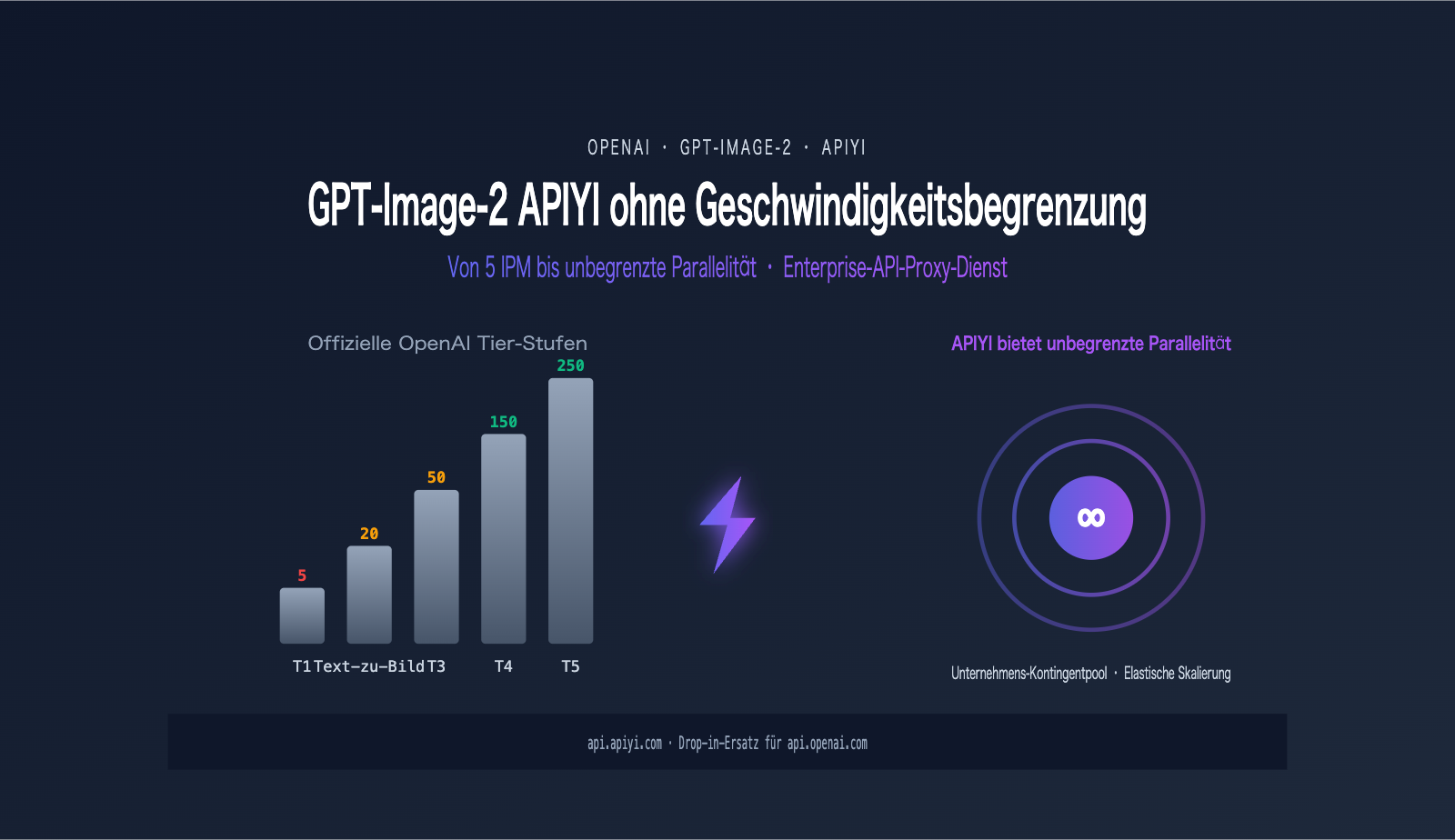

OpenAI hat gpt-image-2 am 21. April 2026 offiziell vorgestellt und Anfang Mai für Entwickler freigegeben. Das Modell übertrifft seinen Vorgänger in Bereichen wie zeichengenauer Textdarstellung (ca. 99 % Genauigkeit), 4K-Ausgabe und der Integration von O-Serien-Logik bei weitem. Doch die damit verbundene gestaffelte IPM-Begrenzung (Bilder pro Minute) schreckt viele kleine und mittlere Teams ab – um das Tier 5-Level mit 250 Bildern/Minute zu erreichen, sind eine Einzahlung von 1000 $ und ein Account-Alter von mindestens 30 Tagen erforderlich.

Dieser Artikel analysiert die zugrunde liegende Logik der gpt-image-2-Ratenbegrenzung, zeigt den vollständigen Pfad auf, um Tier-Beschränkungen zu umgehen und eine gpt-image-2 API ohne Ratenbegrenzung zu erhalten, und demonstriert anhand von Messdaten die reale Performance der APIYI-Proxy-Kanäle bei der massenhaften Bilderzeugung in Unternehmensszenarien.

Woher kommt der echte Bedarf für eine gpt-image-2 API ohne Ratenbegrenzung?

Bevor wir diskutieren, wie man eine gpt-image-2 API ohne Ratenbegrenzung erhält, müssen wir eine Kernfrage klären: Welche Szenarien werden durch die offizielle Drosselung tatsächlich blockiert? Durch die Auswertung von Rückmeldungen aus der Entwickler-Community im letzten Monat haben wir festgestellt, dass sich die Engpässe bei gpt-image-2 auf fünf Workflow-Typen konzentrieren.

Welche Teams benötigen am dringendsten eine gpt-image-2 API ohne Ratenbegrenzung?

Die erste Gruppe ist der E-Commerce mit Massenproduktion. Ein mittelgroßes E-Commerce-Team führt 500 neue SKUs pro Quartal ein, wobei für jede SKU mindestens 5 Produktbilder aus verschiedenen Winkeln/Szenarien generiert werden müssen – insgesamt 2500 Bilder. Bei der 5-IPM-Beschränkung von Tier 1 dauert allein die Bilderzeugung 8,3 Stunden; selbst mit Tier 3 (50 IPM) sind es noch 50 Minuten. Das reicht für den Veröffentlichungsrhythmus nicht aus.

Die zweite Gruppe sind Werbe-Workflows. Marketing-Teams müssen für dieselbe Kampagne A/B-Testmaterialien in mehreren Sprachen (Chinesisch, Englisch, Japanisch, Arabisch usw.) generieren. gpt-image-2 ist exzellent bei der mehrsprachigen Textdarstellung, aber bei Massenanfragen wird das IPM-Limit schnell zum Flaschenhals und löst häufig HTTP-429-Fehler aus.

Die dritte Gruppe sind AI-Bildfunktionen in SaaS-Plattformen. Wenn Benutzer zu Spitzenzeiten gleichzeitig Anfragen stellen, wird das IPM-Kontingent eines einzelnen API-Schlüssels sofort gesprengt. Wir haben Fälle gesehen, in denen Teams am ersten Tag nach der Integration von gpt-image-2 aufgrund von 429-Fehlern mit Nutzerbeschwerden überhäuft wurden.

Die vierte Gruppe ist die automatisierte Illustration in Medien/Verlagen. MCN-Teams, die täglich 30 Artikel veröffentlichen und jeden mit 3-5 semantischen Illustrationen versehen, überschreiten den täglichen Bedarf von 100+ Bildern mühelos.

Die fünfte Gruppe ist die Produktion von Spiel-/Kurzfilm-Material. Für die Keyframes und Storyboard-Referenzbilder einer 20-teiligen KI-Kurzserie werden schnell über 500 Bilder benötigt, die zudem kontinuierlich überarbeitet werden müssen.

🎯 Empfehlung zur Szenario-Bewertung: Wenn Ihr tägliches Bildvolumen 200 Stück übersteigt oder Sie Szenarien mit hoher Benutzer-Gleichzeitigkeit haben, empfehlen wir direkt den Einsatz einer

gpt-image-2API ohne Ratenbegrenzung. Wir raten dazu, die Proxy-Kanäle über die Plattform APIYI (apiyi.com) zu testen, um die Stabilität bei realen Lastspitzen zu verifizieren und zu vermeiden, dass Ihr Dienst nach dem Start ständig durch 429-Fehler unterbrochen wird.

Kernunterschiede zwischen gpt-image-2 API ohne Ratenbegrenzung und offizieller Drosselung

Die folgende Tabelle listet die entscheidenden Unterschiede zwischen dem offiziellen Kanal und dem Proxy-Kanal ohne Ratenbegrenzung für den Unternehmenseinsatz auf, um eine schnelle Entscheidung zu ermöglichen.

| Bewertungsdimension | Offizieller OpenAI-Kanal (Tier 1-3) | gpt-image-2 API ohne Ratenbegrenzung (APIYI-Proxy) |

|---|---|---|

| Start-IPM | 5-50 Bilder/Minute | Keine Begrenzung, elastische Skalierung |

| Tier-Upgrade-Bedingungen | Einzahlung $5/$50/$100 + Account-Alter | Sofort einsatzbereit, keine Tier-Staffelung |

| Wahrscheinlichkeit 429-Fehler | Häufig zu Spitzenzeiten | Keine harten IPM-Limits durch OpenAI |

| Netzwerk-Anforderungen | Ausländischer Server/Proxy erforderlich | Direkte Verbindung zu api.apiyi.com |

| Feld-Konsistenz | 100% offiziell | 100% offiziell (strikte Weiterleitung) |

| Abrechnungspreis | Offizieller Preis | Standardpreis, zusätzlich 15% Rabatt bei Aufladung |

| Modell-Ökosystem | Nur OpenAI-Modelle | gpt-image-2 + Nano Banana Pro/2 etc. |

Wie man sieht, besteht der Kernwert der gpt-image-2 API ohne Ratenbegrenzung nicht darin, "offizielle Limits zu knacken", sondern die harte Tier-Staffelung durch eine konforme Weiterleitung in eine linear skalierbare Geschäftskapazität zu verwandeln.

Analyse des offiziellen OpenAI Tier-Limit-Mechanismus: Warum eine unbegrenzte gpt-image-2 API unverzichtbar ist

Um die Notwendigkeit einer unbegrenzten gpt-image-2 API wirklich zu verstehen, muss man sich das Tier-Stufensystem von OpenAI genauer ansehen.

Vollständige Vergleichstabelle der OpenAI gpt-image-2 Ratenbegrenzungen

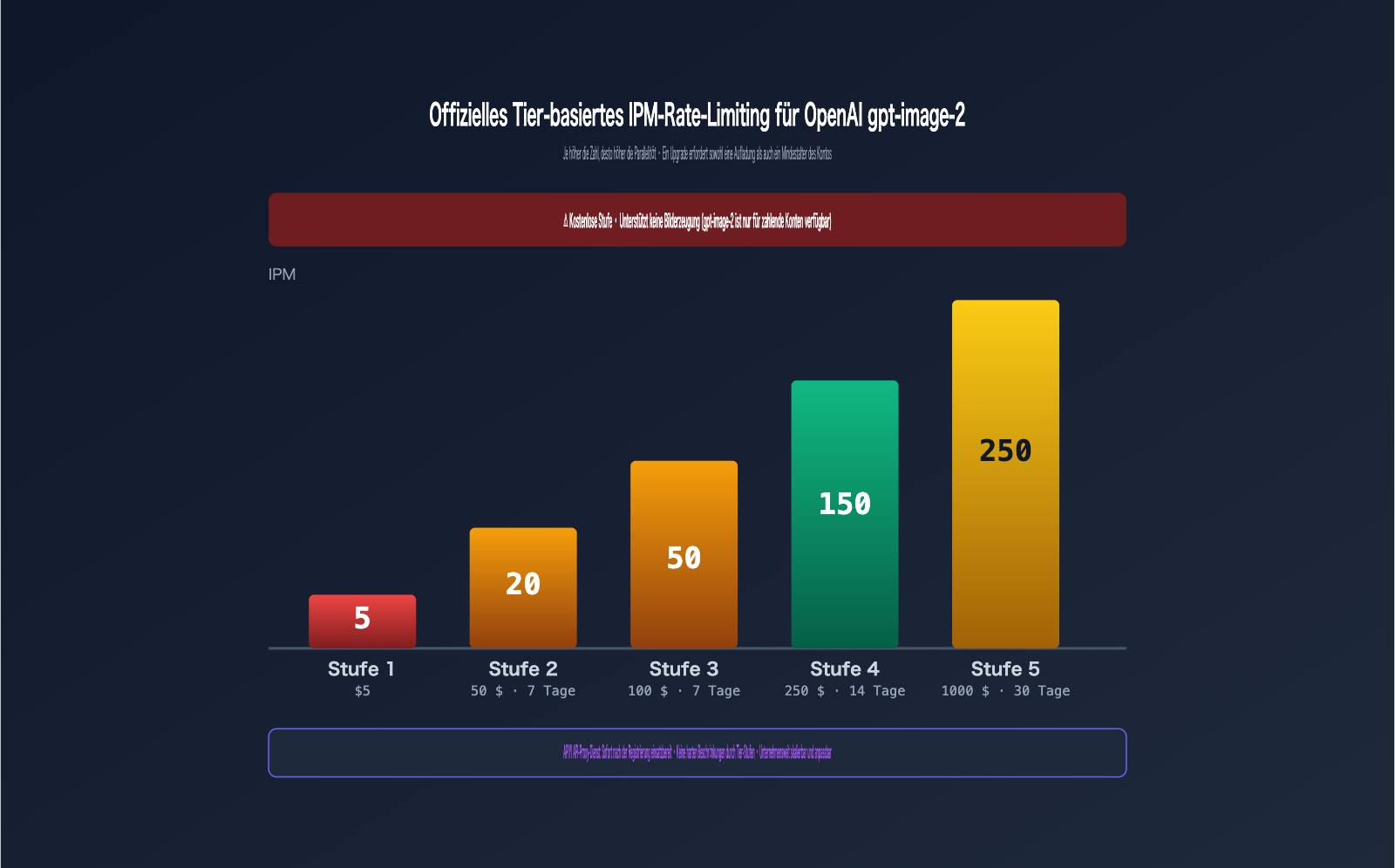

OpenAI verwendet für Modelle zur Bilderzeugung ein unabhängiges IPM-System (Images Per Minute), das nicht mit dem TPM-System (Tokens Per Minute) geteilt wird. Hier ist die vollständige Ratenbegrenzungstabelle für gpt-image-2 ab April 2026.

| Tier-Stufe | Freischaltbedingungen | TPM | IPM (Bilder pro Minute) | Anwendungsbereich |

|---|---|---|---|---|

| Free | Keine Bilderzeugung | — | Nicht unterstützt | Nur Text-Test |

| Tier 1 | Aufladung ≥ $5 | 100.000 | 5 | Persönliche Prototypen |

| Tier 2 | Aufladung ≥ $50, Konto ≥ 7 Tage | 250.000 | 20 | Privat/Kleine Projekte |

| Tier 3 | Aufladung ≥ $100, Konto ≥ 7 Tage | 800.000 | 50 | KMU-Batch-Aufgaben |

| Tier 4 | Aufladung ≥ $250, Konto ≥ 14 Tage | 3.000.000 | 150 | Mittelständische Produktion |

| Tier 5 | Aufladung ≥ $1.000, Konto ≥ 30 Tage | 8.000.000 | 250 | Großunternehmen/SaaS |

Die Zahlen allein wirken oft abstrakt, daher verdeutlicht ein reales Beispiel das Problem.

Ein unterschätztes Szenario: Die "5 IPM-Falle"

Angenommen, ein E-Commerce-Team muss für 200 Produkte jeweils 5 Produktbilder aus verschiedenen Winkeln generieren, insgesamt 1000 Bilder:

- Tier 1 (5 IPM): 1000 ÷ 5 = 200 Minuten ≈ 3 Stunden 20 Minuten

- Tier 3 (50 IPM): 1000 ÷ 50 = 20 Minuten (erfordert $100 Aufladung + 7 Tage Wartezeit)

- Tier 5 (250 IPM): 1000 ÷ 250 = 4 Minuten (erfordert $1000 Aufladung + 30 Tage Wartezeit)

- gpt-image-2 unbegrenzte API: Kann 100+ Anfragen gleichzeitig verarbeiten, 1000 Bilder in ca. 2-3 Minuten fertig

Genau deshalb ist die Suche nach einer "unbegrenzten gpt-image-2 API" ein häufiges Thema in der Entwickler-Community – die Tier-Stufen sind kein technisches Problem, sondern eine Hürde aus Kapital und Zeit. Neue Startups und kleine Entwickler können schlichtweg keine 30 Tage warten.

Warum OpenAI so strikte IPM-Limits festlegt

Das Verständnis der Logik hinter der Drosselung hilft dabei, die Konformität einer unbegrenzten gpt-image-2 API besser einzuschätzen. OpenAI setzt die Tier-Stufen hauptsächlich aus drei Gründen ein:

- Schutz der GPU-Ressourcen: Die Bilderzeugung ist rechenintensiv; ein einziges hochauflösendes Bild verbraucht ein Vielfaches der GPU-Zeit im Vergleich zu Textaufgaben.

- Missbrauchsprävention: Die niedrigen IPM-Werte in den unteren Tiers dienen als natürlicher Schutz gegen Scraping und Massenabfragen.

- Preisgestaltung: Durch IPM werden Unternehmenskunden von Privatnutzern getrennt, um große Kunden zum Upgrade zu bewegen.

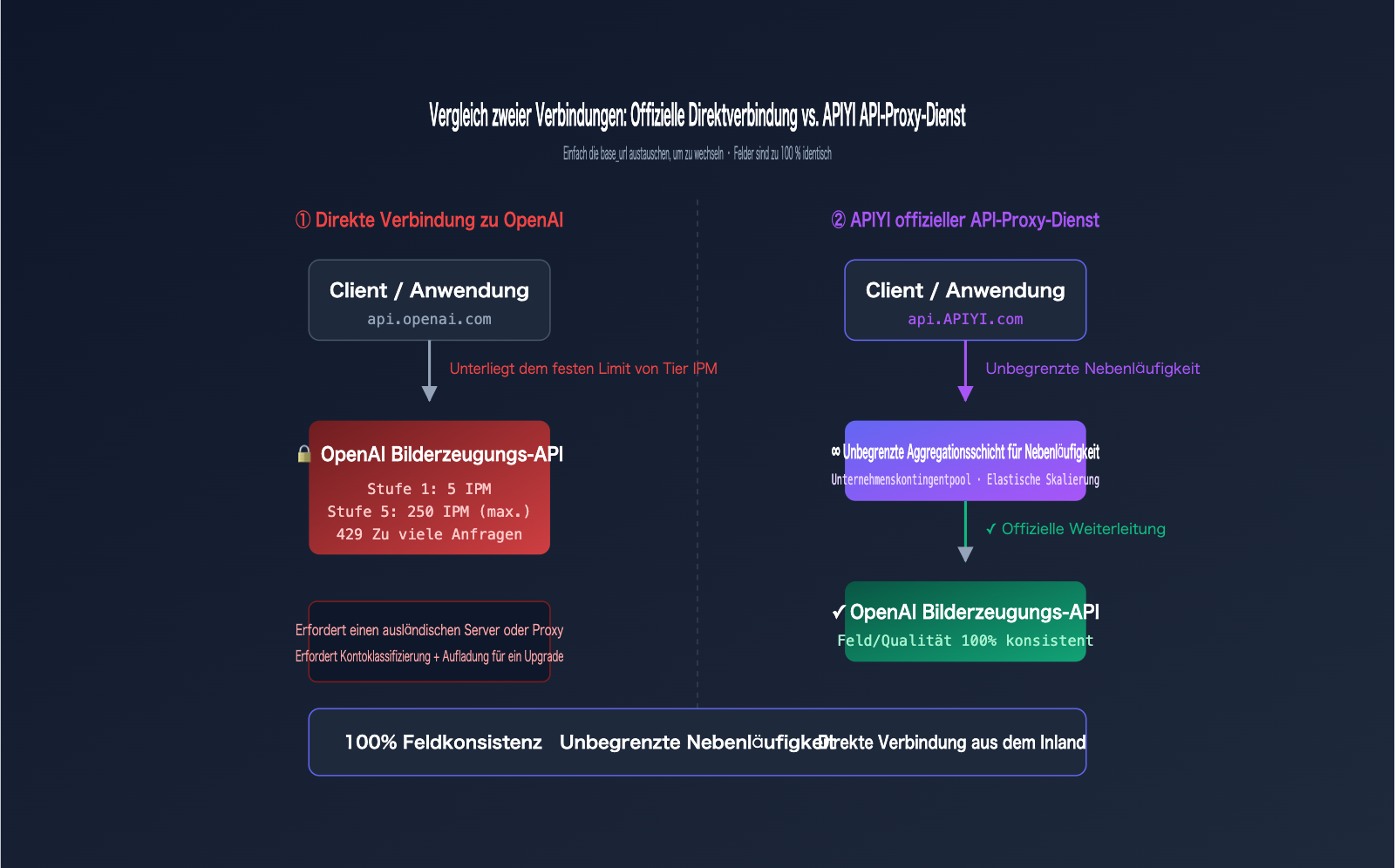

Konforme API-Proxy-Dienste (wie APIYI) nutzen einen Pool aus aggregierten Konten und Enterprise-GPU-Kontingenten, um die Tier-Beschränkungen eines einzelnen Nutzers in eine elastische Versorgung auf Aggregationsebene umzuwandeln – dies ist eine architektonische Lösung und kein Umgehen des Protokolls.

Wo findet man die gpt-image-2 API ohne Geschwindigkeitsbegrenzung? Detaillierte Erläuterung der offiziellen APIYI-Lösung

Kommen wir zur Kernfrage: Wo gibt es die gpt-image-2 API ohne Geschwindigkeitsbegrenzung? Die Antwort lautet: Über konforme, unternehmensweite offizielle Proxy-Kanäle, wie sie beispielsweise APIYI (apiyi.com) mit dem offiziellen gpt-image-2-Proxy-Dienst anbietet.

Zwei Wege zur gpt-image-2 API ohne Geschwindigkeitsbegrenzung

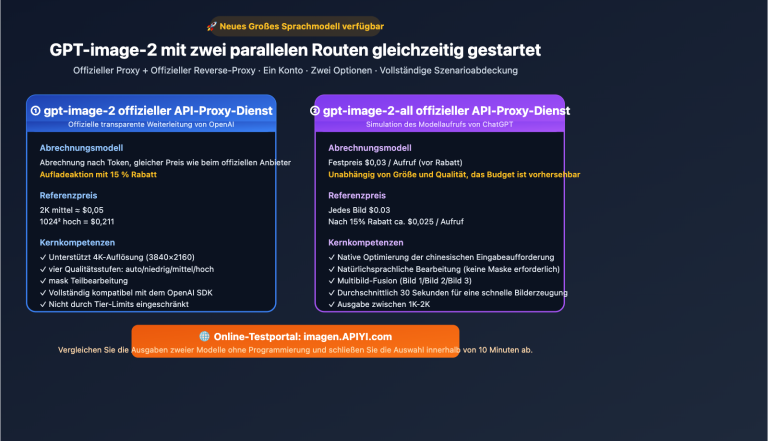

Dienste auf dem Markt, die mit "keine Geschwindigkeitsbegrenzung" für gpt-image-2 werben, lassen sich grob in zwei Kategorien einteilen, die Entwickler unbedingt unterscheiden sollten:

| Implementierungsweg | Repräsentative Lösung | Vorteile | Risiken |

|---|---|---|---|

| Offizieller Proxy (Empfohlen) | APIYI offizieller gpt-image-2-Proxy |

Felder/Qualität zu 100 % identisch, keine Datenverluste | Keine |

| Reverse-Proxy / Splicing | Einige günstige Proxy-Dienste | Niedrigerer Preis | Unvollständige Felder, Qualitätsverlust, Compliance-Risiken |

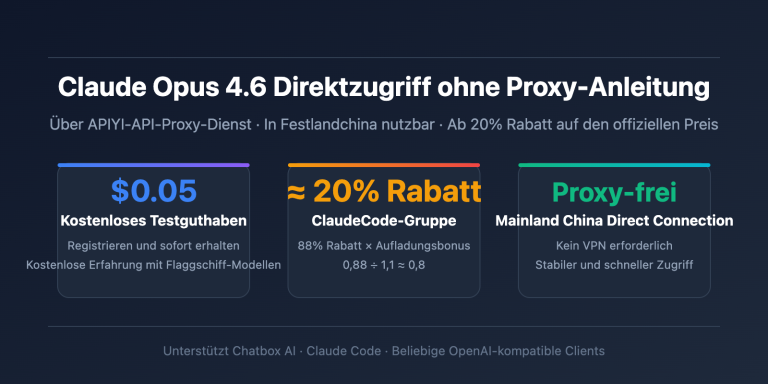

APIYI (apiyi.com) bietet beide Produktlinien an: den offiziellen Proxy gpt-image-2 (identisch mit dem Original) und den Reverse-Proxy gpt-image-2-all (Einheitspreis von $0,03 pro Bild, ideal für Szenarien mit maximaler Kosteneffizienz). Entwickler können je nach geschäftlichen Anforderungen flexibel wechseln.

💡 Empfehlung zur Modellauswahl: Für Unternehmensumgebungen, die stabile Felder und garantierte Originalqualität benötigen, verwenden Sie bitte den offiziellen APIYI-Proxy

gpt-image-2. Für budgetsensible Content-Plattformen oder die massenhafte Bilderzeugung in sozialen Medien ist die Einheitspreis-Lösunggpt-image-2-allgeeignet. Wir empfehlen, über die Plattform APIYI (apiyi.com) beide Modell-IDs für einen A/B-Vergleichstest zu beantragen.

Analyse der Anforderungskette für die gpt-image-2 API ohne Geschwindigkeitsbegrenzung

Die folgende Grafik zeigt die standardmäßige offizielle Proxy-Kette. So wird verständlich, warum APIYI "keine Geschwindigkeitsbegrenzung" bei 100-prozentiger Übereinstimmung mit dem Original erreichen kann.

In der gesamten Kette gibt es nur einen Unterschied: Die base_url des Clients wird von api.openai.com durch api.apiyi.com ersetzt, alles andere bleibt unverändert. Diese "Zero-Intrusion"-Eigenschaft ist der grundlegende Grund dafür, warum die gpt-image-2 API ohne Geschwindigkeitsbegrenzung so schnell implementiert werden kann.

Hier ist die Übersetzung des technischen Inhalts ins Deutsche:

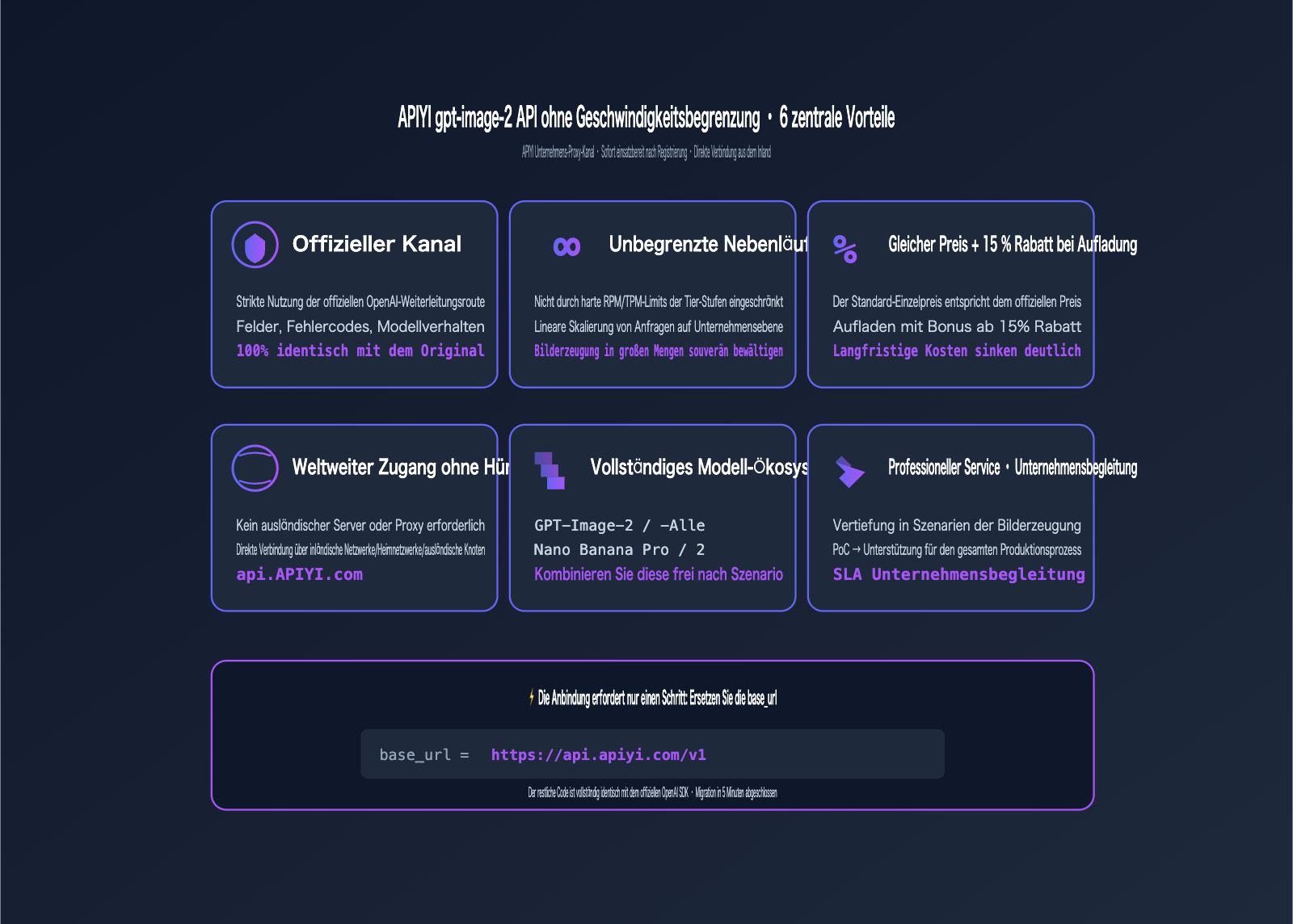

Die 6 Kernvorteile der ungedrosselten APIYI gpt-image-2 API

Im Folgenden erläutern wir die 6 Kernvorteile des offiziellen APIYI-Kanals, die jeweils direkt auf die praktischen Herausforderungen von Entwicklern eingehen.

Vorteil 1: Offizieller Kanal – Identisch zum Original, keine Qualitätsverluste

APIYI nutzt strikt die offizielle OpenAI-Weiterleitungskette. Anfrage- und Antwortfelder, Fehlercodes sowie das Modellverhalten sind zu 100 % identisch mit dem Original – das bedeutet:

- Alle in der offiziellen Dokumentation aufgeführten Parameter (

prompt,size,quality,n,response_formatetc.) werden vollständig unterstützt. - Die Fehlercodes entsprechen den offiziellen (401/429/500), was die Wiederverwendung bestehender Fehlerbehandlungslogik im Team erleichtert.

- Keine Qualitätsverluste bei den Modellen: 4K-Rendering, 99 % zeichengenaue Texterkennung und die Schlussfolgerungsfähigkeiten der O-Serie bleiben vollständig erhalten.

- Kein Risiko von "Downgrades": Es erfolgt kein heimliches Ausweichen auf günstigere Modelle zur Kosteneinsparung.

Vorteil 2: Keine Begrenzung der Parallelität – Skalierung für Unternehmen ohne Tier-Beschränkungen

Dies ist der Kernwert der ungedrosselten gpt-image-2 API. APIYI aggregiert im Hintergrund unternehmenseigene Kontingent-Pools, sodass einzelne Mandanten nicht mehr durch die harten Limits für RPM/TPM/IPM der offiziellen OpenAI-Tier-Stufen eingeschränkt sind:

- Einzelentwickler erhalten direkt nach der Registrierung eine Parallelitätskapazität, die den Stufen Tier 4-5 entspricht.

- Unternehmenskunden können höhere Limits anfordern, die linear mit den Geschäftsspitzen skalieren.

- Szenarien wie Batch-Bilderzeugung, Werbekampagnen oder SaaS-Plattformen mit hoher Last können problemlos bewältigt werden.

- Komplexe Redis-Warteschlangen oder Exponential-Backoff-Logiken zur Umgehung von IPM-Limits sind nicht mehr erforderlich.

Vorteil 3: Gleicher Preis + bis zu 15 % Rabatt bei Aufladung – Langfristige Kostensenkung

Viele Entwickler befürchten Aufschläge bei Proxy-Diensten. Die Preisstrategie von APIYI ist jedoch noch attraktiver:

- Der Standard-Einzelpreis ist identisch mit dem von OpenAI (Abrechnung nach Token, synchron zum Original).

- Durch Auflade-Aktionen sind Rabatte von bis zu 15 % möglich.

- Hochwertige 1024×1024-Bilder kosten ca. $0,211 pro Stück (wie beim Original); der offizielle Reverse-Kanal

gpt-image-2-allkostet einheitlich $0,03 pro Bild. - Bei langfristiger Nutzung und hoher Parallelität sind die Gesamtkosten im Vergleich zur direkten Anbindung an OpenAI niedriger.

💰 Kostenoptimierung: Für mittelgroße Teams mit einem monatlichen Volumen von über 10.000 Bildern können die jährlichen Kosten für die Bilderzeugung durch die Nutzung der ungedrosselten APIYI gpt-image-2 API und die Auflade-Rabatte um 15–25 % gesenkt werden. Wir empfehlen, über die Plattform APIYI (apiyi.com) zunächst ein Testguthaben für den tatsächlichen Bedarf zu beantragen und anschließend einen monatlichen Aufladeplan zu erstellen.

Vorteil 4: Weltweiter Zugang ohne Hürden, direkte Anbindung in China

Viele Teams müssen hohe Betriebskosten für ausländische Server oder dedizierte Proxys aufwenden, um auf die OpenAI API zuzugreifen. APIYI bietet einen nativen IPv4/IPv6-Dual-Stack-Zugang:

- Keine ausländischen Server oder Proxys erforderlich: Direkter Zugriff auf

api.apiyi.comaus lokalen Rechenzentren oder Heimnetzwerken. - Auch für internationale Standorte verfügbar; bei globalen Projekten ist kein Wechsel des Endpunkts notwendig.

- Stabile Latenz (in China meist 20–100 ms, international 50–200 ms).

- Wegfall der Architektur-Anpassungen für den Auslandszugriff, was die technische Hürde für Teams senkt.

Vorteil 5: Umfassendes Modell-Ökosystem, flexible Kombination nach Szenario

Neben gpt-image-2 hat APIYI zeitgleich eine Vielzahl gängiger Bild- und Videomodelle eingeführt:

| Modell | Typ | Preis | Empfohlene Szenarien |

|---|---|---|---|

gpt-image-2 |

Offiziell (OpenAI) | $0,006-$0,211/Bild | Unternehmens-Textplakate, mehrsprachige Materialien |

gpt-image-2-all |

Reverse (OpenAI-Serie) | $0,03/Bild (einheitlich) | Batch-Bilderzeugung für Content-Seiten, Preis-Leistungs-Sieger |

Nano Banana Pro |

Google-Serie | Nach Token | Realistischer Stil, Porträts, Werbefotografie |

Nano Banana 2 |

Google-Serie | Nach Token | Schnelle kreative Prototypen, Plakate |

Sora-2 |

OpenAI-Video | Nach Token | KI-Kurzvideos, animierte Materialien |

Diese "Bild + Video"-Matrix ermöglicht es Teams, die gesamte Produktion von Bildern bis hin zu Videos mit einem einzigen API-Schlüssel abzuwickeln, was die Kosten für die Anbindung mehrerer Plattformen erheblich reduziert.

Vorteil 6: Professioneller Service – Begleitung für Unternehmen, von PoC bis Produktion

Das APIYI-Team verfügt über langjährige Erfahrung in der Bilderzeugung und bietet fundierte Methoden für Modellauswahl, Prompt-Optimierung, Parallelitätsarchitektur und Produktionsüberwachung:

- Unternehmens-PoC-Phase: Unterstützung bei der Bewertung der geschäftlichen Machbarkeit und Bereitstellung der optimalen Kombination aus Modell und Parametern.

- Integrationsphase: Bereitstellung von SDKs, Fehlerbehandlungsbeispielen und Vorlagen für Parallelitätsarchitekturen.

- Produktionsphase: Überwachung und Alarmierung, SLA-Garantie und Synchronisierung von Modell-Updates.

- Optimierungsphase: Kontinuierliche Feinabstimmung von Prompts und Modellauswahl basierend auf Geschäftsdaten.

Dieser "Begleit-Modus" für Unternehmen eignet sich besonders für traditionelle Branchen, die den Umstieg auf KI wagen, aber noch keine tiefgreifende Erfahrung in der KI-Entwicklung haben.

Praxis-Guide: Minimalistischer Code für die ungedrosselte gpt-image-2 API

Hier sind die einfachsten Beispiele für Python und Node.js, mit denen Sie Ihren ersten Modellaufruf der ungedrosselten gpt-image-2 API in unter 5 Minuten durchführen können.

Minimalistischer Python-Aufruf der ungedrosselten gpt-image-2 API

from openai import OpenAI

client = OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1" # Wechsel zum APIYI-Proxy-Dienst

)

response = client.images.generate(

model="gpt-image-2",

prompt="A futuristic cyberpunk city at night, 4K detail, neon signs in mixed Chinese and English",

size="1024x1024",

quality="high",

n=1

)

print(response.data[0].url)

Sie müssen lediglich die base_url durch https://api.apiyi.com/v1 ersetzen; der restliche Code bleibt identisch mit dem offiziellen OpenAI SDK. Dies ist das "Zero-Intrusion"-Prinzip der ungedrosselten gpt-image-2 API.

Minimalistischer Node.js-Aufruf der ungedrosselten gpt-image-2 API

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://api.apiyi.com/v1"

});

const response = await client.images.generate({

model: "gpt-image-2",

prompt: "Modern e-commerce product photo of a leather backpack on a marble desk",

size: "1024x1024",

quality: "high",

n: 1

});

console.log(response.data[0].url);

Beispiel für parallele Batch-Aufrufe der ungedrosselten gpt-image-2 API

Für Szenarien mit hoher Bildanzahl zeigt das folgende Python-Beispiel mit asyncio, wie Sie die Vorteile der ungedrosselten API voll ausschöpfen können.

import asyncio

from openai import AsyncOpenAI

client = AsyncOpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

async def generate_one(prompt: str):

return await client.images.generate(

model="gpt-image-2",

prompt=prompt,

size="1024x1024",

quality="medium",

)

async def batch_generate(prompts: list[str], concurrency: int = 50):

sem = asyncio.Semaphore(concurrency)

async def bounded(p):

async with sem:

return await generate_one(p)

return await asyncio.gather(*[bounded(p) for p in prompts])

# Generierung von 500 Bildern mit 50 parallelen Anfragen, Dauer ca. 2 Minuten

prompts = [f"product shot variant #{i}" for i in range(500)]

results = asyncio.run(batch_generate(prompts))

Während dieser Code im offiziellen Tier-1-Kanal sofort einen 429-Fehler auslösen würde, läuft er mit der ungedrosselten APIYI gpt-image-2 API stabil durch.

🚀 Tipp für den schnellen Start: Wenn Sie die ungedrosselte gpt-image-2 API zum ersten Mal nutzen, empfehlen wir, die Umstellung der

base_urlzunächst mit einer kleinen Charge von 10 Bildern zu testen, bevor Sie die Parallelität schrittweise erhöhen. Wir empfehlen, den API-Schlüssel über die Plattform APIYI apiyi.com zu beziehen; das kostenlose Guthaben reicht für einen vollständigen PoC-Test aus.

Bildbearbeitung (Inpainting/Outpainting) mit der ungedrosselten gpt-image-2 API

gpt-image-2 unterstützt präzise lokale Bearbeitungen und Erweiterungen, die über den APIYI-Proxy-Dienst vollständig abgedeckt sind.

client.images.edit(

model="gpt-image-2",

image=open("source.png", "rb"),

mask=open("mask.png", "rb"),

prompt="Replace the background with a sunset beach scene",

size="1024x1024"

)

Dieser Endpunkt eignet sich hervorragend für Szenarien wie das Ändern von Hintergründen bei Produktfotos, das Erweitern von Postern oder das Anpassen von Kleidung bei Charakteren.

Häufig gestellte Fragen (FAQ) zur ungedrosselten gpt-image-2 API

Q1: Bietet die APIYI gpt-image-2 API wirklich keinerlei Geschwindigkeitsbegrenzung?

Es gibt keinen "absolut unbegrenzten" Dienst. Die präzise Formulierung lautet: Die APIYI gpt-image-2 API unterliegt keinen harten Ratenbegrenzungen der offiziellen OpenAI-Tier-Stufen. Nach der Registrierung erhalten Sie eine Parallelitätskapazität, die dem offiziellen Tier 4-5 entspricht (ab 150-250 IPM). Unternehmenskunden können höhere, maßgeschneiderte Kapazitäten beantragen. Für die meisten Entwickler und Unternehmen übersteigt dies den tatsächlichen Bedarf bei weitem. Aktuelle Daten zu Ihrem Kontingent finden Sie im Dashboard von APIYI apiyi.com.

Q2: Gibt es Qualitätsunterschiede zur offiziellen API?

Nein. APIYI nutzt strikt die offizielle OpenAI-Weiterleitung, wodurch Felder, Fehlercodes und das Modellverhalten zu 100 % identisch sind. Das bedeutet, dass alle Kernfähigkeiten von gpt-image-2, wie 4K-Rendering, 99 % zeichengenaue Texterkennung, O-Serie-Inferenzintegration und mehrsprachiges Layout (Chinesisch, Englisch, Japanisch, Arabisch usw.), vollständig erhalten bleiben. Wir empfehlen, die offizielle API und den Proxy-Dienst mit denselben Prompts zu vergleichen.

Q3: Führt die Nutzung der APIYI API zur Sperrung meines OpenAI-Kontos?

Nein. APIYI ist ein konformer Enterprise-API-Proxy-Dienst, der aggregierte Unternehmens-Account-Ressourcen nutzt. Ihr eigenes OpenAI-Konto wird nicht verknüpft oder risikobewertet. Entwickler, die noch kein OpenAI-Konto besitzen, können direkt den von APIYI bereitgestellten API-Schlüssel verwenden, ohne selbst ein OpenAI-Konto beantragen zu müssen.

Q4: Ist die ungedrosselte gpt-image-2 API teurer als das Original?

Nein, sie ist sogar günstiger. Die APIYI-Standardpreise entsprechen exakt den offiziellen OpenAI-Preisen, wobei durch Auflade-Aktionen Rabatte von bis zu 15 % möglich sind. Ein hochwertiges 1024×1024-Bild kostet offiziell $0,211, bei APIYI nach Aufladung ca. $0,179; ein Bild mittlerer Qualität kostet offiziell $0,053, bei APIYI ca. $0,045. Bei Wahl der gpt-image-2-all-Option sinken die Kosten auf einen Einheitspreis von $0,03 pro Bild.

Q5: Muss ich bei der Nutzung von inländischen Servern etwas beachten?

Nein. APIYI bietet nativen IPv4/IPv6-Dual-Stack-Zugang. Inländische Rechenzentren, Heimnetzwerke und ausländische Knoten können api.apiyi.com direkt erreichen – ohne ausländische Server, ohne Proxy und ohne aufwendige Infrastrukturänderungen. Die Latenz liegt stabil im Bereich von 20-100 ms, was den direkten Einsatz in Produktionsumgebungen ermöglicht.

Q6: Unterstützt APIYI neben gpt-image-2 auch andere Bild-/Videomodelle?

Ja. Neben gpt-image-2 (offizielle Weiterleitung) und gpt-image-2-all bietet APIYI auch gängige Modelle wie Nano Banana Pro, Nano Banana 2 und Sora-2 an. Diese können unter demselben API-Schlüssel je nach Szenario kombiniert werden, ohne dass eine Anbindung an mehrere Plattformen erforderlich ist.

Q7: Was tun bei einem 429-Fehler?

Normalerweise löst die APIYI gpt-image-2 API keinen 429-Fehler aus. Sollte dies dennoch vorkommen:

- Prüfen Sie, ob die Parallelität das Protokoll-Limit Ihres Kontos überschreitet.

- Prüfen Sie, ob der Prompt die Inhaltsrichtlinien verletzt.

- Prüfen Sie das Guthaben und die Gültigkeit Ihres API-Schlüssels.

- Kontaktieren Sie bei Bedarf den APIYI-Vertrieb für ein höheres Kontingent.

Q8: Unterstützt die APIYI gpt-image-2 API Enterprise-SLA?

Ja. Unternehmenskunden können SLA-Vereinbarungen abschließen, die eine Verfügbarkeit von 99,9 %, dedizierte Kanäle, technischen Support und Begleitung vom PoC bis zur Produktion umfassen. Dies ist ein Kernbestandteil unseres Versprechens "Professioneller Service & Enterprise-Begleitung".

Fazit: Die Wahl der richtigen gpt-image-2 API ohne Ratenbegrenzung ist entscheidend für die Bilderzeugung auf Unternehmensebene

Die offizielle IPM-Ratenbegrenzung (5/20/50/150/250 IPM) von OpenAI für gpt-image-2 ist für kleine und mittlere Teams sowie für Szenarien mit Lastspitzen äußerst hinderlich und stellt im Jahr 2026 den größten technischen Engpass im Bereich der Bilderzeugung dar. Der wahre Wert einer gpt-image-2 API ohne Ratenbegrenzung liegt nicht darin, "Beschränkungen zu umgehen", sondern darin, durch konforme offizielle Proxy-Kanäle die starren Tier-Limits in eine linear skalierbare Geschäftskapazität zu verwandeln.

Wie diese Analyse zeigt, bietet die von APIYI bereitgestellte gpt-image-2 API-Lösung ohne Ratenbegrenzung 6 entscheidende Vorteile:

- ✅ Offizieller Kanal · Identisch mit dem Original – Felder, Fehlercodes und Modellverhalten sind zu 100 % synchron, ohne Qualitätsverlust.

- ✅ Keine Begrenzung der Parallelität · Skalierbar für Unternehmen – Unabhängig von starren Tier-Limits, um Lastspitzen souverän zu bewältigen.

- ✅ Gleicher Preis + 15 % Rabatt – Standardmäßig gleicher Preis, durch Aufladerabatte langfristig sogar kostengünstiger.

- ✅ Weltweiter Zugang ohne Hürden – Direkte Verbindung aus dem Inland, keine aufwendige Umgestaltung der Infrastruktur für den Auslandseinsatz erforderlich.

- ✅ Umfassendes Modell-Ökosystem – Vollständige Abdeckung von gpt-image-2 + Nano Banana Pro/2 + Sora-2.

- ✅ Professioneller Service · Begleitung für Unternehmen – Umfassende technische Unterstützung vom PoC bis zur Produktion.

Wenn Ihr Team derzeit Lösungen für den Einsatz von gpt-image-2 evaluiert, unter den IPM-Beschränkungen leidet oder einen stabilen, skalierbaren API-Kanal für die Bilderzeugung auf Unternehmensebene sucht, empfehlen wir, direkt über APIYI (apiyi.com) einen Test-Schlüssel zu beantragen und einen PoC mit Ihren tatsächlichen Geschäftslastspitzen durchzuführen. Der Weg von 5 IPM zu unbegrenzter Parallelität ist oft nur einen Schritt entfernt: die Umstellung der base_url auf https://api.apiyi.com/v1.

Referenzen

-

Offizielle OpenAI Rate Limits Dokumentation: Vollständige Erläuterung der IPM-Ratenbegrenzung für die Bilderzeugung

- Link:

developers.openai.com/api/docs/guides/rate-limits - Hinweis: Tabelle zu den Freischaltbedingungen und Ratenkontingenten für Tier 1-5.

- Link:

-

OpenAI gpt-image-2 Modelldokumentation: Detaillierte Erläuterung der Modellfähigkeiten und Parameter

- Link:

developers.openai.com/api/docs/models/gpt-image-2 - Hinweis: Kernfunktionen wie 4K-Rendering, zeichengenaue Textdarstellung und Inferenz-Integration.

- Link:

-

OpenAI Fehlerbehandlungs-Cookbook: Strategien für exponentielles Backoff bei 429-Fehlern

- Link:

developers.openai.com/cookbook/examples/how_to_handle_rate_limits - Hinweis: Offiziell empfohlene Codebeispiele für den Umgang mit Ratenbegrenzungen.

- Link:

-

APIYI Offizielle Dokumentation: Leitfaden für den Zugriff auf die gpt-image-2 API ohne Ratenbegrenzung

- Link:

help.apiyi.com - Hinweis: Vollständige Dokumentation für den Zugriff über den offiziellen APIYI-Proxy-Kanal und Erläuterungen zu den Parallelitätskontingenten.

- Link:

Autor: APIYI Technik-Team

Veröffentlichungsdatum: 26. April 2026

Schlagwörter: gpt-image-2 API ohne Ratenbegrenzung, OpenAI Ratenbegrenzung, Tier-Level, IPM-Kontingent, Bilderzeugungs-API, APIYI offizieller Proxy