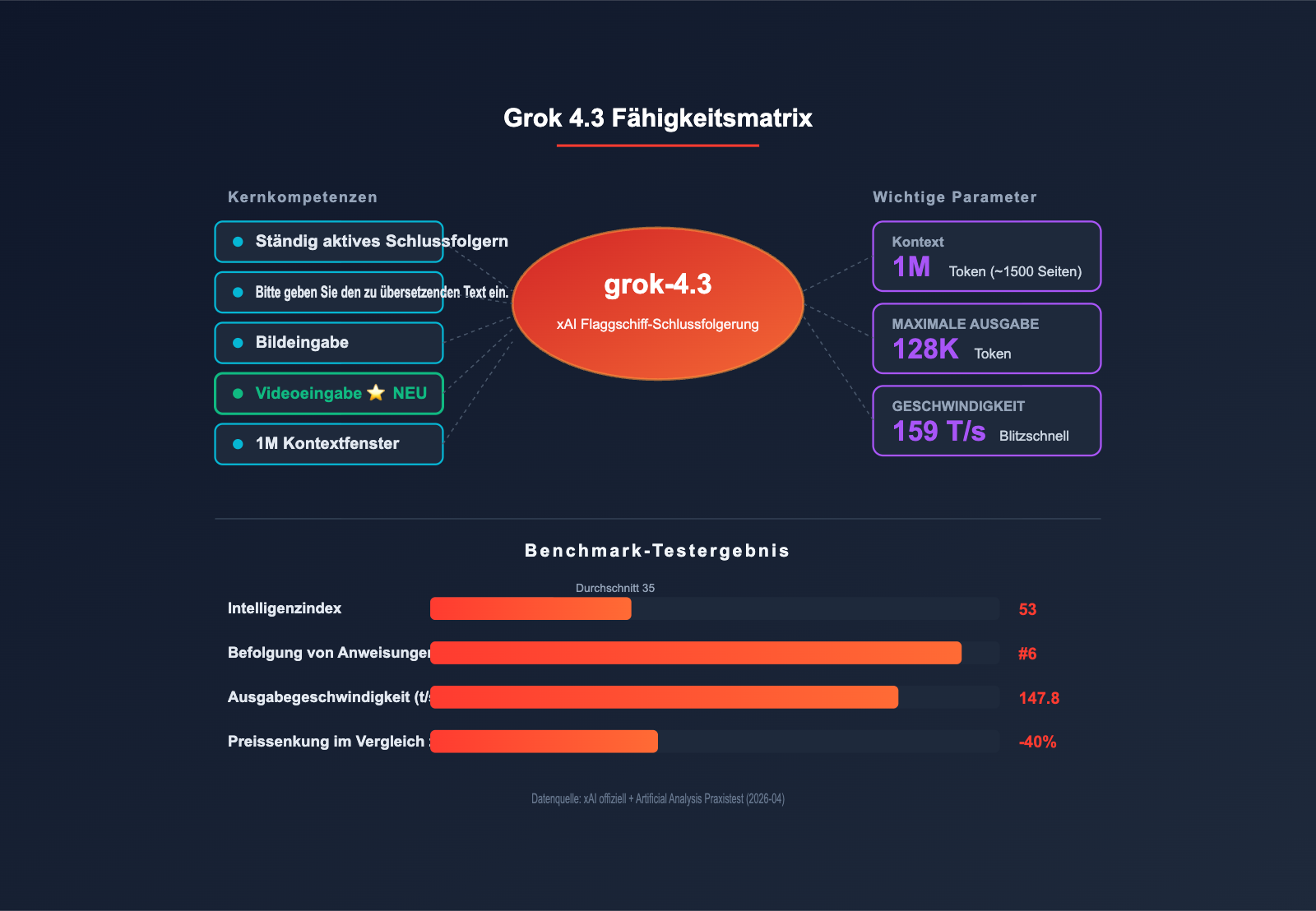

Anmerkung des Autors: Das neueste Flaggschiff von xAI, Grok 4.3, ist jetzt über die offizielle API verfügbar. Dieser Artikel bietet einen vollständigen Überblick über die Funktionen: 1M Kontextfenster, 159 t/s Ausgabegeschwindigkeit, die erstmalige Unterstützung für Videoeingaben sowie die inländische Zugangsoption, die die Kosten gegenüber Grok 4.20 um 40 % senkt.

xAI hat Grok 4.3 Beta am 17.04.2026 eingeführt und am 30.04.2026 offiziell für API-Aufrufe freigegeben. Das herausragende Merkmal dieses Flaggschiff-Modells ist nicht nur das 1M Kontextfenster + 159 Tokens/Sekunde Ausgabegeschwindigkeit + erstmalige Videoeingabe, sondern auch eine aggressive Preisanpassung: Der Preis für die Eingabe wurde gegenüber dem Vorgänger Grok 4.20 um 37,5 % und der Preis für die Ausgabe um 58,3 % gesenkt, was einer Gesamtkostenreduzierung von etwa 40 % entspricht.

Dies ist kein Marketing-Gag: Die offizielle xAI-Dokumentation wurde aktualisiert, und der Intelligence Index von Artificial Analysis erreicht 53 Punkte (der Durchschnitt in dieser Preisklasse liegt bei nur 35), was den 10. Platz unter 146 Modellen weltweit bedeutet. Zudem hat xAI erstmals die Videoeingabefunktion auf API-Ebene freigeschaltet, ein wichtiger Meilenstein für die Grok-Serie im Bereich der multimodalen Modelle.

Kernwert: Dieser Artikel analysiert die praktische Implementierung der Grok 4.3 API aus fünf Perspektiven: Modellspezifikationen, Preisstruktur, Benchmark-Daten, multimodale Aufrufmethoden und die inländische Gruppen-Zugangslösung. Zudem werden ausführbare Python-, cURL- und Videoeingabe-Beispiele bereitgestellt.

Grok 4.3 API Kernpunkte

| Punkt | Beschreibung | Wert |

|---|---|---|

| 1M langes Kontextfenster | 1.000.000 Tokens (ca. 1500 A4-Seiten) | Ein ganzes Buch / vollständige Codebasis auf einmal |

| 159 t/s Höchstgeschwindigkeit | Offizielle xAI-Messung, weit über vergleichbaren Modellen | Schnelle Streaming-Generierung, kurze Wartezeit |

| Videoeingabe-Premiere | Erstes xAI API-Modell mit nativer Videoeingabe | Videoanalyse ohne Vorverarbeitung |

| 40 % Preissenkung | Eingabe -37,5 %, Ausgabe -58,3 % vs 4.20 | Massive Kostensenkung bei Batch-Aufgaben |

| Vollständige Gruppenfreigabe | APIYI Default + SVIP Gruppen verfügbar | Günstig, direkter Zugang für neue Nutzer |

Hauptunterschiede zwischen Grok 4.3 und dem Vorgänger 4.20

Grok 4.3 ist die Flaggschiff-Version, bei der xAI die Inferenz-Tiefe und -Geschwindigkeit gegenüber Grok 4.20 umfassend optimiert hat. Die signifikantesten Änderungen zeigen sich in drei Dimensionen:

Erstens: Inferenzmechanismus auf "Always-on" umgestellt. Grok 4.3 verfügt über ein integriertes, permanentes Chain-of-Thought-Inferenzsystem, das weder deaktiviert noch in der Intensität angepasst werden kann. Das bedeutet, dass jeder Aufruf erst "nachdenkt", bevor er antwortet. Obwohl dies die Latenz bis zum ersten Token auf etwa 19,34 Sekunden erhöht, verbessert es die faktische Genauigkeit und die Fähigkeit, komplexen Anweisungen zu folgen, erheblich. In der Kategorie "Instruction Following" belegt es weltweit Platz 6.

Zweitens: Deutliche Senkung der Preisstruktur. Der Eingabepreis von Grok 4.20 lag bei ca. $2/1M, der Ausgabepreis bei $6/1M. Grok 4.3 wurde auf $1,25 bzw. $2,50 gesenkt. Dies ist ein klares Signal von xAI im API-Preiskampf: Durch Preisvorteile den Markt für agentische Workflows erobern. Deshalb bietet die APIYI-Plattform für Grok 4.3 eine vollständige Gruppenfreigabe an: Der Preis ist attraktiv, das Risiko pro Aufruf kontrollierbar, eine Isolierung der Default-Gruppe ist nicht erforderlich.

Drittens: Erweiterung der multimodalen Grenzen. Grok 4.3 ist das erste Modell der xAI API, das native Videoeingaben unterstützt. Nutzer müssen keine Frames extrahieren oder Videos transkodieren; sie können einfach die Video-URL übergeben, um die Inhaltsanalyse durchzuführen.

Grok 4.3 API – Schnelleinstieg

Minimalistisches Python-Beispiel (Text-Aufruf)

Grok 4.3 ist vollständig mit dem OpenAI SDK kompatibel. Hier ist die einfachste Art, es aufzurufen:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "user", "content": "Implementiere einen performanten LRU-Cache in Python"}

]

)

print(response.choices[0].message.content)

Minimalistisches cURL-Beispiel

curl https://vip.apiyi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "grok-4.3",

"messages": [

{"role": "user", "content": "Analysiere die Kernpunkte dieses langen Dokuments"}

]

}'

Multimodaler Aufruf (Bild- + Video-Input)

Grok 4.3 ist das erste API-Modell von xAI, das nativen Video-Input unterstützt. Der Aufruf erfolgt analog zu den Vision-Modellen von OpenAI:

# Bild-Input

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "Welches System wird in diesem Architekturdiagramm beschrieben?"},

{"type": "image_url", "image_url": {"url": "https://example.com/diagram.png"}}

]

}]

)

# Video-Input (Grok 4.3 Premiere-Funktion)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "Fasse den Kerninhalt dieses Videos zusammen und erstelle eine Zeitleiste"},

{"type": "video_url", "video_url": {"url": "https://example.com/lecture.mp4"}}

]

}]

)

Vollständigen Produktionscode anzeigen (inkl. Kostenkalkulation, gestaffelter Abrechnung und Fehlerbehandlung)

import openai

from typing import List, Dict

# Grok 4.3 Preise (pro 1M Tokens)

PRICE_INPUT_BASE = 1.25

PRICE_OUTPUT_BASE = 2.50

PRICE_INPUT_HIGH = 2.50 # >200K Input

PRICE_OUTPUT_HIGH = 5.00 # >200K Input

PRICE_CACHE_HIT = 0.20 # Preis bei Cache-Treffer

def call_grok_43(

messages: List[Dict],

api_key: str,

max_tokens: int = 4096

) -> Dict:

"""

Produktionsreifer Grok 4.3 Aufruf mit gestaffelter Kostenkalkulation

"""

client = openai.OpenAI(

api_key=api_key,

base_url="https://vip.apiyi.com/v1"

)

try:

response = client.chat.completions.create(

model="grok-4.3",

messages=messages,

max_tokens=max_tokens

)

usage = response.usage

input_tokens = usage.prompt_tokens

output_tokens = usage.completion_tokens

# Gestaffelte Abrechnung (>200K löst 2x Preis aus)

if input_tokens <= 200_000:

input_cost = input_tokens / 1_000_000 * PRICE_INPUT_BASE

output_cost = output_tokens / 1_000_000 * PRICE_OUTPUT_BASE

else:

input_cost = input_tokens / 1_000_000 * PRICE_INPUT_HIGH

output_cost = output_tokens / 1_000_000 * PRICE_OUTPUT_HIGH

total_cost = input_cost + output_cost

print(f"📊 Input: {input_tokens:,} Tokens | Output: {output_tokens:,} Tokens")

print(f"💰 Kosten dieses Aufrufs: ${total_cost:.4f}")

return {

"content": response.choices[0].message.content,

"tokens": {"input": input_tokens, "output": output_tokens},

"cost_usd": total_cost

}

except openai.RateLimitError:

return {"error": "Ratenbegrenzung, bitte später erneut versuchen"}

except openai.APIError as e:

return {"error": f"API-Fehler: {str(e)}"}

# Anwendungsbeispiel

result = call_grok_43(

messages=[

{"role": "system", "content": "Du bist ein erfahrener Architekt"},

{"role": "user", "content": "Entwirf ein Rate-Limiting-System für Millionen von QPS"}

],

api_key="YOUR_API_KEY"

)

print(result["content"])

🎯 Tipp für den Start: Grok 4.3 ist bei APIYI für die Standard-Gruppe vollständig freigeschaltet; neue Nutzer können ohne weitere Anträge direkt darauf zugreifen. Wir empfehlen die Anbindung über die Plattform APIYI (apiyi.com). Bei einer Aufladung von 100 USD erhalten Sie 10 % Bonus, was einem Rabatt von ca. 15 % gegenüber dem offiziellen Preis entspricht. Zudem ist eine direkte Verbindung ohne VPN möglich, bei voller Kompatibilität mit dem OpenAI SDK.

Grok 4.3 API Preisdetails

Offizielle gestaffelte Preisstruktur

Grok 4.3 nutzt eine gestaffelte Preisstrategie für lange Kontexte, ähnlich der GPT-5.5-Serie, jedoch mit einer niedrigeren Auslöseschwelle (200K statt 272K):

| Input-Bereich | Input-Preis (pro 1M) | Output-Preis (pro 1M) | Cache-Treffer-Preis |

|---|---|---|---|

| 0 – 200K Tokens | $1.25 | $2.50 | $0.20 (84 % Rabatt) |

| 200K – ∞ Tokens | $2.50 (2x) | $5.00 (2x) | $0.20 |

⚠️ Wichtig: Die gestaffelte Preisgestaltung gilt für die gesamte Anfrage und nicht nur für den überschüssigen Teil. Sobald der Input 200K überschreitet, wird die gesamte Anfrage zum höheren Tarif abgerechnet. Bei der Analyse langer Dokumente empfiehlt es sich, diese in Blöcke von ca. 180K zu unterteilen, um die Staffelung zu vermeiden.

Preisvergleich: Grok 4.3 vs. Grok 4.20

| Dimension | Grok 4.20 | Grok 4.3 | Senkung |

|---|---|---|---|

| Input-Preis | ~$2.00 / 1M | $1.25 / 1M | -37,5 % |

| Output-Preis | ~$6.00 / 1M | $2.50 / 1M | -58,3 % |

| Mischrate (3:1) | ~$3.00 / 1M | $1.56 / 1M | -48 % |

| Kontextfenster | 256K | 1M | +290 % |

| Multimodal | Text+Bild | Text+Bild+Video | Video neu |

Beispiele für die tatsächliche Kostenkalkulation:

- Einfacher Aufruf (Input 2K + Output 1K): $0,005 (unter einem Cent zum Standardtarif)

- Mittlere Aufgabe (Input 50K + Output 5K): $0,075

- Lange Dokumentanalyse (Input 180K + Output 5K, Staffelung vermieden): $0,238

- Extrem langes Dokument (Input 500K + Output 10K, Staffelung ausgelöst): $1,30

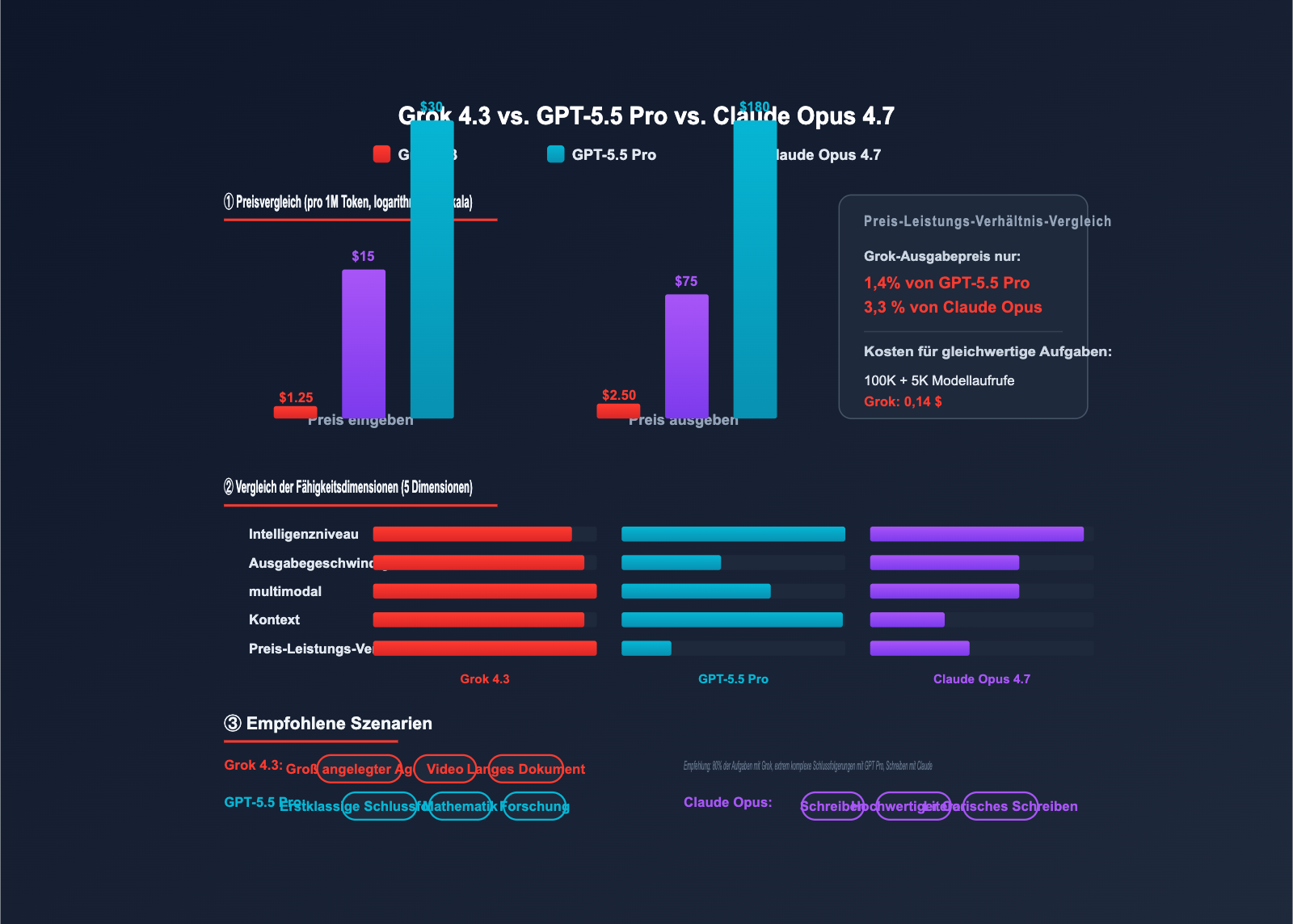

💰 Kostenoptimierung: Bei vergleichbaren Aufgaben betragen die Output-Kosten von Grok 4.3 nur 1,4 % der Kosten von GPT-5.5 Pro ($2.50 vs. $180). Für groß angelegte Batch-Aufgaben, Agenten-Workflows und langfristige Produktionseinsätze kann dieser Preisunterschied die Wahl der Anwendungsarchitektur maßgeblich beeinflussen. Nutzen Sie den 10%-Bonus bei APIYI (apiyi.com), um die tatsächlichen Kosten weiter zu senken.

Grok 4.3 API Performance-Benchmark

Offizielle Messergebnisse

Die Plattform Artificial Analysis hat eine vollständige Evaluierung von Grok 4.3 durchgeführt. Die Ergebnisse zeigen, dass das Intelligenzniveau deutlich über dem Durchschnitt der Preisklasse liegt:

| Bewertungskategorie | Grok 4.3 Punktzahl | Branchendurchschnitt | Ranking |

|---|---|---|---|

| Intelligence Index | 53 | 35 | #10 / 146 |

| Instruction Following | Exzellent | Durchschnitt | #6 / 146 |

| Output Speed | 147,8 t/s | ~80 t/s | #21 / 146 |

| Time to First Token | 19,34 Sek. | 8 Sek. | Langsam (residentes Inferenzmodell) |

| End-to-End Antwortzeit | Mittel | Mittel | Durchschnitt für Inferenzmodelle |

Benchmark-Interpretation

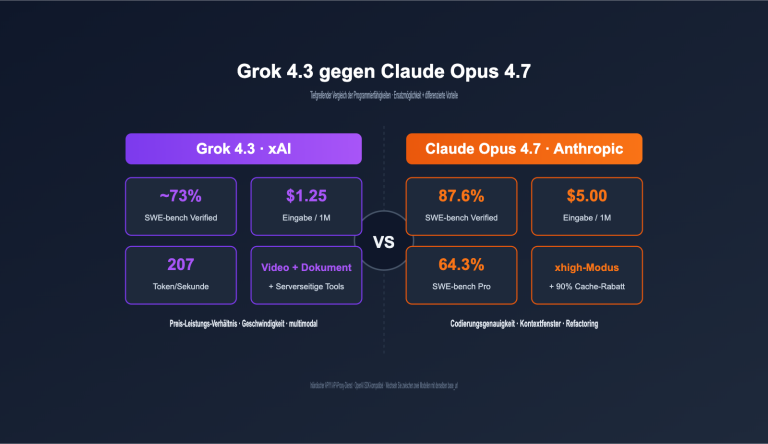

Intelligence Index 53, deutlich über dem Durchschnitt von 35: Dies bedeutet, dass Grok 4.3 bei komplexen Aufgaben (Mathematik, Programmierung, Schlussfolgerungen, Wissen) zur weltweiten Spitzengruppe gehört, während der Preis weit unter dem anderer Top-10-Modelle liegt (z. B. GPT-5.5 Pro 30 $/180 $, Claude Opus 4.7 15 $/75 $).

Instruction Following #6: Dies ist die stärkste Einzelkompetenz von Grok 4.3. Für agentische Workflows, komplexe mehrstufige Aufgaben und strikte JSON-Ausgabeformate ist Grok 4.3 zuverlässiger als andere Modelle in dieser Preisklasse.

Time to First Token 19,34 Sekunden: Dies ist der Preis für den "Always-on"-Inferenzmechanismus. Wenn Ihre Anwendung empfindlich auf die anfängliche Antwortzeit reagiert (z. B. bei Chatbots im Kundenservice), empfiehlt es sich, die Streaming-API zu nutzen, um einen "Denkt gerade nach…"-Status anzuzeigen, oder alternativ die schnellere Standardversion von Grok 4 in Betracht zu ziehen.

Vergleich: Grok 4.3 vs. führende Konkurrenzmodelle

| Modell | Eingabepreis | Ausgabepreis | Kontext | Intelligenz-Index | Multimodal | Empfohlene Szenarien |

|---|---|---|---|---|---|---|

| Grok 4.3 | $1,25 | $2,50 | 1M | 53 | Text+Bild+Video | Große Agenten / Videoanalyse |

| GPT-5.5 Pro | $30 | $180 | 1,05M | ~60 | Text+Bild | Top-Level-Inferenz / Forschung |

| Claude Opus 4.7 | $15 | $75 | 200K | ~58 | Text+Bild | Schreiben / Hochwertiger Code |

| Gemini 2.5 Pro | $1,25 | $10 | 2M | ~55 | Text+Bild+Video | Lange Dokumente / Multimodal |

| Grok 4.20 | $2,00 | $6,00 | 256K | ~48 | Text+Bild | Durch 4.3 ersetzt |

Entscheidungshilfen für die Modellauswahl

Grok 4.3 Analyse: Grok 4.3 führt in den Bereichen Preis-Leistungs-Verhältnis, Geschwindigkeit und Videoeingabe. Allerdings ist die Latenz bis zum ersten Token (Time to First Token) höher und die Schwelle für die Aktivierung des langen Kontextfensters liegt bei 200K. Dennoch ist Grok 4.3 für kosteneffiziente, groß angelegte agentische Workflows und Szenarien, die Videoverständnis erfordern, die derzeit beste Wahl.

GPT-5.5 Pro Analyse: GPT-5.5 Pro bleibt bei extrem schwierigen Inferenzaufgaben wie FrontierMath führend. Der 6-fach höhere Preis macht es jedoch nur für hochpreisige Anwendungsfälle attraktiv. Im Vergleich dazu bietet Grok 4.3 bei 80 % der Standard-Inferenzaufgaben eine ähnliche Leistung zu nur 1/24 des Preises – ein überragendes Preis-Leistungs-Verhältnis.

Claude Opus 4.7 Analyse: Claude Opus 4.7 glänzt bei Stilistik, dem Verfassen langer Texte und der Code-Qualität. Das Kontextfenster ist jedoch auf 200K begrenzt und der Preis liegt im oberen Bereich. Für Anforderungen mit 1M Kontextfenster und große Batch-Aufgaben bleibt Grok 4.3 die stabilere Wahl.

📊 Vergleichsempfehlung: Über APIYI (apiyi.com) können Sie unter einem einzigen API-Schlüssel nahtlos zwischen Grok 4.3, GPT-5.5, Claude Opus 4.7 und anderen führenden Modellen wechseln, indem Sie lediglich den

model-Parameter anpassen. Dieser einheitliche Zugang eignet sich besonders für Anwendungen, die eine dynamische Aufgabensteuerung zwischen verschiedenen Modellen erfordern.

Anwendungsbereiche für die Grok 4.3 API

Die Kombination aus "hoher Intelligenz + niedrigem Preis + voller Multimodalität + langem Kontextfenster" macht Grok 4.3 ideal für folgende Szenarien:

- Groß angelegte agentische Workflows: Instruction Following #6 + attraktive Preise, ideal für Agenten-Systeme mit tausenden Aufrufen täglich.

- Verständnis extrem langer Dokumente: 1M Tokens (ca. 1500 Seiten) ermöglichen das Einlesen ganzer technischer Handbücher oder kompletter Code-Repositories in einem Durchgang.

- Videoinhaltsanalyse: Das erste xAI-Modell mit nativer Videoeingabe – kein vorheriges Extrahieren von Einzelbildern erforderlich.

- Multimodale hybride Aufgaben: Komplexe Anwendungen, die Text, Bilder und Videos gleichzeitig verarbeiten.

- Batch-API-Aufgaben: Kostensensible Szenarien wie großflächige Datenannotation, Inhaltserstellung oder Massenübersetzungen.

- Unternehmens-Wissensdatenbanken: Maximale Kosteneffizienz durch 1M Kontextfenster + Cache-Treffer-Preis von $0,20.

- Schnelles Prototyping und Experimente: 159 t/s extrem schnelle Ausgabe + günstige Preise, ideal für häufige Iterationen.

🎯 Entscheidungshilfe: Wenn Ihre Anwendung eine Kombination aus "hoher Intelligenz, Skalierbarkeit und Kostenkontrolle" benötigt, ist Grok 4.3 derzeit die wirtschaftlichste Wahl. Der Zugriff erfolgt direkt über APIYI (apiyi.com); die Nutzung ist in der Default-Gruppe ohne vorherige Beantragung möglich.

Anschlussanleitung für Grok 4.3 bei APIYI

Strategie für die gruppenübergreifende Freischaltung

Die APIYI-Plattform verfolgt für Grok 4.3 eine völlig andere Anschlussstrategie als für GPT-5.5 Pro:

- ✅ Default-Gruppe: Vollständig geöffnet, für neue Nutzer sofort verfügbar

- ✅ SVIP-Gruppe: Vollständig geöffnet, ohne jegliche Einschränkungen

- ✅ Direkt-Proxy: Identisch mit der offiziellen xAI-API, kein Verlust durch Zwischenschaltung

Warum ist Grok 4.3 für alle Gruppen geöffnet, während GPT-5.5 Pro nur für SVIP verfügbar ist? Der Hauptgrund liegt im Kostenrisiko pro Modellaufruf:

- GPT-5.5 Pro: Ein einzelner Aufruf kann mehrere Dollar kosten, das Risiko bei Fehlbedienung ist hoch → nur für die SVIP-Gruppe geöffnet.

- Grok 4.3: Ein einzelner Aufruf kostet meist nur wenige Cent, selbst bei Fehlbedienung entstehen keine nennenswerten Verluste → für alle Gruppen geöffnet.

Dieses Designkonzept spiegelt die Betriebsphilosophie von APIYI wider, Modelle nach ihrem Risikoprofil zu verwalten – kostengünstige Modelle sollen für alle Nutzer leicht zugänglich sein, während hochpreisige Modelle durch Gruppeneinschränkungen vor Fehlbedienung geschützt werden.

Kostenvergleich: APIYI vs. offizielle Webseite

| Projekt | xAI-Webseite | APIYI apiyi.com |

|---|---|---|

| Basispreis | $1.25 / $2.50 pro 1M | $1.25 / $2.50 pro 1M (identisch) |

| Aufladebonus | Keiner | $100 aufladen, $10 geschenkt (10%) |

| Tatsächliche Kosten | 100% Standardpreis | ca. 90% Standardpreis (ca. 15% Rabatt) |

| Zugriff aus China | VPN erforderlich | Direktverbindung, kein VPN nötig |

| Zahlungsmethoden | Internationale Kreditkarte | RMB, Alipay, WeChat unterstützt |

| SDK-Kompatibilität | xAI natives SDK | Vollständig kompatibel mit OpenAI SDK |

| Mindestaufladung | $5 | Ab $1 möglich |

| Gruppeneinschränkung | Keine | Default + SVIP vollständig offen |

💰 Kostenoptimierung: Durch die Nutzung von Grok 4.3 über APIYI apiyi.com erhalten Sie bei einer Aufladung von 100 Dollar 10% Bonus, was effektiv einem Rabatt von etwa 15% gegenüber der offiziellen Webseite entspricht. Für Teams mit hohem monatlichem Aufrufvolumen senkt dies die API-Kosten über ein Jahr hinweg erheblich.

Häufig gestellte Fragen (FAQ)

Q1: Was ist Grok 4.3? Was ist der Hauptunterschied zur Vorgängerversion Grok 4.20?

Grok 4.3 ist das am 30.04.2026 von xAI veröffentlichte Flaggschiff-Modell für Schlussfolgerungen. Die wichtigsten Unterschiede: 1) Das Kontextfenster wurde von 256K auf 1M erweitert; 2) Der Input-Preis sank von $2 auf $1.25 (-37,5%), der Output-Preis von $6 auf $2.50 (-58,3%); 3) Erstmalige Unterstützung für native Videoeingabe; 4) Always-on-Inferenzmechanismus zur Verbesserung der faktischen Genauigkeit.

Q2: Warum ist Grok 4.3 bei APIYI für alle Gruppen offen, während GPT-5.5 Pro nur für SVIP verfügbar ist?

Der Hauptgrund ist der Unterschied im Kostenrisiko pro Aufruf: GPT-5.5 Pro kostet $180/1M bei der Ausgabe, ein komplexer Aufruf kann mehrere Dollar kosten, was das Risiko bei Fehlbedienung erhöht. Daher ist es nur für die SVIP-Gruppe freigeschaltet. Grok 4.3 kostet nur $2,50/1M, ein Aufruf kostet meist nur wenige Cent, sodass selbst bei Fehlbedienung durch Anfänger kein nennenswerter Schaden entsteht. Dies entspricht der "risikobasierten Verwaltung" von APIYI.

Q3: Wann sollte man Grok 4.3 und wann GPT-5.5 (Standard/Pro) verwenden?

Szenarien für Grok 4.3: Große Agent-Aufgaben, Videoanalyse, 1M-Langdokumente, Batch-Verarbeitung, kostenkritische Anwendungen.

Szenarien für GPT-5.5 Standard: Reguläre Chats, Kundenservice, Übersetzungen und andere leichte Aufgaben ohne Bedarf an Always-on-Inferenz (kein Latenzvorteil).

Szenarien für GPT-5.5 Pro: Mathematische Probleme auf FrontierMath-Niveau, extrem komplexe Agenten-Aufgaben über 20 Stunden, hochkarätige wissenschaftliche Schlussfolgerungen.

Einfache Regel: 80% der Aufgaben lassen sich mit Grok 4.3 erledigen, nur bei extrem komplexen Schlussfolgerungen ist der Wechsel zu GPT-5.5 Pro sinnvoll.

Q4: Wie nutzt man die Videoeingabe von Grok 4.3? Welche Formate werden unterstützt?

Die Videoeingabe erfolgt über das Feld video_url im messages-Array. Unterstützt werden gängige Formate wie mp4, mov und webm. Beispiel:

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "Fasse die wichtigsten Punkte des Videos zusammen"},

{"type": "video_url", "video_url": {"url": "https://example.com/video.mp4"}}

]

}]

Beachten Sie, dass Videoinhalte in Token umgewandelt und berechnet werden. Es wird empfohlen, die Videolänge auf unter 10 Minuten zu begrenzen, um eine gestaffelte Abrechnung zu vermeiden.

Q5: Wie rufe ich Grok 4.3 über APIYI auf? Was muss im Code geändert werden?

APIYI ist vollständig mit dem OpenAI SDK kompatibel. Drei Schritte genügen:

- Registrieren Sie sich bei APIYI apiyi.com (keine Bewerbung nötig, Default-Gruppe ist sofort verfügbar)

- API-Schlüssel abrufen

- Ändern Sie die

base_urlim Code aufhttps://vip.apiyi.com/v1und setzen Sie das Modell aufgrok-4.3

client = openai.OpenAI(

api_key="YOUR_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[...]

)

Bei einer Aufladung von 100 Dollar erhalten Sie 10% Bonus, was effektiv einem Rabatt von ca. 15% entspricht.

Q6: Wie vermeide ich die gestaffelte Abrechnung bei Grok 4.3, wenn der Input 200K überschreitet?

Die Schwelle für die gestaffelte Abrechnung bei Grok 4.3 liegt bei 200K. Danach verdoppeln sich Input- und Output-Preise. Vermeidungsstrategien:

- Chunking-Strategie: Teilen Sie lange Dokumente in mehrere Anfragen von etwa 180K auf (20K Puffer lassen).

- Vorab-Kompression: Nutzen Sie ein günstigeres Modell (z. B. Grok 4 Mini), um das Dokument vorab zu komprimieren, bevor es an 4.3 zur Inferenz übergeben wird.

- Cache-Wiederverwendung: Aktivieren Sie Caching für wiederkehrende Inhalte, um von einem Rabatt von 84% ($0,20/1M) zu profitieren.

- Akzeptanz: Wenn eine Aufgabe zwingend eine einzige Eingabe erfordert, akzeptieren Sie die 2x-Abrechnung (die Kosten liegen immer noch unter dem Standardpreis von GPT-5.5 Pro).

Q7: Warum ist die Latenz bis zum ersten Token bei Grok 4.3 so hoch?

Grok 4.3 verfügt über einen integrierten Always-on Chain-of-Thought-Inferenzmechanismus. Jeder Aufruf "denkt" erst, bevor er antwortet, was zu einer Latenz von ca. 19,34 Sekunden bis zum ersten Token führt. Dies ist ein Design-Kompromiss zur Verbesserung der faktischen Genauigkeit und der Befolgung von Anweisungen. Wenn Ihre Anwendung eine schnelle Antwort erfordert:

- Nutzen Sie den Streaming-Modus und zeigen Sie eine "Denkt nach…"-Meldung an.

- Wählen Sie Grok 4 Standard (niedrigere Latenz, aber etwas weniger intelligent).

- Wählen Sie GPT-5.5 Standard (keine permanente Inferenz, schnellere Antwort).

Q8: Welche bekannten Einschränkungen hat Grok 4.3?

Die wichtigsten Einschränkungen sind:

- Hohe Latenz bis zum ersten Token: ca. 19,34 Sekunden, nicht für Echtzeit-Chats geeignet.

- Inferenz nicht abschaltbar: Der Always-on-CoT-Mechanismus kann nicht deaktiviert oder in der Intensität angepasst werden.

- Ausgabe sehr ausführlich: In Tests wurden 88M Token generiert (sehr wortreich), achten Sie auf die Steuerung von

max_tokens. - Niedrige Staffelungsschwelle: 200K lösen die 2x-Preiserhöhung aus (bei GPT-5.5 sind es 272K).

- Videoempfehlung: Sehr lange Videos lösen die Staffelung aus, empfohlen sind unter 10 Minuten.

- Nur Textausgabe: Keine Bilderzeugung oder Videogenerierung, nur Verständnis.

Grok 4.3 API – Die wichtigsten Punkte

- Preis-Leistungs-Hammer: $1,25 für Input / $2,50 für Output – das entspricht einer Senkung um 40 % gegenüber der Version 4.20 und übertrifft vergleichbare Modelle deutlich.

- 1M Kontextfenster: Entspricht etwa 1500 A4-Seiten; ermöglicht das Einlesen ganzer Code-Bibliotheken oder technischer Fachbücher in einem Durchgang.

- 159 t/s Höchstgeschwindigkeit: Eine der branchenweit schnellsten Ausgaberaten, die Wartezeiten bei der Generierung langer Texte massiv verkürzt.

- Video-Input-Premiere: Das erste API-Modell von xAI mit nativem Video-Input, das die Grenzen der multimodalen Verarbeitung erweitert.

- Always-on-Inferenz: Intelligence Index 53 (weltweit Platz 10), Instruction Following Platz 6.

- Voller Zugriff: Über APIYI sind die Gruppen „Default“ und „SVIP“ vollständig freigeschaltet – kein Antrag erforderlich.

- 15 % Rabatt in China: Bei Aufladungen über APIYI (apiyi.com) gibt es 10 Einheiten gratis bei 100 Einheiten Aufladung, was effektiv einem Rabatt von 15 % gegenüber der offiziellen Website entspricht.

Fazit

Die Kernpunkte der Grok 4.3 API:

- Preisgestaltung: $1,25 / $2,50 pro 1 Mio. Token, eine Senkung um 40 %, womit es direkt mit dem Preis-Leistungs-Verhältnis von Gemini 2.5 Pro konkurriert.

- Leistungsfähigkeit: Intelligence Index 53 (weltweit Platz 10), Instruction Following Platz 6 – ideal für hochintelligente Aufgaben und komplexe Agenten-Systeme.

- Zugang: Direkter Aufruf über APIYI (apiyi.com) möglich. Mit der Aktion „100 aufladen, 10 geschenkt“ und der direkten Anbindung aus China ohne Umwege.

Grok 4.3 ist nicht einfach nur „ein weiteres Pro-Modell“, sondern xAIs neue Flaggschiff-Waffe für maximale Wirtschaftlichkeit. Für Anwendungen, die eine Kombination aus hoher Intelligenz, niedrigem Preis, Multimodalität und großem Kontextfenster erfordern – sei es für große Agenten-Systeme, Videoanalysen, Unternehmenswissensdatenbanken oder die Verarbeitung von 1M-Dokumenten – ist Grok 4.3 aktuell die beste Wahl. Es ergänzt GPT-5.5 Pro perfekt: Nutzen Sie Grok 4.3 für komplexe Standard-Inferenzaufgaben und greifen Sie nur bei extrem schwierigen Anforderungen auf GPT-5.5 Pro zurück.

Wir empfehlen den schnellen Einstieg über die Plattform APIYI (apiyi.com): Die „Default“-Gruppe ist ohne Antrag nutzbar, Sie profitieren von 10 % Bonusguthaben und einer stabilen, direkten Verbindung.

Weiterführende Artikel

Wenn Sie sich für die Grok 4.3 API interessieren, empfehlen wir Ihnen folgende weiterführende Lektüre:

- 📘 GPT-5.5 Pro API-Integrationsleitfaden – Erfahren Sie mehr über das Flaggschiff-Modell von OpenAI und wie es sich als Szenario-Ergänzung zu Grok 4.3 eignet.

- 📊 Grok 4.3 vs. Gemini 2.5 Pro: Tiefenanalyse des Preis-Leistungs-Verhältnisses – Ein Vergleich der Fähigkeiten der beiden Spitzenmodelle im gleichen Preissegment.

- 🚀 Grok 4.3 Video-Input in der Praxis: In zehn Minuten einen Agenten zur Videoinhaltsanalyse erstellen – Entdecken Sie produktionsreife Anwendungen der Videofähigkeiten von xAI.

📚 Referenzen

-

Offizielle xAI API-Dokumentation: Spezifikationen, Preisgestaltung und Aufrufbeispiele für das Grok 4.3 Modell.

- Link:

docs.x.ai/developers/models - Hinweis: Hier erhalten Sie die aktuellsten und verbindlichsten offiziellen technischen Parameter.

- Link:

-

Artificial Analysis Grok 4.3 Testbericht: Intelligence Index, Geschwindigkeit und Latenz-Messdaten.

- Link:

artificialanalysis.ai/models/grok-4-3 - Hinweis: Unabhängige Tests von Drittanbietern, ideal für den direkten Vergleich mit ähnlichen Modellen.

- Link:

-

APIYI Grok 4.3 Integrationsdokumentation: Lösungen für den Aufruf aus China, Gruppierungsinformationen und Aufladerabatte.

- Link:

docs.apiyi.com - Hinweis: Ein praktischer Leitfaden für Entwickler in China zur Implementierung.

- Link:

-

OpenRouter Grok 4.3 Leistungsseite: Anbietervergleich und detaillierte Benchmark-Aufschlüsselung.

- Link:

openrouter.ai/x-ai/grok-4-3 - Hinweis: Referenz für plattformübergreifende Leistungsvergleiche und transparente Preisgestaltung.

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Wir freuen uns auf Ihre Erfahrungen mit Grok 4.3 in den Kommentaren. Weitere Informationen zur Modellintegration finden Sie im APIYI-Dokumentationszentrum unter docs.apiyi.com.