ملاحظة المؤلف: شرح مفصل لكيفية استخدام Seedance 2.0، يشمل مداخل التجربة مثل Jimeng، وXiao Yunque، وDoubao، وVolcengine، بالإضافة إلى وقت الوصول إلى واجهة برمجة التطبيقات (API) وتقديرات الأسعار، لمساعدتك في استخدام أقوى نموذج فيديو يعمل بالذكاء الاصطناعي من ByteDance في أسرع وقت ممكن.

كيف تستخدم Seedance 2.0؟ هذا هو السؤال الأكثر تداولاً حالياً. أطلقت ByteDance رسمياً نموذج Seedance 2.0 لتوليد الفيديو بالذكاء الاصطناعي في 12 فبراير 2026، وبفضل بنية التوليد المشترك للصوت والفيديو متعددة الوسائط و القدرة على السرد متعدد اللقطات، أثار النموذج نقاشاً واسعاً على وسائل التواصل الاجتماعي العالمية. سيوضح هذا المقال بالتفصيل جميع طرق استخدام Seedance 2.0 لمساعدتك على البدء بسرعة.

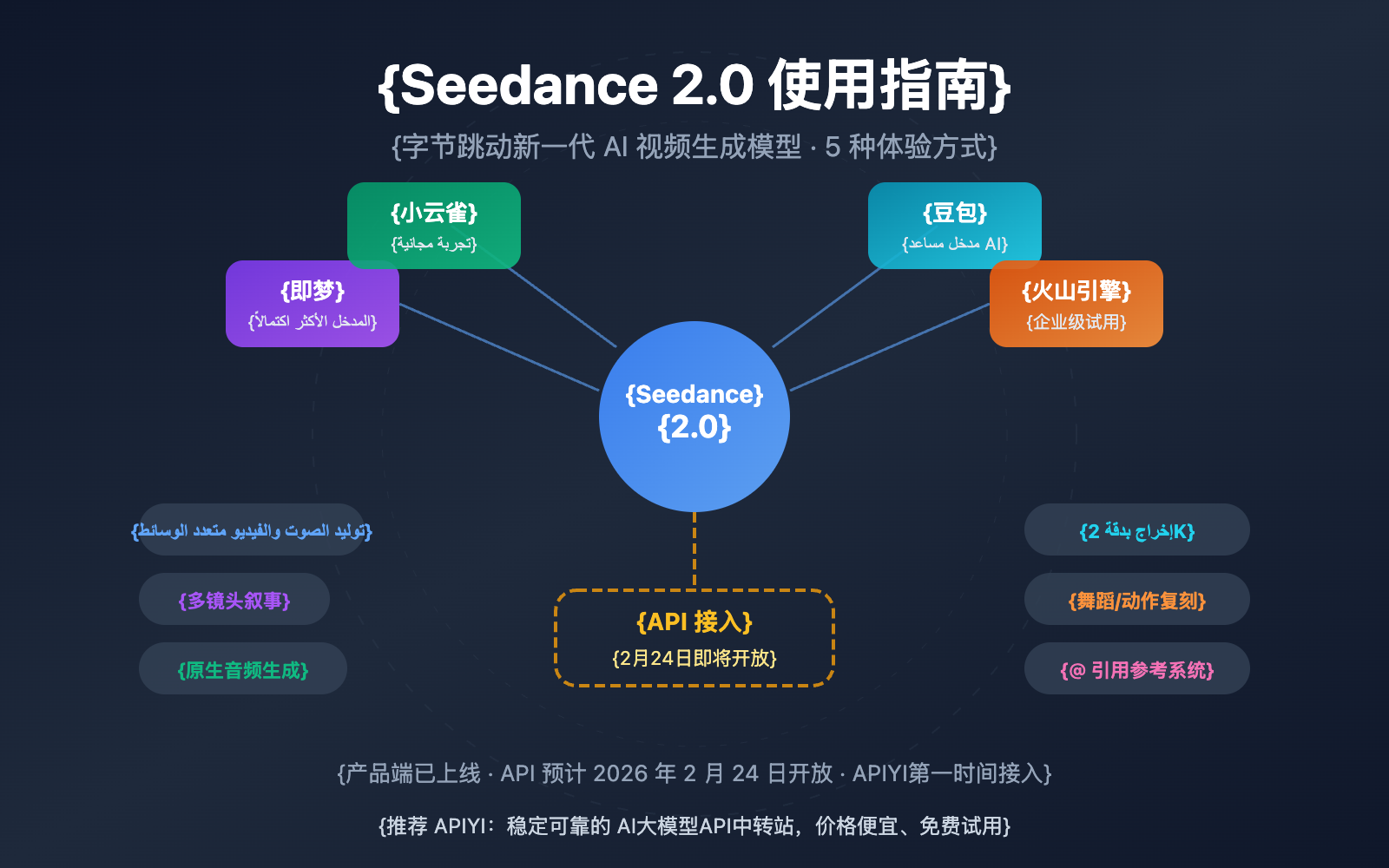

القيمة الجوهرية: بعد قراءة هذا المقال، ستتعرف على 5 طرق لتجربة Seedance 2.0، وخصائصه الأساسية، بالإضافة إلى أحدث المواعيد ومعلومات الأسعار للوصول عبر واجهة برمجة التطبيقات (API).

نظرة عامة على الميزات الأساسية لـ Seedance 2.0

قبل التعرف على كيفية استخدام Seedance 2.0، دعنا نلقي نظرة سريعة على قدراته الأساسية:

| الميزة | الوصف المحدد | التحسينات مقارنة بالجيل السابق |

|---|---|---|

| إدخال متعدد الوسائط | يدعم 4 أنواع من المدخلات: النصوص، الصور، الصوت، والفيديو | إضافة إدخال الصوت |

| سرد متعدد اللقطات | توليد فيديو متسلسل بمشاهد متعددة في المرة الواحدة، مع الحفاظ على اتساق الشخصيات والأسلوب | قدرة جديدة تماماً |

| توليد صوت أصلي | توليد تلقائي للمؤثرات الصوتية والموسيقى التصويرية المتزامنة مع الصورة | قدرة جديدة تماماً |

| مخرجات بدقة 2K | يدعم مخرجات بمستوى الإنتاج تصل إلى 1080p | مضاعفة الدقة |

| محاكاة الرقص/الحركة | رفع فيديو مرجعي لنسخ حركة الكاميرا وتصميم الرقصات بدقة | تحسن كبير في الدقة |

شرح مفصل للهندسة التقنية لـ Seedance 2.0

يعتمد Seedance 2.0 على بنية "Dual-Branch Diffusion Transformer" (محول الانتشار ثنائي الفرع)، وهي المفتاح لتحقيق التوليد المشترك متعدد الوسائط. تقوم هذه البنية بمعالجة إشارات النصوص والصور والصوت والفيديو بشكل موحد، مما يسمح للنموذج بإنتاج صوت متزامن تماماً مع الصورة أثناء توليد الفيديو.

من حيث جودة الفيديو، تبلغ سرعة توليد Seedance 2.0 حوالي 30% أسرع من المنافسين المماثلين (مثل Kling AI). يدعم مدة فيديو تتراوح من 4 إلى 15 ثانية، ويغطي نسب عرض إلى ارتفاع متنوعة مثل 16:9، 9:16، 4:3، 3:4، 21:9، و1:1. كما شهد اتساق وجوه الشخصيات والملابس والنصوص والمشاهد تحسناً ملحوظاً مقارنة بالجيل السابق، مما يحل بفعالية مشاكل "انحراف الشخصية" وتغير الأسلوب المفاجئ الشائعة في فيديوهات الذكاء الاصطناعي.

كيفية استخدام Seedance 2.0: شرح مفصل لـ 5 طرق للتجربة

تم إطلاق Seedance 2.0 رسميًا الآن، ولكن واجهة برمجة التطبيقات (API) لم تفتح بعد. إليك جميع الطرق المتاحة حاليًا لاستخدام Seedance 2.0:

الطريقة الأولى: Jimeng (即梦) — المدخل الأكثر اكتمالاً للتجربة

منصة Jimeng هي منصة إبداع مدعومة بالذكاء الاصطناعي تابعة لشركة ByteDance، وهي أول مدخل لتجربة Seedance 2.0، وتتميز بوظائفها الأكثر اكتمالاً.

خطوات الاستخدام:

- قم بزيارة منصة Jimeng:

jimeng.jianying.com - قم بتسجيل الدخول باستخدام حساب Douyin (تيك توك الصيني)

- ادخل إلى قسم "إنشاء" (生成)، واختر "إنشاء فيديو" (视频生成)

- في خيارات النموذج، اختر Seedance 2.0

- أدخل الموجه (Prompt) النصي أو قم بتحميل المواد المرجعية، وابدأ في الإنشاء

توضيح التكلفة: توفر Jimeng تجربة قائمة على نظام العضوية المدفوعة، ويمكن للمستخدمين الجدد تجربتها مقابل 1 يوان لمدة 7 أيام. ميزة Seedance 2.0 متاحة للأعضاء المشتركين.

🎯 نصيحة للاستخدام: منصة Jimeng هي حاليًا المنصة الأكثر اكتمالاً لتجربة Seedance 2.0، ونوصي باستخدامها كخيار أول. إذا كنت بحاجة لاحقًا إلى استدعاء API بكميات كبيرة، يمكنك متابعة إشعارات الإطلاق على موقع APIYI (apiyi.com)، حيث سنقوم بتوفير الخدمة فور فتح الـ API.

الطريقة الثانية: Xiao Yunque (小云雀) — مدخل التجربة المجانية

Xiao Yunque هو تطبيق ذكاء اصطناعي آخر تابع لشركة ByteDance، ويوفر فرصًا لتجربة Seedance 2.0 مجانًا.

خطوات الاستخدام:

- قم بتحميل تطبيق Xiao Yunque

- بعد تسجيل الدخول، ستحصل على 3 فرص مجانية لإنشاء فيديوهات باستخدام Seedance 2.0

- يتم منح 120 نقطة يوميًا، مما يتيح لك الاستمرار في التجربة

الفئة المستهدفة: المستخدمون الذين يرغبون في تجربة Seedance 2.0 مجانًا، خاصة لمن يريد التعرف على النتائج الأولية.

الطريقة الثالثة: Doubao (豆包) — مدخل مساعد الذكاء الاصطناعي الشامل

تطبيق Doubao هو المساعد الشامل للذكاء الاصطناعي من ByteDance، وقد تم دمج قدرات إنشاء الفيديو الخاصة بـ Seedance 2.0 فيه بالفعل.

خطوات الاستخدام:

- قم بتحميل تطبيق Doubao أو قم بزيارة نسخة الويب

- اختر وظيفة إنشاء الفيديو في المحادثة

- اختر نموذج Seedance 2.0 للبدء في الإبداع

الطريقة الرابعة: Volcengine — تجربة مخصصة للمؤسسات

Volcengine (火山引擎) هي منصة الخدمات السحابية التابعة لشركة ByteDance، وتوفر تجربة Seedance 2.0 عبر لوحة تحكم مخصصة للمؤسسات.

| المنصة | طريقة الوصول | المميزات | هل يتوفر API؟ |

|---|---|---|---|

| Volcengine | لوحة تحكم volcengine.com |

موجهة للمؤسسات داخل الصين | غير متاح حاليًا، متوقع في 24 فبراير |

| BytePlus | لوحة تحكم byteplus.com |

موجهة للمؤسسات الدولية | غير متاح حاليًا، متوقع في 24 فبراير |

ملاحظة: حاليًا، توفر Volcengine وBytePlus تجربة عبر واجهة لوحة العمل فقط، ولم يتم فتح واجهات برمجة التطبيقات (API) بعد.

الطريقة الخامسة: الوصول عبر API — الخيار المفضل للمطورين (قريبًا)

بالنسبة للمطورين والمؤسسات التي تحتاج إلى استدعاء Seedance 2.0 برمجيًا، فإن الـ API هو أهم وسيلة للوصول.

الجدول الزمني لإطلاق API:

| المرحلة الزمنية | الحدث | التوضيح |

|---|---|---|

| 12 فبراير 2026 | الإطلاق الرسمي لـ Seedance 2.0 | متاح عبر تطبيقات المستخدمين |

| 24 فبراير 2026 | الموعد المتوقع لفتح الـ API الرسمي | عبر Volcengine/BytePlus |

| فور فتح الـ API | الإطلاق المتزامن على منصة APIYI | بخصم يصل إلى 10% من السعر الرسمي |

🎯 نصيحة للمطورين: من المتوقع فتح API الخاص بـ Seedance 2.0 رسميًا في 24 فبراير 2026. ستوفر منصة APIYI (apiyi.com) خدمة الوصول إلى Seedance 2.0 API فور صدوره، وبسعر يقل بنسبة 10% تقريبًا عن الموقع الرسمي، مع توفير واجهة موحدة متوافقة مع تنسيق OpenAI لتسهيل التكامل السريع. ابقوا مترقبين.

نصائح استخدام Seedance 2.0 وأفضل الممارسات

إتقان مهارات استخدام Seedance 2.0 التالية يمكن أن يحسن نتائج الإنشاء بشكل كبير:

مهارات كتابة الموجه (Prompt) في Seedance 2.0

نصائح لموجهات "النص إلى فيديو" (Text-to-Video):

- صف مشهد الصورة بدقة، بما في ذلك الشخصيات، الحركات، البيئة، والإضاءة.

- حدد طريقة حركة الكاميرا (تقريب، ابتعاد، بانوراما، تتبع، إلخ).

- وضح نمط الصورة (جودة سينمائية، نمط وثائقي، نمط أنمي، إلخ).

- حدد الوقت والإيقاع (مثل "تقدم بطيء"، "تبديل سريع").

مثال لموجه:

امرأة شابة ترتدي فستانًا أبيض ترقص تحت شجرة كرز،

تتحرك الكاميرا ببطء من لقطة بعيدة إلى لقطة متوسطة،

ضوء طبيعي ناعم يسقط من الجانب الأيسر، وبتلات الزهور تتساقط مع الريح،

صورة بجودة سينمائية، عمق مجال ضحل، دقة 4K

مهارات استخدام الفيديو المرجعي في Seedance 2.0

يعد نظام الإشارة @ في Seedance 2.0 ميزة فريدة، حيث يمكنك تحميل فيديو مرجعي للتحكم في:

- مرجع حركة الكاميرا: قم بتحميل مقطع يحتوي على حركة الكاميرا التي تعجبك، وسيقوم النموذج بنسخها بدقة.

- تنسيق الرقص: قم بتحميل فيديو رقص مرجعي، وسيقوم النموذج بمزامنة الإيقاع لإنشاء محتوى رقص متوافق.

- مرجع النمط: قم بتحميل صورة أو فيديو مرجعي للحفاظ على نمط بصري متسق.

🎯 نصيحة متقدمة: في سيناريوهات الإدخال متعدد الوسائط، يمكنك الحصول على تحكم أدق من خلال تحديد دور واضح لكل مادة مرجعية باستخدام الإشارة @ (مثل @مرجع_حركة_الكاميرا، @مرجع_الشخصية). بعد فتح الـ API، ستدعم منصة APIYI (apiyi.com) أيضًا قدرات الإدخال متعدد الوسائط الكاملة.

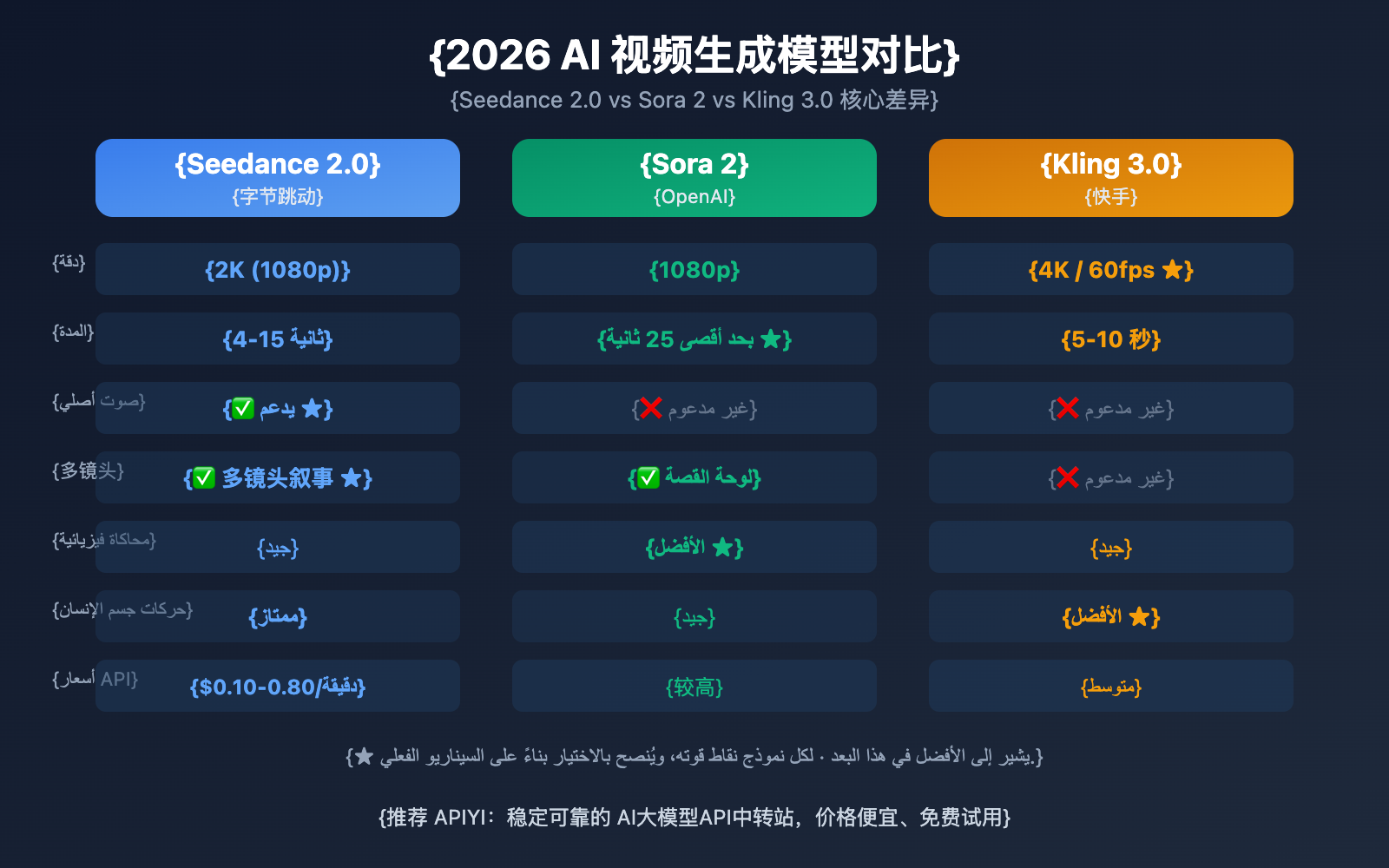

مقارنة Seedance 2.0 مع المنافسين

| معيار المقارنة | Seedance 2.0 | Sora 2 | Kling 3.0 |

|---|---|---|---|

| الشركة المطورة | بايت دانس (ByteDance) | OpenAI | كوايشو (Kuaishou) |

| أقصى دقة | 2K (1080p) | 1080p | 4K/60fps |

| مدة الفيديو | 4-15 ثانية | حتى 25 ثانية | 5-10 ثوانٍ |

| صوت أصلي | ✅ مدعوم | ❌ غير مدعوم | ❌ غير مدعوم |

| سرد بلقطات متعددة | ✅ مدعوم | ✅ Storyboard | ❌ غير مدعوم |

| إدخال فيديو مرجعي | ✅ متعدد الوسائط @ مرجع | ❌ محدود | ✅ مدعوم |

| محاكاة فيزيائية | جيد | الأفضل | جيد |

| حركة الجسم البشري | ممتاز | جيد | الأفضل |

| سعر API التقديري | 0.10-0.80 دولار/دقيقة | مرتفع | متوسط |

توضيح المقارنة: تتميز هذه النماذج بتنوع نقاط قوتها؛ حيث يتفوق Seedance 2.0 في دعم الصوت الأصلي والإشارات المرجعية متعددة الوسائط، بينما يبرز Sora 2 كالأقوى في المحاكاة الفيزيائية وإنتاج الفيديوهات الطويلة، في حين يقدم Kling 3.0 أداءً استثنائياً من حيث الدقة وحركة الأجسام البشرية. نوصي باختيار النموذج الأنسب بناءً على احتياجات مشروعك، ويمكنك تجربة ومقارنة هذه النماذج بسهولة عبر منصة APIYI (apiyi.com).

الأسئلة الشائعة

س1: أين يمكن استخدام Seedance 2.0؟ وما هي المداخل المتاحة حالياً؟

يمكن تجربة Seedance 2.0 حالياً عبر القنوات التالية: تطبيقات ByteDance الرسمية مثل Jimeng (即梦)، وXiao Yunque، وDoubao. كما يمكن لمستخدمي الشركات تجربته عبر منصتي Volcengine (火山引擎) وBytePlus. ومن المتوقع إطلاق واجهة برمجة التطبيقات (API) في 24 فبراير 2026.

س2: متى سيتم إطلاق Seedance 2.0 API؟ وما هي التكلفة؟

من المتوقع إطلاق Seedance 2.0 API رسمياً في 24 فبراير 2026 عبر Volcengine وBytePlus. السعر التقديري الرسمي يتراوح بين 0.10 و0.80 دولار للدقيقة (حسب الدقة). وستقوم منصة APIYI (apiyi.com) بتوفيره فور إطلاقه بخصم يصل إلى 10% تقريباً عن السعر الرسمي.

س3: هل Seedance 2.0 مجاني؟

Seedance 2.0 ليس مجانياً بالكامل. تتطلب منصة Jimeng اشتراكاً مدفوعاً (يوجد عرض تجريبي للمستخدمين الجدد مقابل 1 يوان لمدة 7 أيام)؛ بينما يوفر تطبيق Xiao Yunque ثلاث فرص تجربة مجانية و120 نقطة يومياً. أما عند استخدام الـ API، فسيتم الدفع حسب الاستهلاك.

س4: كيف يمكن استخدام النسخة الدولية من Seedance 2.0؟ وكيف يمكن للمستخدمين خارج الصين تجربته؟

حالياً، يتوفر Seedance 2.0 بشكل أساسي عبر منصة Jimeng المخصصة للصين القارية. النسخ الدولية مثل Dreamina (dreamina.capcut.com) وPippit لم تطلق Seedance 2.0 بعد. يمكن للمستخدمين في الخارج متابعة تحديثات منصة BytePlus، أو الانتظار حتى فتح الـ API والوصول إليه عبر منصة APIYI (apiyi.com).

ملاحظات هامة عند استخدام Seedance 2.0

عند استخدام Seedance 2.0، يرجى الانتباه إلى النقاط التالية:

- تعليق ميزة استنساخ الصوت مؤقتاً: تم تعليق ميزة "توليد الصوت من الصور" التي رافقت إطلاق Seedance 2.0 من قبل ByteDance خلال 48 ساعة من إطلاقها بسبب مخاوف تتعلق بالتزييف العميق (Deepfake)، ومن المقرر إعادة إطلاقها لاحقاً بعد إضافة آلية للتحقق من الهوية.

- الامتثال للمحتوى: يجب أن يتوافق المحتوى المولد مع القوانين واللوائح ذات الصلة، وتجنب توليد محتوى ينتهك حقوق الطبع والنشر أو يثير جدلاً أخلاقياً.

- متطلبات الحساب: تتطلب منصة Jimeng تسجيل الدخول باستخدام حساب Douyin، وهو ما يتطلب التحقق عبر رقم هاتف من الصين القارية.

ملخص

النقاط الأساسية لكيفية استخدام Seedance 2.0:

- تجربة فورية: يمكنك استخدام Seedance 2.0 عبر تطبيقات ByteDance الرسمية مثل Jimeng وLark وDoubao.

- تجربة المؤسسات: توفر منصتا Volcengine وBytePlus واجهة عمل للتجربة، لكن واجهة برمجة التطبيقات (API) لم تفتح بعد.

- الوصول عبر API: من المتوقع افتتاحه في 24 فبراير 2026، حيث سيكون متاحاً للاستدعاء البرمجي حينها.

- المزايا الأساسية: توليد صوت أصلي + سرد قصصي متعدد اللقطات + إشارات @ متعددة الوسائط؛ ثلاث قدرات تمييزية تتفوق بها على المنافسين.

نوصي بمتابعة APIYI (apiyi.com) للحصول على إشعارات إطلاق API الخاص بـ Seedance 2.0. ستوفر المنصة خدمة الوصول بخصم يصل إلى 10% تقريباً عن السعر الرسمي، مع دعم واجهة موحدة متوافقة مع تنسيق OpenAI، مما يسهل على المطورين التكامل السريع.

📚 المراجع

-

صفحة التعريف الرسمية بـ Seedance 2.0: تفاصيل النموذج المنشورة من قبل فريق Seed في ByteDance

- الرابط:

seed.bytedance.com/en/seedance2_0 - ملاحظة: تتضمن المواصفات التقنية الكاملة وعرضاً للميزات.

- الرابط:

-

منصة Jimeng AI للإبداع: مدخل التجربة الأول لـ Seedance 2.0

- الرابط:

jimeng.jianying.com - ملاحظة: المنصة التي توفر حالياً الوظائف الأكثر اكتمالاً لـ Seedance 2.0.

- الرابط:

-

مدونة الإطلاق الرسمية لـ Seedance 2.0: إعلان الإطلاق من فريق Seed في ByteDance

- الرابط:

seed.bytedance.com/en/blog/official-launch-of-seedance-2-0 - ملاحظة: تتضمن معلومات رسمية مثل وقت الإطلاق وأبرز الميزات.

- الرابط:

الكاتب: الفريق التقني

التواصل التقني: نرحب بمناقشة تجربة استخدام Seedance 2.0 في قسم التعليقات. لمزيد من المعلومات حول نماذج توليد الفيديو بالذكاء الاصطناعي، يمكنك زيارة مجتمع APIYI (apiyi.com) التقني.