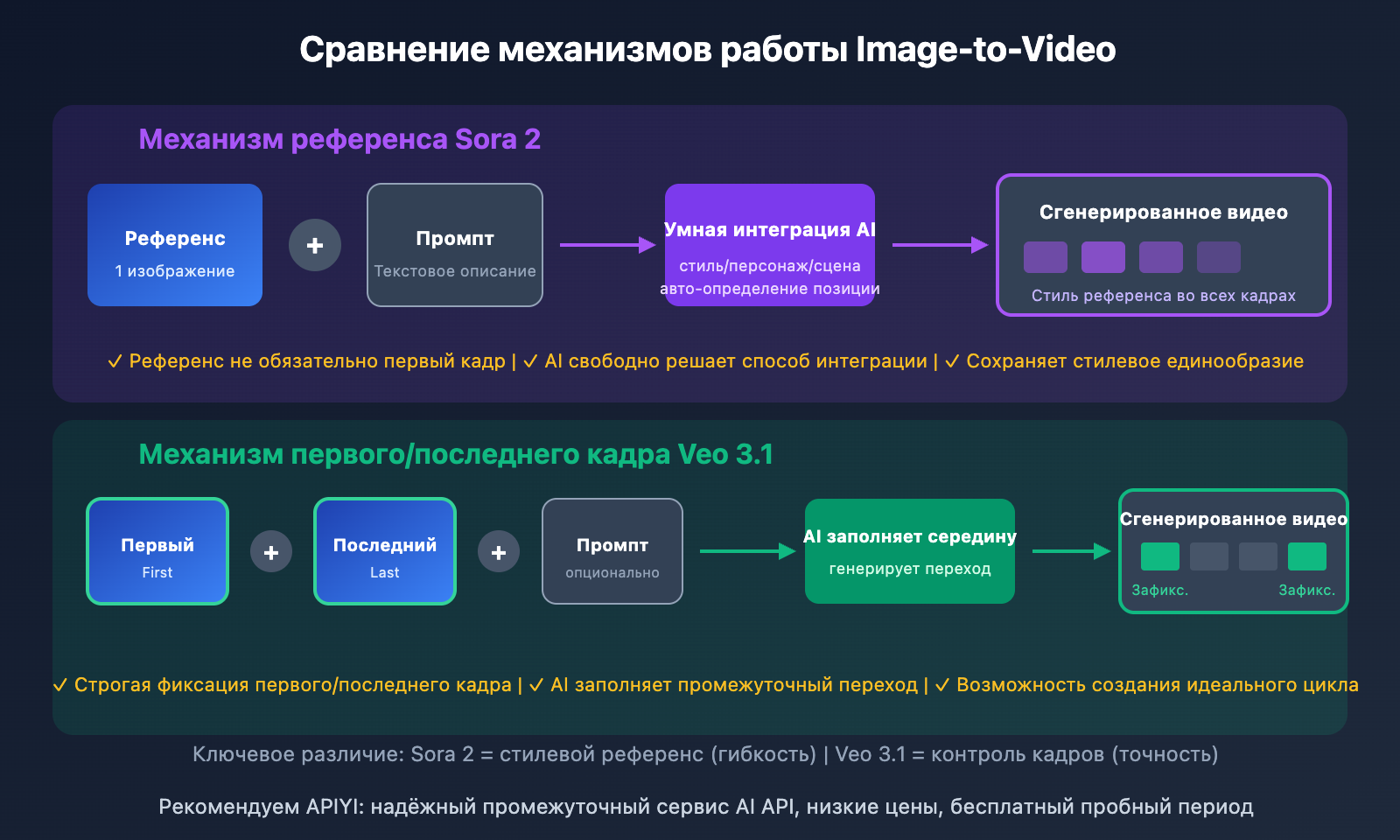

Примечание автора: Подробное сравнение функций генерации видео из изображений Sora 2 и Veo 3: Sora 2 поддерживает 1 референсное изображение для интеграции в видео, Veo 3.1 поддерживает 2 изображения для контроля первого и последнего кадра, помогая разработчикам выбрать наиболее подходящий API

В области генерации AI-видео функция Image-to-Video (изображение в видео) является одной из самых востребованных. Но многие разработчики неправильно понимают механизм загрузки изображений в Sora 2 и Veo 3: правда ли, что Sora 2 может использовать изображение только как первый кадр? Как работают две картинки в Veo 3? Эта статья подробно разберёт ключевые различия между двумя моделями.

Основная ценность: После прочтения этой статьи вы поймёте принципиальную разницу между референсным изображением Sora 2 и управлением первым/последним кадром в Veo 3, и научитесь выбирать наиболее подходящий API в зависимости от творческих задач.

Ключевые различия Image-to-Video в Sora 2 vs Veo 3

| Параметр сравнения | Sora 2 | Veo 3.1 |

|---|---|---|

| Количество изображений | 1 | 2 |

| Роль изображений | Референс (интеграция стиля в видео) | Первый кадр + Последний кадр |

| Обязательно ли это первый кадр | Нет, может интегрироваться в любое место | Да, строгий контроль начала и конца |

| Творческая свобода | Высокая (AI решает, как интегрировать) | Средняя (чёткие начальная и конечная точки) |

| Сценарии применения | Стилевой референс, единообразие персонажа | Переходная анимация, точный контроль |

Image-to-Video в Sora 2: правда об 1 референсном изображении

Многие ошибочно думают, что загружаемое в Sora 2 изображение — это "первый кадр". Это распространённое заблуждение. На самом деле, изображение в Sora 2 — это "референс" (Reference Image), его роль — предоставить визуальный стиль, дизайн персонажа или референс сцены, а не жёстко зафиксировать его как первый кадр видео.

Принцип работы референсного изображения:

- Интеграция стиля: Цветовая гамма, светотень и художественный стиль референса влияют на всё видео

- Единообразие персонажа: Загрузка изображения персонажа помогает сохранить его внешний вид во всём видео

- Референс сцены: Предоставление изображения окружения помогает AI понять атмосферу нужной вам сцены

- Не обязательно первый кадр: AI решает, как интегрировать референс в видео на основе промпта

Конечно, если ваш промпт явно требует "начать с этого изображения", Sora 2 обработает его как первый кадр. Но это результат управления через промпт, а не врождённое ограничение загрузки изображения.

Подробное руководство по вызову API Sora 2 для генерации видео из изображений

Базовый пример генерации видео из изображения в Sora 2

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Sora 2 генерация видео из изображения - режим референсного изображения

response = client.videos.create(

model="sora-2",

prompt="Рыжий кот лениво потягивается на солнце, камера медленно приближается",

input_reference=open("cat_reference.jpg", "rb"), # Референсное изображение

size="1280x720",

seconds=8

)

Полный пример вызова Sora 2 (с polling для получения результата)

import openai

import time

def generate_video_with_reference(

prompt: str,

reference_image_path: str,

model: str = "sora-2",

size: str = "1280x720",

seconds: int = 8

) -> dict:

"""

Генерация видео с помощью Sora 2 на основе референсного изображения

Args:

prompt: Описание видео

reference_image_path: Путь к референсному изображению

model: sora-2 или sora-2-pro

size: Размер видео

seconds: Длительность видео (4/8/12)

"""

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Создание задачи генерации видео

with open(reference_image_path, "rb") as img_file:

response = client.videos.create(

model=model,

prompt=prompt,

input_reference=img_file,

size=size,

seconds=seconds

)

video_id = response.id

print(f"Задача генерации видео создана: {video_id}")

# Polling - ожидание завершения

while True:

status = client.videos.retrieve(video_id)

if status.status == "completed":

return {

"success": True,

"video_url": status.video_url,

"duration": seconds

}

elif status.status == "failed":

return {"success": False, "error": status.error}

print(f"Генерация... Статус: {status.status}")

time.sleep(5)

# Пример использования

result = generate_video_with_reference(

prompt="Персонаж идет по городской улице, теплый солнечный свет, кинематографическое качество",

reference_image_path="character.jpg"

)

Совет: Для вызова Sora 2 API рекомендуем использовать сервис APIYI (apiyi.com) — платформа предоставляет стабильный интерфейс и бесплатные тестовые лимиты, что удобно для быстрой проверки результатов генерации видео из изображений.

Veo 3.1: управление первым и последним кадром — как работать с 2 изображениями

В отличие от режима референсного изображения в Sora 2, Veo 3.1 поддерживает загрузку 2 изображений, которые становятся первым и последним кадром видео. AI автоматически генерирует промежуточную анимацию, создавая плавный переход от точки А к точке Б.

Ключевые преимущества управления первым и последним кадром в Veo 3.1

| Функция | Описание | Сценарии применения |

|---|---|---|

| Точный контроль | Четкое определение начальной и конечной точки видео | Презентация продуктов, переходы между сценами |

| Эффекты переходов | AI автоматически заполняет промежуточную анимацию | Креативные переходы, морфинг-анимация |

| Зацикленное видео | Одинаковые первый и последний кадр создают идеальный луп | Фоновая анимация, Loading-эффекты |

| Нарративный контроль | Переход из состояния A в состояние B | Рассказ историй, передача эмоций |

Пример вызова API Veo 3.1 с управлением первым и последним кадром

import google.generativeai as genai

from google.genai import types

# Настройка API (через прокси APIYI)

genai.configure(api_key="YOUR_API_KEY")

# Загрузка первого и последнего кадра

first_frame = genai.upload_file("start_scene.jpg")

last_frame = genai.upload_file("end_scene.jpg")

# Генерация в Veo 3.1 с первым и последним кадром

response = genai.models.generate_videos(

model="veo-3.1",

prompt="Плавный переход между сценами, кинематографическое качество",

image=first_frame,

config=types.GenerateVideosConfig(

last_frame=last_frame,

duration_seconds=8

)

)

Специальная возможность Veo 3.1: Помимо управления первым и последним кадром, Veo 3.1 поддерживает до 4 референсных изображений для визуального руководства, что помогает сохранить согласованность персонажей и стилистики. Эта функция доступна только в стандартной версии Veo 3.1, быстрая версия (Fast) её не поддерживает.

Сравнение генерации видео из изображений: Sora 2 vs Veo 3

| Параметр | Sora 2 — режим референса | Veo 3.1 — режим первого и последнего кадра |

|---|---|---|

| Количество изображений | 1 | 2 (первый + последний) |

| Роль изображения | Референс стиля/персонажа | Точный контроль кадров |

| Свобода AI | Высокая | Низкая (ограничена кадрами) |

| Творческое направление | Свободное исследование | Чёткая цель |

| Способность к переходам | Средняя | Отличная |

| Зацикленное видео | Требует навыков | Нативная поддержка |

| Длительность видео | 4/8/12 сек | 4/6/8 сек |

| Разрешение | 720p/1080p | От 720p |

Как выбрать? Практическое руководство

Выбирайте Sora 2, когда:

- У вас есть изображение персонажа или сцены, и вы хотите дать AI свободу для творчества

- Нужно сохранить единообразие визуального стиля бренда

- Вы хотите, чтобы AI сама определила оптимальную композицию и траекторию движения

- Необходимо создать видео длительностью 12 секунд

Выбирайте Veo 3.1, когда:

- Вы точно знаете, как должны выглядеть начальный и конечный кадры видео

- Нужно показать трансформацию продукта из состояния A в состояние B

- Хотите создать идеально зацикленную фоновую анимацию

- Создаёте переходы между сценами или эффекты морфинга

Частые вопросы

Q1: Обязательно ли референсное изображение Sora 2 появляется в первом кадре?

Не обязательно. Референсное изображение в Sora 2 — это "визуальный референс", а не "фиксация первого кадра". ИИ сам решает, как интегрировать элементы референсного изображения в видео на основе вашего промпта. Если вам нужно, чтобы референс стал первым кадром, явно укажите это в промпте: "использовать это изображение как начальную сцену".

Q2: Могут ли два изображения в Veo 3.1 быть совершенно разными по содержанию?

Да, но лучше, если между ними есть визуальная связь. Veo 3.1 создаёт плавный переход между двумя изображениями, и если контент слишком различается, переход может получиться неестественным. Оптимально, когда начальное и конечное изображения имеют определённую преемственность в композиции, тональности или объектах.

Q3: У какой модели качество генерации видео из изображений лучше?

У каждой свои преимущества: Sora 2 Pro блестяще справляется с текстурой картинки и естественностью движения — идеально для киношного контента; Veo 3.1 превосходит в точности контроля и эффектах переходов. Рекомендую протестировать обе модели через APIYI apiyi.com и выбрать ту, что даёт лучший результат для вашей задачи.

Резюме

Ключевые различия между Sora 2 и Veo 3 в режиме генерации видео из изображений:

- Разное количество изображений: Sora 2 поддерживает 1 референсное изображение, Veo 3.1 — 2 изображения для начального и конечного кадров

- Разная роль изображений: в Sora 2 референс влияет на стиль видео, в Veo 3.1 начальный и конечный кадры точно контролируют начало и финал

- Разные сценарии применения: Sora 2 подходит для творческого поиска, Veo 3.1 — для чётко заданных переходов

Понимание принципиальной разницы между этими механизмами поможет вам выбрать наиболее подходящий API под конкретную задачу и добиться лучших результатов.

Рекомендуем подключить оба API — Sora 2 и Veo 3 — через платформу APIYI apiyi.com, которая предоставляет единый интерфейс и бесплатные тестовые квоты для удобного сравнения и гибкого переключения между моделями.

📚 Справочные материалы

⚠️ О формате ссылок: Все внешние ссылки даны в формате

Название ресурса: domain.comдля удобства копирования, но без возможности перехода по клику — это помогает сохранить SEO-вес сайта.

-

Официальная документация OpenAI Sora API: Полное руководство по генерации видео с помощью Sora

- Ссылка:

platform.openai.com/docs/guides/video-generation - Описание: Узнайте об официальных параметрах и способах использования функции image-to-video в Sora 2

- Ссылка:

-

Документация Google Veo 3.1 по первому и последнему кадру: Руководство по генерации видео в Vertex AI

- Ссылка:

docs.cloud.google.com/vertex-ai/generative-ai/docs/video/generate-videos-from-first-and-last-frames - Описание: Подробная информация об использовании функции генерации по первому и последнему кадру в Veo 3.1

- Ссылка:

-

Руководство по промптам для Sora 2: Официальный гайд от OpenAI

- Ссылка:

cookbook.openai.com/examples/sora/sora2_prompting_guide - Описание: Научитесь писать качественные промпты для генерации видео в Sora 2

- Ссылка:

-

Обзор возможностей Google Veo 3.1: Детальный разбор функций работы с первым/последним кадром и референсными изображениями

- Ссылка:

getimg.ai/blog/google-veo-3-1-review - Описание: Глубокое погружение в новые функции Veo 3.1 и практические советы по их использованию

- Ссылка:

Автор: Техническая команда

Обсуждение: Приглашаем к обсуждению в комментариях. Больше материалов — в техническом сообществе APIYI apiyi.com