Недавно на GitHub появился проект под названием ARIS-Code, который буквально «взорвал» сообщество, набрав более 8400 звезд и 783 форка. Его разработал энтузиаст wanshuiyin на базе открытого исходного кода Claude Code. Полное название проекта — Auto-Research-In-Sleep, что можно перевести как «автоматические исследования во время сна». И это не просто маркетинговый слоган: инструмент действительно позволяет Claude Code самостоятельно проводить эксперименты, искать литературу и править черновики статей, пока вы отдыхаете. Проснувшись, вы обнаружите, что работа продвинулась на значительный шаг вперед.

Особый интерес вызывает реакция академического сообщества: автор проекта представил три примера научных работ, подготовленных с помощью системы. По оценкам AI-рецензентов, черновики получили 7–8 баллов из 10 и уже были поданы на топовые конференции по компьютерным наукам, AAAI 2026 и в журнал IEEE TGRS. Это доказывает, что автономные научные исследования с помощью ИИ переросли стадию демо-версий и теперь способны генерировать материалы, пригодные для публикации.

В этой статье мы подробно разберем архитектуру ARIS-Code, его 42 встроенных навыка (Skills), а также способ подключения к моделям Claude через сторонний сервис-прокси API для работы в российских условиях. Это поможет вам понять, впишется ли такой инструмент в ваш рабочий процесс.

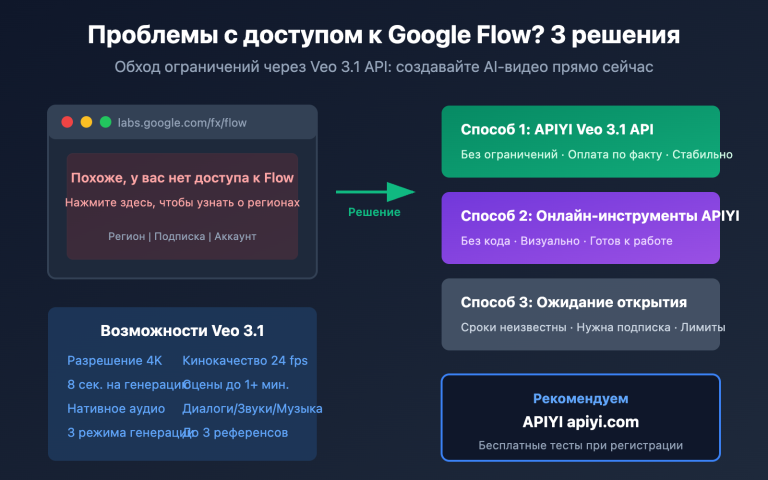

🎯 Важное примечание: Поскольку ARIS-Code основан на открытой версии Claude Code, его исполнитель поддерживает только модели серии Claude (Sonnet/Opus/Haiku). Поддержка GPT или Gemini в качестве основного исполнителя отсутствует. Мы рекомендуем использовать платформу APIYI (apiyi.com) для подключения к моделям Claude. Она полностью совместима с нативным протоколом Anthropic, обеспечивает стабильный доступ из РФ и работает по модели оплаты за использование, не требуя зарубежных банковских карт.

Что такое проект ARIS-Code: Auto-Research-In-Sleep

ARIS (Auto-Research-In-Sleep) — это система автономного рабочего процесса для исследователей в области машинного обучения и ИИ. Ссылка на проект: github.com/wanshuiyin/Auto-claude-code-research-in-sleep. Цель системы предельно ясна: позволить исследователю с минимальным вмешательством пройти весь путь от «обзора литературы → генерации идей → проведения экспериментов → написания статьи → до подготовки ответов на рецензии (Rebuttal)». Это освобождает ученого от рутинной механической работы.

По своей сути ARIS-Code — это библиотека методологий. Вся система состоит из обычных Markdown-файлов (SKILL.md). Здесь нет сложных фреймворков для установки, баз данных для обслуживания или Docker-контейнеров для настройки. Каждый навык (Skill) представляет собой инструкцию рабочего процесса, которую может прочитать любой LLM-агент. Поэтому вы можете переключать исполнителя с Claude Code на Codex CLI, OpenClaw, Cursor, Trae или любой другой инструмент с поддержкой режима агента — рабочий процесс останется эффективным.

Такой подход «нулевой зависимости и отсутствия привязки» — главная особенность ARIS-Code, отличающая его от других ИИ-инструментов для науки. По сути, он превращает научный процесс в явный промпт-инжиниринг, а не прячет его в «черный ящик». Для исследователя это критически важно: рабочий процесс остается прозрачным, его можно читать, изменять и переносить, не опасаясь зависимости от конкретного коммерческого продукта.

Стоит отметить, что в репозитории ARIS-Code уже более 719 коммитов, и проект продолжает активно развиваться. Только за последние три месяца были добавлены такие полезные навыки, как paper-talk (генерация докладов для конференций), resubmit-pipeline (конвейер для повторной подачи после отклонения статьи) и kill-argument (генерация контраргументов для защиты позиции). Экосистема проекта крайне активна.

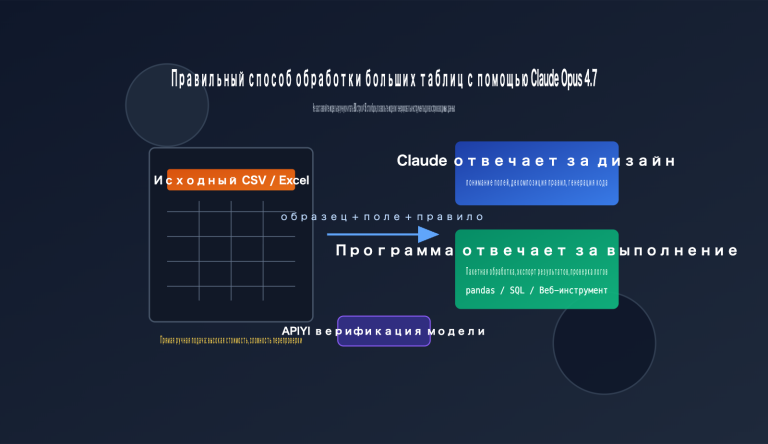

Основная архитектура ARIS-Code: состязательная проверка «Исполнитель-Рецензент»

Ключевая инженерная ценность ARIS-Code заключается в его двухмодельной состязательной архитектуре, что принципиально отличает его от других научных помощников на рынке. Автор проекта в README делает глубокое наблюдение: самопроверка одной моделью имеет структурную слабость. Когда одна и та же модель выполняет задачу и сама же оценивает результат, она систематически воспроизводит свои «слепые зоны», попадая в ловушку локального оптимума.

Решение, предложенное ARIS-Code, заключается в передаче права на проверку полностью независимой модели. Распределение ролей выглядит следующим образом:

| Роль | Выбор модели | Обязанности | Рекомендуемые навыки |

|---|---|---|---|

| Executor (Исполнитель) | Claude Sonnet / Opus | Основная работа: написание кода, поиск литературы, проведение экспериментов, черновики статей | Высокая скорость, большое контекстное окно, стабильный вызов инструментов |

| Reviewer (Рецензент) | GPT-5.4 (Codex MCP) / Oracle Pro | Состязательная проверка: поиск уязвимостей, сомнения в выводах, поиск контрпримеров | Глубокое мышление, критический подход, независимый стиль |

| Механизм координации | Инструментарий LlmReview | Межмодельная коммуникация, сохранение состояния | Прозрачная передача через протокол MCP |

Весь рабочий процесс можно свести к простому циклу: Исполнитель пишет → Рецензент проверяет → Исполнитель исправляет → снова проверка и исправление, пока Рецензент не даст «добро». Этот цикл эффективен, потому что модели созданы разными компаниями, обучались на разных данных и имеют разные стили рассуждений, поэтому их «слепые зоны» не пересекаются.

Чтобы предотвратить загрязнение научных выводов галлюцинациями LLM, в ARIS-Code также разработана многоуровневая цепочка аудита доказательств: experiment-audit (целостность кода) → result-to-claim (соответствие результатов утверждениям) → paper-claim-audit (аудит утверждений в статье) → citation-audit (проверка цитирований). Каждый уровень имеет независимый JSON-вердикт и SHA256-хеш для верификации воспроизводимости — такая инженерная строгость встречается в научных ИИ-инструментах крайне редко.

🔧 Совет по настройке: Если вы хотите полностью воспроизвести двухмодельную архитектуру ARIS-Code, в России рекомендуется использовать сервис-прокси API APIYI (apiyi.com) для одновременного получения API-ключей моделей Claude и GPT. Одна платформа предоставляет доступ к обеим линейкам интерфейсов, что избавляет от необходимости открывать зарубежные счета и привязывать иностранные банковские карты.

ARIS-Code: полный цикл научных исследований на базе 42 встроенных Skills

Самое впечатляющее в ARIS-Code — это более 42 встроенных Skills. Это не просто разрозненные инструменты, а полноценный конвейер, охватывающий весь жизненный цикл научного исследования. Я классифицировал их по этапам рабочего процесса:

| Этап рабочего процесса | Основные Skills | Ключевые возможности |

|---|---|---|

| Выбор темы (Idea Discovery) | research-lit / novelty-check / idea-creator / idea-discovery | Поиск по разным источникам, проверка новизны через кросс-модели, генерация 8-12 идей |

| Эксперименты (Experimentation) | experiment-bridge / experiment-queue / run-experiment | Ревью кода → деплой на GPU → оркестрация сидов → автообработка OOM |

| Автоматическое ревью (Auto Review) | auto-review-loop / research-review / experiment-audit | 4 цикла итеративного улучшения, структурированное peer-review, проверка целостности кода |

| Написание статьи (Paper Writing) | paper-writing / paper-claim-audit / proof-checker / citation-audit | Нарратив → LaTeX → PDF, аудит утверждений, проверка доказательств, верификация цитат |

| Работа с Rebuttal | rebuttal | Анализ замечаний рецензентов → черновик ответа → стресс-тестирование |

| Мета-способности | research-wiki / meta-optimize / deepxiv | Постоянная база знаний, внешняя оптимизация, альтернативные источники литературы |

Самый полезный на практике Skill — это experiment-bridge. Он объединяет «ревью кода → удаленный деплой на GPU → запуск эксперимента → сбор результатов» в единый конвейер. Когда рецензент просит «сделать здесь абляционное исследование», Executor автоматически пишет скрипт, отправляет его через rsync на GPU-узел, запускает обучение, мониторит логи и собирает результаты. Исследователю даже не нужно вмешиваться.

Еще один важный Skill — citation-audit. Он подключается к реальным базам данных DBLP и CrossRef, устраняя главную боль при написании статей с LLM — галлюцинации в цитатах. Каждый BibTeX-запрос берется из реальной базы, а не выдумывается моделью. Для академической работы это критически важно: любая вымышленная ссылка может привести к немедленному отказу в публикации.

Исследователи также высоко ценят research-wiki — базу знаний, которая сохраняется между сессиями. Она накапливает заметки по прочитанным статьям, черновики идей и записи о неудачных экспериментах, формируя «память» вашего исследования. Когда вы вернетесь к заброшенному проекту через три месяца, вам не придется перечитывать всё заново — ИИ-ассистент уже сохранил контекст.

💡 Совет: Вызов любого Skill потребляет много токенов Claude API, особенно при генерации длинных текстов, как в случае с paper-writing. Рекомендуем подключаться к моделям Claude через APIYI (apiyi.com). Платформа поддерживает оплату по факту использования и предоставляет детальный мониторинг расхода токенов, что поможет заранее оценить стоимость написания статьи.

Полная схема подключения ARIS-Code через APIYI

Поскольку исполнитель (Executor) в ARIS-Code основан на Claude Code, он принимает только нативный протокол Anthropic. Это означает, что модели GPT или Gemini нельзя использовать в качестве Executor. Это жесткое ограничение, с которым сталкиваются многие разработчики при первом развертывании.

Настройка доступа к моделям Claude через APIYI выполняется всего в 5 шагов:

# Шаг 1: Клонируем репозиторий

git clone https://github.com/wanshuiyin/Auto-claude-code-research-in-sleep

cd Auto-claude-code-research-in-sleep

# Шаг 2: Устанавливаем Skills в директорию конфигурации Claude Code

mkdir -p ~/.claude/skills/

cp -r skills/* ~/.claude/skills/

# Шаг 3: Настраиваем адрес прокси APIYI (ключевой шаг)

export ANTHROPIC_BASE_URL="https://vip.apiyi.com"

export ANTHROPIC_AUTH_TOKEN="Ваш API-ключ APIYI"

# Шаг 4: Запускаем Claude Code

claude

# Шаг 5: Вызываем любой Skill прямо в Claude Code

# Например: /research-pipeline "factorized gap in discrete diffusion LMs"

Самое важное здесь — шаг 3: установка переменной окружения ANTHROPIC_BASE_URL. Она указывает Claude Code обращаться не к официальному эндпоинту Anthropic, а к нашему шлюзу. Шлюз полностью совместим с протоколом Anthropic, поэтому встроенные в ARIS-Code инструменты работают «из коробки» без правок кода, включая вызовы функций, потоковый вывод и цепочки рассуждений (thinking).

Если вам также нужно развернуть сторону рецензента (Codex MCP), процесс выглядит так:

# Установка Codex MCP для ревью

npm install -g @openai/codex

codex setup # Здесь также можно указать адрес прокси для моделей GPT

claude mcp add codex -s user -- codex mcp-server

Для исследователей, стремящихся к максимальному качеству, проект предлагает подключение Oracle MCP с моделью GPT-5.4 Pro в качестве продвинутого рецензента. Это полезно на финальных этапах работы над статьей, так как глубина критики и способность модели находить контрпримеры у версии Pro значительно выше.

🚀 Единое решение для доступа: Платформа APIYI (apiyi.com) поддерживает модели серий Claude (Sonnet 4.5/Opus 4), GPT (GPT-5/o4) и Gemini (Gemini 3 Pro). Один ключ позволяет управлять и Executor, и Reviewer в ARIS-Code, что очень удобно для контроля расходов и учета вызовов в научных командах.

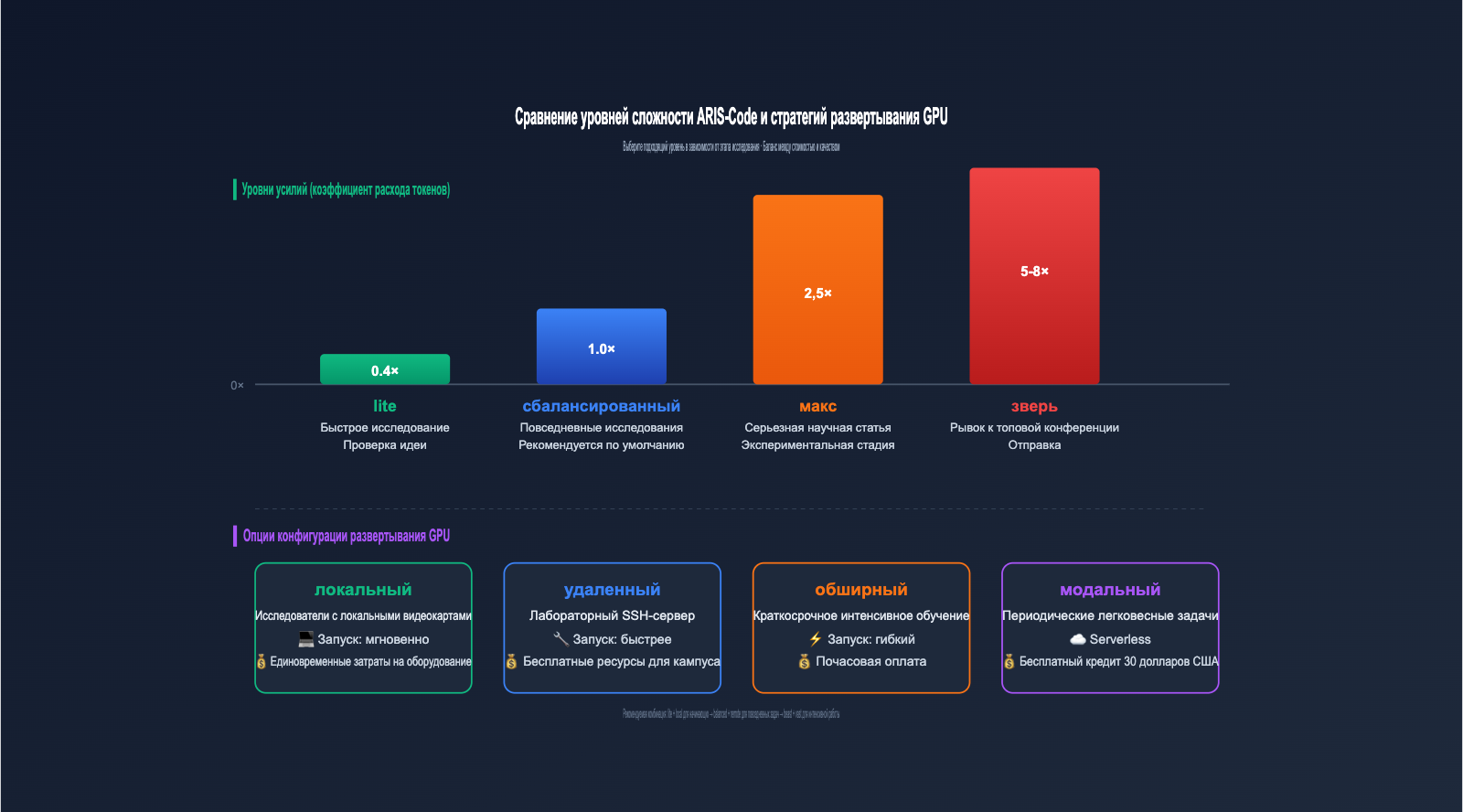

Уровни усилий (Effort Levels) и стратегии конфигурации GPU в ARIS-Code

ARIS-Code предлагает 4 уровня Effort Level для баланса между стоимостью и качеством — это очень продуманное инженерное решение. Требования к глубине проработки сильно различаются на разных этапах исследования: на стадии ранних экспериментов нет смысла тратить лишние токены, а вот при подготовке к публикации качество должно быть доведено до максимума.

| Effort Level | Множитель токенов | Сценарий использования | Оценка за вызов |

|---|---|---|---|

| lite | 0.4× | Быстрый поиск, проверка идей | Очень низкая |

| balanced | 1.0× | Обычный рабочий процесс | Стандартная |

| max | 2.5× | Серьезные эксперименты для статей | Выше среднего |

| beast | 5-8× | Финишная прямая, режим подачи (Submission) | Высокая |

Для GPU в ARIS-Code также предусмотрены 4 варианта конфигурации, подходящие как для работы локально, так и в облаке:

| Конфигурация GPU | Сценарий использования | Особенности затрат |

|---|---|---|

| local | Исследователи с мощной картой | Единоразовые затраты на железо |

| remote | Лабораторный SSH-сервер | Бесплатно (ресурсы вуза) |

| vast | Краткосрочное интенсивное обучение | Почасовая оплата, гибкость |

| modal | Периодические легкие задачи | Serverless, 30$ бесплатного кредита |

💰 Советы по контролю затрат: Если вы только начинаете работать с ARIS-Code, рекомендую сначала отладить процесс в режиме lite + local. Используйте сервис-прокси API от APIYI (apiyi.com), чтобы было проще отслеживать расход токенов. Как только процесс станет стабильным, переходите на уровни max или beast для серьезных исследований — это поможет избежать лишних трат из-за ошибок в конфигурации на старте.

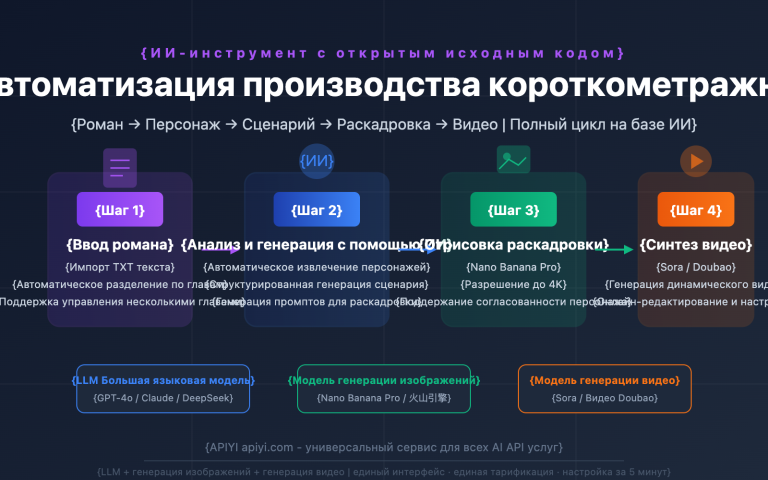

Практический рабочий процесс ARIS-Code: от идеи до научной статьи

Самое впечатляющее в ARIS-Code — это его сквозной конвейер /research-pipeline. Этот навык объединяет все этапы работы в одну команду. Вам достаточно лишь описать направление исследования, и система автоматически подготовит черновик за 8–24 часа.

Типичные сценарии использования:

# Сценарий 1: Новое направление, начинаем с нуля

/research-pipeline "factorized gap in discrete diffusion LMs"

# Сценарий 2: Улучшение существующей статьи

/research-pipeline "improve method X" \

--ref-paper https://arxiv.org/abs/2406.04329 \

--base-repo https://github.com/org/project

# Сценарий 3: Только Rebuttal (ответ на рецензии)

/rebuttal "paper/ + reviews" --venue ICML --char-limit 5000

Во время выполнения ARIS-Code последовательно проходит все этапы: обзор литературы → генерация идей → проверка на новизну → дизайн эксперимента → планирование ресурсов GPU → сбор результатов → написание статьи → аудит цитирований → верстка. Если система сталкивается с неоднозначным решением, она приостанавливается и ждет подтверждения от пользователя. При настройке --AUTO_PROCEED false вы сможете вручную вмешиваться в процесс после каждого раунда обратной связи от рецензентов.

В ARIS-Code также есть полезный параметр style-ref. Вы можете указать статью в качестве эталона стиля (например, лучшую работу с прошлой конференции), и система скопирует структуру и ритм повествования, не заимствуя при этом конкретные фрагменты текста. Для исследователей, стремящихся к высокой вероятности принятия статьи, это практически «нечестное преимущество», так как негласные требования рецензентов к стилю часто сложнее соблюсти, чем требования к содержанию.

Еще одна важная инженерная деталь: ARIS-Code интегрируется с Overleaf (двусторонняя синхронизация), W&B (мониторинг графиков обучения) и Lark/Feishu (уведомления на мобильный). Когда эксперимент на GPU достигает ключевой точки, вы сразу получите уведомление на телефон — это настоящий «исследовательский процесс во сне».

📊 Данные о производительности: Согласно трем кейсам из сообщества, статьи, созданные с помощью ARIS-Code, получили оценки 7–8/10 от AI-рецензентов (конференции CS, AAAI 2026, IEEE TGRS). Однако авторы предупреждают: человеческие рецензенты обладают взглядом, который не уловить AI, поэтому полностью полагаться на автоматику нельзя.

FAQ по ARIS-Code

Q1: Почему ARIS-Code нельзя использовать с GPT-5 в качестве исполнителя?

Поскольку ARIS-Code — это форк с открытым исходным кодом Claude Code, его уровень исполнения жестко привязан к нативному API Anthropic (форматы вызова инструментов, потоковый вывод, цепочки рассуждений). Если вы хотите сменить исполнителя, придется переходить на OpenClaw или другие дистрибутивы, но это уже будет не оригинальный ARIS-Code. Мы рекомендуем подключаться к моделям Claude через APIYI — это самый простой способ.

Q2: Сколько токенов нужно для написания полной статьи?

В режиме «beast» полный прогон /research-pipeline потребляет от 5 до 15 млн токенов (вход + выход), что в пересчете на цены Claude Sonnet составляет от нескольких сотен до пары тысяч рублей. В сбалансированном режиме расход можно снизить до 2–5 млн токенов. Итоговая стоимость зависит от сложности эксперимента и количества итераций.

Q3: Можно ли использовать ARIS-Code без локального GPU?

Конечно. В ARIS-Code предусмотрены режимы работы с облачными GPU (vast и modal). У modal, например, есть бесплатный лимит в 30 долларов, чего вполне хватит для легких экспериментов. Если вы пишете только теоретическую статью (/proof-writer + /formula-derivation), GPU вообще не потребуется.

Q4: Обязательно ли использовать GPT-5.4 в качестве рецензента в архитектуре с двумя моделями?

Не обязательно. Проект поддерживает замену на любую модель, совместимую с протоколом OpenAI (GLM, MiniMax, Kimi и др.). Мы рекомендуем использовать агрегаторы вроде APIYI для доступа к разным моделям-рецензентам, чтобы проводить A/B-тесты и находить наиболее критически настроенный LLM для вашей области. Некоторые исследователи отмечают, что Gemini 3 Pro неожиданно хорош в качестве рецензента для математических работ, а GPT-5.4 остается фаворитом для инженерных оптимизаций.

Q5: Подходит ли ARIS-Code для студентов или новичков?

Он больше ориентирован на аспирантов и исследователей с опытом. Качество вывода сильно зависит от вашей способности судить о предметной области. Например, когда рецензент указывает на контрпример, вы должны понимать, является ли это критической ошибкой или второстепенной деталью. Новичка AI может легко увести в неверном направлении.

Q6: Что делать, если сеть в РФ работает нестабильно?

Прямое подключение к официальному API Anthropic часто приводит к разрывам соединения, что может прервать длительную задачу /research-pipeline. Надежное решение — переключить ANTHROPIC_BASE_URL на прокси-сервер, развернутый внутри страны. Это позволит ARIS-Code работать 8 часов подряд без риска прерывания из-за сетевых колебаний, что критически важно для экспериментов в режиме «beast».

Итоги

Появление ARIS-Code подтверждает важный тренд: инструменты для научных исследований в эпоху больших языковых моделей переходят от «точечной помощи» к «полной автоматизации рабочих процессов». Архитектура с двумя моделями (Executor-Reviewer), 42 навыка (Skills) для рабочих процессов и дизайн на базе Markdown без лишних зависимостей — всё это формирует зрелую методологическую базу.

Для исследователей из РФ и СНГ главным барьером при работе с ARIS-Code является не кривая обучения, а стабильный доступ к моделям Claude. Мы рекомендуем использовать платформу apiyi.com для подключения моделей серии Claude, а также GPT для роли Reviewer. Таким образом, одна платформа покроет все потребности ARIS-Code в вызовах моделей, что значительно упростит расчеты и ведение логов. Кроме того, стабильность узлов APIYI гарантирует, что ваш сценарий «запустил эксперимент и пошел спать» не прервется из-за сетевых проблем.

Если вы готовитесь к публикации на топовой конференции или у вас есть идея, которую хочется проверить, но нет времени на ручную итерацию, ARIS-Code определенно стоит того, чтобы потратить на него выходные. Если к утру у вас на руках будет готовый черновик — это станет отличной инвестицией времени.

📌 Автор: Команда APIYI — мы давно следим за экосистемой API больших языковых моделей. Больше примеров интеграции Claude/GPT/Gemini вы найдете в центре документации apiyi.com.