최근 GitHub에서 ARIS-Code라는 오픈소스 프로젝트가 별 8,400개 이상, 포크 783개를 기록하며 조용히 돌풍을 일으키고 있습니다. 개발자 wanshuiyin이 Claude Code 오픈소스 버전을 기반으로 발전시킨 이 프로젝트의 정식 명칭은 'Auto-Research-In-Sleep'으로, 말 그대로 "자면서 연구한다"는 뜻입니다. 이는 단순한 마케팅 문구가 아닙니다. 실제로 Claude Code가 잠든 사이 자동으로 실험을 수행하고, 문헌을 조사하며, 논문을 수정하여 다음 날 아침이면 연구 진척도가 크게 앞서 있게 만들어 줍니다.

ARIS-Code가 학계에서 불러일으킨 반향은 특히 주목할 만합니다. 프로젝트 작성자가 공개한 세 가지 커뮤니티 논문 사례를 보면, AI가 작성한 초안이 AI 평가 점수 7~8/10 수준에 도달했으며, 실제로 CS 최상위 학회, AAAI 2026, IEEE TGRS 등에 투고되었습니다. 이는 AI를 활용한 완전 자동화 연구가 단순한 데모 수준을 넘어, 실제 투고 가능한 수준의 논문을 산출할 수 있는 단계에 이르렀음을 의미합니다.

본 글에서는 ARIS-Code의 핵심 아키텍처와 42개의 내장 Skill, 그리고 국내 환경에서 API 중계 서비스를 통해 Claude 모델을 연동하는 구체적인 방법을 심층 분석하여, 이 도구가 여러분의 연구 워크플로우에 적합한지 판단할 수 있도록 돕겠습니다.

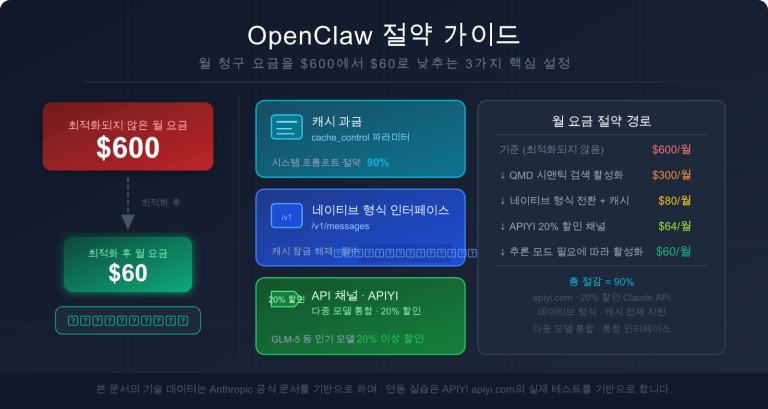

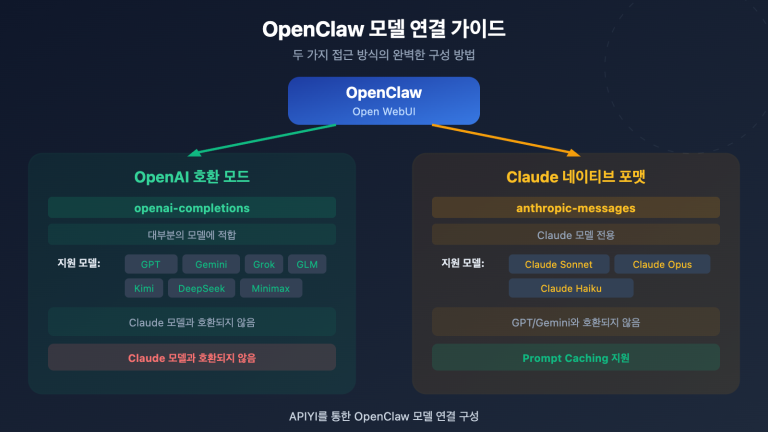

🎯 특별 안내: ARIS-Code는 Claude Code 오픈소스 버전을 기반으로 하므로 실행기는 Claude 시리즈 모델(Sonnet/Opus/Haiku)만 연동 가능하며, GPT나 Gemini 시리즈는 메인 실행기로 지원하지 않습니다. Anthropic 원본 프로토콜과 호환되며, 국내에서 안정적인 접속과 종량제 과금을 지원하여 해외 신용카드가 필요 없는 APIYI(apiyi.com) 플랫폼을 통해 Claude 모델을 연동하는 것을 권장합니다.

ARIS-Code: Auto-Research-In-Sleep 프로젝트란 무엇인가

ARIS(Auto-Research-In-Sleep)는 머신러닝/AI 연구자를 위한 자율 연구 워크플로우 시스템으로, 프로젝트 주소는 github.com/wanshuiyin/Auto-claude-code-research-in-sleep 입니다. 이 시스템의 설계 목표는 명확합니다. 연구자가 최소한의 개입만으로 '문헌 조사 → 아이디어 생성 → 실험 수행 → 논문 작성 → 반박(Rebuttal) 대응'의 전 과정을 완료하여, 반복적인 육체노동에서 해방되도록 돕는 것입니다.

ARIS-Code의 본질은 방법론 라이브러리입니다. 전체 시스템은 순수 마크다운 파일(SKILL.md)로 구성되어 있어 별도의 프레임워크 설치나 데이터베이스 유지보수, Docker 설정이 필요 없습니다. 각 Skill은 어떤 LLM 에이전트라도 읽을 수 있는 워크플로우 설명서이므로, 실행기를 Claude Code에서 Codex CLI, OpenClaw, Cursor, Trae 등 에이전트 모드를 지원하는 도구로 변경해도 워크플로우는 그대로 작동합니다.

이러한 "제로 의존성, 제로 락인(Lock-in)" 설계는 ARIS-Code가 다른 연구용 AI 도구와 차별화되는 가장 큰 특징입니다. 이는 연구 과정을 블랙박스 도구로 캡슐화하는 대신, 실행 가능한 프롬프트 엔지니어링으로 "명시화"한 것입니다. 연구자에게 있어 이는 워크플로우를 읽고, 수정하고, 이식할 수 있다는 것을 의미하며, 특정 상업용 제품에 종속되지 않는다는 점에서 매우 중요한 가치를 지닙니다.

참고로 ARIS-Code 저장소는 이미 719개의 커밋을 기록하며 빠르게 발전하고 있습니다. 최근 3개월 동안 paper-talk(학회 발표 자료 생성), resubmit-pipeline(논문 거절 후 재투고 파이프라인), kill-argument(대립적 반박 생성) 등 고가치 Skill이 추가되면서 생태계가 매우 활발하게 운영되고 있습니다.

ARIS-Code 핵심 아키텍처: Executor-Reviewer 대립형 검토 모델

ARIS-Code의 가장 핵심적인 엔지니어링 가치는 **이중 모델 대립형 아키텍처(Dual-Model Adversarial Architecture)**에 있습니다. 이는 시중의 다른 연구 보조 도구들과 차별화되는 가장 본질적인 요소죠. 프로젝트 개발자는 README에서 매우 통찰력 있는 관점을 제시했습니다. 단일 모델이 스스로 검토할 경우 구조적인 약점이 발생하는데, 동일한 모델이 작업을 수행하고 동시에 출력물을 평가하면 자신의 사각지대를 시스템적으로 반복하게 되어 '로컬 옵티마(Local Optimum) 함정'에 빠지기 쉽다는 것입니다.

ARIS-Code는 검토 권한을 완전히 독립된 모델에 넘기는 방식을 택했습니다. 구체적인 역할 분담은 다음과 같습니다.

| 역할 | 모델 선정 | 역할 정의 | 추천 능력 |

|---|---|---|---|

| Executor (실행자) | Claude Sonnet / Opus | 주력 실행: 코드 작성, 문헌 조사, 실험 수행, 논문 초안 작성 | 빠른 속도, 긴 컨텍스트, 안정적인 도구 호출 |

| Reviewer (검토자) | GPT-5.4 (Codex MCP) / Oracle Pro | 대립 검토: 취약점 발견, 결론 의문 제기, 반례 제시 | 심층 추론, 비판적 사고, 독립적 스타일 |

| 조정 메커니즘 | LlmReview 도구 체인 | 모델 간 통신, 상태 유지 | MCP 프로토콜을 통한 투명한 전달 |

전체 워크플로우는 간단한 루프로 요약됩니다: Executor 작성 → Reviewer 검토 → Executor 수정 → 재검토 및 수정, Reviewer가 통과 판정을 내릴 때까지 반복. 이 루프가 효과적인 이유는 두 모델이 서로 다른 제조사 출신이며 학습 데이터와 추론 스타일이 달라 사각지대가 겹치지 않기 때문입니다.

LLM 환각이 연구 결론을 오염시키는 것을 방지하기 위해, ARIS-Code는 다층 증거 감사 체인(Evidence Audit Chain)을 설계했습니다: experiment-audit(코드 무결성) → result-to-claim(결과-주장 연결) → paper-claim-audit(논문 주장 감사) → citation-audit(인용 검증). 각 단계는 독립적인 JSON 검증 결과와 SHA256 해시를 사용하여 재현성을 보장하며, 이러한 엔지니어링 엄격함은 연구용 AI 도구 중 매우 드문 사례입니다.

🔧 설정 제안: ARIS-Code의 이중 모델 아키텍처를 완벽하게 재현하고 싶다면, 국내 환경에서는 APIYI(apiyi.com)를 통해 Claude와 GPT 시리즈 모델 키를 동시에 확보하는 것을 추천합니다. 하나의 플랫폼에서 두 인터페이스를 모두 제공하므로, 해외 계정을 별도로 만들거나 신용카드를 등록할 필요가 없습니다.

ARIS-Code에 내장된 42개 Skills: 전체 연구 파이프라인

ARIS-Code에서 가장 인상적인 점은 42개 이상의 내장 Skill입니다. 이 Skill들은 단순한 개별 도구가 아니라, 전체 연구 생애 주기를 아우르는 하나의 파이프라인입니다. 워크플로우 단계별로 분류하면 다음과 같습니다:

| 워크플로우 단계 | 대표 Skills | 핵심 능력 |

|---|---|---|

| 주제 선정 (Idea Discovery) | research-lit / novelty-check / idea-creator / idea-discovery | 다중 소스 문헌 검색, 모델 간 참신성 검증, 8~12개 아이디어 후보 생성 |

| 실험 단계 (Experimentation) | experiment-bridge / experiment-queue / run-experiment | 코드 검토 → GPU 배포 → 다중 시드 배치 → OOM 자동 처리 |

| 자동 검토 (Auto Review) | auto-review-loop / research-review / experiment-audit | 4단계 반복 개선, 구조화된 동료 검토, 코드 무결성 검증 |

| 논문 작성 (Paper Writing) | paper-writing / paper-claim-audit / proof-checker / citation-audit | 서술 → LaTeX → PDF, 주장 감사, 증명 검증, 인용 확인 |

| Rebuttal 대응 | rebuttal | 리뷰 의견 해석 → 답변 초안 작성 → 스트레스 테스트 |

| 메타 능력 | research-wiki / meta-optimize / deepxiv | 지속 가능한 지식 베이스, 외부 루프 최적화, 대체 문헌 소스 |

가장 실전적인 Skill은 experiment-bridge입니다. 이 기능은 "코드 검토 → GPU 원격 배포 → 실험 시작 → 결과 회수"를 하나의 파이프라인으로 연결합니다. Reviewer가 "여기서 소거 실험(Ablation Study)이 필요하다"고 제안하면, Executor가 자동으로 스크립트를 작성하고 GPU 노드에 rsync로 전송한 뒤, 학습을 시작하고 로그를 모니터링하여 결과를 수집합니다. 연구자가 직접 개입할 필요가 전혀 없죠.

또 하나 주목할 점은 citation-audit Skill입니다. DBLP와 CrossRef 데이터베이스를 직접 연동하여 LLM이 논문을 쓸 때 가장 큰 골칫거리인 '인용 환각'을 제거합니다. 모든 BibTeX 항목은 모델이 지어낸 것이 아니라 실제 데이터베이스에서 가져옵니다. 이는 학술 논문 작성의 기본 요구 사항으로, 허구의 인용은 투고 즉시 거절(Reject) 사유가 될 수 있습니다.

연구자들은 세션 간 지속되는 지식 베이스인 research-wiki도 매우 높게 평가합니다. 이 기능은 여러 프로젝트에 걸쳐 연구자의 논문 읽기 노트, 아이디어 초안, 실패한 실험 기록을 누적하여 계속 성장하는 '개인 연구 기억 장치'를 형성합니다. 3개월 뒤에 잠시 멈췄던 연구를 다시 시작할 때, 모든 논문을 다시 읽을 필요 없이 AI 보조 도구가 이미 컨텍스트를 보존하고 있습니다.

💡 사용 팁: 특정 Skill을 호출할 때마다 특히 paper-writing과 같은 긴 텍스트 생성 작업에서는 많은 Claude API 토큰이 소모됩니다. APIYI(apiyi.com)를 통해 Claude 모델을 연동하는 것을 권장합니다. 해당 플랫폼은 종량제 과금을 지원하며 상세한 토큰 사용량 모니터링을 제공하므로 논문 한 편당 비용을 미리 예측하기 편리합니다.

ARIS-Code 接入 APIYI 的完整配置方案

ARIS-Code 的执行器(Executor)是基于 Claude Code 开源版迭代而来的,它只接受 Anthropic 原生 API 协议。这意味着 GPT、Gemini 系列模型无法直接作为执行器使用。这是一个硬性约束,也是很多开发者在初次部署时最容易感到困惑的地方。

通过 APIYI 接入 Claude 模型的配置步骤非常简洁,整个过程可以归纳为 5 步:

# 第 1 步: clone 프로젝트 저장소

git clone https://github.com/wanshuiyin/Auto-claude-code-research-in-sleep

cd Auto-claude-code-research-in-sleep

# 第 2 步: 로컬 Claude Code 구성 디렉토리에 Skills 설치

mkdir -p ~/.claude/skills/

cp -r skills/* ~/.claude/skills/

# 第 3 步: APIYI 중계 주소 설정 (핵심 단계)

export ANTHROPIC_BASE_URL="https://vip.apiyi.com"

export ANTHROPIC_AUTH_TOKEN="당신의 APIYI Key"

# 第 4 步: Claude Code 실행

claude

# 第 5 步: Claude Code에서 원하는 Skill 호출

# 예시: /research-pipeline "factorized gap in discrete diffusion LMs"

这里最关键的是第 3 步设置 ANTHROPIC_BASE_URL 环境变量,它告诉 Claude Code 不要请求 Anthropic 官方端点,而是去中转网关。该网关的接口完全兼容 Anthropic 原生协议,ARIS-Code 内置的 Skill 不需要做任何代码修改,包括工具调用、流式输出、思考链 (thinking) 在内的所有特性都能透明传递。

如果你还需要部署 Reviewer 端 (Codex MCP),流程如下:

# 설치 Codex MCP (검토용)

npm install -g @openai/codex

codex setup # 여기서도 중계 주소를 입력하여 GPT 모델 사용 가능

claude mcp add codex -s user -- codex mcp-server

对于希望完全复现 ARIS-Code 论文级别效果的研究者,项目还提供了 Oracle MCP 接入 GPT-5.4 Pro 作为高级 Reviewer 的方案。这个方案在严肃论文冲刺阶段非常有用,因为 Pro 版本的批判深度和反例构造能力相比基础版有明显提升。

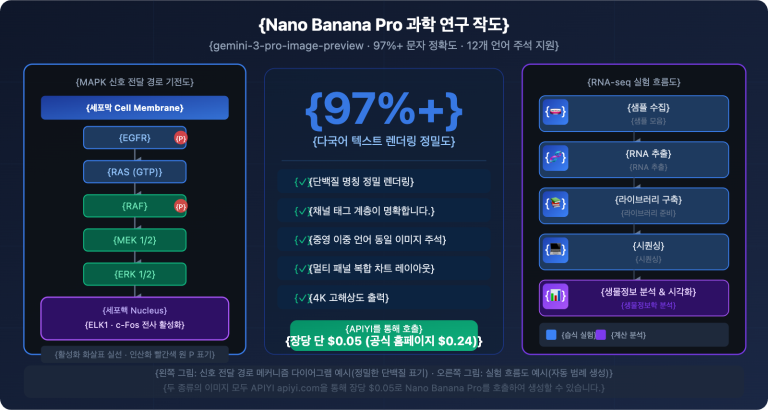

🚀 통합 접속 솔루션: APIYI (apiyi.com) 플랫폼은 Claude 시리즈(Sonnet 4.5/Opus 4), GPT 시리즈(GPT-5/o4), Gemini 시리즈(Gemini 3 Pro) 등 주요 모델을 모두 지원합니다. 하나의 Key로 ARIS-Code의 Executor와 Reviewer 양쪽을 모두 구동할 수 있어, 연구팀의 비용 관리와 호출 기록 통합에 매우 효율적입니다.

ARIS-Code Effort Levels 与 GPU 配置策略

ARIS-Code 提供了 4 档 Effort Level 用于平衡成本和质量,这是它非常工程化的一个设计。不同的研究阶段对深度的要求差异巨大,早期探索阶段没必要烧 token,投稿冲刺阶段则需要把质量推到极致。

| Effort Level | Token 배율 | 적용 시나리오 | 1회 호출 예상 |

|---|---|---|---|

| lite | 0.4× | 빠른 탐색, 아이디어 검증 | 매우 낮음 |

| balanced | 1.0× | 기본 일상 연구 프로세스 | 표준 |

| max | 2.5× | 진지한 논문 실험 단계 | 중고 |

| beast | 5-8× | 탑티어 학회 제출 모드 | 높음 |

GPU 측면에서도 ARIS-Code는 로컬 환경과 클라우드 환경을 모두 고려한 4가지 옵션을 제공합니다:

| GPU 구성 | 적용 시나리오 | 비용 특징 |

|---|---|---|

| local | 로컬 GPU 보유 연구자 | 일회성 하드웨어 비용 |

| remote | 연구실 SSH 서버 | 교내 자원 무료 |

| vast | 단기 고강도 학습 | 시간당 과금, 유연함 |

| modal | 주기적 경량 작업 | Serverless, 30달러 무료 크레딧 |

💰 비용 절감 팁: ARIS-Code를 처음 시작하신다면 lite + local 조합으로 먼저 프로세스를 익히고, 모델 호출은 APIYI 중계를 통해 토큰 사용량을 관리하는 것을 추천합니다. 프로세스가 안정화된 후 max나 beast 모드로 업그레이드하여 본격적인 연구를 진행하면, 초기 설정 실수로 인한 과도한 토큰 비용 낭비를 방지할 수 있습니다.

ARIS-Code 실전 워크플로우: 한 문장에서 논문 한 편까지

ARIS-Code의 가장 놀라운 점은 엔드투엔드 파이프라인인 /research-pipeline입니다. 이 Skill은 앞서 언급한 모든 단계를 하나의 명령어로 연결해 줍니다. 연구 방향에 대한 설명만 입력하면, 시스템이 자동으로 8~24시간 내에 초안을 출력합니다.

전형적인 호출 방식은 다음과 같습니다:

# 시나리오 1: 완전히 새로운 방향, 처음부터 시작하기

/research-pipeline "이산 확산 언어 모델(discrete diffusion LMs)의 팩터화된 갭(factorized gap)"

# 시나리오 2: 기존 논문 개선

/research-pipeline "방법 X 개선" \

--ref-paper https://arxiv.org/abs/2406.04329 \

--base-repo https://github.com/org/project

# 시나리오 3: Rebuttal(반박문)만 작성

/rebuttal "paper/ + reviews" --venue ICML --char-limit 5000

실제로 실행하면 ARIS-Code는 문헌 조사 → 아이디어 생성 → 참신성 검사 → 실험 설계 → GPU 스케줄링 → 결과 수집 → 논문 작성 → 인용 감사 → 포맷 패키징 순으로 차근차근 진행합니다. 모호한 의사결정 지점을 만나면 시스템이 일시 중지하고 사람이 체크포인트를 확인하기를 기다립니다. 기본 설정인 --AUTO_PROCEED false를 사용하면 각 라운드의 리뷰어 피드백 이후 사람이 직접 개입할 수 있습니다.

ARIS-Code는 매우 유용한 style-ref 파라미터도 제공합니다. 참고할 논문 스타일(예: 같은 학회에서 최고의 평가를 받은 논문)을 지정하면, 시스템이 구체적인 문장을 복사하지 않고도 해당 논문의 구조와 서술 리듬을 모방합니다. 이는 '논문 게재 성공률'을 높이려는 연구자들에게는 그야말로 차원이 다른 강점입니다. 탑티어 학회 리뷰어들이 논문의 내용만큼이나 까다롭게 보는 것이 바로 논문의 스타일이기 때문입니다.

또 하나 주목할 만한 엔지니어링 디테일은 ARIS-Code가 Overleaf 양방향 동기화, W&B 학습 곡선 모니터링, 페이슈(Lark) 모바일 푸시 알림 등 다양한 외부 시스템과 통합되어 있다는 점입니다. GPU에서 실험의 중요한 변곡점이 발생하면 즉시 휴대폰으로 알림을 받을 수 있어, '자면서도 연구를 진행하는' 환경을 구현할 수 있습니다.

📊 성능 데이터: 프로젝트 저자가 공개한 3건의 커뮤니티 논문 사례에 따르면, ARIS-Code로 작성된 논문은 AI 리뷰 점수에서 7~8/10점(CS 학회, AAAI 2026, IEEE TGRS)을 기록했습니다. 다만, 저자는 인간 리뷰어만이 제공할 수 있는 관점이 존재하므로 AI 심사 시스템이 인간의 검수를 완전히 대체할 수는 없다고 명시했습니다.

ARIS-Code 자주 묻는 질문(FAQ)

Q1: ARIS-Code에서 왜 GPT-5를 Executor로 사용할 수 없나요?

ARIS-Code는 Claude Code 오픈소스 버전에서 포크(fork)되어 발전했기 때문에, 실행기 레이어가 Anthropic의 네이티브 API 프로토콜에 완전히 고정되어 있습니다. 도구 호출 형식, 스트리밍 출력 형식, 사고 체인(Chain of Thought) 형식 등이 모두 Claude 모델과 깊게 결합되어 있기 때문입니다. 실행기를 바꾸려면 OpenClaw나 Codex CLI 배포판을 사용해야 하지만, 이는 이미 원본 ARIS-Code가 아닙니다. 가장 간편한 방법은 apiyi.com을 통해 Claude 모델을 직접 연결하는 것입니다.

Q2: 논문 한 편을 완성하는 데 토큰이 얼마나 드나요?

beast 모드에서 /research-pipeline을 한 번 완주하는 데 약 500만1,500만 개의 input + output 토큰이 소모되며, Claude Sonnet 가격 기준으로 수만 원에서 수십만 원 정도의 비용이 발생합니다. balanced 모드를 사용하면 200만500만 토큰으로 줄일 수 있습니다. 구체적인 비용은 실험의 복잡도와 반복 횟수에 따라 달라집니다.

Q3: 로컬 GPU가 없어도 ARIS-Code를 사용할 수 있나요?

물론입니다. ARIS-Code는 vast와 modal이라는 두 가지 클라우드 GPU 모드를 지원합니다. 특히 modal은 30달러의 무료 크레딧을 제공하므로 가벼운 실험을 돌리기엔 충분합니다. 이론 중심의 논문(/proof-writer + /formula-derivation)이라면 GPU가 아예 없어도 됩니다.

Q4: 듀얼 모델 아키텍처에서 Reviewer는 반드시 GPT-5.4를 써야 하나요?

필수는 아닙니다. 프로젝트는 GLM, MiniMax, Kimi 등 OpenAI 프로토콜과 호환되는 모든 모델로 교체할 수 있습니다. apiyi.com과 같은 통합 플랫폼을 통해 다양한 Reviewer 후보 모델을 확보하여, 본인의 연구 분야에 가장 적합한 비판적 LLM을 찾기 위한 A/B 테스트를 진행하는 것을 추천합니다. 일부 연구자들은 수학적 추론 논문에서는 Gemini 3 Pro가 Reviewer로서 의외로 좋은 성능을 보였고, 공학 최적화 논문에서는 GPT-5.4가 여전히 최우선 선택지라고 평가했습니다.

Q5: ARIS-Code는 학부생이나 초보자에게 적합한가요?

어느 정도 연구 경험이 있는 대학원생 이상에게 더 적합합니다. 출력물의 품질이 연구자의 분야에 대한 판단력에 크게 의존하기 때문입니다. 예를 들어 리뷰어가 반례를 제시했을 때, 이것이 정말 핵심적인 결함인지 아니면 사소한 지엽적 문제인지 판단할 수 있어야 합니다. 경험이 전혀 없는 초보자는 AI가 제시하는 방향에 쉽게 휘둘릴 수 있습니다.

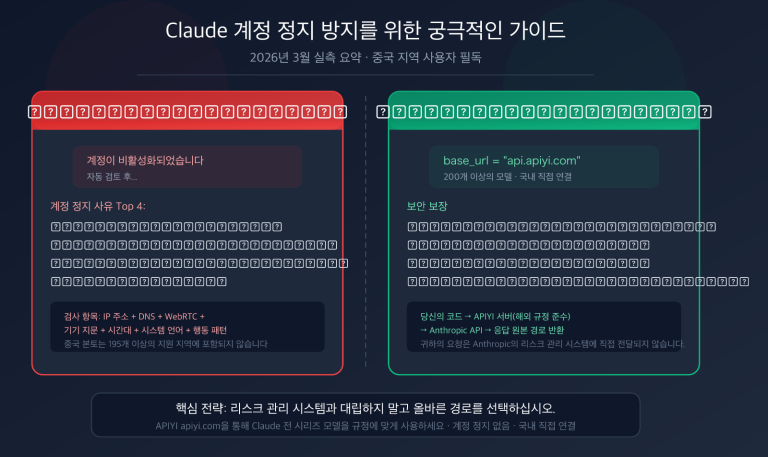

Q6: 국내에서 ARIS-Code를 실행할 때 네트워크가 불안정하면 어떻게 하나요?

Anthropic 공식 인터페이스에 직접 연결하면 국내에서는 연결 끊김이나 타임아웃이 자주 발생하여, 장시간 실행되는 research-pipeline 작업이 도중에 실패할 수 있습니다. 이를 해결하는 성숙한 방법은 ANTHROPIC_BASE_URL을 국내 IDC에 배포된 API 중계 서비스로 전환하는 것입니다. 이렇게 하면 '수면 모드'에서 8시간 동안 연속으로 작업을 돌려도 네트워크 불안정으로 중단되지 않으며, 이는 beast 모드의 연속 실험에 매우 중요합니다.

요약

ARIS-Code의 등장은 중요한 트렌드를 입증하고 있습니다. 바로 대규모 언어 모델 시대의 연구 생산성 도구가 '단일 지점 보조'에서 '전체 파이프라인 자동화'로 나아가고 있다는 점입니다. Executor-Reviewer 이중 모델 아키텍처, 42개의 워크플로우 스킬, 그리고 의존성이 없는 Markdown 설계는 매우 성숙한 방법론적 프레임워크를 구성합니다.

국내 연구자들에게 ARIS-Code 도입의 가장 큰 문턱은 기술적 학습 곡선이 아니라 Claude 모델의 안정적인 호출입니다. 저희는 apiyi.com 플랫폼을 통해 Claude 시리즈 모델을 연동하고, 동시에 Reviewer 역할을 수행할 GPT 시리즈 모델을 함께 활용할 것을 권장합니다. 이렇게 하면 하나의 플랫폼에서 ARIS-Code 워크플로우에 필요한 모든 모델 요구 사항을 충족할 수 있으며, 비용 정산과 호출 로그 관리도 훨씬 편리해집니다. 또한 국내 IDC 노드의 안정성 덕분에 '자면서 실험 돌리기'와 같은 핵심 시나리오가 네트워크 문제로 중단될 걱정도 없습니다.

만약 학회 논문 투고를 준비 중이거나, 검증하고 싶지만 수동으로 반복하기엔 시간이 부족한 연구 주제가 있다면 이번 주말에 시간을 내어 ARIS-Code를 꼭 시도해 보세요. 잠에서 깼을 때 완성된 초안을 마주할 수 있다면, 이 시간 투자는 충분히 가치 있을 것입니다.

📌 작성자: APIYI Team — AI 대규모 언어 모델 API 서비스와 개발자 생태계를 꾸준히 연구합니다. 더 많은 Claude/GPT/Gemini 멀티 모델 연동 사례는 apiyi.com 문서 센터에서 확인하실 수 있습니다.