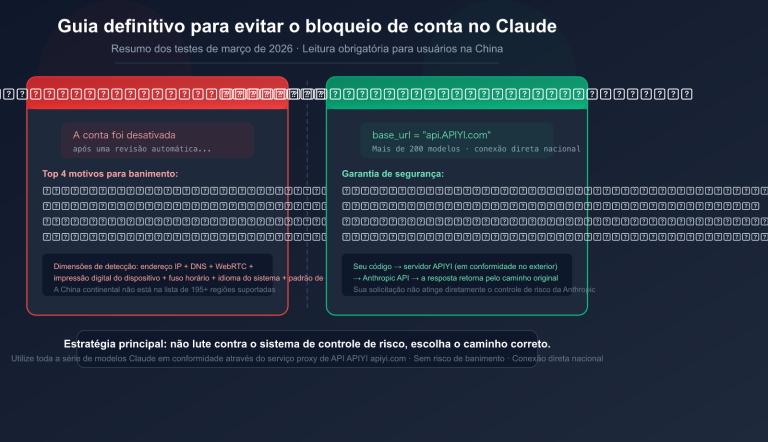

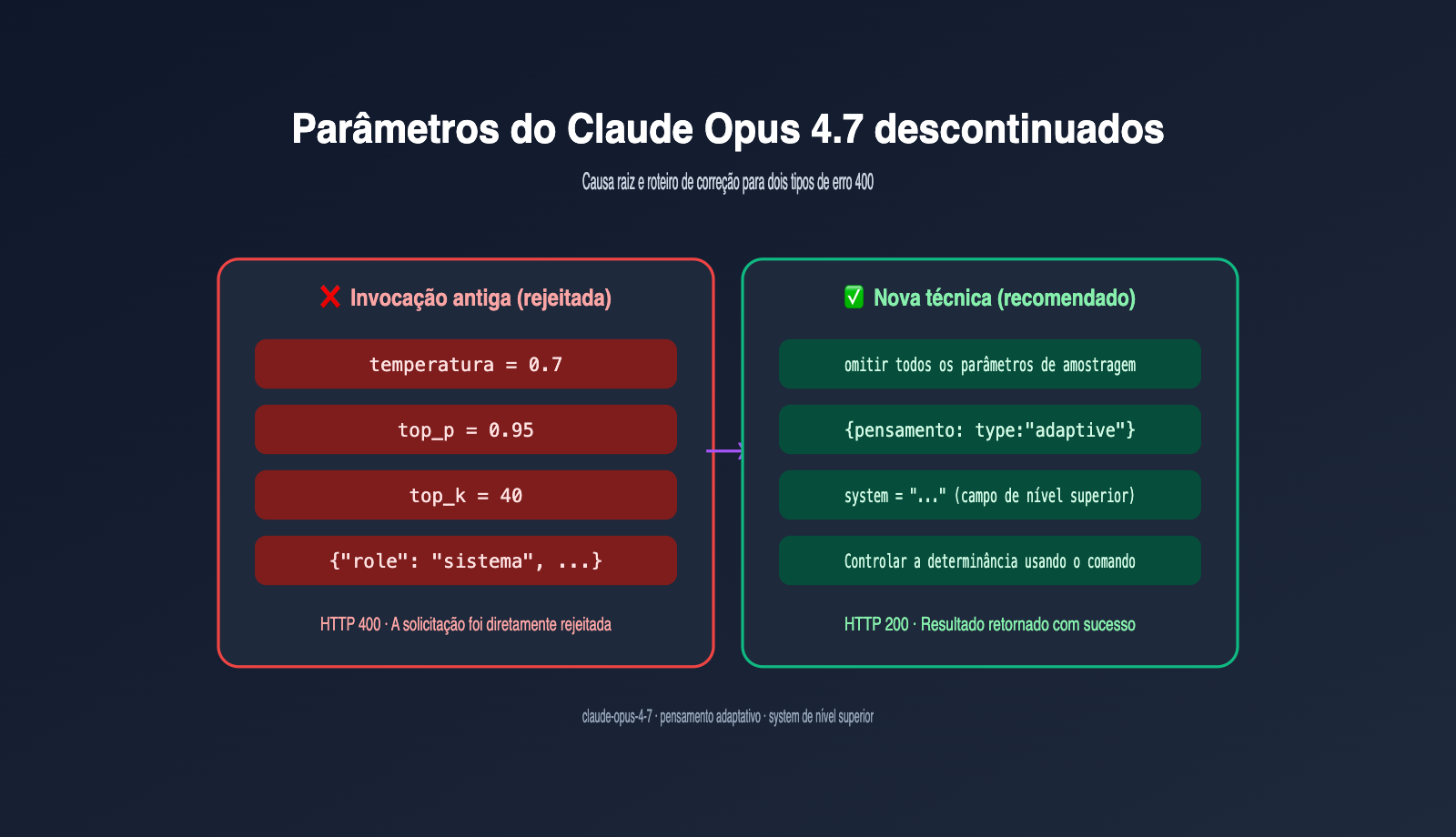

Ao atualizar para o Claude Opus 4.7, o que mais trava os desenvolvedores não é o modelo em si, mas os parâmetros da requisição. O primeiro erro frequente é temperature is deprecated for this model, e o segundo é Unexpected role "system". The Messages API accepts a top-level system parameter, not "system" as an input message role. Ambos os erros são HTTP 400 e, embora pareçam desconexos, apontam para o mesmo fato: a Anthropic realizou uma convergência de API bastante agressiva no Opus 4.7.

Muitas equipes, antes de entenderem essa mudança, costumam usar "temperatura em 0" ou "adicionar uma mensagem de sistema" como uma solução mágica para aumentar a determinismo. O Opus 4.7 bloqueou diretamente esses dois caminhos. Este guia explicará detalhadamente as causas, os erros e as soluções, acompanhado de código de migração que você pode copiar e usar. Após a leitura, você não só resolverá os erros 400 em 10 minutos, como também entenderá a lógica por trás dessa mudança de design da Anthropic, evitando novas armadilhas em futuras atualizações.

Quais parâmetros foram descontinuados no Claude Opus 4.7

Antes de entender o erro, veja uma "lista de descontinuação" completa. As mudanças que a Anthropic fez no Opus 4.7 são mais profundas do que parecem e o impacto é muito maior do que as depreciações da era 4.6.

| Parâmetro | Status | Comportamento | Alternativa |

|---|---|---|---|

temperature |

Descontinuado | Qualquer valor diferente do padrão retorna 400 | Omitir completamente, usar o comando para controlar a aleatoriedade |

top_p |

Descontinuado | O mesmo que acima | Omitir completamente |

top_k |

Descontinuado | O mesmo que acima | Omitir completamente |

thinking.budget_tokens |

Removido | Orçamento explícito retorna 400 | thinking: { type: "adaptive" } |

reasoning_effort (antigo) |

Removido | Campo antigo não funciona mais | output_config: { effort: "max" } |

role: "system" nas mensagens |

Não suportado | Sempre foi assim, mas o erro é mais rigoroso no 4.7 | Parâmetro system de nível superior |

🎯 Obrigatório antes de atualizar: Se você usa o SDK Python, qualquer código antigo que contenha

temperature=0.7,top_p=0.95oumessages=[{"role": "system", ...}]resultará em um erro 400 no Opus 4.7. Recomendamos acessar o Opus 4.7 via APIYI (apiyi.com), pois a plataforma realiza uma degradação elegante na compatibilidade de parâmetros, permitindo uma transição suave para a nova interface.

O item mais fácil de ignorar na lista é o parâmetro thinking. Na era do Opus 4.6, você podia enviar thinking: {"type": "enabled", "budget_tokens": 8000} para fazer o modelo pensar por mais tempo, mas no Opus 4.7 esse uso é rejeitado diretamente. A nova versão aceita apenas o tipo adaptive, onde o modelo decide a intensidade do raciocínio por conta própria. Além disso, o pensamento adaptativo (adaptive thinking) vem desativado por padrão, sendo necessário ativá-lo explicitamente.

Outra mudança oculta é o tokenizer. O Opus 4.7 utiliza um novo tokenizer; o número de tokens para o mesmo texto no novo modelo será de 0% a 35% maior do que no 4.6. Isso significa que o seu orçamento estimado para a versão 4.6 provavelmente sofrerá um "aumento silencioso" no 4.7, exigindo uma revisão cuidadosa da sua fatura.

Por que o Claude Opus 4.7 abandonou o parâmetro temperature

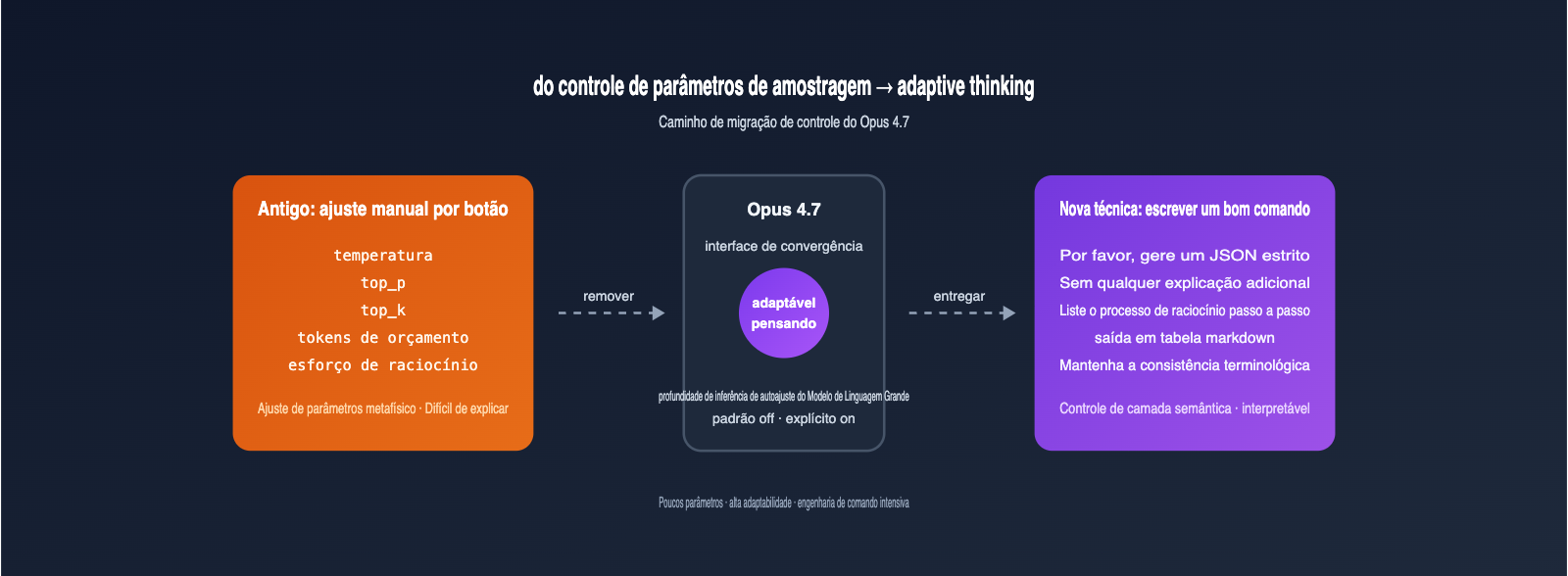

Entender a lógica por trás dessa mudança vai te poupar de muitas dores de cabeça. O motivo pelo qual a Anthropic "retirou" os parâmetros de amostragem temperature, top_p e top_k no Opus 4.7 é, essencialmente, a transição do modelo de uma "biblioteca de parâmetros ajustáveis" para uma "caixa-preta adaptativa".

Do ponto de vista da arquitetura, o Opus 4.7 transferiu o controle da intensidade de raciocínio para o módulo de adaptive thinking, que já possui internamente um sistema de gerenciamento de incertezas. Ou seja, métodos como a temperatura, que "ajustam a aleatoriedade na camada de amostragem", tornaram-se incompatíveis com a lógica de inferência interna do modelo; forçar esses parâmetros só prejudicaria o caminho de otimização da nova versão. A Anthropic foi direta na documentação: em avaliações internas, o adaptive thinking é consistentemente superior à combinação de extended thinking com temperatura manual.

Olhando por outro ângulo, esse "corte nos botões de ajuste" também é uma atualização amigável para iniciantes. Antigamente, ao ajustar LLMs, os desenvolvedores frequentemente caíam na armadilha metafísica de "será que a temperatura não está certa?", perdendo tempo sem encontrar um valor ideal ou explicar as variações nos resultados. O Opus 4.7 fecha esse caminho de otimização "duvidoso", permitindo que você foque no design de comandos e na gestão da janela de contexto, que são os fatores que realmente trazem ganhos estáveis.

Na prática de engenharia, o abandono dos três parâmetros de amostragem significa que a Anthropic não incentiva mais a prática antiga de "usar a temperatura para garantir estabilidade". A recomendação para a nova versão é usar a engenharia de comandos para especificar claramente que "você precisa de respostas determinísticas" ou "por favor, gere um JSON estrito", forçando o modelo a se restringir no nível semântico, em vez de tentar controlá-lo rigidamente na camada de amostragem. Recomendamos que as equipes que utilizam o APIYI (apiyi.com) para invocar o Opus 4.7 migrem gradualmente o código que dependia de temperature=0 para uma abordagem que exija determinismo diretamente no system prompt.

Essa abordagem contrasta com o "nível de esforço de raciocínio" do GPT-5.5. Enquanto a OpenAI "dá aos desenvolvedores interruptores mais finos", a Anthropic "retira os interruptores e os entrega ao modelo". Não há certo ou errado, mas ambas as filosofias enfraquecem claramente o papel do ajuste tradicional de hiperparâmetros. A maior lição para os desenvolvedores é: o foco do ajuste de LLMs mudará de "girar botões" para "escrever bons comandos e gerenciar o contexto".

Vale notar que essa "convergência agressiva" da Anthropic não veio do nada. Na era do Opus 4.6, a documentação já marcava o extended thinking como obsoleto, sugerindo que os desenvolvedores transitassem para o adaptive thinking. Se você já começou a escrever código seguindo essa recomendação, a atualização para o 4.7 será praticamente indolor; por outro lado, se você ainda dependia da velha estratégia de "aumentar a temperatura para criatividade e diminuir para estabilidade", essa migração será um pouco mais trabalhosa.

Solução para o erro 400 no parâmetro temperature

Agora que você sabe o motivo, a correção é direta. Abaixo, apresento um exemplo de correção mínima, que pode ser executado de forma estável no Brasil utilizando a base_url do APIYI (apiyi.com).

# pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Invocação unificada do Opus 4.7 via APIYI

)

# ❌ Código antigo: causará erro 400 (temperature is deprecated)

# response = client.messages.create(

# model="claude-opus-4-7",

# max_tokens=1024,

# temperature=0.7,

# top_p=0.95,

# messages=[{"role": "user", "content": "Hello"}]

# )

# ✅ Código novo: omita completamente os parâmetros de amostragem

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You must return strict JSON. No extra commentary.",

messages=[{"role": "user", "content": "Hello"}]

)

🎯 Dica de correção rápida: Altere a

base_urlparahttps://api.apiyi.come use a chave API fornecida pelo APIYI. No seu código antigo, basta remover as três linhas de parâmetros de amostragem para que tudo funcione. Se você tem receio de não conseguir alterar tudo de uma vez, o APIYI (apiyi.com) realiza um downgrade suave automático para parâmetros obsoletos, garantindo um período de transição para o seu projeto.

A tabela abaixo organiza três abordagens típicas de migração para te ajudar a escolher a melhor estratégia.

| Uso antigo | Nova abordagem | Benefício |

|---|---|---|

temperature=0 para determinismo |

Escreva no system prompt: "retorne JSON estrito, sem texto extra" | Respostas mais estáveis, economia de tokens |

temperature=1 para criatividade |

Não defina parâmetros de amostragem, deixe o modelo fluir | Comportamento nativo do 4.7 |

top_p / top_k para limitar amostragem |

Use com effort: "max" do adaptive thinking |

Substitua o corte de amostragem por profundidade de raciocínio |

Se você utiliza o protocolo compatível com OpenAI (muitos frameworks de terceiros usam esse padrão), verifique se o SDK não está inserindo temperature=1.0 por baixo dos panos. Já existem várias issues na comunidade sobre frameworks que codificam valores padrão, fazendo com que o Opus 4.7 rejeite a solicitação. Nesses casos, atualize o framework ou utilize a camada de compatibilidade do APIYI (apiyi.com).

A essência do erro de função "system" e como corrigi-lo

O segundo erro 400 mais frequente não tem relação com a temperature; é um problema antigo que foi "amplificado" nos novos modelos. A API Messages da Anthropic nunca permitiu definir o system como um papel (role) dentro das mensagens, mas muitos códigos migrados do Chat Completions da OpenAI fazem isso automaticamente, disparando o erro Unexpected role "system".

A chave para entender isso é: a Anthropic trata o system como uma "configuração de sessão" e não como "conteúdo de diálogo". Ele deve aparecer no nível superior do corpo da requisição, e não dentro do array messages. A tabela abaixo compara as diferenças entre OpenAI e Anthropic.

| Item | OpenAI Chat Completions | Anthropic Messages |

|---|---|---|

Local do system |

Primeiro item do array messages |

Campo system no nível superior |

Quantidade de system |

Múltiplos permitidos | Apenas uma string |

| Erro no 4.7 | Nenhum | Unexpected role "system" 400 |

| Dificuldade de migração | — | Baixa, basta mover a posição |

🎯 Dica de migração: Se o seu projeto possui uma lógica de "execução dupla OpenAI / Claude", recomendo encapsular um adaptador: ao chamar a OpenAI, coloque o

systemdentro dasmessages; ao chamar o Claude, mova-o para osystemde nível superior. Ao acessar ambos os modelos via APIYI (apiyi.com), você pode gerenciar tudo com o mesmo sistema de chaves, evitando configurações repetidas.

O método de correção é direto. Abaixo, veja a comparação entre a forma incorreta e a correta, basta seguir este padrão.

# ❌ Forma incorreta: dispara erro 400 Unexpected role "system"

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a quicksort in Python."}

]

)

# ✅ Forma correta: system como parâmetro de nível superior

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You are a coding assistant.",

messages=[

{"role": "user", "content": "Write a quicksort in Python."}

]

)

Vale ressaltar que, se você realmente precisar enviar "múltiplas instruções de sistema" para o Claude, a forma correta é combiná-las em uma única string, separadas por quebras de linha ou numeração. O SDK da Anthropic também suporta o campo system como um array de blocos de conteúdo, mas isso é um uso avançado; para iniciantes, basta entender como uma "string única". Isso traz um benefício oculto: ao consolidar em uma única string, é mais fácil acionar o cache de comandos da APIYI (apiyi.com), reduzindo ainda mais os custos em tarefas de longa duração.

Modelo de código completo para migração ao Claude Opus 4.7

Combinando as correções dos dois tipos de erro, o código abaixo é um "ponto de partida pronto para uso" para o Opus 4.7, incluindo adaptive thinking, parâmetros de nível superior para system e uma estrutura amigável para cobrança via cache.

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # Chamando o Opus 4.7 via APIYI

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2048,

system="You are an expert Python engineer. Always return strict JSON.",

thinking={

"type": "adaptive",

"display": "summarized"

},

messages=[

{"role": "user", "content": "Refactor my quicksort to be O(n log n) average."}

]

)

print(response.content[0].text)

🎯 Dica para ambiente de produção: Ao chamar o Opus 4.7 via APIYI (apiyi.com), coloque o system prompt estável e as descrições de ferramentas no início para acionar o cache com custo de 0.1x, reduzindo o custo de requisições repetidas para 10% do valor original. Isso é especialmente útil para agentes de longa duração e tarefas de geração de documentos.

Ao realizar a migração, há alguns detalhes a considerar. Primeiro, o campo thinking não é obrigatório, mas se sua tarefa for sensível à profundidade de raciocínio, recomendo ativar explicitamente o adaptive thinking, caso contrário, o modelo manterá o modo de raciocínio leve padrão. Segundo, como o novo tokenizer faz com que o mesmo texto conte de 0% a 35% mais tokens, o orçamento de max_tokens deve ser ajustado, caso contrário, você pode sofrer cortes em cenários de saída longa. Terceiro, parâmetros periféricos da versão antiga, como thinking_budget, também devem ser removidos; campos residuais não geram erro, mas são ignorados, o que pode levar você a acreditar erroneamente que ainda estão ativos. Quarto, se sua aplicação chama tanto o 4.6 quanto o 4.7, é melhor registrar a fatura por nome de modelo para evitar distorções na atribuição de custos devido à confusão entre os tokenizers.

Se você estiver mantendo uma base de código que precisa ser compatível com o Opus 4.6 e o Opus 4.7, a abordagem mais segura é criar uma lista de permissões de parâmetros por nome de modelo. Ignore os "parâmetros de amostragem + campos de raciocínio antigos" ao chamar o 4.7 e mantenha-os ao chamar o 4.6; assim, você não precisa manter dois conjuntos de funções de chamada para modelos diferentes.

A tabela de consulta rápida de erros abaixo resume os tipos de erro 400 mais comuns durante a atualização para o Opus 4.7, facilitando a localização do ponto de correção pelo texto do erro.

| Palavra-chave do erro | Significado do erro | Método de correção |

|---|---|---|

temperature is deprecated |

Campo temperature descontinuado |

Remova completamente o temperature do corpo da requisição |

top_p is deprecated |

Campo top_p descontinuado |

Remova o top_p, deixe o modelo se adaptar |

top_k is deprecated |

Campo top_k descontinuado |

Remova o top_k, deixe o modelo se adaptar |

| Unexpected role "system" | system definido no array messages |

Mova para o campo system no nível superior |

Invalid budget_tokens |

Uso de orçamento de raciocínio antigo | Mude para adaptive thinking sem passar budget |

Unknown parameter reasoning_effort |

Campo de intensidade de raciocínio antigo | Mude para output_config: {effort: "max"} |

Perguntas Frequentes sobre a Depreciação de Parâmetros no Claude Opus 4.7

P1: Por que o Opus 4.7 descontinuou tantos parâmetros de uma só vez?

O motivo principal é que o adaptive thinking assumiu as responsabilidades de "controle de aleatoriedade e profundidade de raciocínio", que antes eram gerenciadas individualmente por temperature, top_p, top_k e thinking budget. Avaliações internas da Anthropic mostram que o adaptive thinking supera consistentemente o ajuste manual, por isso optaram por centralizar o controle.

P2: Posso definir temperature como 1.0 para "contornar" o erro?

Não. O Opus 4.7 verifica se os parâmetros de amostragem foram enviados, independentemente do valor. Se a chave aparecer no corpo da requisição, ela será identificada como uma configuração não padrão e retornará um erro 400. A forma correta é omitir completamente esses campos da requisição, permitindo que o SDK utilize o comportamento padrão de amostragem do modelo.

P3: Usar o SDK da OpenAI via APIYI para chamar o Opus 4.7 causará erro de temperature?

Depende da versão do SDK e do framework utilizado. O SDK da OpenAI inclui temperature=1.0 por padrão; se for encaminhado diretamente para o backend da Anthropic, o Opus 4.7 ainda o rejeitará. Ao utilizar o APIYI (apiyi.com), a plataforma já trata essa compatibilidade de forma elegante, filtrando automaticamente os campos obsoletos.

P4: O erro de system ocorre apenas no 4.7? Modelos anteriores do Claude não apresentavam isso?

Não é exclusivo. A API de Mensagens da Anthropic nunca permitiu incluir system dentro do array messages, mas a validação do Opus 4.7 tornou-se mais rigorosa; alguns modelos antigos podiam ser "mais flexíveis". A melhor prática é sempre colocar o system no nível superior da requisição. Após migrar para o topo, todos os modelos Claude funcionarão corretamente.

P5: Migrando o código da OpenAI, quantas linhas preciso alterar para rodar o Opus 4.7?

Geralmente três pontos: 1) Mude o model para claude-opus-4-7; 2) Mova o item system de dentro de messages para o campo system no nível superior; 3) Remova parâmetros de amostragem como temperature e top_p. Ao apontar a base_url para https://api.apiyi.com, o projeto geralmente estará funcionando em menos de 10 minutos. Se o seu projeto tiver dezenas de chamadas, recomendo encapsular uma função utilitária call_claude() para centralizar essas alterações.

P6: O adaptive thinking vem ativado por padrão? Preciso ativá-lo explicitamente?

Ele vem desativado por padrão. Se sua tarefa exige profundidade de raciocínio (raciocínio matemático, refatoração de código, planejamento complexo), recomendo passar explicitamente thinking: {type: "adaptive"}. Você pode combinar com output_config: {effort: "max"} para obter a máxima capacidade de raciocínio, ao custo de um maior consumo de tokens — é preciso equilibrar qualidade e custo.

P7: A chamada do Opus 4.7 é estável no Brasil?

A conexão direta com a interface da Anthropic pode ser afetada pela rede, especialmente em tarefas longas. Chamar o Opus 4.7 via APIYI (apiyi.com) resolve os problemas de estabilidade de acesso local, com a plataforma operando de forma estável e oferecendo redução de custos com o faturamento de cache a 0.1x.

P8: O novo tokenizer aumentou os custos? Como lidar com isso?

O novo tokenizer apresenta uma taxa de expansão entre 0% e 35% em diferentes textos, com uma média de 10% a 15%. A estratégia mais prática é colocar o system prompt e as descrições de ferramentas (que podem ser armazenadas em cache) no início, ativando o faturamento de cache a 0.1x, o que reduz o custo unitário em vez de aumentá-lo.

Pontos Principais sobre a Depreciação de Parâmetros no Claude Opus 4.7

- O Opus 4.7 descontinuou completamente os três parâmetros de amostragem:

temperature,top_petop_k. Qualquer valor enviado causará um erro 400. - O Extended thinking foi removido; apenas o adaptive thinking é suportado e deve ser ativado explicitamente.

Unexpected role "system"é uma regra histórica da API de Mensagens; osystemdeve estar no nível superior, não como um papel de mensagem.- O novo tokenizer faz com que o mesmo texto tenha de 0% a 35% mais tokens do que no 4.6; o orçamento e o

max_tokensdevem ser recalculados. - A correção mínima requer apenas três passos: remover parâmetros de amostragem, mover o

systempara o nível superior e alterar o nome do modelo paraclaude-opus-4-7. - Chamar o Opus 4.7 via APIYI (apiyi.com) permite desfrutar de compatibilidade elegante, faturamento de cache a 0.1x e acesso estável.

- O uso de adaptive thinking com

output_config: {effort: "max"}é a forma padrão de obter o máximo poder de raciocínio no Opus 4.7.

Resumo

A descontinuação de parâmetros no Claude Opus 4.7 parece uma "mudança disruptiva", mas, na prática, é um passo fundamental da Anthropic para evoluir o modelo de uma "ferramenta de detalhes expostos" para uma "caixa-preta adaptativa". Para os desenvolvedores, isso significa que a estabilidade, antes alcançada através de "interruptores" como temperature e thinking budget, deve ser gradualmente migrada para uma combinação de engenharia de comando e pensamento adaptativo. A curto prazo, isso traz custos de migração, mas, a longo prazo, resultará em códigos mais concisos e um desempenho do modelo mais estável. Essa trajetória de evolução não é isolada; os principais Modelos de Linguagem Grande estão caminhando na direção de "menos parâmetros, mais adaptabilidade", e quanto mais cedo você se adaptar, mais cedo colherá os benefícios.

Se você está atualizando para o Opus 4.7 ou avaliando o impacto dessa mudança na sua produção, recomendamos que comece testando a nova versão através do APIYI (apiyi.com). A plataforma já oferece suporte estável ao Opus 4.7 e implementou uma degradação compatível para os parâmetros descontinuados. Combinado com o faturamento de cache a 0,1x, esta é a rota de migração com o menor custo de entrada disponível atualmente.

Desejamos que você evite problemas e termine seu trabalho mais cedo.

— Equipe técnica da APIYI. Para mais tutoriais práticos sobre modelos de IA, acesse APIYI em apiyi.com.