Muitos desenvolvedores, ao integrar a interface de edição de imagens gpt-image-2 pela primeira vez, costumam enviar a imagem original via POST — afinal, a documentação oficial menciona um limite de 50 MB, então por que não aproveitar, certo? No entanto, após realizar dezenas de testes, você perceberá que, comparado a uma imagem comprimida de 1,5 MB, o envio de uma imagem original de 20 MB pode ser 3 vezes mais lento, além de aumentar drasticamente a taxa de falhas (especialmente o erro 413 Request Entity Too Large).

Este artigo reúne experiências práticas para apresentar 5 melhores práticas de upload de imagens para o gpt-image-2, focando nas duas dúvidas que mais geram erros entre desenvolvedores: qual o tamanho ideal para compressão e o que realmente define a resolução de saída.

🎯 Conclusão principal: Recomenda-se manter o upload de cada imagem no gpt-image-2 abaixo de 1,5 MB; a resolução de saída é definida pelo parâmetro

size, e escrever "8K" ou "4K" no comando não tem efeito algum. Todo o código deste artigo pode ser executado diretamente via APIYI (apiyi.com), sem a necessidade de uma conexão internacional.

Especificações de upload do gpt-image-2: Limites oficiais vs. Limites práticos

A documentação oficial da OpenAI para o gpt-image-2 é bastante flexível quanto às especificações de entrada, o que pode dar uma falsa sensação de segurança. Mas "funcionar" e "funcionar bem" são coisas diferentes; na prática, é essencial estabelecer limites mais rigorosos.

A tabela abaixo compara os limites oficiais com os valores recomendados, baseados na experiência de desenvolvedores que utilizam o serviço:

| Dimensão | Limite Oficial | Recomendação Prática | Motivo da Diferença |

|---|---|---|---|

| Tamanho por imagem | 50 MB | ≤ 1,5 MB | Imagens grandes aumentam o tempo de transmissão e decodificação |

| Imagens por vez | 16 | 1-4 | O excesso de imagens reduz a taxa de sucesso |

| Formatos | PNG / WEBP / JPG | WEBP / JPG (comprimidos) | PNG costuma ser pesado; WEBP é o melhor custo-benefício |

| Pixels (lado) | Máx. 3840 | Não exceder 2048 | O modelo fará subamostragem para extração de características |

| Proporção | 1:3 ~ 3:1 | Próxima à saída | Proporções incompatíveis geram preenchimento ou cortes |

Por que definir o limite em 1,5 MB? Esse é o "ponto ideal" que equilibra tempo de transmissão, tempo de decodificação e estabilidade de rede. Abaixo de 1,5 MB, a maioria das conexões domésticas envia o arquivo em 1 a 2 segundos; acima de 5 MB, o tempo total de processamento cresce de forma não linear, tornando a resposta da API visivelmente mais lenta.

💡 Dica prática: Recomendamos tratar 1,5 MB como uma restrição rígida no seu código, utilizando bibliotecas como a PIL para realizar a compressão automática antes do envio. Ao utilizar o gpt-image-2 via APIYI (apiyi.com), a otimização de transmissão para arquivos menores é ainda mais evidente nos nós de rede locais.

Por que recomendamos comprimir imagens individuais para menos de 1,5 MB

Muitos desenvolvedores perguntam: se o limite oficial é de 50 MB, por que insistir em 1,5 MB? Existem quatro razões técnicas por trás disso, e qualquer uma delas é motivo suficiente para levar o tamanho das imagens a sério.

A primeira razão é a latência de transmissão, o fator mais subestimado. Uma imagem de 25 MB leva cerca de 4 segundos apenas para ser enviada em uma conexão de 50 Mbps de upload, enquanto uma versão comprimida de 1,5 MB leva apenas 0,24 segundos. Esse tempo é somado diretamente ao tempo total de resposta da API.

A segunda razão é o risco de erro 413. Erros "413 Request Entity Too Large" com o gpt-image-1 / gpt-image-2 são comuns. Mesmo que você não atinja o limite de 50 MB, a imagem pode ser bloqueada por algum gateway intermediário (CDN, proxy reverso, balanceador de carga). Manter a imagem abaixo de 1,5 MB elimina praticamente qualquer risco desse tipo, aumentando a estabilidade das chamadas.

A terceira razão é o tempo de decodificação no servidor. Após receber a imagem, o servidor da OpenAI precisa decodificá-la, extrair características e realizar a vetorização (embedding). O tempo gasto nessas etapas é diretamente proporcional ao número total de pixels. Mesmo que a largura de banda não seja um gargalo, imagens muito grandes atrasam a geração.

A quarta razão é o custo de novas tentativas (retry). Se uma chamada com uma imagem grande falha, você precisa reenviar todos os 25 MB; com uma imagem de 1,5 MB, o reenvio é quase instantâneo, tornando a confiabilidade ponta a ponta muito superior.

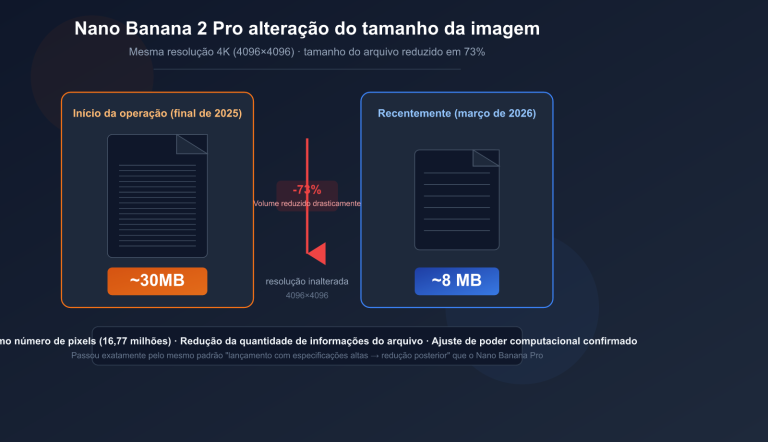

Ao quantificar esses motivos em testes reais, a comparação fica clara: ao enviar a mesma imagem original com 25 MB / 5 MB / 1,5 MB / 500 KB para a interface de edição do gpt-image-2, repetindo 50 vezes com o mesmo comando e parâmetros de tamanho, notamos um ponto de inflexão claro no tempo total e na taxa de sucesso. 1,5 MB é o ponto ideal dessa curva; comprimir mais do que isso traz ganhos marginais, sacrificando qualidade sem necessidade.

🔧 Dica de otimização: Ao chamar o

gpt-image-2em produção, recomendo fortemente que a "compressão antes do upload" seja um passo padrão no seu código, e não algo opcional. Usando o serviço proxy de API da APIYI para tarefas em lote, combinada com a estratégia de compressão de 1,5 MB, a taxa de falha por lote pode cair de 5-8% para menos de 1%, uma diferença significativa quando você processa dezenas de milhares de chamadas por mês.

Compressão não significa perda de qualidade: um mito superestimado

Este é um dos mitos mais difundidos entre desenvolvedores: "compressão = perda de qualidade = impacto no resultado da IA". Esse julgamento talvez fosse válido na era JPEG de 2010, mas em 2026, com o WebP e JPEGs de alta qualidade, ele está completamente ultrapassado.

A tabela abaixo compara mitos comuns com os fatos para ajudar você a desenvolver uma intuição correta sobre o processamento de imagens:

| Mito Comum | Fato |

|---|---|

| Compressão sempre perde qualidade | WebP com qualidade 85+ é visualmente indistinguível, o mesmo vale para JPEG 90+ |

| Quanto maior a imagem, melhor a IA vê | O gpt-image-2 faz subamostragem de imagens grandes; o que excede a resolução de trabalho é desperdício |

| PNG é sem perdas, logo é o melhor | PNG costuma ser 3-5 vezes maior que WebP, mas o resultado após a decodificação pelo modelo é quase idêntico |

| Ferramentas de compressão alteram cores | Ferramentas modernas (Squoosh / TinyPNG / Sharp) preservam perfis de cor ICC |

| Se o comando for bom, não precisa comprimir | Comando e tamanho da imagem são dimensões independentes; a compressão afeta apenas a transmissão |

Quanto à escolha de ferramentas, você pode selecionar uma conforme o seu cenário:

| Ferramenta | Cenário de Uso | Vantagem |

|---|---|---|

| PIL / Pillow | Processamento em lote no backend Python | Fácil integração, permite ajustar a qualidade em loop até atingir a meta |

| Sharp (Node.js) | Backend Node.js | Melhor desempenho, processa dezenas de imagens por segundo em um único núcleo |

| Squoosh | Compressão de imagem única no frontend | WASM no navegador, comprime sem precisar de servidor |

| TinyPNG | Processamento manual em lote | Redução inteligente de paleta, visualmente sem perdas |

| Ferramenta de captura | macOS / Windows | Basta selecionar JPEG 80% para atender aos requisitos |

Entender a "compressão" como um "passo de pré-processamento necessário" em vez de um "compromisso que prejudica o resultado" é a base psicológica para utilizar bem as APIs de imagem.

Um ponto importante: o gpt-image-2 realiza internamente uma subamostragem de imagens muito grandes; sua "resolução interna" de trabalho é muito menor do que o limite máximo de upload. Isso significa que, ao enviar uma imagem original de 4000×3000 pixels, o que o modelo realmente processa pode ser apenas uma versão de 1024×1024. Os pixels extras que você enviou foram descartados pelo modelo desde o início, sendo um desperdício total de largura de banda.

Ao compreender isso, a ideia de que "o efeito antes e depois da compressão é quase idêntico" deixa de ser uma intuição e passa a ser uma conclusão com base técnica clara. Comprimir a imagem para a faixa de 1024-2048 pixels atinge exatamente a resolução de trabalho do modelo, sem desperdícios e sem perdas.

Resolução de saída do gpt-image-2: o parâmetro size é o único interruptor

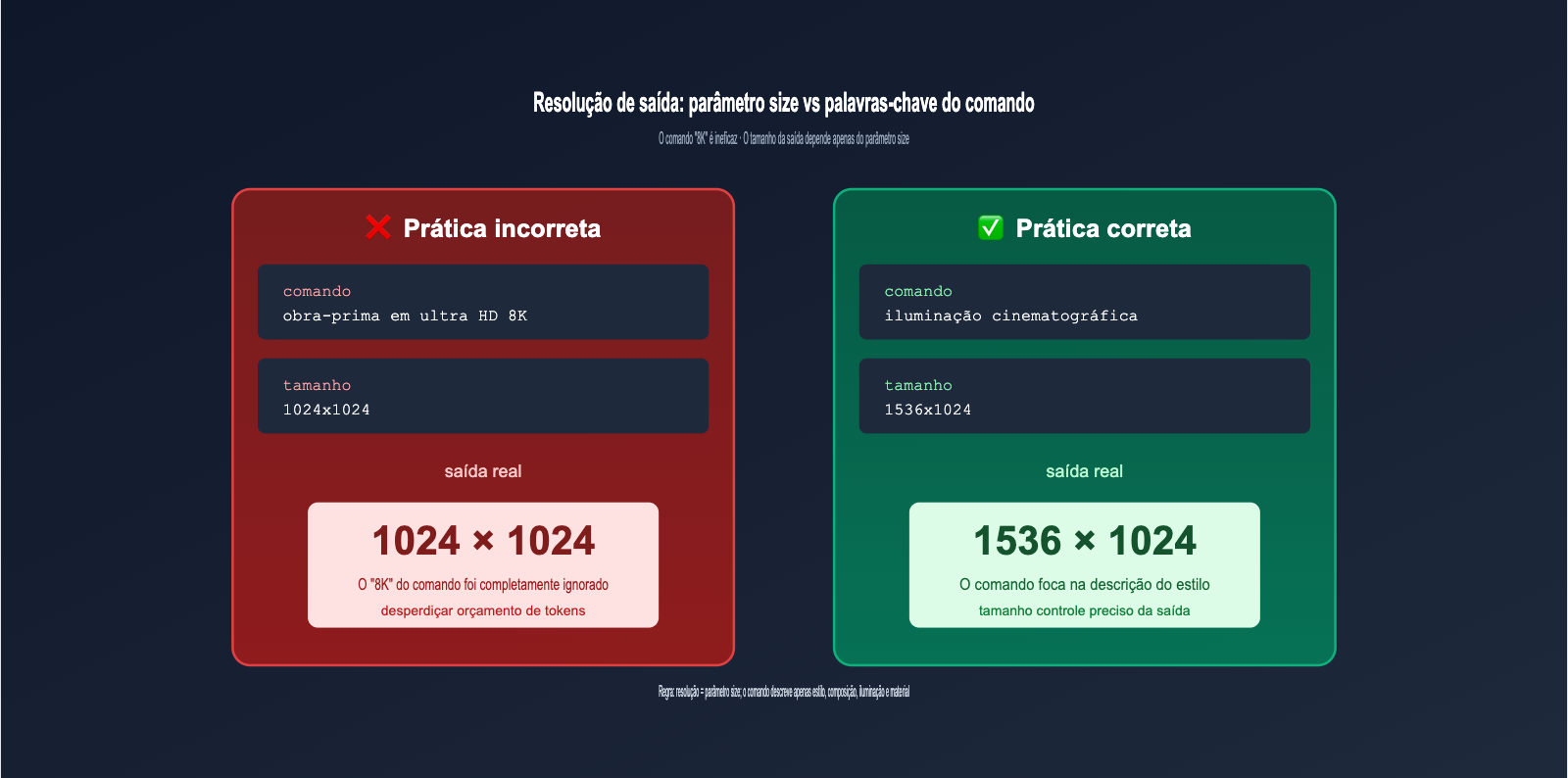

Se "compressão sem perda de qualidade" é um equívoco comum no envio de arquivos, acreditar que "escrever 8K no comando gera uma imagem 8K" é o maior erro na ponta da saída. Nesta seção, vamos esclarecer de uma vez por todas como a resolução de saída do gpt-image-2 é realmente definida.

O único parâmetro que afeta a resolução de saída é o size, nada mais. Esta é uma regra crucial, porém amplamente mal compreendida. Preparei um experimento comparativo para te ajudar a entender melhor:

| Configuração da invocação da API | Resolução de saída real |

|---|---|

size="1024x1024" + comando sem termos 4K/8K |

1024×1024 |

size="1024x1024" + comando com "8K resolution" |

Ainda 1024×1024 |

size="1024x1024" + comando com "ultra HD 4K" |

Ainda 1024×1024 |

size="1536x1024" + comando com "low resolution" |

1536×1024 (size tem prioridade) |

size="3840x2160" + qualquer comando |

3840×2160 (experimental) |

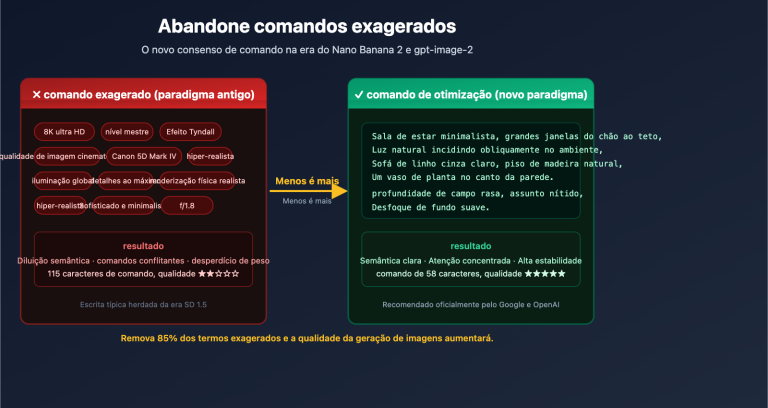

A conclusão é clara: encher o comando com palavras-chave como "8K", "4K", "ultra HD" ou "HQ" não fará sua imagem sair maior ou mais nítida; pelo contrário, apenas desperdiça tokens e ocupa o orçamento do seu comando.

Então, quais valores o parâmetro size suporta? O gpt-image-2 é muito mais flexível que a geração anterior, suportando tanto predefinições quanto valores personalizados:

| Método de configuração | Faixa de valores | Observação |

|---|---|---|

| Predefinição padrão | 1024×1024 / 1536×1024 / 1024×1536 | Mais estável, recomendado para uso diário |

| Personalizado (comum) | Múltiplos de 16 para largura e altura | Ex: 1280×720, 1600×900 |

| Personalizado (imagem grande) | Máximo de 3840px em um dos lados | Acima de 2560×1440 é experimental |

| Restrição de proporção | Entre 1:3 e 3:1 | Proporções muito extremas não são suportadas |

| Restrição de pixels totais | 655.360 ~ 8.294.400 | Possui limites superior e inferior |

Reserve os "termos descritivos de resolução" para conteúdos mais valiosos no seu comando, como estilo ("estilo pintura a óleo"), enquadramento ("tomada em ângulo baixo"), iluminação ("iluminação de hora dourada") ou textura ("superfície de cerâmica fosca"). Estes são os elementos que realmente impactam o resultado final.

Um detalhe contraintuitivo, mas muito importante: escolher um size maior não garante necessariamente uma imagem mais detalhada. Ao selecionar resoluções experimentais altas, como 3840×2160, o modelo gera a imagem internamente em uma resolução menor e aplica uma amostragem de super-resolução. A densidade de detalhes não aumenta linearmente com o número de pixels e, na verdade, pode haver uma queda na consistência devido ao tempo de geração prolongado. Para o fluxo de trabalho diário, os tamanhos recomendados são 1024×1024 ou 1536×1024, que oferecem velocidade, detalhes suficientes e um custo de API mais amigável.

📌 Dica de limpeza de comando: Antes de chamar o gpt-image-2, remova todos os termos inúteis como "8K", "4K", "ultra HD" e "high resolution" do seu comando para abrir espaço para descrições realmente úteis. Recomendamos usar a plataforma APIYI para comparar o efeito do mesmo conjunto de comandos com diferentes parâmetros de

size, ajudando você a criar uma intuição sobre a relação entre resolução e densidade de imagem.

Prática com gpt-image-2: código completo em Python para compressão e upload

Teoria explicada, vamos ao código funcional. O trecho em Python abaixo implementa o fluxo completo de "compressão automática para menos de 1.5MB → invocação da interface de edição do gpt-image-2 → salvamento da saída". Você pode copiar e colar em seu projeto.

import io

import base64

from PIL import Image

from openai import OpenAI

# Invocação via serviço proxy de API da APIYI, sem necessidade de rede internacional

client = OpenAI(

base_url="https://vip.apiyi.com/v1",

api_key="Sua chave API da APIYI"

)

def compress_image(input_path: str, target_kb: int = 1500) -> bytes:

"""Comprime automaticamente a imagem para dentro do limite de KB, priorizando o formato WebP"""

img = Image.open(input_path).convert("RGB")

# Limita a borda máxima a 2048, redimensionando proporcionalmente se necessário

if max(img.size) > 2048:

img.thumbnail((2048, 2048), Image.LANCZOS)

# Começa com qualidade 90, reduzindo de 5 em 5 até atingir o alvo

quality = 90

while quality >= 50:

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=quality)

if len(buf.getvalue()) <= target_kb * 1024:

return buf.getvalue()

quality -= 5

# Fallback: qualidade mínima

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=50)

return buf.getvalue()

# Chama a interface de edição do gpt-image-2

image_bytes = compress_image("./input.png", target_kb=1500)

result = client.images.edit(

model="gpt-image-2",

image=("input.webp", image_bytes, "image/webp"),

prompt="Mude esta foto para o estilo cyberpunk, luzes de neon, cena de rua em noite chuvosa",

size="1536x1024", # A resolução de saída é definida aqui

output_format="webp", # Formato de saída

output_compression=85 # Nível de compressão de saída 0-100

)

# Salva a saída

output_b64 = result.data[0].b64_json

with open("./output.webp", "wb") as f:

f.write(base64.b64decode(output_b64))

Este código possui alguns pontos cruciais. Primeiro, a função compress_image adota uma estratégia de "redução cíclica de qualidade", começando em 90 e diminuindo de 5 em 5 até que o tamanho do arquivo esteja dentro do limite, garantindo a melhor qualidade possível.

Segundo, o parâmetro output_compression=85 na saída é aplicado apenas aos formatos WebP/JPEG, controlando o nível de compressão da imagem retornada (o padrão é 100, sem compressão). Se você precisar exibir a imagem gerada diretamente em uma página web, definir entre 80-90 oferece um bom equilíbrio entre qualidade e velocidade de carregamento.

Terceiro, a linha size="1536x1024" define a resolução de saída; independentemente do que estiver escrito no comando, a imagem de saída terá 1536×1024.

🚀 Dica de integração: O gpt-image-2 é compatível com o SDK nativo da OpenAI. O código acima pode ser executado na plataforma APIYI apenas alterando a

base_urle aapi_key. A plataforma possui otimizações de rede específicas para interfaces de imagem, reduzindo drasticamente a ocorrência de timeouts e erros 413.

FAQ sobre upload de imagens no gpt-image-2

Q1: É melhor fazer upload em PNG ou WebP?

O WebP tem um tamanho de arquivo de 1/3 a 1/5 do PNG com a mesma qualidade visual. Como o gpt-image-2 decodifica ambos com resultados praticamente idênticos, priorize o uso de WebP. A menos que sua imagem tenha um canal de transparência (alfa) essencial (como no recorte de um logotipo), não há motivo para usar PNG.

Q2: Quantas imagens de referência posso enviar de uma só vez?

O limite oficial é de 16 imagens, mas, na prática, a taxa de sucesso cai significativamente após 4 imagens, e a atenção do modelo sobre as referências acaba sendo diluída. Recomendamos usar 1 imagem de referência principal + 1 ou 2 imagens de referência de estilo; colocar muitas imagens pode acabar deixando o estilo da saída confuso.

Q3: Se eu escrever "8K" no meu comando, não preciso comprimir a imagem?

O termo "8K" no comando é uma palavra-chave ineficaz. Ele não faz com que a saída seja 8K (isso é determinado pelo parâmetro size), nem faz com que o gpt-image-2 ignore o processamento de compressão. Sugerimos que você compare o resultado real antes e depois da compressão usando o console do apiyi.com; você verá que, visualmente, é quase impossível notar a diferença.

Q4: Qual é a resolução máxima de saída suportada pelo modelo?

O parâmetro size suporta até 3840×2160, mas tudo o que excede 2560×1440 é classificado oficialmente como "experimental", o que pode reduzir a estabilidade e a consistência. Para ambientes de produção diários, recomendamos limitar-se a 1536×1024, que é rápido e estável.

Q5: Posso ajustar áreas detalhadas da imagem após o upload?

Sim. Através do parâmetro mask, você pode especificar uma imagem de máscara com as mesmas dimensões; o modelo gerará novo conteúdo apenas nas áreas transparentes da máscara, mantendo o restante inalterado. Esta é uma capacidade poderosa da interface de edição do gpt-image-2, ideal para repintura local (inpainting) e troca de elementos.

Q6: O que fazer se a taxa de falha ao chamar o gpt-image-2 no Brasil for alta?

A conexão direta com a OpenAI pode sofrer timeouts ou falhas no handshake SSL, especialmente em interfaces de imagem, que possuem payloads maiores e são mais propensas a interrupções do que as de texto. Ao configurar o base_url para um serviço proxy de API como o do apiyi.com, combinado com uma estratégia de compressão de 1.5MB, a taxa de sucesso geral pode ser estabilizada acima de 99%.

Q7: A qualidade realmente não muda após a compressão? Existe risco de comprimir demais?

Com WebP acima de 85 ou JPEG acima de 90, não há diferença visual em imagens naturais (pessoas, paisagens, produtos). No entanto, para cenários com textos densos (cartazes, capturas de tela de PPT) ou linhas nítidas (diagramas técnicos, pixel art), sugerimos elevar a qualidade para 92-95 ou manter o PNG, caso contrário, podem surgir leves artefatos de compressão nas bordas dos textos. A função de compressão em Python fornecida no artigo já define o ponto de partida em 90, o que garante estabilidade na maioria dos casos.

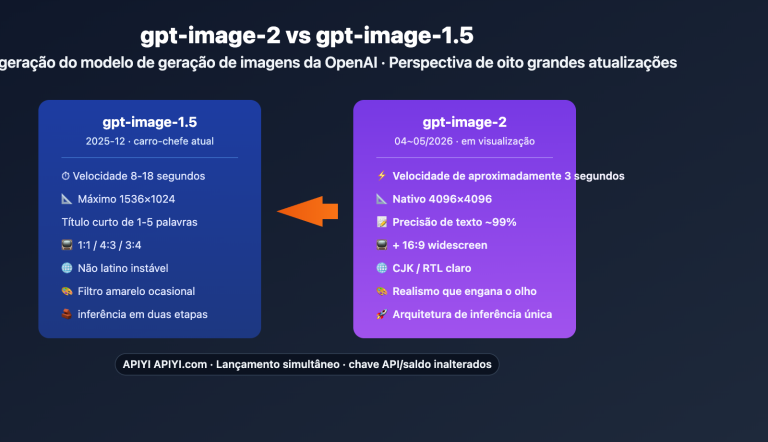

Q8: Qual a diferença na estratégia de upload entre o gpt-image-2 e o gpt-image-1.5?

A estratégia geral é consistente: 1.5MB por imagem / prioridade WebP / size define a saída. Essas regras se aplicam a ambos os modelos. A diferença principal é que o gpt-image-2 suporta resoluções personalizadas (múltiplos de 16) e resoluções experimentais altas, enquanto o gpt-image-1.5 suporta apenas algumas predefinições fixas. Se você está migrando, pode reutilizar o mesmo código de compressão com segurança.

Conclusão

Voltando às duas perguntas centrais do início do artigo, as respostas agora devem estar bem claras.

Primeira pergunta: Qual o tamanho ideal para o upload de imagens no gpt-image-2? Embora o limite oficial seja 50MB, na prática, defina um limite rígido de 1.5MB. Este é o "ponto ideal" que equilibra latência de transmissão, risco de erro 413, tempo de decodificação e custo de novas tentativas. A compressão moderna quase não perde qualidade, então não há necessidade de insistir em enviar a imagem original.

Segunda pergunta: O que determina a resolução de saída? A única resposta é o parâmetro size, não o comando. Remova termos como "8K", "4K" ou "ultra HD" dos seus modelos de comando e reserve seu precioso orçamento de tokens para descrições úteis de estilo, composição e iluminação.

Ao incorporar essas duas regras, a velocidade e a taxa de sucesso das suas chamadas ao gpt-image-2 aumentarão drasticamente. Recomendamos começar com o código de compressão em Python fornecido aqui, integrar via apiyi.com para validar rapidamente e dedicar um ou dois dias para encontrar sua combinação ideal de parâmetros.

📌 Autor: Equipe APIYI — Focada na prática de engenharia de APIs multimodais da OpenAI / Anthropic / Google. Para mais usos avançados do gpt-image-2 e modelos de comando, consulte a central de documentação em apiyi.com.