{OpenClaw conectado ao gpt-image-2}

{Habilidades · Sem escrever código · Geração de imagens com uma frase em linguagem natural}

{OpenClaw}

{Assistente de IA de código aberto}

{🧩 Habilidades}

{APIYI-gpt-image-2-gen}

{Inversão positiva · controle preciso · 4K}

{APIYI-gpt-image-2-all-gen}

{Inversão · Econômico · $0,03/imagem}

{GPT}

{gpt-image-2}

{OpenAI · 2026}

{⚡ Sem código}

{💬 gatilho de linguagem natural}

{⏱ Execute em 5 minutos}

{apiyi.com}

Quer que o OpenClaw aprenda a invocar diretamente o modelo de imagem mais potente da OpenAI, o gpt-image-2? Como você faria isso? A primeira reação da maioria das pessoas é abrir o editor, escrever um script Python com requests.post(...) e encapsulá-lo como uma função de ferramenta para o Agent.

Não que esse caminho não funcione, mas ele fará com que você caia imediatamente em quatro problemas:

- Ter que lidar com o upload de

multipart/form-datapara a imagem de referência. - Ter que escrever lógica de retentativa, timeout e tratamento de limites de taxa (429).

- Ter que escrever um conjunto de encapsulamentos para cada cenário (texto para imagem, imagem para imagem, máscara, lote).

- Ter que reintegrar tudo cada vez que trocar de cliente OpenClaw (ou Claude Code, Cursor).

A resposta em 2026 mudou: não escreva código, apenas instale um Skill.

O OpenClaw suporta um ecossistema completo de Skills — o registro ClawHub já conta com mais de 5.700 Skills contribuídos pela comunidade. Neste artigo, vou compartilhar dois Skills oficiais do gpt-image-2 contribuídos pela equipe APIYI para o repositório expert-skills-hub:

apiyi-gpt-image-2-gen(fluxo direto / controle preciso, recomendado)apiyi-gpt-image-2-all-gen(fluxo reverso / modo econômico)

Instalar um Skill requer apenas um comando, configurar a chave API requer apenas um export, e então você pode dizer diretamente no OpenClaw: "ajude-me a criar uma imagem de um copo de cerâmica em 4K", e o Agent selecionará automaticamente o Skill, preencherá os parâmetros e salvará o arquivo.

Ao terminar este tutorial de integração do gpt-image-2 no OpenClaw, você terá:

- Uma comparação clara entre "escrever código vs. instalar Skill", entendendo por que a segunda opção é superior.

- Dois Skills oficiais prontos para uso, cobrindo cenários de alta qualidade e de lote econômico.

- Um exemplo mínimo de 5 passos (um em Node.js e outro em Python).

- Três comandos práticos (pôster 4K / composição com múltiplas imagens de referência / rascunhos em lote).

- O método para reutilizar o mesmo conjunto de Skills no Claude Code e no Cursor.

1. Por que os Skills são a melhor solução para integrar o gpt-image-2 ao OpenClaw

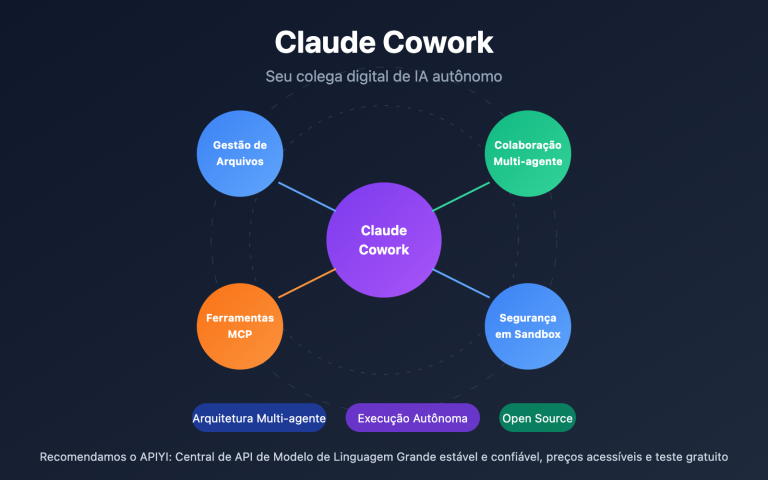

1.1 O sistema de Skills do OpenClaw: a forma padrão de "turbinar" o seu Agent

O OpenClaw é um assistente de IA open source multiplataforma (repositório GitHub github.com/openclaw/openclaw). Seu objetivo de design não é ser "apenas mais uma caixa de chat", mas "fornecer uma caixa de ferramentas combináveis para o Agent". A unidade básica dessa caixa de ferramentas é chamada de Skill.

Um Skill é, essencialmente:

skill-package/

├── SKILL.md # Diz ao Agent o que este Skill faz

├── scripts/

│ ├── generate_image.js # Runtime Node.js

│ └── generate_image.py # Runtime Python

└── requirements.txt / package.json

Quando você diz "ajude-me a desenhar uma xícara de café", o OpenClaw irá:

- Escanear o resumo do

SKILL.mdde todos os Skills instalados. - Determinar que a "geração de imagens" é mais compatível com o

apiyi-gpt-image-2-gen. - Extrair parâmetros da sua linguagem natural (dimensões, qualidade, formato de saída).

- Invocar o

generate_image.js/pycorrespondente. - Retornar o caminho da imagem gerada para você.

Todo o processo não exige que você escreva código, configure rotas ou chame SDKs. Essa é a principal vantagem do ecossistema OpenClaw em relação ao modelo tradicional de "escrever plugins".

1.2 Escrever código vs. Instalar Skill: uma tabela para entender tudo

| Dimensão de comparação | Escrever código HTTP | Instalar Skill oficial |

|---|---|---|

| Custo inicial | A partir de 30 minutos | 1 comando, 30 segundos |

| Detalhes HTTP | Lidar com multipart, retentativas, timeouts | Já encapsulado no Skill |

| Upload de imagem de referência | Fazer codificação base64 manualmente | Passar o caminho do arquivo diretamente |

| Múltiplos runtimes | Ou Node ou Python | Ambos (Node.js + Python) |

| Percepção do Agent | Escrever descrição da ferramenta manualmente | SKILL.md incluído |

| Multi-cliente | Reintegrar a cada troca de ambiente | Funciona em Claude Code / Cursor / OpenClaw |

| Caminho de atualização | Acompanhar atualizações da API OpenAI | npx skills update com um clique |

| Troca de rota | Alterar código | Alterar variáveis de ambiente |

Em outras palavras, escrever código faz de você um trabalhador braçal que vive fazendo manutenção, enquanto instalar um Skill transfere o trabalho de manutenção para o autor do Skill.

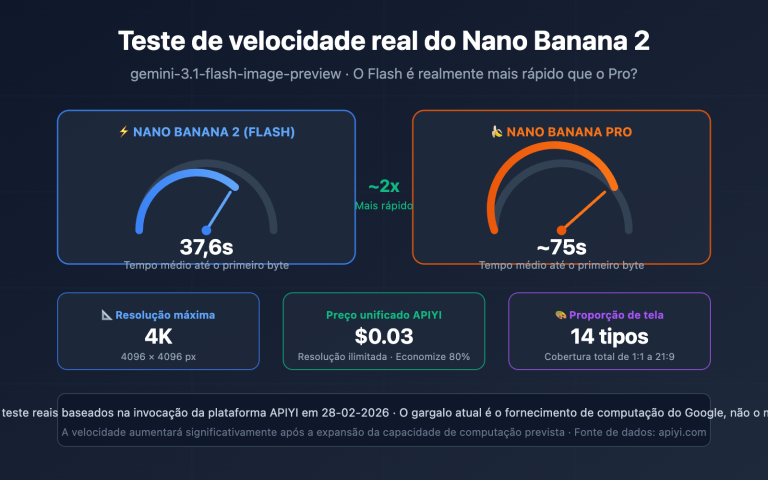

1.3 Divisão de tarefas entre os dois Skills: escolha a ferramenta certa antes de gerar

A equipe APIYI contribuiu com dois Skills para o gpt-image-2 no repositório expert-skills-hub, voltados para cenários completamente diferentes:

| Nome do Skill | Alias do modelo | Posicionamento | Modelo de preço | Melhor cenário |

|---|---|---|---|---|

apiyi-gpt-image-2-gen |

gpt-image-2 |

Fluxo direto / Controle preciso | Cobrança por token | Pôsteres, fotos comerciais, capas, saída 4K |

apiyi-gpt-image-2-all-gen |

gpt-image-2-all |

Fluxo reverso / Modo econômico | Fixo $0,03/imagem | Rascunhos conceituais em lote, prompt em chinês, exploração de rascunhos |

Ambos os Skills compartilham a mesma APIYI_API_KEY, com o backend centralizado no gateway da APIYI. Você pode instalar ambos ao mesmo tempo e deixar que o Agent do OpenClaw escolha automaticamente com base no cenário: gerar pôsteres usa o fluxo direto, rodar 100 variações usa o fluxo reverso.

{OpenClaw integração com gpt-image-2 · comparação de dois caminhos}

{De 30 minutos para construir do zero a 1 linha de comando para instalar, a resposta em 2026 já mudou}

{❌ Escrever código HTTP manualmente}

{Abordagem tradicional · quanto mais se avança, mais cansativo se torna}

{✗}

{A partir de 30 minutos}

{Encapsulamento de SDK / depuração / execução do exemplo mínimo}

{✗}

{upload multipart de imagem de referência}

{processar Base64 / form-data por conta própria}

{✗}

{Tentar novamente / Tempo limite / 429 limite de taxa}

{Você mesmo precisa escrever um conjunto completo de tratamento de erros}

{✗}

{Reintegração necessária entre clientes}

{Tente novamente com Claude Code / Cursor}

{✗}

{O Agent nem sempre consegue realizar a invocação do modelo de forma autônoma}

{A descrição da ferramenta deve ser escrita cuidadosamente por você.}

{2026}

{Solução melhor}

{✅ Instalar Skill oficial}

{Recomendação 2026 · Quanto mais você usa, mais leve fica}

{✓}

{1 linha de comando, instalado em 30 segundos}

{npx skills add … –skill …}

{✓}

{Todos os detalhes do HTTP encapsulados}

{Envie o caminho do arquivo diretamente para a imagem de referência}

{✓}

{Tempo de execução duplo Node.js + Python}

{A mesma Skill, duas formas de invocação}

{✓}

{reutilização de mesma origem entre clientes}

{OpenClaw / Claude Code / Cursor}

{✓}

{O agente seleciona automaticamente o comando}

{SKILL.md permite que a IA entenda quais comandos deve utilizar}

{Uma única instalação · reutilização em múltiplos clientes · mesma origem para OpenClaw / Claude Code / Cursor · backend unificado APIYI em apiyi.com}

1.4 Backend subjacente: Três rotas da APIYI apiyi.com

As requisições HTTP de ambos os Skills são direcionadas por padrão para api.apiyi.com, que é o site principal da APIYI.

🎯 Sugestão de rota: Recomendamos que, em ambientes de produção, você altere a

APIYI_BASE_URLdo OpenClaw para a rota de alta concorrência da APIYI (vip.apiyi.com), especialmente ao rodar gerações em lote. O site principalapi.apiyi.comé adequado para chamadas diárias de imagem única, a rota VIPvip.apiyi.comé ideal para filas de lote/noturnas, eb.apiyi.comserve como um fallback automático. As três rotas compartilham a mesma chave, bastando alterar uma variável de ambiente para alternar.

2. 5 minutos para integrar o OpenClaw ao gpt-image-2

2.1 Verificação do ambiente prévio

Antes de integrar o OpenClaw ao gpt-image-2, certifique-se de que o ambiente está pronto:

| Item | Requisito | Comando de verificação |

|---|---|---|

| OpenClaw instalado | Versão mais recente | openclaw --version |

| Node.js | 18+ | node --version |

| Python | 3.10+ (opcional) | python3 --version |

| npx | Incluso no Node | npx --version |

| Rede | Acesso a github.com e api.apiyi.com | curl -I api.apiyi.com |

| Chave APIYI | Obtenha no painel api.apiyi.com |

Verifique o prefixo sk- |

⚠️ Atenção: Se o comando

npx skillsnão for encontrado na sua versão do OpenClaw, atualize para a versão mais recente (openclaw update). A CLI de Skills é o recurso central do ecossistema OpenClaw 2026; versões antigas podem não suportá-la.

2.2 Passo 1: Instale o Skill com um comando

Abra o terminal e instale o Skill correspondente ao seu caso de uso. Recomendamos instalar ambos:

# Direto (recomendado para uso diário)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub \

--skill apiyi-gpt-image-2-gen

# Reverso (ideal para lotes/prompts em chinês)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub \

--skill apiyi-gpt-image-2-all-gen

Após a conclusão, o Skill será colocado no diretório padrão do OpenClaw (geralmente ~/.openclaw/skills/). Você pode confirmar com o comando abaixo:

npx skills list

# Saída esperada:

# - apiyi-gpt-image-2-gen ✓ instalado

# - apiyi-gpt-image-2-all-gen ✓ instalado

2.3 Passo 2: Configure a chave API

A integração do OpenClaw ao gpt-image-2 requer apenas uma variável de ambiente:

# macOS / Linux

export APIYI_API_KEY="sk-sua-chave-aqui"

# Windows PowerShell

$env:APIYI_API_KEY = "sk-sua-chave-aqui"

Recomendamos adicionar essa linha ao seu ~/.zshrc ou ~/.bashrc para persistência.

🎯 Como obter a chave: Acesse o APIYI em

apiyi.com, registre-se e vá para o painel → API Keys → Criar nova chave. Recomendamos ativar o "limite de uso" e definir um limite diário (ex: ¥50) para a chave usada pelo OpenClaw, evitando gastos excessivos por disparos acidentais do agente.

Troca de rota opcional, caso precise de alta concorrência em cenários de processamento em lote:

export APIYI_BASE_URL="https://vip.apiyi.com/v1" # Rota VIP

# ou

export APIYI_BASE_URL="https://b.apiyi.com/v1" # Rota reserva

Se não for definido, o padrão será https://api.apiyi.com/v1.

2.4 Passo 3: Gere sua primeira imagem (Node.js)

O Skill já vem com um script de exemplo. O comando de verificação mais simples é:

cd ~/.openclaw/skills/apiyi-gpt-image-2-gen

node scripts/generate_image.js \

-p "Um pôster minimalista com o texto 'HELLO 2026' centralizado" \

-s "1024x1024" \

-q "medium" \

-o "png" \

-f "./hello_2026.png"

Após cerca de 20 a 40 segundos, o terminal exibirá:

✔ Imagem gerada: ./hello_2026.png (1024x1024, png, 312 KB)

Abra o arquivo hello_2026.png. Você deverá ver um pôster minimalista com o texto "HELLO 2026" nítido. Se o texto não estiver borrado, significa que toda a cadeia (OpenClaw Skill → APIYI api.apiyi.com → OpenAI gpt-image-2) está funcionando perfeitamente.

2.5 Passo 4: Gere sua primeira imagem (versão Python)

Se o seu projeto utiliza a stack Python, o mesmo Skill inclui um script Python:

cd ~/.openclaw/skills/apiyi-gpt-image-2-gen

python3 scripts/generate_image.py \

-p "Um pôster minimalista com o texto 'HELLO 2026' centralizado" \

-s "1024x1024" \

-q "medium" \

-o "png" \

-f "./hello_2026.png"

Os parâmetros são idênticos aos da versão Node.js, utilizando as cinco opções curtas (-p/-s/-q/-o/-f) ou suas equivalentes longas (--prompt/--size/--quality/--output-format/--filename).

💡 Sem necessidade de trocar o runtime: A presença de ambos os scripts no mesmo pacote de Skill significa que você pode usar Node (amigável para front-end) em uma parte do projeto e Python (amigável para ciência de dados) em outra; o Skill de integração do OpenClaw com gpt-image-2 trata ambos como cidadãos de primeira classe.

2.6 Passo 5: Invocação por linguagem natural no OpenClaw

A CLI acima serve apenas para validar o Skill. O uso real é deixar o OpenClaw invocar o Skill autonomamente. Ao iniciar o OpenClaw, basta dar o comando em linguagem natural:

Usuário: Ajude-me a gerar uma imagem de uma xícara de chá de cerâmica em 4K usando o gpt-image-2,

luz suave da manhã, fundo neutro, formato PNG, salve em ./output/tea_cup.png

OpenClaw: Certo, vou usar o Skill apiyi-gpt-image-2-gen para processar este pedido.

Parâmetros: size=3840x2160, quality=high, output-format=png

Gerando...

✔ Concluído: ./output/tea_cup.png (3840x2160, 2.4 MB)

A camada de raciocínio do OpenClaw irá:

- Identificar o tipo de tarefa = geração de imagens.

- Comparar o

SKILL.mddos dois Skills e selecionar oapiyi-gpt-image-2-gen(já que o usuário pediu 4K + PNG). - Traduzir "4K" para

3840x2160e incorporar "luz suave da manhã" ao prompt. - Executar o

generate_image.jse retornar o caminho do arquivo.

Todo o processo foi feito com uma única frase, sem escrever código Python ou Node. Esse é o valor central da integração do OpenClaw ao gpt-image-2 via Skills.

III. Consulta rápida de parâmetros do OpenClaw para gpt-image-2

3.1 Skill de encaminhamento: apiyi-gpt-image-2-gen

Este é o modo de controle preciso, recomendado para uso padrão. Tabela completa de parâmetros:

| Opção | Opção longa | Intervalo de valores | Padrão | Descrição |

|---|---|---|---|---|

-p |

--prompt |

Texto | Obrigatório | Descrição da imagem, recomenda-se misturar palavras-chave em inglês e português |

-s |

--size |

WIDTHxHEIGHT |

1024x1024 |

Qualquer múltiplo de 16, até o máximo de 3840x3840 |

-q |

--quality |

low/medium/high/auto | auto |

Use high para pôsteres, low para rascunhos |

-o |

--output-format |

png/jpeg/webp | png |

Fundo transparente exige png |

-c |

--output-compression |

0-100 | 85 |

Válido apenas para jpeg/webp |

-i |

--input-image |

Caminho (repetível) | Nenhum | Até 5 imagens de referência |

-m |

--mask |

Caminho | Nenhum | Máscara em preto e branco, branco = área de edição |

-f |

--filename |

Caminho | ./output.png |

Arquivo de saída |

Consulta rápida de tamanhos comuns:

| Uso | Tamanho recomendado |

|---|---|

| Stories/Feed | 1080x1080 |

| Vertical (Redes Sociais) | 1080x1440 |

| Capa de vídeo | 1920x1080 |

| Capa de blog | 1600x900 |

| Pôster 4K | 3840x2160 |

| Banner longo | 2400x800 |

| Papel de parede mobile | 1170x2532 |

3.2 Skill de reversão: apiyi-gpt-image-2-all-gen

Este é o modo econômico em lote, custando cerca de $0,03 por imagem. Parâmetros mais simplificados:

| Opção | Opção longa | Intervalo de valores | Descrição |

|---|---|---|---|

-p |

--prompt |

Texto | Descrição, tamanho/proporção devem ser escritos diretamente no texto |

-r |

--response-format |

url / b64_json | url retorna link CDN de 24h, b64_json retorna Base64 |

-i |

--input-image |

Caminho (repetível) | Até 5 imagens de referência |

-f |

--filename |

Caminho | Arquivo de saída (baixado automaticamente no modo url) |

A Skill de reversão não expõe -s/-q/-o, pois o modelo subjacente é conversacional e o tamanho precisa ser expresso via comando:

# Exemplo correto

-p "Gere um papel de parede horizontal 16:9, paisagem urbana cyberpunk noturna, luzes de neon"

# Exemplo incorreto (o modo de reversão não suporta -s)

-p "Paisagem urbana cyberpunk noturna" -s "1920x1080" # ❌

3.3 Três comandos práticos

Prática 1: Pôster de filme 4K (Encaminhamento)

node scripts/generate_image.js \

-p "Cinematic poster for sci-fi novel 'NEON HORIZON', \

dark blue and magenta gradient sky, lone silhouette on cliff, \

bold serif title centered at top, subtle tagline bottom, \

35mm film grain" \

-s "3840x5760" \

-q "high" \

-o "png" \

-f "./poster_neon_horizon.png"

- Formato vertical 2:3 em 4K

quality=highgarante nitidez no texto- Tempo de geração de 3 a 5 minutos (o tempo de geração 4K está fortemente relacionado à qualidade)

Prática 2: Repintura local com máscara (Encaminhamento + Imagem + Máscara)

node scripts/generate_image.js \

-p "Replace the background with luxurious white marble countertop, \

soft natural window light from the left, \

keep product subject pixel-stable" \

-i "./coffee_cup.png" \

-m "./coffee_cup_mask.png" \

-s "2048x2048" \

-q "high" \

-f "./coffee_cup_marble.png"

- Pixels brancos = fundo a ser substituído

- Pixels pretos = produto (estabilidade de pixels)

- O gpt-image-2 não danificará a forma do produto

Prática 3: Rascunhos conceituais em lote (Reversão + Loop)

# 100 conceitos de vestuário, $0,03 cada, custo total de aprox. $3

for i in $(seq 1 100); do

node scripts/generate_image.js \

-p "Design de personagem cyberpunk #${i}, Hanfu melhorado, tons neon, arte de corpo inteiro" \

-r "url" \

-f "./concepts/concept_${i}.png"

done

- A Skill de reversão tem suporte mais estável para comandos em português

- No modo

-r url, o script baixa automaticamente para o local - Para cenários em lote, sugere-se definir

APIYI_BASE_URL=https://vip.apiyi.com/v1

IV. Combinações avançadas do OpenClaw com gpt-image-2

4.1 Deixe o Agente escolher a Skill autonomamente

Após instalar as Skills de encaminhamento e reversão, o OpenClaw escolherá automaticamente com base no seu idioma. Para ajudar o Agente a ser mais preciso, você pode incluir sinais de comando ao falar:

| O que você diz | Tendência de escolha do Agente |

|---|---|

| "Alta qualidade", "4K", "Pôster", "Comercial" | Encaminhamento apiyi-gpt-image-2-gen |

| "Rascunho", "Lote", "Conceito", "Português" | Reversão apiyi-gpt-image-2-all-gen |

| "Gere 10 para ver" | Reversão (econômico) |

| "Usar máscara para mudar fundo" | Encaminhamento (reversão não suporta máscara) |

| "Preço fixo de $0,03" | Reversão |

🎯 Dica de comando: Ao usar termos como "controle preciso" ou "lote econômico" nas palavras-chave, o OpenClaw quase 100% das vezes acertará a Skill correspondente. Você pode encontrar mais exemplos de gatilhos na seção de ecossistema de Skills em

docs.apiyi.com.

4.2 Cadeia de Skills: Geração de imagem → OCR → Tradução

Como as Skills podem ser orquestradas livremente pelo Agente, o OpenClaw integrado ao gpt-image-2 pode formar pipelines de várias etapas. Exemplo: "Gere um pôster com um slogan em inglês e depois traduza o slogan para uma versão em japonês":

Usuário: Gere um pôster minimalista com o slogan "Less is more",

depois gere a mesma imagem mas com o slogan em japonês

OpenClaw:

Passo 1: apiyi-gpt-image-2-gen (versão em inglês)

→ ./en_poster.png

Passo 2: apiyi-gpt-image-2-gen (versão em japonês, usando en_poster.png como referência)

-i ./en_poster.png

-p "Same layout, replace text with 'より少なく、より豊かに'"

→ ./jp_poster.png

Este é o ponto mais forte do ecossistema de Skills: uma única Skill faz uma coisa, e o Agente é responsável por encadeá-las em fluxos de trabalho de qualquer complexidade.

4.3 Encapsulando Skills em CI/CD

Os scripts das duas Skills são, essencialmente, CLI padrão, o que significa que podem ser integrados perfeitamente em CI/CD:

# .github/workflows/generate-og-image.yml

name: Generate OG image on release

on:

release:

types: [published]

jobs:

og-image:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v4

- uses: actions/setup-node@v4

with: { node-version: '20' }

- run: npx skills add https://github.com/wuchubuzai2018/expert-skills-hub --skill apiyi-gpt-image-2-gen

- env:

APIYI_API_KEY: ${{ secrets.APIYI_API_KEY }}

run: |

node ~/.openclaw/skills/apiyi-gpt-image-2-gen/scripts/generate_image.js \

-p "Release ${{ github.event.release.tag_name }} cover image" \

-s "1200x630" \

-q "high" \

-f "./og-image.png"

- uses: actions/upload-artifact@v4

with: { name: og-image, path: ./og-image.png }

Gere automaticamente uma imagem OG a cada lançamento; o Agente e o CI compartilham a mesma definição de Skill.

4.4 Reutilização no Claude Code e Cursor

Embora este artigo foque no OpenClaw, as duas Skills apiyi-gpt-image-2-gen / apiyi-gpt-image-2-all-gen seguem totalmente os padrões universais de Skills, portanto:

| Cliente | Suporte | Observações |

|---|---|---|

| OpenClaw | ✅ | Cenário principal deste artigo |

| Claude Code | ✅ | Basta colocar em ~/.claude/skills/ |

| Cursor | ✅ | Referenciado via arquivo de regras |

| Windsurf | ✅ | Compatível com a especificação de Skill |

| Agente próprio (LangChain, etc.) | ⚠️ | Requer uma camada de adaptador de ferramenta |

"Instale uma vez, reutilize em vários clientes" permite que sua capacidade de geração de imagens acompanhe suas ferramentas principais sem a necessidade de reescrever nada.

V. FAQ: Integração do OpenClaw com gpt-image-2

Q1: O comando npx skills add retorna "command not found"?

Certifique-se de que o OpenClaw esteja atualizado para a versão mais recente (openclaw update), pois versões antigas não possuem o Skills CLI. Se o erro persistir, você pode clonar o repositório manualmente para o diretório ~/.openclaw/skills/ como uma alternativa.

Q2: O script exibe "APIYI_API_KEY is not set"?

Siga estes três passos para verificar:

- Execute

echo $APIYI_API_KEYpara ver se a variável foi exportada corretamente. - Confirme se a chave possui o prefixo

sk-. - Se você acabou de adicioná-la ao

~/.zshrc, abra um novo terminal para que a alteração entre em vigor.

Q3: Como alternar a invocação do modelo para a linha de alta concorrência vip.apiyi.com?

Existem duas maneiras:

# Opção 1: Variável de ambiente global

export APIYI_BASE_URL="https://vip.apiyi.com/v1"

# Opção 2: Prefixo para uma única invocação

APIYI_BASE_URL="https://vip.apiyi.com/v1" node scripts/generate_image.js ...

O mesmo se aplica ao domínio de backup: b.apiyi.com. Todos os três domínios compartilham a mesma chave. Se o site principal apresentar instabilidade, mudar manualmente para o VIP geralmente resolve o problema imediatamente. Para estratégias específicas, consulte o guia de alternância de rotas na documentação oficial da APIYI em docs.apiyi.com.

Q4: Como escolher entre o modo reverso e o modo direto?

Consulte esta tabela de decisão:

| Se você precisa de… | Escolha |

|---|---|

Controle preciso de resolução (ex: 1920x1080) |

Direto |

| Uso de máscara para repintura local | Direto |

| Pôsteres de alta qualidade acima de 4K | Direto |

| Processamento em lote de 50+ imagens | Reverso |

| Comando em chinês como foco principal | Reverso |

| Custo previsível ($0,03/imagem) | Reverso |

A abordagem mais prática: instale ambos e deixe o agente do OpenClaw escolher automaticamente com base no seu comando em linguagem natural.

Q5: Posso usar no Claude Code?

Sim. Basta criar um link simbólico ou copiar o pacote de Skill de ~/.openclaw/skills/ para ~/.claude/skills/. O Claude Code reconhecerá automaticamente o SKILL.md e o registrará como uma ferramenta chamável. A mesma APIYI_API_KEY pode ser compartilhada.

Q6: As Skills são seguras?

É preciso ter cautela com o ecossistema de Skills da comunidade. Em fevereiro de 2026, foi relatado que 341 Skills maliciosas distribuíam o malware Atomic Stealer via ClawHub. Recomendações:

- Instale apenas Skills de repositórios confiáveis (o

wuchubuzai2018/expert-skills-hubmencionado aqui é a fonte oficial da APIYI). - Após a instalação, revise o

SKILL.mde o conteúdo dos scripts, prestando atenção especial a comandoscurl | bashou códigos que conectam a domínios desconhecidos. - Use

npx skills inspect <nome-da-skill>para verificar quais endereços de rede a Skill acessará.

Todas as requisições das Skills oficiais da APIYI são direcionadas apenas para *.apiyi.com, permitindo uma auditoria de segurança completa.

Q7: O que fazer se a geração de imagens 4K estiver lenta?

- É um comportamento normal.

quality=high+3840x2160leva cerca de 3 a 5 minutos. - Adicione uma proteção de tempo limite fora do script (no Bash, use

timeout 360 node ...). - Se precisar de uma visualização rápida, use

size=2048x1152 quality=mediumpara um rascunho e, após confirmar o resultado, faça o upscale para 4K.

Q8: Como monitorar os custos?

No painel de controle da APIYI (apiyi.com), ative o "Alerta de orçamento diário" e as "Estatísticas por chave". Defina um limite específico para a chave dedicada ao OpenClaw; isso permite observar o consumo e interromper o uso em caso de imprevistos.

VI. Conclusão: Integração do OpenClaw com gpt-image-2

Olhando para trás, o melhor caminho em 2026 para a integração do OpenClaw com gpt-image-2 mudou de "escrever código" para "instalar Skills". O motivo é simples:

- Mais rápido: Dois comandos (

npx skills add+export KEY) e tudo pronto em 30 segundos. - Mais estável: Detalhes de HTTP, estratégias de retentativa e validação de parâmetros ficam encapsulados na Skill; as atualizações acompanham o autor da Skill.

- Mais abrangente: A mesma Skill funciona no OpenClaw, Claude Code e Cursor.

- Mais inteligente: O agente entende o

SKILL.mde decide por conta própria quando e qual ferramenta usar.

As duas Skills fornecidas pela APIYI, apiyi-gpt-image-2-gen (controle refinado) e apiyi-gpt-image-2-all-gen (lote econômico), cobrem perfeitamente os dois cenários mais comuns. Instalar ambas é o ponto de partida mais prático — seja para pôsteres 4K ou 100 rascunhos conceituais, o agente do OpenClaw escolherá a Skill correta automaticamente.

🎯 Dica de implementação: Comece solicitando uma chave de teste na APIYI (

apiyi.com) (recomenda-se um limite diário de ¥20–50) e execute o exemplo mínimo seguindo os 5 passos da seção §2. Após confirmar a conectividade, tente os comandos práticos da §3 para pôsteres 4K e repintura com máscara. Em caso de instabilidade, altere oAPIYI_BASE_URLparavip.apiyi.comoub.apiyi.com. Para combinações de Skills mais complexas ou exemplos de CI/CD, consulte a coluna do ecossistema de Skills na documentação oficial da APIYI (docs.apiyi.com).

Com isso, você tem uma solução completa e reutilizável para a integração do gpt-image-2 no OpenClaw. A única coisa a fazer agora é remover permanentemente a tarefa "escrever ferramenta de invocação de imagem" da sua lista de pendências — deixe que as Skills cuidem disso.

Autor: Equipe Técnica da APIYI

Recursos relacionados:

- Repositório de Skills: github.com/wuchubuzai2018/expert-skills-hub

- Página inicial do OpenClaw: github.com/openclaw/openclaw

- Site oficial da APIYI: apiyi.com

- Documentação da APIYI: docs.apiyi.com

- Site principal da APIYI: api.apiyi.com (backups: vip.apiyi.com / b.apiyi.com)