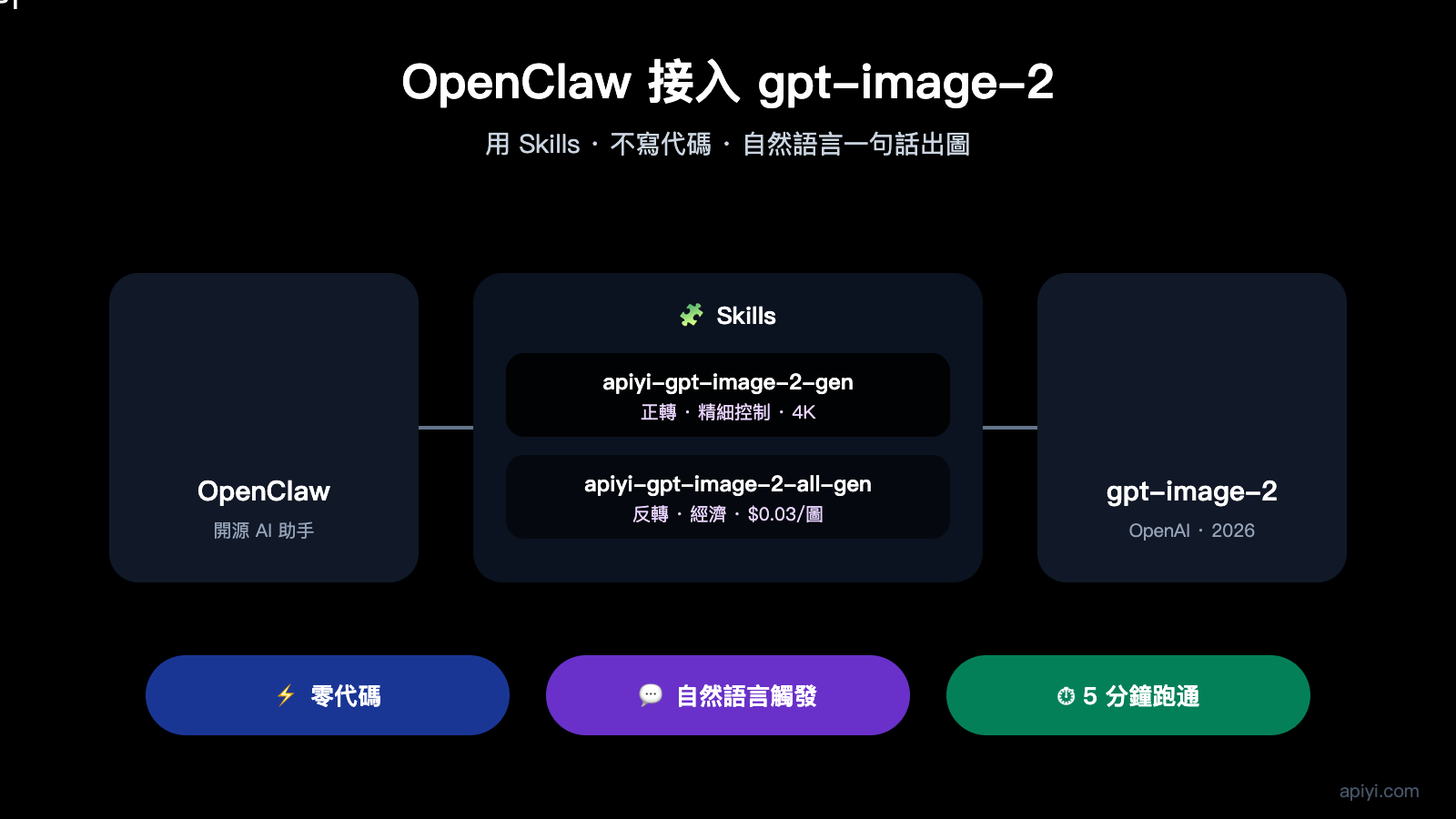

想讓 OpenClaw 學會直接調用 OpenAI 最強圖像模型 gpt-image-2,你會先想到怎麼做?大多數人第一反應是打開編輯器,寫一個 requests.post(...) 的 Python 腳本,再把它封裝成工具函數餵給 Agent。

這條路不是不能走,但它會讓你立刻陷入四個麻煩:

- 要處理 multipart/form-data 上傳參考圖

- 要寫重試/超時/429 限流邏輯

- 要爲每個場景(文生圖、圖生圖、Mask、批量)分別寫一套封裝

- 每換一個 OpenClaw 客戶端(或 Claude Code、Cursor),都得重新集成一次

2026 年的答案已經變了:不要寫代碼,裝 Skill 就好。

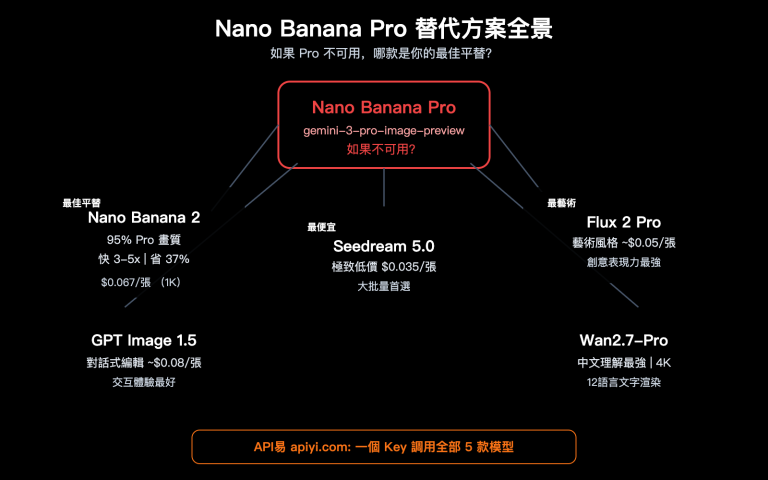

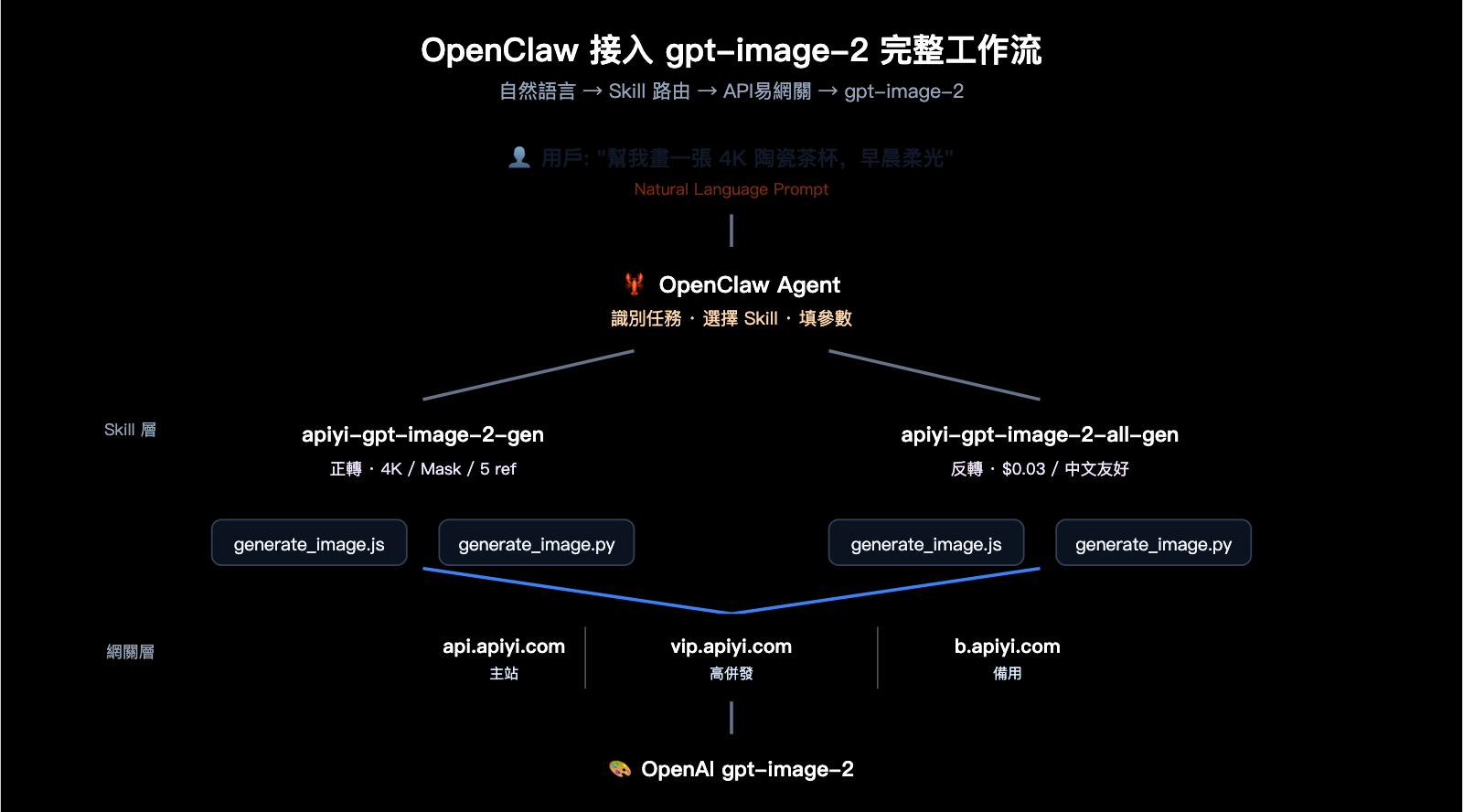

OpenClaw 支持完整的 Skills 生態——ClawHub 註冊表目前已有 5700+ 社區貢獻的 Skill。本文要分享的是 API易團隊貢獻到 expert-skills-hub 倉庫的兩個官方 gpt-image-2 Skill:

apiyi-gpt-image-2-gen(正轉 / 精細控制,推薦)apiyi-gpt-image-2-all-gen(反轉 / 經濟模式)

裝 Skill 只需要一行命令,配 Key 只需要一行 export,然後你就可以在 OpenClaw 裏直接說"幫我畫一張 4K 陶瓷杯商品圖",Agent 會自動挑 Skill、填參數、落文件。

跟完這篇 OpenClaw 接入 gpt-image-2 教程,你會得到:

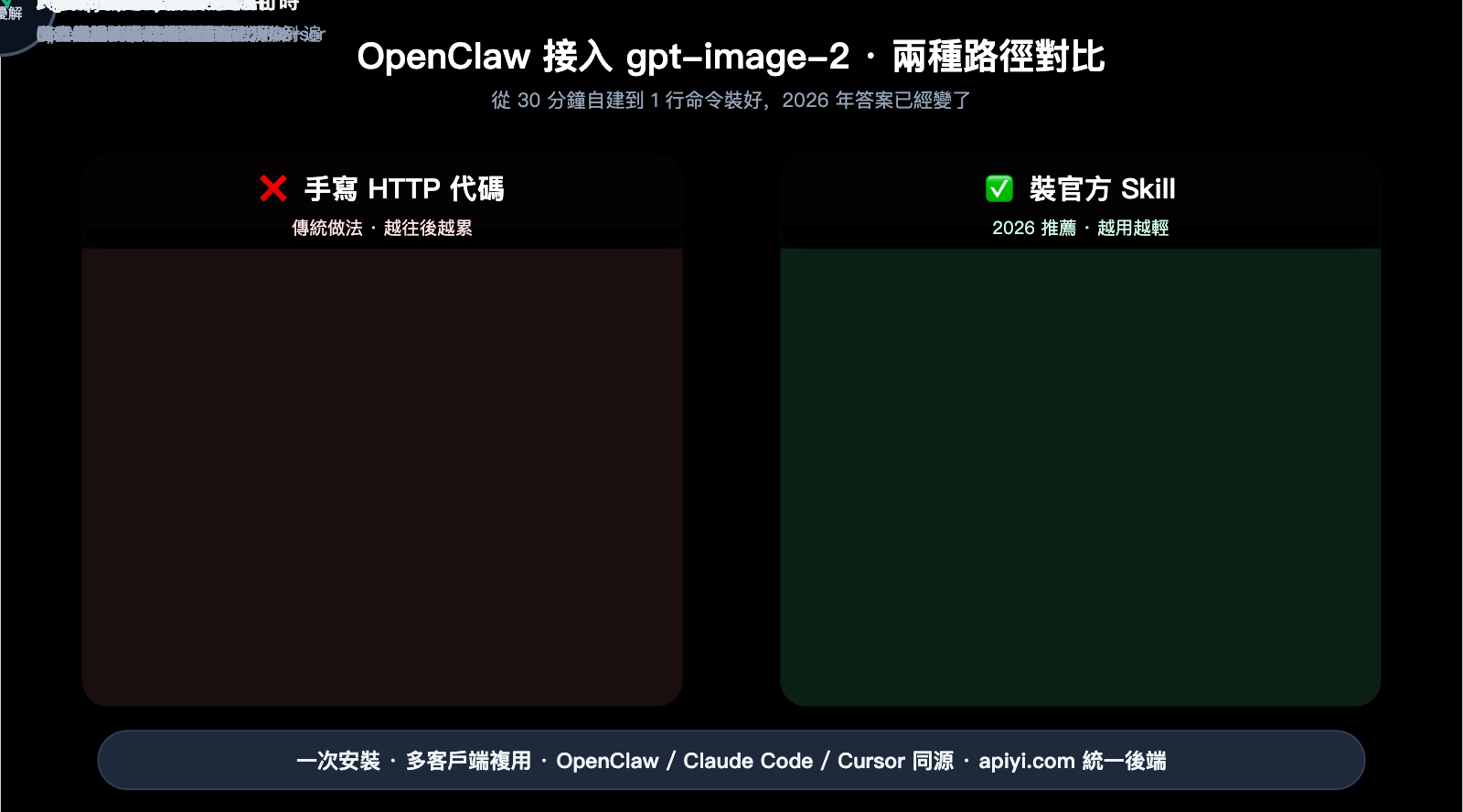

- 一份"寫代碼 vs 裝 Skill"的清晰對比,知道爲什麼後者更優

- 兩個即裝即用的官方 Skill,覆蓋高質量輸出和經濟批量兩種場景

- 5 步跑通的最小示例(Node.js 和 Python 各一份)

- 三個實戰命令(4K 海報 / 多圖參考合成 / 批量草圖)

- 在 Claude Code、Cursor 裏複用同一套 Skill 的方法

一、爲什麼 Skills 是 OpenClaw 接入 gpt-image-2 的最優解

1.1 OpenClaw 的 Skills 體系:給 Agent 開外掛的標準方式

OpenClaw 是一個跨平臺開源 AI 助手(GitHub 倉庫 github.com/openclaw/openclaw),它的設計目標不是"又一個聊天框",而是"給 Agent 提供一套可組合的工具箱"。這套工具箱的基本單元就叫 Skill。

一個 Skill 本質上是:

skill-package/

├── SKILL.md # 告訴 Agent 這個 Skill 是做什麼的

├── scripts/

│ ├── generate_image.js # Node.js 運行時

│ └── generate_image.py # Python 運行時

└── requirements.txt / package.json

當你說"幫我畫一張咖啡杯",OpenClaw 會:

- 掃描所有已安裝 Skill 的

SKILL.md摘要 - 判斷"圖像生成"最匹配

apiyi-gpt-image-2-gen - 從你的自然語言裏抽取參數(尺寸、質量、輸出格式)

- 調用對應的

generate_image.js/py - 把生成的圖片路徑返回給你

整個過程你不寫代碼、不配路由、不調 SDK,這是 OpenClaw 生態相對傳統"寫插件"模式的核心優勢。

1.2 寫代碼 vs 裝 Skill:一張表看清楚

| 對比維度 | 手寫 HTTP 代碼 | 安裝官方 Skill |

|---|---|---|

| 起步成本 | 30 分鐘起步 | 1 行命令,30 秒 |

| HTTP 細節 | 自己處理 multipart、重試、超時 | Skill 內部已封裝 |

| 參考圖上傳 | 自己做 base64 編碼 | 直接傳文件路徑 |

| 多運行時 | 要麼 Node 要麼 Python | Node.js + Python 都有 |

| Agent 感知 | 要自己寫工具描述 | SKILL.md 自帶 |

| 跨客戶端 | 換一次環境重集成 | Claude Code / Cursor / OpenClaw 通喫 |

| 升級路徑 | 自己追 OpenAI API 更新 | npx skills update 一鍵 |

| 線路切換 | 改代碼 | 改環境變量 |

換句話說,寫代碼是讓你自己變成一個永遠在維護的 glue 工人,而裝 Skill 是把維護工作交給專門的 Skill 作者。

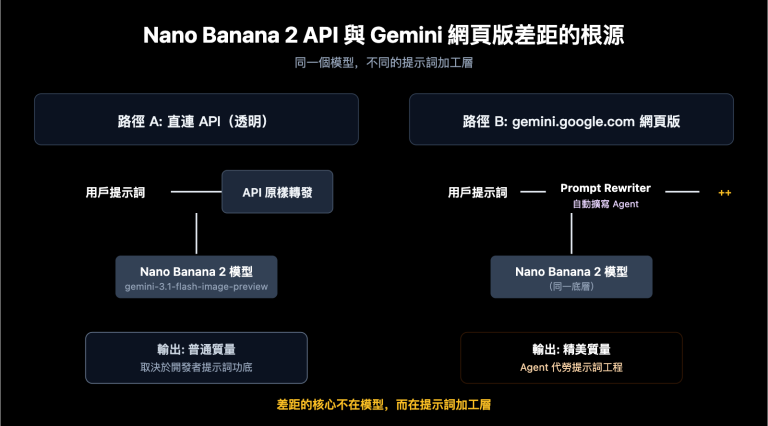

1.3 兩個 Skill 的分工:先選對工具再出圖

API易團隊向 expert-skills-hub 倉庫貢獻了兩個針對 gpt-image-2 的 Skill,它們面向完全不同的場景:

| Skill 名 | 模型別名 | 定位 | 價格模式 | 最佳場景 |

|---|---|---|---|---|

apiyi-gpt-image-2-gen |

gpt-image-2 |

正轉 / 精細控制 | 按 token 計費 | 海報、商拍、封面、4K 出圖 |

apiyi-gpt-image-2-all-gen |

gpt-image-2-all |

反轉 / 經濟模式 | 固定 $0.03/圖 | 批量概念稿、中文 prompt、草圖探索 |

兩個 Skill 共享同一個 APIYI_API_KEY,後端統一走 API易網關。你可以同時裝兩個,讓 OpenClaw Agent 根據場景自動選:生成海報走正轉,跑 100 張變體走反轉。

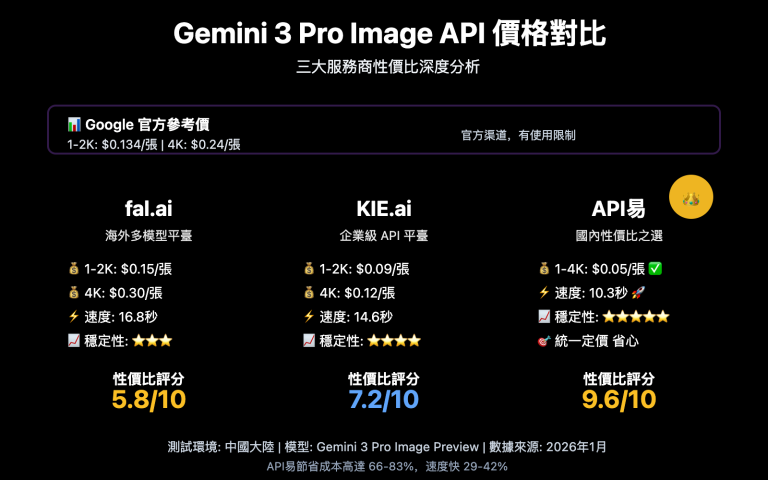

1.4 底層後端:API易 apiyi.com 三線路

兩個 Skill 的 HTTP 請求默認打到 api.apiyi.com,這是 API易的主站。

🎯 線路建議:我們建議在生產環境中把 OpenClaw 的

APIYI_BASE_URL切到 API易 apiyi.com 的高併發線路vip.apiyi.com,特別是批量跑圖時。主站api.apiyi.com適合日常單圖調用,VIP 線路vip.apiyi.com適合批量/夜間隊列,b.apiyi.com則作爲備用 fallback 自動生效。三條線路共用一把 Key,只需改一個環境變量就能切換。

二、5 分鐘完成 OpenClaw 接入 gpt-image-2

2.1 前置環境檢查

在 OpenClaw 接入 gpt-image-2 之前,先確認環境就緒:

| 項 | 要求 | 驗證命令 |

|---|---|---|

| OpenClaw 已安裝 | 最新版 | openclaw --version |

| Node.js | 18+ | node --version |

| Python | 3.10+(可選) | python3 --version |

| npx | 隨 Node 自帶 | npx --version |

| 網絡 | 能訪問 github.com 和 api.apiyi.com | curl -I api.apiyi.com |

| API易 Key | 從 api.apiyi.com 控制檯獲取 |

看 sk- 前綴 |

⚠️ 注意:如果

npx skills命令在你的 OpenClaw 版本里找不到,請升級到最新版(openclaw update)。Skills CLI 是 OpenClaw 2026 生態的核心能力,舊版可能沒有。

2.2 Step 1:一行命令裝 Skill

打開終端,根據你的主要使用場景裝對應 Skill。推薦兩個都裝:

# 正轉(推薦日常使用)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub \

--skill apiyi-gpt-image-2-gen

# 反轉(批量/中文 prompt 友好)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub \

--skill apiyi-gpt-image-2-all-gen

命令完成後,Skill 會被放置到 OpenClaw 的默認 Skill 目錄(通常是 ~/.openclaw/skills/)。你可以用下面的命令確認:

npx skills list

# 預期輸出:

# - apiyi-gpt-image-2-gen ✓ installed

# - apiyi-gpt-image-2-all-gen ✓ installed

2.3 Step 2:配置 API 密鑰

OpenClaw 接入 gpt-image-2 只需要一個環境變量:

# macOS / Linux

export APIYI_API_KEY="sk-your-key-here"

# Windows PowerShell

$env:APIYI_API_KEY = "sk-your-key-here"

建議把這行寫進 ~/.zshrc / ~/.bashrc 做持久化。

🎯 拿 Key 步驟:訪問 API易

apiyi.com,註冊後進入控制檯 → API Keys → 新建密鑰。建議開啓"用量上限"功能,給 OpenClaw 用的 Key 單獨設置日上限(如 ¥50),避免 Agent 誤觸發消耗過大。

可選的三線路切換,如果你在批量場景需要高併發:

export APIYI_BASE_URL="https://vip.apiyi.com/v1" # VIP 線路

# 或

export APIYI_BASE_URL="https://b.apiyi.com/v1" # 備用

不設置時默認走 https://api.apiyi.com/v1。

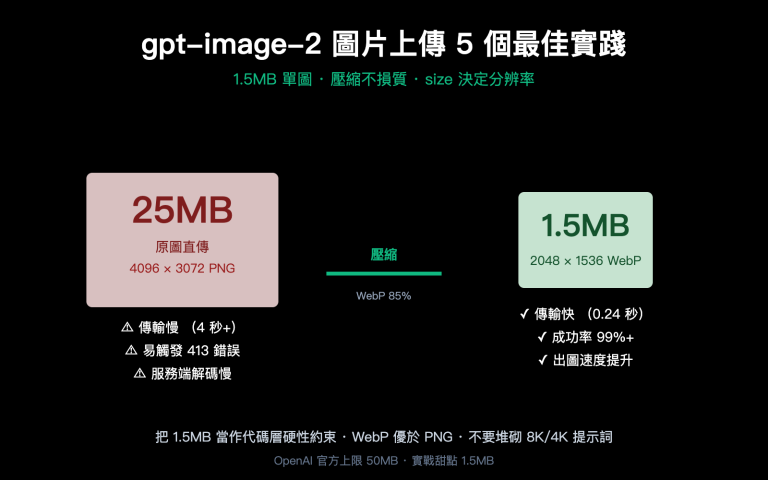

2.4 Step 3:跑第一張圖(Node.js)

Skill 安裝完自帶示例腳本。最簡單的驗證命令:

cd ~/.openclaw/skills/apiyi-gpt-image-2-gen

node scripts/generate_image.js \

-p "A minimalist poster with the text 'HELLO 2026' centered" \

-s "1024x1024" \

-q "medium" \

-o "png" \

-f "./hello_2026.png"

大約 20–40 秒後終端會提示:

✔ Image generated: ./hello_2026.png (1024x1024, png, 312 KB)

打開 hello_2026.png,應該能看到一張乾淨的極簡海報,中間是清晰的 "HELLO 2026" 文字。看到文字不糊就說明整條鏈路(OpenClaw Skill → API易 api.apiyi.com → OpenAI gpt-image-2)已經通了。

2.5 Step 4:跑第一張圖(Python 版)

如果你的項目是 Python 技術棧,同一個 Skill 也帶了 Python 腳本:

cd ~/.openclaw/skills/apiyi-gpt-image-2-gen

python3 scripts/generate_image.py \

-p "A minimalist poster with the text 'HELLO 2026' centered" \

-s "1024x1024" \

-q "medium" \

-o "png" \

-f "./hello_2026.png"

參數與 Node.js 版完全一致,-p/-s/-q/-o/-f 五個短選項或對應的長選項(--prompt/--size/--quality/--output-format/--filename)。

💡 無需切換運行時:同一個 Skill 包裏兩個腳本並存,意味着你可以在同一個項目裏一部分代碼用 Node(前端友好)、一部分代碼用 Python(數據科學友好),OpenClaw 接入 gpt-image-2 的 Skill 對兩邊都是對等公民。

2.6 Step 5:在 OpenClaw 裏自然語言調用

上面的 CLI 只是驗證 Skill 可用。真正的用法是讓 OpenClaw 自主調用。啓動 OpenClaw 後,直接用自然語言下達:

用戶: 幫我用 gpt-image-2 畫一張 4K 的陶瓷茶杯商品圖,

早晨柔光,素色背景,PNG 格式,保存到 ./output/tea_cup.png

OpenClaw: 好的,我選用 apiyi-gpt-image-2-gen Skill 處理這個請求。

參數: size=3840x2160, quality=high, output-format=png

正在生成...

✔ 完成: ./output/tea_cup.png (3840x2160, 2.4 MB)

OpenClaw 的推理層會:

- 識別任務類型 = 圖像生成

- 比較兩個 Skill 的

SKILL.md,選apiyi-gpt-image-2-gen(因爲用戶要 4K + PNG) - 把"4K"翻譯成

3840x2160,"早晨柔光"併入 prompt - 執行

generate_image.js,返回文件路徑

整個過程你只說了一句中文,沒有任何 Python/Node 代碼。這就是 OpenClaw 接入 gpt-image-2 走 Skill 路徑的核心價值。

三、OpenClaw 調用 gpt-image-2 的參數速查

3.1 正轉 Skill:apiyi-gpt-image-2-gen

這是精細控制型,推薦默認使用。完整參數表:

| 選項 | 長選項 | 值範圍 | 默認 | 說明 |

|---|---|---|---|---|

-p |

--prompt |

文本 | 必填 | 圖像描述,建議英文+中文關鍵詞混寫 |

-s |

--size |

WIDTHxHEIGHT |

1024x1024 |

任意 16 倍數,最大 3840x3840 內 |

-q |

--quality |

low/medium/high/auto | auto |

海報選 high,草圖選 low |

-o |

--output-format |

png/jpeg/webp | png |

透明背景必須 png |

-c |

--output-compression |

0-100 | 85 |

僅 jpeg/webp 生效 |

-i |

--input-image |

路徑(可重複) | 無 | 最多 5 張參考圖 |

-m |

--mask |

路徑 | 無 | 黑白 Mask,白=編輯區 |

-f |

--filename |

路徑 | ./output.png |

輸出文件 |

常用 size 速查:

| 用途 | 推薦 size |

|---|---|

| 微信朋友圈 | 1080x1080 |

| 小紅書豎圖 | 1080x1440 |

| B 站封面 | 1920x1080 |

| 博客頭圖 | 1600x900 |

| 4K 海報 | 3840x2160 |

| 長條 banner | 2400x800 |

| 手機壁紙 | 1170x2532 |

3.2 反轉 Skill:apiyi-gpt-image-2-all-gen

這是經濟批量型,按張計費約 $0.03。參數更精簡:

| 選項 | 長選項 | 值範圍 | 說明 |

|---|---|---|---|

-p |

--prompt |

文本 | 描述,尺寸/比例直接寫進文字 |

-r |

--response-format |

url / b64_json | url 返回 24h CDN 鏈接,b64_json 返回 Base64 |

-i |

--input-image |

路徑(可重複) | 最多 5 張參考圖 |

-f |

--filename |

路徑 | 輸出文件(url 模式下會自動下載) |

反轉 Skill 不暴露 -s/-q/-o,因爲底層模型是對話式,尺寸需要通過 prompt 表達:

# 正確示範

-p "生成一張 16:9 橫版壁紙,科幻城市夜景,霓虹燈光"

# 錯誤示範(反轉模式不支持 -s)

-p "科幻城市夜景" -s "1920x1080" # ❌

3.3 三個實戰命令

實戰 1:4K 電影海報(正轉)

node scripts/generate_image.js \

-p "Cinematic poster for sci-fi novel 'NEON HORIZON', \

dark blue and magenta gradient sky, lone silhouette on cliff, \

bold serif title centered at top, subtle tagline bottom, \

35mm film grain" \

-s "3840x5760" \

-q "high" \

-o "png" \

-f "./poster_neon_horizon.png"

- 2:3 豎版 4K

- quality=high 確保文字銳利

- 大約 3–5 分鐘出圖(4K 生成時間與 quality 強相關)

實戰 2:Mask 局部重繪(正轉 + 圖+Mask)

node scripts/generate_image.js \

-p "Replace the background with luxurious white marble countertop, \

soft natural window light from the left, \

keep product subject pixel-stable" \

-i "./coffee_cup.png" \

-m "./coffee_cup_mask.png" \

-s "2048x2048" \

-q "high" \

-f "./coffee_cup_marble.png"

- 白色像素 = 要換的背景

- 黑色像素 = 商品本體(像素穩定)

- gpt-image-2 不會破壞商品形狀

實戰 3:批量概念稿(反轉 + 循環)

# 100 個服裝概念,每張 $0.03,總成本約 $3

for i in $(seq 1 100); do

node scripts/generate_image.js \

-p "賽博朋克角色設計稿 #${i},改良漢服,霓虹色調,全身立繪" \

-r "url" \

-f "./concepts/concept_${i}.png"

done

- 反轉 Skill 對中文 prompt 支持更穩

-r url模式下腳本會自動下載到本地- 批量場景建議切

APIYI_BASE_URL=https://vip.apiyi.com/v1

四、OpenClaw 接入 gpt-image-2 的進階組合

4.1 讓 Agent 自主選 Skill

同時裝了正轉和反轉後,OpenClaw 會根據你的語言自動選。幫助 Agent 選得更準,可以在說話時帶上提示詞信號:

| 你的說法 | Agent 傾向選擇 |

|---|---|

| "高質量"、"4K"、"海報"、"商拍" | 正轉 apiyi-gpt-image-2-gen |

| "草圖"、"批量"、"概念稿"、"中文" | 反轉 apiyi-gpt-image-2-all-gen |

| "先出 10 張看看" | 反轉(經濟) |

| "用 Mask 改背景" | 正轉(反轉不支持 Mask) |

| "固定 $0.03 一張" | 反轉 |

🎯 提示詞技巧:在關鍵詞裏寫"精細控制"或"經濟批量"這類術語,OpenClaw 幾乎 100% 命中對應 Skill。在

docs.apiyi.com的 Skills 生態專欄裏還能找到更多觸發詞樣例。

4.2 Skill 鏈:生成圖 → OCR → 翻譯

因爲 Skill 之間可以被 Agent 自由編排,OpenClaw 接入 gpt-image-2 可以串成多步流水線。示例:"生成一張帶英文標語的海報,然後把標語翻譯成日語版":

用戶: 生成一張帶 "Less is more" 英文標語的極簡海報,

然後生成同構圖但標語換成日語的版本

OpenClaw:

Step 1: apiyi-gpt-image-2-gen (英文版)

→ ./en_poster.png

Step 2: apiyi-gpt-image-2-gen (日語版,以 en_poster.png 爲參考圖)

-i ./en_poster.png

-p "Same layout, replace text with 'より少なく、より豊かに'"

→ ./jp_poster.png

這是 Skill 生態最強大的地方:單個 Skill 做一件事,Agent 負責把它們串成任意複雜度的工作流。

4.3 把 Skill 封裝進 CI/CD

兩個 Skill 的腳本本質是標準 CLI,意味着它們能無縫進入 CI/CD:

# .github/workflows/generate-og-image.yml

name: Generate OG image on release

on:

release:

types: [published]

jobs:

og-image:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v4

- uses: actions/setup-node@v4

with: { node-version: '20' }

- run: npx skills add https://github.com/wuchubuzai2018/expert-skills-hub --skill apiyi-gpt-image-2-gen

- env:

APIYI_API_KEY: ${{ secrets.APIYI_API_KEY }}

run: |

node ~/.openclaw/skills/apiyi-gpt-image-2-gen/scripts/generate_image.js \

-p "Release ${{ github.event.release.tag_name }} cover image" \

-s "1200x630" \

-q "high" \

-f "./og-image.png"

- uses: actions/upload-artifact@v4

with: { name: og-image, path: ./og-image.png }

每次發 release 自動生成 OG 圖,Agent 和 CI 共享同一套 Skill 定義。

4.4 在 Claude Code 和 Cursor 裏複用

本文雖然聚焦 OpenClaw,但 apiyi-gpt-image-2-gen / apiyi-gpt-image-2-all-gen 兩個 Skill 完全遵循通用 Skills 標準,所以:

| 客戶端 | 是否支持 | 備註 |

|---|---|---|

| OpenClaw | ✅ | 本文主場景 |

| Claude Code | ✅ | 放到 ~/.claude/skills/ 即可 |

| Cursor | ✅ | 通過 Rules 文件引用 |

| Windsurf | ✅ | Skill 規範兼容 |

| 自建 Agent(LangChain 等) | ⚠️ | 需要包一層 Tool Adapter |

"一次安裝,多客戶端複用"讓你的圖像生成能力可以跟着主力工具遷移,不用每次重寫。

五、OpenClaw 接入 gpt-image-2 常見問題 FAQ

Q1:npx skills add 報 "command not found"?

確保 OpenClaw 已升級到最新版(openclaw update),舊版沒有 Skills CLI。如果仍然報錯,可以手動克隆倉庫到 ~/.openclaw/skills/ 目錄作爲兜底。

Q2:跑腳本提示 "APIYI_API_KEY is not set"?

三步排查:

echo $APIYI_API_KEY看變量是否導出成功- 確認 Key 帶

sk-前綴 - 如果剛寫入

~/.zshrc,開個新終端讓它生效

Q3:如何把調用切到 vip.apiyi.com 高併發線路?

兩種方式:

# 方式 1:全局環境變量

export APIYI_BASE_URL="https://vip.apiyi.com/v1"

# 方式 2:單次調用前綴

APIYI_BASE_URL="https://vip.apiyi.com/v1" node scripts/generate_image.js ...

備用域名同理:b.apiyi.com。三個域名共用同一把 Key,主站抖動時手工切到 VIP 通常能立刻恢復,具體策略也可以參考 API易官方文檔 docs.apiyi.com 的線路切換指南。

Q4:反轉和正轉到底怎麼選?

對照這張決策表:

| 如果你需要… | 選 |

|---|---|

精確控制分辨率(比如 1920x1080) |

正轉 |

| 使用 Mask 局部重繪 | 正轉 |

| 4K 以上高質量海報 | 正轉 |

| 批量跑 50+ 張 | 反轉 |

| 中文 prompt 佔主導 | 反轉 |

| 成本可預測($0.03/張) | 反轉 |

最省心的做法:兩個都裝,讓 OpenClaw Agent 根據你的自然語言自動選。

Q5:能在 Claude Code 裏用嗎?

可以。把 Skill 包從 ~/.openclaw/skills/ 軟鏈接或複製到 ~/.claude/skills/,Claude Code 會自動識別 SKILL.md 並把它註冊爲可調用工具。同一把 APIYI_API_KEY 共用。

Q6:Skill 安全嗎?

社區 Skill 生態需要警惕。2026 年 2 月曾曝出 341 個惡意 Skill 通過 ClawHub 分發 Atomic Stealer 惡意軟件。建議:

- 只裝來自可信倉庫的 Skill(本文的

wuchubuzai2018/expert-skills-hub是 API易官方源) - 安裝後審閱

SKILL.md和 scripts 內容,尤其注意curl | bash或連接陌生域名的代碼 - 用

npx skills inspect <skill-name>查看 Skill 會訪問哪些網絡地址

官方 API易 Skill 的所有請求都只打向 *.apiyi.com,可以安全審計。

Q7:4K 出圖很慢怎麼辦?

- 正常現象。

quality=high+3840x2160大約需要 3–5 分鐘 - 在腳本外層加超時保護(Bash 裏

timeout 360 node ...) - 如果需要快速預覽,先用

size=2048x1152 quality=medium出草圖,確認效果再升 4K

Q8:如何做成本監控?

在 API易 apiyi.com 控制檯開啓「日預算告警」和「按 Key 統計」。給 OpenClaw 專用 Key 單獨設額度,既能觀察消耗,也能在意外情況下及時停損。

六、OpenClaw 接入 gpt-image-2 總結

回過頭看,OpenClaw 接入 gpt-image-2 在 2026 年的最佳路徑已經從"寫代碼"轉向"裝 Skill"。原因非常樸素:

- 更快:

npx skills add+export KEY兩條命令,30 秒完成 - 更穩:HTTP 細節、重試策略、參數校驗全都封在 Skill 裏,升級跟着 Skill 作者走

- 更廣:同一個 Skill 在 OpenClaw / Claude Code / Cursor 裏通用

- 更聰明:Agent 看得懂

SKILL.md,能自己決定什麼時候用、用哪一個

API易貢獻的兩個 Skill apiyi-gpt-image-2-gen(精細控制)與 apiyi-gpt-image-2-all-gen(經濟批量)正好覆蓋了最常見的兩類場景。同時安裝它們就是目前最省心的起點——後續不管是 4K 海報還是 100 張概念稿,OpenClaw Agent 都能自動選對 Skill。

🎯 落地建議:先去 API易

apiyi.com申請一把測試 Key(建議設置 ¥20–50 的日上限),按本文 §2 的 5 步跑通最小示例;確認鏈路通暢後,回到 §3 的實戰命令嘗試 4K 海報和 Mask 重繪;遇到線路抖動時隨時把APIYI_BASE_URL切到vip.apiyi.com或b.apiyi.com。需要更復雜的 Skill 組合或 CI/CD 樣例,可以查閱 API易官方文檔docs.apiyi.com的 Skills 生態專欄。

至此,你已經擁有一套完整的、跨客戶端可複用的 OpenClaw gpt-image-2 接入方案。接下來要做的唯一事情,就是把"寫一個圖像調用工具"這件事從你的 todo list 上永久刪掉——交給 Skill 就好。

作者: API易技術團隊

相關資源:

- Skills 倉庫: github.com/wuchubuzai2018/expert-skills-hub

- OpenClaw 主頁: github.com/openclaw/openclaw

- API易官網: apiyi.com

- API易文檔: docs.apiyi.com

- API易主站: api.apiyi.com(備用 vip.apiyi.com / b.apiyi.com)