"Por que o Gemini 3.1 Pro Preview está travando de novo?" "O que diabos é esse erro 429 RESOURCE_EXHAUSTED?" — Se você tem usado a nova API do Gemini 3.1 Pro Preview do Google recentemente, essas duas perguntas provavelmente surgem todos os dias. O tempo de resposta do primeiro token (TTFT) pode chegar a 41 segundos, erros 429 aparecem com frequência mesmo para usuários pagantes, e a cota global compartilhada dos modelos Preview piora ainda mais a disputa por recursos.

O problema não está no seu código, mas é uma ocorrência comum na fase atual do Gemini 3.1 Pro Preview. Fóruns de desenvolvedores do Google AI e Issues no GitHub estão cheios de relatos semelhantes.

Valor central: Este artigo não oferece uma solução milagrosa "que resolve tudo" — porque ela realmente não existe. Mas vamos desconstruir tecnicamente as 5 causas principais dos travamentos e erros 429, e compartilhar 7 estratégias validadas pela comunidade para ajudá-lo a usar melhor este modelo que é, de fato, muito poderoso, na fase atual.

O quão poderoso é o Gemini 3.1 Pro Preview? Vejamos os dados

Antes de discutir os problemas, é importante entender por que esse modelo vale a pena enfrentar essas dificuldades. O Gemini 3.1 Pro Preview foi lançado em 19 de fevereiro de 2026 e é atualmente o modelo de raciocínio mais poderoso do Google.

| Métrica | Gemini 3.1 Pro Preview | Benchmark de Comparação |

|---|---|---|

| Pontuação ARC-AGI-2 | 77.1% (validação) | Mais de 2x o Gemini 3 Pro |

| GPQA Diamond | 94.3% | Pontuação mais alta da história nesse benchmark |

| Ranking em Benchmarks | 1º lugar em 12+ de 18 benchmarks | Codificação, raciocínio, tarefas de agente |

| Janela de Contexto | 1.048.576 tokens (1M) | Topo do setor |

| Saída Máxima | 65.536 tokens (64K) | Muito superior à maioria dos concorrentes |

| Modalidades de Entrada | Texto + Imagem + Áudio + Vídeo + Código | Multimodal nativo |

| Velocidade de Saída | ~108 tokens/segundo | Nível médio |

| TTFT (Primeiro Token) | ~41.54 segundos | Mediana de modelos similares é apenas 2.65 segundos |

| Preço (Entrada) | $2.00/M tokens | Médio-alto |

| Preço (Saída) | $12.00/M tokens | Alto |

| Índice de Inteligência | 57 pontos | Muito acima da mediana de 31 pontos |

Fonte dos dados: Artificial Analysis (artificialanalysis.ai), Blog oficial do Google

Resumindo em uma frase: O Gemini 3.1 Pro Preview é um dos modelos públicos mais inteligentes atualmente, mas também um dos mais lentos. Isso não é exatamente um defeito — sua "lentidão" é, em parte, uma escolha de design.

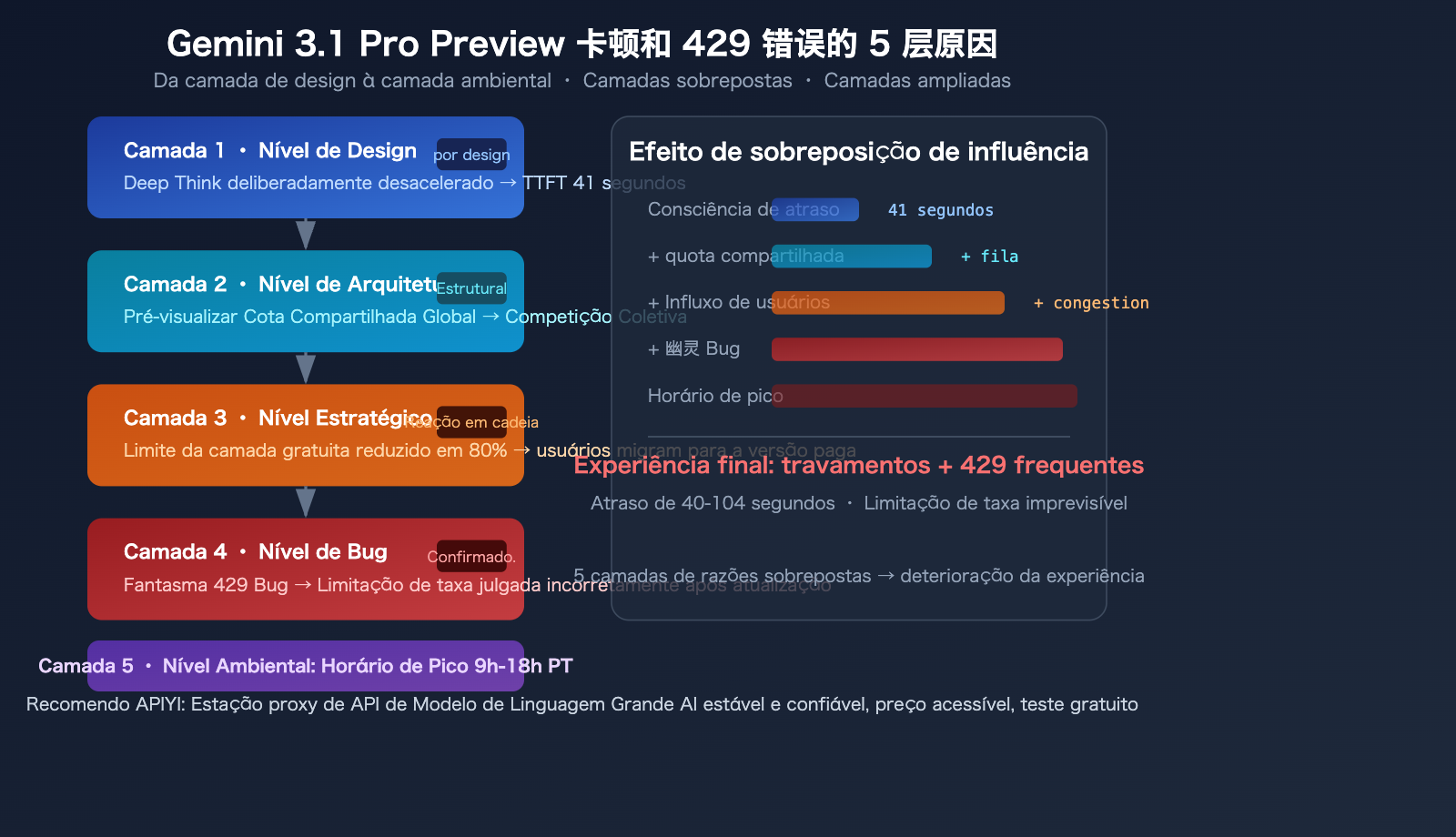

As 5 principais razões para a lentidão do Gemini 3.1 Pro Preview

Razão 1: Deep Think (Pensamento Profundo) — A lentidão é "intencional"

O Gemini 3.1 Pro Preview introduz a funcionalidade "Deep Think" — o modelo deliberadamente reduz a velocidade para realizar um raciocínio mais profundo. O Google fornece o parâmetro thinking_level, que suporta 4 níveis: low, medium (novo), high, max.

Por padrão, o modelo tende a usar níveis de pensamento mais altos, o que resulta diretamente em um TTFT de 41.54 segundos — enquanto a mediana para modelos similares é de apenas 2.65 segundos, uma diferença de mais de 15 vezes.

Em outras palavras: Os 40 segundos que você espera, o modelo não está "travando", está "pensando".

Um desenvolvedor publicou um artigo no Medium com o título: "Gemini 3.1 Pro Isn't Faster, It's Deeper" (Gemini 3.1 Pro não é mais rápido, é mais profundo). Esta é uma escolha filosófica de design — o Google optou por trocar velocidade por profundidade de raciocínio.

Razão 2: Cota global compartilhada para modelos Preview

Este é o fator mais negligenciado, mas com maior impacto.

Modelos Preview (versão de pré-visualização) usam "Cota Dinâmica Compartilhada" (Dynamic Shared Quota) — todos os usuários compartilham um pool global de capacidade. Isso significa que, mesmo que seu uso pessoal esteja muito abaixo do limite, quando o volume total de solicitações de outros usuários em todo o mundo for muito alto, você também será limitado.

Diferenças-chave entre modelos Preview vs GA (versão de disponibilidade geral):

| Dimensão de Comparação | Modelo Preview | Modelo GA (Versão Geral) |

|---|---|---|

| Capacidade do Servidor | Baixa, alocação limitada | Suficiente, escala conforme demanda |

| Mecanismo de Cota | Cota dinâmica compartilhada | Cota independente |

| Garantia de Estabilidade | Nenhuma, pode mudar a qualquer momento | Com garantia de SLA |

| Comportamento de Limitação | Pode ser acionado por congestionamento global | Acionado apenas por exceder limite pessoal |

| Ciclo de Disponibilidade | Pode ser descontinuado a qualquer momento | Manutenção de longo prazo |

Isso explica uma dúvida comum: "Por que recebo erro 429 se claramente não excedi meu limite?" — Porque a cota não considera apenas o seu uso individual.

Razão 3: Redução significativa dos limites da camada gratuita pelo Google no final de 2025

Em dezembro de 2025, o Google reduziu os limites da camada gratuita da API Gemini em até 80%. Embora o Gemini 3.1 Pro Preview em si não ofereça acesso gratuito (apenas para usuários pagantes), essa redução indiretamente empurrou muitos desenvolvedores para os modelos Preview da camada paga, intensificando a competição por recursos.

Limites atuais da camada gratuita (dados de março de 2026):

| Modelo | RPM (Solicitações por Minuto) | RPD (Solicitações por Dia) | TPM (Tokens por Minuto) |

|---|---|---|---|

| Gemini 2.5 Pro | 5 | 100 | 250.000 |

| Gemini 2.5 Flash | 10 | 250 | 250.000 |

| Flash-Lite | 15 | 1.000 | 250.000 |

| Gemini 3.1 Pro Preview | Não disponível | Não disponível | Não disponível |

Comparando com o Tier 1 pago: O Gemini 2.5 Flash salta de 10 RPM para 2.000 RPM — uma diferença de 200 vezes. Mas mesmo na camada paga, os limites reais do 3.1 Pro Preview frequentemente "parecem mais rigorosos do que a documentação diz".

Razão 4: Bug "Fantasma 429" — Conhecido, mas não totalmente corrigido

Há um bug amplamente discutido no fórum de desenvolvedores do Google: o "Ghost 429".

Os sintomas são: Nas primeiras 24-48 horas após fazer upgrade da camada gratuita para o Tier 1 pago, mesmo que o painel mostre uso zero ou próximo de zero, o erro 429 RESOURCE_EXHAUSTED ainda ocorre com frequência.

O Google já confirmou a existência desse bug no fórum de desenvolvedores, explicando que é causado por um cálculo incorreto do sistema de cotas após o upgrade da conta. A solução temporária é aguardar 24-48 horas para o sistema se recalibrar.

Este bug afeta principalmente:

- Usuários que recentemente fizeram upgrade da camada gratuita para o Tier 1

- Usuários que criaram recentemente um novo projeto e habilitaram a cobrança

Razão 5: Congestionamento do servidor em horários de pico

De acordo com o feedback da comunidade, o Gemini 3.1 Pro Preview apresenta latência e taxas de erro 429 significativamente maiores nos seguintes horários:

- Horário do Pacífico 9:00 AM – 6:00 PM (1:00 – 10:00 da manhã, horário de Pequim, no dia seguinte)

- Isso coincide perfeitamente com o horário comercial de pico nos EUA.

Durante os horários de pico, a latência de algumas solicitações pode chegar a 104 segundos, e erros 503 (serviço indisponível) também ocorrem ocasionalmente. O GitHub Issues #22160 documenta o problema de "latência extremamente alta ou falta de resposta ao usar o modelo gemini-3.1-pro".

🎯 Experiência prática: Se você está no Brasil e enfrenta lentidão frequente ao usar a API Gemini, além dos motivos acima, a latência de rede também é um fator. Usar plataformas agregadoras como a APIYI (apiyi.com) para fazer chamadas pode aproveitar rotas de rede otimizadas, reduzindo parte da latência de transmissão.

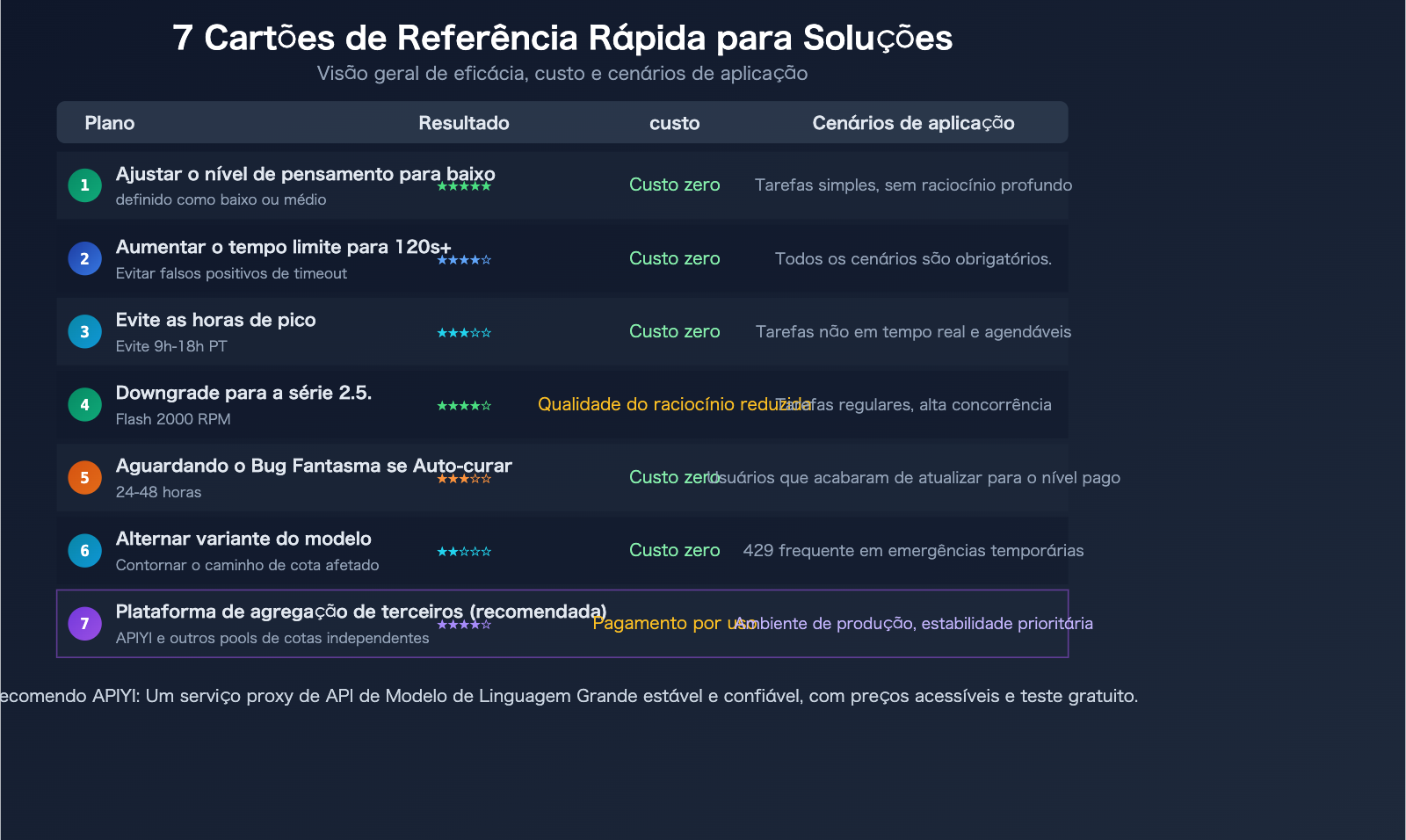

7 Soluções para Lidar com Lentidão e Erros 429 no Gemini 3.1 Pro Preview

Aviso: As soluções a seguir são compartilhadas pela comunidade de desenvolvedores e não são recomendações oficiais do Google. A eficácia pode variar dependendo do cenário específico e não há garantia de resolução completa do problema.

Solução 1: Ajustar o Parâmetro thinking_level

Esta é a forma mais direta de acelerar. Definir thinking_level como low pode reduzir drasticamente o TTFT (Tempo para o Primeiro Token):

import openai

client = openai.OpenAI(

api_key="sua-chave-api",

base_url="https://api.apiyi.com/v1" # Interface unificada da APIYI

)

response = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[

{"role": "user", "content": "Explique a computação quântica em 3 frases"}

],

extra_body={

"thinking_level": "low" # Opções: low / medium / high / max

}

)

print(response.choices[0].message.content)

| thinking_level | Estimativa de TTFT | Profundidade de Raciocínio | Cenário de Uso |

|---|---|---|---|

| low | 5-10 segundos | Raciocínio básico | Perguntas simples, resumos, classificação |

| medium | 15-25 segundos | Raciocínio médio | Codificação diária, geração de conteúdo |

| high | 30-45 segundos | Raciocínio profundo | Análise complexa, provas matemáticas |

| max | 45-100+ segundos | Raciocínio mais profundo | Tarefas de raciocínio extremamente difíceis, nível de pesquisa |

Compromisso: low é mais rápido, mas a qualidade do raciocínio diminui; se você está usando o 3.1 Pro justamente por sua capacidade de raciocínio profundo, reduzir o thinking_level pode não valer a pena.

Solução 2: Aumentar o Tempo Limite (Timeout) do Cliente

A maioria dos clientes HTTP e SDKs tem um tempo limite padrão de 30 segundos – mas o TTFT normal do Gemini 3.1 Pro Preview pode facilmente ultrapassar 40 segundos. Recomenda-se definir o timeout para pelo menos 120 segundos:

import httpx

import openai

# Configurar timeout de 120 segundos

http_client = httpx.Client(timeout=120.0)

client = openai.OpenAI(

api_key="sua-chave-api",

base_url="https://api.apiyi.com/v1",

http_client=http_client

)

Solução 3: Evitar Horários de Pico

Se sua tarefa não exige resposta em tempo real, tente chamar a API nos seguintes horários:

- Horário do Pacífico 18:00 – 09:00 (Horário de Pequim 10:00 – 01:00 do dia seguinte)

- Finais de semana geralmente são mais estáveis do que dias de semana

- A cota RPD (Requisições por Dia) é redefinida à meia-noite, horário do Pacífico

Solução 4: Fazer Downgrade para Gemini 2.5 Pro / 2.5 Flash

Nem todas as tarefas exigem a profundidade de raciocínio do 3.1 Pro. Para tarefas rotineiras, a série Gemini 2.5 ainda é uma escolha confiável:

- Gemini 2.5 Flash: Camada gratuita com 10 RPM, camada paga com até 2.000 RPM, muito mais rápido

- Gemini 2.5 Pro: Camada gratuita com 5 RPM, capacidade ainda muito forte

Quando o 3.1 Pro estiver frequentemente retornando erro 429, a série 2.5 é a solução de downgrade mais prontamente disponível.

Solução 5: Aguardar a Correção Automática do Bug "Ghost 429"

Se você acabou de fazer upgrade da camada gratuita para a Tier 1, ou acabou de criar um novo projeto e habilitou a cobrança:

- Aguarde 24-48 horas para o sistema de cotas se recalibrar

- Use outros modelos ou plataformas como transição durante esse período

- Se o problema persistir após 48 horas, abra um Issue no fórum de desenvolvedores do Google AI

Solução 6: Alternar para uma Variante do Modelo para Contornar a Limitação de Taxa

Há um truque verificado no fórum de desenvolvedores do Google: alternar para uma variante diferente do mesmo modelo às vezes pode contornar o caminho de cota afetado.

Por exemplo:

- Se

gemini-3.1-pro-previewretornar 429, tentegemini-3.1-flash-preview(se disponível) - Diferentes variantes de modelo podem seguir caminhos de cálculo de cota distintos

Solução 7: Usar uma Plataforma de Agregação de API de Terceiros

Plataformas de terceiros geralmente têm pools de cotas independentes, não sujeitos às limitações de cota global compartilhada da API oficial do Google. Esta é uma solução cada vez mais adotada pela comunidade.

Ver código completo (com lógica de downgrade automático e repetição em caso de erro)

import openai

import time

# Chamada via plataforma de agregação APIYI, pool de cotas independente

client = openai.OpenAI(

api_key="sua-chave-api",

base_url="https://api.apiyi.com/v1"

)

# Cadeia de fallback de modelos: usa o mais forte primeiro, faz downgrade automático em caso de 429

model_fallback = [

"gemini-3.1-pro-preview",

"gemini-2.5-pro",

"gemini-2.5-flash",

]

def call_with_fallback(prompt, max_retries=3):

for model in model_fallback:

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000,

timeout=120

)

return {

"model": model,

"content": response.choices[0].message.content,

"attempt": attempt + 1

}

except openai.RateLimitError:

wait = 2 ** attempt

print(f"[{model}] Limitação de taxa 429, aguardando {wait}s antes de tentar novamente...")

time.sleep(wait)

except openai.APITimeoutError:

print(f"[{model}] Timeout, tentando próximo modelo...")

break

return {"error": "Todos os modelos estão indisponíveis"}

result = call_with_fallback("Analise a complexidade computacional do mecanismo de atenção do Transformer")

print(f"Modelo usado: {result.get('model')}")

print(f"Resposta: {result.get('content', result.get('error'))}")

🚀 Solução Recomendada: Chamar o Gemini 3.1 Pro Preview e outros modelos do Google através da plataforma APIYI (apiyi.com) permite aproveitar o pool de cotas independente da plataforma e o roteamento multicanal, reduzindo a probabilidade de erros 429. O registro oferece créditos gratuitos e suporta chamadas unificadas para modelos de vários provedores, como Claude, GPT e Gemini.

Uma questão em aberto: os modelos Preview realmente valem a pena usar?

Esta é uma pergunta sem resposta padrão, mas que vale a pena cada desenvolvedor refletir.

Razões para usar:

- O 3.1 Pro Preview ficou em 1º lugar em 12+ de 18 benchmarks

- 94.3% no GPQA Diamond é a pontuação mais alta da história

- A profundidade de raciocínio trazida pelo Deep Think é realmente única

- Adaptar-se antecipadamente ao modelo mais recente dá uma vantagem competitiva quando a versão GA for lançada

Razões para não usar:

- TTFT de 41 segundos, não é adequado para cenários de interação em tempo real

- Erros 429 frequentes, instável para ambiente de produção

- Modelos Preview podem ser alterados ou descontinuados a qualquer momento (Gemini 3 Pro Preview foi desativado em 09/03/2026)

- Sem garantia de SLA, se der problema, você que se vire

Caminho do meio: Use o 3.1 Pro Preview na fase de desenvolvimento e testes para validar os resultados. Use a série 2.5 ou outros modelos estáveis em produção. Faça a migração para o 3.1 Pro quando a versão oficial (GA) for lançada.

💡 Conselho prático: Se seu caso de uso requer raciocínio profundo e pode aceitar alta latência, o 3.1 Pro Preview vale a pena testar. Se precisa de estabilidade e velocidade, o 2.5 Flash é uma escolha mais pragmática. Recomendamos integrar múltiplas versões do Gemini simultaneamente através da APIYI apiyi.com, comparar o desempenho no seu cenário real e então tomar uma decisão.

Perguntas Frequentes

Q1: O erro 429 RESOURCE_EXHAUSTED é porque minha cota gratuita acabou?

Não necessariamente. O erro 429 pode ser acionado por várias razões: limite pessoal excedido (RPM/RPD/TPM), congestionamento da cota compartilhada global, e o bug do "429 fantasma". Especialmente os modelos Preview usam uma cota compartilhada dinâmica, então mesmo que seu uso pessoal esteja bem abaixo do limite, você pode ser limitado durante congestionamentos globais. Recomenda-se primeiro verificar seu uso real no Google AI Studio para confirmar se realmente excedeu o limite. Se o painel mostrar uso baixo mas ainda assim o erro 429 aparecer, provavelmente é devido à cota compartilhada ou ao bug.

Q2: Fazer upgrade para o Tier 1 pago resolve o problema do 429?

Ajuda a aliviar, mas não resolve completamente. Os limites da camada paga são realmente muito maiores (ex: Flash vai de 10 RPM para 2.000 RPM), mas o mecanismo de cota compartilhada do 3.1 Pro Preview também se aplica na camada paga. Além disso, logo após o upgrade você pode encontrar o bug do "429 fantasma", sendo necessário aguardar 24-48 horas para estabilizar. Para cenários que exigem cotas mais altas, chamar o modelo através de plataformas agregadoras como a APIYI apiyi.com pode aproveitar pools de cota independentes, reduzindo a probabilidade de ser limitado.

Q3: Quando será lançada a versão oficial (GA) do Gemini 3.1 Pro?

O Google ainda não anunciou uma data específica. Com base no ritmo histórico, a transição de Preview para GA geralmente leva de 2 a 4 meses. O 3.1 Pro Preview foi lançado em 19 de fevereiro de 2026, então uma estimativa otimista é que a versão GA possa ser lançada entre o final do Q2 e o Q3 de 2026. A versão GA terá cota independente (não compartilhada), garantia de SLA e capacidade de servidor mais robusta. Atualmente, você pode testar gratuitamente a invocação de toda a série de modelos Gemini através da APIYI apiyi.com.

Resumo: Conviver com as "imperfeições" do Gemini 3.1 Pro Preview

O Gemini 3.1 Pro Preview é um modelo muito poderoso, mas "exigente". Seus 94,3% no GPQA Diamond e 77,1% no ARC-AGI-2 comprovam que sua capacidade de raciocínio está realmente no topo atual, mas um TTFT de 41 segundos e frequentes erros 429 tornam o uso diário um desafio.

Razão principal: as compensações de design do Deep Think, a cota global compartilhada dos modelos Preview e as reações em cadeia no ecossistema causadas pela redução drástica dos limites na camada gratuita do Google.

Abordagem prática:

- Para tarefas que não exigem raciocínio profundo, configure

thinking_level: "low"ou faça downgrade para a série 2.5 - Aumente o tempo limite para 120 segundos ou mais, para evitar falsos positivos de timeout

- Use uma plataforma de agregação de terceiros (como a APIYI apiyi.com) para obter um pool de cotas independente

- Aguarde a versão GA (Disponibilidade Geral) antes de usar em ambiente de produção

É provável que esses problemas sejam resolvidos na versão GA. Até lá, o que podemos fazer é — entender seu comportamento e usá-lo da maneira correta.

Autor: APIYI Team | Chamada unificada de API para toda a série de modelos Gemini, Claude e GPT. Visite a APIYI apiyi.com para obter créditos de teste gratuitos.

📚 Referências

-

Google Oficial – Documentação de Limites de Taxa da API Gemini: Detalhes dos limites por modelo

- Link:

ai.google.dev/gemini-api/docs/rate-limits - Descrição: Tabela comparativa dos limites RPM/RPD/TPM para as camadas gratuita e paga

- Link:

-

Fórum de Desenvolvedores do Google AI – Tópico de discussão sobre erro 429: Compilação de feedback da comunidade

- Link:

discuss.ai.google.dev - Descrição: Inclui confirmação do bug do "429 fantasma" e soluções temporárias

- Link:

-

GitHub Issue #22160 – Latência extremamente alta do Gemini 3.1 Pro: Feedback de desenvolvedores

- Link:

github.com/google-gemini/gemini-cli/issues/22160 - Descrição: Dados de latência e discussão da comunidade

- Link:

-

Artificial Analysis – Avaliação do Gemini 3.1 Pro Preview: Testes de benchmark independentes

- Link:

artificialanalysis.ai/models/gemini-3-1-pro-preview - Descrição: Dados objetivos como TTFT, velocidade de saída, índice de inteligência, etc.

- Link:

-

Documentação oficial do Vertex AI – Explicação do código de erro 429: Tratamento de erros na plataforma Google Cloud

- Link:

docs.cloud.google.com/vertex-ai/generative-ai/docs/provisioned-throughput/error-code-429 - Descrição: Classificação oficial das causas do erro e formas sugeridas de tratamento

- Link: