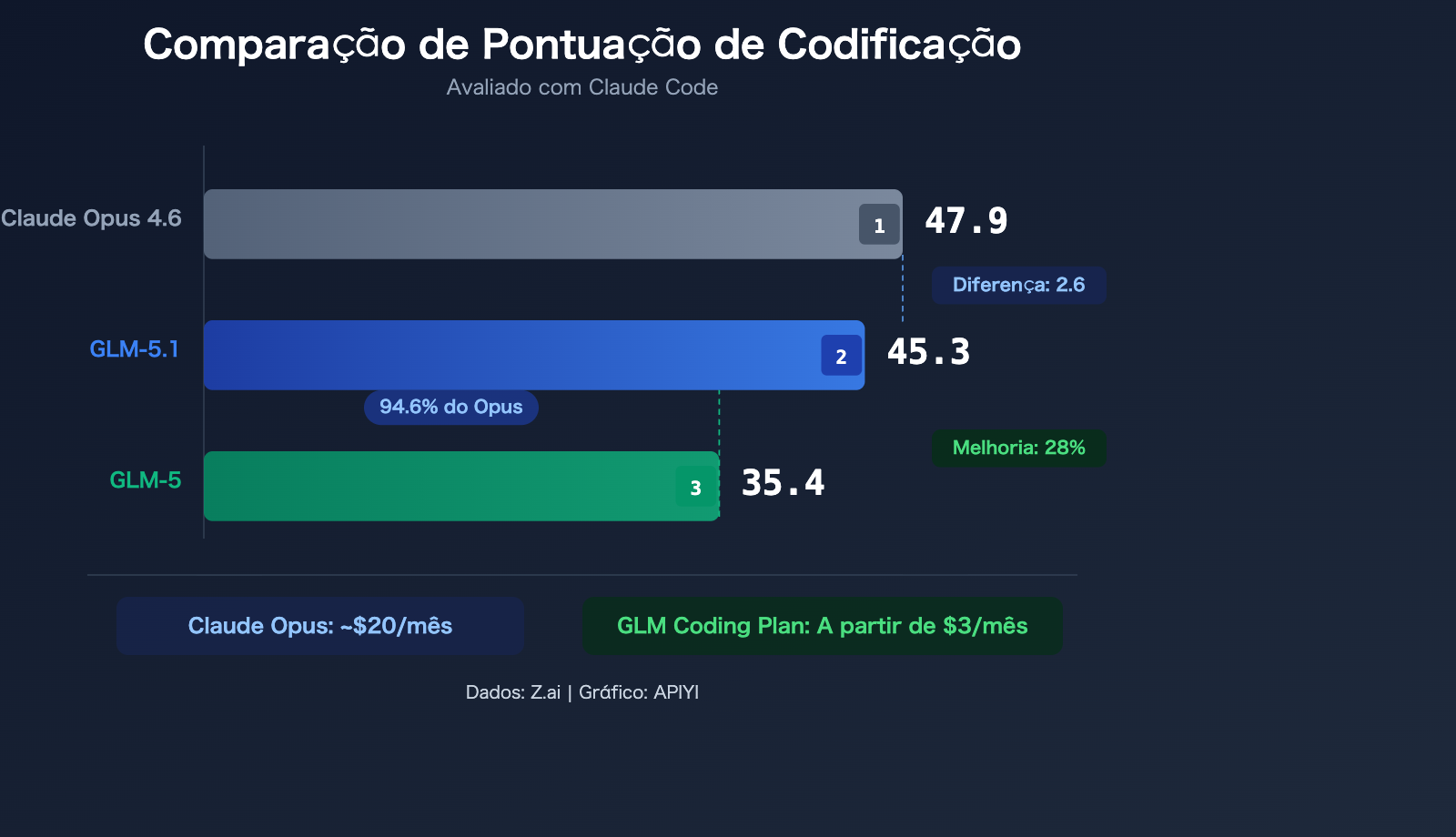

Em 27 de março de 2026, a Z.ai (anteriormente conhecida como ZhiPu AI) anunciou oficialmente: O GLM-5.1 está oficialmente disponível, e todos os usuários do GLM Coding Plan já podem usá-lo. Em uma avaliação de codificação que usou o Claude Code como ferramenta de teste, o GLM-5.1 alcançou uma pontuação de 45.3 — apenas 2.6 pontos abaixo dos 47.9 pontos do Claude Opus 4.6, atingindo 94.6% do nível do Opus.

O mais surpreendente é que o GLM-5.1 superou a pontuação de 35.4 da geração anterior, GLM-5, em 28% — um salto geracional significativo.

E qual é a barreira de preço para tudo isso? O GLM Coding Plan começa em apenas US$ 3/mês (preço promocional), com o preço oficial começando em apenas US$ 10/mês.

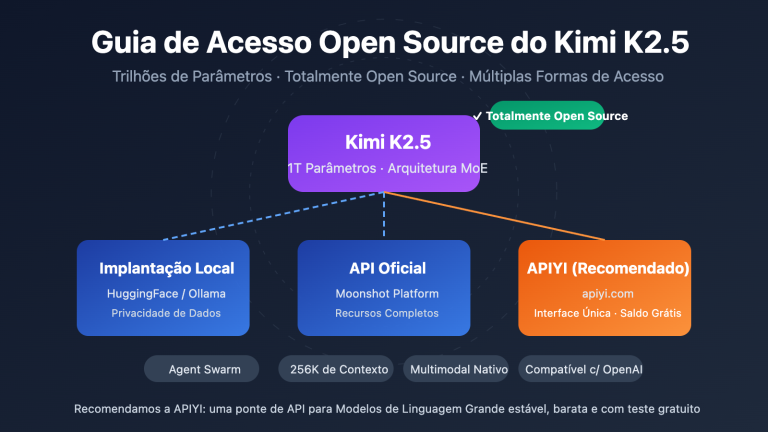

Valor Principal: Este artigo analisará o aprimoramento das capacidades de codificação do GLM-5.1, os detalhes e formas de uso do Coding Plan, e seu valor prático como uma alternativa de alto custo-benefício quando os preços oficiais do Claude estão altos ou sua capacidade computacional está instável. Após o lançamento da API, o APIYI também a integrará imediatamente.

Interpretação dos Dados da Avaliação de Codificação do GLM-5.1

Dados Principais: Usando Claude Code como Ferramenta de Teste

A avaliação de codificação (Coding Evaluation) publicada oficialmente pela Z.ai usa o Claude Code como estrutura de teste, um detalhe importante — o GLM-5.1 demonstrou um desempenho próximo ao do Opus no próprio ambiente de teste da Claude.

| Modelo | Pontuação na Avaliação de Codificação | Diferença para o Opus | Melhoria vs GLM-5 |

|---|---|---|---|

| Claude Opus 4.6 | 47.9 | — | — |

| GLM-5.1 | 45.3 | -2.6 (94.6%) | +28% |

| GLM-5 | 35.4 | -12.5 (73.9%) | Base |

Três descobertas-chave:

1. GLM-5.1 alcançou 94.6% do Claude Opus 4.6

Uma diferença de 2.6 pontos em cenários de codificação reais é praticamente insignificante para a maioria das tarefas. Isso significa que, na assistência de codificação do dia a dia, a experiência com o GLM-5.1 já está muito próxima da oferecida pelo Opus.

2. O salto de GLM-5 para GLM-5.1 é impressionante

De 35.4 para 45.3, uma melhoria de 28%. Considerando que o GLM-5 foi lançado apenas em fevereiro de 2026 (com pontuação SWE-bench Verified de 77.8%, já um nível líder entre modelos de código aberto), alcançar uma iteração tão grande em pouco mais de um mês demonstra uma capacidade de engenharia impressionante da Z.ai.

3. Justiça do Ambiente de Teste

Usar o Claude Code como estrutura de teste significa que esta avaliação naturalmente confere certa vantagem aos modelos Claude (o Claude Code é uma ferramenta otimizada para a série Claude). O fato do GLM-5.1 ter alcançado 94.6% "fora de casa" sugere que sua capacidade real pode ser ainda maior.

Melhorias Técnicas do GLM-5.1 em Comparação ao GLM-5

Embora o relatório técnico completo do GLM-5.1 ainda não tenha sido publicado, podemos especular com base nos fundamentos do GLM-5 e nas informações conhecidas:

| Dimensão Técnica | GLM-5 | GLM-5.1 (conhecido/especulado) |

|---|---|---|

| Parâmetros Totais | 744 bilhões | Não divulgado (esperado ≥ GLM-5) |

| Parâmetros Ativos | 40 bilhões | Não divulgado |

| Arquitetura | MoE | MoE (melhorias especuladas) |

| Contexto | 200K tokens | Não divulgado (esperado ≥200K) |

| Dados de Treinamento | 28.5T tokens | Não divulgado (esperado mais) |

| Licença | Código Aberto MIT | Confirmado que será de código aberto |

| Avaliação de Codificação | 35.4 | 45.3 (+28%) |

Zixuan Li, responsável global da Z.ai, confirmou em um tweet em 20 de março: "Don't panic. GLM-5.1 will be open source." — Isso significa que os pesos do modelo GLM-5.1 serão eventualmente abertos sob licença MIT, assim como o GLM-5.

🎯 Perspectiva do Setor: O compromisso de código aberto do GLM-5.1 é muito importante. Significa que plataformas de inferência de terceiros (incluindo a APIYI apiyi.com) podem integrá-lo rapidamente após o lançamento oficial da API, possivelmente até oferecendo o serviço a um preço mais baixo que o oficial.

GLM Coding Plan Explicado: Solução de IA de Codificação a partir de US$ 3

O GLM Coding Plan é um serviço de IA de codificação por assinatura lançado pela Z.ai, cujo principal atrativo é obter uma experiência de codificação próxima à do Claude por um preço muito inferior.

Comparação dos Três Planos

| Plano | Taxa Mensal (Regular) | Preço Promocional | Solicitações a cada 5 horas | Pesquisas por mês |

|---|---|---|---|---|

| Lite | US$ 10/mês | US$ 3 (primeiro mês) | 120 | 100 |

| Pro | US$ 30/mês | US$ 15 (primeiro mês) | 600 | 1.000 |

| Max | Mais alto | — | Mais | 4.000 |

Modelos e Ferramentas Suportados pelo Coding Plan

Modelos incluídos:

- GLM-5.1 (mais recente, pontuação de codificação 45.3)

- GLM-5 (pontuação de codificação 35.4)

- GLM-5-Turbo (versão mais rápida)

- GLM-4.7

Ferramentas de codificação compatíveis:

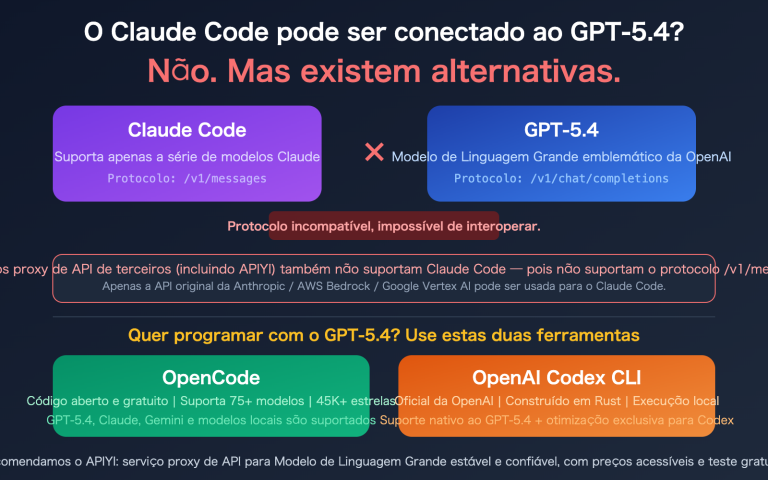

- Claude Code (via camada de compatibilidade de API)

- Cline

- Kilo Code

- OpenCode

- Clawdbot / OpenClaw

Funcionalidades adicionais:

- Compreensão visual (Vision Understanding)

- Web Search MCP

- Web Reader MCP

- Zread MCP

- Velocidade de geração de 55+ tokens/segundo

- Sem restrições de rede, sem risco de bloqueio de conta

Comparação de Custos: Coding Plan vs Assinatura Oficial Claude

Esta é a comparação de custo-benefício mais direta:

| Dimensão de Comparação | GLM Coding Lite | GLM Coding Pro | Claude Pro | Claude Max |

|---|---|---|---|---|

| Taxa Mensal | US$ 10 (promo US$ 3) | US$ 30 (promo US$ 15) | US$ 20 | US$ 100-200 |

| Capacidade de Codificação | 45.3 (GLM-5.1) | 45.3 (GLM-5.1) | Nível Sonnet | Nível Opus (47.9) |

| Proporção em relação ao Opus | 94.6% | 94.6% | ~80% | 100% |

| Relação Custo/Capacidade | Muito alta | Alta | Média | Média-Baixa |

Um desenvolvedor compartilhou no Medium: "O GLM Coding Plan me permitiu obter 3 vezes o volume de uso do Claude Max por US$ 30/mês" — essa avaliação, embora subjetiva, reflete a experiência real da comunidade.

💰 Fazendo as contas: Se você gasta mais de US$ 30 por mês na API do Claude, principalmente para tarefas de codificação, o plano GLM Coding Pro vale uma consideração séria. Obter um modelo com 94,6% da capacidade de codificação do Opus por US$ 30/mês é realmente um ótimo custo-benefício.

Nossa Perspectiva: Uma Alternativa de Alto Custo-Benefício Quando o Claude Está Instável

Como uma plataforma de agregação de APIs, a APIYI observa uma dor real em suas operações diárias: a capacidade computacional do Claude oficial ocasionalmente fica instável. Especialmente durante os horários de pico, a latência de resposta do Opus 4.6 aumenta e o tempo de fila das solicitações se alonga, afetando a produtividade dos desenvolvedores.

Por que o GLM Coding Plan é uma boa alternativa?

Razão 1: A capacidade de codificação já é suficientemente próxima

45.3 vs 47.9, uma diferença de 2,6 pontos é quase imperceptível na codificação diária. A menos que você esteja lidando com projetos de arquitetura de código extremamente complexos ou tarefas de raciocínio profundo, o GLM-5.1 é perfeitamente capaz.

Razão 2: A diferença de preço é enorme

Claude Max custa US$ 100-200 por mês, o GLM Coding Pro custa apenas US$ 30. Se você usar o dinheiro economizado em cenários que realmente exigem o Opus (chamando via API sob demanda), o custo total pode ser ainda menor.

Razão 3: Sem preocupações com instabilidade computacional

O GLM Coding Plan promete nenhuma restrição de rede e nenhum risco de bloqueio de conta. Embora a Z.ai também tenha enfrentado tensão na capacidade computacional no final de fevereiro, o gerenciamento de capacidade de seu modelo de assinatura é relativamente mais previsível.

Razão 4: Boa compatibilidade com ferramentas

Compatível diretamente com o Claude Code — você não precisa trocar de ferramenta de codificação, apenas alterar o endpoint da API para mudar do Claude para o GLM. Para desenvolvedores já acostumados com o fluxo de trabalho do Claude Code, o custo de migração é quase zero.

Quando você deve continuar usando o Claude?

O GLM-5.1 é um bom substituto, mas não é a solução ideal para todos os cenários:

- Precisa de uma janela de contexto de 1M: Claude Opus 4.6 suporta 1 milhão de tokens, a série GLM-5 suporta 200K.

- Precisa de profundidade de raciocínio extrema: O Opus ainda tem vantagem em raciocínio profundo e análise complexa.

- Precisa de saída multimodal: A compreensão de imagem e a criação de textos longos do Claude são mais fortes em certos cenários.

- Requisitos de conformidade empresarial: Algumas empresas têm requisitos específicos para fornecedores de modelos.

🎯 Estratégia Recomendada: Use o GLM Coding Plan como sua principal ferramenta de codificação diária e chame o Claude Opus sob demanda através da APIYI (apiyi.com) para tarefas complexas. Essa combinação "GLM no dia a dia + Claude para tarefas pesadas" pode garantir a eficácia enquanto reduz significativamente o custo total.

Integração da API GLM-5.1: Status Atual e Preparativos

Status Atual

Até 27 de março de 2026, o status do GLM-5.1 é o seguinte:

| Canal | Status | Observação |

|---|---|---|

| GLM Coding Plan (z.ai) | ✅ Disponível | Disponível para todos os usuários do Coding Plan |

| API Oficial do Z.ai | ⏳ Ainda não disponível | Aguardando liberação oficial |

| APIYI apiyi.com | ⏳ Aguardando integração | Suporte assim que a API for lançada |

| Pesos Open Source | ⏳ Comprometido a ser open source | Data específica não definida |

Preparativos que você pode fazer agora

Método 1: Usar diretamente o GLM Coding Plan

Vá para z.ai/subscribe e assine o Coding Plan para usar o GLM-5.1 no Claude Code.

Método 2: Chamar o GLM-5 via API (disponível atualmente)

A API do GLM-5 já está disponível, com preços de entrada de $1,00/M tokens e saída de $3,20/M tokens. Embora sua pontuação em benchmarks de codificação (35,4) seja inferior à do GLM-5.1 (45,3), ele ainda é forte em outras tarefas (SWE-bench Verified 77,8%).

import openai

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1" # Interface unificada da APIYI

)

# Atualmente disponível: GLM-5

response = client.chat.completions.create(

model="glm-5",

messages=[

{"role": "user", "content": "Otimize o desempenho deste código Python"}

]

)

# Mudar para GLM-5.1 quando a API for lançada

# model="glm-5.1"

print(response.choices[0].message.content)

Ver código completo (incluindo estratégia de chamada mista GLM + Claude)

import openai

import time

# Chamar vários modelos através da interface unificada da APIYI

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# Estratégia de seleção de modelo: GLM para tarefas simples, Claude para tarefas complexas

def smart_route(prompt, complexity="normal"):

"""

Seleciona automaticamente o modelo com base na complexidade da tarefa

- simple: GLM-5 (custo mais baixo)

- normal: GLM-5.1 (mudar após o lançamento)

- complex: Claude Opus 4.6 (raciocínio mais forte)

"""

model_map = {

"simple": "glm-5",

"normal": "glm-5", # Mudar para "glm-5.1" após o lançamento

"complex": "claude-opus-4-6"

}

model = model_map.get(complexity, "glm-5")

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000,

temperature=0.7

)

elapsed = time.time() - start

return {

"model": model,

"content": response.choices[0].message.content,

"time": f"{elapsed:.2f}s",

"tokens": response.usage.total_tokens

}

# Exemplo: GLM para codificação diária, Claude para raciocínio profundo

tasks = [

("Escreva uma implementação Python do Quicksort", "simple"),

("Refatore o pool de conexões de banco de dados deste microsserviço", "normal"),

("Projete um mecanismo de compensação para transações distribuídas", "complex"),

]

for prompt, complexity in tasks:

result = smart_route(prompt, complexity)

print(f"[{complexity}] Modelo: {result['model']}")

print(f" Tempo gasto: {result['time']} | Tokens: {result['tokens']}")

print(f" Resposta: {result['content'][:100]}...\n")

🚀 Início Rápido: A APIYI apiyi.com já suporta chamadas de API para o GLM-5. Quando a API do GLM-5.1 for oficialmente lançada, a APIYI a integrará imediatamente. Cadastre-se para receber créditos gratuitos e suporte unificado para chamadas de vários modelos como Claude, GPT, Gemini e GLM.

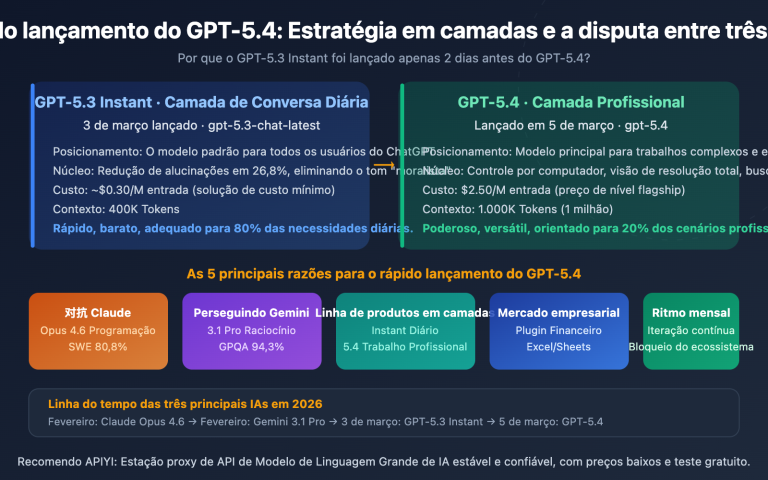

Cenário Competitivo do GLM-5.1 e Outras IAs de Codificação

O lançamento do GLM-5.1 tornou o cenário competitivo das IAs de codificação ainda mais interessante:

| Modelo | Posicionamento de Capacidade de Codificação | Posicionamento de Preço | Status da API | Status Open Source |

|---|---|---|---|---|

| Claude Opus 4.6 | Mais forte (47,9) | Mais alto | Público | Fechado |

| GLM-5.1 | Próximo do Opus (45,3) | Baixo ($3-30/mês) | Disponível no Coding Plan | Será open source |

| Gemini 3.1 Pro | Forte (primeiro em vários benchmarks) | Médio | Disponível em Preview | Fechado |

| GPT-5.2 | Forte | Alto | Público | Fechado |

| DeepSeek V3.2 | Médio | Mais baixo | Público | Open source |

| GLM-5 | Médio-alto (35,4) | Baixo | Público | MIT Open source |

O posicionamento único do GLM-5.1 está em: oferecer capacidade de codificação próxima dos modelos principais fechados, com a transparência de um modelo open source e o baixo preço de uma assinatura. Isso não tinha precedentes antes — é a primeira vez que um modelo open source se aproxima tanto do líder fechado em capacidade de codificação.

Perguntas Frequentes

Q1: Quando a API do GLM-5.1 será lançada?

Atualmente não há uma data exata. O GLM-5.1 já está disponível no Coding Plan, mas a interface de API independente ainda não foi aberta. Com base no intervalo de tempo entre o lançamento do GLM-5 e a disponibilização de sua API, é provável que a API do GLM-5.1 seja lançada em algumas semanas. A APIYI apiyi.com integrará a API assim que ela for oficialmente aberta, permitindo que você invoque o GLM-5.1 diretamente através de uma interface unificada.

Q2: Como usar o GLM Coding Plan no Claude Code?

A API da Z.ai é compatível com o formato da API da Anthropic, portanto, o Claude Code pode rotear solicitações para a Z.ai alterando o endpoint da API. Os passos específicos envolvem mudar o endpoint da API nas configurações do Claude Code do endpoint oficial da Anthropic para o endpoint fornecido pela Z.ai, sem necessidade de modificar qualquer outra configuração. Para configurações detalhadas, consulte a documentação para desenvolvedores da Z.ai: docs.z.ai.

Q3: O GLM-5.1 pode substituir completamente o Claude Opus 4.6?

Em tarefas de codificação, o GLM-5.1 (45.3 pontos) já está muito próximo do Opus (47.9 pontos), com diferenças quase imperceptíveis em cenários de codificação do dia a dia. No entanto, o Opus ainda mantém vantagens claras nos seguintes cenários: contexto super longo de 1M token, raciocínio profundo de alto nível e fluxos de trabalho complexos de Agent com múltiplas etapas. Nossa estratégia recomendada é "GLM para o dia a dia + Claude para tarefas pesadas" — use o GLM para codificação diária e economia de custos, e invoque o Opus sob demanda através da APIYI apiyi.com para tarefas complexas.

Resumo: O GLM-5.1 muda o panorama de custo-benefício da IA de codificação

O lançamento do GLM-5.1 é um marco importante no campo da IA de codificação em 2026 — é a primeira vez que um modelo de código aberto (em breve) atinge 94.6% do desempenho do Claude Opus 4.6 em benchmarks de codificação, enquanto seu preço é apenas uma fração do custo do Opus.

3 pontos principais:

- Capacidade de codificação se aproxima do estado da arte: 45.3 vs 47.9, uma diferença de apenas 2.6 pontos, quase imperceptível na codificação diária.

- Vantagem de preço esmagadora: Coding Plan $3-30/mês vs Claude Max $100-200/mês.

- API em breve disponível: A APIYI integrará a API do GLM-5.1 imediatamente após seu lançamento, permitindo a invocação através de uma interface unificada.

No cenário atual de preços oficiais elevados da Claude e ocasional instabilidade computacional, o GLM Coding Plan já provou ser uma alternativa confiável e de alto custo-benefício. Seja você optar pela assinatura do Coding Plan ou aguardar a API para chamadas sob demanda, o GLM-5.1 merece um lugar na sua caixa de ferramentas de IA para codificação.

Autor: APIYI Team | A APIYI apiyi.com dará suporte ao GLM-5.1 API imediatamente após seu lançamento. Visite-nos para obter créditos de teste gratuitos e experimentar a invocação unificada de múltiplos modelos: Claude + GLM + GPT + Gemini

📚 Referências

-

Anúncio oficial do Z.ai: GLM-5.1 lança o Coding Plan

- Link:

z.ai/subscribe - Descrição: Assine o GLM Coding Plan para usar o GLM-5.1

- Link:

-

Blog oficial do Z.ai: Introdução técnica do GLM-5

- Link:

z.ai/blog/glm-5 - Descrição: Detalhes sobre a arquitetura, dados de treinamento e benchmarks do GLM-5

- Link:

-

Documentação para desenvolvedores do Z.ai: Integração de API e preços

- Link:

docs.z.ai/guides/overview/pricing - Descrição: Preços dos modelos, especificações de chamada de API e guias de integração de ferramentas

- Link:

-

Artificial Analysis: Avaliação independente do GLM-5

- Link:

artificialanalysis.ai/models/glm-5 - Descrição: Dados de benchmark de terceiros e comparação de modelos

- Link:

-

Repositório GitHub do GLM-5: Pesos do modelo de código aberto

- Link:

github.com/zai-org/GLM-5 - Descrição: Código aberto sob licença MIT, incluindo pesos do modelo e guias de uso

- Link: