O evento mais dramático da IA em março de 2026: um modelo anônimo chamado "Hunter Alpha" surgiu silenciosamente no OpenRouter, consumindo 500 bilhões de tokens por semana, com um desempenho que rivaliza com o GPT-5.2 e o Claude Opus 4.6. Desenvolvedores de todo o mundo começaram a especular: "Será este o DeepSeek V4?"

A resposta surpreendeu a todos — trata-se do MiMo V2 Pro da Xiaomi. Uma fabricante de celulares que, em menos de um ano, construiu um Modelo de Linguagem Grande de escala global com trilhões de parâmetros.

Lançado simultaneamente, temos o MiMo V2 Omni — um modelo multimodal capaz de processar nativamente texto, imagens, vídeos e mais de 10 horas de áudio contínuo. Agora, ambos os modelos já estão disponíveis na plataforma APIYI, prontos para invocação direta pelos desenvolvedores.

Valor central: Ao ler este artigo, você entenderá o nível real de capacidade do MiMo V2 Pro e do Omni, as diferenças em comparação com a concorrência e por que eles são atualmente um dos modelos de IA com a melhor relação custo-benefício.

O caso Hunter Alpha: como a Xiaomi chocou o mundo da IA

Linha do tempo

| Data | Evento |

|---|---|

| Início de 2026 | Um modelo codinome "Hunter Alpha" é lançado anonimamente no OpenRouter |

| Durante semanas | Consumo de 500 bilhões de tokens por semana; desenvolvedores globais testam intensamente |

| Discussão na comunidade | Desempenho próximo a modelos fechados de elite; especula-se que seja o DeepSeek V4 |

| 18-19/03/2026 | Xiaomi revela oficialmente: Hunter Alpha = MiMo V2 Pro |

| Mesmo dia | MiMo V2 Omni e MiMo V2 Flash são lançados simultaneamente |

| Dia do anúncio | Ações da Xiaomi sobem cerca de 4% |

Por que isso é tão impactante: Uma empresa conhecida por celulares e casas inteligentes treinou, em menos de um ano, um Modelo de Linguagem Grande com escala de trilhões de parâmetros, cujo desempenho entrou diretamente para o top 10 mundial. Mais surpreendente ainda é que o líder da equipe, Luo Fuli, foi um dos principais colaboradores dos modelos inovadores da DeepSeek.

🎯 Informações úteis: O MiMo V2 Pro e o MiMo V2 Omni já estão disponíveis na plataforma APIYI (apiyi.com), permitindo a invocação direta pelos desenvolvedores. Com o nível de desempenho do MiMo V2 Pro e um preço de 1/3, este é um dos modelos de inferência com a melhor relação custo-benefício atualmente.

title: MiMo V2 Pro 与 MiMo V2 Omni:小米全模态 AI 旗舰解析

MiMo V2 Pro:Modelo de Linguagem Grande de um trilhão de parâmetros

Especificações principais

| Parâmetro | Detalhes |

|---|---|

| Nome do Modelo | MiMo V2 Pro (anteriormente Hunter Alpha) |

| Data de Lançamento | 18-19 de março de 2026 |

| Parâmetros Totais | Aprox. 1 trilhão (arquitetura MoE) |

| Parâmetros Ativos | 42B (ativados por inferência) |

| Janela de contexto | 1.048.576 tokens (1M) |

| Saída Máxima | 131.072 tokens (128K) |

| Entrada/Saída | Apenas texto |

| Capacidade de Inferência | Suporta raciocínio estendido (tag <think>) |

| Status Open Source | Não disponível (acesso via API) |

| Líder de P&D | Luo Fuli (ex-membro central da DeepSeek) |

Desempenho de referência: 8º no mundo, 2º na China

| Benchmark | MiMo V2 Pro | Ranking |

|---|---|---|

| Artificial Analysis Intelligence Index | 49 | #8 Global |

| PinchBench | 84.0 | #3 Global |

| ClawEval (Capacidade de Agente) | 61.5 | #3 Global |

| GDPval-AA | 1434 Elo | #1 Modelo Chinês |

| Precisão Matemática | 94.0% | Top |

| Precisão de Codificação | 92.5% | Supera o Claude Sonnet 4.6 |

| Taxa de Alucinação | 30% | Melhor que os pares |

Descoberta chave: O MiMo V2 Pro ocupa o 3º lugar global em tarefas de agente (ClawEval) — atrás apenas do Claude Opus 4.6 (66.3) e de outro modelo. Isso significa que ele tem um desempenho excelente em raciocínio de várias etapas, invocação de ferramentas e execução autônoma de tarefas.

Preço: 1/6 do preço para o mesmo desempenho

| Alcance de Contexto | Entrada (por milhão de tokens) | Saída (por milhão de tokens) |

|---|---|---|

| ≤ 256K | $1.00 | $3.00 |

| 256K – 1M | $2.00 | $6.00 |

Comparação de preços com concorrentes:

| Modelo | Entrada | Saída | Relativo ao MiMo V2 Pro |

|---|---|---|---|

| MiMo V2 Pro | $1.00 | $3.00 | Referência |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 5x mais caro |

| Claude Opus 4.6 | $15.00 | $75.00 | 25x mais caro |

| GPT-5.2 | ~$7.50 | ~$30.00 | 10x mais caro |

O MiMo V2 Pro supera a capacidade de codificação do Claude Sonnet 4.6, mas custa apenas 1/5 do preço. A capacidade de agente é próxima à do Claude Opus 4.6, mas custa apenas 1/25 do preço.

💡 Recomendação de custo-benefício: O MiMo V2 Pro é atualmente um dos modelos de baixo custo com a maior capacidade de inferência do mercado. Você pode invocá-lo diretamente através do serviço proxy de API APIYI (apiyi.com), sendo ideal para cenários de desenvolvimento sensíveis a custos, mas que exigem alta qualidade.

MiMo V2 Omni: Modelo de IA multimodal

O MiMo V2 Omni é o flagship multimodal da Xiaomi — um modelo que suporta nativamente texto, imagem, vídeo e áudio em uma arquitetura unificada.

Especificações principais

| Parâmetro | Detalhes |

|---|---|

| Nome do Modelo | MiMo V2 Omni |

| Data de Lançamento | 18-19 de março de 2026 |

| Janela de contexto | 256K tokens |

| Modalidades de entrada | Texto + Imagem + Vídeo + Áudio |

| Modalidades de saída | Texto |

| Processamento de áudio | Suporta 10+ horas de áudio contínuo (pioneiro na indústria) |

| Preço | Entrada $0.40/MTok · Saída $2.00/MTok |

Destaques das capacidades multimodais

1. Raciocínio visual supera o Claude Opus 4.6

Nos benchmarks MMMU-Pro (raciocínio visual multidisciplinar) e CharXiv RQ (análise de gráficos complexos), o MiMo V2 Omni superou o Claude Opus 4.6, aproximando-se do nível do Gemini 3.

2. Compreensão de 10 horas de áudio contínuo

Esta é uma capacidade pioneira na indústria — é possível processar mais de 10 horas de áudio contínuo em uma única solicitação, sem perda de qualidade. Cenários de aplicação:

- Análise e resumo completos de gravações de reuniões

- Extração de conteúdo de podcasts/entrevistas

- Compreensão de diálogos de voz de longa duração

- Análise conjunta de áudio e vídeo

3. Invocação nativa de ferramentas e localização de UI

O modelo Omni possui invocação de ferramentas estruturadas, execução de funções e capacidade de localização de elementos de interface (UI) integradas — podendo ser usado diretamente em frameworks de agentes de IA, sem necessidade de encapsulamento adicional.

4. Demonstração prática

A Xiaomi demonstrou um fluxo de trabalho completo do Omni na conferência:

O usuário fornece um requisito em uma frase

↓

Omni escreve o roteiro autonomamente

↓

Gravação de 4 cenas

↓

Edição, síntese de voz, correção de erros de renderização

↓

Upload e publicação de um vídeo curto de 15 segundos

Todo o processo é concluído de forma totalmente autônoma.

Preço: O melhor custo-benefício multimodal

| Item de cobrança | Preço |

|---|---|

| Entrada | $0.40 / milhão de tokens |

| Saída | $2.00 / milhão de tokens |

Este é um dos preços mais baixos entre os modelos multimodais atuais. Comparado ao Gemini 3.1 Pro ($2/$12) e ao Claude Opus 4.6 ($15/$75), a vantagem de preço do Omni é enorme.

🚀 Cenários de aplicação: Se sua aplicação precisa processar imagens, vídeos ou áudios de longa duração, o MiMo V2 Omni é uma escolha de excelente custo-benefício. Você pode invocá-lo diretamente através do serviço proxy de API APIYI (apiyi.com), com suporte ao formato padrão compatível com OpenAI.

title: "MiMo V2 Pro vs Modelos Globais: Uma Análise Comparativa"

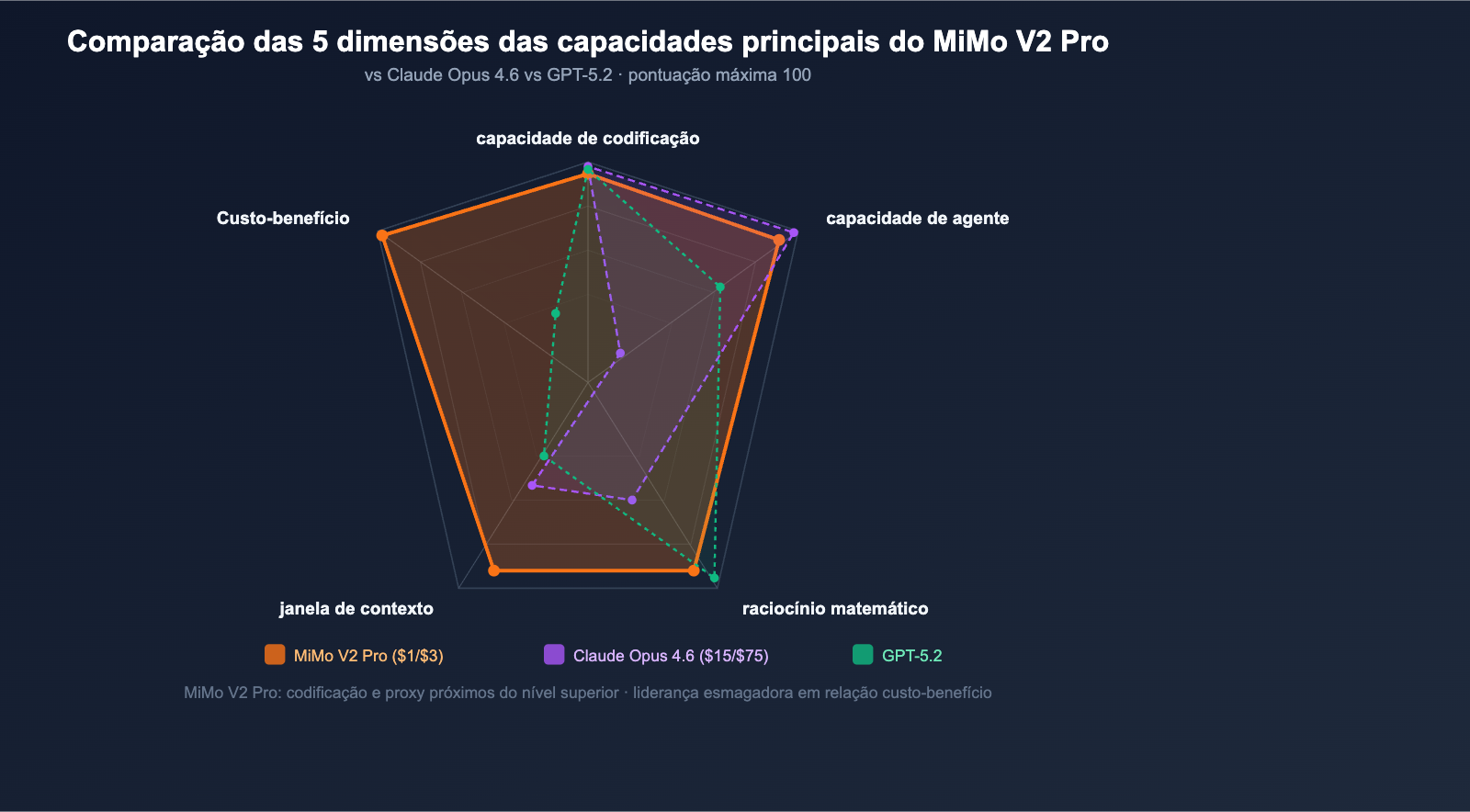

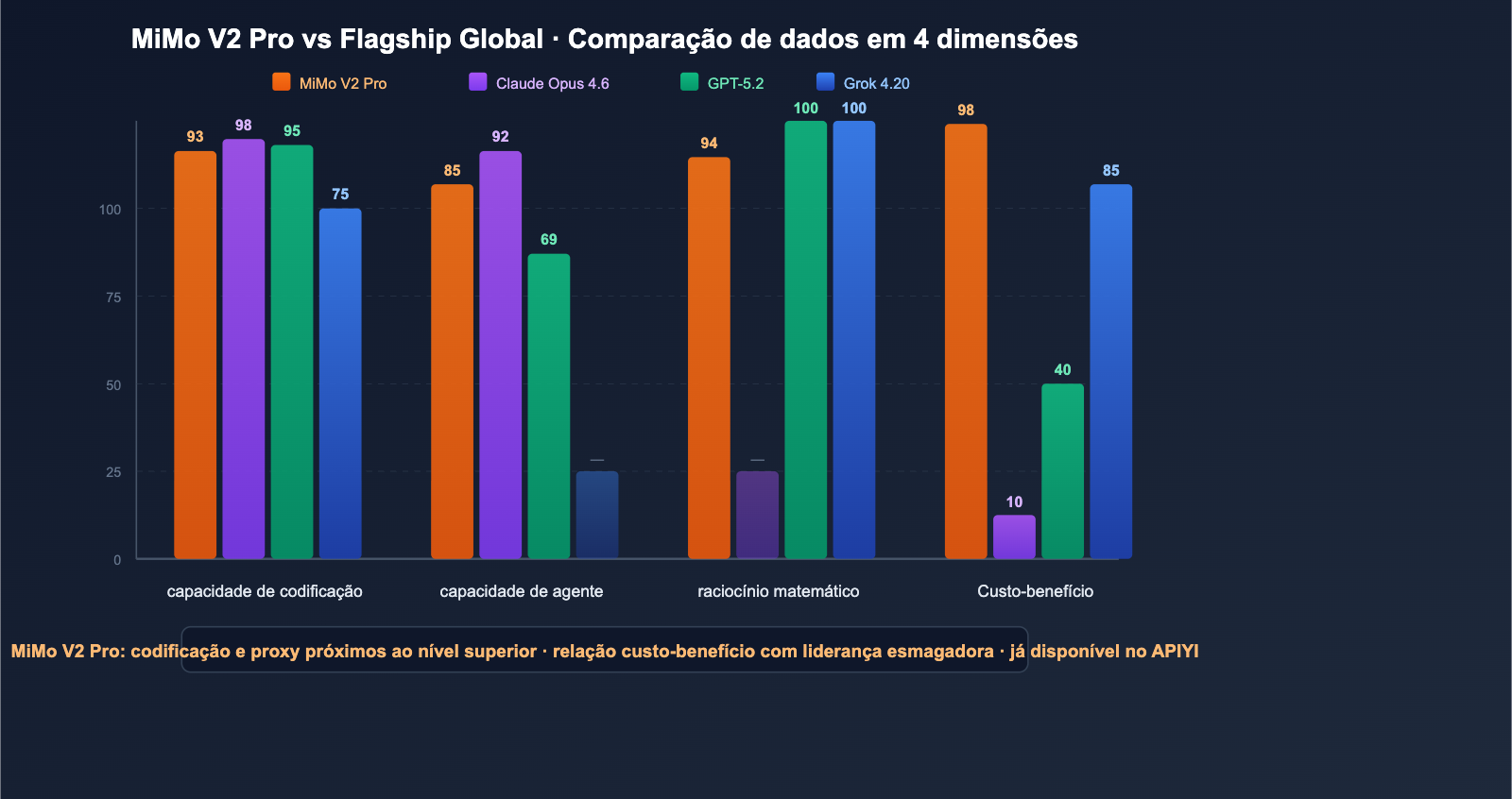

MiMo V2 Pro vs Comparativo de Modelos Globais

Comparação Multidimensional

| Dimensão | MiMo V2 Pro | Claude Opus 4.6 | GPT-5.2 | Grok 4.20 |

|---|---|---|---|---|

| Arquitetura | 1T MoE (42B ativo) | Fechada | Fechada | MoE Fechada |

| Precisão de Código | 92.5% | Mais forte (SWE 81.4%) | Forte (SWE ~80%) | SWE ~75% |

| Capacidade de Agente (ClawEval) | 61.5 (#3) | 66.3 (#1) | 50.0 | — |

| Matemática | 94.0% | — | AIME 100% | AIME 100% |

| Contexto | 1M | 1M | Varia por modelo | 2M |

| Preço de Entrada | $1.00 | $15.00 | ~$7.50 | $2.00 |

| Preço de Saída | $3.00 | $75.00 | ~$30.00 | $6.00 |

| Modo de Inferência | Tag <think> |

Raciocínio Adaptativo | Inferência estendida | Inferência/Não inferência |

| Multimodal | ❌ (Pro apenas texto) | ✅ | ✅ | ✅ Limitado |

Posicionamento do MiMo V2 Pro

Desempenho: Próximo ao Claude Opus 4.6 (diferença de apenas 5 pontos em agentes)

Preço: Cerca de 1/25 do Opus

↓

Posicionamento: "Opus para quem busca economia" / Rei do custo-benefício

Cenários ideais para o MiMo V2 Pro:

- Aplicações sensíveis a custos que exigem alto poder de raciocínio

- Tarefas de agente (raciocínio em várias etapas, chamadas de ferramentas)

- Geração e análise de grandes volumes de código

- Raciocínio matemático e lógico

- Cenários de texto puro que não exigem recursos multimodais

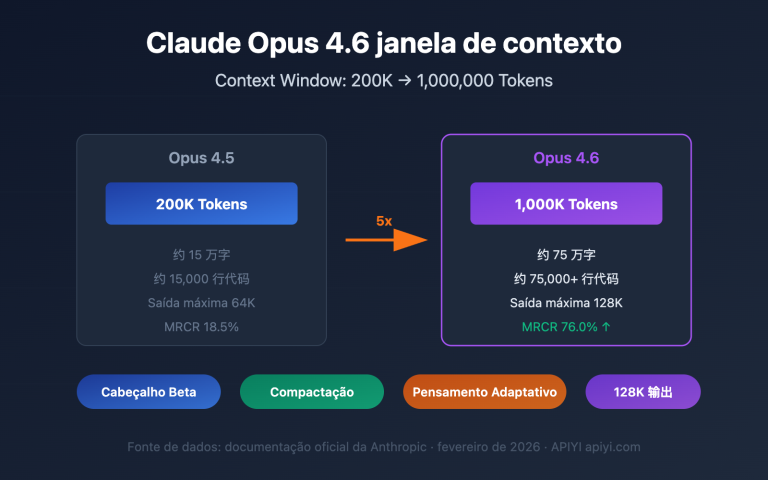

Cenários onde o Claude Opus 4.6 ainda é superior:

- Engenharia de software extremamente complexa (diferença de ~6 pontos no SWE-bench)

- Necessidade de saídas longas de 128K

- Requisitos de conformidade e segurança de nível empresarial

- Necessidade de raciocínio adaptativo (Adaptive Thinking)

💰 Dica de escolha: Para desenvolvimento diário e tarefas em lote, o MiMo V2 Pro ($1/$3) gera uma economia enorme. Para tarefas críticas de segurança e arquitetura, utilize o Claude Opus 4.6. Com o serviço proxy de API da APIYI (apiyi.com), você pode usar uma única chave API para acessar ambos e alternar conforme a necessidade.

Visão geral da família MiMo V2

A Xiaomi lançou de uma só vez 3 modelos, cobrindo desde cenários super leves até os de nível flagship.

| Modelo | Parâmetros | Posicionamento | Preço Entrada | Preço Saída | Open Source |

|---|---|---|---|---|---|

| MiMo V2 Flash | 309B (15B ativos) | Leve e veloz | $0,09 | $0,29 | ✅ MIT |

| MiMo V2 Pro | ~1T (42B ativos) | Flagship de raciocínio | $1,00 | $3,00 | ❌ API |

| MiMo V2 Omni | — | Multimodal | $0,40 | $2,00 | ❌ API |

Notas adicionais sobre o MiMo V2 Flash:

- Totalmente open source sob licença MIT, pesos disponíveis para download no HuggingFace

- SWE-bench Verified: 73,4% (o primeiro entre modelos open source)

- AIME 2025: 94,1%

- Velocidade de inferência: 150+ tokens/segundo

- Supera o DeepSeek-R1-0528 em 7 das 8 categorias de teste

🎯 Estratégia da família: Use o Flash para tarefas simples (preço ultrabaixo de $0,09/$0,29), o Pro para tarefas de raciocínio (melhor custo-benefício por $1/$3) e o Omni para tarefas multimodal ($0,40/$2,00). Você pode acessar todos os modelos MiMo V2 de forma unificada através da APIYI apiyi.com.

Prática de chamada de API

Chamando o MiMo V2 Pro

import openai

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://api.apiyi.com/v1" # Interface unificada da APIYI

)

response = client.chat.completions.create(

model="mimo-v2-pro",

messages=[

{"role": "system", "content": "Você é um engenheiro de software sênior, especialista em revisão de código e design de arquitetura."},

{"role": "user", "content": "Revise a segurança de concorrência do seguinte código Python..."}

],

max_tokens=8192

)

print(response.choices[0].message.content)

Chamando o MiMo V2 Omni (Multimodal)

# Exemplo de compreensão de imagem

response = client.chat.completions.create(

model="mimo-v2-omni",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Analise o fluxo de dados neste diagrama de arquitetura"},

{"type": "image_url", "image_url": {"url": "data:image/png;base64,..."}}

]

}

]

)

Ver código de teste comparativo: MiMo V2 Pro vs Claude Sonnet 4.6

import openai

import time

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://api.apiyi.com/v1"

)

models = ["mimo-v2-pro", "claude-sonnet-4-6"]

prompt = "Implemente em Python um cache LRU que suporte concorrência, garantindo segurança de thread"

for model in models:

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=4096

)

elapsed = time.time() - start

usage = response.usage

print(f"\n{'='*50}")

print(f"Modelo: {model}")

print(f"Tempo decorrido: {elapsed:.1f}s")

print(f"Token: Entrada {usage.prompt_tokens} / Saída {usage.completion_tokens}")

print(f"Prévia: {response.choices[0].message.content[:200]}...")

🚀 Experimente agora: Registre-se na APIYI apiyi.com para obter sua chave e começar a usar o MiMo V2 Pro e o Omni. Com uma única chave, você acessa mais de 200 modelos, incluindo Xiaomi, Claude, GPT e outros.

Perguntas Frequentes

Q1: O MiMo V2 Pro realmente tem um trilhão de parâmetros? Por que é tão barato?

Sim, o total de parâmetros é de cerca de 1 trilhão, mas ele utiliza uma arquitetura MoE (Mistura de Especialistas), onde apenas cerca de 42B de parâmetros são ativados por inferência. Isso significa que o custo de inferência é muito menor do que o de modelos densos com a mesma quantidade de parâmetros. Esta é a mesma rota tecnológica adotada por modelos como DeepSeek e Grok. Através da APIYI apiyi.com, você pode realizar a invocação do modelo de um trilhão de parâmetros por 1/3 do preço.

Q2: O MiMo V2 Pro pode substituir o Claude para revisão de código?

Em alguns cenários, sim. A precisão de codificação (92,5%) e a capacidade de agente (ClawEval 61,5) do MiMo V2 Pro são muito fortes. Para revisões de código diárias e análise de bugs, ele é uma escolha extremamente econômica. No entanto, para auditorias críticas de segurança e refatoração de arquiteturas de grande escala, o Claude Opus 4.6 ainda é mais confiável. Recomendamos acessar ambos os modelos simultaneamente via APIYI apiyi.com e alternar entre eles de forma flexível conforme a tarefa.

Q3: O processamento de 10 horas de áudio do MiMo V2 Omni é confiável?

A Xiaomi afirma que esta é uma capacidade pioneira no setor: suporte para compreensão de áudio contínuo de mais de 10 horas em uma única solicitação, sem degradação. É ideal para cenários de áudio de longa duração, como análise de gravações de reuniões e extração de conteúdo de podcasts. No entanto, como é um modelo recém-lançado, sugerimos testar e validar primeiro em tarefas não críticas. Você pode realizar testes com baixo custo ($0,40/$2,00) através da APIYI apiyi.com.

Q4: O MiMo V2 Pro será de código aberto?

A Xiaomi indicou que planeja abrir o código "quando o modelo estiver suficientemente estável". O MiMo V2 Flash, da mesma série, já foi disponibilizado como código aberto sob a licença MIT no HuggingFace. Considerando a postura positiva da Xiaomi em relação ao código aberto (o MiMo V1 também foi aberto), o código aberto do V2 Pro é apenas uma questão de tempo.

Q5: Como escolher entre MiMo V2 Pro, Flash e Omni?

Escolha de acordo com sua necessidade: para tarefas de inferência puramente de texto, escolha o Pro ($1/$3, a inferência mais poderosa); se precisar de um preço extremamente baixo ou implantação local, escolha o Flash ($0,09/$0,29, código aberto e auto-implantável); se precisar processar imagens/vídeos/áudio, escolha o Omni ($0,40/$2,00). Com a APIYI apiyi.com, você pode invocar todos os três modelos com uma única chave API.

Conclusão: A ambição da Xiaomi em IA não pode ser subestimada

O lançamento da série MiMo V2 marca a transição oficial da Xiaomi de uma "empresa de celulares fazendo IA" para uma "player global de IA de ponta". A estratégia de lançamento anônimo do Hunter Alpha foi uma aula de lançamento de produto: primeiro, deixe que os resultados falem por si, depois revele a identidade.

3 julgamentos principais:

- O MiMo V2 Pro é o modelo de inferência com a melhor relação custo-benefício atual: capacidade de agente em #3 no mundo, codificação superior ao Sonnet 4.6 e preço de apenas 1/25 do Opus.

- A capacidade multimodal do MiMo V2 Omni merece atenção: o processamento de 10 horas de áudio é uma vantagem diferencial real.

- A capacidade de execução da equipe de IA da Xiaomi é impressionante: menos de um ano do zero ao modelo de um trilhão de parâmetros, com a equipe principal vindo da DeepSeek.

Recomendamos experimentar toda a série MiMo V2 através da APIYI apiyi.com para obter uma capacidade de inferência de IA de nível superior pelo menor preço do mercado.

Referências

-

Página oficial do Xiaomi MiMo V2 Pro: Especificações técnicas e dados de benchmark

- Link:

mimo.xiaomi.com/mimo-v2-pro

- Link:

-

Artificial Analysis: Avaliação de benchmark do MiMo V2 Pro

- Link:

artificialanalysis.ai/models/mimo-v2-pro

- Link:

-

VentureBeat: Reportagem sobre o lançamento do Xiaomi MiMo V2 Pro

- Link:

venturebeat.com

- Link:

-

OpenRouter: Precificação e informações de API do modelo MiMo V2

- Link:

openrouter.ai

- Link:

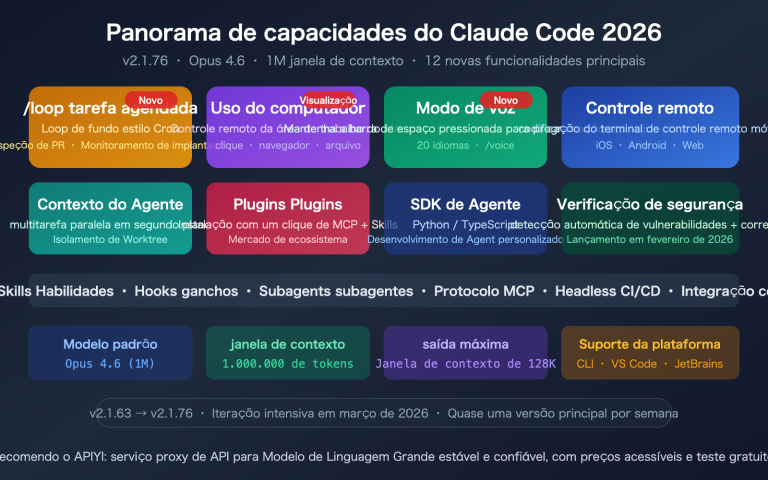

Autor: Equipe APIYI | Disponibilizamos os modelos de IA mais recentes em primeira mão. Acesse a APIYI em apiyi.com para experimentar toda a série de modelos Xiaomi MiMo V2.