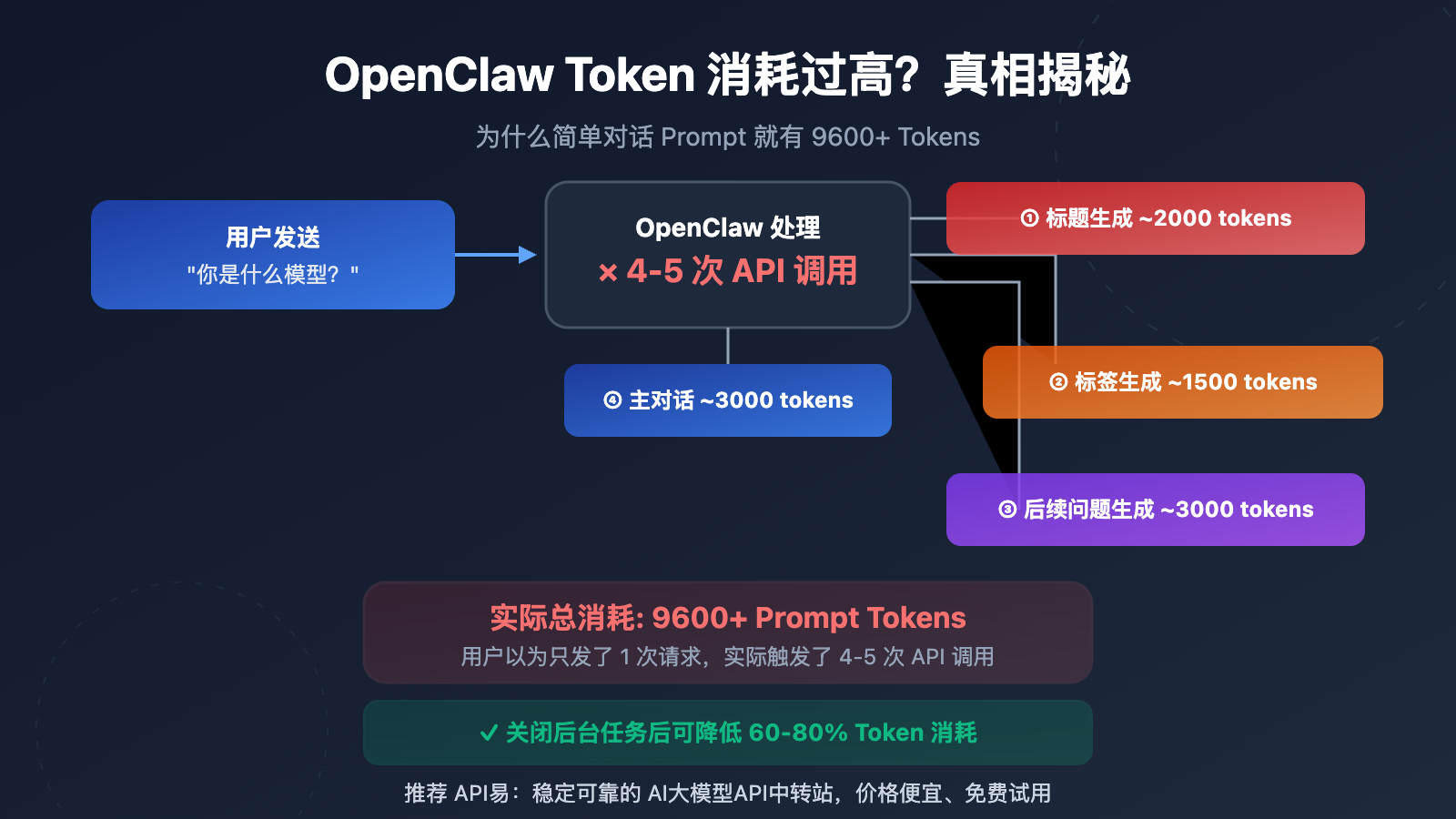

作者注:深入分析 OpenClaw(Open WebUI)Token 消耗异常高的 5 大原因,包括隐藏后台 API 调用、对话历史累积等,并提供可立即生效的优化配置方案

"我只是问了一句'你是什么模型',为什么 Prompt Token 就有 10000 多?" 这是很多 OpenClaw 用户的真实疑惑。本文将从技术层面解析 OpenClaw Token 消耗过高的根本原因,并提供 5 个可立即生效的优化方案。

核心价值: 读完本文,你将理解 OpenClaw 为什么 Token 消耗远超预期,并掌握将 Token 成本降低 60-80% 的具体配置方法。

OpenClaw Token 消耗 核心要点

| 要点 | 说明 | 影响程度 |

|---|---|---|

| 隐藏后台调用 | 每条消息触发 4-5 次独立 API 调用 | ⭐⭐⭐⭐⭐ 最高 |

| 对话历史累积 | 每轮对话重发全部历史消息 | ⭐⭐⭐⭐ 高 |

| 任务模型未分离 | 后台任务默认使用主模型 | ⭐⭐⭐⭐ 高 |

| 系统提示词注入 | 工具描述和 RAG 上下文自动注入 | ⭐⭐⭐ 中 |

| 系统提示词重复 Bug | Agentic 工具调用时系统提示词叠加 | ⭐⭐⭐ 中 |

OpenClaw Token 消耗高的根本原因

很多用户看到 API 用量统计时会震惊——明明只问了"你是什么模型"这样简单的问题,Prompt Token 却高达 9600-10000+。这并不是 API 提供商的计费问题,而是 OpenClaw(Open WebUI)的架构设计导致的。

核心原因在于:OpenClaw 在用户每发送一条消息时,会在后台自动触发多次独立的 API 调用。这些调用对用户完全不可见,但每一次都会消耗真实的 Token。

OpenClaw Token 消耗的 5 大来源详解

来源 1:自动标题生成(Title Generation)

用户发送第一条消息后,OpenClaw 会自动调用 API 生成一个 3-5 个字的对话标题。这个调用会发送用户的消息内容,消耗约 1500-2000 个 Prompt Token。

来源 2:自动标签生成(Tag Generation)

同时,OpenClaw 还会调用 API 为对话生成 1-3 个分类标签。这又是一次独立的 API 调用,消耗约 1000-1500 个 Prompt Token。

来源 3:后续问题建议(Follow-up Generation)

OpenClaw 默认会生成 3-5 个后续问题建议。这个调用使用 {{MESSAGES:END:6}} 模板,会拉取最近 6 条对话消息作为上下文,消耗约 2000-3000 个 Prompt Token。

来源 4:自动补全(Autocomplete Generation)

部分版本的 OpenClaw 还会启用输入自动补全功能,预测用户下一步可能输入的内容。

来源 5:主对话请求本身

最后才是用户实际看到的主对话请求,包含系统提示词、对话历史和用户输入。

OpenClaw Token 消耗 快速优化指南

极简配置:关闭后台任务

以下是最快速的优化方式——通过环境变量关闭不必要的后台 API 调用:

# 在 docker-compose.yml 中添加环境变量

environment:

- ENABLE_TITLE_GENERATION=false

- ENABLE_TAGS_GENERATION=false

- ENABLE_FOLLOW_UP_GENERATION=false

- ENABLE_AUTOCOMPLETE_GENERATION=false

查看通过管理面板配置的完整步骤

如果你不方便修改环境变量,也可以通过 OpenClaw 的管理面板进行配置:

- 登录 OpenClaw 管理后台

- 进入 Settings → Tasks

- 逐个关闭以下选项:

- Title Generation → 关闭

- Tags Generation → 关闭

- Follow-up Generation → 关闭

- Autocomplete Generation → 关闭

- 如果不想完全关闭,可以设置 Task Model 为廉价模型(如

gpt-4o-mini) - 保存设置并刷新页面

# 方案二:不关闭功能,但使用廉价模型处理后台任务

environment:

- TASK_MODEL_EXTERNAL=gpt-4o-mini

这样后台任务仍然可以正常运行(标题、标签、后续问题都会自动生成),但使用的是价格更低的模型,而不是你选择的主聊天模型。

🎯 优化建议: 关闭后台任务是降低 OpenClaw Token 消耗最直接的方法。如果你通过 API易 apiyi.com 使用 API,这些优化可以显著降低你的使用成本。API易 提供统一的多模型接口,方便你设置不同的 Task Model。

OpenClaw Token 消耗 实际数据分析

以下是用户反馈的真实 Token 消耗数据,可以清晰看到问题的严重程度:

| 使用场景 | 预期 Token 消耗 | 实际 Token 消耗 | 倍率 |

|---|---|---|---|

| 简单问答"你是什么模型" | ~200 | 9,600-10,269 | 50x |

| 5 轮日常对话 | ~3,000 | ~45,000 | 15x |

| 30 轮编程对话 | ~12,000 | 1,860,000 | 155x |

| 上传文档后对话 | ~5,000 | 600,000+ | 120x |

上表中的数据来源于 Open WebUI GitHub 社区的真实用户反馈。其中 30 轮编程对话达到 155 倍的极端情况,主要是因为后续问题生成模板 {{MESSAGES:END:6}} 会拉取最近 6 条消息,而编程对话中单条消息往往包含大量代码。

OpenClaw Token 消耗的对话轮次累积效应

| 对话轮次 | 默认设置消耗 | 优化后消耗 | 节省比例 |

|---|---|---|---|

| 第 1 轮 | ~10,000 | ~3,000 | 70% |

| 第 5 轮 | ~50,000 | ~15,000 | 70% |

| 第 10 轮 | ~150,000 | ~45,000 | 70% |

| 第 20 轮 | ~500,000 | ~150,000 | 70% |

| 第 30 轮 | ~1,200,000 | ~360,000 | 70% |

随着对话轮次增加,Token 消耗呈指数级增长。这是因为每一轮对话都会重新发送完整的对话历史。在默认设置下,这个历史不仅在主对话中发送一次,还会在标题生成、标签生成、后续问题生成中各发送一次。

🎯 成本控制建议: 长对话场景下,Token 消耗增长尤为惊人。我们建议通过 API易 apiyi.com 进行 API 调用,平台提供详细的用量统计面板,方便你监控和优化 Token 消耗。

OpenClaw Token 消耗 优化方案对比

| 优化方案 | 操作难度 | Token 节省 | 功能影响 | 推荐度 |

|---|---|---|---|---|

| 关闭后续问题生成 | 简单 | ~30% | 不再显示建议问题 | ⭐⭐⭐⭐⭐ |

| 设置廉价任务模型 | 简单 | 任务成本降 90% | 功能完全保留 | ⭐⭐⭐⭐⭐ |

| 关闭标题/标签生成 | 简单 | ~25% | 需手动命名对话 | ⭐⭐⭐⭐ |

| RAG 移至系统提示词 | 中等 | 启用缓存 | 无负面影响 | ⭐⭐⭐⭐ |

| 上下文长度过滤器 | 中等 | 控制长对话成本 | 可能丢失早期上下文 | ⭐⭐⭐ |

🎯 最佳实践: 如果你不想损失任何功能,方案 2(设置廉价任务模型)是最优选择——后台任务继续运行,但使用

gpt-4o-mini等低成本模型。通过 API易 apiyi.com 可以方便地管理多个模型的 API Key,一个 Key 即可调用所有主流模型。

常见问题

Q1: OpenClaw Token 消耗为什么和 ChatGPT 官方差这么多?

ChatGPT 官方是订阅制,不按 Token 计费,你感知不到 Token 消耗。而 OpenClaw 通过 API 调用,每个 Token 都会计费。加上 OpenClaw 的后台任务默认开启,实际消耗是用户可见请求的 3-5 倍。

Q2: 关闭后台任务后 OpenClaw Token 消耗会恢复正常吗?

是的。关闭标题生成、标签生成、后续问题生成和自动补全后,每条消息只会触发一次 API 调用(主对话),Token 消耗会降低 60-80%。如果还想保留这些功能,可以通过 API易 apiyi.com 平台设置一个廉价模型(如 gpt-4o-mini)专门处理这些后台任务。

Q3: 如何监控 OpenClaw Token 的实际消耗?

推荐以下方式监控 Token 消耗:

- 通过 API易 apiyi.com 的用量统计面板查看每次 API 调用的详细 Token 数据

- 在 OpenClaw 管理面板的 Usage 页面查看统计

- 关注 Prompt Token 和 Completion Token 的比例——如果 Prompt 远大于 Completion,说明后台任务消耗过多

总结

OpenClaw Token 消耗过高的核心要点:

- 隐藏后台调用是主因: 每条消息触发 4-5 次独立 API 调用,用户只看到 1 次

- 设置廉价任务模型是最优解:

TASK_MODEL_EXTERNAL=gpt-4o-mini可在保留功能的同时降低 90% 的后台任务成本 - 长对话要特别注意: 对话历史在每次调用中都会重发,30 轮对话可达 100 万+ Token

掌握这些优化技巧后,你可以将 OpenClaw 的 Token 成本降低 60-80%,让 API 使用更加经济高效。

推荐通过 API易 apiyi.com 管理你的 API 调用,平台提供统一接口和详细用量统计,帮助你精准控制 Token 消耗和成本。

📚 参考资料

-

Open WebUI Token 消耗讨论: GitHub 社区关于高 Token 消耗的讨论

- 链接:

github.com/open-webui/open-webui/discussions/7281 - 说明: 多位用户分享了实际 Token 消耗数据和优化经验

- 链接:

-

Open WebUI 环境变量配置文档: 官方环境变量配置参考

- 链接:

docs.openwebui.com/reference/env-configuration - 说明: 包含所有可配置的环境变量及默认值

- 链接:

-

Follow-up Generation Token 消耗问题: 后续问题生成消耗完整上下文

- 链接:

github.com/open-webui/open-webui/issues/15081 - 说明: 详细分析了后续问题生成模板如何消耗大量 Token

- 链接:

-

系统提示词重复 Bug: Agentic 工具调用导致系统提示词叠加

- 链接:

github.com/open-webui/open-webui/issues/19169 - 说明: 使用工具调用功能时需要特别注意的已知问题

- 链接:

作者: APIYI 技术团队

技术交流: 欢迎在评论区讨论,更多资料可访问 API易 docs.apiyi.com 文档中心