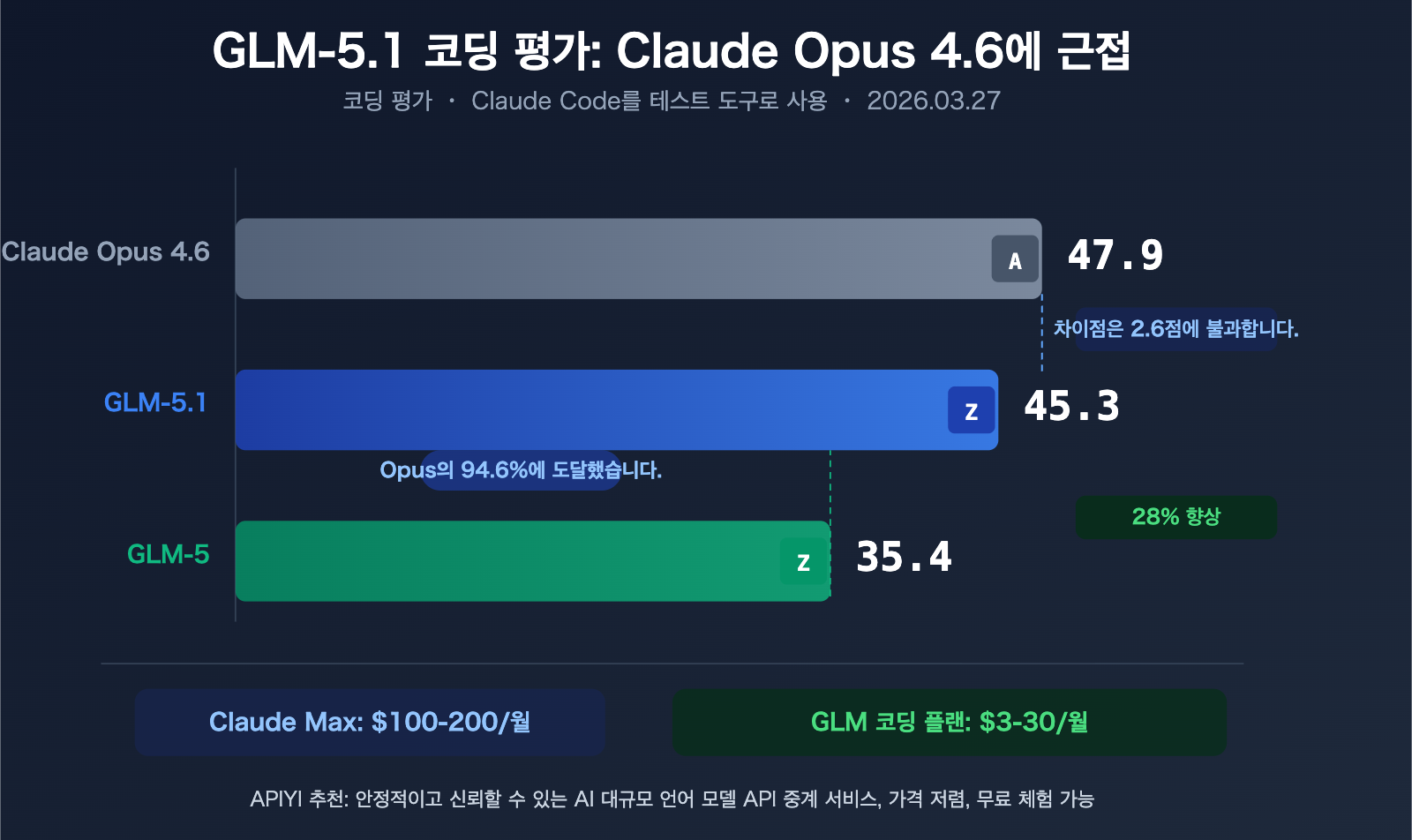

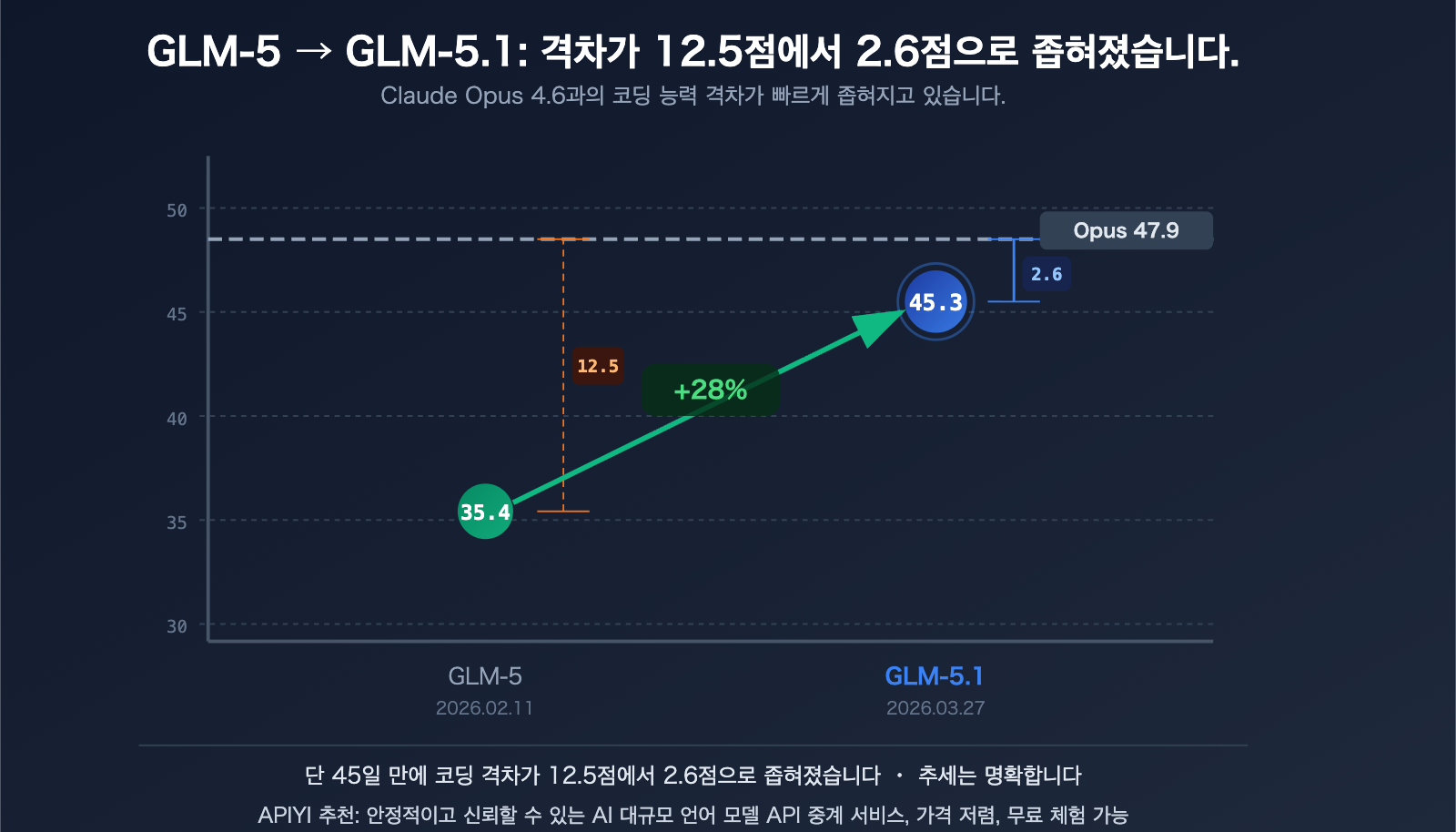

2026년 3월 27일, Z.ai(구 지푸 AI)가 공식 발표했습니다: GLM-5.1이 정식 출시되었으며, 모든 GLM 코딩 플랜 사용자가 이용할 수 있습니다. Claude Code를 테스트 도구로 사용한 코딩 평가에서 GLM-5.1은 45.3점을 기록했습니다. 이는 Claude Opus 4.6의 47.9점보다 단 2.6점 낮은 수치로, Opus 성능의 94.6% 수준에 도달했음을 의미합니다.

더 놀라운 점은 GLM-5.1이 이전 세대 GLM-5의 35.4점보다 28% 향상되었다는 사실입니다. 이는 엄청난 세대 간 도약입니다.

그리고 이 모든 것을 이용할 수 있는 가격은 얼마일까요? GLM 코딩 플랜은 월 최저 3달러(프로모션 가격)부터 시작하며, 정식 가격도 월 10달러부터입니다.

핵심 가치: 이 글에서는 GLM-5.1의 코딩 능력 향상, 코딩 플랜의 패키지 상세 및 사용 방법, 그리고 Claude의 공식 가격이 높거나 컴퓨팅 성능이 가끔 불안정할 때 고성능 대안으로서의 실질적 가치를 분석합니다. API가 출시되면 APIYI도 최대한 빨리 연동할 예정입니다.

핵심 데이터: Claude Code를 테스트 도구로 사용

Z.ai 공식이 발표한 코딩 평가(Coding Evaluation)는 Claude Code를 테스트 프레임워크로 사용했는데요, 이는 주목할 만한 세부사항입니다. GLM-5.1이 Claude 자체의 테스트 환경에서 Opus에 근접한 실력을 보여줬다는 뜻이니까요.

| 모델 | 코딩 평가 점수 | Opus 대비 격차 | GLM-5 대비 향상 |

|---|---|---|---|

| Claude Opus 4.6 | 47.9 | — | — |

| GLM-5.1 | 45.3 | -2.6 (94.6%) | +28% |

| GLM-5 | 35.4 | -12.5 (73.9%) | 기준 |

세 가지 핵심 발견점입니다:

1. GLM-5.1은 Claude Opus 4.6의 94.6%에 달했습니다

2.6점 차이는 실제 코딩 시나리오에서 대부분의 작업에 대해 거의 무시할 수 있을 정도입니다. 이는 일상적인 코딩 보조 작업에서 GLM-5.1의 경험이 이미 Opus에 매우 근접했음을 의미합니다.

2. GLM-5 → GLM-5.1의 도약 폭이 놀랍습니다

35.4에서 45.3으로, 28% 향상되었습니다. GLM-5가 2026년 2월에야 출시되었고(SWE-bench Verified 점수 77.8%, 이미 오픈소스 모델 중 선두 수준), 불과 한 달여 만에 이렇게 큰 반복을 이루었다는 점에서 Z.ai의 엔지니어링 역량이 인상적입니다.

3. 테스트 환경의 공정성

Claude Code를 테스트 프레임워크로 사용했다는 것은 이 평가가 Claude 모델에 본질적으로 일정한 이점(Claude Code는 Claude 시리즈에 최적화된 도구)이 있음을 의미합니다. GLM-5.1이 '원정 경기'에서 94.6%의 성적을 거둔 것은 실제 능력이 더 뛰어날 수 있음을 시사합니다.

GLM-5 대비 GLM-5.1의 기술적 개선 사항

GLM-5.1의 완전한 기술 보고서는 아직 공개되지 않았지만, GLM-5의 기반과 알려진 정보를 바탕으로 추측해 볼 수 있습니다:

| 기술 차원 | GLM-5 | GLM-5.1 (알려진/추측) |

|---|---|---|

| 총 파라미터 | 7440억 | 미공개 (예상 ≥GLM-5) |

| 활성화 파라미터 | 400억 | 미공개 |

| 아키텍처 | MoE | MoE (개선 추측) |

| 컨텍스트 | 200K 토큰 | 미공개 (예상 ≥200K) |

| 학습 데이터 | 28.5T 토큰 | 미공개 (예상 더 많음) |

| 라이선스 | MIT 오픈소스 | 오픈소스 확정 |

| 코딩 평가 | 35.4 | 45.3 (+28%) |

Z.ai의 글로벌 책임자 리쯔쉬안(李子轩)은 3월 20일 트윗을 통해 확인했습니다: "Don't panic. GLM-5.1 will be open source." — 이는 GLM-5.1의 모델 가중치가 결국 GLM-5처럼 MIT 라이선스로 공개될 것임을 의미합니다.

🎯 업계 시각: GLM-5.1의 오픈소스 약속은 매우 중요합니다. 이는 제3자 추론 플랫폼(APIYI apiyi.com 포함)이 API가 정식 출시된 후 빠르게 연동할 수 있고, 공식보다 더 낮은 가격으로 서비스를 제공할 수도 있음을 의미합니다.

GLM 코딩 플랜 상세 분석: 3달러부터 시작하는 코딩 AI 솔루션

GLM 코딩 플랜은 Z.ai에서 출시한 구독제 코딩 AI 서비스로, 핵심 장점은 Claude보다 훨씬 저렴한 가격으로 Claude에 가까운 코딩 경험을 제공한다는 점입니다.

세 가지 플랜 비교

| 플랜 | 월 정기 요금 (정가) | 프로모션 가격 | 5시간당 요청 수 | 월간 검색 횟수 |

|---|---|---|---|---|

| Lite | $10/월 | 첫 달 $3 | 120 | 100 |

| Pro | $30/월 | 첫 달 $15 | 600 | 1,000 |

| Max | 더 높음 | — | 더 많음 | 4,000 |

코딩 플랜이 지원하는 모델과 도구

포함 모델:

- GLM-5.1 (최신, 코딩 벤치마크 45.3)

- GLM-5 (코딩 벤치마크 35.4)

- GLM-5-Turbo (더 빠른 버전)

- GLM-4.7

호환되는 코딩 도구:

- Claude Code (API 호환 레이어 통해)

- Cline

- Kilo Code

- OpenCode

- Clawdbot / OpenClaw

추가 기능:

- 시각 이해 (Vision Understanding)

- Web Search MCP

- Web Reader MCP

- Zread MCP

- 55+ 토큰/초 생성 속도

- 네트워크 제한 없음, 계정 정지 위험 없음

코딩 플랜 vs Claude 공식 구독 비용 비교

가장 직관적인 가성비 비교입니다:

| 비교 항목 | GLM 코딩 Lite | GLM 코딩 Pro | Claude Pro | Claude Max |

|---|---|---|---|---|

| 월 요금 | $10 (프로모션 $3) | $30 (프로모션 $15) | $20 | $100-200 |

| 코딩 능력 | 45.3 (GLM-5.1) | 45.3 (GLM-5.1) | Sonnet 수준 | Opus 수준 (47.9) |

| Opus 대비 비율 | 94.6% | 94.6% | ~80% | 100% |

| 비용/성능 비율 | 매우 높음 | 높음 | 중간 | 중하 |

Medium에서 한 개발자가 공유한 내용입니다: "GLM 코딩 플랜 덕분에 월 30달러로 Claude Max 사용량의 3배를 얻었어요." — 이 평가는 주관적일 수 있지만, 커뮤니티의 실제 경험을 반영합니다.

💰 비용 계산: 만약 매달 Claude API에 30달러 이상을 지출하고, 주로 코딩 작업에 사용한다면 GLM 코딩 Pro 플랜을 진지하게 고려해볼 가치가 있습니다. 월 30달러로 Opus 코딩 능력의 94.6%에 달하는 모델을 얻을 수 있다는 점은 확실히 가성비가 높습니다.

우리의 관점: Claude 연산 자원 불안정 시의 고성능 대안

API 중계 플랫폼으로서, APIYI는 일상 운영에서 하나의 실제 문제점을 관찰했습니다: Claude 공식 서비스의 연산 자원이 가끔 불안정하다는 점입니다. 특히 피크 시간대에는 Opus 4.6의 응답 지연이 증가하고, 요청 대기 시간이 길어져 개발자의 작업 효율에 영향을 미칩니다.

왜 GLM 코딩 플랜이 좋은 대안이라고 할 수 있을까요?

이유 1: 코딩 능력이 이미 충분히 가깝습니다

45.3 vs 47.9, 2.6점 차이는 일상적인 코딩에서 거의 느껴지지 않습니다. 극도로 복잡한 코드 아키텍처 설계나 심층 추론 작업을 처리하지 않는 한, GLM-5.1은 완벽히 충분합니다.

이유 2: 가격 차이가 큽니다

Claude Max는 월 $100-200인 반면, GLM 코딩 Pro는 단 $30입니다. 절약한 비용을 진짜로 Opus가 필요한 상황(API를 통해 필요할 때마다 호출)에 사용한다면, 총 비용은 더 낮아질 수 있습니다.

이유 3: 연산 자원 불안정에 대한 걱정이 없습니다

GLM 코딩 플랜은 네트워크 제한 없음과 계정 정지 위험 없음을 약속합니다. Z.ai 자체도 2월 말 연산 자원이 부족한 상황을 겪었지만, 구독제 모델의 용량 관리가 상대적으로 더 예측 가능합니다.

이유 4: 도구 호환성이 좋습니다

Claude Code와 직접 호환됩니다 — 코딩 도구를 바꿀 필요 없이, API 엔드포인트만 변경하면 Claude에서 GLM으로 전환할 수 있습니다. 이미 Claude Code 워크플로에 익숙한 개발자에게는 이전 비용이 거의 제로입니다.

언제 Claude를 계속 사용해야 할까요?

GLM-5.1은 좋은 대안이지만, 모든 시나리오에서 최적의 해결책은 아닙니다:

- 100만 토큰 컨텍스트 윈도우가 필요할 때: Claude Opus 4.6은 100만 토큰을 지원하지만, GLM-5 시리즈는 20만 토큰입니다.

- 극한의 추론 깊이가 필요할 때: Opus는 심층 추론과 복잡한 분석에서 여전히 우위를 가집니다.

- 멀티모달 출력이 필요할 때: Claude의 이미지 이해와 장문 생성이 특정 시나리오에서 더 강력합니다.

- 기업 규정 준수 요구사항: 일부 기업은 모델 공급업체에 특정 요구사항을 가지고 있습니다.

🎯 추천 전략: GLM 코딩 플랜을 일상 코딩의 주력으로 사용하고, 복잡한 작업 처리를 위해 Claude Opus를 APIYI apiyi.com을 통해 필요할 때마다 호출하세요. 이렇게 "GLM 일상 + Claude 중포" 조합은 효과를 보장하면서 총 비용을 크게 낮출 수 있습니다.

GLM-5.1 API 접속: 현재 상태와 준비 사항

현재 상태

2026년 3월 27일 기준, GLM-5.1의 상태는 다음과 같습니다:

| 채널 | 상태 | 설명 |

|---|---|---|

| GLM Coding Plan (z.ai) | ✅ 출시됨 | 모든 Coding Plan 사용자 사용 가능 |

| Z.ai 공식 API | ⏳ 아직 출시 전 | 공식 오픈 대기 중 |

| APIYI apiyi.com | ⏳ 접속 대기 중 | API 출시 즉시 지원 예정 |

| 오픈소스 가중치 | ⏳ 오픈소스 약속 | 구체적인 일정 미정 |

지금 준비할 수 있는 방법

방법 1: GLM Coding Plan 직접 사용하기

z.ai/subscribe로 이동하여 Coding Plan을 구독하면 Claude Code에서 GLM-5.1을 사용할 수 있습니다.

방법 2: API를 통해 GLM-5 호출하기 (현재 사용 가능)

GLM-5의 API는 이미 사용 가능하며, 가격은 입력 $1.00/M 토큰, 출력 $3.20/M 토큰입니다. 코딩 평가 점수(35.4)는 GLM-5.1(45.3)보다 낮지만, 다른 작업에서는 여전히 강력한 성능(SWE-bench Verified 77.8%)을 보입니다.

import openai

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스

)

# 현재 사용 가능: GLM-5

response = client.chat.completions.create(

model="glm-5",

messages=[

{"role": "user", "content": "이 Python 코드의 성능을 최적화해줘"}

]

)

# GLM-5.1 API 출시 후 전환

# model="glm-5.1"

print(response.choices[0].message.content)

전체 코드 보기 (GLM + Claude 혼합 호출 전략 포함)

import openai

import time

# APIYI 통합 인터페이스를 통해 여러 모델 호출

client = openai.OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# 모델 선택 전략: 간단한 작업은 GLM, 복잡한 작업은 Claude

def smart_route(prompt, complexity="normal"):

"""

작업 복잡도에 따라 모델 자동 선택

- simple: GLM-5 (가장 저렴)

- normal: GLM-5.1 (출시 후 전환)

- complex: Claude Opus 4.6 (가장 강력한 추론)

"""

model_map = {

"simple": "glm-5",

"normal": "glm-5", # GLM-5.1 출시 후 "glm-5.1"로 변경

"complex": "claude-opus-4-6"

}

model = model_map.get(complexity, "glm-5")

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=2000,

temperature=0.7

)

elapsed = time.time() - start

return {

"model": model,

"content": response.choices[0].message.content,

"time": f"{elapsed:.2f}s",

"tokens": response.usage.total_tokens

}

# 예시: 일상 코딩은 GLM, 심층 추론은 Claude

tasks = [

("퀵 정렬의 Python 구현 작성해줘", "simple"),

("이 마이크로서비스의 데이터베이스 연결 풀 리팩터링", "normal"),

("분산 트랜잭션의 보상 메커니즘 설계", "complex"),

]

for prompt, complexity in tasks:

result = smart_route(prompt, complexity)

print(f"[{complexity}] 모델: {result['model']}")

print(f" 소요 시간: {result['time']} | Tokens: {result['tokens']}")

print(f" 응답: {result['content'][:100]}...\n")

🚀 빠른 시작: APIYI apiyi.com은 현재 GLM-5 API 호출을 지원합니다. GLM-5.1 API가 공식 출시되면, APIYI는 즉시 접속할 예정입니다. 등록하면 무료 크레딧을 제공하며, Claude, GPT, Gemini, GLM 등 여러 모델의 통합 호출을 지원합니다.

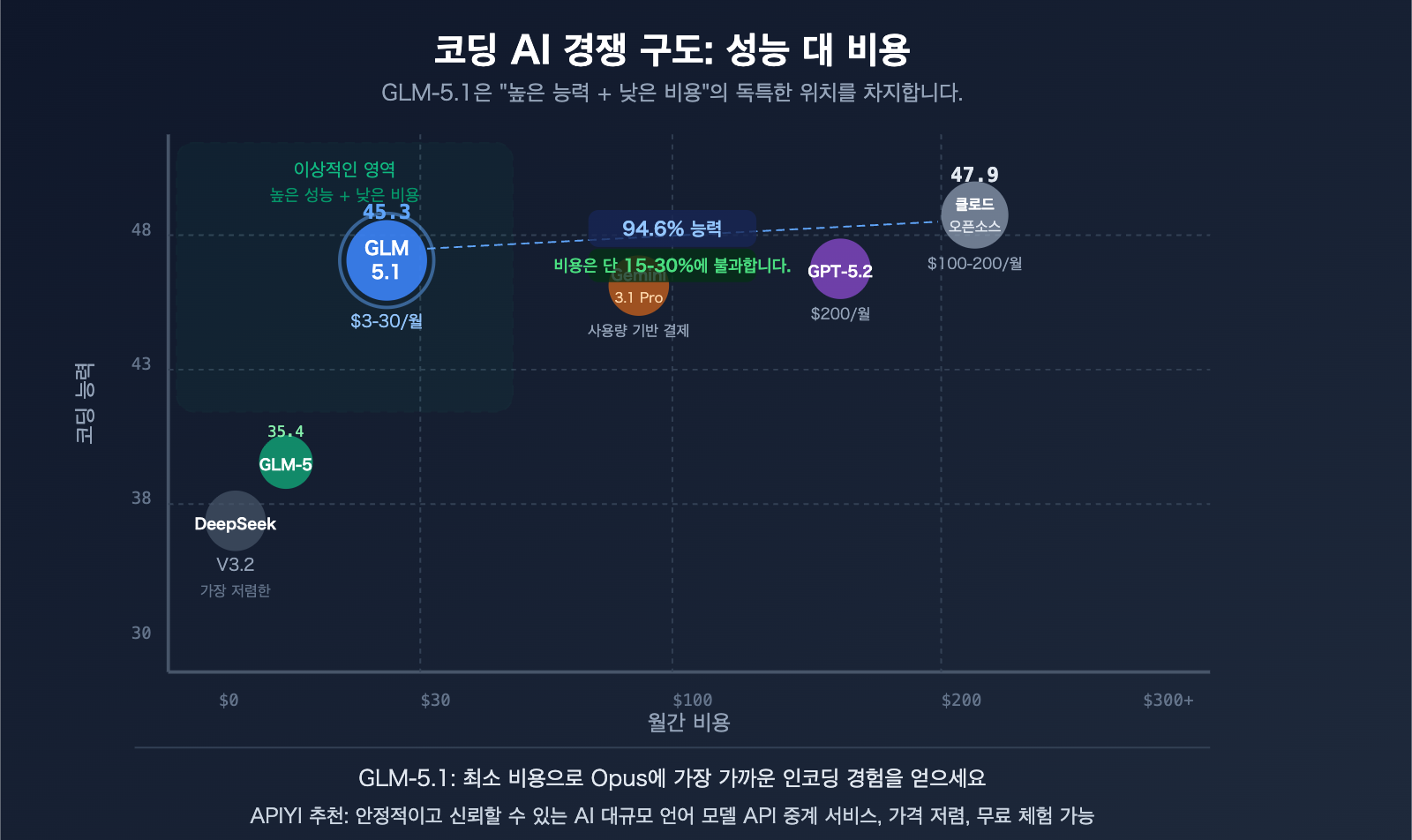

GLM-5.1과 다른 코딩 AI의 경쟁 구도

GLM-5.1의 출시로 코딩 AI의 경쟁 구도가 더욱 흥미로워졌습니다:

| 모델 | 코딩 능력 포지셔닝 | 가격 포지셔닝 | API 상태 | 오픈소스 상태 |

|---|---|---|---|---|

| Claude Opus 4.6 | 최강 (47.9) | 최고 | 공개됨 | 클로즈드 소스 |

| GLM-5.1 | Opus에 근접 (45.3) | 저렴 ($3-30/월) | Coding Plan 사용 가능 | 오픈소스 예정 |

| Gemini 3.1 Pro | 강력함 (다수 벤치마크 1위) | 중간 | Preview 사용 가능 | 클로즈드 소스 |

| GPT-5.2 | 강력함 | 높음 | 공개됨 | 클로즈드 소스 |

| DeepSeek V3.2 | 중간 | 최저 | 공개됨 | 오픈소스 |

| GLM-5 | 중상 (35.4) | 저렴 | 공개됨 | MIT 오픈소스 |

GLM-5.1의 독특한 포지션은 다음과 같습니다: 오픈소스 모델의 투명성과 구독제의 저렴한 가격으로, 클로즈드 소스 플래그십 모델에 근접한 코딩 능력을 제공합니다. 이는 이전에는 전례가 없었던 일입니다—오픈소스 모델이 코딩 능력에서 클로즈드 소스 최고 수준에 이렇게 근접한 것은 처음입니다.

자주 묻는 질문

Q1: GLM-5.1 API는 언제 출시되나요?

현재 정확한 출시 날짜는 없습니다. GLM-5.1은 Coding Plan에서 사용할 수 있지만, 독립적인 API 인터페이스는 아직 공개되지 않았습니다. GLM-5가 출시된 후 API가 공개되기까지 걸린 시간을 참고하면, GLM-5.1 API는 몇 주 내에 출시될 수 있습니다. APIYI apiyi.com은 API가 정식으로 공개되는 즉시 연동할 예정이며, 그때부터 통합 인터페이스를 통해 GLM-5.1을 직접 호출할 수 있습니다.

Q2: GLM Coding Plan은 Claude Code에서 어떻게 사용하나요?

Z.ai의 API는 Anthropic API 형식과 호환되므로, Claude Code는 API 엔드포인트를 변경하여 요청을 Z.ai로 라우팅할 수 있습니다. 구체적인 단계는 Claude Code 설정에서 API 엔드포인트를 Anthropic 공식 엔드포인트에서 Z.ai가 제공하는 엔드포인트로 변경하는 것이며, 다른 설정은 수정할 필요가 없습니다. 자세한 구성은 Z.ai 개발자 문서를 참조하세요: docs.z.ai.

Q3: GLM-5.1이 Claude Opus 4.6를 완전히 대체할 수 있나요?

코딩 작업에서는 GLM-5.1(45.3점)이 이미 Opus(47.9점)에 매우 근접하여, 일상적인 코딩 시나리오에서는 거의 차이를 느끼기 어렵습니다. 그러나 다음과 같은 시나리오에서는 Opus가 여전히 뚜렷한 우위를 가집니다: 1M 토큰 초장기 컨텍스트, 극한의 심층 추론, 복잡한 다단계 에이전트 워크플로우. 저희가 권장하는 전략은 "일상은 GLM + 무거운 작업은 Claude"입니다. 즉, 일상적인 코딩에는 비용 절감을 위해 GLM을 사용하고, 복잡한 작업은 필요할 때 APIYI apiyi.com을 통해 Opus를 호출하는 방식입니다.

요약: GLM-5.1이 코딩 AI의 가성비 판도를 바꾸다

GLM-5.1의 출시는 2026년 코딩 AI 분야의 중요한 이정표입니다. 오픈소스(곧 오픈소스화 예정) 모델이 코딩 벤치마크에서 Claude Opus 4.6의 94.6%에 도달한 것은 처음이며, 가격은 Opus의 몇 분의 일 수준입니다.

핵심 포인트 3가지:

- 코딩 능력이 천장에 근접: 45.3점 대 47.9점, 격차는 단 2.6점, 일상 코딩에서는 거의 체감 불가

- 가격 우위가 압도적: Coding Plan 월 $3-30 vs Claude Max 월 $100-200

- API 출시 임박: APIYI가 GLM-5.1 API를 최초로 연동하여 통합 인터페이스로 호출 가능

Claude 공식 가격이 높고, 가끔 연산 자원이 불안정한 현재 상황에서, GLM Coding Plan은 이미 신뢰할 수 있는 고성능 대안임을 입증했습니다. Coding Plan 구독제를 선택하든, API 종량제 호출을 기다리든, GLM-5.1은 여러분의 코딩 AI 도구 상자에 포함할 가치가 충분합니다.

작성: APIYI Team | GLM-5.1 API 출시 후, APIYI apiyi.com이 최초로 지원할 예정입니다. 무료 테스트 크레딧을 받아 Claude + GLM + GPT + Gemini 멀티모델 통합 호출을 경험해 보세요.

📚 참고 자료

-

Z.ai 공식 발표: GLM-5.1 출시 및 Coding Plan

- 링크:

z.ai/subscribe - 설명: GLM Coding Plan을 구독하고 GLM-5.1을 사용하세요

- 링크:

-

Z.ai 공식 블로그: GLM-5 기술 소개

- 링크:

z.ai/blog/glm-5 - 설명: GLM-5의 아키텍처, 학습 데이터, 벤치마크 상세 정보

- 링크:

-

Z.ai 개발자 문서: API 연동 및 가격 정책

- 링크:

docs.z.ai/guides/overview/pricing - 설명: 모델 가격, API 호출 규칙, 도구 통합 가이드

- 링크:

-

Artificial Analysis: GLM-5 독립 평가

- 링크:

artificialanalysis.ai/models/glm-5 - 설명: 제3자 벤치마크 데이터 및 모델 비교

- 링크:

-

GLM-5 GitHub 저장소: 오픈소스 모델 가중치

- 링크:

github.com/zai-org/GLM-5 - 설명: MIT 라이선스로 오픈소스 제공, 모델 가중치 및 사용 가이드 포함

- 링크: