작성자 주: 모델의 정가를 유지하면서 저가형 채널로 바꾸지 않고도, OpenClaw가 입력 토큰 길이를 제어하여 비용을 절감하는 방법을 상세히 설명합니다. 새로운 대화 격리 작업, 전체 내용을 넣는 대신 코드 블록을 정밀하게 검색, 컨텍스트 가지치기, QMD 로컬 검색 등 6가지 전략을 다룹니다.

OpenClaw는 토큰 소모량이 많기로 유명합니다. 어떤 사용자는 하루에 2,150만 토큰을 태워 월 청구액이 600달러를 넘기도 하죠. 많은 사람이 가장 먼저 떠올리는 해결책은 저렴한 모델 채널로 바꾸는 것이지만, 이는 품질 저하를 감수해야 합니다. 진정한 토큰 절약 방법은 입력단을 제어하는 것입니다. 모델에 얼마나 많은 컨텍스트를 제공하느냐가 비용을 결정짓는 핵심 요소이기 때문입니다. 이 글에서는 모델을 바꾸거나 품질을 낮추지 않고도, 입력 토큰을 "전체 삽입" 방식에서 "정밀 투입" 방식으로 바꾸는 핵심 문제를 집중적으로 다룹니다.

핵심 가치: 이 글을 읽고 나면 토큰 입력을 제어하는 6가지 실전 전략을 익히게 되며, 토큰 비용을 50~90%까지 절감할 수 있습니다.

OpenClaw 토큰 절약 핵심 포인트

먼저 전제 조건을 명확히 할게요. 이 글에서 다루는 내용은 모델을 바꾸거나 품질을 낮추지 않고 토큰을 절약하는 방법입니다. Claude Opus 3.5나 GPT-4o 같은 정가 모델을 그대로 사용하면서, 입력 단계에서 비용을 줄이는 것이 핵심입니다.

| 전략 | 절약 비율 | 구현 난이도 | 핵심 아이디어 |

|---|---|---|---|

| 새 대화로 작업 격리 | 60-80% | 낮음 | 독립적인 작업마다 새 대화를 열어 기록 누적 방지 |

| 코드 블록 정밀 검색 | 40-95% | 중간 | 전체 파일 대신 관련 코드 조각만 전달 |

| 컨텍스트 가지치기 | 30-50% | 낮음 | 불필요한 대화 기록 수동/자동 정리 |

| QMD 로컬 검색 | 80-90% | 중간 | 로컬 벡터 검색을 통해 관련 조각만 전송 |

| 프롬프트 캐싱 | 80-90%(입력 비용) | 낮음 | 캐시를 활용해 시스템 프롬프트 중복 전송 방지 |

| Thinking 모드 끄기 | 10-50배 | 낮음 | 추론이 필요 없는 작업 시 생각 모드 비활성화 |

OpenClaw 토큰 소모의 기본 원리

토큰을 절약하려면 먼저 OpenClaw가 왜 토큰을 많이 소모하는지 이해해야 합니다.

OpenClaw에서 메시지를 보낼 때마다 단순히 현재 메시지만 보내는 것이 아니라, 전체 대화 기록을 모델에 다시 보냅니다. 대화가 길어질수록 요청당 입력 토큰은 기하급수적으로 늘어납니다.

구체적으로 한 번의 요청에는 다음이 포함됩니다:

- 시스템 프롬프트: OpenClaw의 핵심 지침, 보통 2000-5000 토큰

- AGENTS.md / SOUL.md: 워크스페이스 설정 파일

- 로드된 스킬: 활성화된 각 스킬이 토큰을 점유

- 전체 대화 기록: 세션 시작부터 현재까지의 모든 메시지

- 도구 호출 결과: 파일 읽기, 명령 실행 시의 출력값

- 메모리 검색 결과: 메모리 저장소에서 검색된 관련 내용

30분 동안 지속된 OpenClaw 세션의 마지막 메시지는 입력 토큰이 이미 10만, 심지어 100만 개에 달할 수 있습니다. 하지만 앞선 29분 동안의 내용 중 대부분은 현재 작업에 더 이상 필요 없는 정보일 가능성이 높죠.

전략 1: OpenClaw 작업별 새 대화 시작하기

가장 간단하면서도 효과적인 전략입니다.

새 대화가 토큰을 절약하는 이유

같은 세션에서 3가지 작업을 한다고 가정해 봅시다: 버그 A 수정 → 기능 B 개발 → 모듈 C 리팩토링. 세 번째 작업을 할 때 모델의 입력값에는 앞선 두 작업의 대화 기록과 파일 읽기 결과가 모두 포함됩니다. 하지만 이는 모듈 C를 리팩토링하는 데 전혀 도움이 되지 않죠.

같은 세션 유지 시:

작업 A 대화 기록 (20K 토큰)

+ 작업 A 파일 내용 (30K 토큰)

+ 작업 B 대화 기록 (25K 토큰)

+ 작업 B 파일 내용 (40K 토큰)

+ 작업 C 현재 메시지 (5K 토큰)

= 120K 토큰 입력 (그중 115K는 불필요한 과거 기록)

새 세션 시작 시:

작업 C 현재 메시지 (5K 토큰)

+ 시스템 프롬프트 (3K 토큰)

= 8K 토큰 입력 (93% 절약)

대화 상황별 모범 사례

| 상황 | 새 세션 시작 여부 | 이유 |

|---|---|---|

| 완전히 다른 작업으로 전환 | 새 세션 | 이전 작업의 컨텍스트가 전혀 쓸모없음 |

| 동일 기능의 반복 수정 | 유지 | 이전 논의 내용이 필요함 |

| 서로 다른 파일의 버그 수정 | 새 세션 | 각 버그는 독립적이므로 컨텍스트 공유 불필요 |

| 동일 모듈의 연속 수정 | 유지 | 모델이 이전 수정 의도를 이해해야 함 |

| 대화가 20회 이상 진행 | 새 세션 또는 요약 | 기록이 너무 많이 쌓임 |

🎯 실전 팁: 간단한 판단 기준은 이렇습니다. "앞의 내용은 잊고 이제 다른 일을 하자"라고 말해야 하는 상황이라면, 그냥 새 대화를 여세요.

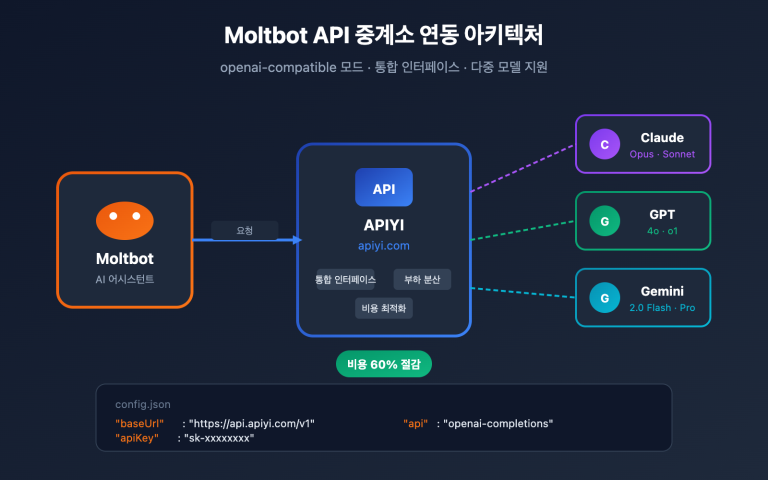

이 원칙은 OpenClaw뿐만 아니라 Claude Code 및 다른 AI 코딩 도구에도 적용됩니다. APIYI(apiyi.com)를 통해 호출하는 모든 개별 API 요청은 본래 "새 세션"이므로 컨텍스트 누적 문제가 발생하지 않습니다.

전략 2: OpenClaw 정밀 코드 블록 검색, 전체 내용 입력 금지

이 글의 핵심 포인트입니다. 어떻게 하면 모델이 수정이 필요한 코드 블록만 보게 하고, 파일 전체나 프로젝트 전체를 통째로 집어넣지 않을 수 있을까요?

문제의 본질: "전체 입력"이 낭비인 이유

연구 데이터에 따르면 AI 코딩 에이전트가 사용하는 토큰의 80%가 '찾기' 과정에서 낭비됩니다. 흔한 상황을 예로 들어볼까요? 여러분이 OpenClaw에게 함수 하나를 수정하라고 시키면, 에이전트는 관련 있는 함수 3개를 찾기 위해 파일 25개를 읽습니다. 이때 파일 25개를 읽는 모든 토큰 비용이 고스란히 여러분의 몫이 됩니다.

1,000줄짜리 파일은 대략 15,00025,000 토큰 정도입니다. 만약 그중 20줄(약 300500 토큰)만 수정하면 되는데 파일 전체를 모델에게 먹인다면, 입력 토큰의 96~98%가 낭비되는 셈이죠.

OpenClaw 정밀 코드 블록 검색을 위한 4가지 방법

방법 1: 파일과 줄 번호를 명확히 지정하기

"로그인 기능 수정해 줘"라고 하지 말고, "src/auth/login.ts의 45~78행 handleLogin 함수를 수정해 줘"라고 말하세요. 지시가 정확할수록 OpenClaw가 읽어야 할 파일은 줄어듭니다.

❌ "로그인 버그 수정"

→ OpenClaw가 10개 이상의 파일을 읽음, 200K+ 토큰 소모

✅ "src/auth/login.ts 52행의 널 포인터 체크 수정"

→ OpenClaw가 1개 파일의 관련 부분만 읽음, ~20K 토큰 소모

방법 2: QMD 로컬 의미론적 검색 활용

OpenClaw의 QMD(Quick Memory Database)는 로컬에 벡터 인덱스를 생성할 수 있습니다. 관련 코드 조각을 검색한 뒤, 가장 관련성 높은 내용만 모델에게 전송하죠.

사용 방법: OpenClaw 설정에서 QMD를 활성화하세요. 프로젝트 파일과 대화 기록을 자동으로 인덱싱합니다. 이후 질문할 때 QMD가 로컬에서 관련 코드를 먼저 찾아, 정확히 일치하는 조각만 모델에게 보냅니다.

방법 3: @file 문법으로 직접 참조하기

OpenClaw에서는 @file 문법을 사용하여 파일을 정확하게 참조할 수 있습니다. 모델이 스스로 검색하게 두지 마세요.

@src/auth/login.ts 의 handleLogin 함수를 수정해서,

refreshToken 만료 처리 로직을 추가해 줘.

@src/auth/token.ts 의 isTokenExpired 메서드를 참고해.

이렇게 하면 OpenClaw는 전체 src/auth/ 디렉토리를 스캔하는 대신, 여러분이 지정한 파일 2개만 로드합니다.

방법 4: 프로젝트 구조 파일로 가이드하기

AGENTS.md나 SOUL.md에 프로젝트 구조 개요를 작성해 두세요. OpenClaw가 "어떤 기능이 어느 파일에 있는지" 알게 되면, 탐색을 위한 파일 스캔을 줄일 수 있습니다.

## 프로젝트 구조

- 인증 관련: src/auth/ (login.ts, token.ts, session.ts)

- 사용자 관리: src/user/ (profile.ts, settings.ts)

- API 라우팅: src/routes/ (auth.route.ts, user.route.ts)

이 개요는 수백 토큰밖에 차지하지 않지만, OpenClaw가 수만 토큰을 낭비하며 파일을 맹목적으로 스캔하는 것을 막아줍니다.

전략 3~6: OpenClaw 고급 토큰 절약 팁

전략 3: 컨텍스트 가지치기 (Context Pruning)

OpenClaw는 수동 및 자동 컨텍스트 가지치기를 지원합니다. 대화가 너무 길어지면 더 이상 필요 없는 이전 메시지를 정리할 수 있어요.

OpenClaw 2026.3.7 버전부터는 '컨텍스트 엔진 플러그인(Context Engine Plugins)'이 도입되어, 서드파티 플러그인을 통해 대체 컨텍스트 관리 전략을 사용할 수 있게 되었습니다(이전에는 핵심 기능에 하드코딩되어 있었습니다). lossless-claw 플러그인을 활용하면 핵심 정보를 잃지 않으면서도 대화 기록을 효율적으로 압축할 수 있습니다.

실전 팁:

- 하위 작업을 완료할 때마다 관련 없는 도구 호출 출력을 수동으로 정리하세요.

contextTokens: 50000으로 설정하여 컨텍스트 윈도우 크기를 제한하세요.- 'compact' 기능을 사용하여 대화 기록을 압축하세요.

전략 4: QMD 로컬 의미론적 검색

QMD(Quick Memory Database)는 OpenClaw의 로컬 벡터 검색 기능입니다. 로컬 기기에 벡터 데이터베이스를 구축하여 대화 기록과 문서를 인덱싱하죠. 검색 시 먼저 로컬에서 관련 내용을 찾은 뒤, 가장 연관성 높은 조각만 모델에 전송합니다.

효과: 입력 토큰 비용을 80~90% 절감할 수 있습니다.

전략 5: 프롬프트 캐싱(Prompt Caching) 활용

Claude와 GPT 모델 제품군은 모두 프롬프트 캐싱을 지원합니다. 시스템 프롬프트나 자주 사용하는 컨텍스트가 변경되지 않으면 API가 자동으로 캐시된 버전을 사용하여 입력 토큰 비용을 80~90% 낮춰줍니다.

하지만 중요한 제한 사항이 있습니다: OpenAI 호환 형식(/v1/chat/completions)을 통해 Claude를 호출할 때는 프롬프트 캐싱이 지원되지 않으며, 반드시 Anthropic 네이티브 형식(/v1/messages)을 사용해야 합니다. APIYI(apiyi.com)를 통해 호출하면 플랫폼에서 네이티브 형식의 프롬프트 캐싱을 지원하니 안심하세요.

전략 6: 비추론 작업 시 Thinking 모드 끄기

Thinking/Reasoning 모드는 토큰 소비량을 10~50배까지 폭증시킵니다. 현재 작업이 깊은 추론을 필요로 하지 않는다면(예: 단순 서식 지정, 파일 이동, 텍스트 교체 등), Thinking 모드를 끄는 것만으로도 비용을 크게 절감할 수 있습니다.

| 작업 유형 | Thinking 필요 여부 | 토큰 차이 |

|---|---|---|

| 복잡한 버그 분석 | 필요 | 정상 소비 |

| 아키텍처 설계 | 필요 | 정상 소비 |

| 단순 서식 지정 | 불필요 | 끄면 10~50배 절약 |

| 파일 이동/이름 변경 | 불필요 | 끄면 10~50배 절약 |

| 샘플 코드 생성 | 상황에 따라 다름 | 간단한 템플릿은 끄기 가능 |

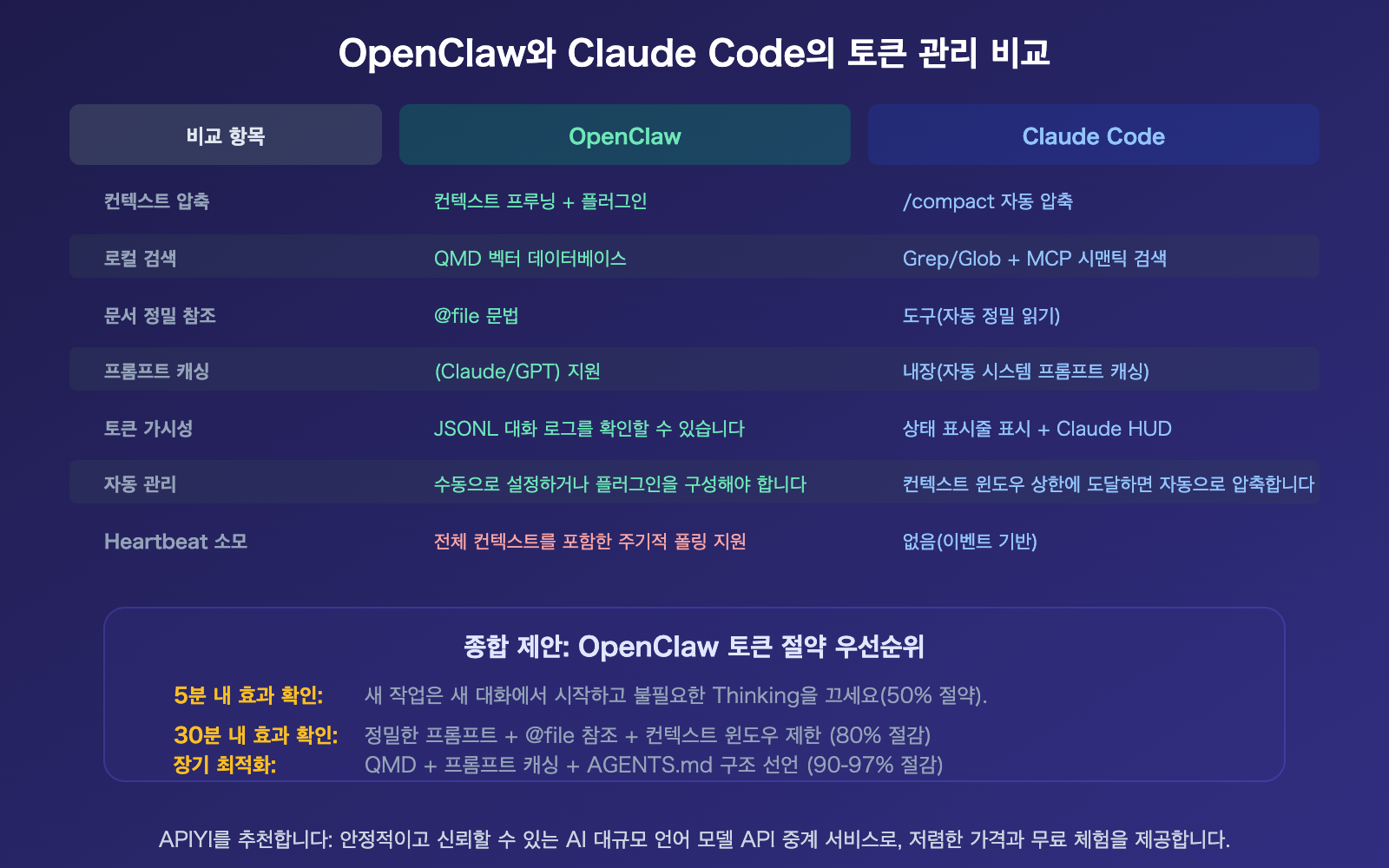

팁: Claude Code의 컨텍스트 압축(Context Compaction)과 OpenClaw의 컨텍스트 가지치기(Context Pruning)는 모두 '누적된 입력 토큰 제어'라는 동일한 문제를 해결합니다. 두 도구를 동시에 사용한다면 APIYI(apiyi.com)를 통해 API 호출 한도를 통합 관리해 보세요.

OpenClaw와 Claude Code 토큰 절약 비교

두 도구는 같은 문제를 다루지만 해결 방식에는 차이가 있습니다.

자주 묻는 질문(FAQ)

Q1: 새로운 대화를 시작하면 모델이 프로젝트 배경을 모르는데 어떻게 하나요?

OpenClaw의 Memory 시스템과 AGENTS.md 파일을 활용해 보세요. Memory는 새로운 세션에서 관련 프로젝트 배경 정보를 자동으로 검색합니다(전체 기록이 아닌 가장 관련성 높은 조각만 전송). AGENTS.md에 프로젝트 구조와 핵심 약속을 미리 적어두면 매번 새로운 대화마다 자동으로 로드되는데, 이는 20번의 대화 기록을 모두 가져오는 것보다 훨씬 효율적입니다.

Q2: 현재 세션의 토큰 사용량은 어떻게 확인하나요?

OpenClaw의 대화 기록은 .openclaw/agents.main/sessions/ 디렉토리 내의 JSONL 파일에 저장되므로, 각 요청의 토큰 수를 직접 확인할 수 있습니다. 더 편리한 방법은 API 제공업체의 사용량 대시보드를 사용하는 것입니다. APIYI(apiyi.com)를 통해 호출하면 백엔드에서 각 요청의 정확한 토큰 소모량과 비용을 확인할 수 있습니다.

Q3: QMD와 일반 grep 검색의 차이점은 무엇인가요?

grep은 정확히 일치하는 문자열을 찾는 방식입니다. 예를 들어 "handleLogin"을 검색하면 해당 문자열이 포함된 곳만 찾을 수 있죠. 반면 QMD는 의미론적 검색(Semantic Search)을 수행합니다. "사용자 로그인 오류 처리"라고 검색하면 코드 내에 "로그인"이나 "오류 처리"라는 문자열이 없더라도 의미적으로 관련된 모든 코드 블록을 찾아냅니다. 의미론적 검색은 정확도가 훨씬 높고 모델에게 전달되는 불필요한 내용이 적어 토큰을 크게 절약할 수 있습니다.

Q4: Heartbeat(하트비트)가 왜 많은 토큰을 소모하나요?

OpenClaw의 Heartbeat 메커니즘은 정기적으로 작업 상태를 확인합니다. 간격을 너무 짧게(예: 5분마다) 설정하면, 매번 하트비트가 발생할 때마다 전체 대화 컨텍스트를 모델에 전송하게 됩니다. 실제로 자동 이메일 확인 기능을 사용하다가 하루 만에 50달러를 소모한 사례도 있습니다. 해결 방법은 하트비트 간격을 늘리거나, 자동 모니터링이 필요 없을 때는 Heartbeat를 일시 중지하는 것입니다.

요약

모델을 바꾸거나 품질을 낮추지 않고도 OpenClaw에서 토큰을 절약하는 핵심 포인트입니다:

- 입력 토큰이 비용의 대부분(70-85%)을 차지합니다: 요청할 때마다 전체 대화 기록을 다시 보내면 대화가 길어질수록 비용이 비싸집니다. 가장 쉬운 절약법은 작업 성격이 다를 때마다 새로운 대화를 시작하는 것입니다.

- 정밀한 코드 블록 검색이 가장 큰 레버리지입니다: "전체 내용을 다 넣는 것"(120K 토큰)에서 "필요한 부분만 정밀하게 넣는 것"(4K 토큰)으로 바꾸면 동일한 수정 작업에서 96%를 절약할 수 있습니다. 방법은 파일 행 번호 지정, @file 참조, QMD 의미론적 검색, AGENTS.md 구조 선언을 활용하는 것입니다.

- 3단계 최적화 경로: 5분 만에 효과 보기(새 대화 + Thinking 끄기, 50% 절약) → 30분 만에 효과 보기(정밀한 지시 + 컨텍스트 제한, 80% 절약) → 장기적 효과(QMD + Caching, 97% 절약).

APIYI(apiyi.com)를 통해 OpenClaw의 API 호출을 관리하는 것을 추천합니다. 플랫폼에서 제공하는 정확한 토큰 사용량 통계와 비용 모니터링을 통해 최적화의 실제 효과를 직접 확인해 보세요.

📚 참고 자료

-

OpenClaw 토큰 사용 및 비용 관리 가이드: 공식 토큰 관리 문서

- 링크:

docs.openclaw.ai/reference/token-use - 설명: contextTokens 설정 및 Heartbeat 최적화 포함

- 링크:

-

OpenClaw 토큰 절약 실전: $600에서 $20로: 3단계 최적화 프레임워크 완벽 가이드

- 링크:

blog.laozhang.ai/en/posts/openclaw-save-money-practical-guide - 설명: 구체적인 설정 파라미터 및 예상 절감 비율 포함

- 링크:

-

AI 코딩 에이전트 토큰 80%가 검색에 낭비되는 이유: 컨텍스트 정확도 연구

- 링크:

medium.com/@jakenesler/context-compression-to-reduce-llm-costs - 설명: 왜 컨텍스트 윈도우를 늘리는 것보다 정밀한 검색이 더 효과적인지 설명

- 링크:

-

APIYI 문서 센터: 토큰 사용량 통계 및 비용 모니터링

- 링크:

docs.apiyi.com - 설명: OpenClaw 및 Claude Code의 모델 호출 관리 지원

- 링크:

작성자: APIYI 기술팀

기술 교류: 댓글로 자유롭게 의견을 나눠주세요. 더 많은 자료는 APIYI 문서 센터(docs.apiyi.com)에서 확인하실 수 있습니다.