저자 주: 2026년 가장 강력한 수학 문제 풀이 AI 모델 3종을 심층 비교합니다. AIME, MATH 등 권위 있는 벤치마크 데이터를 포함하여, 여러분에게 가장 적합한 수학 추론 모델을 찾는 데 도움을 드립니다.

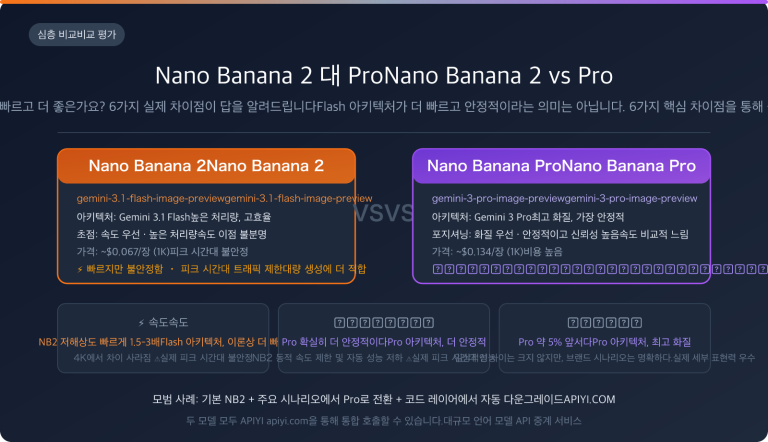

수학 문제 풀이에 어떤 AI 모델을 사용해야 할지는 개발자와 학생 커뮤니티 모두가 가장 관심을 갖는 선택 중 하나입니다. 이 글은 Gemini 3.1 Pro Preview, Claude Sonnet 4.6, 그리고 GPT-5.4 이렇게 세 가지 2026년 최신 수학 추론 모델을 비교합니다. 벤치마크 성적, 추론 능력, API 가격, 그리고 적용 시나리오 등 다양한 차원에서 명확한 조언을 제공합니다.

핵심 가치: 이 글을 읽고 나면, 다양한 수학 문제 풀이 시나리오에서 어떤 AI 모델을 선택해야 하는지, 그리고 어떻게 최적의 비용으로 호출할 수 있는지 명확하게 이해하게 될 것입니다.

수학 문제 해결 AI 모델 핵심 비교 요약

상세 분석에 들어가기 전에, 세 가지 수학 문제 해결 AI 모델의 주요 차이점을 빠르게 파악할 수 있는 핵심 데이터 비교표를 먼저 살펴보세요.

| 비교 항목 | Gemini 3.1 Pro Preview | Claude Sonnet 4.6 | GPT-5.4 |

|---|---|---|---|

| 출시일 | 2026년 2월 19일 | 2026년 초 | 2026년 3월 6일 |

| AIME 2025 | 92%(도구 없이) | — | 100%(만점) |

| MATH 벤치마크 | 95.1% | 89% | 88.6% |

| GPQA Diamond | 94.3% | 74.1% | 84.2% |

| ARC-AGI-2 | 77.1% | 58.3% | 73.3% |

| 입력 가격 | $2.00/1M 토큰 | $3.00/1M 토큰 | $2.50/1M 토큰 |

| 출력 가격 | $12.00/1M 토큰 | $15.00/1M 토큰 | $15.00/1M 토큰 |

| 종합 추천 | ⭐ 최우선 추천 | ⭐ 학습용 추천 | ⭐ 경시대회용 추천 |

수학 문제 해결 AI 모델 추천 순위

종합적인 가성비 관점에서 다음과 같은 순위를 제안합니다:

- 최우선: Gemini 3.1 Pro Preview:MATH 벤치마크 95.1%로 선두, 가격 최저, 종합 수학 능력 최강

- 차선: Claude Sonnet 4.6:수학 능력 27%p 급상승, 문제 풀이 과정이 명확하고 이해하기 쉬움, 학습 시나리오에 적합

- 경시대회급: GPT-5.4:AIME 2025 만점 100%, 고난도 수학 경시대회 및 전문 연구에 적합

🎯 기술 제안:세 모델 모두 APIYI apiyi.com 플랫폼을 통해 통합 호출이 가능합니다. 실제 수학 문제에 대해 각각 테스트해보고, 당신의 요구에 가장 잘 맞는 모델을 선택하는 것을 권장합니다.

Gemini 3.1 Pro Preview 수학 문제 해결 능력 상세 분석

Gemini 3.1 Pro Preview는 Google DeepMind가 2026년 2월 19일에 출시한 최신 플래그십 모델입니다. 이번은 Google이 처음으로 '.1' 버전 증분을 사용한 것으로(이전 중기 업데이트는 모두 '.5'를 사용), 지능형 추론 능력에 초점을 맞춘 방향성 업그레이드임을 의미합니다.

Gemini 3.1 Pro 수학 벤치마크 테스트 성적

| 벤치마크 테스트 | 점수 | 설명 |

|---|---|---|

| MATH | 95.1% | 대수, 기하, 미적분 등 다양한 분야를 아우르는 종합 수학 테스트 |

| AIME 2025(도구 없이) | 92% | 미국 수학 초청 시험, 고등학교 경시대회 수준 난이도 |

| AIME 2025(코드 실행) | 100% | 이전 세대 Gemini 3 Pro가 코드 실행 후 만점 |

| GPQA Diamond | 94.3% | 대학원 수준 과학 질의응답, 동급 모든 모델 선두 |

| ARC-AGI-2 | 77.1% | 추상 추론 능력, 이전 세대 3 Pro 대비 두 배 |

| MathArena Apex | 현저히 우세 | 이전 세대 대비 20배 이상 향상 |

Gemini 3.1 Pro는 Google이 공식 발표한 18개 주요 벤치마크 테스트 중 12개에서 1위 성적을 거두었습니다. 수학 추론 측면에서 MATH 벤치마크 95.1%의 성과는 특히 두드러지며, 이는 대수, 기하, 확률, 미적분 등 각 수학 하위 분야에서 매우 강력한 문제 해결 능력을 갖추고 있음을 의미합니다.

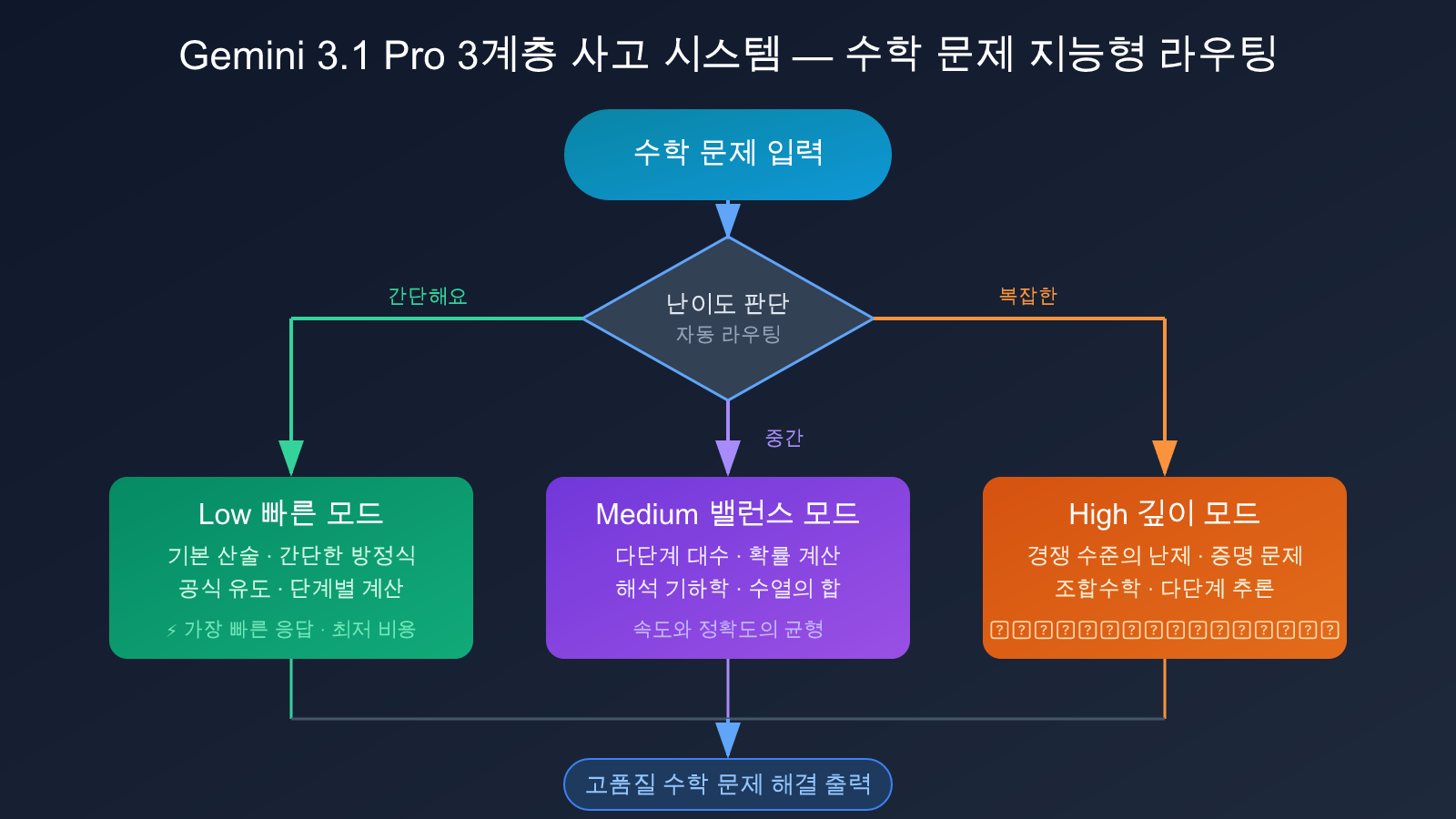

Gemini 3.1 Pro 3단계 사고 시스템

Gemini 3.1 Pro는 핵심적인 아키텍처 혁신을 도입했습니다 — 3단계 사고 시스템:

- Low(빠른 모드):간단한 수학 계산과 공식 유도 처리, 응답 속도 최고

- Medium(균형 모드):새로 추가된 중간 계층, 중간 난이도 수학 문제 처리, 속도와 정확성 균형

- High(심층 모드):복잡한 다단계 추론 문제 처리, 예: 경시대회급 수학 문제

이 3단계 시스템 덕분에 개발자는 수학 문제의 난이도에 따라 유연하게 라우팅할 수 있어, '빠르지만 거칠다'와 '느리지만 정확하다' 사이에서 이분법적 선택을 할 필요가 없습니다. 다양한 난이도의 수학 문제를 일괄 처리하는 시나리오(예: 교육 플랫폼의 적응형 출제 시스템)에서 이 아키텍처의 장점은 특히 두드러집니다.

Gemini 3.1 Pro 수학 문제 해결 실제 체험

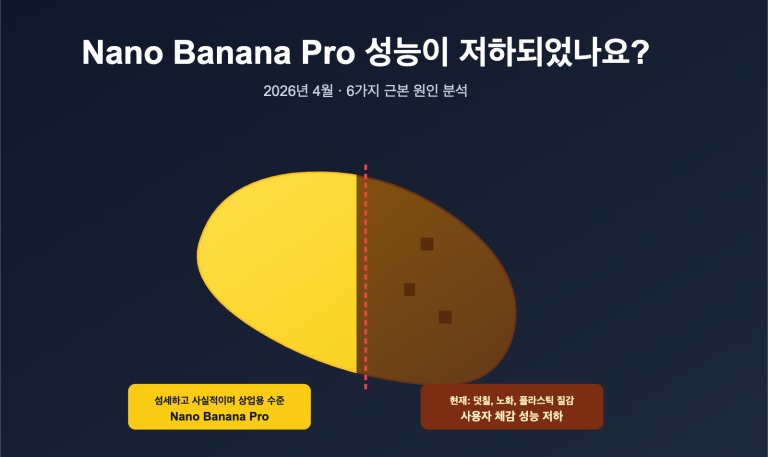

실제 수학 문제 해결에서 Gemini 3.1 Pro Preview의 성능은 '포괄적이고 안정적'이라고 요약할 수 있습니다:

- 대수 분야:다항식 연산, 연립방정식 풀이, 부등식 증명 등 문제에서 거의 실수가 없으며, 이는 MATH 95.1%의 높은 커버리지 덕분입니다.

- 기하 분야:해석 기하와 입체 기하의 추론 체인이 완전하며, 특히 좌표계 관련 계산 문제에서 뛰어난 성능을 보입니다.

- 확률 통계:조건부 확률, 순열 조합 등 문제의 추론 논리가 명확하며, 복잡한 단계별 계산을 올바르게 처리할 수 있습니다.

- 미적분:정적분, 부정적분 풀이가 정확하며, 일반적인 적분 기법을 인식하고 올바르게 적용할 수 있습니다.

Gemini 3.1 Pro가 18개 주요 벤치마크 중 12개에서 1위를 차지한 것은 우연이 아닙니다. 그 Artificial Analysis Intelligence Index 점수는 57점으로, GPT-5.4(xhigh)와 함께 1위를 차지하며 중앙값 28점을 훨씬 웃도는, 전방위적인 지능형 추론 우위를 보여줍니다.

Claude Sonnet 4.6 수학 문제 해결 능력 상세 분석

Claude Sonnet 4.6는 Anthropic가 출시한 최신 중급 모델로, 수학 추론 능력에서 질적인 도약을 이루었습니다. 전작 Sonnet 4.5의 62%에서 Sonnet 4.6는 89%로, 무려 27% 포인트나 향상되었습니다.

Claude Sonnet 4.6 수학 벤치마크 성적

| 벤치마크 테스트 | Sonnet 4.6 | Sonnet 4.5 (전작) | 향상 폭 |

|---|---|---|---|

| 수학 종합 | 89% | 62% | +27% 포인트 |

| ARC-AGI-2 | 58.3% | 13.6% | 4.3배 향상 |

| GPQA Diamond | 74.1% | — | 대학원 수준 과학 추론 |

| 프로그래밍 능력 | 79.6% | — | Opus 4.6의 80.8%에 근접 |

| 금융 분석 | 63.3% | — | 동급 최고 |

수학 능력이 62%에서 89%로 도약한 것은 Sonnet 4.6의 가장 눈에 띄는 변화 중 하나입니다. 이는 '가끔 수학 문제를 틀리는 모델'에서 '복잡한 계산을 안정적으로 처리할 수 있는 모델'로 변모했음을 의미합니다.

Claude Sonnet 4.6 적응형 사고 메커니즘

Claude Sonnet 4.6의 또 다른 하이라이트는 적응형 사고 깊이(Adaptive Thinking) 메커니즘입니다:

- 간단한 문제: 빠르게 응답하여 추론 자원을 낭비하지 않습니다. 예: 기초 산술, 간단한 방정식 풀이

- 중간 난이도 문제: 적절히 사고 사슬을 확장합니다. 예: 다단계 대수 연산, 확률 계산

- 복잡한 문제: 자동으로 심층 추론 사슬을 발동합니다. 예: 조합 수학, 증명 문제, 경시대회 수준 문제

이러한 적응 메커니즘의 실제 사용상 이점은 다음과 같습니다. 사용자가 수동으로 추론 깊이를 조절할 필요 없이, 모델이 수학 문제의 난이도를 자동으로 판단하여 적절한 계산 자원을 할당하여 지연 시간과 비용 사이의 최적 균형을 찾습니다.

Claude Sonnet 4.6의 독특한 장점: 문제 해결 과정

수학 문제 해결 시나리오에서 Claude Sonnet 4.6는 널리 인정받는 독특한 장점이 있습니다. 바로 문제 해결 과정의 명확성입니다. 여러 평가에서 Claude 모델이 수학 개념을 설명하는 데 가장 뛰어나다고 지적했습니다. 또한, Anthropic가 출시한 학습 모드(Learning Mode)는 답을 직접 주는 것이 아니라 학생의 추론 과정을 이끌도록 특별히 설계되었습니다.

이로 인해 Claude Sonnet 4.6는 특히 다음과 같은 경우에 적합합니다:

- 수학 교육 및 과외 시나리오

- 문제 해결 단계를 이해해야 하는 학습자

- 문제 해결 사고 과정을 검증하고자 하는 연구자

💡 학습 제안: 만약 당신의 핵심 요구사항이 '답을 얻는 것'이 아니라 '수학 문제 해결 과정을 이해하는 것'이라면, Claude Sonnet 4.6가 최선의 선택입니다. APIYI apiyi.com을 통해 무료 테스트 크레딧을 받아 그 문제 해결 과정의 상세함을 경험해 볼 수 있습니다.

GPT-5.4 수학 문제 해결 능력 상세 분석

GPT-5.4는 OpenAI가 2026년 3월 6일에 출시한 최신 플래그십 모델입니다. 이는 최첨단 전문 능력, 프로그래밍 능력(GPT-5.3-Codex 출신), 네이티브 컴퓨터 조작 및 1.05M 컨텍스트 윈도우를 동일한 기본 모델에 통합한 최초의 OpenAI 추론 모델입니다.

GPT-5.4 수학 벤치마크 성적

| 벤치마크 테스트 | 점수 | 설명 |

|---|---|---|

| AIME 2025 | 100% (만점) | 고등학교 수학 경시대회 수준, 완벽한 성능 |

| GSM8K | 99% | 초등학교 수학 응용 문제, 거의 완벽 |

| MATH | 88.6% | 종합 수학 추론 벤치마크 |

| GPQA Diamond | 84.2% (표준) / 92.8% (고추론) | 대학원 수준 과학 추론 |

| ARC-AGI-2 | 73.3% (표준) / 83.3% (Pro) | 추상 추론 능력 |

| FrontierMath (전작 5.2) | 40.3% | 전문가 수준 최첨단 수학 신기록 |

GPT-5.4는 AIME 2025에서 놀라운 100% 만점을 기록했는데, 이는 미국 수학 초청 시험(AMC/AIME)의 모든 고난도 경시대회 문제를 완벽하게 해결할 수 있음을 의미합니다. 경시대회 수준의 수학 문제를 해결해야 하는 사용자에게 이 성과는 매우 설득력이 있습니다.

주목할 점은 GPT-5.4의 MATH 벤치마크 점수가 88.6%로, Gemini 3.1 Pro의 95.1%에 비해 약간의 격차가 있다는 것입니다. 이는 GPT-5.4가 경시대회급 난제에서는 완벽한 성능을 보이지만, 광범위한 수학 분야를 포괄하는 종합 테스트에서는 가장 강력하지 않을 수 있음을 시사합니다.

GPT-5.4 추론 구성 옵션

GPT-5.4는 다양한 수학 문제에 적응하기 위해 여러 추론 구성을 제공합니다:

- GPT-5.4 표준판: 일상적인 수학 계산 및 중간 난이도 문제에 적합

- GPT-5.4 Thinking: 고급 추론 활성화, 복잡한 다단계 추론 및 증명에 적합

- GPT-5.4 Pro: 최고 성능 구성, ARC-AGI-2에서 83.3% 달성, 최고 난이도 시나리오에 적합

다만, GPT-5.4 Pro의 가격은 입력 $30.00/1M + 출력 $180.00/1M으로, 표준판보다 비용이 훨씬 높습니다. 대부분의 수학 문제 해결 시나리오에는 표준판으로도 충분합니다.

GPT-5.4 수학 문제 해결 실제 경험

GPT-5.4는 경시대회 수준의 수학 문제에서 특히 놀라운 성능을 보입니다:

- 경시대회 수학: AMC/AIME 수준의 정수론, 조합, 기하 종합 문제 거의 완벽하게 답변, 100%의 AIME 성적은 실질적 가치가 있음

- 증명 문제: 완전한 수학 증명 사슬을 구성할 수 있으며, 논리가 엄밀하고 단계 간 연결이 자연스러움

- 응용 수학: GSM8K 99%의 성적은 실제 응용 문제(예: 공학 계산, 경제 모델링)에서도 매우 신뢰할 수 있음을 보여줌

- 다단계 추론: 1.05M의 초장기 컨텍스트 윈도우 덕분에 완전한 추론 사슬을 유지하면서도 극도로 복잡한 다단계 수학 문제를 처리할 수 있음

GPT-5.4의 독특한 장점 중 하나는 전작 GPT-5.2가 FrontierMath(전문가 수준 최첨단 수학)에서 40.3%의 신기록을 세웠다는 점입니다. 이는 GPT 시리즈가 진정한 최첨단의, 미해결된 수학 문제에서도 일정한 탐구 능력을 갖추고 있음을 의미하며, 이는 현재 다른 모델들이 따라잡기 어려운 부분입니다.

수학 문제 해결 AI 모델 벤치마크 해석

수학 문제 해결 AI 모델을 비교하기 전에, 각 벤치마크의 의미와 중점을 이해하는 것이 모델 능력을 더 정확히 판단하는 데 도움이 됩니다:

| 벤치마크 | 전체 이름 | 테스트 내용 | 난이도 수준 |

|---|---|---|---|

| AIME 2025 | American Invitational Mathematics Examination | 미국 수학 초청 시험(AIME) 실제 기출 문제, 정수론, 조합론, 기하학 등 포함 | 고등학교 경시대회 수준 (상위 5% 학생) |

| MATH | Mathematics Aptitude Test of Heuristics | 대수학, 기하학, 미적분학 등 7개 주요 분야를 포괄하는 종합 테스트 | 고등학교~대학교 학부 수준 |

| GSM8K | Grade School Math 8K | 초등학교~중학교 수준의 수학 응용 문제 8000개 | 기초 수준 |

| GPQA Diamond | Graduate-Level Google-Proof QA | 대학원 수준의 과학적 추론 문제, 해당 분야 전문가가 작성 | 대학원/박사 수준 |

| ARC-AGI-2 | Abstraction and Reasoning Corpus | 새로운 논리 패턴 인식, 추상적 추론 능력 테스트 | 범용 지능 수준 |

| FrontierMath | Frontier Mathematics | 전문가 수준의 최첨단 수학 문제, 미해결 또는 새로운 분야 포함 | 전문가/연구원 수준 |

핵심 이해: AIME는 경시대회 수준의 수학적 기교와 창의적 사고에 더 중점을 두고, MATH는 광범위한 분야에 대한 종합적 포괄 능력에 더 중점을 둡니다. 한 모델이 AIME에서 만점을 받았지만 MATH에서 최고 점수가 아닐 경우(예: GPT-5.4), 이는 그 모델이 경시대회 수준의 까다로운 문제에는 매우 강하지만, 일부 기본 분야에서의 포괄력은 MATH 점수가 더 높은 모델보다 약간 떨어질 수 있음을 의미합니다.

이것이 바로 우리가 Gemini 3.1 Pro Preview를 종합적인 우선 선택으로 추천하는 이유입니다 — MATH 95.1%는 다양한 수학 하위 분야에서 더 균형 잡힌 성능을 보인다는 것을 의미합니다.

주의할 점은 AIME 2025 벤치마크가 현재 포화 상태에 도달했다는 것입니다 — 여러 최상위 모델(코드 실행 기능과 결합 시)이 95% 이상, 심지어 만점에 도달할 수 있습니다. 따라서 모델의 진정한 수학 능력을 더 잘 구분해주는 것은 MathArena Apex나 FrontierMath와 같은 더 높은 난이도의 벤치마크입니다. MathArena Apex에서 Gemini 3.1 Pro는 이전 세대 대비 20배 이상의 향상을 보여주며, 매우 강력한 내재적 수학 추론 기반을 보여줍니다.

또 하나 주목해야 할 차원은 **ARC-AGI-2(추상적 추론 능력)**입니다. 이 테스트는 모델이 훈련 중에 한 번도 접해보지 않은 새로운 논리 패턴을 인식하는 능력을 평가합니다. Gemini 3.1 Pro Preview가 77.1%로 선두를 달리고 있는데, 이는 이 모델이 이미 본 유형의 문제를 해결할 뿐만 아니라, 더 강력한 일반화 추론 능력을 갖추고 있어 완전히 새로운 유형의 수학 문제를 접했을 때 더 나은 성능을 보인다는 것을 의미합니다.

수학 문제 해결 AI 모델 API 호출 실전

다음은 수학 문제 해결 AI 모델을 API로 호출하는 매우 간단한 코드 예시입니다. 단 10줄의 코드로 실행할 수 있습니다:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI 통합 인터페이스

)

response = client.chat.completions.create(

model="gemini-3.1-pro-preview", # claude-sonnet-4.6 또는 gpt-5.4로 전환 가능

messages=[{"role": "user", "content": "求解: 已知等差数列{an}的首项a1=2,公差d=3,求前20项的和S20"}]

)

print(response.choices[0].message.content)

전체 수학 문제 해결 호출 코드 보기 (다중 모델 비교 포함)

import openai

from typing import Optional

def solve_math(

problem: str,

model: str = "gemini-3.1-pro-preview",

system_prompt: Optional[str] = None

) -> str:

"""

AI 모델을 호출하여 수학 문제 해결

Args:

problem: 수학 문제 설명

model: 모델 이름, gemini-3.1-pro-preview / claude-sonnet-4.6 / gpt-5.4 지원

system_prompt: 시스템 프롬프트, 문제 해결 스타일 지정 가능

Returns:

모델의 문제 해결 응답

"""

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI 통합 인터페이스

)

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

else:

messages.append({

"role": "system",

"content": "당신은 수학 문제 해결 전문가입니다. 명확한 단계로 수학 문제를 풀어주세요. 각 단계마다 추론 근거를 설명해주세요."

})

messages.append({"role": "user", "content": problem})

try:

response = client.chat.completions.create(

model=model,

messages=messages,

max_tokens=2000

)

return response.choices[0].message.content

except Exception as e:

return f"Error: {str(e)}"

# 사용 예시: 동일한 문제를 세 모델로 해결하여 비교

problem = "在三角形ABC中,已知a=5, b=7, C=60°,求三角形面积和第三边c的长度"

models = ["gemini-3.1-pro-preview", "claude-sonnet-4.6", "gpt-5.4"]

for m in models:

print(f"\n{'='*50}")

print(f"모델: {m}")

print(f"{'='*50}")

result = solve_math(problem, model=m)

print(result)

권장사항: APIYI apiyi.com에서 무료 테스트 크레딧을 받아보세요. 하나의 API 키로 위의 세 가지 수학 문제 해결 모델을 모두 호출할 수 있어, 여러분의 실제 문제에서 각 모델의 성능 차이를 빠르게 비교해 볼 수 있습니다.

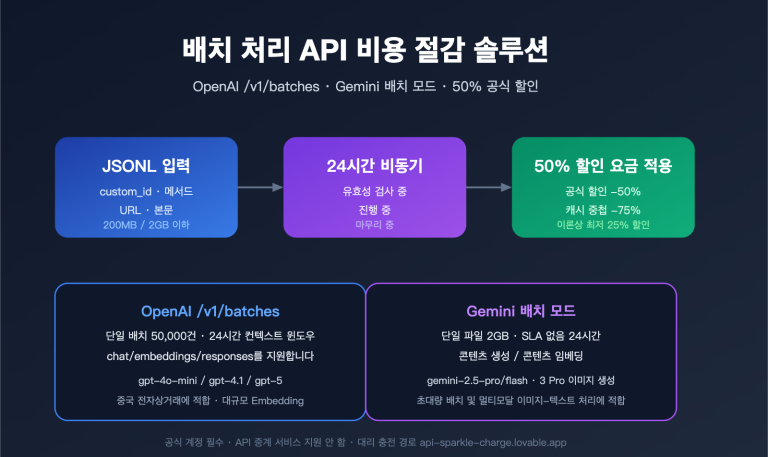

수학 문제 해결 AI 모델 가격 및 가성비 비교

수학 문제 해결 AI 모델을 선택할 때 가격은 무시할 수 없는 요소입니다. 다음은 세 가지 모델의 상세 가격 비교입니다:

| 가격 차원 | Gemini 3.1 Pro Preview | Claude Sonnet 4.6 | GPT-5.4 |

|---|---|---|---|

| 입력 가격 | $2.00/1M 토큰 | $3.00/1M 토큰 | $2.50/1M 토큰 |

| 출력 가격 | $12.00/1M 토큰 | $15.00/1M 토큰 | $15.00/1M 토큰 |

| 혼합 가격 (3:1) | $4.50/1M 토큰 | $6.00/1M 토큰 | $5.63/1M 토큰 |

| 긴 컨텍스트 추가 요금 | >200K 2배 | 없음 | >272K 2배 |

| 컨텍스트 윈도우 | 1M 토큰 | 표준 윈도우 | 1.05M 토큰 |

| 최대 출력 | 65,536 토큰 | 표준 출력 | 128,000 토큰 |

가성비 관점에서 분석해보면:

- Gemini 3.1 Pro Preview 가성비 최고: 입력 가격이 $2.00/1M 토큰으로 저렴하고, MATH 벤치마크 성적 95.1%로 선두를 달리고 있어요. Artificial Analysis에 따르면 운영 비용이 Claude Opus 4.6의 약 1/7.5 수준이지만, 수학과 프로그래밍 벤치마크에서는 동등하거나 오히려 더 뛰어난 성능을 보여줍니다.

- Claude Sonnet 4.6 가격 적정: $3.00/$15.00의 가격 책정은 이전 세대 Sonnet 4.5와 동일하지만, 수학 능력이 27% 포인트 향상되어 가성비가 크게 개선되었어요.

- GPT-5.4 표준판 가격 합리적: $2.50/$15.00의 가격은 합리적인 범위에 있지만, GPT-5.4 Pro($30/$180)를 사용하면 비용이 크게 증가하게 됩니다.

💰 비용 제안: 일상적인 수학 문제 해결 요구사항에는 Gemini 3.1 Pro Preview를 사용해 최적의 가성비를 얻는 것을 추천합니다. 비용을 더 최적화하려면 APIYI와 같은 API 중계 서비스를 통해 더 유연한 충전 방안을 고려해볼 수 있어요.

수학 문제 해결 비용 실제 추정

비용 차이를 더 직관적으로 이해하기 위해, 다음은 전형적인 수학 문제 해결 시나리오의 비용 추정입니다:

시나리오 가정: 매일 중간 난이도의 수학 문제 100개를 해결하고, 각 문제당 평균 500 입력 토큰 + 1500 출력 토큰을 소비한다고 가정합니다.

| 모델 | 일일 입력 비용 | 일일 출력 비용 | 일일 총 비용 | 월간 비용 (30일) |

|---|---|---|---|---|

| Gemini 3.1 Pro | $0.10 | $1.80 | $1.90 | $57.00 |

| GPT-5.4 | $0.13 | $2.25 | $2.38 | $71.25 |

| Claude Sonnet 4.6 | $0.15 | $2.25 | $2.40 | $72.00 |

| GPT-5.4 Pro | $1.50 | $27.00 | $28.50 | $855.00 |

| DeepSeek R2 | $0.03 | $0.33 | $0.36 | $10.80 |

비용 추정에서 명확히 볼 수 있는 점은:

- Gemini 3.1 Pro Preview의 월간 비용은 약 $57로, 세 가지 주요 모델 중 가장 경제적입니다.

- Claude Sonnet 4.6과 GPT-5.4 표준판의 비용은 비슷하게 $71-72/월 정도입니다.

- GPT-5.4 Pro의 비용은 $855/월로, 예산이 충분하고 극도의 정확도가 필요한 시나리오에만 적합합니다.

- DeepSeek R2는 $10.80/월의 초저가로 매우 경쟁력 있는 솔루션을 제공합니다.

수학 문제 풀이 AI 모델 종합 지능 지수 비교

단일 벤치마크 외에도 종합 지능 지수는 모델의 수학적 추론 잠재력을 더 포괄적으로 반영합니다. Artificial Analysis Intelligence Index는 현재 가장 권위 있는 종합 평가 체계 중 하나로, 추론, 지식, 수학, 프로그래밍 네 가지 차원을 기반으로 모델의 종합 점수를 계산합니다.

| 모델 | 종합 지능 지수 | AIME 2025 | MATH | GPQA Diamond | ARC-AGI-2 | 종합 평가 |

|---|---|---|---|---|---|---|

| GPT-5.4(xhigh) | 57 | 100% | 88.6% | 84.2% | 73.3% | 경시대회 문제의 왕, 종합 지수 공동 1위 |

| Gemini 3.1 Pro Preview | 57 | 92% | 95.1% | 94.3% | 77.1% | 종합 지수 공동 1위, 수학 분야 가장 폭넓게 커버 |

| Claude Opus 4.6 | 53 | — | — | 91.3% | — | 과학적 추론 및 설명 능력 최상위 |

| Claude Sonnet 4.6(max) | 52 | — | 89% | 74.1% | 58.3% | 가성비 우수, 문제 풀이 과정 가장 명확함 |

종합 지능 지수로 보면, GPT-5.4(xhigh)와 Gemini 3.1 Pro Preview가 57점으로 공동 1위지만, 두 모델의 강점은 다릅니다:

- GPT-5.4: AIME 같은 경시대회 문제에서 완벽한 성적(100%)을 보이지만, MATH 종합 벤치마크(88.6%)는 약간 낮습니다.

- Gemini 3.1 Pro: MATH 종합 벤치마크(95.1%)와 과학적 추론 GPQA Diamond(94.3%)에서 더 균형 잡힌 성능을 보입니다.

즉, 수학적 요구사항이 경시대회나 극한의 난이도 문제에 치우쳐 있다면 GPT-5.4가 더 나은 선택입니다. 넓은 수학 분야를 안정적으로 커버해야 한다면 Gemini 3.1 Pro Preview가 더 안전한 선택이 됩니다.

수학 문제 풀이 AI 모델 시나리오별 추천

다양한 수학 응용 시나리오는 모델에 서로 다른 요구사항을 제기합니다. 실제 사용 시나리오를 기반으로 한 추천 방안은 다음과 같습니다.

Gemini 3.1 Pro Preview를 선택해야 할 수학 시나리오

- 종합 수학 학습 플랫폼: 대수, 기하, 미적분 등 전 분야를 커버하며, MATH 95.1%의 종합 능력이 가장 뛰어납니다.

- 대량 수학 문제 처리: 가격이 가장 저렴하고, 3단계 사고 시스템이 문제 난이도에 자동으로 적응하여 처리 비용을 낮춥니다.

- 과학 계산 결합 시나리오: GPQA Diamond 94.3%의 과학적 추론 능력으로, 물리, 화학과 수학이 교차하는 문제에 적합합니다.

- 시각화된 수학 문제: 차트, 기하 도형이 포함된 수학 문제를 처리할 때, Gemini의 멀티모달 능력이 장점을 가집니다.

Claude Sonnet 4.6를 선택해야 할 수학 시나리오

- 수학 교육 및 학습: 문제 풀이 과정이 가장 명확하며, Learning Mode는 답을 직접 주기보다는 학생의 추론을 유도하도록 설계되었습니다.

- 문제 풀이 단계 학습: "왜 이렇게 해야 하는지" 이해가 필요한 시나리오에 적합합니다. Claude의 설명 능력은 공식적으로 최고로 인정받고 있습니다. 사용자의 70%가 이전 4.5 버전보다 Sonnet 4.6를 선호한다는 점은 사용자 경험이 질적으로 도약했음을 보여줍니다.

- 수학 연구 보조: 상세한 유도 과정이 필요한 연구자가 아이디어를 검증할 때 적합하며, 적응형 사고 깊이(Adaptive Thinking Depth)가 문제 복잡도에 자동으로 맞춥니다.

- 사무 및 금융 계산: 금융 분석 63.3%로 동급 최고, 사무 생산성 GDPval-AA 점수 1633 Elo로 더 비싼 Opus 4.6를 능가합니다.

- 프로그래밍+수학 결합: 프로그래밍 능력 79.6%로 Opus 4.6에 근접하여, 수학 계산 프로그램 작성이 필요한 개발자에게 적합합니다.

GPT-5.4를 선택해야 할 수학 시나리오

- 고난도 수학 경시대회: AIME 만점 100%, 경시대회 수준 수학 문제의 최우선 모델입니다.

- 긴 문서 수학 추론: 1.05M 컨텍스트 윈도우로, 대량의 수학 배경 정보가 필요한 복잡한 문제 처리에 적합합니다.

- 전문 수학 연구: 이전 GPT-5.2 버전이 FrontierMath에서 40.3%의 신기록을 세웠듯이, 전문가 수준의 첨단 수학 능력이 뛰어납니다.

- 투자 은행 및 양적 금융: 투자 은행 모델링 과제 87.3%의 높은 점수로, 고급 금융 수학 시나리오에 적합합니다.

혼합 사용 전략: 수학 문제 풀이 모델 최적 조합

실제 생산 환경에서는 최적의 효과를 얻기 위해 많은 팀이 혼합 사용 전략을 채택합니다.

전략 1: 난이도 기반 라우팅

- 기초 문제(산술, 단순 방정식) → Gemini 3.1 Pro Low 모드, 비용 최저

- 중급 문제(다단계 추론, 응용 문제) → Claude Sonnet 4.6 적응형 모드, 풀이 과정 명확

- 고난도 문제(경시대회, 증명) → GPT-5.4 Thinking 모드, 정확도 최고

전략 2: 교차 검증

- 먼저 Gemini 3.1 Pro로 빠르게 문제 해결(비용 저렴, 속도 빠름)

- 핵심 결과는 GPT-5.4로 이차 검증(정확도 높음)

- 사용자에게 설명이 필요할 때는 Claude Sonnet 4.6로 재구성하여 표현(표현 명확)

🚀 구현 제안: 위의 혼합 사용 전략은 APIYI(apiyi.com) 플랫폼을 통해 쉽게 구현할 수 있습니다. 하나의 API 키로 모든 모델을 호출할 수 있으며, 코드에서

model파라미터만 전환하면 됩니다.

수학 문제 해결 AI 모델 선택 가이드

위 분석을 종합하여, 다양한 사용자 그룹에 대한 선택 가이드를 제시합니다:

| 사용자 유형 | 추천 모델 | 추천 이유 |

|---|---|---|

| 학생/자습자 | Claude Sonnet 4.6 | 풀이 과정이 명확하고, Learning Mode가 사고를 유도해 줍니다. |

| 교육 플랫폼 개발자 | Gemini 3.1 Pro Preview | 종합 능력이 가장 뛰어나고, 가격이 가장 저렴하며, 3단계 사고 방식이 난이도에 적합합니다. |

| 경시대회 참가자/코치 | GPT-5.4 | AIME 만점, 경시대회 수준 문제 해결 능력이 가장 강력합니다. |

| 연구원 | Gemini 3.1 Pro Preview | GPQA Diamond 94.3%, 과학+수학 융합 능력이 선두를 달립니다. |

| 기업 대량 처리 | Gemini 3.1 Pro Preview | 가성비가 가장 뛰어나고, 입력 토큰당 $2.00/1M의 가격을 제공합니다. |

| 금융 퀀트 팀 | GPT-5.4 | 투자은행 모델링 87.3%, 금융 수학 시나리오에서 가장 강력합니다. |

💡 선택 제안: 어떤 수학 문제 해결 AI 모델을 선택할지는 주로 당신의 구체적인 적용 시나리오에 달려 있습니다. 어떤 모델이 가장 적합한지 확신이 서지 않는다면, APIYI apiyi.com 플랫폼을 통해 동일한 수학 문제로 세 가지 모델을 테스트해 보고, 해결 품질과 응답 속도를 기준으로 최종 선택을 하는 것을 권장합니다. 플랫폼은 통일된 인터페이스 호출을 지원하여 빠른 비교와 전환이 가능합니다.

주목할 만한 다른 수학 문제 해결 모델

위 세 가지 주력 모델 외에도, 특정 시나리오에서 주목할 만한 수학 문제 해결 AI 모델이 몇 가지 더 있습니다:

| 모델 이름 | AIME 2025 | 핵심 장점 | API 가격 (입력/출력) | 적합한 시나리오 |

|---|---|---|---|---|

| DeepSeek R2 | Gemini 3.1 Pro보다 우수 | 극한의 가성비 | $0.55/$2.19 per 1M | 예산에 민감한 대량 수학 처리 |

| Claude Opus 4.6 | — | GPQA 91.3%, 가장 깊은 설명 | $15/$75 per 1M | 고급 연구 및 심층 추론 |

| Qwen3-235B | 89.2% | 오픈소스 최강 | 자체 배포 비용 | 사유화 배포가 필요한 시나리오 |

| DeepSeek R1 | 약 87.5% | 오픈소스 벤치마크, 671B MoE | 자체 배포 비용 | 오픈소스 커뮤니티 연구 및 2차 개발 |

| MiMo-V2-Flash | 94.1% | 추론 비용이 Claude의 2.5% 수준 | 매우 낮음 | 초대규모 저비용 추론 |

특히 주목할 만한 것은 DeepSeek R2입니다. 이 모델은 AIME에서 Gemini 3.1 Pro Preview를 능가했지만, 가격은 후자의 약 1/4 수준에 불과합니다. 수학 문제 해결 시나리오가 예산에 매우 민감하다면, DeepSeek R2는 매우 경쟁력 있는 선택지입니다.

한편, MiMo-V2-Flash는 AIME 2025에서 94.1%의 높은 점수를 달성했지만, 추론 비용은 Claude의 2.5%에 불과하여, 대규모로 수학 문제를 일괄 처리해야 하는 에듀테크 플랫폼에 매우 적합합니다.

수학 문제 해결 AI 모델 프롬프트 최적화 팁

어떤 모델을 선택하든, 좋은 프롬프트는 수학 문제 해결 품질을 크게 향상시킬 수 있습니다. 검증된 수학 문제 해결 프롬프트 팁은 다음과 같습니다:

- 문제 유형 명시: 프롬프트에 '이것은 조합 수학 문제입니다' 또는 '이것은 해석 기하 문제입니다'라고 표시하여 모델이 올바른 해결 전략을 호출하도록 돕습니다.

- 단계별 풀이 요구: '단계별로 유도해 주시고, 각 단계마다 사용된 정리나 공식을 표시해 주세요'를 추가하여 풀이 과정의 가독성을 높입니다.

- 출력 형식 지정: 예를 들어 '수학 공식은 LaTeX 형식으로 출력해 주세요' 또는 '최종 답변은 상자로 표시해 주세요'와 같이 지정합니다.

- 배경 제약 제공: 'x가 양의 정수라고 가정합니다' 또는 '실수 범위 내에서 해를 구합니다'와 같이 제공하여 모델이 불필요한 분류 논의를 생성하는 것을 방지합니다.

- 다중 모델 교차 검증: 중요한 결과에 대해, 다른 모델로 답변 일관성을 검증하여 신뢰도를 높입니다.

자주 묻는 질문

Q1: 수학 문제 풀이 AI 모델의 벤치마크 점수는 믿을 만한가요?

벤치마크는 표준화된 수평적 비교 기준을 제공하지만, 실제 성능은 문제 유형, 프롬프트 품질 등 다양한 요소의 영향을 받습니다. AIME와 MATH는 현재 가장 권위 있는 수학 추론 벤치마크로, 학계와 산업계에서 널리 인정받고 있습니다. 벤치마크 데이터를 참고하는 동시에, 여러분 자신의 실제 문제로 테스트하여 검증하는 것을 권장합니다.

Q2: 학생인데, 어떤 수학 문제 풀이 AI 모델을 선택해야 하나요?

Claude Sonnet 4.6을 첫 번째로 추천합니다. 이 모델의 문제 풀이 과정이 가장 명확하며, 각 단계마다 명확한 추론 설명이 있어 수학 문제 풀이 방식을 학습하고 이해하는 데 매우 적합합니다. Anthropic의 Learning Mode 기능은 직접 답을 주기보다 여러분 스스로 생각하도록 유도할 수 있습니다. 특히 어려운 경시대회 문제를 만났을 때는 GPT-5.4로 전환하여 도움을 구할 수 있습니다.

Q3: 어떻게 하면 이 수학 문제 풀이 AI 모델들을 빠르게 시작해서 테스트할 수 있나요?

다중 모델 통합 인터페이스를 지원하는 API 중계 서비스 플랫폼을 이용해 테스트하는 것을 추천합니다:

- APIYI(apiyi.com)에 접속하여 계정을 등록하세요.

- API 키와 무료 테스트 크레딧을 획득하세요.

- 본문에서 제공하는 Python 코드 예제를 사용하여, model 매개변수만 수정하면 다른 모델로 전환할 수 있습니다.

- 동일한 수학 문제로 세 가지 모델을 각각 테스트하여 풀이 품질과 응답 속도를 비교하세요.

Q4: 이 수학 문제 풀이 AI 모델들은 LaTeX 공식 출력을 지원하나요?

세 모델 모두 LaTeX 형식의 수학 공식 출력을 지원합니다. 프롬프트에 "모든 수학 공식을 LaTeX 형식으로 출력해 주세요"라고 추가하기만 하면 됩니다. Gemini 3.1 Pro와 GPT-5.4의 LaTeX 서식이 더 표준적이며, Claude Sonnet 4.6은 공식 사이의 텍스트 설명이 더 상세합니다. 논문에 공식을 직접 복사해 붙여넣어야 하는 상황에서는 Gemini나 GPT 사용을 권장합니다.

Q5: 수학 문제 풀이 AI 모델은 이미지 속 수학 문제를 처리할 수 있나요?

Gemini 3.1 Pro Preview와 GPT-5.4는 모두 멀티모달 입력을 지원하여, 수학 문제가 포함된 이미지를 직접 업로드하여 해답을 얻을 수 있습니다. Gemini는 기하 도형과 손글씨 공식이 포함된 이미지 처리에서 특히 뛰어난 성능을 보입니다. Claude Sonnet 4.6 역시 이미지 입력을 지원하지만, 복잡한 기하 도형 인식에서는 Gemini에 약간 뒤처집니다. 여러분의 수학 문제가 종종 이미지 형태(예: 사진 검색 문제)로 나타난다면, Gemini 3.1 Pro Preview가 최선의 선택입니다.

요약

수학 문제 풀이 AI 모델의 핵심 선택 포인트:

- 종합 능력 최우선: Gemini 3.1 Pro Preview: MATH 95.1%로 종합 선두, $2.00/1M 토큰으로 최적 가격, 3단계 사고 시스템으로 다양한 난이도에 유연하게 대응

- 학습 이해 최우선: Claude Sonnet 4.6: 수학 능력 27%p 향상(89% 도달), 문제 풀이 단계 명확, 적응형 사고 깊이로 비용과 품질 균형

- 경시대회 난제 최우선: GPT-5.4: AIME 2025 만점 100%, 1.05M 초장기 컨텍스트 윈도우, 고난도 추론 능력 타의 추종 불허

모든 수학 시나리오에서 최적의 해답을 제공하는 단일 모델은 없습니다. 2026년 수학 문제 풀이 AI 모델의 경쟁 구도는 이렇게 정리할 수 있습니다:

- 종합 커버리지: Gemini 3.1 Pro Preview가 MATH 95.1%와 최저 가격으로 종합 최우선 위치 차지

- 학습 교육: Claude Sonnet 4.6은 27%p라는 수학적 도약과 비교할 수 없는 문제 풀이 설명 능력으로 교육 시나리오의 최적 선택

- 극한 경시대회: GPT-5.4는 AIME 만점이라는 절대적 실력으로 고난도 수학 경시대회 분야에서 독보적

- 예산 우선: DeepSeek R2는 Gemini의 1/4 미만 가격으로 비슷한 수준의 수학 추론 능력 제공

가장 현명한 전략은 여러분의 실제 요구에 맞는 적절한 모델을 선택하고, 심지어는 다른 난이도의 문제에서 여러 모델을 혼합 사용하여 각 모델의 고유한 장점을 최대한 활용하는 것입니다.

APIYI(apiyi.com)를 통해 이 모델들을 빠르게 테스트하고 비교하는 것을 추천합니다. 플랫폼은 무료 크레딧과 통합 API 인터페이스를 제공하여, 한 번의 연동으로 모든 주류 수학 추론 모델을 유연하게 호출할 수 있으며, 다중 모델 혼합 사용 전략을 쉽게 구현할 수 있습니다.

📚 참고 자료

-

Google DeepMind Gemini 3.1 Pro 모델 카드: 공식 벤치마크 데이터 및 기술 상세 정보

- 링크:

deepmind.google/models/model-cards/gemini-3-1-pro/ - 설명: 완전한 벤치마크 테스트 결과와 아키텍처 설명을 포함합니다.

- 링크:

-

Anthropic Claude Sonnet 4.6 발표 노트: 수학적 추론 능력 향상 상세 정보

- 링크:

docs.anthropic.com - 설명: Sonnet 4.6과 이전 세대 비교 데이터 및 적응적 사고 메커니즘 설명을 포함합니다.

- 링크:

-

OpenAI GPT-5.4 발표 공지: 최신 모델 기능 및 벤치마크 데이터

- 링크:

openai.com/index/introducing-gpt-5-4/ - 설명: GPT-5.4 완전한 벤치마크 테스트 결과와 추론 설정 설명을 포함합니다.

- 링크:

-

Artificial Analysis 모델 평가: 독립 제3자 벤치마크 비교 플랫폼

- 링크:

artificialanalysis.ai/evaluations/aime-2025 - 설명: AIME 2025 등 벤치마크 테스트의 독립적인 순위표와 분석을 제공합니다.

- 링크:

-

AIME 2025 벤치마크 순위표: 수학적 추론 능력 권위 있는 비교

- 링크:

vals.ai/benchmarks/aime - 설명: 지속적으로 업데이트되는 AI 수학 추론 벤치마크 순위 데이터

- 링크:

저자: APIYI 기술 팀

기술 교류: 댓글에서 여러분의 수학 문제 해결 AI 사용 경험을 공유해 주세요. 더 많은 모델 호출 튜토리얼은 APIYI docs.apiyi.com 문서 센터를 방문하세요.