AI 도구에 수만 행의 Excel 파일을 업로드했는데, 인터페이스에서 '잔액 부족' 오류가 발생합니다. 하지만 계좌에는 분명 돈이 남아있는데 말이죠? 이는 AI로 Excel 빅데이터를 처리할 때 가장 흔하게 겪는 문제 상황이며, 토큰 선공제 메커니즘과 컨텍스트 윈도우 제한이라는 이중 제약 때문입니다.

핵심 가치: 이 글을 읽고 나면, 왜 대용량 Excel 파일에서 오류가 발생하는지, AI를 이용해 수만 행의 데이터를 올바르게 분석하는 방법은 무엇인지, 그리고 어떤 방법이 가장 저렴하고 효율적인지 완벽하게 이해하게 될 거예요.

<!-- Error response bubble -->

<rect x="0" y="58" width="256" height="84" rx="9" fill="#2d0808" stroke="#ef4444" stroke-width="1.5"/>

<text x="128" y="80" font-family="'PingFang SC',sans-serif" font-size="13" font-weight="bold" fill="#ef4444" text-anchor="middle">❌ 오류 402</text>

<text x="128" y="100" font-family="monospace" font-size="10" fill="#fca5a5" text-anchor="middle">잔액 부족</text>

<text x="128" y="116" font-family="'PingFang SC',sans-serif" font-size="10" fill="#fca5a5" text-anchor="middle">잔액이 부족합니다. 충전 후 다시 시도해 주세요.</text>

<text x="128" y="132" font-family="'PingFang SC',sans-serif" font-size="9" fill="#94a3b8" text-anchor="middle">(선공제 $9.00 · 잔액 $5.20)</text>

<!-- AI avatar -->

<circle cx="268" cy="100" r="10" fill="#991b1b"/>

<text x="268" y="105" font-family="sans-serif" font-size="11" fill="#fecaca" text-anchor="middle">🤖</text>

<!-- Confused user thought -->

<rect x="40" y="158" width="218" height="50" rx="9" fill="#0f2028"/>

<text x="149" y="178" font-family="'PingFang SC',sans-serif" font-size="10" fill="#7dd3fc" text-anchor="middle">😕 하지만 제 계정에는 분명히 잔액이 있는데요!</text>

<text x="149" y="196" font-family="'PingFang SC',sans-serif" font-size="10" fill="#7dd3fc" text-anchor="middle">왜 잔액 부족이라고 뜨나요??</text>

<circle cx="28" cy="183" r="10" fill="#1d4ed8"/>

<text x="28" y="188" font-family="sans-serif" font-size="11" fill="#ffffff" text-anchor="middle">👤</text>

1. 대용량 Excel 파일을 업로드하면 왜 '잔액 부족' 오류가 발생할까요?

많은 사용자가 이 문제를 처음 겪을 때 매우 당황합니다. 계정 잔액이 분명히 충분한데, 왜 API는 계속 잔액 부족 오류를 반환할까요?

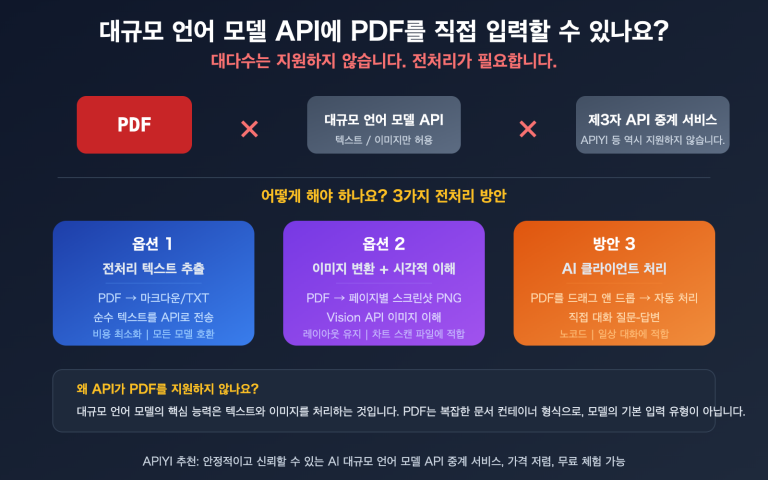

여기서 AI API의 핵심 메커니즘인 토큰 선결제 메커니즘을 이해해야 합니다.

토큰 선결제 메커니즘 상세 설명

Cherry Studio 또는 Chatbox와 같은 AI 클라이언트에서 파일을 업로드하고 요청을 보낼 때, API는 응답이 생성될 때까지 기다리지 않고 요금을 청구하지 않습니다. 요청이 전송되는 순간, 이번 요청에서 소모될 수 있는 최대 토큰 수를 미리 예상하고 해당 비용을 계정 잔액에서 임시로 '동결'(선결제)합니다.

이 선결제 과정은 대략 다음과 같습니다.

- 사용자가 Excel 파일을 업로드 → 클라이언트가 파일 내용을 순수 텍스트로 변환

- 순수 텍스트가 프롬프트(대화 컨텍스트)에 모두 삽입됩니다.

- API가 입력 토큰 수 + 예상 최대 출력 토큰 수를 계산합니다.

- 시스템 판단: 선결제 총액 > 계정 잔액 → '잔액 부족' 오류 반환

따라서 본질적으로 '돈이 없는' 것이 아니라, 이번 요청의 선결제 금액이 너무 커서 현재 계정 잔액을 초과한 것입니다.

AI 클라이언트와 ChatGPT의 본질적인 차이점

많은 분들이 Cherry Studio에서 Excel을 업로드하는 것과 ChatGPT에서 파일을 업로드하는 것이 같은 것이라고 오해합니다.

실제로는 완전히 다릅니다.

| 비교 기준 | Cherry Studio / Chatbox | ChatGPT (코드 인터프리터) |

|---|---|---|

| 파일 처리 방식 | 텍스트로 변환하여 컨텍스트에 모두 삽입 | 샌드박스 환경에서 코드 실행 처리 |

| 토큰 소모 | 파일 크기가 토큰 소모량과 직결 | 대화 컨텍스트 토큰 미소모 |

| 적합한 파일 크기 | 100행 이내 권장 | 대용량 파일 지원 (공식 제한 약 512MB) |

| 데이터 분석 능력 | 텍스트 이해만 가능, 코드 실행 불가 | Python을 직접 실행하여 통계 분석 가능 |

| API 연동 방식 | API 키를 통해 호출, 토큰 단위 과금 | ChatGPT Plus 구독제 |

🎯 핵심 인지: API 중계 서비스(예: APIYI apiyi.com)를 사용하여 AI를 호출할 때, 파일 업로드는 서드파티 클라이언트를 통해 이루어지며, 모든 파일 내용은 텍스트 토큰으로 변환되어 대규모 언어 모델로 전송됩니다. 이는 ChatGPT 공식 파일 처리 샌드박스 메커니즘과는 완전히 다릅니다.

2. 대용량 Excel 파일은 도대체 얼마나 많은 토큰을 소모할까요?

해결책을 논의하기 전에, 토큰 소모량에 대한 직관적인 이해를 먼저 확립해 봅시다.

토큰 환산 기초 지식

| 콘텐츠 유형 | 토큰 예상치 |

|---|---|

| 영단어 1개 | 약 1-2 토큰 |

| 영문자 1개 | 약 0.25 토큰 (4자 = 1토큰) |

| 한자 1개 | 약 1-2 토큰 |

| 날짜 1개 (예: 2024-01-15) | 약 5 토큰 |

| 숫자 1개 (예: 12345.67) | 약 3-4 토큰 |

| Excel 데이터 1행 (10열) | 약 30-80 토큰 |

실제 사례 계산

사용자가 겪었던 실제 시나리오를 예로 들어보겠습니다.

파일 A: 6만 행 × 10열의 프로세스 효율 데이터

예상치: 60,000 행 × 10 열 × 평균 5 토큰/셀

= 60,000 × 50

= 3,000,000 토큰 (약 300만 토큰!)

파일 B: 4만 행 × 8열의 비즈니스 데이터

예상치: 40,000 행 × 8 열 × 평균 5 토큰/셀

= 40,000 × 40

= 1,600,000 토큰 (약 160만 토큰)

각 모델의 컨텍스트 윈도우 및 비용 비교

| 모델 | 컨텍스트 윈도우 | 입력 단가 ($/1M 토큰) | 300만 토큰 처리 비용 |

|---|---|---|---|

| GPT-4o | 128K 토큰 | $2.50 | 처리 불가 (초과) |

| Claude 3.5 Sonnet | 200K 토큰 | $3.00 | 처리 불가 (초과) |

| Gemini 1.5 Pro | 1M 토큰 | $1.25 | 처리 불가 (초과) |

| Gemini 1.5 Pro 2.0 | 2M 토큰 | $1.25 | 약 $3.75/회 |

💡 보시다시피, 대부분의 모델 컨텍스트 윈도우는 6만 행의 Excel을 담을 수 없습니다. Gemini 2M 컨텍스트 모델을 억지로 사용하더라도, 한 번의 요청에 약 $3.75가 필요합니다.

삼. AI가 Excel 대용량 데이터를 처리하는 4가지 올바른 방법

근본 원인을 이해했으니, 이제 실제 테스트를 거친 4가지 해결책을 추천 순으로 소개합니다.

<line x1="0" y1="56" x2="194" y2="56" stroke="#059669" stroke-width="1" opacity="0.5"/>

<text x="0" y="74" font-size="11" font-weight="bold" fill="#34d399">작업 단계</text>

<rect x="0" y="80" width="194" height="18" rx="4" fill="#022c22"/>

<text x="8" y="93" font-size="9.5" fill="#6ee7b7">① 10개 행의 샘플 데이터를 추출하여 AI에 제공합니다.</text>

<rect x="0" y="102" width="194" height="18" rx="4" fill="#022c22"/>

<text x="8" y="115" font-size="9.5" fill="#6ee7b7">② AI 구조 이해, 분석 스크립트 생성</text>

<rect x="0" y="124" width="194" height="18" rx="4" fill="#022c22"/>

<text x="8" y="137" font-size="9.5" fill="#6ee7b7">③ 로컬에서 스크립트를 실행하여 전체 데이터를 처리</text>

<line x1="0" y1="152" x2="194" y2="152" stroke="#059669" stroke-width="1" opacity="0.5"/>

<text x="0" y="170" font-size="11" font-weight="bold" fill="#34d399">적용 시나리오</text>

<text x="0" y="186" font-size="10" fill="#a7f3d0">데이터량 1만 행 초과</text>

<text x="0" y="200" font-size="10" fill="#a7f3d0">통계 분석 / 보고서 생성</text>

<rect x="0" y="214" width="194" height="26" rx="6" fill="#065f46" stroke="#10b981" stroke-width="1.5"/>

<text x="97" y="231" font-size="11" font-weight="bold" fill="#34d399" text-anchor="middle">토큰 소모: < 2,000</text>

<line x1="0" y1="56" x2="194" y2="56" stroke="#3b82f6" stroke-width="1" opacity="0.5"/>

<text x="0" y="74" font-size="11" font-weight="bold" fill="#93c5fd">작업 단계</text>

<rect x="0" y="80" width="194" height="18" rx="4" fill="#1e3a5f"/>

<text x="8" y="93" font-size="9.5" fill="#93c5fd">① 행 단위로 여러 개의 하위 파일로 분할</text>

<rect x="0" y="102" width="194" height="18" rx="4" fill="#1e3a5f"/>

<text x="8" y="115" font-size="9.5" fill="#93c5fd">② 각 배치를 처리하도록 API를 반복 호출</text>

<rect x="0" y="124" width="194" height="18" rx="4" fill="#1e3a5f"/>

<text x="8" y="137" font-size="9.5" fill="#93c5fd">③ 각 배치 결과 취합</text>

<line x1="0" y1="152" x2="194" y2="152" stroke="#3b82f6" stroke-width="1" opacity="0.5"/>

<text x="0" y="170" font-size="11" font-weight="bold" fill="#93c5fd">적용 시나리오</text>

<text x="0" y="186" font-size="10" fill="#bfdbfe">5천~2만 행 데이터</text>

<text x="0" y="200" font-size="10" fill="#bfdbfe">줄별 분류 / 감성 분석</text>

<rect x="0" y="214" width="194" height="26" rx="6" fill="#1e3a5f" stroke="#3b82f6" stroke-width="1.5"/>

<text x="97" y="231" font-size="11" font-weight="bold" fill="#93c5fd" text-anchor="middle">총 비용 약 0.5-1.5달러</text>

<line x1="0" y1="56" x2="194" y2="56" stroke="#a855f7" stroke-width="1" opacity="0.5"/>

<text x="0" y="74" font-size="11" font-weight="bold" fill="#d8b4fe">작업 단계</text>

<rect x="0" y="80" width="194" height="18" rx="4" fill="#3b0764"/>

<text x="8" y="93" font-size="9.5" fill="#d8b4fe">① Excel 피벗 테이블로 집계 통계</text>

<rect x="0" y="102" width="194" height="18" rx="4" fill="#3b0764"/>

<text x="8" y="115" font-size="9.5" fill="#d8b4fe">② 요약 데이터 (수십 줄)를 AI에 제공</text>

<rect x="0" y="124" width="194" height="18" rx="4" fill="#3b0764"/>

<text x="8" y="137" font-size="9.5" fill="#d8b4fe">③ AI 분석 보고서 및 통찰 작성</text>

<line x1="0" y1="152" x2="194" y2="152" stroke="#a855f7" stroke-width="1" opacity="0.5"/>

<text x="0" y="170" font-size="11" font-weight="bold" fill="#d8b4fe">적용 시나리오</text>

<text x="0" y="186" font-size="10" fill="#e9d5ff">전반적인 추세 분석 보고서가 필요합니다</text>

<text x="0" y="200" font-size="10" fill="#e9d5ff">원본 데이터를 한 줄씩 이해할 필요가 없습니다.</text>

<rect x="0" y="214" width="194" height="26" rx="6" fill="#3b0764" stroke="#a855f7" stroke-width="1.5"/>

<text x="97" y="231" font-size="11" font-weight="bold" fill="#d8b4fe" text-anchor="middle">토큰 소모: 극히 적음</text>

<line x1="0" y1="56" x2="194" y2="56" stroke="#f97316" stroke-width="1" opacity="0.5"/>

<text x="0" y="74" font-size="11" font-weight="bold" fill="#fdba74">추천 모델</text>

<rect x="0" y="80" width="194" height="18" rx="4" fill="#431407"/>

<text x="8" y="93" font-size="9.5" fill="#fdba74">Gemini 2.0 Flash (1M 컨텍스트 윈도우)</text>

<rect x="0" y="102" width="194" height="18" rx="4" fill="#431407"/>

<text x="8" y="115" font-size="9.5" fill="#fdba74">Gemini 1.5 Pro (1M 컨텍스트 윈도우)</text>

<rect x="0" y="124" width="194" height="18" rx="4" fill="#431407"/>

<text x="8" y="137" font-size="9.5" fill="#fdba74">Claude 3.5 Sonnet(200K)</text>

<line x1="0" y1="152" x2="194" y2="152" stroke="#f97316" stroke-width="1" opacity="0.5"/>

<text x="0" y="170" font-size="11" font-weight="bold" fill="#fdba74">적용 시나리오</text>

<text x="0" y="186" font-size="10" fill="#fed7aa">데이터량 5000행 미만</text>

<text x="0" y="200" font-size="10" fill="#fed7aa">더 높은 API 비용을 감당할 수 있다</text>

<rect x="0" y="214" width="194" height="26" rx="6" fill="#431407" stroke="#f97316" stroke-width="1.5"/>

<text x="97" y="231" font-size="11" font-weight="bold" fill="#fdba74" text-anchor="middle">비용: $1-5 / 회</text>

방법 A (강력 추천): 샘플 데이터 + AI가 스크립트 작성

핵심 아이디어: AI가 전체 데이터를 직접 처리하게 하는 대신, AI가 데이터 구조를 이해한 후 로컬에서 실행할 처리 스크립트를 생성하게 합니다.

작업 단계:

1단계: 샘플 데이터 추출 (10행이면 충분해요)

import pandas as pd

# 첫 10행을 샘플로 읽어옵니다 (헤더 포함)

df_sample = pd.read_excel("your_data.xlsx", nrows=10)

# AI에 복사하기 쉽도록 텍스트 형식으로 출력합니다

print(df_sample.to_string())

print("\n--- 데이터 개요 ---")

print(f"총 행 수: {len(pd.read_excel('your_data.xlsx'))}")

print(f"열 이름: {list(df_sample.columns)}")

print(f"데이터 유형:\n{df_sample.dtypes}")

2단계: 샘플 데이터와 요구사항을 AI에 전달

프롬프트 예시:

다음은 제 Excel 데이터의 첫 10행 샘플과 구조 설명입니다:

[이전 단계의 출력 내용 붙여넣기]

총 데이터는 6만 행입니다. 다음 내용을 분석해야 합니다:

1. 부서별 프로세스 완료율 통계

2. 평균 처리 시간이 2시간을 초과하는 프로세스 노드 찾기

3. 주간 트렌드 보고서 생성

전체 데이터를 읽고 분석 결과를 출력하는 Python 스크립트를 작성해 주세요.

3단계: AI가 생성한 스크립트를 로컬에서 실행

AI는 10행의 샘플 데이터를 기반으로 필드 의미를 이해한 후, 완전한 분석 스크립트를 생성합니다. 이 스크립트를 로컬에서 실행하여 전체 6만 행의 데이터를 처리하면, 이 과정에서 더 이상 AI API를 호출할 필요가 없으며, 토큰 소모도 없습니다.

방법의 장점:

- 토큰 소모가 극히 적습니다 (10행 샘플 ≈ 수백 토큰)

- 로컬 스크립트는 반복 실행이 가능하며, 데이터 업데이트 후 바로 다시 실행할 수 있습니다.

- 동일한 유형의 데이터를 정기적으로 처리해야 하는 시나리오에 적합합니다.

🎯 추천 도구: APIYI apiyi.com에서 Claude 3.5 Sonnet 또는 GPT-4o를 호출하여 데이터 처리 스크립트를 생성해 보세요. 이러한 코드 생성 작업에서 모델 성능이 매우 뛰어나며, 단일 요청당 일반적으로 2000 토큰을 초과하지 않아 비용이 매우 저렴합니다.

방법 B: 데이터 분할 처리

적용 시나리오: 데이터 행 수가 5천~2만 행 사이이며, AI가 각 행의 내용을 이해해야 하는 경우 (예: 감성 분석, 텍스트 분류).

작업 단계:

import pandas as pd

def process_in_batches(file_path, batch_size=500):

"""대용량 Excel 파일을 배치로 처리합니다"""

df = pd.read_excel(file_path)

total_rows = len(df)

results = []

for start in range(0, total_rows, batch_size):

end = min(start + batch_size, total_rows)

batch = df.iloc[start:end]

# 이 배치 데이터를 CSV 텍스트로 변환하여 AI에 전달합니다

batch_text = batch.to_csv(index=False)

print(f"현재 {start+1}-{end}행을 처리 중입니다 (총 {total_rows}행)")

# 여기에 AI API를 호출하여 batch_text를 처리하는 코드를 추가합니다

# result = call_ai_api(batch_text)

# results.append(result)

return results

각 배치 500행은 약 25,00040,000 토큰을 소모하며, GPT-4o mini를 사용하여 6만 행의 전체 데이터를 처리하는 총 비용은 약 $0.5$1.5 USD입니다.

주의사항:

- 각 배치 처리 후 결과를 취합해야 하며, 배치 간 통계 정확성에 유의해야 합니다.

- 분할 처리는 행 간의 연관 관계를 놓칠 수 있으므로, 행 간 독립적인 작업에 적합합니다.

방법 C: 데이터 전처리 후 업로드

적용 시나리오: AI가 전체적인 추세를 분석하고 분석 보고서를 작성해야 하지만, AI가 각 행의 원본 데이터를 볼 필요는 없는 경우.

작업 단계:

1단계: Excel 피벗 테이블 또는 Python으로 데이터 요약 생성

import pandas as pd

df = pd.read_excel("data.xlsx")

# 요약 통계 생성

summary = {

"총 행 수": len(df),

"시간 범위": f"{df['날짜'].min()} 부터 {df['날짜'].max()}",

"부서별 통계": df.groupby('부서')['완료율'].mean().to_dict(),

"월별 추세": df.groupby(df['날짜'].dt.month)['처리 시간'].mean().to_dict(),

"이상 데이터 수": len(df[df['처리 시간'] > 120])

}

# 요약 데이터를 구조화된 텍스트로 변환하여 AI에 전달하여 분석 보고서를 작성하게 합니다

import json

print(json.dumps(summary, ensure_ascii=False, indent=2))

2단계: 요약 데이터를 AI에 전달하여 분석 보고서 작성

요약 데이터는 보통 수백 행에 불과하므로, AI에 전달해도 토큰 소모가 거의 없으면서도 AI가 완전한 추세 분석 및 비즈니스 통찰 보고서를 생성할 수 있습니다.

방법 D: 초대형 컨텍스트 모델 선택

적용 시나리오: AI가 정말로 전체 데이터의 의미론적 내용을 이해해야 하며, 높은 비용을 기꺼이 감수할 의향이 있는 경우.

| 모델 | 최대 컨텍스트 윈도우 | 적합한 데이터 양 | 참고 비용 |

|---|---|---|---|

| Gemini 1.5 Pro | 100만 토큰 | 약 2~3만 행 | APIYI를 통해 종량제 과금 |

| Gemini 2.0 Flash | 100만 토큰 | 약 2~3만 행 | 가성비가 비교적 높음 |

| Claude 3.5 Sonnet | 20만 토큰 | 약 3000~5000 행 | 코드 생성 품질이 매우 뛰어남 |

💡 초대형 컨텍스트 모델을 사용하더라도, 데이터를 미리 정제하는 것을 강력히 권장합니다 (빈 행 삭제, 중복 열 병합, 관련 없는 필드 제거). 이는 토큰 소모를 줄이고 선결제 한도 초과를 방지하는 데 도움이 됩니다.

🎯 통합 API 장점: APIYI apiyi.com 플랫폼을 통해 Gemini, Claude, GPT 등 다양한 대규모 컨텍스트 모델을 통합 API 인터페이스로 호출할 수 있습니다. 각 모델별로 별도의 계정을 등록할 필요 없이, 빠르고 편리하게 모델을 전환하고 비용을 비교할 수 있습니다.

4. 다시 문제에 빠지지 않는 방법

위에서 설명한 해결책들을 이해하셨다면, 이제 AI로 데이터를 처리할 때 일상적으로 활용할 수 있는 몇 가지 모범 사례를 알려드릴게요.

<!-- Arrow -->

<line x1="182" y1="38" x2="182" y2="52" stroke="#ef4444" stroke-width="1.5" stroke-dasharray="4,3"/>

<polygon points="176,50 188,50 182,56" fill="#ef4444"/>

<!-- Step 2 -->

<rect x="0" y="56" width="364" height="38" rx="7" fill="#2d1414" stroke="#ef4444" stroke-width="1"/>

<text x="22" y="70" font-size="11" font-weight="bold" fill="#fca5a5">단계 2: AI 데이터 분석</text>

<text x="22" y="86" font-size="10" fill="#ef4444">데이터 양이 많아 "lost-in-the-middle" 효과 발생, 분석 부정확</text>

<!-- Arrow -->

<line x1="182" y1="94" x2="182" y2="108" stroke="#ef4444" stroke-width="1.5" stroke-dasharray="4,3"/>

<polygon points="176,106 188,106 182,112" fill="#ef4444"/>

<!-- Step 3 -->

<rect x="0" y="112" width="364" height="38" rx="7" fill="#3d0808" stroke="#dc2626" stroke-width="2"/>

<text x="22" y="126" font-size="12" font-weight="bold" fill="#ff6b6b">단계 3: 반복 디버깅</text>

<text x="22" y="142" font-size="10" fill="#fca5a5">매번 디버깅 시 재업로드 및 재분석 필요, 시간과 비용 소모</text>

<!-- Problem stats -->

<rect x="0" y="162" width="174" height="54" rx="7" fill="#1a0505" stroke="#ef4444" stroke-width="1"/>

<text x="87" y="180" font-size="10" fill="#fca5a5" text-anchor="middle">성공률</text>

<text x="87" y="202" font-size="22" font-weight="bold" fill="#ef4444" text-anchor="middle">20%</text>

<rect x="186" y="162" width="178" height="54" rx="7" fill="#1a0505" stroke="#ef4444" stroke-width="1"/>

<text x="275" y="180" font-size="10" fill="#fca5a5" text-anchor="middle">평균 소요 시간</text>

<text x="275" y="202" font-size="18" font-weight="bold" fill="#ef4444" text-anchor="middle">30분 이상</text>

<!-- Cost label -->

<rect x="0" y="228" width="364" height="28" rx="6" fill="#2d0808" stroke="#dc2626" stroke-width="1.5"/>

<text x="182" y="246" font-size="12" font-weight="bold" fill="#ff6b6b" text-anchor="middle">총비용: 매우 높음</text>

<!-- Arrow -->

<line x1="182" y1="38" x2="182" y2="52" stroke="#10b981" stroke-width="1.5" stroke-dasharray="4,3"/>

<polygon points="176,50 188,50 182,56" fill="#10b981"/>

<!-- Step 2 -->

<rect x="0" y="56" width="364" height="38" rx="7" fill="#022c22" stroke="#10b981" stroke-width="1"/>

<text x="22" y="70" font-size="11" font-weight="bold" fill="#6ee7b7">단계 2: AI 스크립트 생성</text>

<text x="22" y="86" font-size="10" fill="#34d399">샘플과 요구사항 기반으로 재사용 가능한 처리 스크립트 생성</text>

<!-- Arrow -->

<line x1="182" y1="94" x2="182" y2="108" stroke="#10b981" stroke-width="1.5" stroke-dasharray="4,3"/>

<polygon points="176,106 188,106 182,112" fill="#10b981"/>

<!-- Step 3 -->

<rect x="0" y="112" width="364" height="38" rx="7" fill="#064e3b" stroke="#059669" stroke-width="2"/>

<text x="22" y="126" font-size="12" font-weight="bold" fill="#34d399">단계 3: 로컬에서 스크립트 실행</text>

<text x="22" y="142" font-size="10" fill="#a7f3d0">대용량 파일 처리, 반복 업로드 불필요, 고효율, 저비용</text>

<!-- Success stats -->

<rect x="0" y="162" width="174" height="54" rx="7" fill="#021a0d" stroke="#10b981" stroke-width="1"/>

<text x="87" y="180" font-size="10" fill="#6ee7b7" text-anchor="middle">성공률</text>

<text x="87" y="202" font-size="22" font-weight="bold" fill="#34d399" text-anchor="middle">95%</text>

<rect x="186" y="162" width="178" height="54" rx="7" fill="#021a0d" stroke="#10b981" stroke-width="1"/>

<text x="275" y="180" font-size="10" fill="#6ee7b7" text-anchor="middle">평균 소요 시간</text>

<text x="275" y="202" font-size="18" font-weight="bold" fill="#34d399" text-anchor="middle">5분</text>

<!-- Cost label -->

<rect x="0" y="228" width="364" height="28" rx="6" fill="#064e3b" stroke="#059669" stroke-width="1.5"/>

<text x="182" y="246" font-size="12" font-weight="bold" fill="#34d399" text-anchor="middle">총비용: 매우 낮음</text>

사용 전 토큰 예상 방법

파일을 업로드하기 전에 다음 방법으로 토큰 양을 빠르게 예상할 수 있습니다.

import pandas as pd

def estimate_tokens(file_path):

"""Excel 파일을 텍스트로 변환했을 때의 토큰 수를 대략적으로 추정합니다."""

df = pd.read_excel(file_path)

# 데이터를 CSV 텍스트로 변환

csv_text = df.to_csv(index=False)

# 대략적인 추정: 영어는 약 4자/토큰, 중국어는 약 1.5자/토큰

char_count = len(csv_text)

estimated_tokens = char_count / 3.5 # 영어와 중국어 혼합 시 평균값 사용

print(f"파일 행 수: {len(df)}")

print(f"파일 열 수: {len(df.columns)}")

print(f"CSV 문자 수: {char_count:,}")

print(f"예상 토큰 수: {estimated_tokens:,.0f}")

print(f"GPT-4o ($2.5/1M)로 계산 시 예상 비용: ${estimated_tokens/1_000_000*2.5:.4f}")

if estimated_tokens > 100_000:

print("⚠️ 경고: 토큰 양이 10만 개를 초과합니다. 방식 A(샘플 + 스크립트) 사용을 권장합니다.")

estimate_tokens("your_data.xlsx")

일반적인 오류 및 해결책 비교표

| 오류 현상 | 근본 원인 | 해결책 |

|---|---|---|

| "잔액 부족" 보고되지만 잔액이 있음 | 토큰 선결제 금액이 계정 잔액을 초과함 | 잔액 충전 또는 방식 A/C 사용 |

| 응답이 매우 느리거나 시간 초과됨 | 입력 토큰이 너무 많아 추론 시간이 길어짐 | 입력 데이터 양 줄이기 |

| AI 분석 결과가 부정확함 | 데이터 양이 너무 많아 "lost-in-the-middle" 효과 발생 | 데이터 간소화, 배치 처리 사용 |

| API에서 컨텍스트 길이 초과 보고됨 | 모델의 최대 컨텍스트 윈도우를 초과함 | 더 큰 컨텍스트 모델 사용 또는 배치 처리 |

| 매번 비용이 매우 높음 | 대량의 데이터를 반복적으로 업로드함 | 방식 A를 사용하여 재사용 가능한 로컬 스크립트 생성 |

V. 실전 연습: 6만 행의 프로세스 데이터 분석

아래에서는 완전한 비즈니스 사례를 통해 문제 해결의 전 과정을 시연합니다.

배경: 운영팀은 부서, 프로세스명, 시작 시간, 종료 시간, 처리자, 완료 상태 등의 필드를 포함하는 6만 행의 프로세스 효율성 데이터를 가지고 있습니다. AI가 어떤 프로세스 노드의 효율성이 가장 낮은지 분석하기를 원합니다.

Step 1: 샘플 추출

import pandas as pd

# 상위 10행 읽기

df = pd.read_excel("process_data.xlsx", nrows=10)

print("=== 데이터 샘플 (상위 10행) ===")

print(df.to_string())

print("\n=== 필드 설명 ===")

for col in df.columns:

print(f"- {col}: {df[col].dtype}, 예시 값: {df[col].iloc[0]}")

Step 2: AI에 전달하여 분석 스크립트 받기

위 출력 내용을 AI에 전달하고, 다음 요구사항을 추가합니다:

다음은 제 Excel 프로세스 데이터의 구조와 10행 샘플입니다:

[출력 내용 붙여넣기]

요구사항:

1. 각 '프로세스명'의 평균 처리 시간(종료 시간 - 시작 시간) 계산

2. 부서별 프로세스 완료율('완료 상태'가 '완료'인 비율) 통계

3. 평균 처리 시간이 가장 긴 상위 10개 프로세스를 찾아 표로 출력

4. 결과는 analysis_result.xlsx 파일로 저장

완전히 실행 가능한 Python 스크립트를 작성해 주세요.

Step 3: 로컬에서 스크립트 실행

AI는 다음과 유사한 분석 스크립트를 생성할 것입니다 (예시 간소화 버전):

import pandas as pd

# 전체 데이터 읽기

df = pd.read_excel("process_data.xlsx")

# 처리 시간 계산 (분 단위)

df['처리时长_分钟'] = (

pd.to_datetime(df['结束时间']) - pd.to_datetime(df['开始时间'])

).dt.total_seconds() / 60

# 프로세스별 평균 시간 통계

process_avg = (

df.groupby('流程名称')['처리时长_分钟']

.agg(['mean', 'count'])

.rename(columns={'mean': '평균时长', 'count': '총次数'})

.sort_values('평균时长', ascending=False)

)

# 부서별 완료율 통계

dept_completion = (

df.groupby('部门')['完成状态']

.apply(lambda x: (x == '完成').mean() * 100)

.round(2)

.rename('완료率%')

)

# 가장 느린 상위 10개 프로세스 출력

print("=== 가장 오래 걸리는 상위 10개 프로세스 노드 ===")

print(process_avg.head(10).to_string())

# 결과 저장

with pd.ExcelWriter("analysis_result.xlsx") as writer:

process_avg.to_excel(writer, sheet_name="流程效率分析")

dept_completion.to_excel(writer, sheet_name="部门完成率")

print("\n✅ 분석 결과가 analysis_result.xlsx에 저장되었습니다.")

전체 프로세스의 토큰 소모량 비교:

| 방식 | 토큰 소모량 | 예상 비용 (GPT-4o) | 분석 품질 |

|---|---|---|---|

| 6만 행 직접 업로드 | ~300만 토큰 | $7.5+ 및 컨텍스트 윈도우 초과 | 완료 불가 |

| 방안 A (샘플 + 스크립트) | ~2000 토큰 | < $0.01 | 완전하고 정확함 |

🎯 비용 비교: 방안 A의 소모량은 직접 업로드 방식의 0.1% 미만이며, 분석 결과는 더 정확하고 재사용 가능합니다. APIYI apiyi.com을 통해 GPT-4o 또는 Claude 3.5 Sonnet을 호출하여 데이터 처리 스크립트를 생성하는 것을 추천합니다. 효과가 뛰어나고 비용이 매우 저렴합니다.

VI. 자주 묻는 질문 (FAQ)

Q1: Python 기초가 없어도 이 방안을 사용할 수 있나요?

물론입니다. 방안 A의 핵심은 'AI가 스크립트를 작성하고, 여러분이 실행하는 것'입니다. 여러분은 다음만 하면 됩니다:

- Python 설치 (공식 웹사이트: python.org, 다음-다음만 누르면 됩니다)

- pandas 설치: 터미널에

pip install pandas openpyxl입력 - AI에 샘플 데이터 추출 → AI가 스크립트 생성 →

.py파일로 저장 → 더블 클릭하여 실행

명령줄에 익숙하지 않은 사용자라면 Jupyter Notebook (Anaconda 설치 패키지에 포함)을 사용하여 더 직관적으로 작업할 수도 있습니다.

💡 APIYI apiyi.com에서는 내장된 코드 인터프리터 기능을 사용하여 AI가 스크립트 로직을 직접 생성하고 검증하게 하여 디버깅 시간을 줄일 수도 있습니다.

Q2: Python 외에 대용량 데이터를 처리하는 다른 방법이 있나요?

네, 다음 몇 가지 방법은 사용 편의성 순으로 정렬되어 있습니다:

- Excel 내장 기능: 피벗 테이블 + Power Query, 프로그래밍 필요 없음, 집계 통계에 적합

- Python pandas: 가장 유연하고 처리 효율성이 높으며, 중급 및 고급 사용자에게 추천

- Microsoft Copilot (Excel 플러그인): Excel 내에서 AI와 직접 대화하여 분석하지만, 여전히 행 수 제한이 있습니다

- 전문 데이터 분석 도구: Tableau, Power BI는 데이터 소스에 연결하여 대용량 데이터 처리 능력이 강력합니다

Q3: 계정 잔액은 얼마 정도가 적절하며, 선결제 오류를 피할 수 있나요?

이는 여러분의 일상적인 사용 시나리오에 따라 다릅니다. 일반적으로 다음을 권장합니다:

- 일반 대화 사용자: $5-20 잔액 유지

- 데이터 처리 사용자 (가끔 파일 업로드): $20-50 잔액 유지

- 고빈도 API 호출: 자동 충전 설정을 권장하거나 $100+ 잔액 유지

🎯 잔액 관리: APIYI apiyi.com 콘솔에서 토큰 소모 내역을 확인하고, 사용량 알림을 설정하여 잔액 부족으로 인해 업무에 지장이 생기는 것을 방지할 수 있습니다. 플랫폼은 필요에 따라 충전을 지원하며, 최소 소비 요구 사항이 없습니다.

Q4: 제 데이터에 개인 정보가 포함되어 있는데, 샘플 데이터를 AI에 보내도 될까요?

합리적인 방법은 다음과 같습니다:

- 비식별화 후 AI에 제공: 이름, 휴대폰 번호, 신분증 번호 등 민감한 필드를 예시 값으로 대체합니다 (예: '장삼' → '사용자 A')

- 필드명과 데이터 타입만 제공: 구체적인 값은 제공하지 않고, AI에게 필드 구조와 데이터 타입만 알려줍니다

- 로컬 모델 방안: Ollama를 사용하여 로컬 모델(예: Qwen2.5)을 실행하면, 데이터가 로컬 머신을 벗어나지 않습니다

요약

AI가 Excel 빅데이터를 처리할 때 가장 흔한 오해는 전체 파일을 직접 업로드하는 것입니다. 이는 토큰 폭발, 인터페이스 오류, 비용 통제 불능으로 이어집니다. 핵심 해결책은 매우 간단합니다:

AI가 '전체를 보고 계산'하는 대신 '샘플을 보고 스크립트를 작성'하게 하세요.

네 가지 솔루션의 적용 시나리오 요약:

| 시나리오 | 추천 솔루션 | 난이도 |

|---|---|---|

| 데이터 양 > 1만 행, 통계 분석 필요 | 솔루션 A: 샘플 + 스크립트 | ⭐⭐ (Python 실행 필요) |

| 데이터 양 5000-2만 행, 행별 이해 필요 | 솔루션 B: 배치 처리 | ⭐⭐⭐ (API 호출 필요) |

| 추세 보고서만 필요, 행별 분석 불필요 | 솔루션 C: 사전 처리 요약 | ⭐ (Excel로 가능) |

| 데이터 양 < 5000 행, 높은 비용 감당 가능 | 솔루션 D: 대규모 컨텍스트 모델 | ⭐ (직접 업로드) |

지금 바로 솔루션 A를 시도해 보세요: Excel 파일에서 처음 10행을 추출한 다음, APIYI apiyi.com에서 GPT-4o 또는 Claude 3.5 Sonnet을 선택하고, AI에게 분석 요구사항을 알려주어 처리 스크립트를 생성하게 하세요—대부분의 데이터 분석 작업은 0.01달러 미만으로 해결할 수 있습니다.

🎯 빠르게 시작하기: APIYI apiyi.com에 접속하여 가입하면 다양한 주요 모델을 경험할 수 있습니다. OpenAI, Claude, Gemini 등 통합 인터페이스 호출을 지원하며, 실제 사용량에 따라 요금이 부과되고, 월정액이나 최소 소비액이 없습니다. 비즈니스 팀과 개인 사용자가 다양한 데이터 분석 작업을 처리하는 데 적합합니다.

이 글은 APIYI 기술팀이 실제 사용자 피드백과 테스트 경험을 바탕으로 작성했습니다. 질문이나 제안이 있으시면 apiyi.com을 통해 저희에게 연락해 주세요.