최근 많은 개발자들이 Gemini API를 호출할 때 다음과 같은 오류 메시지를 만났습니다:

{

"error": {

"code": 503,

"message": "This model is currently experiencing high demand. Spikes in demand are usually temporary. Please try again later.",

"status": "UNAVAILABLE"

}

}

쉽게 말해, 이 모델이 지금 너무 인기가 많아서 서버가 감당하기 어렵다는 뜻이니, 잠시 후에 다시 시도해 보세요.

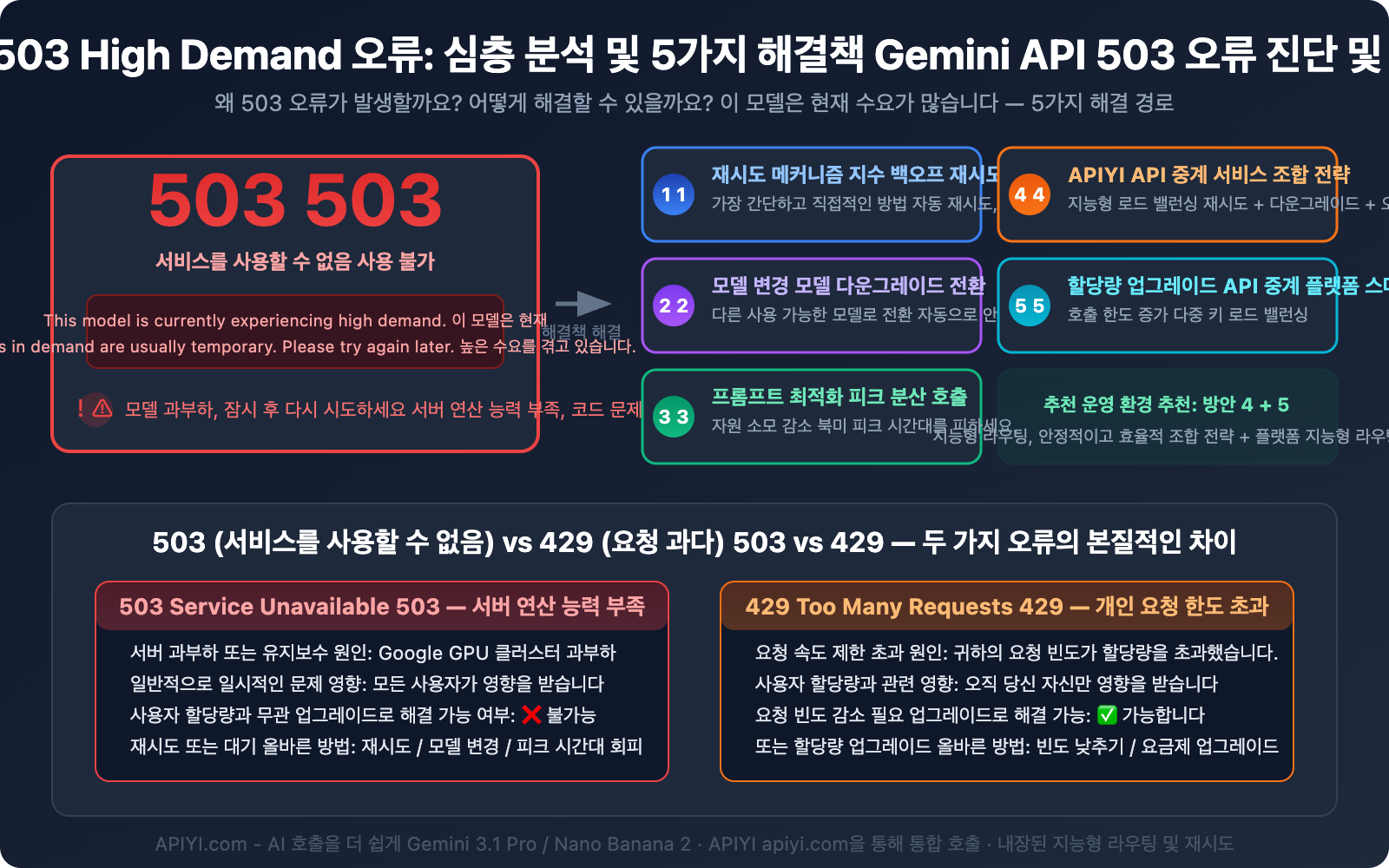

이 문제는 Gemini 3.1 Pro Preview와 Gemini 3.1 Flash Image Preview (Nano Banana 2) 이 두 가지 새로운 모델에서 특히 심각합니다. 이 글에서는 이 오류의 본질, 다른 일반적인 오류와의 차이점, 그리고 실제로 효과가 입증된 5가지 해결책을 자세히 설명해 드릴게요.

핵심 가치: 이 글을 다 읽고 나면, 503 high demand 오류의 근본 원인을 정확히 이해하고, 즉시 적용 가능한 5가지 해결책을 익혀서 더 이상 이 오류 때문에 개발 진행이 멈추는 일이 없을 거예요.

Gemini API 503 High Demand 오류는 정확히 무슨 의미인가요?

먼저 이 문제를 쉽게 이해할 수 있는 비유를 들어볼게요.

Google의 Gemini 서버를 인기 맛집이라고 상상해 보세요. 평소에는 장사가 잘 되고 좌석도 충분합니다. 그런데 어느 날 갑자기 소셜 미디어에서 화제가 되어(새 모델 출시) 온 도시 사람들이 줄을 서기 시작합니다. 식당의 수용 능력은 정해져 있어서, 자리가 다 차면 더 이상 손님을 받을 수 없죠. 이때 당신이 문 앞에 도착하면, 종업원이 이렇게 말할 겁니다. "죄송합니다. 지금 손님이 너무 많아요. 피크 시간대는 보통 일시적이니 잠시 후에 다시 와주세요."

이것이 바로 This model is currently experiencing high demand 오류의 본질입니다. 즉, 당신의 코드에 문제가 있거나, API 키에 문제가 있는 것이 아니라, Google 측 서버의 컴퓨팅 파워가 부족한 것입니다.

Gemini 503 오류의 3가지 핵심 사실

| 사실 | 설명 | 영향 |

|---|---|---|

| 서버 측 문제 | 503은 Google 서버 용량 부족 문제로, 사용자 코드 및 설정과는 무관합니다 | 유료 요금제를 업그레이드해도 해결되지 않습니다 |

| 모든 사용자 영향 | 무료 사용자, 유료 사용자, 기업 고객 모두 겪을 수 있습니다 | "돈을 낸다고 해결되는" 문제가 아닙니다 |

| 일반적으로 일시적 | 피크 시간대 503 오류의 약 70%는 60분 이내에 자동으로 복구됩니다 | 코드 수정이 아닌 재시도 메커니즘이 필요합니다 |

Gemini 3.1 Pro와 Nano Banana 2가 특히 503 오류에 취약한 이유

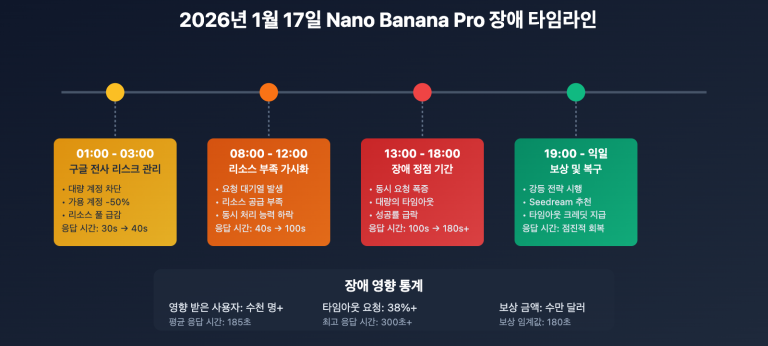

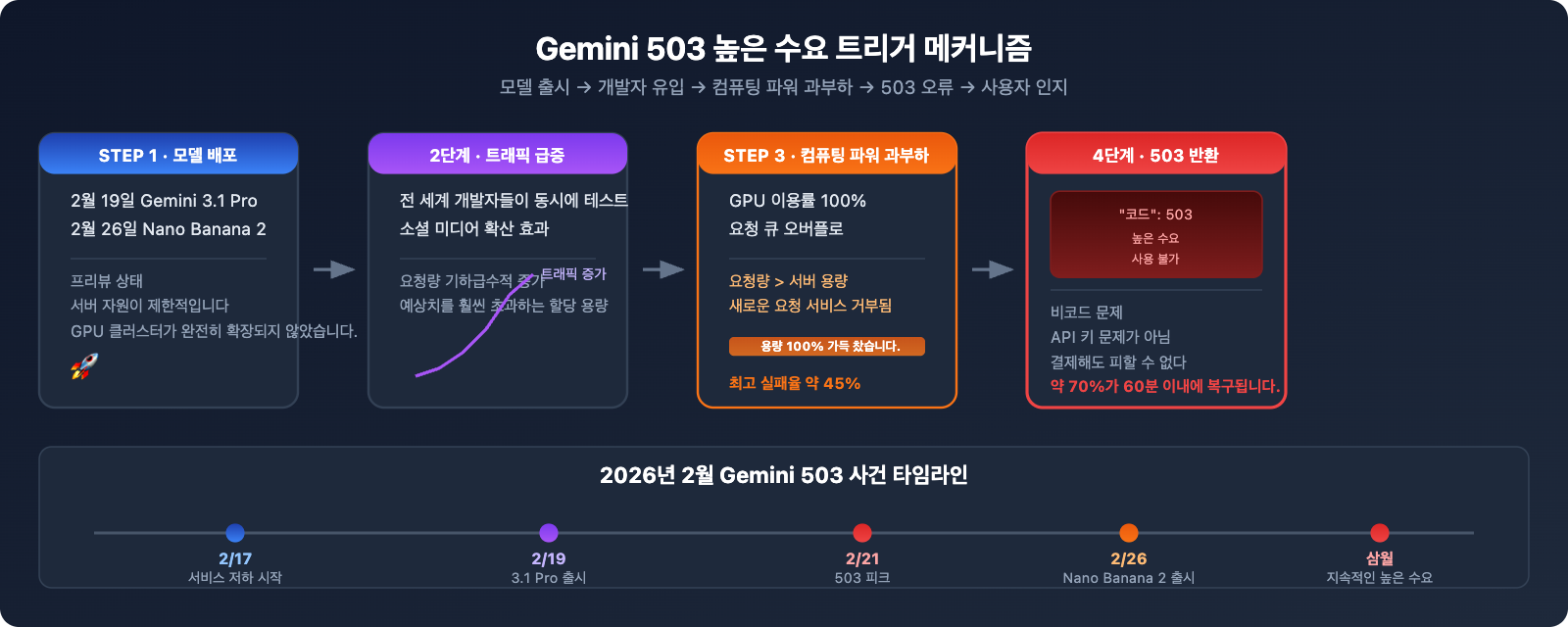

2026년 2월의 503 오류 발생에는 명확한 타임라인이 있습니다.

- 2월 19일: Google이 Gemini 3.1 Pro Preview를 출시하며, 수많은 개발자가 테스트를 위해 몰려들었습니다.

- 2월 26일: Nano Banana 2(

gemini-3.1-flash-image-preview)가 출시되며, 이미지 생성 수요가 급증했습니다. - 2월 17-21일: StatusGator는 Gemini 서비스 성능 저하 경고를 일주일 내내 연속으로 기록했습니다.

- 피크 시간대 실패율 약 45%: 커뮤니티 데이터에 따르면 피크 시간대 요청 실패율이 거의 절반에 달했습니다.

근본 원인: 새 모델이 막 출시되어 Google이 할당한 컴퓨팅 파워(GPU 클러스터)가 아직 수요에 맞춰 확장되지 않았기 때문입니다. Preview 상태의 모델 서버 리소스는 원래 제한적인데, 전 세계 개발자들이 동시에 테스트를 위해 몰려들면서 공급 부족 상황이 발생한 것입니다.

Gemini 503 High Demand와 429 Rate Limit의 본질적인 차이

많은 개발자들이 503과 429 오류를 혼동하지만, 이 두 오류는 원인이 완전히 다르고 해결책도 완전히 다릅니다. 방향을 잘못 잡으면 헛수고만 하게 됩니다.

| 비교 기준 | 503 High Demand | 429 Rate Limit |

|---|---|---|

| 오류 메시지 | "This model is currently experiencing high demand" | "Resource has been exhausted" |

| 본질적인 원인 | Google 서버 컴퓨팅 자원 부족 | 개인 요청 빈도 초과 |

| 영향 범위 | 모든 사용자에게 영향 | 본인에게만 영향 |

| 업그레이드로 해결 가능 여부 | ❌ 유료 플랜 업그레이드로 해결 불가 | ✅ Tier 1으로 업그레이드 시 해결 가능 |

| 재시도 유효성 | ✅ 잠시 후 보통 복구됨 | ❌ 빈도를 낮추지 않으면 계속 오류 발생 |

| 피크 시간대 특징 | 북미 업무 시간(PT 기준 오전 9시~오후 5시)에 자주 발생 | 시간대와 무관하게, 초과 시 오류 발생 |

| 근본적인 해결책 | 재시도 + 백업 모델 + 피크 시간대 회피 | 요청 빈도 낮추기 또는 플랜 업그레이드 |

한 문장으로 판단하는 방법

- 503 오류 발생 시 → Google의 문제입니다. 잠시 기다리거나 다른 모델을 사용해 보세요.

- 429 오류 발생 시 → 본인의 요청이 너무 빠릅니다. 속도를 늦추거나 플랜을 업그레이드하세요.

🎯 기술 조언: 프로덕션 환경에서 503과 429 두 가지 오류를 동시에 처리하는 것은 API 통합의 기본입니다. APIYI apiyi.com 플랫폼을 통해 Gemini 시리즈 모델을 호출하면, 플랫폼에 내장된 지능형 재시도 및 로드 밸런싱 메커니즘 덕분에 최종 사용자가 인지하는 503 오류 빈도를 현저히 낮출 수 있습니다.

해결책 1: 지수 백오프 재시도 (가장 기본적인 방법)

503 오류가 "잠시 후에 다시 시도해 주세요"를 의미하므로, 가장 직접적인 대응은 자동 재시도입니다. 하지만 무작정 재시도해서는 안 됩니다. 서버 부하를 가중시키지 않도록 매번 재시도 간격을 두 배로 늘리는 '지수 백오프' 전략을 사용해야 합니다.

Gemini 503 지수 백오프 재시도 코드

import openai

import time

import random

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 통합 인터페이스

)

def call_gemini_with_retry(messages, model="gemini-3.1-pro-preview", max_retries=5):

"""지수 백오프를 적용한 Gemini API 호출"""

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=messages

)

return response

except openai.APIStatusError as e:

if e.status_code == 503:

# 지수 백오프: 2초, 4초, 8초, 16초, 32초 + 무작위 지터

wait_time = (2 ** attempt) + random.uniform(0, 1)

print(f"⏳ 503 High Demand - {attempt+1}번째 재시도, {wait_time:.1f}초 대기 중...")

time.sleep(wait_time)

elif e.status_code == 429:

# 429 Rate Limit: 더 오래 기다림

wait_time = 60 + random.uniform(0, 10)

print(f"🚫 429 Rate Limit - {wait_time:.1f}초 대기 중...")

time.sleep(wait_time)

else:

raise # 다른 오류는 즉시 발생

raise Exception(f"{max_retries}번 재시도 후에도 실패했습니다.")

# 사용 예시

response = call_gemini_with_retry(

messages=[{"role": "user", "content": "Hello, Gemini!"}]

)

print(response.choices[0].message.content)

지수 백오프 재시도의 핵심 매개변수

| 매개변수 | 권장 값 | 설명 |

|---|---|---|

| 최대 재시도 횟수 | 5회 | 5회를 초과하면 일시적인 문제가 아닐 가능성이 높습니다. |

| 초기 대기 시간 | 2초 | 너무 짧으면 서버 부하를 가중시킬 수 있습니다. |

| 백오프 배수 | 2배 | 매번 두 배로 증가: 2초 → 4초 → 8초 → 16초 → 32초 |

| 무작위 지터 | 0-1초 | 많은 클라이언트가 동시에 재시도하는 것을 방지합니다. |

| 최대 대기 시간 | 32초 | 32초를 초과하면 백업 솔루션으로 전환해야 합니다. |

💡 실용적인 팁: 무작위 지터(jitter)는 매우 중요합니다. 모든 클라이언트가 정확히 2초 후에 재시도하면 '떼 지어 몰려드는 현상(thundering herd effect)'이 발생하여 모든 요청이 동시에 서버로 다시 몰려들고, 다음 라운드에서도 503 오류가 발생할 수 있습니다. 무작위 지터를 추가하면 재시도 요청을 분산시킬 수 있습니다.

해결책 2: 모델 폴백/예비 모델 자동 전환

Gemini 3.1 Pro Preview가 계속해서 503 오류를 반환할 때 가장 실용적인 해결책은 더 안정적인 예비 모델로 자동 전환하는 것입니다.

Gemini 503 모델 폴백 전략

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# 모델 폴백 체인: 가장 강력한 모델을 우선 사용하고, 안 되면 다음으로 폴백

FALLBACK_MODELS = [

"gemini-3.1-pro-preview", # 1순위: 최신, 최강

"gemini-3.0-pro", # 2순위: 이전 세대 Pro, 더 안정적

"gemini-2.5-flash-image-preview", # 3순위: Flash 버전, 빠름

"gemini-2.5-flash", # 최종: 가장 안정적인 Flash

]

def call_with_fallback(messages):

"""모델 폴백을 포함한 API 호출"""

for model in FALLBACK_MODELS:

try:

response = client.chat.completions.create(

model=model,

messages=messages

)

if model != FALLBACK_MODELS[0]:

print(f"⚠️ 예비 모델로 폴백되었습니다: {model}")

return response

except openai.APIStatusError as e:

if e.status_code in (503, 429):

print(f"❌ {model}에서 {e.status_code} 오류가 발생했습니다. 다음 모델을 시도합니다...")

continue

raise

raise Exception("모든 모델을 사용할 수 없습니다")

response = call_with_fallback(

messages=[{"role": "user", "content": "이 코드의 성능 병목 현상을 분석해 주세요"}]

)

Gemini 모델 안정성 순위

| 모델 | 안정성 | 503 빈도 | 적합한 시나리오 |

|---|---|---|---|

gemini-2.5-flash |

⭐⭐⭐⭐⭐ | 매우 낮음 | 고가용성 프로덕션 환경의 최종 방어선 |

gemini-3.0-pro |

⭐⭐⭐⭐ | 낮음 | Pro 기능이 필요한 안정적인 시나리오 |

gemini-2.5-flash-image-preview |

⭐⭐⭐ | 중간 | 이미지 생성 예비 모델 |

gemini-3.1-pro-preview |

⭐⭐ | 높음 | 최신 기능이 필요하지만 가끔 실패를 허용할 수 있는 경우 |

gemini-3.1-flash-image-preview |

⭐⭐ | 높음 | 나노 바나나 2 이미지 생성 |

🚀 빠른 시작: APIYI apiyi.com 플랫폼을 통해 하나의 API 키로 위 표의 모든 모델을 호출할 수 있습니다. 모델 전환 시 model 매개변수만 수정하면 되며, 인증을 다시 구성할 필요가 없습니다. 코드에서 모델 폴백 체인을 구현하기 매우 편리합니다.

해결책 3: 피크 시간대를 피한 호출 (제로 비용 솔루션)

503 high demand 오류는 시간대별로 뚜렷한 경향을 보입니다. 커뮤니티 데이터에 따르면:

- 피크 시간대 (태평양 표준시 오전 9시 – 오후 5시): 실패율 약 45%

- 비피크 시간대 (태평양 표준시 오전 2시 – 오전 7시): 실패율 5% 미만

베이징 시간으로 환산하면 다음과 같습니다:

| 시간대 (베이징 시간) | 해당 태평양 표준시 | Gemini 503 빈도 | 권장 사항 |

|---|---|---|---|

| 오전 1:00 – 오전 10:00 | 9AM-6PM PT (전날) | 🔴 높음 | 피하거나 예비 모델 사용 |

| 오전 10:00 – 오후 3:00 | 6PM-11PM PT (전날) | 🟡 중간 | 재시도 메커니즘을 포함하여 호출 |

| 오후 3:00 – 오후 11:00 | 11PM-7AM PT | 🟢 낮음 | 최적의 호출 시간대 |

| 오후 11:00 – 오전 1:00 | 7AM-9AM PT | 🟡 중간 | 빈도 증가 시작 |

피크 시간대를 피한 호출에 적합한 시나리오

- 대량 데이터 처리: 실시간 응답이 필요 없는 작업은 비피크 시간대에 실행하도록 예약합니다.

- 정기 작업: 비피크 시간대에 실행되도록 cron job을 설정합니다.

- 콘텐츠 생성: 기사, 이미지 등 미리 생성하여 나중에 게시할 수 있는 시나리오에 적합합니다.

솔루션 4: 조합 전략 (프로덕션 환경 권장)

실제 프로덕션 환경에서는 단일 솔루션만으로는 부족한 경우가 많습니다. 앞서 설명한 3가지 솔루션을 조합하여 사용하는 것을 권장합니다.

프로덕션 수준 Gemini API 호출 솔루션

import openai

import time

import random

from datetime import datetime

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

FALLBACK_MODELS = [

"gemini-3.1-pro-preview",

"gemini-3.0-pro",

"gemini-2.5-flash",

]

def smart_gemini_call(messages, max_retries=3):

"""

프로덕션 수준 Gemini API 호출

전략: 지수 백오프 재시도 + 모델 다운그레이드 + 오류 분류

"""

for model in FALLBACK_MODELS:

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model=model,

messages=messages,

timeout=30

)

return response, model

except openai.APIStatusError as e:

if e.status_code == 503:

if attempt < max_retries - 1:

wait = (2 ** attempt) + random.uniform(0, 1)

print(f"⏳ {model} 503 - 재시도 {attempt+1}/{max_retries}, {wait:.1f}초 대기")

time.sleep(wait)

else:

print(f"⚠️ {model} 503 지속, 다음 모델로 다운그레이드")

break # 재시도 중단, 모델 전환

elif e.status_code == 429:

wait = 60

print(f"🚫 {model} 429 속도 제한 - {wait}초 대기")

time.sleep(wait)

else:

raise

except openai.APITimeoutError:

print(f"⏰ {model} 요청 시간 초과, 다음 모델 시도")

break

raise Exception("모든 모델 및 재시도가 실패했습니다. 네트워크를 확인하거나 나중에 다시 시도해주세요.")

# 사용 예시

response, used_model = smart_gemini_call(

messages=[{"role": "user", "content": "你好"}]

)

print(f"✅ 사용 모델: {used_model}")

print(response.choices[0].message.content)

전체 프로덕션 수준 캡슐화(로그, 모니터링, 캐시 포함) 보기

import openai

import time

import random

import hashlib

import json

import logging

from datetime import datetime

from functools import lru_cache

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger("gemini_client")

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# 간단한 요청 캐시

_cache = {}

def get_cache_key(messages, model):

"""요청의 캐시 키 생성"""

content = json.dumps(messages, sort_keys=True) + model

return hashlib.md5(content.encode()).hexdigest()

def gemini_call_production(

messages,

models=None,

max_retries=3,

cache_ttl=3600,

enable_cache=True

):

"""

프로덕션 수준 Gemini API 호출 캡슐화

특징:

- 지수 백오프 재시도 (503 처리)

- 모델 자동 다운그레이드

- 응답 캐시 (반복 요청 감소)

- 구조화된 로그

"""

if models is None:

models = ["gemini-3.1-pro-preview", "gemini-3.0-pro", "gemini-2.5-flash"]

# 캐시 확인

if enable_cache:

cache_key = get_cache_key(messages, models[0])

if cache_key in _cache:

cached_time, cached_response = _cache[cache_key]

if time.time() - cached_time < cache_ttl:

logger.info("캐시 적중, API 호출 건너뛰기")

return cached_response, "cache"

errors = []

for model in models:

for attempt in range(max_retries):

try:

start_time = time.time()

response = client.chat.completions.create(

model=model,

messages=messages,

timeout=30

)

elapsed = time.time() - start_time

logger.info(f"성공 | model={model} | 소요 시간={elapsed:.2f}s")

# 캐시 기록

if enable_cache:

_cache[cache_key] = (time.time(), response)

return response, model

except openai.APIStatusError as e:

errors.append(f"{model}:{e.status_code}")

if e.status_code == 503:

if attempt < max_retries - 1:

wait = (2 ** attempt) + random.uniform(0, 1)

logger.warning(f"503 | model={model} | 재시도={attempt+1} | 대기={wait:.1f}s")

time.sleep(wait)

else:

logger.warning(f"503 지속 | model={model} | 다음 모델로 다운그레이드")

break

elif e.status_code == 429:

logger.warning(f"429 속도 제한 | model={model}")

time.sleep(60)

else:

raise

except Exception as e:

logger.error(f"예외 | model={model} | error={e}")

break

raise Exception(f"모두 실패: {errors}")

해결책 5: API 중계 서비스의 지능형 라우팅 사용

위에서 설명한 복잡한 재시도 및 모델 다운그레이드 로직을 직접 구현하고 싶지 않다면, 더 편리한 방법이 있습니다. 바로 지능형 라우팅 기능을 자체적으로 갖춘 API 중계 플랫폼을 사용하는 것이죠.

API 중계 서비스는 Gemini 503 문제를 어떻게 해결할까요?

전문적인 API 중계 서비스는 일반적으로 다음과 같은 기능을 제공합니다.

- 다중 API 키 로테이션: 플랫폼이 여러 Google API 키를 보유하고 있어, 단일 키가 속도 제한에 걸리면 자동으로 전환됩니다.

- 지능형 재시도: 플랫폼 수준에서 지수 백오프 재시도를 구현하여 개발자에게 투명하게 제공됩니다.

- 로드 밸런싱: 요청을 여러 Google 계정 및 지역으로 분산시킵니다.

- 장애 감지: 특정 모델의 503 오류 빈도가 높아지면, 해당 모델의 요청 할당 비율을 자동으로 낮춥니다.

🎯 기술 조언: APIYI(apiyi.com) 플랫폼은 Gemini 시리즈 모델에 대해 위에서 언급한 지능형 라우팅 기능을 제공합니다. OpenAI 호환 인터페이스를 사용하여 호출하면, 플랫폼 백엔드에서 503 재시도 및 다중 API 키 로드 밸런싱을 자동으로 처리하므로 개발자가 복잡한 오류 처리 로직을 직접 구현할 필요가 없습니다.

API 중계 서비스 솔루션의 간결한 코드 예시

import openai

# APIYI API 중계 서비스를 사용하면 503 오류 처리는 플랫폼에서 담당합니다.

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

# 이렇게 간단하게 503 오류를 직접 처리할 필요가 없습니다.

response = client.chat.completions.create(

model="gemini-3.1-pro-preview",

messages=[{"role": "user", "content": "你好"}]

)

print(response.choices[0].message.content)

Gemini API 오류 전체 문제 해결 절차

Gemini API 오류가 발생했을 때, 다음 절차에 따라 문제를 빠르게 파악해 보세요.

첫 번째 단계: 오류 코드 확인

| 오류 코드 | 오류 메시지 | 유형 | 즉시 조치 |

|---|---|---|---|

| 503 | "high demand" / "overloaded" | 서버 컴퓨팅 파워 부족 | 재시도 대기 또는 모델 전환 |

| 429 | "resource exhausted" | 개인 속도 제한 | 요청 빈도 감소 또는 요금제 업그레이드 |

| 400 | "invalid request" | 요청 파라미터 오류 | 요청 형식 및 파라미터 확인 |

| 401 | "unauthorized" | 인증 실패 | API 키 확인 |

| 500 | "internal error" | 서버 내부 오류 | 재시도 대기 |

두 번째 단계: 503과 429 구분

- 여러 API 키에서 모두 오류 발생 → 503, Google 서버 문제입니다.

- 본인의 API 키에서만 오류 발생 → 429, 개인 할당량 문제입니다.

세 번째 단계: 해당 솔루션 선택

- 503: 지수 백오프 재시도 → 모델 다운그레이드 → 비피크 시간대 호출

- 429: 요청 빈도 감소 → 유료 결제 활성화 후 Tier 1으로 업그레이드 (무료 계층 5-15 RPM, Tier 1은 150-300 RPM)

자주 묻는 질문

Q1: 제가 유료 사용자인데도 왜 503 High Demand 오류가 발생하나요?

503 오류는 결제 여부와는 전혀 관련이 없습니다. 503은 Google 서버의 컴퓨팅 파워 부족 문제로, 무료 사용자든 기업 고객이든 모두 겪을 수 있습니다. 이는 429 속도 제한과는 다릅니다. 429는 요금제 업그레이드를 통해 해결할 수 있지만, 503은 그렇지 않습니다. 503 오류가 발생하면 지수 백오프 재시도(exponential backoff retry)를 사용하거나 더 안정적인 모델 버전으로 전환하는 것을 권장합니다. APIYI apiyi.com 플랫폼을 통해 모델 호출 시, 다중 API 키 로드 밸런싱을 활용하여 503 오류 발생 빈도를 줄일 수 있습니다.

Q2: Gemini 3.1 Pro Preview의 503 오류는 언제쯤 개선될까요?

과거 경험에 따르면, 새 모델 출시 후 503 오류 피크는 보통 1~3주간 지속되며, Google이 점진적으로 용량을 확장함에 따라 크게 개선됩니다. Gemini 3.0 Pro도 출시 초기에 비슷한 503 오류 급증을 겪었지만, 지금은 매우 안정적입니다. 기다리는 동안 모델 다운그레이드 전략을 구현하여, 503 오류 발생 시 자동으로 gemini-3.0-pro 또는 gemini-2.5-flash로 폴백(fallback)하도록 하는 것을 권장합니다.

Q3: “high demand”와 “model is overloaded”는 같은 오류인가요?

본질적으로는 같은 문제에 대한 다른 표현입니다. "This model is currently experiencing high demand"와 "The model is overloaded"는 모두 503 상태 코드를 나타내며, Google 서버의 컴퓨팅 파워 부족을 의미합니다. 전자는 비교적 최신 API 버전에서 더 흔하고, 후자는 초기 버전에서 더 많이 나타났습니다. 처리 방식은 완전히 동일합니다.

Q4: Gemini API가 503 오류를 일으킬지 미리 알 수 있는 방법이 있나요?

공식적인 사전 경고는 없습니다. 하지만 몇 가지 신호를 주시할 수 있습니다: (1) Google이 새 모델을 출시한 후 1~2주는 위험 기간입니다; (2) 북미 업무 시간(베이징 시간 새벽부터 오전)에 503 오류 빈도가 더 높습니다; (3) 커뮤니티 포럼 discuss.ai.google.dev에서 실시간 피드백을 확인할 수 있습니다. 문제가 발생한 후에 임시로 추가하는 대신, 코드에 항상 재시도 및 다운그레이드 로직을 유지하는 것을 권장합니다. APIYI apiyi.com 플랫폼은 모델 가용성 상태 모니터링을 제공하여, 미리 상황을 파악하는 데 도움을 줄 수 있습니다.

Q5: 코드에서 503과 429 오류를 동시에 처리해야 하나요?

네, 필수적입니다. 운영 환경에서는 503과 429 오류 모두 발생할 수 있으며, 처리 전략은 다르지만 둘 다 중요합니다. 503은 지수 백오프 재시도 + 모델 다운그레이드를 사용하고, 429는 요청 빈도 감소 + 속도 제한 대기열을 사용합니다. 이 문서의 '솔루션 4: 조합 전략' 코드는 이 두 가지 오류를 동시에 처리하므로, 운영 환경에서 바로 사용할 수 있습니다.

요약

This model is currently experiencing high demand라는 503 오류의 본질은 매우 간단합니다. 바로 Google 서버의 컴퓨팅 파워가 일시적으로 부족해진 것입니다. 특히 Gemini 3.1 Pro Preview, Nano Banana 2와 같은 새 모델은 출시 초기 단계에서 거의 필연적으로 이러한 문제를 겪게 됩니다.

권장 우선순위에 따른 5가지 해결책:

- 지수 백오프 재시도 — 가장 기본적인 방법으로, 모든 프로젝트에 적용해야 합니다.

- 모델 다운그레이드 체인 — 503 오류 발생 시 자동으로 더 안정적인 모델로 전환합니다.

- 피크 시간대 외 호출 — 실시간이 아닌 작업은 사용량이 적은 시간대에 예약합니다.

- 조합 전략 — 운영 환경에 권장되며, 재시도 + 다운그레이드 + 오류 분류를 포함합니다.

- API 중계 서비스 스마트 라우팅 — 가장 편리한 방법으로, 플랫폼이 오류 처리 로직을 담당합니다.

어떤 솔루션을 선택하든 핵심 원칙은 503 오류는 당신의 잘못이 아니지만, 이를 우아하게 처리해야 한다는 것입니다. APIYI apiyi.com을 통해 Gemini 시리즈 모델을 빠르게 통합하고, 내장된 스마트 라우팅 및 재시도 기능을 활용하는 것을 권장합니다.

참고 자료

-

Google AI 개발자 포럼 – 503 오류 토론

- 링크:

discuss.ai.google.dev - 설명: Gemini API 503 오류에 대한 커뮤니티 토론 및 공식 답변

- 링크:

-

Google Gemini API – 속도 제한 문서

- 링크:

ai.google.dev/gemini-api/docs/rate-limits - 설명: 공식 속도 제한 규칙 및 각 티어(Tier)별 할당량 설명

- 링크:

-

Google Gemini API – 문제 해결 가이드

- 링크:

ai.google.dev/gemini-api/docs/troubleshooting - 설명: 공식 오류 해결 가이드

- 링크:

📝 작성자: APIYI 팀 | 기술 교류 및 API 연동은 apiyi.com을 방문해 주세요.