description: 2026年4月2日,微软MAI团队发布了三款自研基础模型:MAI-Transcribe-1、MAI-Voice-1及MAI-Image-2,标志着微软在AI领域迈向独立自主的新阶段。

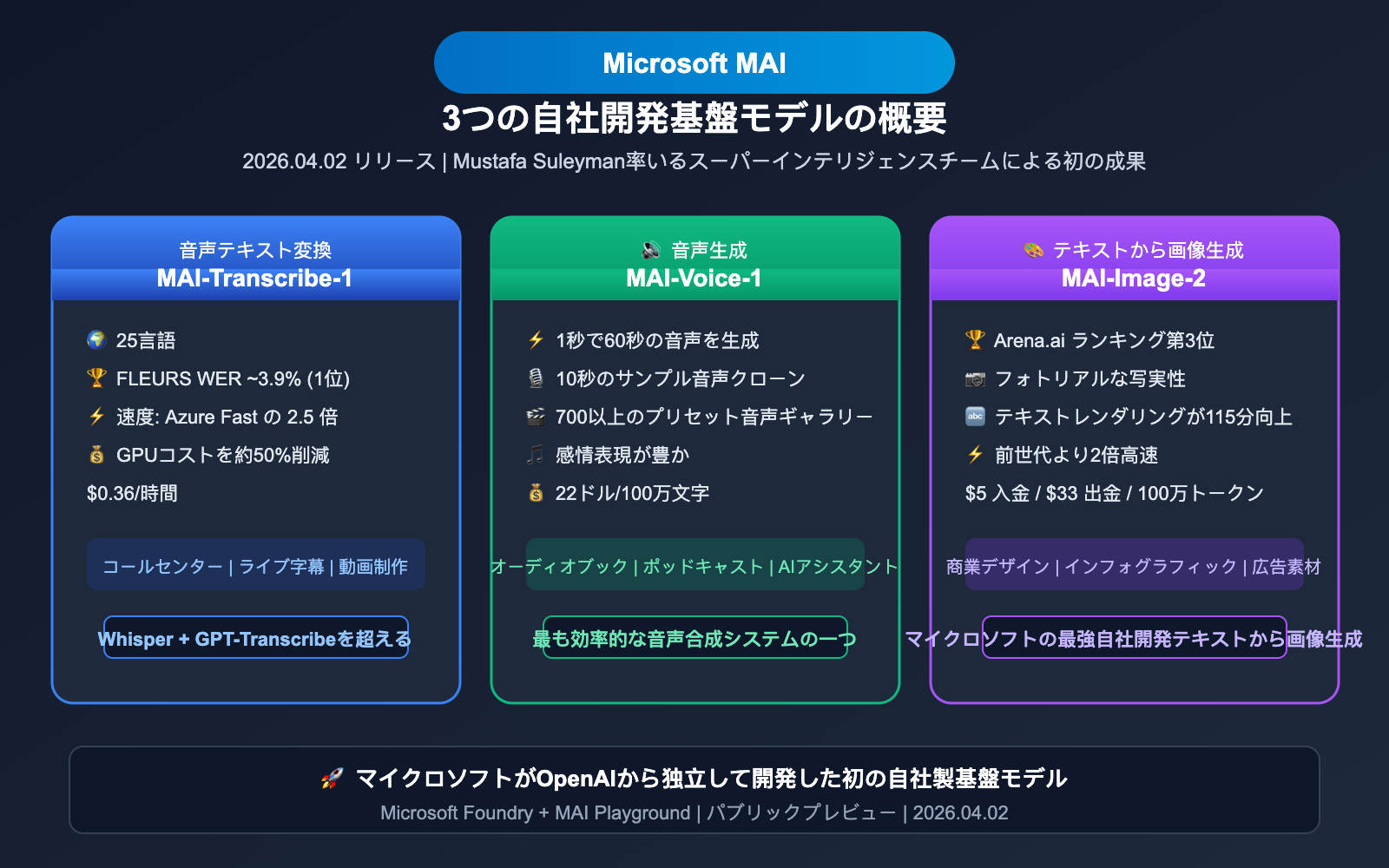

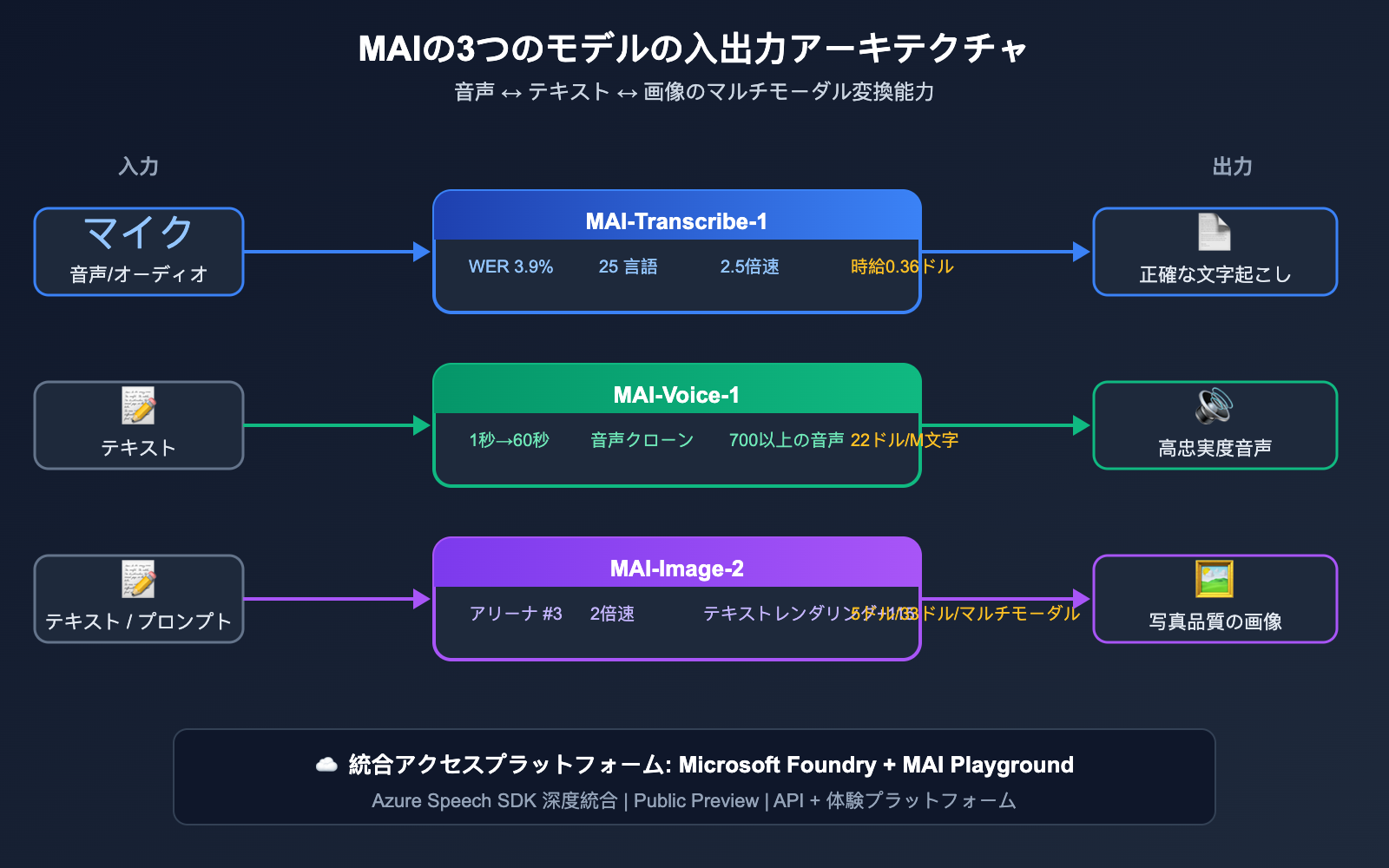

2026 年 4 月 2 日,微软 MAI 超级智能团队正式发布了 3 款自研基础模型——MAI-Transcribe-1(语音转文字)、MAI-Voice-1(语音生成)和 MAI-Image-2(文本到图像生成)。这是自 Mustafa Suleyman 领导的 MAI 团队成立以来的首次重大产品发布,标志着微软开始构建独立于 OpenAI 的 AI 模型能力。

核心价值: 3 分钟了解微软 MAI 三款新模型的核心技术参数、基准表现、API 定价以及对 AI 行业格局的影响。

微软 MAI 3 款新模型核心信息速览

| 信息项 | 详情 |

|---|---|

| 发布时间 | 2026 年 4 月 2 日 |

| 发布方 | 微软 MAI 超级智能团队 (CEO: Mustafa Suleyman) |

| 发布模型 | MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2 |

| 平台入口 | Microsoft Foundry + MAI Playground |

| 战略意义 | 微软首批自研多模态基础模型,降低对 OpenAI 的依赖 |

| 当前状态 | 公开预览 (Public Preview) |

这三款模型分别覆盖语音识别、语音生成和图像生成三大赛道,是微软在与 OpenAI 重新谈判合作条款后,首次独立推出的有竞争力的基础模型。

MAI-Transcribe-1:マイクロソフトの音声認識モデルを徹底解説

MAI-Transcribe-1 の主要技術パラメータ

MAI-Transcribe-1 は、マイクロソフトがこれまでに発表した中で最も強力な音声認識モデルであり、FLEURS ベンチマークテストにおいて総合1位を獲得しました。

| パラメータ項目 | MAI-Transcribe-1 |

|---|---|

| 対応言語 | 25言語 |

| FLEURS ベンチマーク WER | ~3.9% (総合1位) |

| 処理速度 | Azure Fast ソリューションより 2.5 倍高速 |

| GPU コスト | 競合製品より約 50% 削減 |

| API 料金 | $0.36/時間 |

| 主な強み | 11の主要言語で WER が最低 |

MAI-Transcribe-1 と競合製品の WER 比較

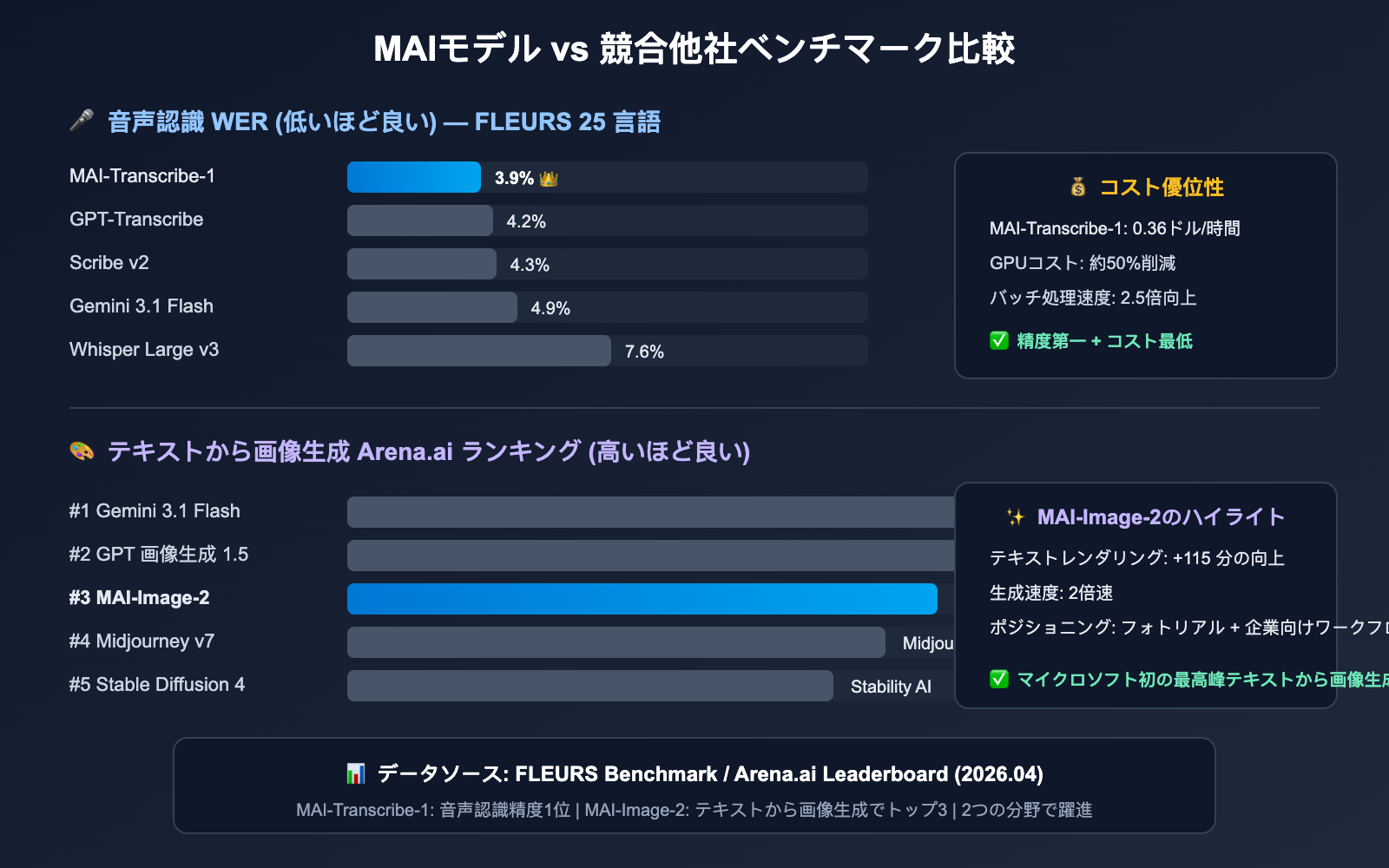

FLEURS 25言語ベンチマークテストにおいて、MAI-Transcribe-1 の単語誤り率(WER)は圧倒的な性能を示しています。

| モデル | FLEURS WER | 1位獲得言語数 | 料金体系 |

|---|---|---|---|

| MAI-Transcribe-1 | ~3.9% | 11/25言語 | $0.36/時間 |

| GPT-Transcribe (OpenAI) | ~4.2% | — | トークン課金 |

| Scribe v2 (ElevenLabs) | ~4.3% | — | $0.40/時間〜 |

| Gemini 3.1 Flash | ~4.9% | — | トークン課金 |

| Whisper Large v3 | ~7.6% | — | オープンソース無料 |

MAI-Transcribe-1 の 5 つの核心的な強み

1. エンタープライズレベルの多言語精度

MAI-Transcribe-1 は25言語で総合1位を獲得しており、英語、中国語、日本語、スペイン語などを含む11の主要言語で業界最低の WER を達成しています。残りの14言語においても Whisper Large v3 を上回り、そのうち11言語では Gemini 3.1 Flash を凌駕しています。

2. バッチ処理速度が 2.5 倍に向上

マイクロソフトの従来の Azure Fast 音声文字起こしソリューションと比較して、MAI-Transcribe-1 はバッチ処理速度が 2.5 倍向上しました。これにより、コールセンターの録音データ解析、会議議事録の大量生成、動画字幕作成などのシーンで大幅な効率化が期待できます。

3. GPU コストを約 50% 削減

モデルアーキテクチャの最適化により、最高レベルの精度を維持しながら GPU 推論コストを約半分に抑えることに成功しました。これにより、大規模な音声文字起こしタスクの総保有コスト(TCO)を大幅に削減できます。

4. 幅広い適用シーン

- IVR システム: 自動音声応答システムのリアルタイム文字起こし

- コールセンター: オペレーターと顧客の会話の自動記録と分析

- ライブ字幕: イベントや会議のリアルタイム字幕生成

- 動画制作: 動画コンテンツの自動字幕生成

- 市場調査: インタビュー録音のバッチ文字起こし

5. 競争力のある API 料金

$0.36/時間という価格設定は、エンタープライズ向けの音声文字起こしサービスとして非常に高いコストパフォーマンスを誇ります。

🎯 開発者向けヒント: アプリケーションに音声文字起こし機能を統合したい開発者は、Microsoft Foundry を通じて API にアクセスできます。もし音声文字起こしだけでなく、テキスト生成や画像生成など複数の AI モデルを組み合わせて利用したい場合は、APIYI (apiyi.com) プラットフォームを活用することで、各社の API 呼び出しを一元管理し、マルチモデル統合のエンジニアリング負荷を大幅に軽減できます。

MAI-Voice-1:マイクロソフトの音声生成モデル技術解説

MAI-Voice-1 の主要パラメータ

MAI-Voice-1 は、マイクロソフトが提供する高効率な音声生成モデルであり、その最大の特徴は圧倒的な生成効率にあります。

| パラメータ項目 | MAI-Voice-1 |

|---|---|

| 生成効率 | 単一 GPU で 60 秒の音声を 1 秒未満で生成 |

| 音声クローン | わずか 10 秒のサンプルでカスタムボイスを作成可能 |

| 音声ライブラリ | 700 種類以上のプリセット音声 |

| API 料金 | $22/100万文字 |

| 統合方法 | Azure Speech / Microsoft Foundry |

| 活用事例 | Copilot の音声読み上げおよびポッドキャスト機能 |

MAI-Voice-1 の技術的特徴

1. 究極の生成効率

単一の GPU 上で 60 秒間の高品質な音声を 1 秒未満で生成可能です。この効率性は、リアルタイムの音声フィードバックを必要とするアプリケーションにとって、現在最も優れた音声合成システムの一つとなっています。

2. 10 秒の音声クローン

「Personal Voice」機能により、わずか 10 秒の音声サンプルから、本人と見紛うようなカスタムボイスを作成できます。なお、この機能の利用にはマイクロソフトの責任ある AI(Responsible AI)に基づく承認プロセスが必要です。

3. 700 種類以上の音声ギャラリー

Azure Speech との統合により、開発者は 700 種類以上のプリセット音声にアクセス可能です。多言語、多様なアクセントやスタイルをカバーしており、あらゆるユースケースに対応します。

4. 感情豊かな音声出力

MAI-Voice-1 は単にクリアな音声を生成するだけでなく、語調の変化、間の取り方、感情表現などをシミュレートし、より自然で表現力豊かな音声を実現します。

💡 応用シーン: MAI-Voice-1 は、オーディオブック制作、ポッドキャストの自動生成、カスタマーサポートの音声応答、アクセシビリティ支援などのシーンに最適です。開発者は大規模言語モデル(LLM)でテキストを生成し、それを MAI-Voice-1 で音声に変換することで、完全な AI 音声アシスタントパイプラインを構築できます。LLM によるテキスト生成部分の統合には、APIYI (apiyi.com) プラットフォームが便利です。

MAI-Image-2:マイクロソフト最強のテキストから画像生成モデルを徹底解説

MAI-Image-2 の主要スペック

MAI-Image-2 は、マイクロソフトが業界ランキングでトップクラスの競争力を誇る、初の自社開発テキストから画像生成モデルです。

| パラメータ項目 | MAI-Image-2 |

|---|---|

| Arena.ai 順位 | 第 3 位 (Gemini 3.1 Flash、GPT Image 1.5 に次ぐ) |

| 生成速度 | 前世代比 2 倍以上 |

| 文字レンダリング向上 | 前世代比 115 ポイント向上 |

| 入力コスト | $5/100万トークン |

| 出力コスト | $33/100万トークン |

| 主な強み | 写真のようなリアリズム、強力な文字レンダリング、複雑なレイアウト精度 |

Arena.ai ランキングにおける MAI-Image-2 の位置付け

| 順位 | モデル | ベンダー | 主な強み |

|---|---|---|---|

| 1 | Gemini 3.1 Flash Image | マルチモーダル総合力最強 | |

| 2 | GPT Image 1.5 | OpenAI | クリエイティブな多様性でリード |

| 3 | MAI-Image-2 | マイクロソフト | 文字レンダリング + 写真のようなリアリズム |

| 4 | Midjourney v7 | Midjourney | 芸術的なスタイルに特化 |

| 5 | Stable Diffusion 4 | Stability AI | オープンソースエコシステム |

MAI-Image-2 の 4 つの技術的ハイライト

1. 写真のようなリアリズム

MAI-Image-2 は、写実的な写真スタイルの画像生成において新たな高みに到達しました。ボリュームライトの効果、素材の質感、光と影のグラデーションなどの細部表現は、本物の写真に近い水準にあり、広告や製品展示のシーンに最適です。

2. 文字レンダリング能力の大幅な向上

前世代のモデルと比較して、MAI-Image-2 の画像内文字レンダリング能力は 115 ポイント向上しました。これにより、インフォグラフィック、ポスター、看板など、文字要素を含む画像を生成する際の文字の鮮明さと正確性が大幅に向上しています。

3. 複雑なレイアウト処理の精度

複数のオブジェクト、複雑な空間関係、詳細なシーンを含む生成タスクにおいて、MAI-Image-2 は競合他社よりも高い構図精度を発揮し、オブジェクトの重なりや比率の不整合といった問題を軽減しています。

4. エンタープライズ向けワークフローへの統合

世界最大の広告グループである WPP は、すでにクリエイティブ制作において MAI-Image-2 を大規模に活用しています。マイクロソフトは本モデルをデザイナーやマーケター向けの生産性向上ツールとして位置づけ、Microsoft 365 エコシステムとの深い統合を進めています。

🔧 技術的実践: 実際の AI 画像生成アプリケーション開発において、開発者は複数のモデルの生成結果を比較する必要があります。APIYI (apiyi.com) プラットフォームを利用すれば、DALL-E や Stable Diffusion など、さまざまな画像生成モデルの API を一元的に接続でき、モデル間の切り替えや効果の比較が容易になります。

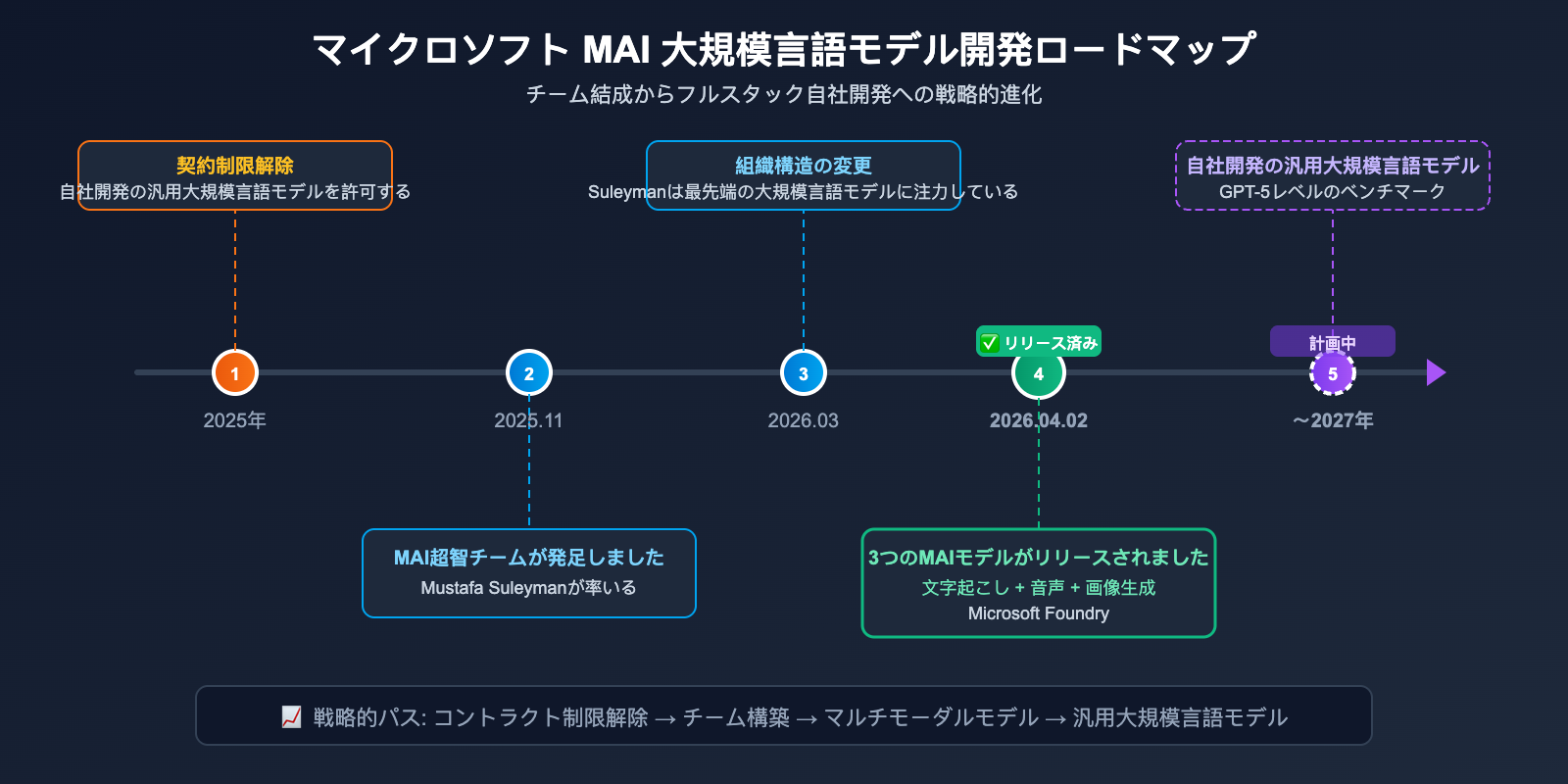

マイクロソフトの MAI 戦略:OpenAI 依存からの脱却に向けた第一歩

なぜマイクロソフトは自社モデルを開発するのか

マイクロソフトと OpenAI の関係は、微妙な変化を迎えています。今回の MAI モデル 3 種の発表は、明確な戦略的シグナルと言えます。

重要なタイムライン:

- 2025 年: マイクロソフトと OpenAI が協力条件を再交渉し、マイクロソフトによる汎用 AI モデルの自社開発を制限していた契約上の制約を撤廃

- 2025 年 11 月: Mustafa Suleyman 氏が MAI スーパーインテリジェンスチームを結成し、最先端モデルの研究開発に注力

- 2026 年 3 月: Satya Nadella 氏が組織改編を発表。Suleyman 氏は最先端モデルに専念し、Copilot の日常業務からは離れる

- 2026 年 4 月 2 日: MAI チームが初の自社開発基盤モデル 3 種を発表

- 2027 年の目標: GPT-5 レベルと競合する汎用大規模言語モデルのリリースを計画

マイクロソフトの AI モデルポートフォリオの現状

| モデルカテゴリ | OpenAI 提供 | マイクロソフト自社開発 (MAI) |

|---|---|---|

| 汎用 LLM | GPT-5.4 (Copilot の中核) | 計画中 (2027) |

| 音声認識 | Whisper / GPT-Transcribe | MAI-Transcribe-1 ✅ |

| 音声生成 | — | MAI-Voice-1 ✅ |

| テキストから画像生成 | DALL-E 3 | MAI-Image-2 ✅ |

| コードモデル | Codex | 計画中 |

開発者にとっての意味

マイクロソフトは、「二本柱」の AI モデル供給体制を構築しています。一方で OpenAI の汎用 LLM (GPT-5.4) を使い続けつつ、もう一方で音声や画像分野で自社開発の代替案を打ち出しています。これは、開発者がマイクロソフトのエコシステム内でより多くの選択肢を持てるようになることを意味します。

🎯 業界の洞察: マイクロソフトによる自社モデルの投入は、AI モデル市場における競争がさらに激化することを意味します。開発者にとって、どのモデルを選択し、どのチャネルを通じて接続するかがますます重要になっています。APIYI (apiyi.com) プラットフォームを通じて複数のベンダーの AI モデル API を一元的に接続することで、コードを変更することなく柔軟に基盤モデルを切り替え、急速に変化する市場環境に対応することが可能です。

description: Microsoft MAI モデルのAPI料金体系、接入方法、およびAI業界への影響を解説。APIYIを活用した効率的なモデル管理についても紹介します。

Microsoft MAI モデル APIの料金体系と接続方法

3つのモデルの料金一覧

| モデル | 課金方式 | 価格 | 接続プラットフォーム |

|---|---|---|---|

| MAI-Transcribe-1 | 音声時間単位 | $0.36/時間 | Microsoft Foundry / Azure Speech |

| MAI-Voice-1 | 文字数単位 | $22/100万文字 | Microsoft Foundry / Azure Speech |

| MAI-Image-2 | トークン単位 | 入力 $5/100万 + 出力 $33/100万トークン | Microsoft Foundry |

接続方法

方法1: Microsoft Foundry

これら3つのモデルはすべて、Microsoft Foundry 開発者プラットフォームを通じてパブリックプレビューとしてAPI接続が提供されています。開発者は Foundry の API エンドポイントから直接呼び出すことが可能です。

方法2: MAI Playground

MAI Playground は、マイクロソフトが新たに提供するモデル体験プラットフォームです。開発者はここで MAI-Transcribe-1 と MAI-Voice-1 の機能を無料で試用でき、自身のアプリケーションに適しているかを迅速に評価できます。

方法3: Azure Speech 統合

MAI-Transcribe-1 と MAI-Voice-1 は Azure Speech サービスに深く統合されており、既存の Azure ユーザーは Azure Speech SDK を通じて直接呼び出すことができます。

💰 コスト最適化: マルチモーダルAIアプリケーションを構築する際、音声文字起こし、テキスト生成、画像生成には、通常異なるベンダーのモデルを組み合わせて使用する必要があります。APIYI (apiyi.com) プラットフォームを利用すれば、APIキーと使用量を一元管理でき、複数のプラットフォームに個別に登録する手間や管理コストを削減できます。当プラットフォームは、マイクロソフト、OpenAI、Anthropic、Alibaba Cloud など、多数のベンダーのモデル接続をサポートしています。

マイクロソフト MAI モデルが AI 業界に与える影響の分析

AI モデル市場への影響

1. 音声認識分野の勢力図の変化

MAI-Transcribe-1 は、WER(単語誤り率)約3.9%という性能で、OpenAI の GPT-Transcribe(約4.2%)や ElevenLabs の Scribe v2(約4.3%)に直接挑戦しています。さらに50%のコスト優位性を備えており、エンタープライズ向け音声文字起こし市場のシェアを急速に奪う可能性があります。

2. テキストから画像生成における「3強」の激化

MAI-Image-2 が Arena.ai のトップ3にランクインしたことで、テキストから画像生成の分野は Google(Gemini 3.1 Flash)、OpenAI(GPT Image 1.5)、マイクロソフト(MAI-Image-2)による3強体制となりました。これにより、Midjourney や Stability AI といった独立系ベンダーへの圧力はさらに強まっています。

3. AI大手の「フルスタック自社開発」がトレンドに

Google(Gemini シリーズ)、Meta(Llama シリーズ)に続き、マイクロソフトもフルスタックなAIモデル能力の構築を開始しました。これは、今後のAI市場における競争が、少数の大手企業にますます集中していくことを意味しています。

開発者への影響

- モデル選択肢の拡大: マイクロソフトのエコシステムにおいて、OpenAI 以外の選択肢が生まれました。

- 価格競争の激化: 複数ベンダーによる競争が、API価格のさらなる低下を促進します。

- マルチモデルの組み合わせ利用: 開発者は、シナリオに応じて異なるベンダーのモデルを柔軟に選択するスキルが求められます。

🚀 開発アドバイス: 急速に増加するAIモデルの選択肢を前に、開発者は APIYI (apiyi.com) のような統合接続プラットフォームを通じてマルチモデルの呼び出しを管理し、特定のベンダーへの依存(ベンダーロックイン)を避けることを推奨します。当プラットフォームは OpenAI 互換の標準インターフェース形式を提供しており、モデルの切り替えは

modelパラメータを変更するだけで完了します。

マイクロソフト MAI モデルに関するよくある質問

Q1: MAI モデルと OpenAI モデルにはどのような関係がありますか?

MAI モデルは、マイクロソフトの MAI スーパーインテリジェンスチームが独自に開発したものであり、OpenAI とは無関係です。マイクロソフトは現在「二本立て」戦略を採用しており、汎用的な大規模言語モデルには引き続き OpenAI の GPT-5.4 を使用し、音声および画像分野では自社開発の MAI シリーズを展開しています。2025 年の OpenAI との再交渉を経て、マイクロソフトの自社モデル開発を制限する契約条項は撤廃されました。

Q2: MAI-Transcribe-1 は Whisper と比べてどの程度優れていますか?

FLEURS 25 言語ベンチマークテストにおいて、MAI-Transcribe-1 の WER(単語誤り率)は約 3.9% であり、Whisper Large v3 の約 7.6% と比較して、精度の面で明確な差があります。また、MAI-Transcribe-1 のバッチ処理速度は Azure Fast ソリューションの 2.5 倍に達し、GPU コストを約 50% 削減可能です。ただし、Whisper にはオープンソースで無料という利点があるため、コストを極めて重視するシナリオには適しています。

Q3: MAI-Image-2 は DALL-E の代わりになりますか?

Arena.ai のランキングを見ると、MAI-Image-2(3位)は総合順位で DALL-E 3 を上回っています。特にテキストのレンダリングや写真のようなリアリティの面で、MAI-Image-2 は明確な強みを持っています。一方で、DALL-E は特定のクリエイティブなスタイルにおいて独自の表現力を持っています。企業ユーザーにとっては、MAI-Image-2 とマイクロソフトエコシステムとの深い統合が、より大きな魅力となるでしょう。

Q4: これら 3 つの MAI モデルを素早く試すにはどうすればよいですか?

最も手軽な方法は、マイクロソフトが新たに公開したモデル体験プラットフォーム「MAI Playground」にアクセスして無料試用することです。正式な API 接続には、Microsoft Foundry 開発者プラットフォーム経由の手続きが必要です。もし複数の AI モデルを同時に呼び出す必要があるアプリケーションを開発している場合は、APIYI (apiyi.com) プラットフォームを利用することで、各社の API 接続を一元管理し、開発フローを簡素化できます。

Q5: マイクロソフトはいつ自社開発の汎用大規模言語モデルをリリースする予定ですか?

公開情報によると、マイクロソフトは現在 Nvidia GB200 チップクラスターを導入しており、今後 12〜18 ヶ月以内に最先端レベルの計算能力を構築する計画です。2027 年前後には、GPT-5 レベルと競合可能な自社開発の汎用大規模言語モデルを投入する見込みです。それまでの間、Copilot の中核となる大規模言語モデルには、引き続き OpenAI の GPT-5.4 が使用されます。

マイクロソフト MAI の新モデル 3 選まとめ

マイクロソフトの MAI チームは、発足からわずか 5 か月で注目すべき最初の成果を発表しました。

- MAI-Transcribe-1: FLEURS ベンチマークで WER(単語誤り率)1 位(約 3.9%)を記録。処理速度は 2.5 倍に向上し、コストは 50% 削減、価格は 1 時間あたり 0.36 ドルとなっています。

- MAI-Voice-1: 単一 GPU で 1 秒未満で 60 秒分の音声を生成可能。10 秒の音声クローンに対応し、700 種類以上のプリセット音声を搭載しています。

- MAI-Image-2: Arena.ai のテキストから画像生成ランキングで 3 位を獲得。テキストレンダリング能力が 115 ポイント向上し、複雑なレイアウトや写真のようなリアルな表現に対応しています。

これら 3 つのモデルのリリースは、マイクロソフトの自社開発能力を示すだけでなく、AI 業界における「巨大テック企業によるフルスタック自社開発」のトレンドが加速していることを象徴しています。開発者にとっては、選択肢が増える中で、APIYI (apiyi.com) のような統合アクセスプラットフォームを通じて複数のベンダーのモデル呼び出しを一元管理することが、開発効率の向上と切り替えコストの削減における重要な戦略となるでしょう。

📝 著者: APIYI Team | AI モデルの技術解説や API 接続ガイドの詳細は、APIYI ヘルプセンター(help.apiyi.com)をご覧ください。