作者注:MiniMax-M2.7 と M2.7-highspeed の2つのモデルについて、その核心能力、性能ベンチマーク、および API 接続方法を深く掘り下げます。開発者の皆さまが、極めて低コストでフラッグシップ級の AI 能力を手に入れるためのガイドです。

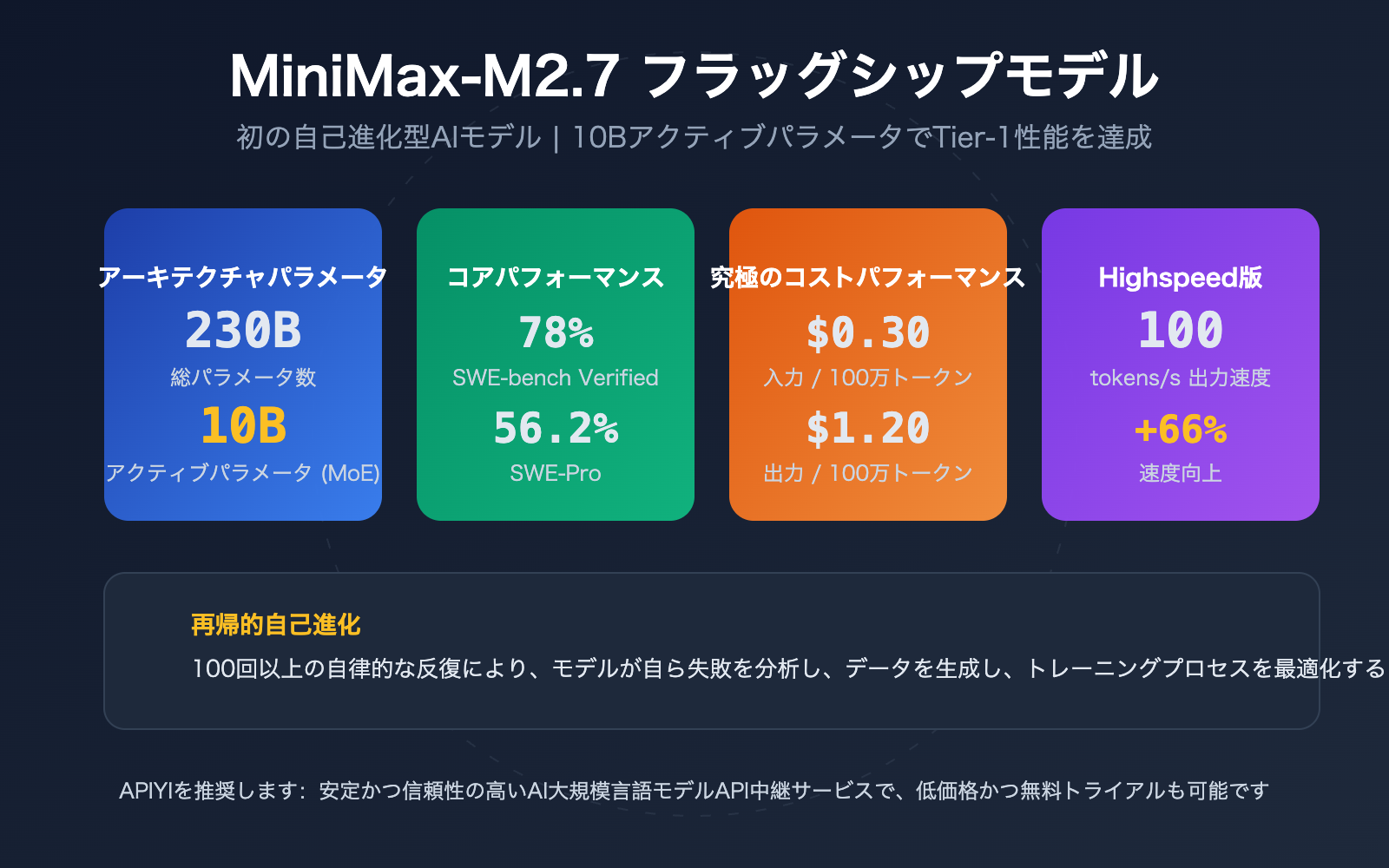

MiniMax は 2026 年 3 月 18 日にフラッグシップ大規模言語モデル「MiniMax-M2.7」を発表しました。これは、AI モデル自身がその進化プロセスに深く関与した初のモデルです。わずか 10B のアクティブパラメータで Claude Opus 4.6 や GPT-5 と同等の Tier-1 性能を実現しつつ、価格は主要なフラッグシップモデルの 5 分の 1 という低価格を達成しました。同時にリリースされた「MiniMax-M2.7-highspeed」バージョンでは、出力速度が 66% 向上し、100 tps に達しています。

核心価値: 実際のベンチマークデータと接続チュートリアルを通じて、MiniMax-M2.7 が現在最もコストパフォーマンスの高いフラッグシップモデルの選択肢であるかどうかを判断する手助けをします。

MiniMax-M2.7 核心要点

| 要点 | 说明 | 价值 |

|---|---|---|

| 230B 総パラメータ / 10B アクティブ | 混合エキスパート(MoE)アーキテクチャ、推論ごとに 10B パラメータのみをアクティブ化 | フラッグシップ性能 + 極めて低い推論コスト |

| 再帰的自己進化トレーニング | モデルが 100 回以上の反復を自律的に実行し、トレーニングプロセスを最適化 | 人の手を介さず性能を 30% 向上 |

| SWE-bench 78% | ソフトウェアエンジニアリングベンチマークで Opus 4.6 の 55% を大幅にリード | プログラミングおよびエンジニアリングタスクの第一選択 |

| 価格は Opus の 1/50 | 入力 $0.30/M、出力 $1.20/M トークン | エンタープライズレベルの大規模デプロイコストを大幅削減 |

MiniMax-M2.7 技術アーキテクチャの詳細

MiniMax-M2.7 は、スパース混合エキスパート(Sparse Mixture-of-Experts)Transformer アーキテクチャを採用しており、総パラメータ数は 230B ですが、各トークンでアクティブ化されるのは 10B パラメータのみです。この設計により、M2.7 は同等の性能レベルの中で最小のモデルとなり、最小限の計算リソースで Claude Opus 4.6 や GPT-5 と同等の Tier-1 パフォーマンスを実現しています。

コンテキストウィンドウは 205K トークン(約 307 ページの A4 文書)に達し、長文分析や大規模なコードベースの理解などのシナリオをサポートします。Artificial Analysis Intelligence Index の評価では、M2.7 は 50 点満点で 136 個の同等モデルの中で 1 位を獲得しました。

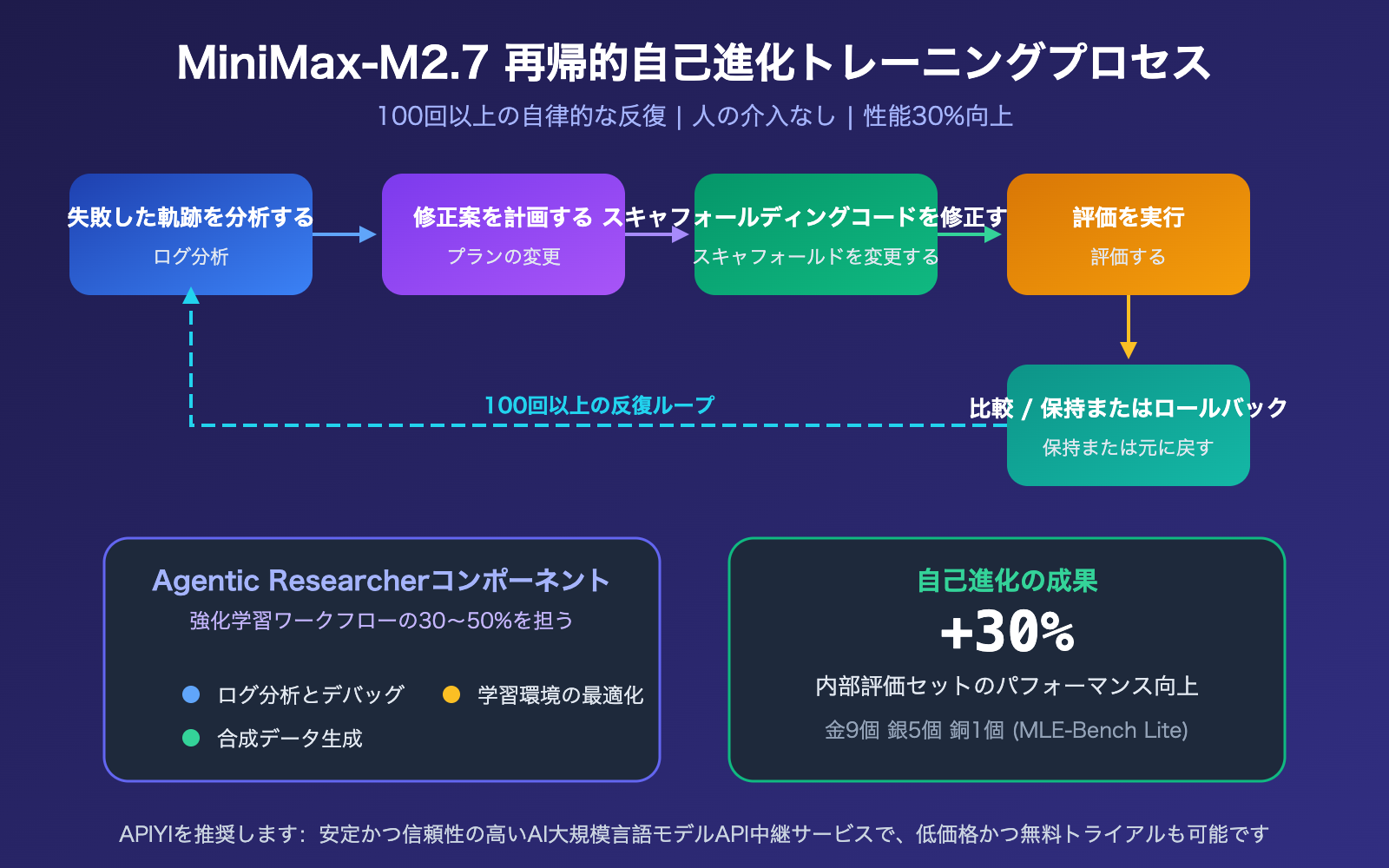

MiniMax-M2.7 の再帰的自己進化メカニズム

「再帰的自己進化」は、M2.7 の最も画期的な技術的ハイライトです。モデルはトレーニングプロセス中に、失敗した軌跡の分析 → 修正の計画 → トレーニング用足場コードの修正 → 評価の実行 → 結果の比較 → 保持またはロールバックの決定という完全な反復サイクルを自律的に実行します。このプロセスは 100 回以上、完全に自律的に実行されました。

その核心コンポーネントである「Agentic Researcher」は、ログ分析とデバッグ、合成データ生成、トレーニング環境の最適化を含む強化学習ワークフローの 30〜50% を担っています。最終的に、人の手を介さずに 30% の性能向上を実現しました。

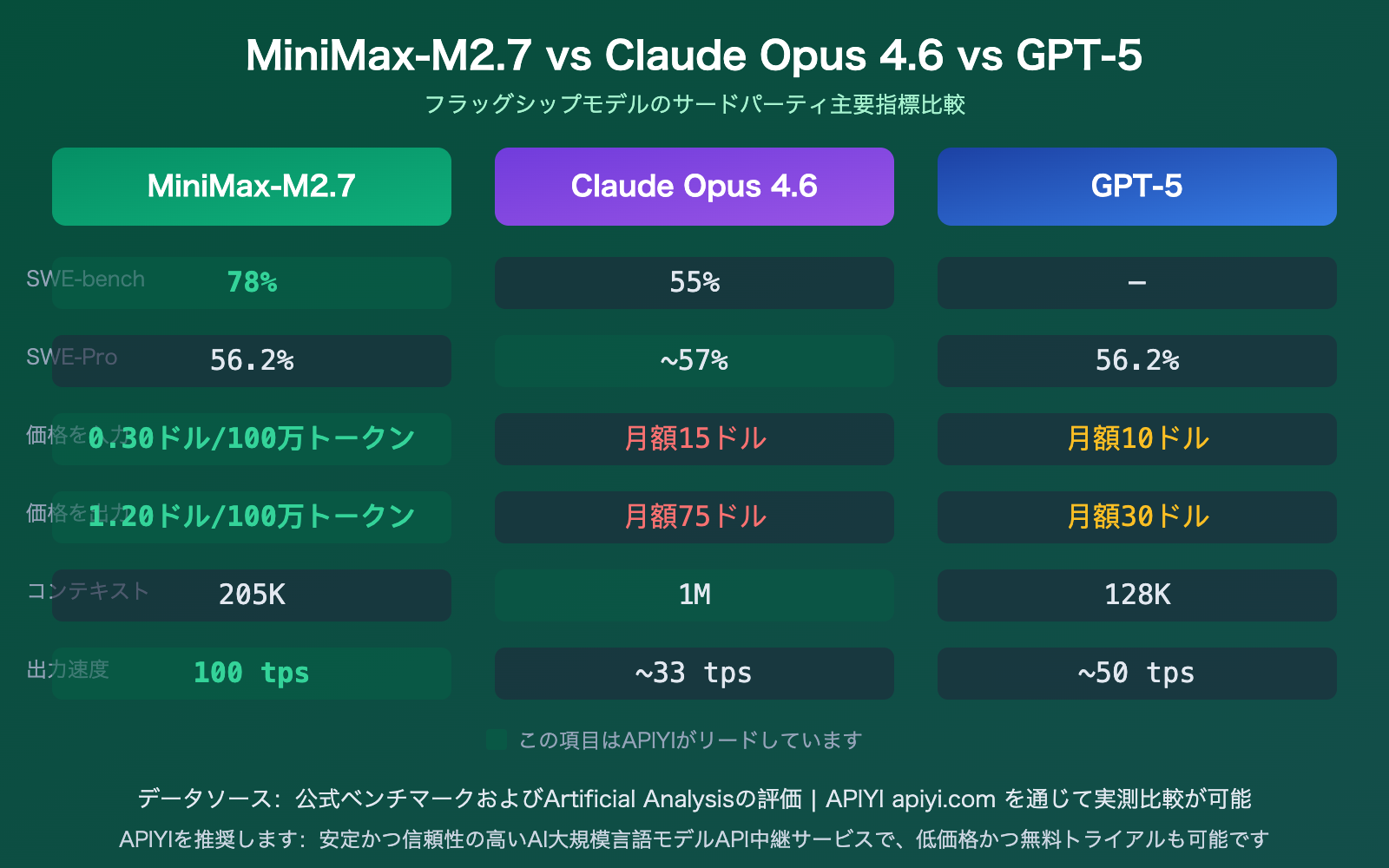

MiniMax-M2.7 パフォーマンスベンチマークとモデル比較

MiniMax-M2.7 ベンチマークスコア

| ベンチマーク | M2.7 スコア | Claude Opus 4.6 | GPT-5 シリーズ | 説明 |

|---|---|---|---|---|

| SWE-bench Verified | 78% | 55% | — | ソフトウェアエンジニアリングの実践、大幅にリード |

| SWE-Pro | 56.2% | ~57% | 56.2% (Codex) | フラッグシップ級の性能 |

| VIBE-Pro | 55.6% | — | — | エンドツーエンドのプロジェクト遂行能力 |

| Terminal Bench 2 | 57.0% | — | — | 複雑なエンジニアリングシステム |

| MLE-Bench Lite | 66.6% | 75.7% | 71.2% (5.4) | MLコンペティション、9金5銀1銅 |

| GDPval-AA ELO | 1495 | — | — | オフィス生産性で第1位 |

MiniMax-M2.7 価格比較

M2.7の価格戦略は非常にインパクトがあり、ほぼ同等の性能レベルでありながら、コストは主要なフラッグシップモデルの数十分の1に抑えられています。

| 指標 | MiniMax-M2.7 | Claude Opus 4.6 | GPT-5 | 倍率の差 |

|---|---|---|---|---|

| 入力価格 | $0.30/M | $15/M | $10/M | 50倍 / 33倍 安い |

| 出力価格 | $1.20/M | $75/M | $30/M | 62倍 / 25倍 安い |

| コンテキストウィンドウ | 205K | 1M | 128K | 中間的な容量 |

| アクティブパラメータ | 10B | — | — | 最小のTier-1モデル |

🎯 選択のアドバイス: MiniMax-M2.7はプログラミングやエンジニアリングタスクにおいて優れたパフォーマンスを発揮し、コストパフォーマンスが非常に高いモデルです。APIYI (apiyi.com) プラットフォームを通じて素早くテスト環境を構築することをお勧めします。同プラットフォームはMiniMax-M2.7およびM2.7-highspeedの統一インターフェース呼び出しをサポートしており、他のフラッグシップモデルとの実用的な比較が容易です。

MiniMax-M2.7-highspeed 高速版の詳細

MiniMax-M2.7-highspeedは、M2.7フラッグシップシリーズのパフォーマンス最適化バージョンです。標準版と全く同じ結果を出力し、知能レベルは同一ですが、highspeed版は遅延に敏感なアプリケーションシナリオ向けに設計されています。

MiniMax-M2.7-highspeed の主な利点

- 出力速度: 100 tokens/s に到達、標準版より66%向上

- サブ秒単位の遅延: 初回トークンの応答時間を最適化し、リアルタイム対話に最適

- 推論バックボーンアーキテクチャの強化: 単なる量子化による性能低下ではなく、推論エンジン自体を専用に最適化

- 結果の一貫性: 標準版と全く同じ出力を提供し、知能レベルを犠牲にしない

MiniMax-M2.7-highspeed の適用シナリオ

| シナリオ | 説明 | highspeedを選ぶ理由 |

|---|---|---|

| インタラクティブなプログラミング支援 | IDE内でのリアルタイムコード補完とリファクタリング | サブ秒単位の応答でコーディング体験が向上 |

| リアルタイムエージェントループ | Agent Loopによる多段階推論実行 | 各ステップの待機時間を削減し、プロセス全体を加速 |

| 高スループット企業パイプライン | 大量ドキュメント処理、データ抽出 | 100 tpsにより完了時間を大幅に短縮 |

| オンラインカスタマーサービスシステム | リアルタイム対話と質問回答 | ユーザーがストレスを感じない高速応答 |

アドバイス: アプリケーションの応答速度に厳しい要件がある場合、MiniMax-M2.7-highspeedは現在、フラッグシップ級モデルの中で最も高速な選択肢の一つです。APIYI (apiyi.com) を通じて直接このモデルを呼び出すことができます。

MiniMax-M2.7 API クイックスタート

シンプルなサンプル

APIYIプラットフォームを通じて MiniMax-M2.7 を呼び出すための最もシンプルなコードです。わずか10行で実行可能です:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="MiniMax-M2.7",

messages=[{"role": "user", "content": "このコードのパフォーマンスのボトルネックを分析し、最適化の提案をしてください"}]

)

print(response.choices[0].message.content)

完全な実装コードを表示(highspeed バージョンの切り替えを含む)

import openai

from typing import Optional

def call_minimax_m27(

prompt: str,

model: str = "MiniMax-M2.7",

system_prompt: Optional[str] = None,

max_tokens: int = 2000,

use_highspeed: bool = False

) -> str:

"""

MiniMax-M2.7 または M2.7-highspeed を呼び出す

Args:

prompt: ユーザー入力

model: モデル名

system_prompt: システムプロンプト

max_tokens: 最大出力トークン数

use_highspeed: highspeed バージョンを使用するかどうか

"""

if use_highspeed:

model = "MiniMax-M2.7-highspeed"

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

response = client.chat.completions.create(

model=model,

messages=messages,

max_tokens=max_tokens

)

return response.choices[0].message.content

# 標準版の呼び出し

result = call_minimax_m27(

prompt="Pythonで効率的なLRUキャッシュを実装してください",

system_prompt="あなたは熟練したPythonエンジニアです"

)

# highspeed版の呼び出し(リアルタイムシナリオ向け)

fast_result = call_minimax_m27(

prompt="このコードの役割を素早く説明してください",

use_highspeed=True

)

アドバイス: APIYI (apiyi.com) で無料のテストクレジットを取得し、MiniMax-M2.7 があなたのビジネスシナリオでどのように機能するかを素早く検証しましょう。プラットフォームは標準版と highspeed 版のワンクリック切り替えをサポートしています。

MiniMax-M2.7 と競合モデルの比較

| 方案 | 核心特徴 | 適用シナリオ | コスパ |

|---|---|---|---|

| MiniMax-M2.7 | 10B アクティブパラメータ、SWE-bench 78% | プログラミング、Agentワークフロー、大規模デプロイ | 非常に高い($0.30/$1.20) |

| M2.7-highspeed | 100 tps、66% の速度向上 | リアルタイム対話、IDE統合、Agentループ | 非常に高い + 高速 |

| Claude Opus 4.6 | 1M コンテキストウィンドウ、総合能力最強 | 長文ドキュメント、複雑な推論、汎用タスク | 中程度($15/$75) |

| GPT-5 | 成熟したエコシステム、マルチモーダル対応 | 汎用シナリオ、マルチモーダルアプリケーション | 中程度($10/$30) |

比較に関する注記: 上記のデータは公式のベンチマークテストおよび Artificial Analysis による第三者評価に基づいています。APIYI (apiyi.com) プラットフォームを通じて実際の比較検証が可能です。

よくある質問

Q1: MiniMax-M2.7 と M2.7-highspeed で出力結果に違いはありますか?

どちらも出力結果は完全に同一です。highspeed バージョンは推論エンジンを最適化することで、より高速なトークン生成速度(100 tps)を実現していますが、モデルの知能レベルや出力品質に変更はありません。レイテンシ(遅延)を特に気にしない用途であれば、標準版で十分です。

Q2: MiniMax-M2.7 の「再帰的自己進化」とは、モデルが継続的に変化するということですか?

いいえ、違います。再帰的自己進化とは、MiniMax が学習段階で採用している技術的な手法であり、モデルが自律的に学習プロセスとパラメータを最適化するものです。リリースされた時点でモデルの重みは固定されています。API を呼び出す際は、常に安定した一貫性のある出力が得られます。

Q3: MiniMax-M2.7 のテストを素早く始めるにはどうすればよいですか?

複数のモデルに対応した API 統合プラットフォームを利用してテストすることをお勧めします:

- APIYI (apiyi.com) にアクセスしてアカウントを登録します

- APIキーを取得し、無料クレジットを受け取ります

- 本記事のコード例を使用して素早く検証を行います

modelパラメータを切り替えるだけで、標準版と highspeed 版を簡単に使い分けることができます

まとめ

MiniMax-M2.7 の API 呼び出しにおける重要なポイント:

- 圧倒的なコストパフォーマンス: 10B のアクティブパラメータで Tier-1 クラスの性能を実現し、価格は Opus の 50 分の 1 です。大規模デプロイに最適です。

- 優れたプログラミング能力: SWE-bench Verified で 78% を記録し、競合モデルを大きくリード。ソフトウェアエンジニアリングタスクで卓越したパフォーマンスを発揮します。

- highspeed バージョン: 100 tps の出力速度は、リアルタイム対話やエージェントループのシナリオに適しており、知能レベルは標準版と全く同じです。

コストパフォーマンスを重視する開発者や企業ユーザーにとって、MiniMax-M2.7 は現在市場で最も注目すべきフラッグシップモデルの一つです。

APIYI (apiyi.com) を通じて効果を素早く検証することをお勧めします。プラットフォームでは無料クレジットが提供されており、統一された API インターフェースにより、MiniMax-M2.7 の標準版と highspeed 版をワンクリックで切り替えて利用可能です。

📚 参考資料

-

MiniMax M2.7 公式リリース: モデルアーキテクチャと自己進化技術の詳細

- リンク:

minimax.io/news/minimax-m27-en - 説明: ベンチマークやアーキテクチャの詳細を含む公式技術ブログ

- リンク:

-

MiniMax M2.7 モデルページ: 技術仕様および API ドキュメント

- リンク:

minimax.io/models/text/m27 - 説明: モデルパラメータ、料金体系、接続方法

- リンク:

-

Artificial Analysis による評価: 第三者機関による独立性能評価

- リンク:

artificialanalysis.ai/models/minimax-m2-7 - 説明: 速度および知能指数に関する独立した評価データ

- リンク:

-

APIYI プラットフォームドキュメント: MiniMax-M2.7 への迅速な接続

- リンク:

docs.apiyi.com - 説明: APIキーの取得、モデルリスト、呼び出し例

- リンク:

著者: APIYI 技術チーム

技術交流: コメント欄での議論を歓迎します。その他の資料については、APIYI ドキュメントセンター(docs.apiyi.com)をご覧ください。