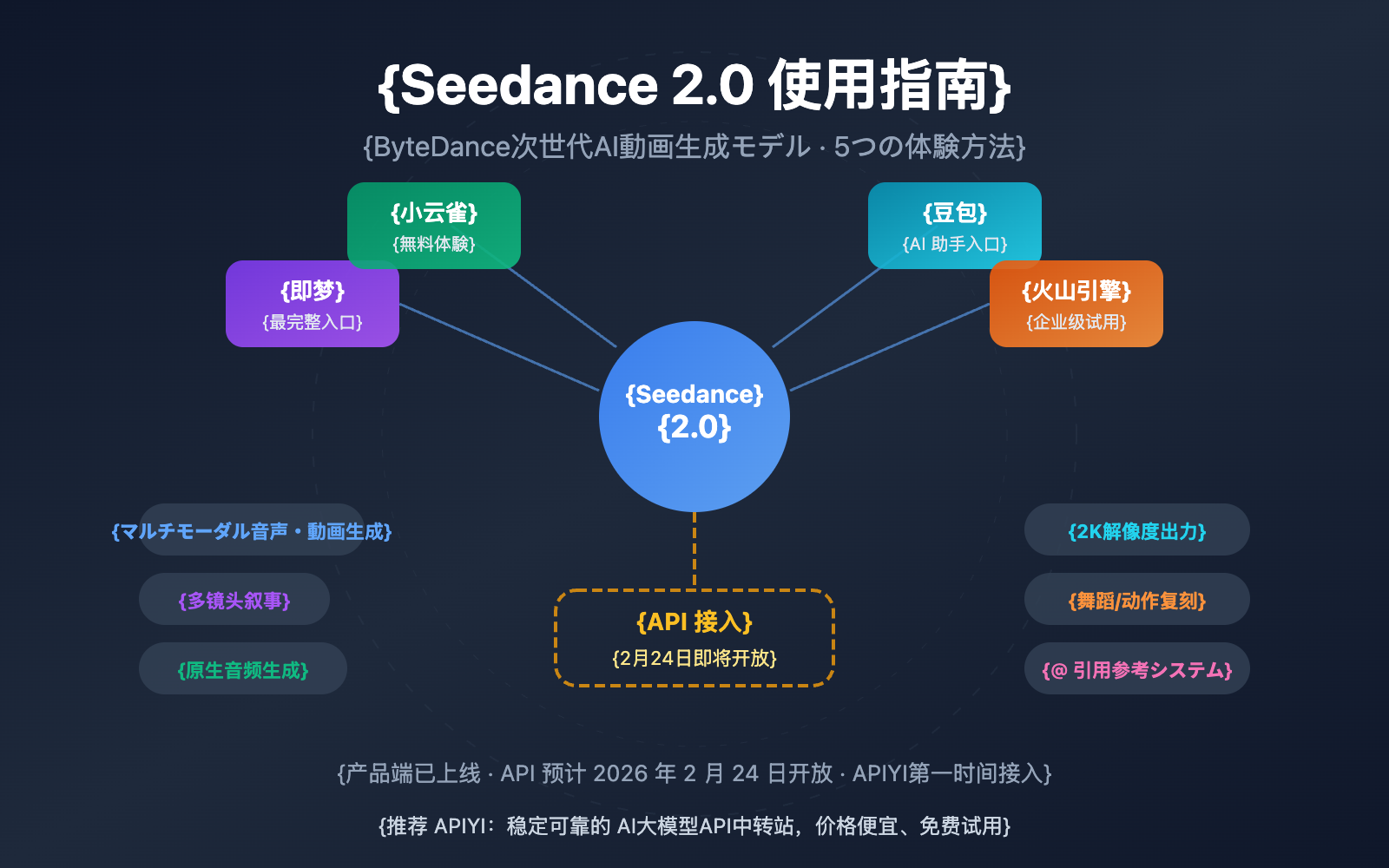

著者注:Seedance 2.0 の使い方を詳しく解説します。Jimeng(即夢)、Xiaoyunque(小雲雀)、Doubao(豆包)、Volcengine(火山エンジン)などの体験ポータルから、API 連携の時期や価格予想まで、バイトダンス(ByteDance)最強の AI 動画生成モデルをいち早く使いこなすための情報を網羅しています。

Seedance 2.0 はどうやって使うのでしょうか?これは今、最も注目されている疑問です。バイトダンスは 2026 年 2 月 12 日、AI 動画生成モデル「Seedance 2.0」を正式に発表しました。マルチモーダル音響・映像統合生成アーキテクチャとマルチショット・ナラティブ能力を備えたこのモデルは、瞬く間に世界のソーシャルメディアで大きな話題となっています。この記事では、Seedance 2.0 のあらゆる利用方法を詳しく紹介し、素早いマスターをサポートします。

核心価値:この記事を読めば、Seedance 2.0 の 5 つの体験ポータル、主要な機能特性、そして API 連携の最新スケジュールと価格情報を把握できます。

Seedance 2.0 主要機能一覧

Seedance 2.0 の使い方を詳しく見る前に、まずはその核心となる能力を素早く把握しましょう。

| 機能特性 | 具体的な説明 | 前世代からの進化 |

|---|---|---|

| マルチモーダル入力 | テキスト、画像、音声、動画の 4 種類の入力に対応 | 音声入力が新たに追加 |

| マルチショット・ナラティブ | 1 回の生成で複数のシーンが連続する動画を作成。キャラやスタイルの一貫性を維持 | 全く新しい能力 |

| ネイティブ・オーディオ生成 | 映像と同期した効果音や BGM を自動生成 | 全く新しい能力 |

| 2K 解像度出力 | 最大 1080p の制作級クオリティでの出力に対応 | 解像度が 2 倍に向上 |

| ダンス/アクション・レプリケーション | 参考動画をアップロードし、カメラワークや振り付けを精密に再現 | 精度が大幅に向上 |

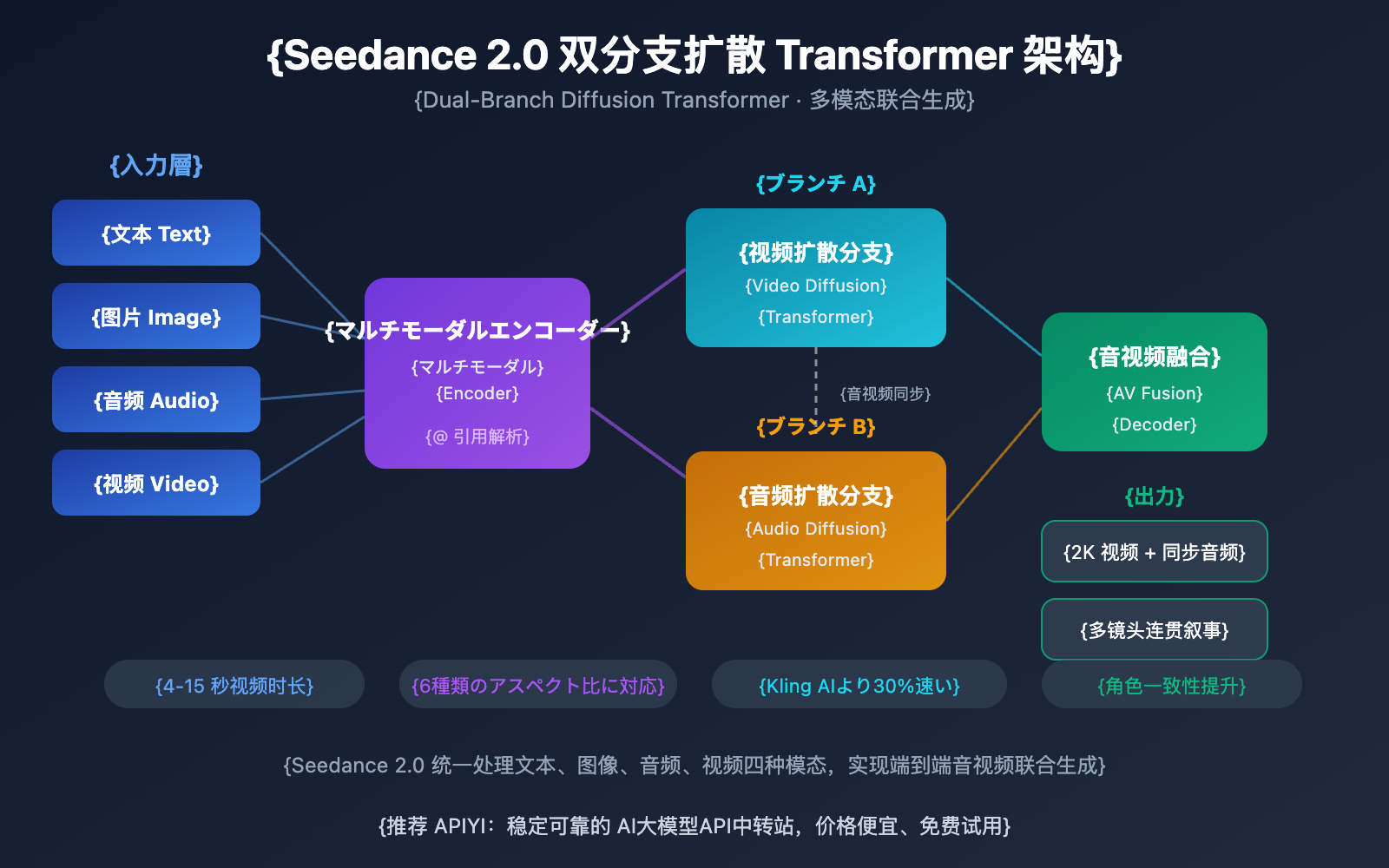

Seedance 2.0 技術アーキテクチャ詳解

Seedance 2.0 は、「デュアルブランチ拡散 Transformer アーキテクチャ(Dual-Branch Diffusion Transformer)」を採用しています。これがマルチモーダル統合生成を実現する鍵となっています。このアーキテクチャは、テキスト、画像、音声、動画の信号を統一して処理するため、モデルは動画を生成すると同時に、画面と完璧に同期した音声を産み出すことができます。

動画の品質面では、Seedance 2.0 の生成速度は競合製品(Kling AI など)よりも約 30% 高速です。4 秒から 15 秒の動画時間をサポートし、16:9、9:16、4:3、3:4、21:9、1:1 といった多様なアスペクト比に対応しています。人物の顔、服装、文字、シーンの一貫性は前世代から飛躍的に向上しており、AI 動画でよく見られる「キャラクターのブレ」や「スタイルの急変」といった問題を効果的に解決しています。

Seedance 2.0 の使い方:5つの体験方法を徹底解説

現在、Seedance 2.0は正式にリリースされていますが、APIはまだ公開されていません。以下に、現在利用可能なすべてのSeedance 2.0の使用方法をまとめました。

方法1:Jimeng(即夢)— 最も完全な体験の入り口

JimengはByteDance傘下のAIクリエイティブプラットフォームであり、Seedance 2.0が最初に導入された、最も機能が充実した体験の入り口です。

利用ステップ:

- Jimengプラットフォームにアクセス:

jimeng.jianying.com - 抖音(Douyin)アカウントでログイン

- 「生成」セクションに入り、「動画生成(视频生成)」を選択

- モデルのオプションで Seedance 2.0 を選択

- テキストプロンプトを入力するか、参考素材をアップロードして生成を開始

料金説明:Jimengはサブスクリプション制の有料サービスですが、新規ユーザーは1元で7日間試用できます。Seedance 2.0は有料会員向けの機能です。

🎯 アドバイス:Jimengは現在、Seedance 2.0を最も完全に体験できるプラットフォームです。まずはここから試すことをお勧めします。将来的にAPIでの一括呼び出しが必要な場合は、APIYI(apiyi.com)のリリース通知をチェックしてください。API公開後、速やかに対応予定です。

方法2:Xiao Yunque(小雲雀)— 無料体験の入り口

Xiao YunqueはByteDance傘下のもう一つのAIアプリで、Seedance 2.0を無料で体験できる機会を提供しています。

利用ステップ:

- Xiao Yunqueアプリをダウンロード

- ログイン後、Seedance 2.0による動画生成を3回無料で利用可能

- 毎日120ポイントが付与され、継続的に体験可能

おすすめの人:Seedance 2.0を無料で試してみたい方、特に生成クオリティをまず確認したい方に適しています。

方法3:Doubao(豆包)— 総合AIアシスタントの入り口

DoubaoはByteDanceの総合AIアシスタントアプリで、Seedance 2.0の動画生成機能も統合されています。

利用ステップ:

- Doubaoアプリをダウンロードするか、ウェブ版にアクセス

- チャット内で動画生成機能を選択

- Seedance 2.0モデルを選択して作成を開始

方法4:Volcengine(火山エンジン)— 企業向け試用

Volcengine(火山エンジン)はByteDanceのクラウドサービスプラットフォームで、Seedance 2.0の企業向けワークベンチ試用を提供しています。

| プラットフォーム | アクセス方法 | 特徴 | API提供の有無 |

|---|---|---|---|

| Volcengine | volcengine.com コンソール |

中国国内の企業ユーザー向け | 未開放(2月24日予定) |

| BytePlus | byteplus.com コンソール |

海外の企業ユーザー向け | 未開放(2月24日予定) |

注意:現在、VolcengineとBytePlusはワークベンチ画面での試用のみを提供しており、APIインターフェースはまだ公開されていません。

方法5:API連携 — 開発者に最適(近日公開)

プログラムからSeedance 2.0を呼び出す必要がある開発者や企業ユーザーにとって、APIは最も重要な連携方法です。

APIリリーススケジュール:

| 時期 | 出来事 | 説明 |

|---|---|---|

| 2026年2月12日 | Seedance 2.0 正式発表 | プロダクト側でのリリース |

| 2026年2月24日 | 公式API公開予定 | Volcengine/BytePlusを通じて提供 |

| API公開後すぐ | APIYIプラットフォームで同時提供 | 公式の約9割の価格で提供予定 |

🎯 開発者へのアドバイス:Seedance 2.0のAPIは2026年2月24日に正式公開される予定です。APIYI(apiyi.com)では、公開後すぐにSeedance 2.0のAPI連携サービスを開始します。価格は公式サイトの約9割に抑え、OpenAI互換形式の統一インターフェースを提供することで、迅速なシステム統合をサポートします。ぜひご期待ください。

Seedance 2.0 の活用テクニックとベストプラクティス

以下のSeedance 2.0活用テクニックをマスターすることで、生成結果を大幅に向上させることができます。

Seedance 2.0 プロンプト作成のコツ

テキストから動画(Text-to-Video)へのプロンプト提案:

- 人物、アクション、環境、照明など、具体的なシーンを記述する

- カメラワークを指定する(ズーム、パン、チルト、トラッキングなど)

- スタイルを指定する(映画風、ドキュメンタリー風、アニメ風など)

- 時間経過やリズムを指定する(例:「ゆっくりと進む」「素早く切り替わる」)

プロンプト例:

白いワンピースを着た若い女性が桜の木の下で軽やかに踊っている。

カメラは遠景から中景へとゆっくりとズームインしていく。

柔らかな自然光が左側から差し込み、花瓣が風に舞い落ちる。

映画のような質感、浅い被写界深度、4K画質。

Seedance 2.0 参考動画の活用テクニック

Seedance 2.0の「@引用システム」は独自の強みです。参考動画をアップロードすることで、以下の要素をコントロールできます。

- カメラワーク参考:好みのカメラの動きをアップロードすると、モデルがそれを正確に再現します。

- ダンスの振り付け:ダンスの参考動画をアップロードすると、モデルがリズムに合わせて振り付けを生成します。

- スタイル参考:参考画像や動画をアップロードすることで、視覚的なスタイルの一貫性を保ちます。

🎯 上級者向けアドバイス:マルチモーダル入力のシーンでは、@引用を使用して各参考素材に明確な役割(例:@カメラワーク参考、@キャラクター参考)を指定することで、より精密なコントロールが可能になります。今後APIが公開された際、APIYI(apiyi.com)でも完全なマルチモーダル入力機能をサポートする予定です。

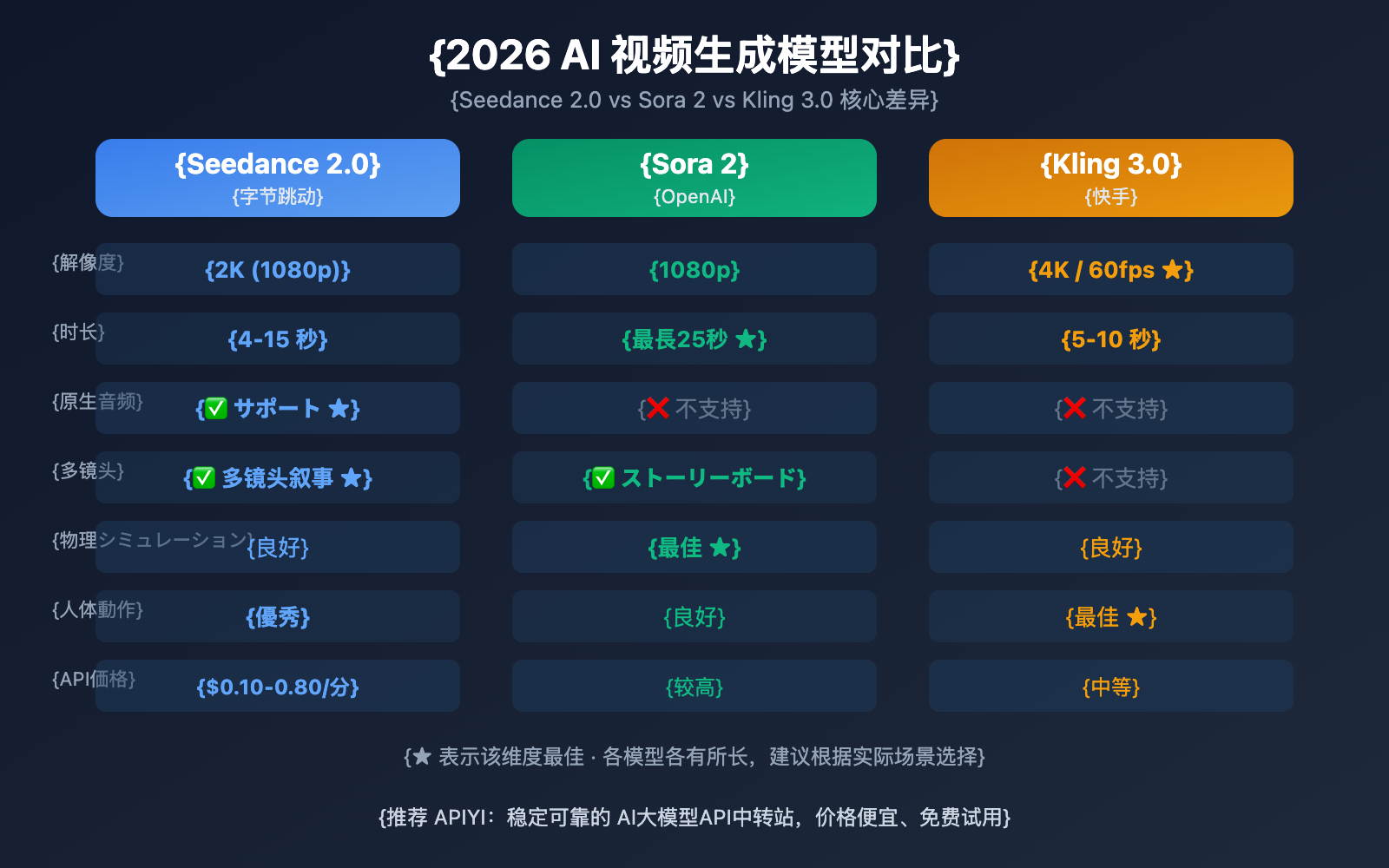

Seedance 2.0 と競合製品の比較

| 比較項目 | Seedance 2.0 | Sora 2 | Kling 3.0 |

|---|---|---|---|

| 開発元 | ByteDance(字節跳動) | OpenAI | Kuaishou(快手) |

| 最高解像度 | 2K(1080p) | 1080p | 4K/60fps |

| 動画の長さ | 4-15 秒 | 最大 25 秒 | 5-10 秒 |

| ネイティブオーディオ | ✅ 対応 | ❌ 非対応 | ❌ 非対応 |

| マルチショット・ナラティブ | ✅ 対応 | ✅ Storyboard | ❌ 非対応 |

| 参照動画入力 | ✅ マルチモーダル @ 引用 | ❌ 限定的 | ✅ 対応 |

| 物理シミュレーション | 良好 | 最高 | 良好 |

| 人体の動き | 優秀 | 良好 | 最高 |

| 推定 API 価格 | $0.10-0.80/分 | 高め | 中程度 |

比較のまとめ:各モデルにはそれぞれの強みがあります。Seedance 2.0 はネイティブオーディオとマルチモーダル引用の面でリードしており、Sora 2 は物理シミュレーションと長尺動画において最も強力です。一方、Kling 3.0 は解像度と人体の動きの表現において際立ったパフォーマンスを見せています。具体的な利用シーンに合わせて選択することをお勧めします。APIYI(apiyi.com)を利用すれば、複数の動画生成モデルを簡単に比較・テストすることが可能です。

よくある質問

Q1: Seedance 2.0 はどこで使えますか?現在利用可能な入り口は?

現在、Seedance 2.0 は以下のチャネルで体験いただけます:即夢(Jimeng)、小雲雀(Little Lark)、豆包(Doubao)などの ByteDance 公式アプリ。企業ユーザーの方は、火山引擎(Volcengine)や BytePlus のワークスペースからもお試しいただけます。API は 2026 年 2 月 24 日に公開される予定です。

Q2: Seedance 2.0 API はいつリリースされますか?価格はいくらですか?

Seedance 2.0 API は、2026 年 2 月 24 日に火山引擎(Volcengine)および BytePlus を通じて正式に公開される予定です。公式の推定価格は、解像度に応じて 1 分あたり 0.10 ドル〜0.80 ドルです。APIYI(apiyi.com)ではリリース後すぐに提供を開始し、公式サイトの約 9 割程度の価格で利用可能になる見込みです。

Q3: Seedance 2.0 は無料ですか?

Seedance 2.0 自体は完全に無料ではありません。即夢(Jimeng)プラットフォームでは有料会員登録が必要です(新規ユーザーは 1 元で 7 日間の試用が可能)。小雲雀(Little Lark)では 3 回の無料体験機会と、毎日 120 ポイントが付与されます。API 連携後は、利用量に応じた従量課金制となります。

Q4: Seedance 2.0 の国際版はどう使いますか?海外ユーザーの体験方法は?

現在、Seedance 2.0 は主に中国本土版の即夢(Jimeng)プラットフォームを通じてフル機能が提供されています。国際版の Dreamina(dreamina.capcut.com)や Pippit には、まだ Seedance 2.0 は実装されていません。海外ユーザーの方は、BytePlus プラットフォームの更新情報をチェックするか、API 公開後に APIYI(apiyi.com)を通じて利用することをご検討ください。

Seedance 2.0 使用上の注意点

Seedance 2.0 を使用する際は、以下の点にご注意ください:

- 音声クローン機能の一時停止:Seedance 2.0 のリリース時に搭載されていた「写真から音声を生成する」機能は、ディープフェイクに関する議論を受け、リリースから 48 時間以内に ByteDance によって一時停止されました。今後、本人確認メカニズムを導入した上で再開される予定です。

- コンテンツのコンプライアンス:生成されるコンテンツは関連法規を遵守する必要があり、著作権侵害や倫理的論争を招く内容の生成は避けてください。

- アカウント要件:即夢(Jimeng)プラットフォームの利用には抖音(Douyin)アカウントでのログインが必要であり、中国本土の携帯電話番号による認証が求められます。

まとめ

Seedance 2.0 の使い方のポイントは以下の通りです:

- 今すぐ体験:Jimeng(即夢)、Xiaoyunque(小雲雀)、Doubao(豆包)などのByteDance公式アプリからSeedance 2.0を利用できます。

- 企業向けトライアル:Volcengine(火山引擎)とBytePlusでワークベンチ画面からの試用が可能ですが、APIはまだ公開されていません。

- API連携:2026年2月24日に公開予定です。その際、プログラム経由での呼び出しが可能になります。

- 主な強み:ネイティブオーディオ生成 + マルチショット・ナラティブ + マルチモーダル @ 引用という、競合他社をリードする3つの差別化機能を備えています。

APIYI (apiyi.com) をフォローして、Seedance 2.0 APIのリリース通知を受け取ることをお勧めします。本プラットフォームでは、公式サイトの約9割の価格で連携サービスを提供予定です。OpenAI互換形式の統一インターフェースをサポートしているため、開発者は迅速に統合できます。

📚 参考資料

-

Seedance 2.0 公式紹介ページ: ByteDance Seedチームが発表したモデルの詳細

- リンク:

seed.bytedance.com/en/seedance2_0 - 説明: 完全な技術仕様と機能紹介が含まれています

- リンク:

-

Jimeng AI 創作プラットフォーム: Seedance 2.0をいち早く体験できる入り口

- リンク:

jimeng.jianying.com - 説明: 現在、最も機能が充実したSeedance 2.0利用プラットフォームです

- リンク:

-

Seedance 2.0 公式リリースブログ: ByteDance Seedチームによるリリース告知

- リンク:

seed.bytedance.com/en/blog/official-launch-of-seedance-2-0 - 説明: リリース時期や機能のハイライトなどの公式情報が含まれています

- リンク:

著者: 技術チーム

技術交流: コメント欄でSeedance 2.0の使用体験についてぜひ議論しましょう。AI動画生成モデルに関するさらなる情報は、APIYI (apiyi.com) 技術コミュニティをご覧ください。