Catatan Penulis: Penjelasan mendalam tentang 3 metode untuk memulai percakapan baru di OpenClaw dan 5 strategi optimasi Token untuk membantu pengguna menghindari masalah lonjakan biaya API akibat akumulasi riwayat percakapan.

"Menghabiskan 100 USD dalam dua jam" — ini adalah kejadian nyata yang dialami oleh seorang pengguna OpenClaw saat menggunakan model Claude Opus 4.5. Akar masalahnya adalah: percakapan yang sama akan mengakumulasi seluruh riwayat dan mengirimkannya ke API, yang menyebabkan konsumsi Token meningkat secara eksponensial.

Nilai Inti: Setelah membaca artikel ini, Anda akan mempelajari 3 cara untuk memulai percakapan baru + 5 strategi optimasi Token, yang dapat mengurangi biaya penggunaan OpenClaw hingga lebih dari 50%.

Prinsip Konsumsi Token OpenClaw

Untuk memahami mengapa biaya bisa melonjak, Anda perlu memahami mekanisme sesi di OpenClaw terlebih dahulu.

Arsitektur Penyimpanan Sesi

OpenClaw mengelola status sesi melalui proses Gateway, menggunakan dua lapisan penyimpanan persisten:

| Lapisan Penyimpanan | Lokasi File | Konten yang Disimpan |

|---|---|---|

| Metadata Sesi | sessions.json |

ID Sesi, Timestamp Aktivitas, Penghitung Token |

| Riwayat Percakapan | *.jsonl |

Riwayat percakapan lengkap, pemanggilan alat (tool calls), ringkasan terkompresi |

Poin Penting: Setiap kali Anda mengirim pesan, OpenClaw akan meneruskan semua konten berikut ke API:

- Petunjuk sistem (alat, keterampilan, file ruang kerja)

- Riwayat percakapan lengkap

- Hasil pemanggilan alat

- Lampiran (gambar, audio, file)

- Ringkasan terkompresi

Ilustrasi Akumulasi Token

Misalkan Anda menggunakan Claude Opus 4.5 untuk 10 putaran percakapan:

| Putaran Percakapan | Input Per Putaran | Konteks Terakumulasi | Biaya API (Input) |

|---|---|---|---|

| Putaran ke-1 | 500 token | 500 token | $0.0075 |

| Putaran ke-5 | 500 token | 5.000 token | $0.075 |

| Putaran ke-10 | 500 token | 15.000 token | $0.225 |

| Putaran ke-20 | 500 token | 50.000 token | $0.75 |

Masalah Terungkap: Jika percakapan yang sama terus berlanjut, konsumsi Token di setiap putaran akan terus bertambah. Saat menggunakan Claude Opus 4.5 (Input $15/M token), biaya satu putaran pada percakapan ke-20 sudah mencapai 100 kali lipat dari putaran pertama.

🎯 Peringatan Biaya: Jika Anda mendapati biaya API meningkat secara tidak wajar, kemungkinan besar Anda sudah mengobrol terlalu lama dalam satu percakapan yang sama. OpenClaw akan mengirimkan semua konten sebelumnya ke API, itulah alasan mengapa skenario "menghabiskan 100 USD dalam dua jam" bisa terjadi.

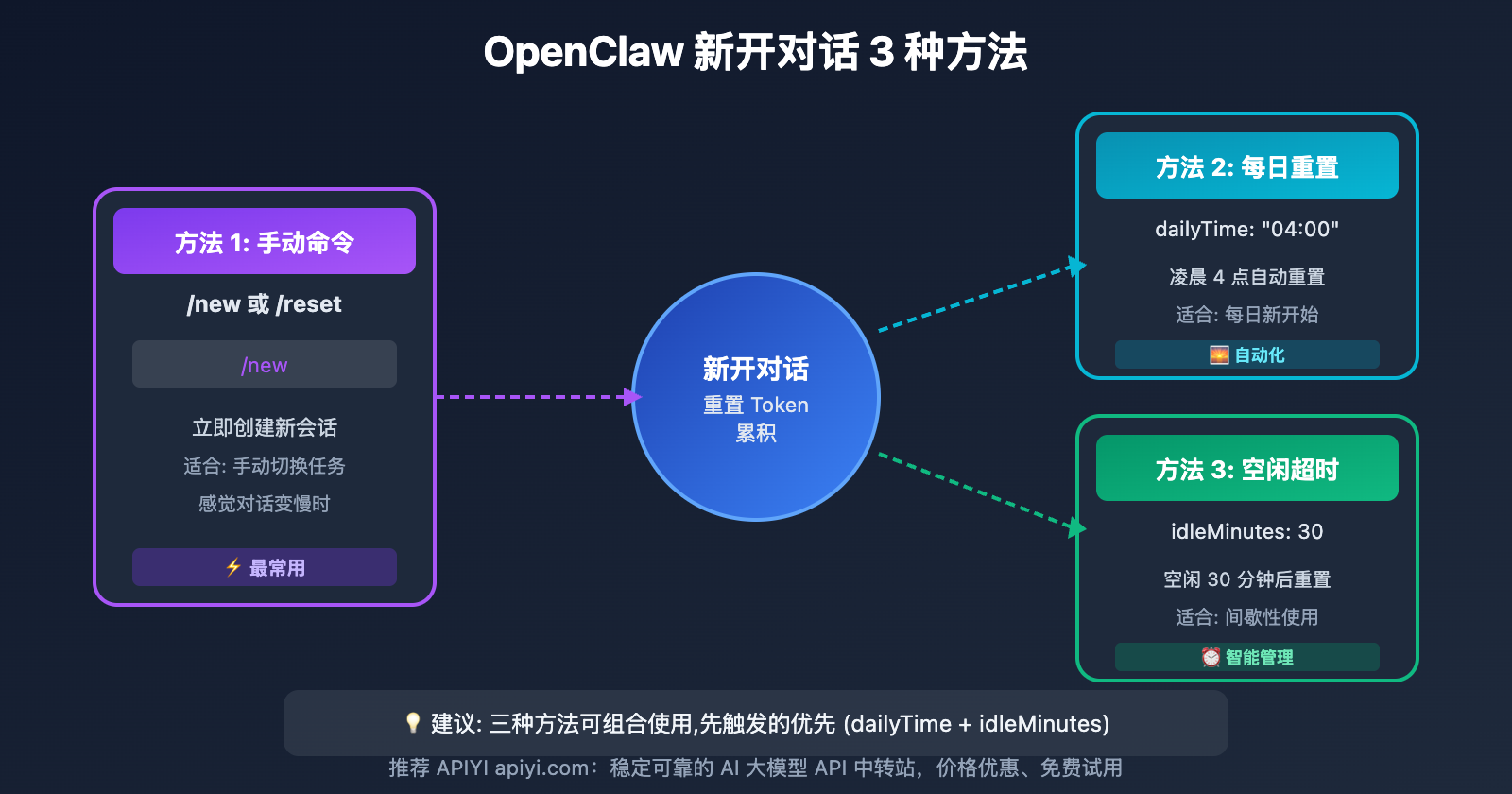

OpenClaw 新开对话 3 种方法

新开对话是控制 Token 成本最直接的方法,类似于 Claude Code 中的 /new 或 /clear 命令。

方法 1: 使用 /new 或 /reset 命令

这是最常用的手动重置方式:

# 在 OpenClaw 对话中输入

/new

# 或者使用

/reset

原理: 这两个命令会立即为当前 sessionKey 创建新的 sessionId,开始一个全新的对话记录文件。

适用场景:

- 切换到新任务时

- 感觉对话变慢时

- 每完成一个独立任务后

方法 2: 配置每日自动重置

OpenClaw 支持在指定时间自动创建新会话:

{

"session": {

"reset": {

"dailyTime": "04:00"

}

}

}

原理: 默认在每天凌晨 4:00 (本地时间) 触发重置。重置后的第一条消息会自动创建新的 sessionId。

适用场景:

- 每天开始工作时获得干净的上下文

- 不想手动管理会话

方法 3: 配置空闲超时重置

当你一段时间不使用 OpenClaw 后,自动开始新对话:

{

"session": {

"reset": {

"idleMinutes": 30

}

}

}

原理: 当会话空闲超过指定时间后,下一条消息会触发新会话创建。

配置组合: 可以同时设置每日重置和空闲超时,先触发的优先:

{

"session": {

"reset": {

"dailyTime": "04:00",

"idleMinutes": 60

}

}

}

建议: 对于使用 Claude Opus 等高价模型的用户,建议将

idleMinutes设置为 30-60 分钟。通过 APIYI apiyi.com 平台调用 Claude API 可以获得更优惠的价格,配合会话管理策略,能显著降低使用成本。

OpenClaw Token 优化 5 大策略

新开对话只是基础,以下 5 个策略能进一步优化你的 Token 消耗。

策略 1: 启用自动压缩 (Compaction)

OpenClaw 内置了上下文压缩机制,会将长对话摘要化:

| 触发条件 | 说明 |

|---|---|

| 溢出恢复 | 模型返回上下文溢出错误时自动压缩并重试 |

| 阈值维护 | contextTokens 超过 contextWindow – reserveTokens 时 |

手动触发压缩:

/compact

配置安全阈值:

{

"agents": {

"defaults": {

"reserveTokens": 20000

}

}

}

注意: 系统会确保至少保留 20,000 tokens 的空间用于多轮操作。

策略 2: 清理会话文件

一个被忽视的优化点是会话文件的清理。社区用户发现删除 .openclaw/agents.main/sessions/ 目录下的 .jsonl 文件后,Token 消耗大幅下降。

# 查看会话文件

ls -la ~/.openclaw/agents.main/sessions/

# 清理旧会话 (谨慎操作)

rm ~/.openclaw/agents.main/sessions/*.jsonl

建议: 定期清理超过 7-14 天的会话文件。

策略 3: 配置 Cache-TTL 优化

利用 API 提供商的缓存机制减少重复 Token 消耗:

{

"cache": {

"ttl": "1h",

"pruneOnExpiry": true

}

}

优化技巧: 将 Heartbeat 间隔设置为略低于 cache TTL:

- Cache TTL: 1 小时

- Heartbeat: 55 分钟

这样可以保持缓存热度,避免重新缓存完整提示词。

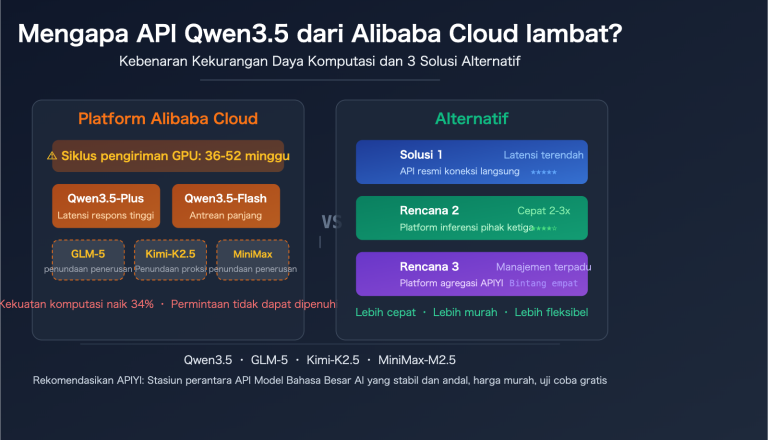

策略 4: 选择合适的模型

不同模型的 Token 单价差异巨大:

| 模型 | 输入价格 | 输出价格 | 适用场景 |

|---|---|---|---|

| Claude Opus 4.5 | $15/M | $75/M | 复杂推理、关键任务 |

| Claude Sonnet 4 | $3/M | $15/M | 日常开发、代码生成 |

| GPT-4o-mini | $0.15/M | $0.6/M | 简单任务、快速迭代 |

| Gemini 3.0 Flash | $0.075/M | $0.3/M | 低成本日常使用 |

| Kimi K2.5 | 更低 | 更低 | 性价比首选 |

实际建议:

- 日常探索: GPT-4o-mini 或 Gemini Flash

- 代码开发: Claude Sonnet 4

- 复杂任务: Claude Opus (配合严格的会话管理)

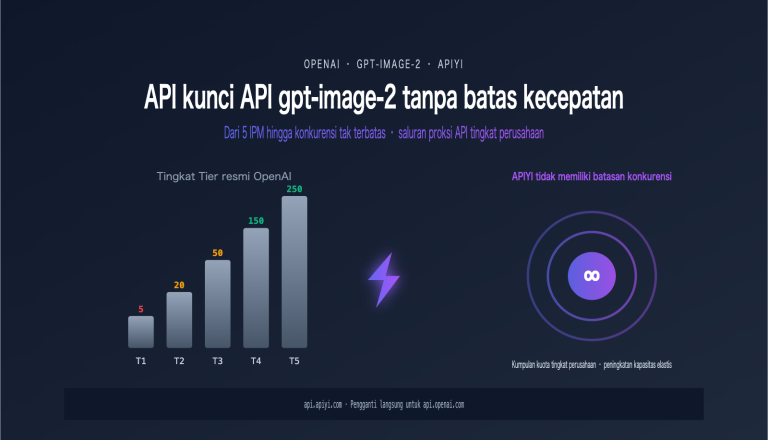

🎯 成本对比: 通过 APIYI apiyi.com 平台可以统一接入以上所有模型,并享受比官方更优惠的价格。平台支持实时切换模型,便于在不同任务间灵活调整成本策略。

策略 5: 优化使用习惯

| 习惯 | 优化前 | 优化后 | 节省估算 |

|---|---|---|---|

| 对话长度 | 一个对话聊几小时 | 每个任务新开对话 | 50%+ |

| 模型选择 | 全程 Opus | 按需切换模型 | 30-70% |

| 浏览器截图 | 频繁截图 | 减少不必要截图 | 20%+ |

| Temperature | 默认值 | 设置为 0.2 | 10%+ |

降低 Temperature 的好处:

{

"agents": {

"defaults": {

"temperature": 0.2

}

}

}

低 Temperature 让模型输出更确定,减少重试次数,从而降低 Token 消耗。

OpenClaw Token 监控实战

实时查看 Token 使用

# 查看当前会话状态

/status

# 启用使用量显示

/usage full

# 查看成本统计

/usage cost

监控输出示例

执行 /status 后会显示:

- 当前模型

- 上下文使用量

- 每轮响应 Token 数

- 预估成本 (仅 API Key 用户可见)

设置成本警报

建议在模型提供商处设置使用量上限,避免意外超支:

- Anthropic Console: 设置月度限额

- OpenAI Dashboard: 配置使用上限

- APIYI平台: 设置余额预警

建议: 使用 APIYI apiyi.com 的额度预警功能,当 API 消耗达到阈值时自动通知,避免"烧钱"事故发生。

常见问题

Q1: /new 和 /reset 命令在 Web UI 中不起作用怎么办?

这是一个已知 Bug (Issue #4446)。临时解决方案:

- 使用其他渠道 (WhatsApp/Telegram) 执行命令

- 直接删除会话文件:

rm ~/.openclaw/agents.main/sessions/*.jsonl - 等待官方修复后更新到最新版本

Q2: 如何判断当前对话的 Token 消耗是否过高?

执行 /status 查看上下文使用量。一般建议:

- 上下文超过 50% 容量时考虑新开对话

- 单轮响应时间明显变长时立即重置

- 使用高价模型 (如 Claude Opus) 时,每完成一个独立任务就新开对话

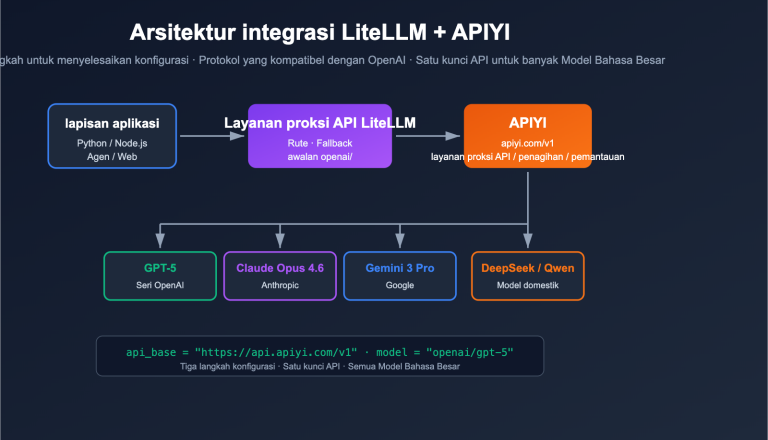

Q3: 有没有更经济的方式使用 Claude 模型?

推荐通过 API 聚合平台降低成本:

- 访问 APIYI apiyi.com 注册账号

- 获取 API Key,享受比官方更优惠的价格

- 配置 OpenClaw 使用聚合平台的 endpoint

- 同时可以灵活切换多种模型,按需选择性价比最高的方案

完整配置示例

以下是一个经过优化的 OpenClaw 配置文件示例:

{

"agents": {

"defaults": {

"model": {

"primary": "anthropic/claude-sonnet-4"

},

"temperature": 0.2,

"reserveTokens": 20000

}

},

"session": {

"reset": {

"dailyTime": "04:00",

"idleMinutes": 60

}

},

"cache": {

"ttl": "1h",

"pruneOnExpiry": true

}

}

查看使用 APIYI 平台的配置示例

{

"models": {

"providers": {

"apiyi": {

"type": "openai",

"baseURL": "https://vip.apiyi.com/v1",

"apiKey": "YOUR_APIYI_KEY",

"models": [

"claude-opus-4-5-20251101",

"claude-sonnet-4-20250514",

"gpt-4o-mini",

"deepseek-chat"

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "apiyi/claude-sonnet-4-20250514"

},

"temperature": 0.2,

"reserveTokens": 20000

}

},

"session": {

"reset": {

"dailyTime": "04:00",

"idleMinutes": 30

}

}

}

总结

OpenClaw Token 优化的核心要点:

- 新开对话是关键: 使用

/new或/reset命令,避免历史累积 - 配置自动重置: 设置

dailyTime和idleMinutes,让系统自动管理 - 启用压缩机制: 使用

/compact或自动压缩,减少上下文大小 - 选择合适模型: 日常用低价模型,复杂任务再用高端模型

- 监控使用量: 定期执行

/status和/usage cost,及时发现异常

记住:"两小时烧 100 美元"的悲剧完全可以避免,关键是养成定期新开对话的习惯。

推荐通过 APIYI apiyi.com 接入 Claude 等模型,获取更优惠的价格和完善的用量监控,让你的 AI 助手既强大又经济。

📚 参考资料

⚠️ 链接格式说明: 所有外链使用

资料名: domain.com格式,方便复制但不可点击跳转,避免 SEO 权重流失。

-

OpenClaw 会话管理文档: Session Management Compaction

- 链接:

docs.openclaw.ai/reference/session-management-compaction - 说明: 官方会话管理和压缩机制详解

- 链接:

-

OpenClaw Token 使用指南: Token Use

- 链接:

docs.openclaw.ai/token-use - 说明: 官方 Token 监控和优化建议

- 链接:

-

社区讨论 – Token 消耗问题: Burning through tokens

- 链接:

github.com/openclaw/openclaw/discussions/1949 - 说明: 用户分享的 Token 优化经验和解决方案

- 链接:

-

OpenClaw GitHub 仓库: 官方源码和文档

- 链接:

github.com/openclaw/openclaw - 说明: 最新版本下载和 Issue 跟踪

- 链接:

作者: 技术团队

技术交流: 欢迎在评论区讨论 OpenClaw 使用技巧,更多 AI API 资料可访问 APIYI apiyi.com 技术社区