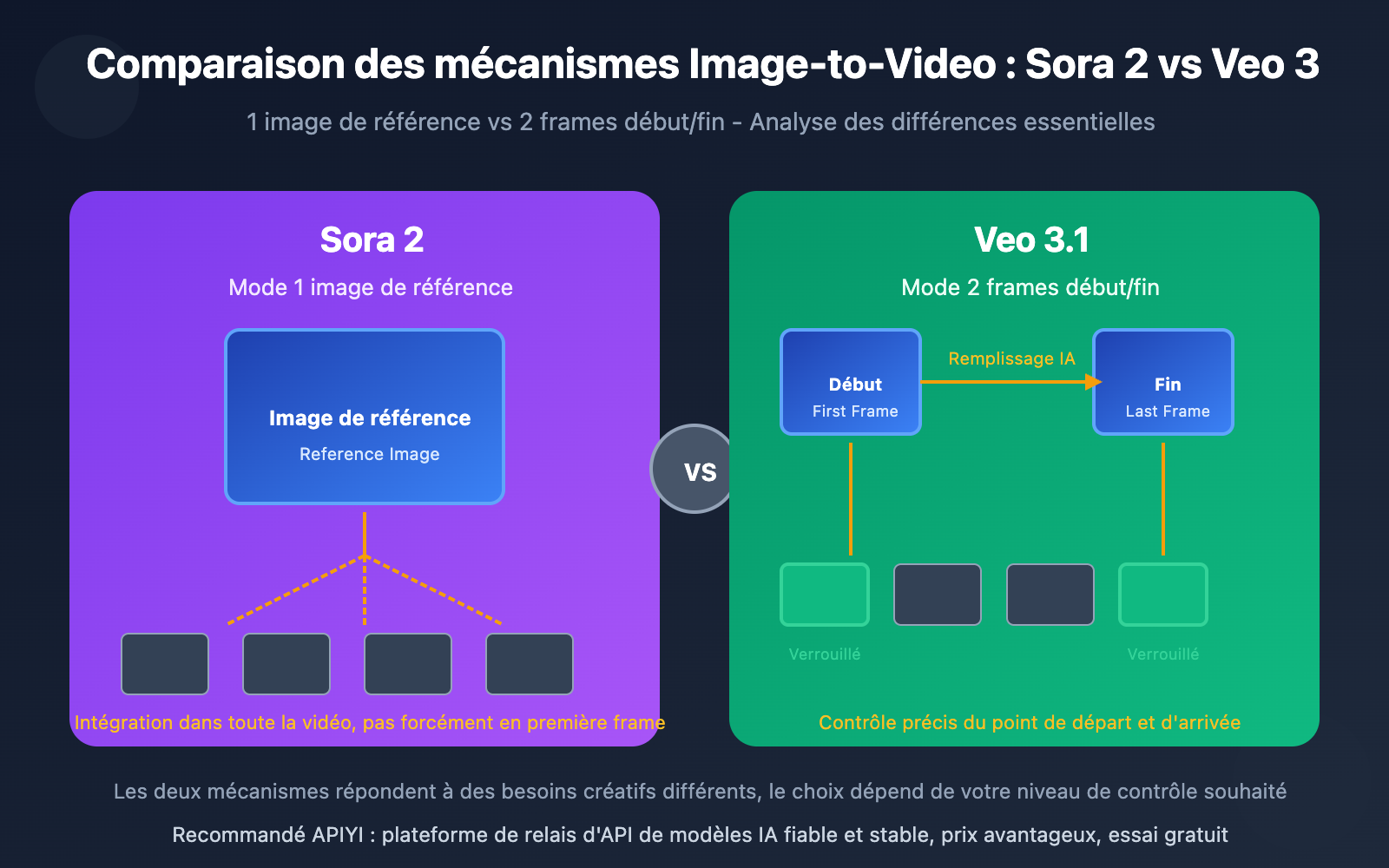

Dans le domaine de la génération vidéo par IA, l'Image-to-Video (génération vidéo à partir d'image) est l'une des fonctionnalités les plus prisées. Cependant, de nombreux développeurs ont des idées fausses sur les mécanismes de chargement d'images de Sora 2 et Veo 3 : Sora 2 ne peut-il vraiment utiliser l'image que comme première frame ? Et comment fonctionnent les deux images de Veo 3 ? Cet article analyse en profondeur les différences fondamentales entre ces deux modèles.

Valeur ajoutée : Après avoir lu cet article, vous comprendrez la différence essentielle entre l'image de référence de Sora 2 et les frames de début/fin de Veo 3, et vous saurez choisir l'API la plus adaptée à vos besoins créatifs.

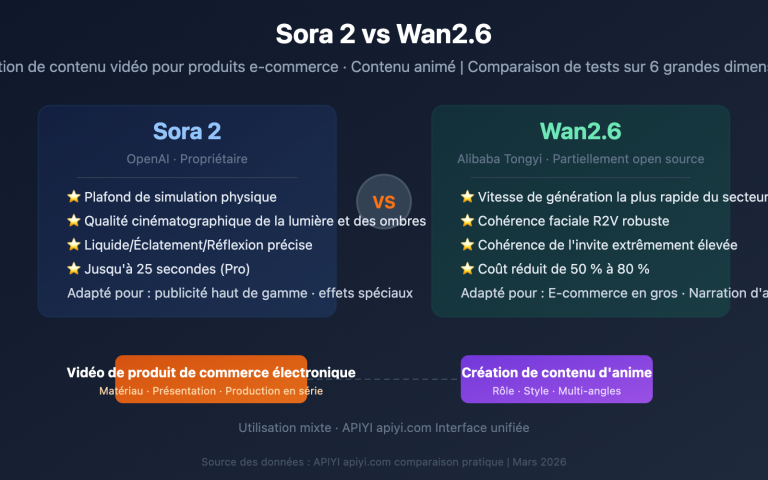

Différences fondamentales entre Sora 2 et Veo 3 pour l'Image-to-Video

| Critère de comparaison | Sora 2 | Veo 3.1 |

|---|---|---|

| Nombre d'images | 1 | 2 |

| Rôle de l'image | Image de référence (intégrée au style vidéo) | Frame de début + Frame de fin |

| Obligatoirement en première frame | Non, peut être intégrée à n'importe quelle position | Oui, contrôle strict du début et de la fin |

| Liberté créative | Élevée (l'IA décide comment l'intégrer) | Moyenne (points de départ et d'arrivée définis) |

| Cas d'usage | Référence de style, cohérence des personnages | Animations de transition, contrôle précis |

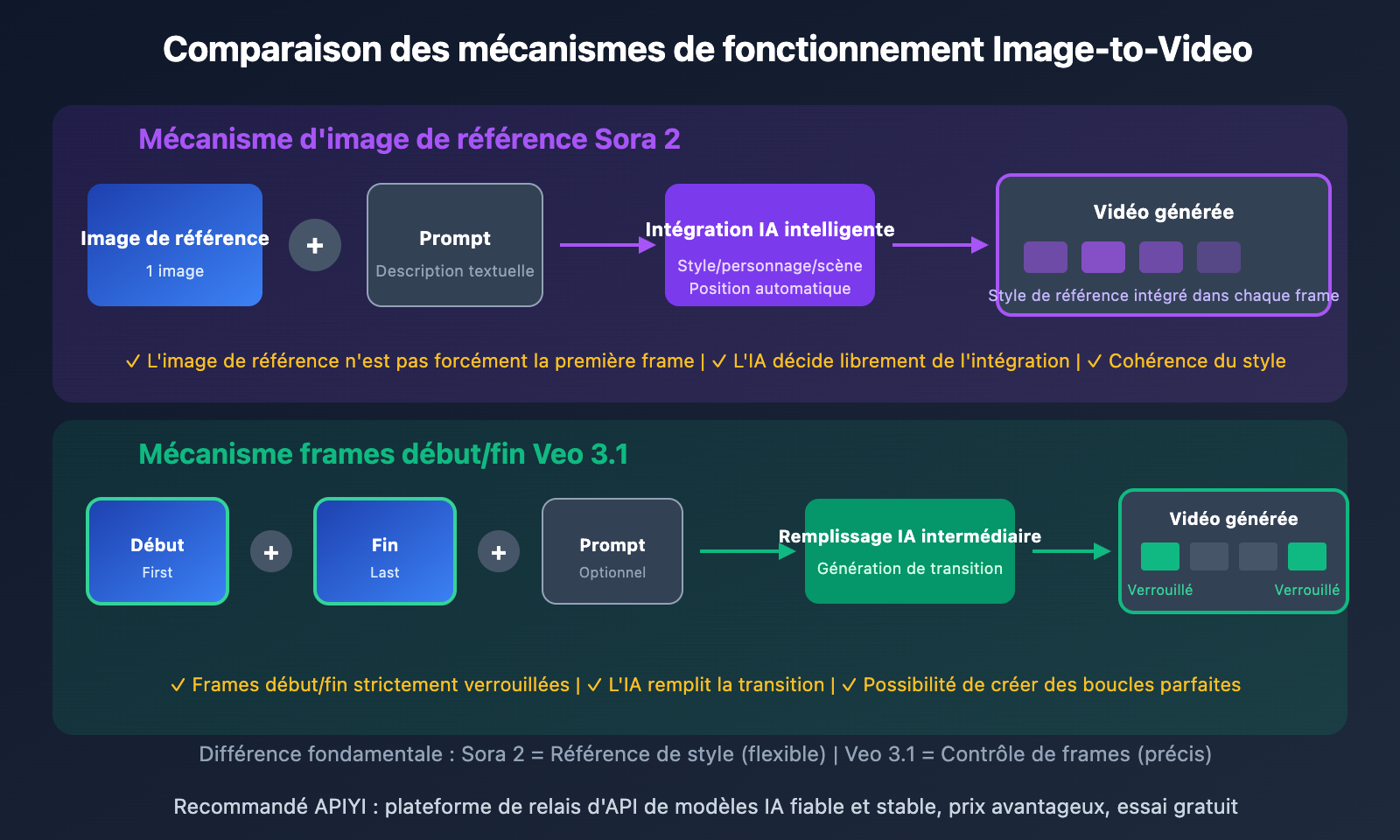

Image-to-Video de Sora 2 : la vérité sur l'image de référence

Beaucoup pensent que l'image fournie à Sora 2 devient automatiquement la "première frame", mais c'est une idée reçue courante. En réalité, l'image de Sora 2 est une "image de référence" (Reference Image), qui sert à fournir un style visuel, un design de personnage ou une référence de scène, plutôt qu'à être verrouillée comme première frame de la vidéo.

Principe de fonctionnement de l'image de référence :

- Intégration du style : Les tonalités, l'éclairage et le style artistique de l'image de référence influencent toute la vidéo

- Cohérence des personnages : Charger une image de personnage permet de maintenir son apparence cohérente dans la vidéo

- Référence de scène : Fournir une image d'environnement aide l'IA à comprendre l'atmosphère de la scène souhaitée

- Pas de première frame obligatoire : L'IA décide comment intégrer l'image de référence en fonction du prompt

Bien sûr, si votre prompt demande explicitement "commencer par cette image", Sora 2 l'utilisera comme première frame. Mais c'est le résultat du contrôle par le prompt, pas une limitation inhérente au chargement d'image.

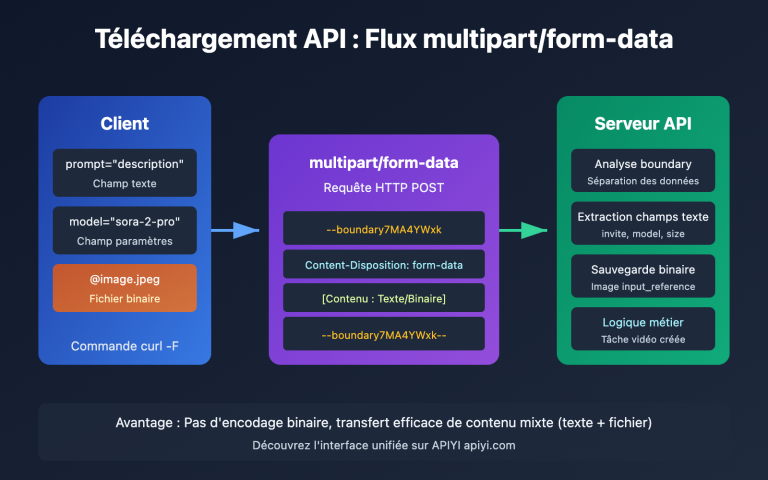

Appel API Sora 2 pour la génération de vidéos à partir d'images

Exemple de base – Génération vidéo avec Sora 2

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Sora 2 image vers vidéo - Mode image de référence

response = client.videos.create(

model="sora-2",

prompt="Un chat roux s'étire paresseusement au soleil, mouvement de caméra lent",

input_reference=open("cat_reference.jpg", "rb"), # Image de référence

size="1280x720",

seconds=8

)

Voir l’exemple complet d’appel Sora 2 (avec récupération des résultats par polling)

import openai

import time

def generate_video_with_reference(

prompt: str,

reference_image_path: str,

model: str = "sora-2",

size: str = "1280x720",

seconds: int = 8

) -> dict:

"""

Génère une vidéo avec Sora 2 à partir d'une image de référence

Args:

prompt: Description de la vidéo

reference_image_path: Chemin vers l'image de référence

model: sora-2 ou sora-2-pro

size: Dimensions de la vidéo

seconds: Durée de la vidéo (4/8/12)

"""

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Créer la tâche de génération vidéo

with open(reference_image_path, "rb") as img_file:

response = client.videos.create(

model=model,

prompt=prompt,

input_reference=img_file,

size=size,

seconds=seconds

)

video_id = response.id

print(f"Tâche de génération créée : {video_id}")

# Polling pour attendre la fin

while True:

status = client.videos.retrieve(video_id)

if status.status == "completed":

return {

"success": True,

"video_url": status.video_url,

"duration": seconds

}

elif status.status == "failed":

return {"success": False, "error": status.error}

print(f"Génération en cours... Statut : {status.status}")

time.sleep(5)

# Exemple d'utilisation

result = generate_video_with_reference(

prompt="Personnage marchant dans les rues de la ville, lumière chaude, qualité cinématographique",

reference_image_path="character.jpg"

)

Conseil : Passez par APIYI apiyi.com pour appeler l'API Sora 2. La plateforme offre un service d'interface stable et des crédits de test gratuits, pratique pour valider rapidement vos résultats de génération vidéo.

Veo 3.1 – Contrôle par images de début et fin : la magie de 2 images

Contrairement au mode image de référence de Sora 2, Veo 3.1 permet d'uploader 2 images qui serviront respectivement de première et dernière frame de la vidéo. L'IA génère automatiquement l'animation de transition intermédiaire, créant une transformation fluide de A vers B.

Avantages clés du contrôle par images de début/fin avec Veo 3.1

| Fonction | Description | Cas d'usage |

|---|---|---|

| Contrôle précis | Définir clairement le point de départ et d'arrivée | Présentation produit, transitions de scène |

| Effets de transition | L'IA remplit automatiquement l'animation intermédiaire | Transitions créatives, animations de morphing |

| Vidéos en boucle | Début et fin identiques créent une boucle parfaite | Animations de fond, effets de chargement |

| Contrôle narratif | Changement d'un état A vers un état B | Narration, expression émotionnelle |

Exemple d'appel API Veo 3.1 avec images de début/fin

import google.generativeai as genai

from google.genai import types

# Configuration de l'API (via APIYI)

genai.configure(api_key="YOUR_API_KEY")

# Charger les images de première et dernière frame

first_frame = genai.upload_file("start_scene.jpg")

last_frame = genai.upload_file("end_scene.jpg")

# Génération Veo 3.1 avec contrôle début/fin

response = genai.models.generate_videos(

model="veo-3.1",

prompt="Transition de scène fluide, qualité cinématographique",

image=first_frame,

config=types.GenerateVideosConfig(

last_frame=last_frame,

duration_seconds=8

)

)

Fonctionnalité spéciale Veo 3.1 : Au-delà du contrôle par images de début/fin, Veo 3.1 supporte jusqu'à 4 images de référence pour guider le style visuel et maintenir la cohérence des personnages et du style. Cette fonctionnalité n'est disponible que dans la version standard de Veo 3.1, pas dans la version Fast.

| Critère | Mode Image de référence Sora 2 | Mode Images début/fin Veo 3.1 |

|---|---|---|

| Nombre d'images | 1 image | 2 images (début + fin) |

| Rôle de l'image | Référence style/personnage | Contrôle précis des frames |

| Liberté de l'IA | Élevée | Basse (contraintes début/fin) |

| Direction créative | Exploration ouverte | Objectif défini |

| Capacité de transition | Moyenne | Excellente |

| Vidéos en boucle | Nécessite des astuces | Support natif |

| Durée vidéo | 4/8/12 sec | 4/6/8 sec |

| Résolution | 720p/1080p | À partir de 720p |

Comment choisir ? Guide de décision par scénario

Choisissez Sora 2 si :

- Vous avez une image de référence d'un personnage/scène et voulez laisser l'IA explorer librement

- Vous devez maintenir la cohérence du style visuel de votre marque

- Vous souhaitez que l'IA décide de la meilleure composition et trajectoire de mouvement

- Vous créez du contenu vidéo de 12 secondes

Choisissez Veo 3.1 si :

- Vous savez exactement à quoi doivent ressembler les images de début et de fin

- Vous devez créer une démonstration de transformation de produit A→B

- Vous voulez créer des animations de fond en boucle parfaite

- Vous créez des transitions de scène ou des effets de morphing

Questions fréquentes

Q1 : L’image de référence de Sora 2 apparaît-elle forcément dans la première frame ?

Pas nécessairement. L'image de référence de Sora 2 est une "référence visuelle" et non un "verrouillage de première frame". L'IA décide comment intégrer les éléments de l'image de référence dans la vidéo en fonction de votre prompt. Si vous avez besoin que l'image de référence serve de première frame, précisez-le explicitement dans votre prompt : "Utilise cette image comme plan d'ouverture".

Q2 : Les deux images de Veo 3.1 peuvent-elles avoir un contenu complètement différent ?

Oui, mais il est recommandé qu'elles aient un certain lien visuel. Veo 3.1 va tenter de créer une transition fluide entre les deux images, et si le contenu diffère trop, la transition risque de paraître peu naturelle. La meilleure pratique consiste à avoir une certaine continuité dans la composition, les tonalités ou le sujet entre les images de début et de fin.

Q3 : Quel modèle offre la meilleure qualité pour la génération de vidéo à partir d’images ?

Chacun a ses avantages : Sora 2 Pro excelle dans la qualité visuelle et le naturel des mouvements, parfait pour créer du contenu cinématographique ; Veo 3.1 est supérieur en termes de contrôle précis et d'effets de transition. Je vous suggère de tester les deux modèles via l'API disponible sur apiyi.com pour choisir selon vos résultats concrets.

Résumé

Les différences clés entre la génération vidéo à partir d'images de Sora 2 et Veo 3 :

- Nombre d'images différent : Sora 2 prend en charge 1 image de référence, Veo 3.1 prend en charge 2 frames de début et de fin

- Rôle des images différent : L'image de référence de Sora 2 s'intègre au style de la vidéo, les frames de début et fin de Veo 3.1 contrôlent précisément le point de départ et d'arrivée

- Cas d'usage différents : Sora 2 convient à la création ouverte, Veo 3.1 convient aux effets de transition avec un objectif précis

Comprendre la différence fondamentale entre ces deux mécanismes vous permet de choisir l'API la plus adaptée à vos besoins spécifiques pour obtenir de meilleurs résultats créatifs.

Je vous recommande d'intégrer simultanément les API Sora 2 et Veo 3 via APIYI apiyi.com, une plateforme qui offre une interface unifiée et des crédits de test gratuits, pratique pour comparer et basculer facilement entre les modèles.

📚 Ressources

⚠️ Format des liens : Tous les liens externes utilisent le format

Nom de la ressource: domain.com, facile à copier mais non cliquable, pour éviter la perte de poids SEO.

-

Documentation officielle de l'API OpenAI Sora : Guide complet de génération vidéo Sora

- Lien :

platform.openai.com/docs/guides/video-generation - Description : Découvrez les paramètres officiels et l'utilisation de Sora 2 pour la génération vidéo à partir d'images

- Lien :

-

Documentation Google Veo 3.1 sur les images de début et fin : Guide de génération vidéo Vertex AI

- Lien :

docs.cloud.google.com/vertex-ai/generative-ai/docs/video/generate-videos-from-first-and-last-frames - Description : Apprenez en détail comment utiliser la fonctionnalité d'images de début et fin de Veo 3.1

- Lien :

-

Sora 2 Prompting Guide : Guide officiel OpenAI des invites

- Lien :

cookbook.openai.com/examples/sora/sora2_prompting_guide - Description : Apprenez à rédiger des prompts vidéo de haute qualité pour Sora 2

- Lien :

-

Analyse des fonctionnalités Google Veo 3.1 : Détails sur les images de début/fin et les images de référence

- Lien :

getimg.ai/blog/google-veo-3-1-review - Description : Explorez en profondeur les nouvelles fonctionnalités et astuces d'utilisation de Veo 3.1

- Lien :

Auteur : Équipe technique

Échanges techniques : N'hésitez pas à discuter dans les commentaires. Pour plus de ressources, visitez la communauté technique APIYI apiyi.com