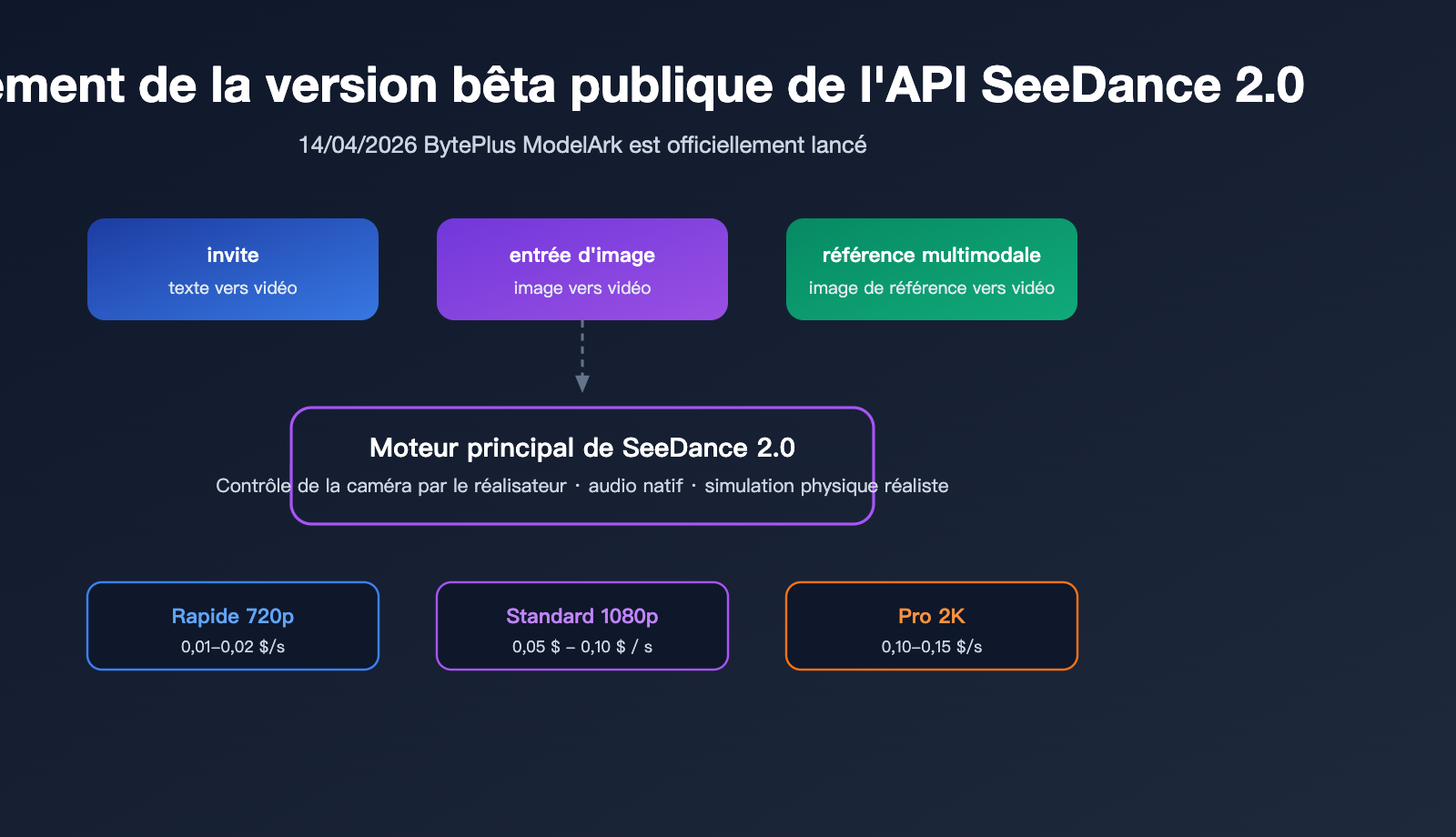

Le 14 avril 2026, le modèle de génération vidéo SeeDance 2.0 de ByteDance a officiellement ouvert sa bêta publique sur la plateforme BytePlus ModelArk. Les développeurs peuvent enfin accéder à cette technologie de pointe via une API standard. Contrairement à la phase d'accès limité lancée le 9 avril, cette bêta prend en charge des interfaces multimodales (texte vers vidéo, image vers vidéo, vidéo avec image de référence) et propose trois variantes : Fast, Standard et Pro, afin de répondre aux différents besoins en termes de qualité et de coût.

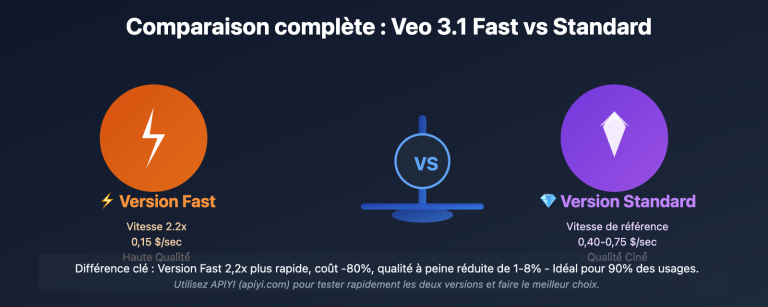

Cet article s'appuie sur les informations officielles de la documentation BytePlus (docs.byteplus.com/en/docs/ModelArk/2291680) et sur des tests effectués sur la version internationale. Nous explorerons en détail la matrice des modèles, les spécifications des paramètres, le flux d'appel asynchrone et les cas d'usage réels de l'API SeeDance 2.0. Que vous souhaitiez intégrer rapidement une ligne de production de vidéos courtes ou que vous cherchiez une alternative à Veo 3 ou Kling 2, ce guide vous fournira les clés nécessaires pour prendre vos décisions.

Aperçu des points clés de l'API SeeDance 2.0

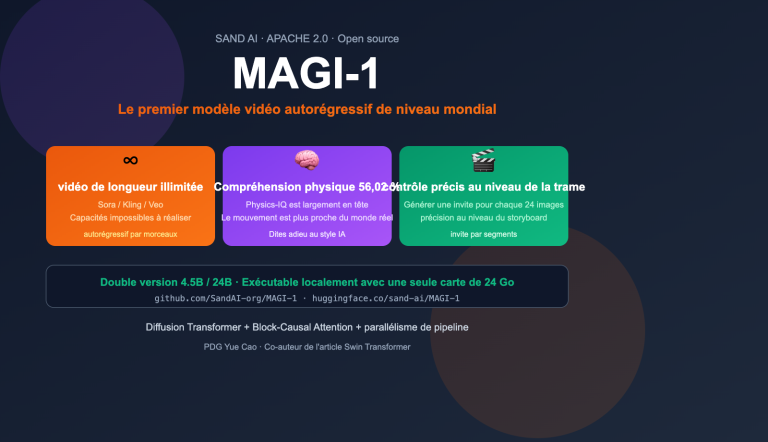

SeeDance 2.0 est le modèle de base de génération vidéo de deuxième génération lancé par ByteDance après le SeeDance 1.5 Pro. Il se distingue par quatre améliorations majeures : qualité cinématographique, audio natif, physique réaliste et contrôle de caméra digne d'un réalisateur. Depuis l'ouverture de la bêta le 14 avril, les capacités de l'API officielle sont alignées avec celles du centre d'expérience, permettant aux développeurs d'obtenir des autorisations d'appel complètes via l'interface d'inférence standard ModelArk.

Améliorations clés par rapport à la version 1.5 Pro

Comparé à la génération précédente, l'API SeeDance 2.0 présente des améliorations significatives :

| Dimension de capacité | SeeDance 1.5 Pro | SeeDance 2.0 | Niveau d'amélioration |

|---|---|---|---|

| Résolution max. | 1080p | 2K (variante Pro) | +1 niveau |

| Durée max. | 10 secondes | 15 secondes | +50% |

| Audio natif | Non supporté | Supporté (ambi + voix) | Capacité inédite |

| Contrôle caméra | Invites de base | Paramétrage professionnel | Évolution qualitative |

| Entrées de référence | Jusqu'à 3 images | 9 img + 3 vid + 3 audio | Capacité x4 |

| Simulation physique | Limitée | Moteur physique réaliste | Évolution qualitative |

🎯 Conseils d'intégration : L'API SeeDance 2.0 est actuellement disponible simultanément sur la version internationale de BytePlus et sur certaines plateformes agrégatrices. Nous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour appeler de manière unifiée SeeDance 2.0 et d'autres modèles vidéo de premier plan. Cette plateforme propose des interfaces encapsulées et supporte l'accès depuis la Chine, permettant d'éviter les problèmes d'instabilité réseau liés aux connexions directes à l'étranger.

Conditions d'accès à la bêta et quotas

La phase de bêta publique de BytePlus est ouverte aux développeurs, mais soumise à certaines limitations de débit :

- Mode d'accès : Après vérification de l'identité sur la console ModelArk, vous pouvez faire une demande sans liste d'attente.

- Quota gratuit : 20 appels par mois et par compte sur la variante Fast durant la phase de bêta.

- Limitation de débit : QPS = 2 par compte, un dépassement entraîne une erreur HTTP 429.

- Tâches simultanées : Jusqu'à 3 tâches en cours de traitement simultanément.

Matrice des modèles et points de terminaison de l'API SeeDance 2.0

BytePlus propose une matrice combinant trois niveaux de qualité et trois types de modalités d'entrée pour l'API SeeDance 2.0, permettant aux développeurs de choisir la solution la plus adaptée à chaque scénario.

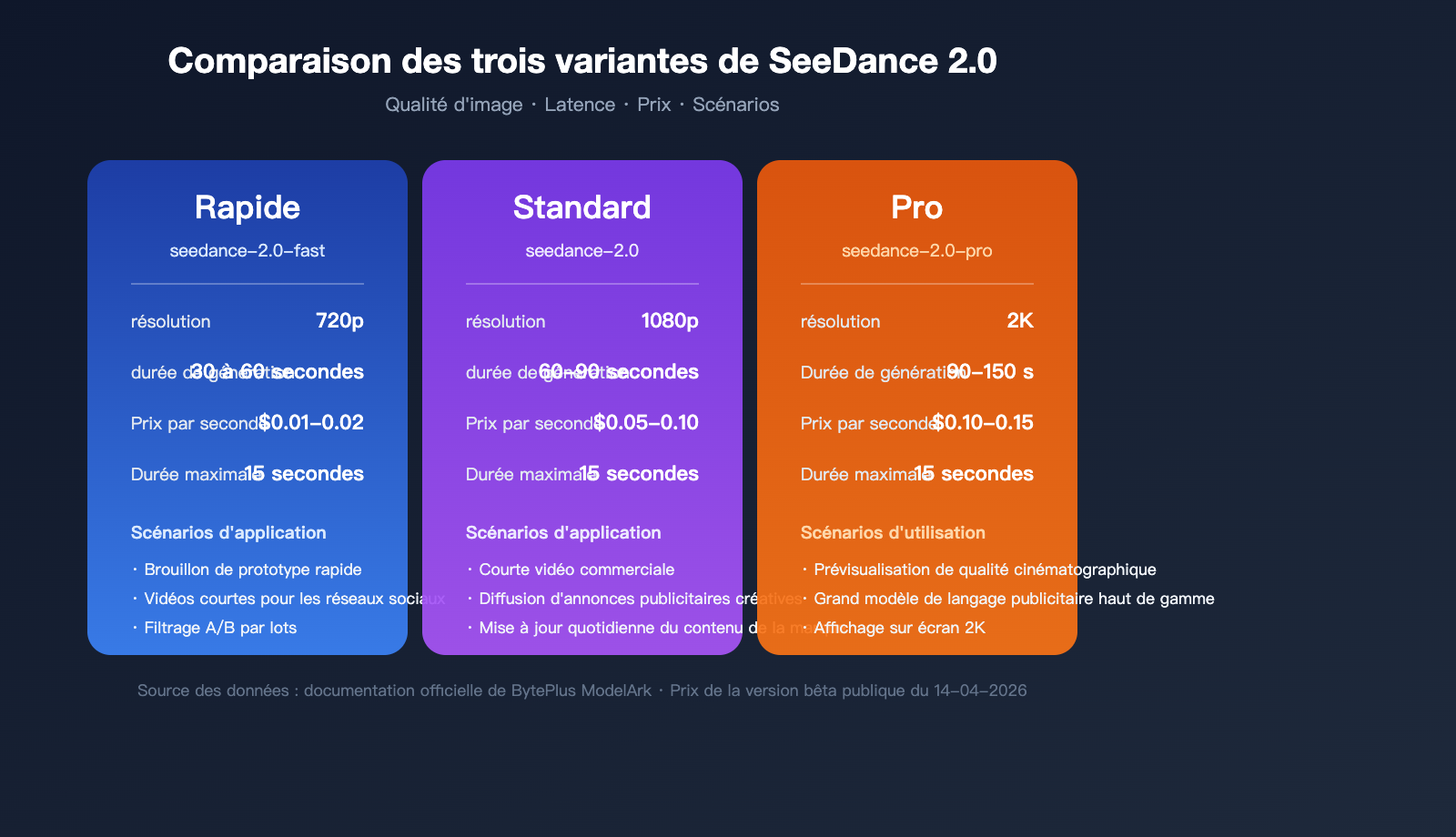

Comparaison des variantes de modèles

Les trois variantes diffèrent considérablement en termes de temps de génération, de qualité d'image et de coût :

| Variante | ID du modèle | Résolution par défaut | Temps de génération typique | Scénario cible |

|---|---|---|---|---|

| Fast | seedance-2.0-fast |

720p | 30-60 secondes | Prototypage rapide, contenu social |

| Standard | seedance-2.0 |

1080p | 60-90 secondes | Vidéos commerciales, publicité |

| Pro | seedance-2.0-pro |

2K | 90-150 secondes | Prévisualisation cinématographique, haute production |

Trois types de points de terminaison d'entrée

Selon la modalité d'entrée, l'API SeeDance 2.0 est divisée en trois points de terminaison distincts :

- Texte vers vidéo (Text-to-Video) : Une simple invite suffit pour générer du contenu, idéal pour la création assistée par script.

- Image vers vidéo (Image-to-Video) : Permet d'entrer une ou plusieurs images avec une invite optionnelle pour générer une animation étendue.

- Vidéo de référence (Reference-to-Video) : Fusionne des entrées hybrides d'images, de clips vidéo et d'audio pour une intégration multimodale.

💡 Conseil d'invocation : Si vous devez transmettre plusieurs modalités (images, audio, vidéo) lors d'un même appel, utilisez le point de terminaison Reference-to-Video et spécifiez un rôle pour chaque élément dans le tableau

references(subject/environment/motion/audio). Passer par le service proxy API APIYI (apiyi.com) permet de centraliser l'authentification et la facturation, facilitant ainsi le suivi des coûts pour votre équipe.

Paramètres de requête de l'API SeeDance 2.0 en détail

L'API SeeDance 2.0 utilise un mode de tâches asynchrones : une fois la requête soumise, un job_id est retourné, et le développeur doit effectuer un interrogeage (polling) pour récupérer l'URL de la vidéo finale.

Tableau des paramètres principaux

Le tableau ci-dessous détaille les spécifications complètes des paramètres pour le point de terminaison Texte vers vidéo :

| Paramètre | Type | Plage de valeurs | Requis | Description |

|---|---|---|---|---|

model |

String | seedance-2.0 / -fast / -pro |

Oui | ID du modèle |

prompt |

String | ≤ 2000 caractères | Oui | Anglais ou chinois |

resolution |

String | 480p / 720p / 1080p / 2k |

Non | Par défaut selon la gamme |

duration |

Integer | 4-15 (secondes) | Non | 5 secondes par défaut |

aspect_ratio |

String | 21:9 / 16:9 / 4:3 / 1:1 / 3:4 / 9:16 | Non | 16:9 par défaut |

audio |

Boolean | true / false | Non | Générer de l'audio natif |

seed |

Integer | Entier arbitraire | Non | Graine fixe pour la reproductibilité |

negative_prompt |

String | ≤ 500 caractères | Non | Éléments à exclure |

style |

String | cinematic / anime / realistic / 3d_render | Non | Style prédéfini |

Exemple de code pour démarrer rapidement

Voici un exemple minimal pour appeler le modèle Texte vers vidéo, illustrant le processus standard en trois étapes : Soumission-Interrogeage-Téléchargement :

import requests

import time

BASE_URL = "https://api.apiyi.com/seedance/v1" # Accès via le service proxy APIYI

API_KEY = "your_apiyi_key"

# Étape 1 : Soumettre la tâche

submit_resp = requests.post(

f"{BASE_URL}/videos",

headers={"Authorization": f"Bearer {API_KEY}"},

json={

"model": "seedance-2.0",

"prompt": "Un chat roux se promène sous une pluie de fleurs de cerisier, profondeur de champ cinématographique, tons chauds au crépuscule",

"resolution": "1080p",

"duration": 5,

"aspect_ratio": "16:9",

"audio": True,

"seed": 42

}

)

job_id = submit_resp.json()["job_id"]

# Étape 2 : Interroger le statut

while True:

status_resp = requests.get(

f"{BASE_URL}/videos/{job_id}",

headers={"Authorization": f"Bearer {API_KEY}"}

)

data = status_resp.json()

if data["status"] == "completed":

video_url = data["output"]["video_url"]

print(f"Génération de la vidéo terminée : {video_url}")

break

elif data["status"] == "failed":

raise Exception(f"Échec de la génération : {data.get('error')}")

time.sleep(5)

Cet exemple utilise APIYI (apiyi.com) comme point d'entrée, permettant aux développeurs d'accéder directement au service sans configurer de proxy à l'étranger. Si vous utilisez le point de terminaison officiel de BytePlus, remplacez simplement BASE_URL par https://api.byteplus.com/seedance/v1, les autres paramètres restent parfaitement compatibles.

Paramètres avancés pour Image vers vidéo et Vidéo de référence

Le point de terminaison Image vers vidéo ajoute les champs image_url ou image_base64 aux paramètres de base :

{

"model": "seedance-2.0",

"image_url": "https://example.com/start_frame.jpg",

"prompt": "Zoom lent, le personnage se retourne et sourit",

"duration": 8,

"camera_motion": "dolly_in"

}

Le tableau references du point de terminaison Vidéo de référence peut contenir jusqu'à 12 éléments (9 images + 3 vidéos + 3 audios), chaque élément doit spécifier un role et un type :

{

"references": [

{"type": "image", "role": "subject", "url": "https://..."},

{"type": "image", "role": "environment", "url": "https://..."},

{"type": "audio", "role": "audio", "url": "https://..."}

]

}

Stratégie tarifaire et optimisation des coûts de l'API SeeDance 2.0

Pendant la phase de bêta publique, l'API SeeDance 2.0 est facturée selon la durée réelle de la vidéo, à la seconde. Le tableau suivant présente les tarifs officiels de référence pour chaque niveau :

| Niveau | Résolution | Prix par seconde (USD) | Coût vidéo 5 s | Coût vidéo 10 s |

|---|---|---|---|---|

| Fast | 720p | $0.01 – $0.02 | $0.05 – $0.10 | $0.10 – $0.20 |

| Standard | 1080p | $0.05 – $0.10 | $0.25 – $0.50 | $0.50 – $1.00 |

| Pro | 2K | $0.10 – $0.15 | $0.50 – $0.75 | $1.00 – $1.50 |

⚡ Conseils d'optimisation des coûts : Pour les projets en volume, nous vous recommandons d'utiliser le niveau Fast pour tester vos brouillons d'invites. Une fois la direction validée, utilisez les niveaux Standard ou Pro pour la génération finale ; cela permet d'économiser plus de 60 % sur vos coûts. En passant par la plateforme APIYI (apiyi.com), vous bénéficiez d'une facturation en RMB et d'une consolidation des coûts, facilitant ainsi la gestion comptable et la répartition des frais.

Exemple de calcul de coût réel

Imaginons un compte de vidéos courtes produisant 20 vidéos de 8 secondes en 1080p par jour :

- Coût unitaire : 8 secondes × $0,075 ≈ $0,60

- Coût journalier : 20 vidéos × $0,60 = $12

- Coût mensuel : $12 × 30 ≈ $360

En utilisant le niveau Fast pour trois cycles de brouillons avant de finaliser en Standard, le coût mensuel peut être réduit à environ $180.

Les six capacités essentielles de l'API SeeDance 2.0

Capacité 1 : Contrôle de caméra digne d'un réalisateur

SeeDance 2.0 prend nativement en charge plus de 10 commandes de mouvement de caméra, activables via le paramètre camera_motion ou par une description naturelle dans votre invite :

dolly_in/dolly_out: Travelling avant / arrièrepan_left/pan_right: Panoramique horizontal (gauche/droite)tilt_up/tilt_down: Inclinaison verticale (haut/bas)orbit_left/orbit_right: Rotation orbitalecrane_up/crane_down: Mouvement de grue (montée/descente)zoom_in/zoom_out: Zoom avant / arrière

Capacité 2 : Génération audio native

En activant audio: true dans votre requête, le modèle génère des sons ambiants, des voix ou de la musique parfaitement synchronisés avec le contenu visuel. Par exemple, une scène de "café sous la pluie" ajoutera automatiquement le son de la pluie et une musique d'ambiance, sans post-production supplémentaire.

Capacité 3 : Simulation physique réaliste

Le moteur physique de SeeDance 2.0 gère les projections de liquide, les mouvements de tissus, les collisions et rebonds complexes, renforçant considérablement le réalisme et atténuant l'aspect "artificiel" de l'IA.

Capacité 4 : Fusion multimodale de références

Le point de terminaison "Reference-to-Video" permet aux développeurs d'intégrer simultanément une image de personnage, une image de référence pour la scène, une vidéo de référence pour le mouvement et de l'audio d'ambiance. Le modèle dissocie et fusionne automatiquement ces éléments, ce qui est crucial pour les créations basées sur des licences (IP) ou la production de séries.

Capacité 5 : Génération stable de longue durée

SeeDance 2.0 prend en charge des générations continues allant jusqu'à 15 secondes en une seule passe. La cohérence visuelle et la stabilité des personnages sont supérieures aux 5 secondes par défaut de Kling 2 et aux 8 secondes de Veo 3.

Capacité 6 : Sortie haute résolution 2K

Le niveau Pro prend en charge nativement une sortie en résolution 2K, couvrant tous vos besoins, du format vertical pour vidéos courtes aux publicités horizontales et campagnes de diffusion.

Gestion des erreurs et stratégie de limitation de débit de l'API SeeDance 2.0

Voici les codes d'état courants lors de l'invocation du modèle ainsi que les stratégies à adopter :

| Code HTTP | Signification | Action recommandée |

|---|---|---|

| 200 | Requête réussie | Analyser la réponse normalement |

| 400 | Paramètre invalide | Vérifier la longueur de l'invite et la validité de la résolution |

| 401 | Échec d'authentification | Vérifier la validité de la clé API |

| 429 | Limite de débit dépassée | Réessayer avec un repli exponentiel (début suggéré : 2s) |

| 500 | Erreur interne du serveur | Réessayer 2-3 fois puis rétrograder vers le mode Fast |

| 503 | Service temporairement indisponible | Basculer vers un point de terminaison de secours ou patienter 30s |

Bonnes pratiques pour le sondage asynchrone

Nous recommandons d'utiliser une stratégie de repli exponentiel + délai d'expiration maximal :

def poll_with_backoff(job_id, max_wait=300):

start = time.time()

delay = 3

# Boucle de vérification du statut du job

while time.time() - start < max_wait:

resp = get_job_status(job_id)

if resp["status"] in ("completed", "failed"):

return resp

time.sleep(delay)

# Augmentation progressive du délai d'attente

delay = min(delay * 1.5, 15)

raise TimeoutError("Le délai d'expiration de la tâche est dépassé")

Questions fréquentes (FAQ)

Q1 : Quelles sont les différences entre l'API SeeDance 2.0 et la version initiale du 9 avril ?

Lorsque SeeDance 2.0 a été lancé le 9 avril au centre d'expérience BytePlus, il n'était disponible que pour un essai via le web, sans accès ouvert à l'invocation du modèle via API. Depuis le lancement de la version bêta publique le 14 avril, les développeurs peuvent obtenir des droits d'API complets via la console ModelArk, couvrant les modes Fast/Standard/Pro ainsi que les trois types de points de terminaison d'entrée. Pour une intégration rapide sans configuration, nous recommandons de passer directement par la plateforme APIYI (apiyi.com), évitant ainsi les procédures de vérification de compte à l'étranger.

Q2 : L'API SeeDance 2.0 prend-elle en charge les invites en chinois ?

Oui. SeeDance 2.0 utilise un encodeur de texte multilingue ; les invites en chinois, anglais et japonais peuvent être saisies directement. Les tests montrent que la précision de compréhension sémantique du chinois est pratiquement identique à celle de l'anglais. Nous suggérons d'utiliser une structure d'invite en quatre parties : Action + Scène + Style + Angle de vue, par exemple : "Un chat orange se promenant dans les rues de Kyoto sous des pétales de cerisier, style ukiyo-e, suivi caméra grand angle".

Q3 : Comment continuer à utiliser le service une fois le quota gratuit de la bêta épuisé ?

La bêta publique officielle offre 20 invocations gratuites par compte et par mois en mode Fast. Au-delà, la facturation s'effectue au tarif standard. Si vous avez besoin d'un quota supérieur ou d'un contrat de niveau de service (SLA) d'entreprise, vous pouvez :

- Passer à un compte entreprise BytePlus (nécessite des justificatifs étrangers)

- Acheter un service proxy API unifié via la plateforme APIYI (apiyi.com), qui prend en charge le paiement à l'utilisation et le règlement en RMB, vous épargnant ainsi les tracas des factures internationales.

Q4 : Quelles sont les causes courantes d'échec de génération ?

Les causes d'échec les plus fréquentes sont les suivantes : l'invite enfreint la politique de sécurité des contenus (env. 40 %), la résolution de l'image de référence est inférieure à 512px (env. 25 %), délai d'attente réseau (env. 20 %), dépassement de la limite de concurrence (env. 15 %). Nous recommandons d'effectuer une vérification locale avant l'appel : anonymisation de l'invite + prétraitement de l'image en 1024px+ + implémentation de la logique de réessai pour les erreurs 429.

Q5 : Comment choisir entre SeeDance 2.0, Veo 3 et Kling 2 ?

Principe de décision simple : Choisissez SeeDance 2.0 pour le réalisme physique + l'audio natif, Veo 3 pour la qualité d'image ultime + l'esthétique occidentale, et Kling 2 pour l'itération rapide + les scènes en contexte chinois. Si le budget le permet, nous suggérons d'utiliser les trois pour effectuer des tests A/B afin de déterminer la solution optimale pour chaque scénario.

Résumé

Le 14 avril 2026, l'API SeeDance 2.0 a lancé sa bêta publique, marquant l'entrée officielle du modèle de génération vidéo de ByteDance dans une phase de commercialisation pour les développeurs. Grâce à une combinaison de trois variantes, trois types de points de terminaison, une entrée multimodale, une gestion native de l'audio et un contrôle de la caméra par le réalisateur, SeeDance 2.0 affiche une compétitivité remarquable en termes de réalisme physique, de compréhension du chinois et de maîtrise des coûts.

Pour les développeurs nationaux souhaitant intégrer SeeDance 2.0 au plus vite, nous recommandons de passer par la plateforme APIYI (apiyi.com). Cette plateforme propose des interfaces encapsulées et une optimisation réseau complète, prend en charge les niveaux Fast, Standard et Pro, et offre une facturation en RMB ainsi qu'un support technique de niveau entreprise. C'est la solution la plus efficace pour déployer rapidement des capacités de génération vidéo.

📌 Signature de l'auteur : Cet article est publié par l'équipe technique d'APIYI (apiyi.com). Il est basé sur la documentation officielle de BytePlus et sur des données de tests réels de la version internationale. Tous les prix et paramètres sont conformes à l'annonce de la bêta publique du 14/04/2026.