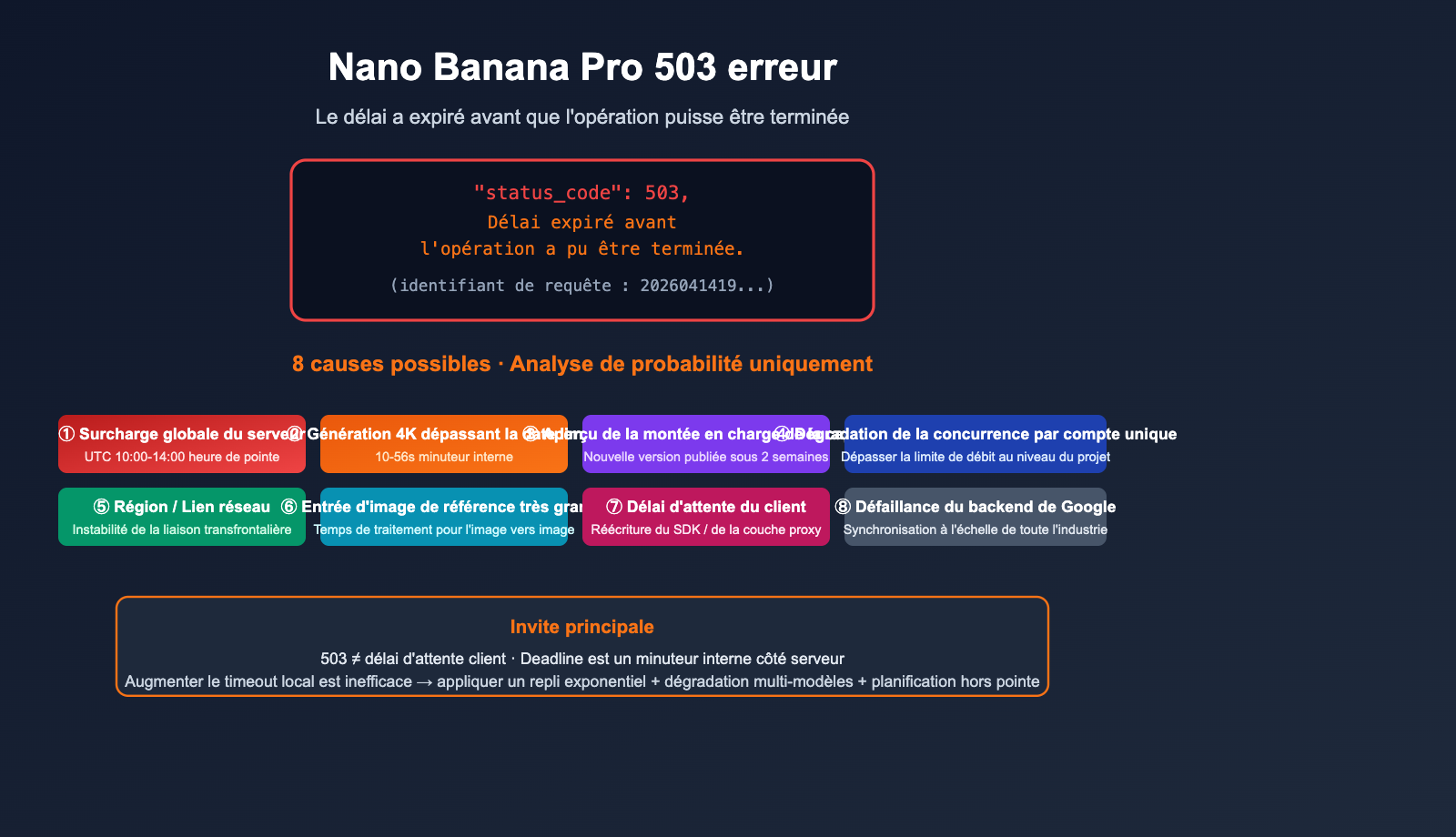

Récemment, lors de l'utilisation du Nano Banana Pro de Google (correspondant à gemini-3-pro-image-preview), de nombreux développeurs ont rencontré ce message d'erreur :

{

"status_code": 503,

"error": {

"message": "Deadline expired before operation could complete. (request id: 2026...)",

"type": "",

"code": 503

}

}

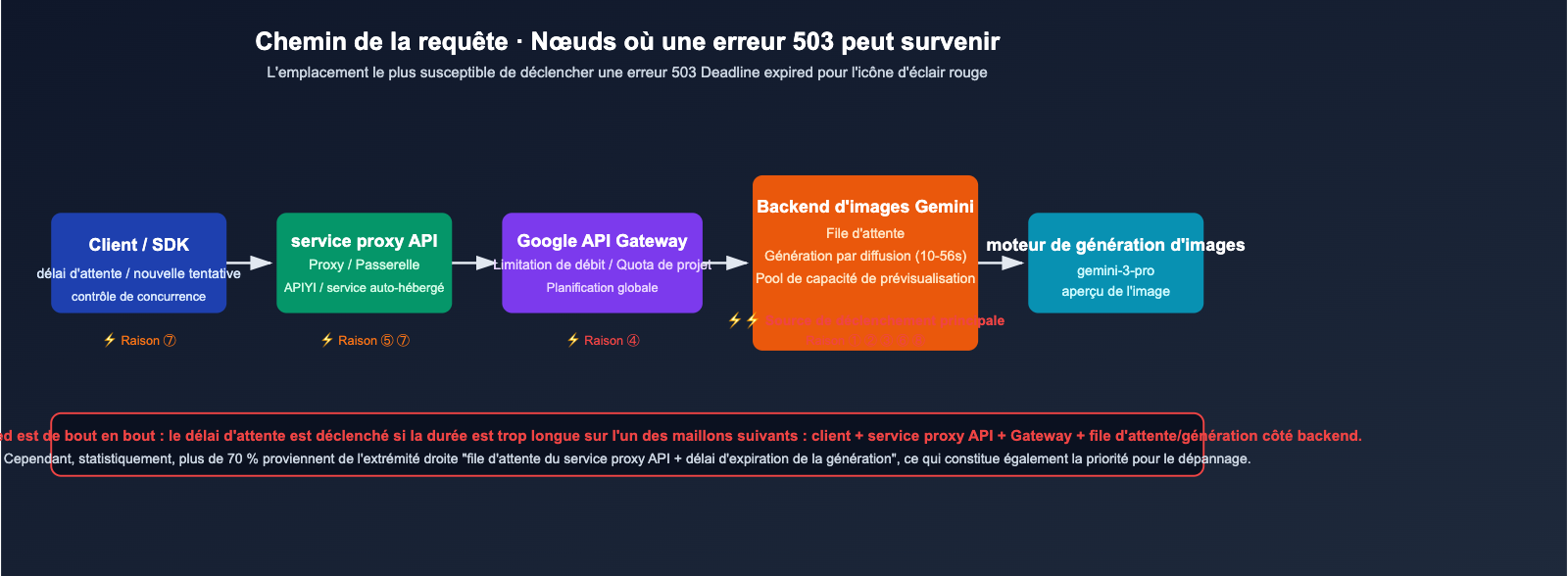

À première vue, on pourrait croire à une simple « expiration du délai d'attente » (timeout), mais la sémantique HTTP du code 503 correspond en réalité à Service Unavailable (Service indisponible), et non à une simple timeout côté client. En recoupant les informations des forums officiels de Google, des tickets GitHub et des changements récents de l'API Gemini Image, cette erreur ne provient pas d'une cause unique, mais est le résultat d'une superposition de facteurs côté serveur, côté client et au niveau métier.

Cet article se concentre uniquement sur l'analyse des probabilités. Il ne propose pas de solution miracle « miracle en une étape » — après tout, l'essence même du 503 est de vous cacher l'état interne du serveur. Nous allons lister 8 causes fréquentes, classées de la plus probable à la moins probable, avec leurs scénarios de déclenchement et leurs pistes de diagnostic pour vous aider à identifier rapidement « la plus probable d'entre elles » lors de votre prochaine erreur.

Comprendre l'erreur : décryptage de la sémantique 503 et Deadline expired

Avant de chercher à résoudre le problème, décortiquons ce message d'erreur pour éviter les mauvaises interprétations.

HTTP 503 ≠ Timeout client

- 503 UNAVAILABLE dans l'API Google Gemini signifie : le serveur a déterminé qu'il ne pouvait pas traiter la requête à ce moment-là, ce qui est généralement lié à la capacité, à une surcharge ou à une dégradation du backend.

Deadline expired before operation could completesignifie que le minuteur interne du serveur a rapporté : « La tâche n'a pas été terminée dans le délai de traitement imparti ».- Cela n'est pas égal à une timeout réseau côté curl/SDK. Une timeout côté client se manifeste généralement par une interruption de connexion ou une erreur locale de type

TimeoutError, pas par un 503.

Différence entre 504 / 429

| Code erreur | Sémantique | Signification courante |

|---|---|---|

| 503 | Service Unavailable | Surcharge serveur / limitation de débit / file d'attente dépassée |

| 504 | Gateway Timeout | Requête reçue, mais la génération n'a pas fini dans les temps |

| 429 | Too Many Requests | Limitation de débit par compte / clé API / projet |

| 500 | Internal Error | Erreur serveur, généralement retentable |

Conclusion clé : Si vous voyez 503 + Deadline expired, suspectez en priorité un problème de capacité serveur / file d'attente plutôt que de modifier le timeout local.

🎯 Conseil pour le diagnostic : Si le même ID de requête échoue systématiquement en 503 pendant 5 minutes, il s'agit généralement d'un problème côté serveur ; si cela n'arrive que sporadiquement (1% des cas), il s'agit très probablement d'une surcharge passagère. Lorsque vous utilisez APIYI (apiyi.com) pour appeler Nano Banana Pro, vous pouvez consulter les journaux de requêtes détaillés dans le tableau de bord pour déterminer rapidement s'il s'agit d'une surcharge globale ou d'un problème spécifique à votre compte.

Raison possible n°1 : Surcharge de la capacité des serveurs Google (la plus courante)

Caractéristiques du phénomène

- Apparitions concentrées pendant les heures de pointe (10:00-14:00 UTC, soit 18:00-22:00 heure de Pékin) ;

- Le service se rétablit après quelques tentatives, et le problème est quasi inexistant pendant la nuit ;

- Signalé simultanément dans plusieurs communautés (forum Google AI Developers, GitHub Issue #1808).

Mécanismes sous-jacents

Nano Banana Pro, alias gemini-3-pro-image-preview, reste un modèle en version Preview. Le pool de calcul alloué par Google est nettement plus restreint que celui des modèles GA (disponibilité générale). À cela s'ajoute une explosion de la demande de génération d'images suite aux sorties de Gemini 3.1 Pro (19 février) et Nano Banana 2 (26 février), entraînant jusqu'à 45 % de requêtes en erreur 503 aux heures de pointe.

Méthodes de diagnostic

- Vérifiez si l'heure de la requête se situe entre 10:00 et 14:00 UTC ;

- Essayez à nouveau pendant le creux de la nuit (00:00-06:00 UTC) pour voir si le taux d'erreur diminue de manière significative ;

- Vérifiez si toutes les clés API du même compte génèrent des erreurs sur la même période.

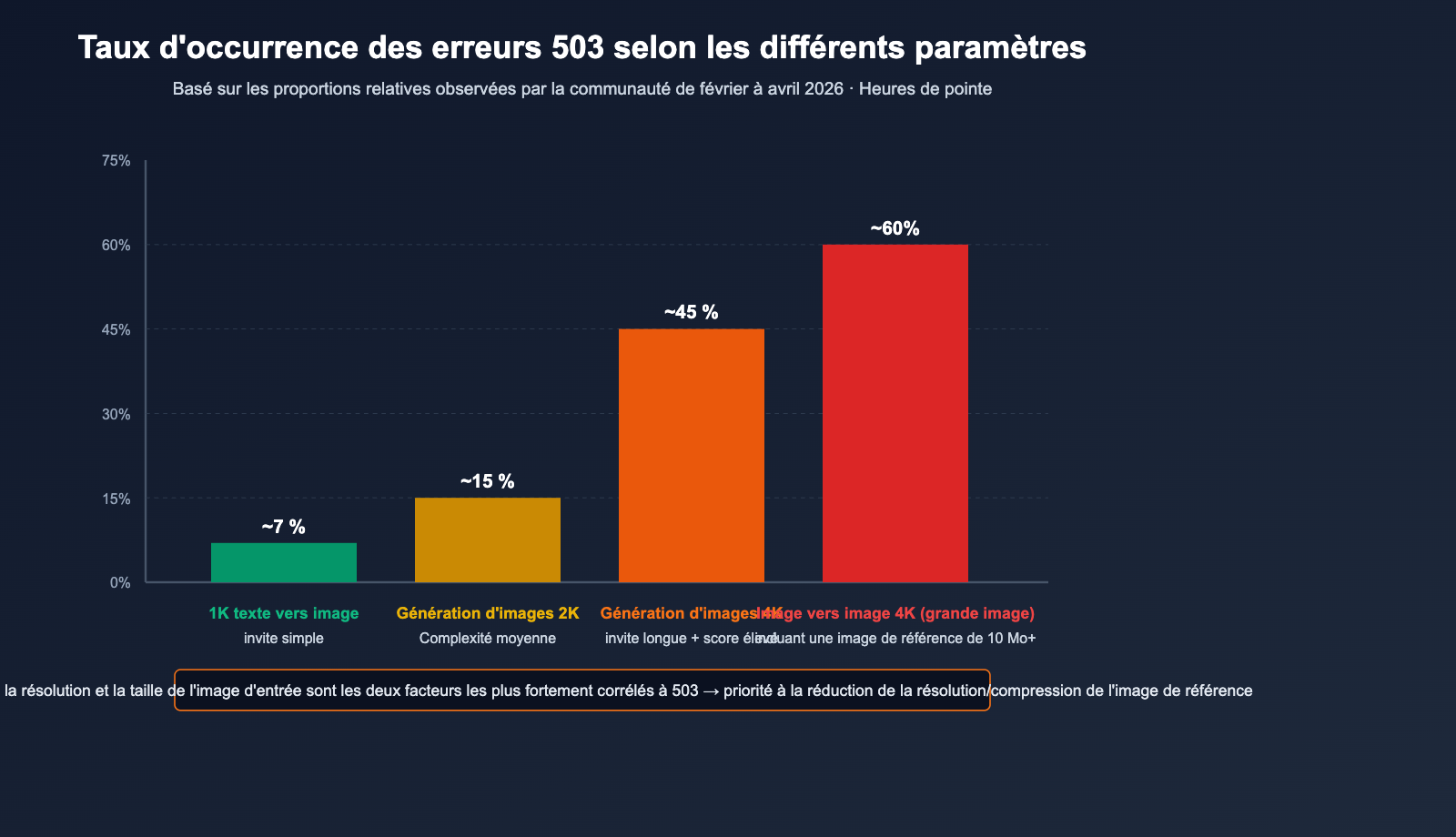

Raison possible n°2 : Le délai de génération dépasse le temps imparti pour les résolutions 4K ou les invites complexes

Caractéristiques du phénomène

- Se produit uniquement dans les scénarios "4K / plus de 2048×2048" ou avec des "invites complexes très longues" ;

- La génération en 1K/2K ne pose aucun problème, mais passer à une taille supérieure déclenche immédiatement des erreurs 503 ;

- La même invite fonctionne parfaitement en 1024×1024, mais génère une erreur en 4K.

Mécanismes sous-jacents

La sortie 4K de Nano Banana Pro peut prendre 10 à 56 secondes, voire plus, côté serveur. Google définit une date limite stricte (deadline) pour chaque tâche de génération. Si la somme du temps de file d'attente et du temps de génération réelle dépasse ce délai, une erreur Deadline expired est renvoyée (code 503).

Cela n'a rien à voir avec le délai d'attente (timeout) côté client : même si vous réglez votre timeout local sur 5 minutes, cela ne changera rien, car la deadline est gérée par un minuteur côté serveur.

Méthodes de diagnostic

- Testez la même invite en 1024×1024 pour vérifier si elle fonctionne normalement ;

- Simplifiez votre invite et réessayez avec une version courte ;

- Durant les heures de pointe, privilégiez une sortie en 2K et gardez le 4K pour les périodes creuses.

Cause possible 3 : Instabilité liée à la période de montée en charge des modèles Preview

Caractéristiques du phénomène

- Taux d'échec élevé juste après la publication d'une nouvelle version (dans les 2 semaines) ;

- Mention « Preview » explicitement indiquée dans les notes de version officielles ;

- Temps de récupération parfois long, atteignant 30 à 120 minutes (beaucoup plus lent que les 5 à 15 minutes constatées pour Gemini 2.5 Flash).

Mécanisme sous-jacent

La capacité de service des modèles Preview est allouée selon des prévisions internes de la demande. Si le trafic réel dépasse largement ces estimations, Google donne la priorité au respect du SLA des modèles GA (General Availability), ce qui peut entraîner une réduction passive de la charge, voire une limitation temporaire du modèle Preview.

Cause possible 4 : Concurrence trop élevée / Limitation de débit par compte

Caractéristiques du phénomène

- Augmentation soudaine du taux d'erreurs 503 lors de tâches simultanées sur un même compte ;

- Le taux d'erreur chute significativement après la réduction de la concurrence ;

- Apparition sporadique d'erreurs 429, bien que la grande majorité reste des 503.

Mécanisme sous-jacent

Google impose des limites sur le nombre de requêtes par minute et le nombre de tâches simultanées par projet ou par clé API. Lorsqu'elles sont dépassées :

- Une erreur 429 est prioritairement renvoyée ;

- Dans des scénarios extrêmes, le système renvoie directement une erreur 503 pour activer une protection contre la surcharge.

Dans ce cas, l'erreur n'est pas une "surcharge globale", mais plutôt une "dégradation de service déclenchée par votre compte".

Méthode de diagnostic

- Vérifiez si d'autres comptes fonctionnent normalement sur la même période ;

- Réessayez en limitant la concurrence à moins de 5 tâches ;

- Divisez les tâches par lots en petits flux séquentiels.

🎯 Conseil pour l'optimisation de la concurrence : Nano Banana Pro est extrêmement sensible au niveau de concurrence. Pour les scénarios de génération d'images par lots, nous recommandons de passer par APIYI apiyi.com — le débit illimité permet de tamponner les pics de limitation côté Google, agissant comme une couche de mémoire tampon frontale qui réduit considérablement la probabilité d'erreurs 503.

Cause possible n°5 : Latence excessive au niveau de la zone géographique ou du routage réseau

Symptômes caractéristiques

- Taux d'erreur beaucoup plus élevé lors d'une connexion directe aux terminaux Google depuis le pays par rapport à un service proxy ;

- Retour à la normale après un changement de VPN ou d'adresse IP régionale ;

traceroutemontrant de multiples sauts sur les liaisons internationales.

Mécanisme sous-jacent

Le délai (deadline) dans Deadline expired est de bout en bout : requête client → chaîne de proxy → périphérie de Google → backend réel. Si le réseau international est instable ou si la poignée de main TLS est anormale, le temps disponible perçu par le serveur est réduit, ce qui déclenche prématurément le délai.

Méthode de diagnostic

- Réessayez en changeant de nœud de région ;

- Comparez le taux d'erreur via un service proxy API (par exemple APIYI, apiyi.com) ;

- Vérifiez si la résolution DNS pointe bien vers le serveur Google le plus proche.

Cause possible n°6 : Entrée d'image trop volumineuse ou téléchargement d'image de référence ralentissant la génération

Symptômes caractéristiques

- La génération texte vers image simple fonctionne normalement, mais l'image vers image échoue fréquemment ;

- Plus l'image téléchargée est volumineuse, plus les erreurs 503 sont fréquentes ;

- La même image devient fonctionnelle après compression, mais échoue dans sa version originale.

Mécanisme sous-jacent

En mode image vers image, le serveur doit d'abord effectuer le décodage + prétraitement + extraction de caractéristiques de l'image de référence avant de lancer la génération par diffusion. Les images très volumineuses (plus de 10 Mo ou dépassant 4000 px) consomment une part importante du budget de délai alloué à la génération.

Recommandations

- Compressez vos images de référence entre 1024 et 2048 px côté client ;

- Évitez les fichiers dépassant 4 Mo ;

- Recadrez les images avant de combiner plusieurs images de référence.

Cause possible n° 7 : Stratégies de timeout et de réessai inadaptées au niveau du SDK client / couche HTTP

Caractéristiques du phénomène

- Seul votre système renvoie des erreurs, alors que d'autres utilisateurs dans la même région et avec le même compte n'ont aucun problème ;

- Les journaux du client indiquent que la requête a été annulée ;

- L'ID d'erreur est systématiquement différent et aucune trace n'apparaît dans les journaux côté serveur.

Mécanismes sous-jacents

Ce type de "faux 503" est rare mais bien réel :

- Le timeout par défaut du client est trop court, provoquant une déconnexion avant même que Google n'ait terminé le traitement ;

- Certaines couches de proxy réécrivent les réponses de timeout en erreurs 503 ;

- L'absence de réessais idempotents entraîne une mise en file d'attente multiple pour la même tâche, ce qui fait expirer le délai imparti.

Recommandations

- Réglez le timeout du client sur ≥ 90 secondes pour laisser suffisamment de temps à la génération 4K ;

- Implémentez un réessai avec backoff exponentiel : 1s → 2s → 4s → 8s → 16s → 32s ;

- Respectez l'en-tête

Retry-After(si présent).

Cause possible n° 8 : Maintenance ou panne régionale sur les infrastructures de Google

Caractéristiques du phénomène

- Pendant une période donnée (de quelques minutes à plusieurs heures), tous les utilisateurs reçoivent simultanément des erreurs 503 ;

- Une notification est présente sur la page d'état officielle de Google ;

- Une vague d'incidents apparaît simultanément au sein de la communauté.

Mécanismes sous-jacents

Il s'agit du cas le plus rare, mais ayant le plus fort impact : il concerne une défaillance de l'infrastructure même de Google. L'utilisateur ne peut pas y remédier directement, il faut attendre le rétablissement du service ou basculer vers un autre modèle.

Plan d'urgence

- Basculez vers Nano Banana 2 (

gemini-3.1-flash-image-preview) ; - Basculez vers la série Imagen ou d'autres modèles de génération d'images ;

- Utilisez le pool de secours multi-modèles via APIYI apiyi.com pour une rétrogradation automatique.

🎯 Conseil pour une haute disponibilité : ne liez pas votre système de production à un seul modèle "Preview". Sur APIYI apiyi.com, vous pouvez configurer un routage multi-modèles incluant Nano Banana Pro, Nano Banana 2, GPT-image-1, etc. Ainsi, dès qu'un modèle principal renvoie une erreur 503, le système bascule automatiquement vers un modèle de secours, évitant ainsi un point de défaillance unique pour votre activité.

Tableau de synthèse rapide : 8 causes probables

| # | Cause probable | Symptômes typiques | Méthode de diagnostic | Conseils pratiques |

|---|---|---|---|---|

| 1 | Surcharge serveur globale | Pics de trafic simultanés | Vérifier l'heure + forum | Retenter en creux / Backoff exponentiel |

| 2 | Délai dépassé pour du 4K | Erreur uniquement sur grandes images | Tester avec résolution réduite | 2K puis 4K / Simplifier l'invite |

| 3 | Montée en charge modèle Preview | 2 semaines après sortie | Annonce officielle | Basculer vers modèle GA |

| 4 | Dégradation de concurrence | Échec lors de traitement en masse | Réduire la concurrence | Limiter à 5 / Utiliser service proxy API |

| 5 | Problème de réseau / zone | Fréquent en connexion directe | Tester via un autre nœud | Passer par un service proxy API stable |

| 6 | Image d'entrée trop lourde | Courant en image vers image | Compresser l'image | Réduire sous la 2K |

| 7 | Timeout client inadapté | Problème isolé | Ajuster timeout + logs | Timeout 90s + Backoff exponentiel |

| 8 | Panne backend Google | Panne généralisée | Consulter la Status Page | Passer sur un modèle de secours |

Prise en main rapide : Modèle d'invocation auto-réparateur 503 (pour référence uniquement)

Exemple de backoff exponentiel en Python

import time, random

from openai import OpenAI

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="VOTRE_CLE_API",

)

def generate_with_retry(prompt, size="2048x2048", max_attempts=6):

delay = 1

for attempt in range(max_attempts):

try:

return client.images.generate(

model="nano-banana-pro",

prompt=prompt,

size=size,

)

except Exception as e:

# Identifier les erreurs 503 / Deadline dépassée

if "503" in str(e) or "Deadline" in str(e):

jitter = random.uniform(0, 0.5)

time.sleep(delay + jitter)

delay = min(delay * 2, 32)

continue

raise

raise RuntimeError("Nombre max de tentatives 503 atteint")

📎 Développer pour voir le pseudo-code avec bascule multi-modèle

MODEL_CHAIN = ["nano-banana-pro", "nano-banana-2", "gpt-image-1"]

for model in MODEL_CHAIN:

try:

return generate_with_retry(prompt, model=model)

except Exception:

continue

raise RuntimeError("Tous les modèles ont échoué")

🎯 Conseil de mise en œuvre : Le backoff seul ne résout que la "surcharge globale momentanée". Pour couvrir efficacement les 8 causes, l'approche la plus robuste combine "backoff exponentiel + bascule multi-modèle + buffer de concurrence via service proxy API". En utilisant APIYI (apiyi.com), vous pouvez intégrer ces trois couches en quelques lignes de code pour une haute disponibilité en production.

FAQ – Questions fréquentes

Q1 : Augmenter le timeout de mon client peut-il résoudre les erreurs 503 ?

Généralement non. L'erreur Deadline expired est signalée par le minuteur du serveur, il ne s'agit pas d'un timeout côté client. Augmenter le délai d'attente client n'aidera pas directement à résoudre les 503 et risque même de rendre la détection des échecs plus lente.

Q2 : Pourquoi Nano Banana 2 génère-t-il moins d'erreurs que Nano Banana Pro ?

Nano Banana 2 correspond au modèle gemini-3.1-flash-image-preview et utilise le pool de calcul de niveau Flash. Le temps de génération est plus court, la marge de manœuvre sur le deadline est plus grande et la capacité globale est relativement plus importante. En période de pointe, vous pouvez basculer les tâches non 4K vers Nano Banana 2 pour réduire la probabilité d'obtenir une erreur 503.

Q3 : Est-il vrai que le "off-peak 00:00-06:00 UTC" présente le taux d'erreur le plus bas ?

C'est une observation empirique partagée par plusieurs forums de développeurs : le taux d'occurrence des erreurs 503 entre 00:00 et 06:00 UTC est généralement inférieur à 8 %. Pour les tâches de traitement d'images par lots, décaler le planning sur cette fenêtre est l'optimisation la plus simple et la plus efficace, réalisable via la fonction de tâches planifiées d'APIYI (apiyi.com).

Q4 : Est-ce que ma clé API est limitée par un débit (rate limit) ?

Une simple limitation de débit renvoie généralement une erreur 429, pas 503. Cependant, en cas de surcharge extrême, Google active un canal de "protection contre la surcharge" qui renvoie directement des 503. En réduisant la simultanéité sur le même compte pour vos tests, vous pourrez déterminer si c'est bien une limitation de débit qui en est la cause.

Q5 : Le service proxy API d'APIYI peut-il résoudre les 503 ?

Il ne peut pas "résoudre" la cause profonde (qui se situe du côté de Google), mais il peut réduire significativement la probabilité de les percevoir : APIYI (apiyi.com) propose une simultanéité illimitée, un routage multi-modèles et des stratégies de retrait automatique (automatic backoff). Le service absorbe les "erreurs 503 occasionnelles" au niveau de la couche de transit, pour que votre application ne reçoive que les résultats réussis.

Q6 : Comment savoir s'il s'agit d'une panne du backend de Google ?

Vérifiez simultanément trois sources : la page d'état officielle, les publications des 2 dernières heures sur le forum Google AI Developers et si vos différents comptes retournent tous des erreurs en même temps. Si les trois indicateurs sont au rouge, il s'agit d'une panne backend chez Google ; il ne vous reste plus qu'à attendre ou à basculer vers un modèle de secours.

Résumé : Ordre de vérification des 8 causes possibles

Face à une erreur 503 Deadline expired, nous vous conseillons de procéder à la vérification dans cet ordre. En 2 ou 3 étapes, vous devriez pouvoir identifier le problème :

- Vérifiez l'heure : Est-ce que vous êtes dans le pic de 10:00 à 14:00 UTC ? → Cause 1.

- Vérifiez la résolution : Seules les images 4K ou les grandes images provoquent-elles des erreurs ? → Causes 2, 6.

- Vérifiez la simultanéité : Êtes-vous en train de saturer le service par des traitements en masse ? → Cause 4.

- Vérifiez la région : Utilisez-vous une connexion directe depuis la Chine ? → Cause 5.

- Vérifiez l'état de l'industrie : Tout le monde en parle-t-il sur les forums ? → Cause 8.

- Le reste concerne les paramètres client et le contexte des phases de montée en charge des modèles en préversion.

Cette "analyse de probabilités" ne vous donnera pas une conclusion unique, mais elle vous évitera de perdre du temps lors d'incidents réels.

🎯 Recommandations : Intégrez à vos appels Nano Banana Pro un trio gagnant : "backoff exponentiel + repli multi-modèles + traitement par lots en heures creuses". Pour les systèmes de production, nous recommandons de passer par APIYI (apiyi.com) afin d'absorber les pics de charge grâce à leur couche de transit sans limite de simultanéité et d'utiliser le routage multi-modèles pour automatiser le repli, réduisant ainsi l'impact des 503 sur votre activité.

— L'équipe APIYI (L'équipe technique d'apiyi.com)