L'événement le plus spectaculaire de mars 2026 dans le monde de l'IA : un modèle anonyme baptisé "Hunter Alpha" est apparu discrètement sur OpenRouter, consommant 500 milliards de jetons par semaine, avec des performances rivalisant avec GPT-5.2 et Claude Opus 4.6. Les développeurs du monde entier se sont perdus en conjectures : "S'agit-il du DeepSeek V4 ?"

La réponse a surpris tout le monde : il s'agit du MiMo V2 Pro de Xiaomi. Une entreprise de téléphonie mobile qui, en moins d'un an, a créé un grand modèle de langage à mille milliards de paramètres, se hissant parmi les leaders mondiaux.

Parallèlement, MiMo V2 Omni a été lancé — un modèle multimodal capable de traiter nativement du texte, des images, des vidéos et plus de 10 heures d'audio en continu. Ces deux modèles sont désormais disponibles sur la plateforme APIYI, permettant aux développeurs de les invoquer directement.

Valeur ajoutée : En lisant cet article, vous découvrirez les capacités réelles de MiMo V2 Pro et Omni, leurs différences par rapport à la concurrence et pourquoi ils constituent actuellement l'un des modèles d'IA au meilleur rapport qualité-prix.

L'affaire Hunter Alpha : comment Xiaomi a secoué la sphère IA

Chronologie

| Date | Événement |

|---|---|

| Début 2026 | Un modèle nommé "Hunter Alpha" est lancé anonymement sur OpenRouter |

| Pendant plusieurs semaines | 500 milliards de jetons consommés par semaine, utilisé par les développeurs du monde entier |

| Buzz communautaire | Performances proches des meilleurs modèles fermés, supposé être DeepSeek V4 |

| 18-19 mars 2026 | Xiaomi révèle officiellement : Hunter Alpha = MiMo V2 Pro |

| Même jour | Lancement simultané de MiMo V2 Omni et MiMo V2 Flash |

| Jour de l'annonce | L'action Xiaomi grimpe d'environ 4 % |

Pourquoi cet événement est si marquant : Une entreprise connue pour ses téléphones et ses objets connectés a entraîné, en moins d'un an, un grand modèle de langage à mille milliards de paramètres, atteignant le top 10 mondial. Plus surprenant encore, le responsable principal de l'équipe, Luo Fuli, est l'un des contributeurs clés des modèles révolutionnaires de DeepSeek.

🎯 Informations utiles : MiMo V2 Pro et MiMo V2 Omni sont disponibles sur la plateforme APIYI (apiyi.com), permettant une invocation directe. Avec les performances du MiMo V2 Pro et une tarification à 1/3 du prix, c'est l'un des modèles d'inférence les plus rentables du moment.

MiMo V2 Pro : Modèle d'inférence à mille milliards de paramètres

Spécifications principales

| Paramètre | Détails |

|---|---|

| Nom du modèle | MiMo V2 Pro (anciennement Hunter Alpha) |

| Date de sortie | 18-19 mars 2026 |

| Nombre total de paramètres | Environ 1 000 milliards (architecture MoE) |

| Paramètres actifs | 42B (activés à chaque inférence) |

| Fenêtre de contexte | 1 048 576 tokens (1M) |

| Sortie maximale | 131 072 tokens (128K) |

| Entrée/Sortie | Texte brut |

| Capacité d'inférence | Supporte le raisonnement étendu (balise <think>) |

| Statut open source | Non disponible (accès via API) |

| Responsable R&D | Luo Fuli (ancien membre clé de DeepSeek) |

Performances de référence : 8e mondial, 2e en Chine

| Benchmark | MiMo V2 Pro | Classement |

|---|---|---|

| Indice d'intelligence Artificial Analysis | 49 | #8 mondial |

| PinchBench | 84.0 | #3 mondial |

| ClawEval (capacités d'agent) | 61.5 | #3 mondial |

| GDPval-AA | 1434 Elo | #1 modèle chinois |

| Précision mathématique | 94.0% | Top niveau |

| Précision de codage | 92.5% | Surpasse Claude Sonnet 4.6 |

| Taux d'hallucination | 30% | Meilleur que ses pairs |

Découverte clé : Le MiMo V2 Pro se classe 3e mondial sur les tâches de type agent (ClawEval), juste derrière Claude Opus 4.6 (66.3) et un autre modèle. Cela signifie qu'il excelle dans le raisonnement multi-étapes, l'appel d'outils et l'exécution autonome de tâches.

Tarification : 1/6 du prix pour des performances équivalentes

| Plage de contexte | Entrée (par million de tokens) | Sortie (par million de tokens) |

|---|---|---|

| ≤ 256K | 1,00 $ | 3,00 $ |

| 256K – 1M | 2,00 $ | 6,00 $ |

Comparaison des prix avec la concurrence :

| Modèle | Entrée | Sortie | Par rapport à MiMo V2 Pro |

|---|---|---|---|

| MiMo V2 Pro | 1,00 $ | 3,00 $ | Référence |

| Claude Sonnet 4.6 | 3,00 $ | 15,00 $ | 5x plus cher |

| Claude Opus 4.6 | 15,00 $ | 75,00 $ | 25x plus cher |

| GPT-5.2 | ~7,50 $ | ~30,00 $ | 10x plus cher |

Le MiMo V2 Pro surpasse les capacités de codage de Claude Sonnet 4.6, mais pour seulement 1/5 du prix. Ses capacités d'agent sont proches de celles de Claude Opus 4.6, mais pour seulement 1/25 du prix.

💡 Recommandation rapport qualité-prix : Le MiMo V2 Pro est actuellement l'un des modèles les plus performants à bas prix sur le marché. Vous pouvez l'invoquer directement via APIYI (apiyi.com), idéal pour les projets de développement sensibles aux coûts mais exigeants sur la qualité.

MiMo V2 Omni : Modèle d'IA multimodal complet

MiMo V2 Omni est le fleuron multimodal de Xiaomi — un modèle supportant nativement le texte, l'image, la vidéo et l'audio au sein d'une architecture unifiée.

Spécifications principales

| Paramètre | Détails |

|---|---|

| Nom du modèle | MiMo V2 Omni |

| Date de sortie | 18-19 mars 2026 |

| Fenêtre de contexte | 256K tokens |

| Modalités d'entrée | Texte + Image + Vidéo + Audio |

| Modalités de sortie | Texte |

| Traitement audio | Supporte 10+ heures d'audio continu (première industrielle) |

| Tarification | Entrée 0,40 $/MTok · Sortie 2,00 $/MTok |

Points forts des capacités multimodales

1. Raisonnement visuel supérieur à Claude Opus 4.6

Sur les benchmarks MMMU-Pro (raisonnement visuel multidisciplinaire) et CharXiv RQ (analyse de graphiques complexes), MiMo V2 Omni surpasse Claude Opus 4.6 et se rapproche du niveau de Gemini 3.

2. Compréhension audio continue de 10 heures

C'est une première dans l'industrie : une seule requête peut traiter plus de 10 heures d'audio continu sans perte de qualité. Scénarios d'utilisation :

- Analyse et résumé complets d'enregistrements de réunions

- Extraction de contenu de podcasts/interviews

- Compréhension de longues conversations vocales

- Analyse combinée audio-vidéo

3. Appel d'outils natif et positionnement UI

Le modèle Omni intègre des capacités d'appel d'outils structurés, d'exécution de fonctions et de positionnement d'éléments d'interface utilisateur (UI) — utilisable directement pour des frameworks d'agents IA, sans encapsulation supplémentaire.

4. Démonstration pratique

Lors de la conférence, Xiaomi a présenté un flux de travail complet avec Omni :

L'utilisateur exprime un besoin en une phrase

↓

Omni rédige le script de manière autonome

↓

Tournage de 4 scènes

↓

Montage, synthèse vocale, correction des erreurs de rendu

↓

Upload et publication d'une vidéo courte de 15 secondes

L'ensemble du processus est réalisé de manière totalement autonome.

Tarification : Le meilleur rapport qualité-prix pour le multimodal

| Élément de facturation | Prix |

|---|---|

| Entrée | 0,40 $ / million de tokens |

| Sortie | 2,00 $ / million de tokens |

C'est l'un des modèles multimodaux les moins chers actuellement. Comparé à Gemini 3.1 Pro (2 $/12 $) et Claude Opus 4.6 (15 $/75 $), l'avantage tarifaire d'Omni est considérable.

🚀 Scénarios d'utilisation : Si votre application nécessite de traiter des images, des vidéos ou de longs fichiers audio, MiMo V2 Omni est un choix extrêmement rentable. Vous pouvez l'invoquer directement via APIYI (apiyi.com), avec un support du format standard compatible OpenAI.

title: "Comparaison comparative : MiMo V2 Pro vs les principaux modèles mondiaux"

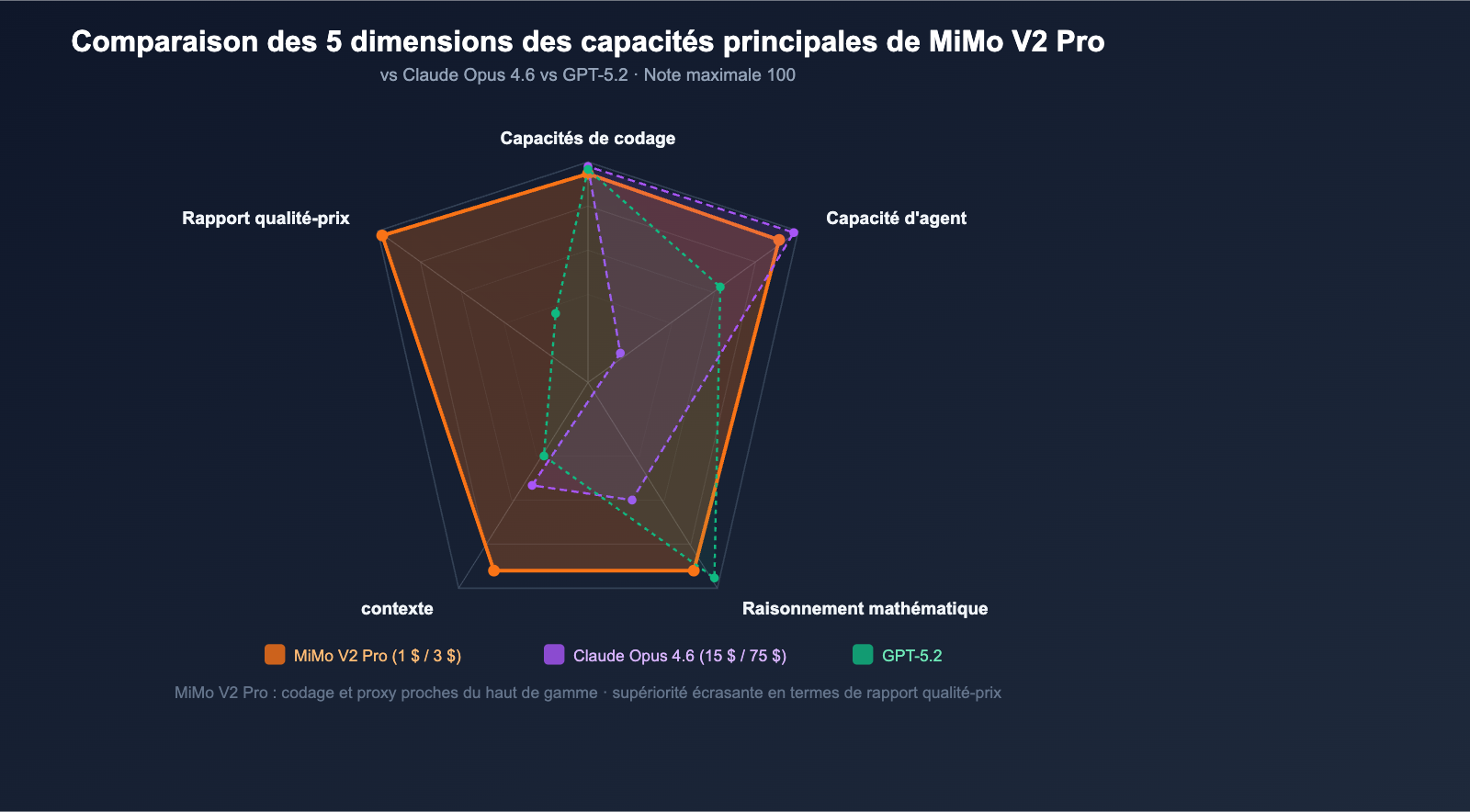

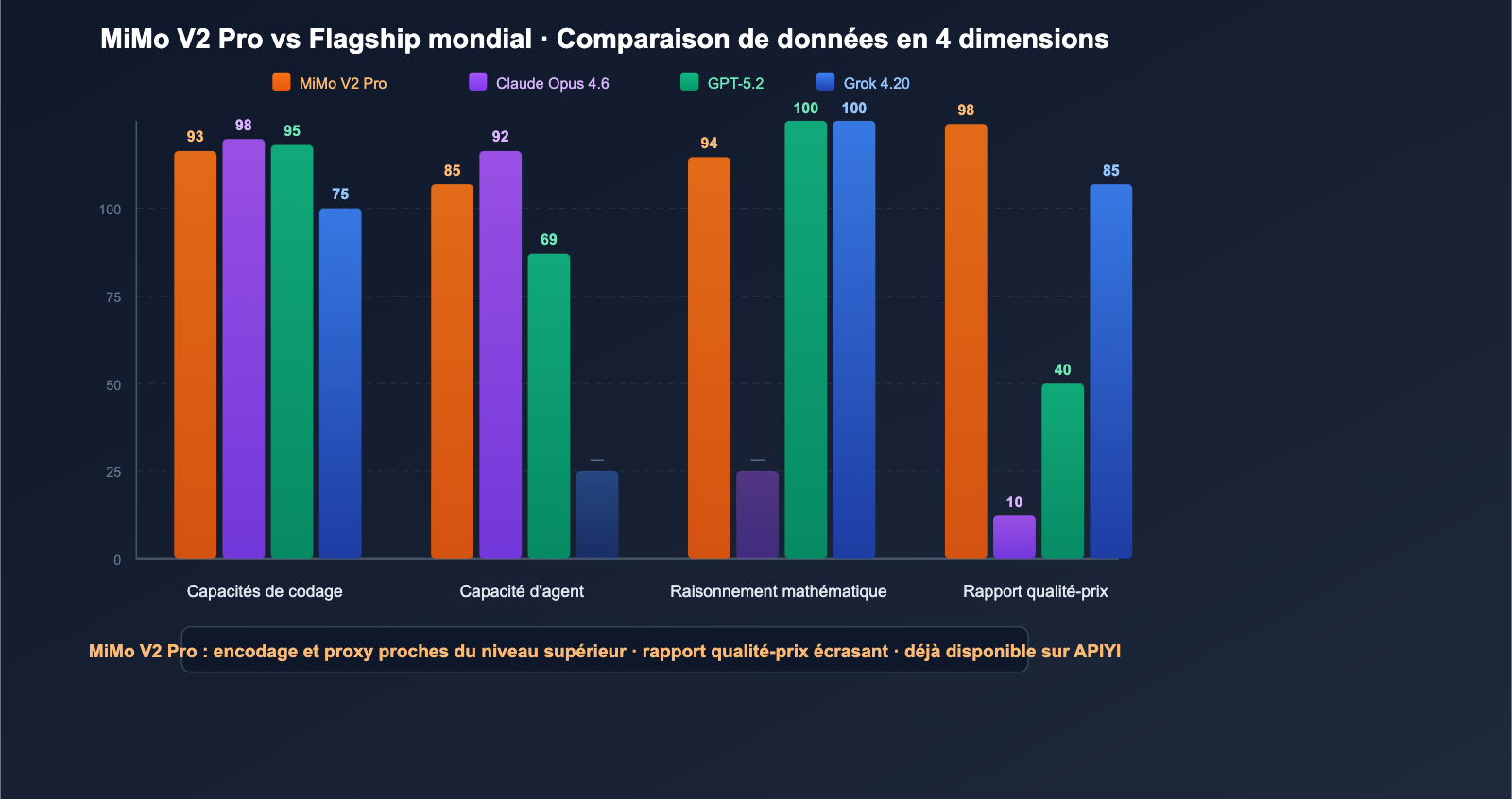

Comparaison comparative : MiMo V2 Pro vs les principaux modèles mondiaux

Comparaison multidimensionnelle

| Dimension | MiMo V2 Pro | Claude Opus 4.6 | GPT-5.2 | Grok 4.20 |

|---|---|---|---|---|

| Architecture | 1T MoE (42B actif) | Propriétaire | Propriétaire | MoE propriétaire |

| Précision de codage | 92,5 % | Le meilleur (SWE 81,4 %) | Fort (SWE ~80 %) | SWE ~75 % |

| Capacité d'agent (ClawEval) | 61,5 (#3) | 66,3 (#1) | 50,0 | — |

| Mathématiques | 94,0 % | — | AIME 100 % | AIME 100 % |

| Fenêtre de contexte | 1M | 1M | Selon le modèle | 2M |

| Prix d'entrée | 1,00 $ | 15,00 $ | ~7,50 $ | 2,00 $ |

| Prix de sortie | 3,00 $ | 75,00 $ | ~30,00 $ | 6,00 $ |

| Mode d'inférence | Balise <think> |

Raisonnement adaptatif | Inférence étendue | Inférence/Non-inférence |

| Multimodal | ❌ (Pro texte uniquement) | ✅ | ✅ | ✅ Limité |

Positionnement du MiMo V2 Pro

Performance : Proche de Claude Opus 4.6 (écart de seulement 5 points sur la capacité d'agent)

Prix : Environ 1/25ème de celui d'Opus

↓

Positionnement : "L'Opus pour les budgets serrés" / Le roi du rapport qualité-prix

Scénarios idéaux pour le MiMo V2 Pro :

- Applications sensibles aux coûts nécessitant de fortes capacités de raisonnement

- Tâches de type agent (raisonnement multi-étapes, appel d'outils)

- Génération et analyse de code à grande échelle

- Mathématiques et raisonnement logique

- Scénarios purement textuels ne nécessitant pas de multimodalité

Scénarios où Claude Opus 4.6 reste supérieur :

- Ingénierie logicielle extrêmement complexe (écart d'environ 6 points sur SWE-bench)

- Besoin de sorties ultra-longues (128K)

- Exigences de conformité et de sécurité de niveau entreprise

- Besoin de raisonnement adaptatif (Adaptive Thinking)

💰 Conseil de sélection : Pour le développement quotidien et les tâches par lots, le MiMo V2 Pro (1 $/3 $) permet de réaliser d'importantes économies. Pour les tâches critiques en matière de sécurité ou d'architecture, privilégiez Claude Opus 4.6. Utilisez un service proxy API comme APIYI (apiyi.com) pour appeler les deux modèles avec une seule clé et basculer selon vos besoins.

Aperçu de la gamme MiMo V2

Xiaomi vient de lancer trois nouveaux modèles, couvrant tous les besoins, du plus léger au plus performant.

| Modèle | Paramètres | Positionnement | Prix entrée | Prix sortie | Open Source |

|---|---|---|---|---|---|

| MiMo V2 Flash | 309B (15B actifs) | Léger et rapide | 0,09 $ | 0,29 $ | ✅ MIT |

| MiMo V2 Pro | ~1T (42B actifs) | Flagship raisonnement | 1,00 $ | 3,00 $ | ❌ API |

| MiMo V2 Omni | — | Multimodal | 0,40 $ | 2,00 $ | ❌ API |

Informations complémentaires sur MiMo V2 Flash :

- Licence MIT entièrement open source, poids disponibles sur HuggingFace

- SWE-bench Verified : 73,4 % (n°1 des modèles open source)

- AIME 2025 : 94,1 %

- Vitesse d'inférence : 150+ tokens/seconde

- Surpasse DeepSeek-R1-0528 dans 7 des 8 catégories de test

🎯 Stratégie de gamme : Utilisez Flash pour les tâches simples (prix ultra-bas de 0,09 $/0,29 $), Pro pour les tâches de raisonnement (meilleur rapport qualité-prix à 1 $/3 $) et Omni pour les tâches multimodales (0,40 $/2,00 $). Grâce à APIYI (apiyi.com), vous pouvez accéder à l'ensemble des modèles MiMo V2 via une interface unique.

Pratique : invocation du modèle

Appel de MiMo V2 Pro

import openai

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://api.apiyi.com/v1" # Interface unifiée APIYI

)

response = client.chat.completions.create(

model="mimo-v2-pro",

messages=[

{"role": "system", "content": "Vous êtes un ingénieur logiciel senior, expert en revue de code et en conception d'architecture."},

{"role": "user", "content": "Révisez la sécurité de concurrence du code Python suivant..."}

],

max_tokens=8192

)

print(response.choices[0].message.content)

Appel de MiMo V2 Omni (multimodal)

# Exemple d'analyse d'image

response = client.chat.completions.create(

model="mimo-v2-omni",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Analysez le flux de données dans ce schéma d'architecture"},

{"type": "image_url", "image_url": {"url": "data:image/png;base64,..."}}

]

}

]

)

Voir le code de test comparatif MiMo V2 Pro vs Claude Sonnet 4.6

import openai

import time

client = openai.OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://api.apiyi.com/v1"

)

models = ["mimo-v2-pro", "claude-sonnet-4-6"]

prompt = "Implémentez en Python un cache LRU supportant la concurrence, avec une sécurité thread-safe"

for model in models:

start = time.time()

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}],

max_tokens=4096

)

elapsed = time.time() - start

usage = response.usage

print(f"\n{'='*50}")

print(f"Modèle : {model}")

print(f"Temps écoulé : {elapsed:.1f}s")

print(f"Token : Entrée {usage.prompt_tokens} / Sortie {usage.completion_tokens}")

print(f"Aperçu : {response.choices[0].message.content[:200]}...")

🚀 Test rapide : Inscrivez-vous sur APIYI (apiyi.com) pour obtenir votre clé et commencer à utiliser MiMo V2 Pro et Omni. Une seule clé suffit pour appeler plus de 200 modèles, dont ceux de Xiaomi, Claude, GPT, etc.

FAQ

Q1 : MiMo V2 Pro possède-t-il vraiment mille milliards de paramètres ? Pourquoi est-il si abordable ?

Oui, le nombre total de paramètres est d'environ 1 000 milliards, mais il utilise une architecture MoE (mélange d'experts), où seuls 42 milliards de paramètres environ sont activés à chaque inférence. Cela signifie que le coût d'inférence est bien inférieur à celui d'un modèle dense ayant le même nombre de paramètres. C'est la même approche technique que celle utilisée par des modèles comme DeepSeek ou Grok. Grâce à APIYI (apiyi.com), vous pouvez accéder à ce modèle aux mille milliards de paramètres pour 1/3 du prix habituel.

Q2 : MiMo V2 Pro peut-il remplacer Claude pour la revue de code ?

Dans certains cas, oui. La précision de codage (92,5 %) et les capacités d'agent (ClawEval 61,5) de MiMo V2 Pro sont très impressionnantes. Pour les revues de code quotidiennes et l'analyse de bugs, c'est un choix extrêmement rentable. Cependant, pour les audits critiques en matière de sécurité et la refonte d'architectures très complexes, Claude Opus 4.6 reste plus fiable. Nous vous recommandons d'utiliser APIYI (apiyi.com) pour intégrer les deux modèles et basculer entre eux de manière flexible selon la tâche.

Q3 : La capacité de traitement audio de 10 heures de MiMo V2 Omni est-elle fiable ?

Xiaomi affirme qu'il s'agit d'une première dans l'industrie : une seule requête prend en charge plus de 10 heures de compréhension audio continue sans perte de performance. C'est idéal pour l'analyse d'enregistrements de réunions, l'extraction de contenu de podcasts et d'autres scénarios audio de longue durée. Toutefois, comme il s'agit d'un modèle récemment publié, nous vous conseillons de le tester d'abord sur des tâches non critiques. Vous pouvez effectuer ces tests à faible coût (0,40 $/2,00 $) via APIYI (apiyi.com).

Q4 : MiMo V2 Pro sera-t-il open source ?

Xiaomi a indiqué qu'il prévoyait de rendre le modèle open source "lorsqu'il sera suffisamment stable". Le MiMo V2 Flash, issu de la même série, a déjà été publié sous licence MIT sur HuggingFace. Compte tenu de l'attitude positive de Xiaomi envers l'open source (MiMo V1 l'est déjà), l'ouverture de V2 Pro n'est qu'une question de temps.

Q5 : Comment choisir entre MiMo V2 Pro, Flash et Omni ?

Choisissez selon vos besoins : pour des tâches d'inférence textuelle pure, optez pour Pro (1 $/3 $, l'inférence la plus puissante) ; pour un prix extrêmement bas ou un déploiement local, choisissez Flash (0,09 $/0,29 $, open source et déployable soi-même) ; si vous devez traiter des images, des vidéos ou de l'audio, choisissez Omni (0,40 $/2,00 $). Avec APIYI (apiyi.com), une seule clé API suffit pour appeler les trois modèles.

Conclusion : L'ambition IA de Xiaomi ne doit pas être sous-estimée

Le lancement de la série MiMo V2 marque la transformation officielle de Xiaomi, passant d'un "fabricant de smartphones faisant de l'IA" à un "acteur mondial de pointe dans le domaine de l'IA". L'arrivée anonyme sur Hunter Alpha a été une véritable leçon de lancement de produit : laisser les performances parler d'elles-mêmes avant de révéler son identité.

3 points clés à retenir :

- MiMo V2 Pro est actuellement le modèle d'inférence au meilleur rapport qualité-prix : 3e rang mondial en capacités d'agent, codage supérieur à Sonnet 4.6, pour un prix 25 fois inférieur à celui d'Opus.

- Les capacités multimodales de MiMo V2 Omni méritent l'attention : le traitement audio de 10 heures constitue un avantage différenciateur réel.

- L'exécution de l'équipe IA de Xiaomi est impressionnante : moins d'un an pour passer de zéro à un modèle aux mille milliards de paramètres, avec une équipe centrale issue de DeepSeek.

Nous vous recommandons de tester toute la gamme MiMo V2 via APIYI (apiyi.com) pour bénéficier d'une puissance d'inférence IA quasi optimale au prix le plus bas du marché.

Références

-

Page officielle du Xiaomi MiMo V2 Pro : Spécifications techniques et données de référence

- Lien :

mimo.xiaomi.com/mimo-v2-pro

- Lien :

-

Artificial Analysis : Évaluation comparative du MiMo V2 Pro

- Lien :

artificialanalysis.ai/models/mimo-v2-pro

- Lien :

-

VentureBeat : Rapport sur le lancement du Xiaomi MiMo V2 Pro

- Lien :

venturebeat.com

- Lien :

-

OpenRouter : Tarification et informations sur l'API du modèle MiMo V2

- Lien :

openrouter.ai

- Lien :

Auteur : Équipe APIYI | Nous intégrons les derniers modèles d'IA dès leur sortie. N'hésitez pas à visiter APIYI sur apiyi.com pour tester toute la gamme de modèles Xiaomi MiMo V2.