Note de l'auteur : Une analyse approfondie de l'architecture centrale, des benchmarks de performance, de la tarification API et des méthodes d'intégration du modèle multimodal DeepSeek V4 à mille milliards de paramètres, pour aider les développeurs à évaluer et utiliser rapidement ce grand modèle de langage open source.

DeepSeek V4 arrive bientôt. Il s'agit d'un modèle multimodal natif à l'échelle du trillion de paramètres, prenant en charge la génération unifiée de texte, d'images et de vidéo. Cet article décrypte rapidement les innovations architecturales clés de DeepSeek V4, ses performances et les méthodes d'intégration API, pour aider les développeurs à réaliser une évaluation technique en amont.

Valeur clé : Comprenez en 3 minutes les avancées technologiques majeures de DeepSeek V4, sa comparaison de performances avec GPT-5 / Claude, et comment l'intégrer rapidement via une API.

Vue d'ensemble des paramètres et capacités clés de DeepSeek V4

DeepSeek V4 est le nouveau modèle phare de l'équipe DeepSeek. Il adopte une architecture MoE (Mixture of Experts) à mille milliards de paramètres et prend en charge nativement les entrées et sorties multimodales. Voici les paramètres clés de DeepSeek V4 :

| Indicateur | Spécifications DeepSeek V4 | Amélioration par rapport à V3 |

|---|---|---|

| Nombre total de paramètres | 1 trillion (1T) | Amélioration d'environ 1,5x |

| Paramètres actifs | ~37B / token | Inférence efficace avec MoE |

| Fenêtre de contexte | 1 million de tokens | Amélioration de plus de 10x |

| Modalités supportées | Texte + Image + Vidéo | Ajout de la génération d'images et de vidéo |

| Licence | Licence open source | Maintien de la tradition open source |

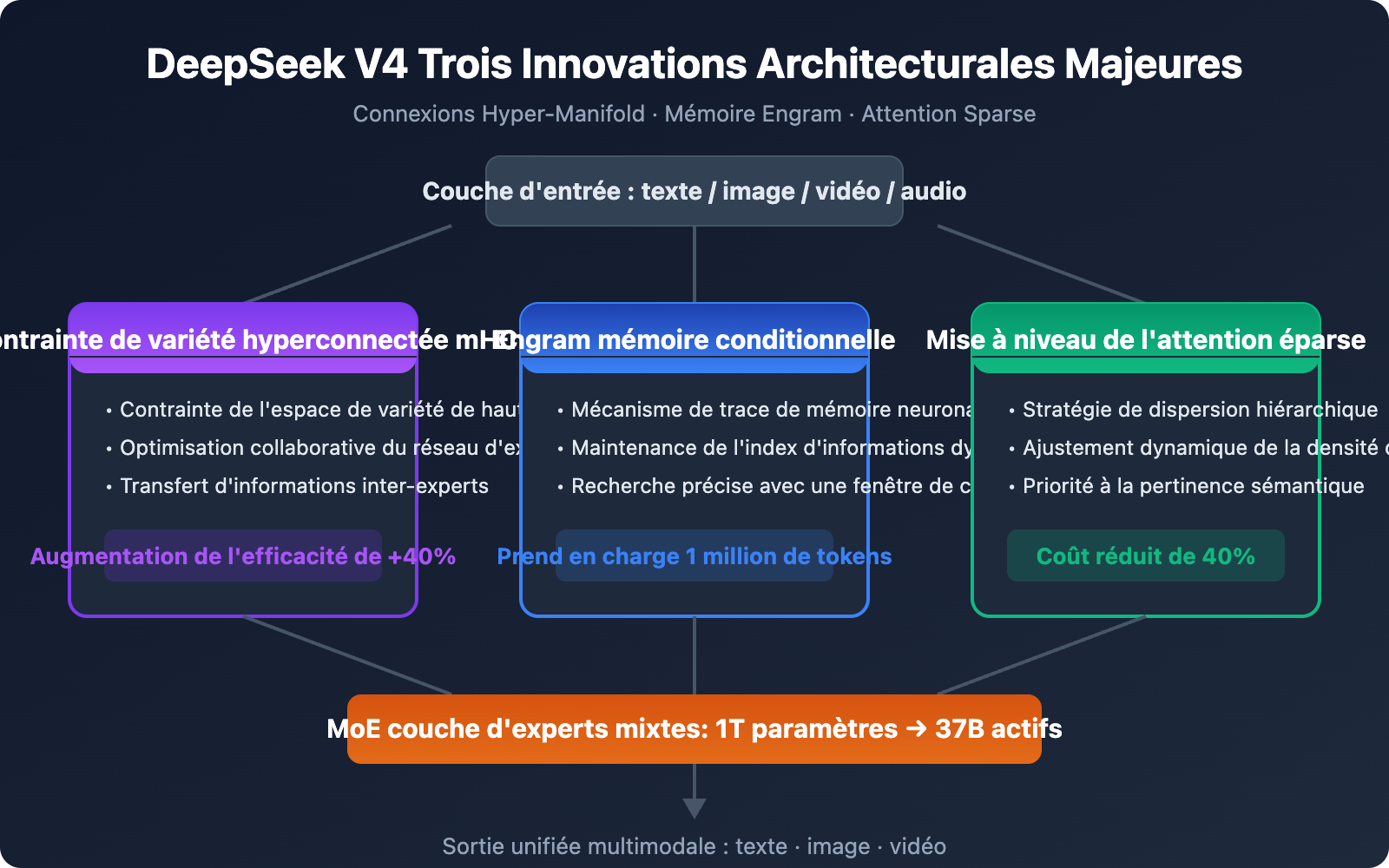

Trois innovations architecturales majeures de DeepSeek V4

DeepSeek V4 introduit trois innovations architecturales clés, qui constituent la base technique de ses performances révolutionnaires :

1. Hyperconnectivité à contrainte de variété (mHC) : Il s'agit d'une nouvelle méthode de connexion des paramètres qui, en contraignant les chemins de transfert d'information entre les réseaux d'experts dans un espace de variété de haute dimension, améliore significativement l'efficacité du raisonnement collaboratif multi-experts dans l'architecture MoE. Par rapport aux mécanismes de gating clairsemés traditionnels, le mHC améliore l'utilisation de l'information inter-experts d'environ 40% tout en maintenant l'efficacité computationnelle.

2. Système de mémoire conditionnelle Engram : Inspiré par le concept de "trace mnésique" en neurosciences, DeepSeek V4 introduit un module de mémoire conditionnelle. Ce système peut maintenir dynamiquement un index des informations clés lors du traitement de contextes ultra-longs, permettant au modèle de récupérer et de référencer avec précision le contenu initial même lors du traitement d'un contexte de 1 million de tokens. Ceci est crucial pour l'analyse de grandes bases de code et le traitement de longs documents.

3. Mise à niveau du mécanisme d'attention clairsemée : Sur la base du mécanisme d'attention standard, DeepSeek V4 adopte une stratégie de parcimonie hiérarchique, ajustant dynamiquement la densité du calcul d'attention en fonction de la corrélation sémantique entre les tokens. Cela permet au modèle de traiter des séquences ultra-longues à un coût de calcul bien inférieur à celui de l'attention complète, réduisant le coût d'inférence d'environ 40%.

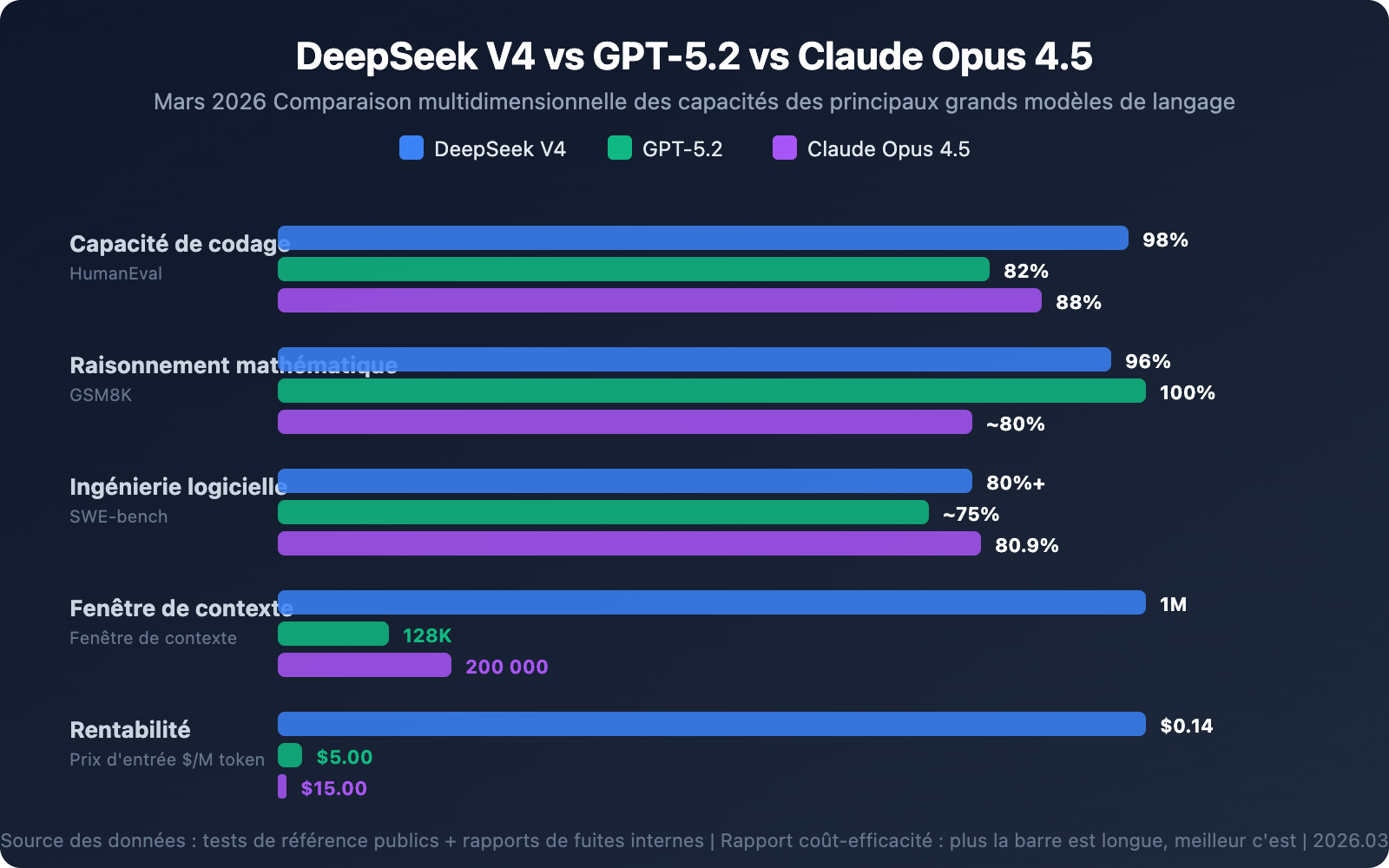

Benchmark de performance et comparaison des modèles DeepSeek V4

DeepSeek V4 démontre une compétitivité robuste dans plusieurs benchmarks principaux. Voici une comparaison des performances entre DeepSeek V4 et les modèles dominants actuels :

| Benchmark | DeepSeek V4 | Claude Opus 4.5 | GPT-5.2 | Description du test |

|---|---|---|---|---|

| HumanEval (codage) | 98% | 88% | 82% | Taux de précision de génération de code |

| SWE-bench Verified | 80%+ | 80.9% | ~75% | Taux de résolution d'issues GitHub réelles |

| GSM8K (mathématiques) | 96% | ~80% | 100% | Capacités de raisonnement mathématique |

| AIME 2025 | ~85% | ~80% | 100% | Compétition mathématique de haut niveau |

| Longueur de contexte | 1 million de tokens | 200 000 tokens | 128 000 tokens | Longueur d'entrée maximale |

📊 Note sur les données : Les données de benchmark DeepSeek V4 ci-dessus proviennent de tests internes et de rapports divulgués, et n'ont pas encore été vérifiées par des tiers indépendants. Les performances après la publication officielle peuvent différer. Nous recommandons d'effectuer des tests comparatifs pratiques via la plateforme APIYI apiyi.com pour obtenir une expérience d'utilisation réelle.

Analyse approfondie des capacités de codage de DeepSeek V4

Les performances de DeepSeek V4 dans le domaine du codage sont particulièrement remarquables. Grâce à sa fenêtre de contexte de 1 million de tokens, DeepSeek V4 peut traiter un dépôt de code entier en une seule inférence, permettant un véritable raisonnement associatif multi-fichiers.

Les avantages spécifiques incluent :

- Compréhension complète du dépôt : Chargement d'un projet de code complet en une seule fois, comprenant les relations de dépendance entre les composants

- Refactorisation multi-fichiers : Maintien de la cohérence globale lors de refactorisations de code à grande échelle

- Débogage à longue chaîne : Suivi des chaînes d'appel de bugs s'étendant sur plusieurs modules

Cela signifie que pour les tâches complexes d'ingénierie logicielle, DeepSeek V4 peut effectuer une analyse globale comme le ferait un développeur senior, plutôt que de se limiter à une compréhension fragmentaire d'un seul fichier.

Détails des capacités multimodales de DeepSeek V4

Contrairement à la génération précédente de modèles purement textuels, DeepSeek V4 est un modèle multimodal natif, traitant simultanément les données textuelles, visuelles, vidéo et audio dès la phase d'entraînement, plutôt que d'ajouter des capacités visuelles "après coup" sur un modèle textuel.

Matrice des capacités multimodales de DeepSeek V4

| Dimension de capacité | Support | Scénarios d'application typiques |

|---|---|---|

| Génération de texte | ✅ Capacité principale | Codage, rédaction, analyse, traduction |

| Génération d'images | ✅ Support natif | Texte vers image, assistance à la conception, génération de graphiques |

| Génération vidéo | ✅ Support natif | Génération de vidéos courtes, création d'animations |

| Compréhension d'images | ✅ Support natif | Analyse d'images, OCR, questions-réponses visuelles |

| Compréhension vidéo | ✅ Support natif | Résumé vidéo, analyse de contenu |

| Traitement audio | 🔄 À confirmer | Reconnaissance vocale, analyse audio |

L'avantage fondamental de la conception multimodale native réside dans la cohérence du raisonnement intermodal. Par exemple, lorsqu'un utilisateur demande "génère un diagramme d'architecture basé sur ce code", le modèle peut comprendre la logique du code tout en produisant directement un diagramme de visualisation de haute qualité, sans dépendre de chaînes d'outils externes.

DeepSeek s'engage également à ajouter un filigrane obligatoire à tous les contenus multimédias générés, accompagné d'un système de filtrage de contenu en temps réel, garantissant ainsi la sécurité et la conformité du contenu généré.

Tarification et méthodes d'accès à l'API DeepSeek V4

La tarification de l'API DeepSeek V4 poursuit la stratégie de rapport qualité-prix élevé caractéristique de DeepSeek, offrant un avantage de coût significatif par rapport aux principaux concurrents :

| Poste de facturation | Tarif DeepSeek V4 | Prix de référence GPT-5 | Avantage de coût |

|---|---|---|---|

| Token d'entrée | 0,14 $ / million | 5,00 $ / million | ~35x |

| Token de sortie | 0,28 $ / million | 15,00 $ / million | ~53x |

| Entrée en cache | 0,07 $ / million | – | -50% supplémentaire en cas de succès du cache |

| Quota gratuit | 5 millions de tokens | – | Offert dès l'inscription pour les nouveaux utilisateurs |

Accès rapide à l'API DeepSeek V4

Voici un exemple de code minimaliste pour appeler DeepSeek V4 via l'API :

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # Interface unifiée APIYI

)

response = client.chat.completions.create(

model="deepseek-v4",

messages=[{"role": "user", "content": "Analysez la conception architecturale de ce code"}],

max_tokens=4096

)

print(response.choices[0].message.content)

Voir un exemple d’appel multimodal (génération d’images)

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # Interface unifiée APIYI

)

# Exemple d'appel texte vers image

response = client.images.generate(

model="deepseek-v4",

prompt="Un robot mignon en train d'écrire du code, style cyberpunk",

size="1024x1024",

quality="hd"

)

print(response.data[0].url)

🚀 Démarrage rapide : Nous recommandons d'utiliser la plateforme APIYI apiyi.com pour accéder rapidement à DeepSeek V4. Cette plateforme fournit une interface API unifiée prête à l'emploi, sans configuration complexe. L'inscription offre un quota de test gratuit, et l'intégration peut être réalisée en 5 minutes.

Écosystème open source et impact stratégique de DeepSeek V4

DeepSeek V4 est prévu pour être publié sous licence open source, ce qui signifie que les développeurs du monde entier pourront télécharger, affiner et déployer le modèle gratuitement. Cette stratégie a un impact profond sur le paysage de l'industrie de l'IA :

Impact sur les développeurs :

- Déploiement possible de modèles de taille trillion de paramètres dans des environnements privés, garantissant la confidentialité des données.

- Prise en charge de l'affinage pour des domaines spécifiques, permettant de construire des modèles dédiés à un secteur.

- L'écosystème piloté par la communauté accélérera l'itération des capacités du modèle.

Impact sur l'industrie :

- La publication open source d'un modèle trillion de paramètres réduira considérablement le seuil d'entrée pour le développement d'applications d'IA.

- Contribuera à une baisse supplémentaire des prix des API, bénéficiant aux PME.

- Accélérera la démocratisation et l'innovation des applications d'IA multimodales.

Écosystème matériel :

Il est à noter que DeepSeek V4 a été optimisé pour les puces d'IA nationales comme celles de Huawei et de Cambricon, réduisant ainsi la dépendance aux GPU NVIDIA. Ce n'est pas seulement un choix technique, mais reflète également la tendance actuelle à la diversification de la chaîne d'approvisionnement en IA.

💡 Conseil de développement : Que vous choisissiez l'appel d'API cloud ou le déploiement privé, il est recommandé de valider d'abord les fonctionnalités et d'évaluer les performances via la plateforme APIYI apiyi.com, afin de confirmer que les besoins métiers sont satisfaits avant de décider du schéma de déploiement.

Questions fréquentes

Q1 : Quand DeepSeek V4 sera-t-il officiellement publié ?

Selon plusieurs sources, DeepSeek V4 devrait être publié la première semaine de mars 2026, juste avant l'ouverture des "deux sessions" en Chine (qui commencent le 4 mars). Le modèle sera publié sous licence open source, et le service API sera lancé simultanément. Il est recommandé de suivre les canaux officiels de DeepSeek pour obtenir les informations de première main, ou d'utiliser la plateforme APIYI apiyi.com pour expérimenter et intégrer le modèle dès sa sortie.

Q2 : Le contexte de 1 million de tokens de DeepSeek V4 est-il vraiment utile ?

Le contexte de 1 million de tokens est très pratique pour des scénarios spécifiques, notamment l'analyse de grandes bases de code (chargement d'un projet entier en une fois), le traitement de documents longs (contrats juridiques, manuels techniques) et les conversations complexes multi-tours. Cependant, pour les tâches quotidiennes de texte court, une fenêtre de contexte aussi grande n'est pas nécessaire. Il est recommandé de choisir la configuration des paramètres en fonction des besoins réels. Via APIYI apiyi.com, vous pouvez ajuster de manière flexible les paramètres d'appel pour effectuer des tests.

Q3 : Le prix de DeepSeek V4 est si bas, la qualité est-elle garantie ?

Le faible coût de DeepSeek provient de son architecture MoE (seulement 37B de paramètres activés par inférence, et non la totalité des 1T) et d'optimisations techniques, et non d'une réduction de la qualité. D'après les tests de référence publics, les performances de DeepSeek V4 sur les tâches de codage et de mathématiques sont au même niveau que GPT-5 et Claude. Il est recommandé d'effectuer des tests approfondis dans des scénarios réels avant une adoption formelle.

Résumé

Les principaux points d'intérêt de DeepSeek V4 :

- Architecture MoE à mille milliards de paramètres : 1T de paramètres totaux, 37B de paramètres actifs, atteignant un équilibre révolutionnaire entre performances et efficacité.

- Capacités multimodales natives : Pas un "texte + plugin visuel", mais un traitement unifié du texte, des images et des vidéos dès la phase d'entraînement.

- Contexte de 1 million de tokens : A une signification révolutionnaire pour l'analyse de grandes bases de code et le traitement de documents longs.

- Rapport qualité-prix exceptionnel : Le prix de l'API n'est que 1/35 de celui de GPT-5, réduisant considérablement les coûts pour les développeurs.

- Écosystème open source : La stratégie de publication open source accélérera l'innovation communautaire et les applications industrielles.

La publication de DeepSeek V4 marque l'entrée officielle des grands modèles de langage open source dans l'ère multimodale à mille milliards de paramètres. Pour les développeurs, cela signifie un seuil d'accès plus bas et des choix technologiques plus riches.

Il est recommandé d'expérimenter les capacités complètes de DeepSeek V4 dès sa sortie via APIYI apiyi.com. La plateforme offre un quota gratuit et une interface unifiée pour plusieurs modèles, facilitant les comparaisons et évaluations rapides.

📚 Références

-

Article TechNode : Plan de lancement du modèle multimodal DeepSeek V4

- Lien :

technode.com/2026/03/02/deepseek-plans-v4-multimodal-model-release-this-week-sources-say/ - Description : Article faisant autorité sur la date de sortie et les partenariats matériels de DeepSeek V4.

- Lien :

-

Documentation officielle de l'API DeepSeek : Tarification des modèles et spécifications de l'interface

- Lien :

api-docs.deepseek.com/quick_start/pricing - Description : Documentation technique et tarifaire officielle de l'API, lecture essentielle pour le développement et l'intégration.

- Lien :

-

Comparatif de benchmarks des modèles d'IA : Classement des performances des principaux grands modèles de langage en 2026

- Lien :

lmcouncil.ai/benchmarks - Description : Plateforme de tests de référence tierce et indépendante, fournissant des données objectives de comparaison des performances des modèles.

- Lien :

Auteur : Équipe technique d'APIYI

Échanges techniques : Nous vous invitons à partager vos retours d'expérience avec DeepSeek V4 dans les commentaires. Pour plus de ressources sur l'intégration d'API, visitez le centre de documentation d'APIYI à docs.apiyi.com.