"Bonjour, j'ai un compte sur Google AI Studio, mais on m'indique que mon quota gratuit est épuisé. Je souhaite continuer à créer des modèles sur AI Studio, mais mon compte gratuit ne se recharge pas. Comment puis-je créditer mon compte Google, ou existe-t-il d'autres moyens de continuer à l'utiliser ?"

C'est une question que nous recevons quotidiennement. Les quotas gratuits de Google AI Studio sont effectivement limités, et en décembre 2025, Google a considérablement réduit les allocations du niveau gratuit.

Bonne nouvelle : vous n'avez pas besoin de créditer votre compte Google pour continuer à utiliser toute la gamme de modèles Gemini.

L'idée centrale est simple : exportez votre code et effectuez vos appels en local.

Cet article détaille 3 solutions pour vous aider à continuer d'utiliser Gemini une fois votre quota gratuit épuisé.

Comprendre les limites de quota d'AI Studio

Quotas actuels du niveau gratuit (2026)

Le 7 décembre 2025, Google a opéré un changement majeur dans les quotas de l'API Gemini pour les développeurs. De nombreuses applications ont soudainement commencé à renvoyer des erreurs 429 :

| Modèle | RPM (Gratuit) | RPD (Gratuit) | RPM (Payant) |

|---|---|---|---|

| Gemini 1.5 Pro | 5 | 25 | 1 000 |

| Gemini 1.5 Flash | 15 | 500 | 2 000 |

| Gemini 2.0 Flash | 15 | 1 500 | 4 000 |

Note : RPM = Requêtes Par Minute, RPD = Requêtes Par Jour

Pourquoi le quota s'épuise-t-il soudainement ?

| Cause | Explication |

|---|---|

| Dépassement du RPM | Trop de requêtes envoyées dans un court intervalle. |

| Dépassement du RPD | Le nombre total de requêtes quotidiennes a atteint la limite. |

| Dépassement du TPM | Les contextes longs consomment une grande quantité de tokens. |

| Réduction des quotas | Les restrictions sont devenues plus strictes après l'ajustement de déc. 2025 par Google. |

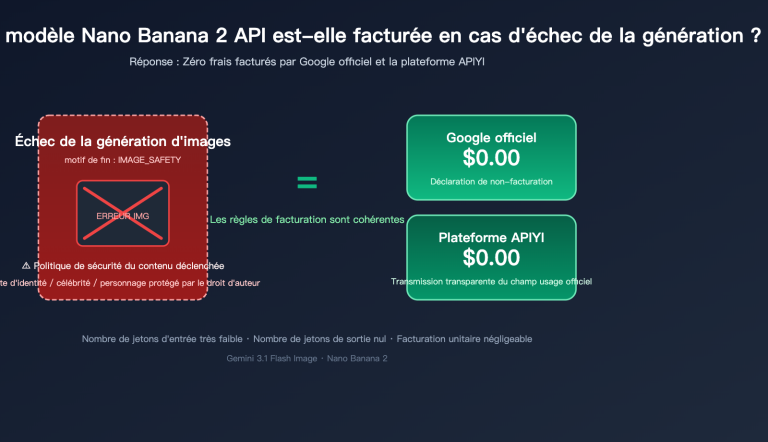

Rappel important : plusieurs clés API n'augmentent pas le quota

Beaucoup d'utilisateurs pensent qu'en créant plusieurs clés API, ils obtiendront plus de quota, mais en réalité :

Le quota est calculé par projet (Project), pas par clé API. Créer plusieurs clés API au sein d'un même projet n'augmentera pas votre quota global.

Solution 1 : Exporter le code vers le développement local (Recommandé)

Concept fondamental

L'essence d'AI Studio est d'être un outil visuel de débogage d'invites. Les modèles que vous créez et les invites que vous ajustez dans AI Studio peuvent tous être exportés sous forme de code, pour être utilisés dans votre environnement local en appelant votre propre clé API.

Étapes à suivre

Étape 1 : Terminer le débogage de l'invite dans AI Studio

Utilisez le quota gratuit d'AI Studio pour peaufiner votre invite, vos configurations de paramètres, etc.

Étape 2 : Exporter le code

AI Studio propose plusieurs modes d'exportation :

- Télécharger le ZIP : Exporte le package de code complet localement.

- Pousser vers GitHub : Envoie directement le code vers votre dépôt.

- Copier des extraits de code : Copie le code en Python, JavaScript ou curl.

Étape 3 : Configuration locale de la clé API

# Définir la variable d'environnement (recommandé)

export GEMINI_API_KEY="votre-clé-api-ici"

# Ou

export GOOGLE_API_KEY="votre-clé-api-ici"

Étape 4 : Exécution locale

import google.generativeai as genai

import os

# Lecture automatique de la clé API depuis les variables d'environnement

genai.configure(api_key=os.environ.get("GEMINI_API_KEY"))

model = genai.GenerativeModel('gemini-2.0-flash')

response = model.generate_content("你好,请介绍一下自己")

print(response.text)

Points d'attention

| Point | Description |

|---|---|

| Sécurité de la clé API | Ne codez pas la clé API en dur dans le code côté client. |

| Variables d'environnement | Utilisez GEMINI_API_KEY ou GOOGLE_API_KEY. |

| Quotas toujours limités | Les appels locaux restent soumis aux limites de quota du niveau gratuit. |

🎯 Conseil technique : Une fois le code exporté, si le quota gratuit ne suffit toujours pas, vous pouvez envisager d'utiliser des fournisseurs d'API tiers comme APIYI (apiyi.com). Ces plateformes offrent des quotas plus élevés et des modes de facturation plus flexibles.

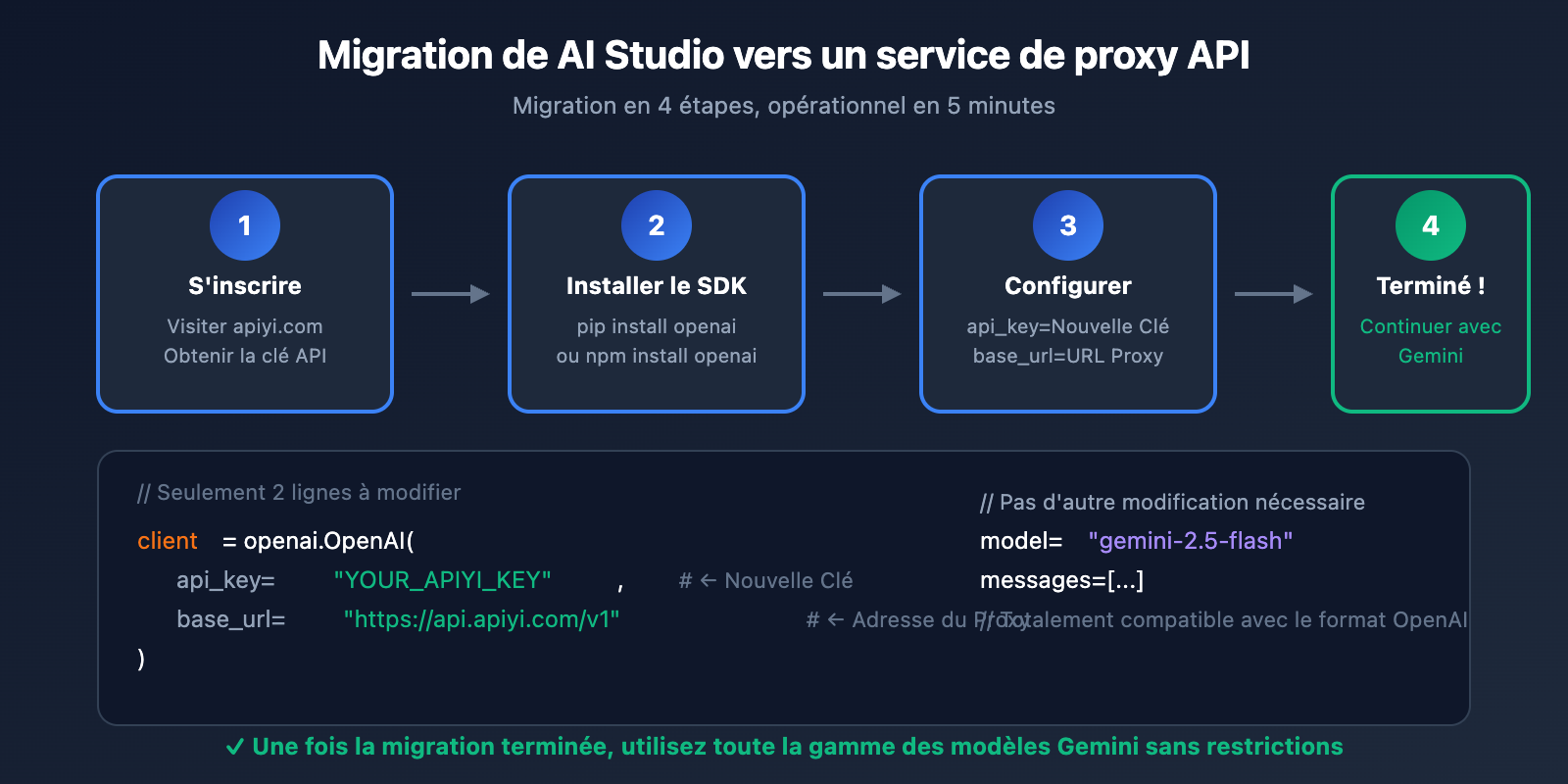

Solution 2 : Utiliser un service de proxy API tiers (La meilleure solution)

Qu'est-ce qu'un service de proxy API ?

Les fournisseurs de proxy API agrègent plusieurs clés API et ressources de comptes pour proposer une interface API unique. Il vous suffit de :

- Vous inscrire sur la plateforme de proxy pour obtenir une clé API.

- Modifier l'adresse API dans votre code pour utiliser celle du proxy.

- Continuer l'utilisation sans vous soucier des problèmes de quota.

Pourquoi choisir un proxy API ?

| Avantage | Description |

|---|---|

| Plus d'angoisse liée aux quotas | Le fournisseur gère les quotas, vous vous contentez de consommer. |

| Support de toute la gamme de modèles | Couverture complète : Gemini Pro, Flash, Nano Banana, etc. |

| Format compatible OpenAI | Pas besoin de modifier la structure de votre code existant. |

| Paiement à l'usage | Payez ce que vous consommez, sans frais mensuels. |

| Plus de stabilité | Équilibrage de charge sur plusieurs nœuds pour éviter les limitations de débit ponctuelles. |

Exemple de migration de code

Avant migration (appel direct à l'API Google) :

import google.generativeai as genai

genai.configure(api_key="YOUR_GOOGLE_API_KEY")

model = genai.GenerativeModel('gemini-2.0-flash')

response = model.generate_content("Hello")

Après migration (utilisation d'un proxy API) :

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1" # Interface unifiée APIYI

)

response = client.chat.completions.create(

model="gemini-2.0-flash",

messages=[{"role": "user", "content": "Hello"}]

)

print(response.choices[0].message.content)

Liste des modèles supportés

| Série de modèles | Modèles spécifiques | Description |

|---|---|---|

| Gemini 2.5 | gemini-2.5-pro, gemini-2.5-flash | Derniers modèles multimodaux |

| Gemini 2.0 | gemini-2.0-flash, gemini-2.0-flash-thinking | Modèles d'inférence rapide |

| Gemini 3 | gemini-3-pro-image-preview | Modèles de génération d'images |

| Nano Banana | nano-banana-pro | Génération d'images native |

💡 Démarrage rapide : Nous vous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour un accès rapide. Cette plateforme supporte toute la gamme des modèles Gemini et propose un format compatible OpenAI, permettant une migration en moins de 5 minutes.

Option 3 : Passer au niveau payant de Google

Comparaison des quotas des niveaux payants

Si vous souhaitez continuer à utiliser les services officiels de Google, vous pouvez envisager de passer à un niveau payant (Paid Tier) :

| Niveau | Condition de déclenchement | Gemini 2.5 Pro RPM | Gemini 2.5 Flash RPM |

|---|---|---|---|

| Free | Par défaut | 5 | 15 |

| Tier 1 | Activer la facturation | 150 | 1 000 |

| Tier 2 | Consommation > 50 $ | 500 | 2 000 |

| Tier 3 | Consommation > 500 $ | 1 000 | 4 000 |

Étapes de mise à niveau

- Connectez-vous à la Google Cloud Console.

- Créez ou sélectionnez un projet.

- Activez la facturation (Billing) en associant une carte de crédit.

- Vérifiez l'évolution des quotas dans AI Studio.

Les inconvénients du niveau payant

| Problème | Explication |

|---|---|

| Carte de crédit internationale requise | Difficile à obtenir pour certains utilisateurs selon leur zone géographique. |

| Compte Google Cloud nécessaire | Configuration relativement complexe. |

| Seuil de consommation minimale | Il faut dépenser un certain montant pour accéder aux niveaux supérieurs. |

| Limites de quotas persistantes | Les plafonds sont augmentés, mais le service n'est pas illimité. |

Comparaison des trois solutions

| Dimension de comparaison | Dév local (Export) | Service Proxy API | Niveau payant Google |

|---|---|---|---|

| Difficulté | Moyenne | Simple | Complexe |

| Quotas | Toujours limités | Illimités | Plafonds relevés |

| Coût | Gratuit (limité) | Pay-as-you-go | Pay-as-you-go |

| Carte de crédit | Non | Non | Oui (internationale) |

| Stabilité | Moyenne | Haute | Haute |

| Usage idéal | Utilisation légère | Recommandé pour tous | Besoins entreprise |

Tutoriel détaillé : migrer de AI Studio vers un proxy API

Étape 1 : Créer un compte sur une plateforme de proxy API

Rendez-vous sur APIYI (apiyi.com), créez un compte et récupérez votre clé API (API Key).

Étape 2 : Installer le SDK OpenAI

# Python

pip install openai

# Node.js

npm install openai

Étape 3 : Modifier la configuration du code

Exemple Python :

import openai

# 配置 API 代理

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1" # APIYI统一接口

)

# 调用 Gemini 模型

def chat_with_gemini(prompt):

response = client.chat.completions.create(

model="gemini-2.5-flash", # 可选其他 Gemini 模型

messages=[

{"role": "user", "content": prompt}

],

temperature=0.7,

max_tokens=2048

)

return response.choices[0].message.content

# 使用示例

result = chat_with_gemini("用 Python 写一个快速排序算法")

print(result)

Exemple Node.js :

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: 'YOUR_APIYI_KEY',

baseURL: 'https://api.apiyi.com/v1'

});

async function chatWithGemini(prompt) {

const response = await client.chat.completions.create({

model: 'gemini-2.5-flash',

messages: [

{ role: 'user', content: prompt }

]

});

return response.choices[0].message.content;

}

// 使用示例

const result = await chatWithGemini('解释什么是机器学习');

console.log(result);

Étape 4 : Test et vérification

# 测试连接

try:

response = client.chat.completions.create(

model="gemini-2.5-flash",

messages=[{"role": "user", "content": "Hello, 测试连接"}],

max_tokens=50

)

print("连接成功:", response.choices[0].message.content)

except Exception as e:

print("连接失败:", e)

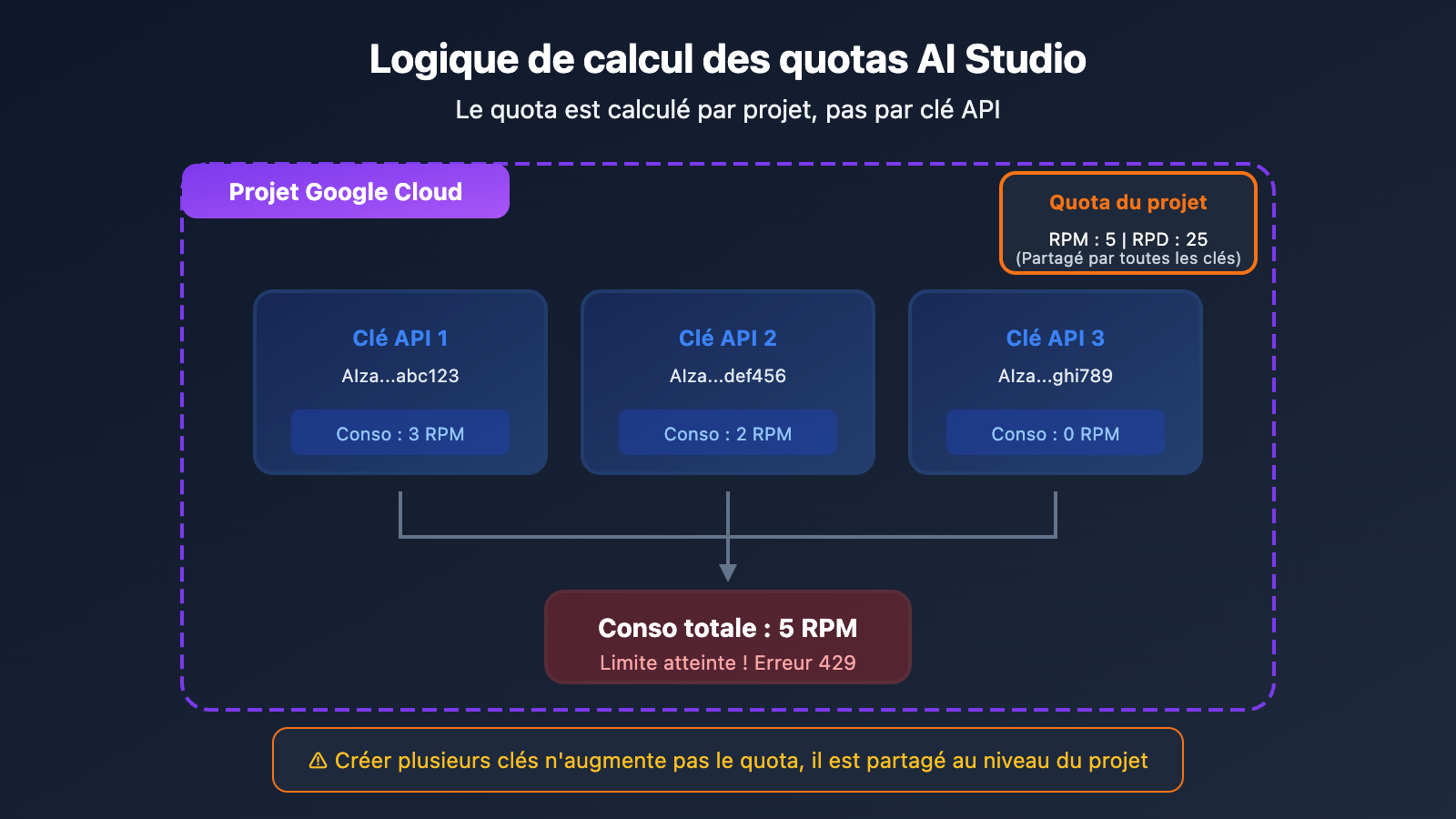

Migration des modèles de génération d'images

Génération d'images dans AI Studio

Si vous utilisez la fonction de génération d'images de Gemini (Nano Banana Pro) dans AI Studio, vous pouvez également continuer à l'utiliser via le proxy API :

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

# Génération d'images

response = client.images.generate(

model="nano-banana-pro",

prompt="Un adorable chat orange faisant la sieste au soleil, style photographique réaliste",

size="1024x1024",

quality="hd"

)

image_url = response.data[0].url

print(f"Image générée : {image_url}")

Dialogue multimodal (mélange image et texte)

import base64

def encode_image(image_path):

with open(image_path, "rb") as f:

return base64.b64encode(f.read()).decode()

image_base64 = encode_image("example.jpg")

response = client.chat.completions.create(

model="gemini-2.5-flash",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Décris le contenu de cette image"},

{

"type": "image_url",

"image_url": {

"url": f"data:image/jpeg;base64,{image_base64}"

}

}

]

}

]

)

print(response.choices[0].message.content)

💰 Optimisation des coûts : Pour vos besoins en génération d'images, la plateforme APIYI (apiyi.com) propose des modes de facturation flexibles et prend en charge de nombreux modèles comme Nano Banana Pro, DALL-E ou Stable Diffusion, vous permettant de choisir la solution la plus adaptée à vos besoins.

Gestion des erreurs courantes

Erreur 1 : 429 Too Many Requests

import time

from tenacity import retry, stop_after_attempt, wait_exponential

@retry(stop=stop_after_attempt(3), wait=wait_exponential(multiplier=1, min=2, max=10))

def call_api_with_retry(prompt):

return client.chat.completions.create(

model="gemini-2.5-flash",

messages=[{"role": "user", "content": prompt}]

)

Erreur 2 : Clé API invalide

# Vérification de la configuration de la clé API

import os

api_key = os.environ.get("APIYI_KEY")

if not api_key:

raise ValueError("Veuillez configurer la variable d'environnement APIYI_KEY")

client = openai.OpenAI(

api_key=api_key,

base_url="https://api.apiyi.com/v1"

)

Erreur 3 : Le modèle n'existe pas

# S'assurer que le nom du modèle est correct

SUPPORTED_MODELS = [

"gemini-2.5-pro",

"gemini-2.5-flash",

"gemini-2.0-flash",

"nano-banana-pro"

]

model_name = "gemini-2.5-flash"

if model_name not in SUPPORTED_MODELS:

print(f"Avertissement : {model_name} ne figure peut-être pas dans la liste des modèles pris en charge")

FAQ (Foire Aux Questions)

Q1 : Quand les quotas gratuits d'AI Studio sont-ils réinitialisés ?

- RPM (Requêtes par minute) : Fenêtre glissante, réinitialisation chaque minute.

- RPD (Requêtes par jour) : Réinitialisation à minuit, heure du Pacifique (PST/PDT).

- TPM (Tokens par minute) : Fenêtre glissante, réinitialisation chaque minute.

Si vous avez un besoin urgent, nous vous conseillons de passer par la plateforme APIYI (apiyi.com) pour vos appels API, afin d'éviter d'attendre la réinitialisation des quotas.

Q2 : Est-il sûr d'utiliser un proxy API ?

Oui, il est sûr d'utiliser un proxy API à condition de choisir un fournisseur sérieux. Voici les points de vigilance :

- Choisissez un prestataire ayant une bonne réputation.

- Ne codez jamais votre clé API en dur dans votre code.

- Utilisez des variables d'environnement pour gérer vos clés secrètes.

Q3 : Quel est le prix d'un proxy API ?

La plupart des services de proxy API utilisent un modèle de facturation à l'usage (pay-as-you-go), et sont souvent plus avantageux que les tarifs officiels. La plateforme APIYI (apiyi.com) propose une tarification transparente que vous pouvez consulter directement sur leur site.

Q4 : Dois-je modifier mon code en profondeur après la migration ?

Si vous utilisez un proxy API compatible avec le format OpenAI, les modifications sont minimes :

- Il suffit de mettre à jour l'

api_keyet lebase_url. - Le nom du modèle devra peut-être être ajusté.

- La logique métier de votre code reste inchangée.

Q5 : Puis-je utiliser plusieurs services d'API simultanément ?

Tout à fait. Vous pouvez choisir différents services selon vos besoins :

- Les quotas gratuits d'AI Studio pour des tests légers.

- Un service de proxy API pour le développement quotidien.

- Le service officiel payant pour des besoins spécifiques en entreprise.

En résumé

Lorsque vos quotas gratuits sur Google AI Studio sont épuisés, vous avez 3 options :

| Option | Public cible | Action clé |

|---|---|---|

| Exporter pour le dev local | Utilisateurs occasionnels | Exporter le code, appel en local |

| Service de proxy API | La plupart des développeurs | Modifier le base_url, continuer |

| Passer au forfait payant | Besoins d'entreprise | Lier une carte, augmenter les quotas |

Nos conseils clés :

- Évitez de créditer votre compte Google (à moins d'avoir une carte de crédit internationale et des besoins de niveau entreprise).

- Exportez votre code vers votre environnement local.

- Utilisez un service de proxy API pour continuer à appeler les modèles Gemini.

- En une phrase : Exportez votre code et poursuivez votre développement en local.

Pour reprendre rapidement votre utilisation de Gemini, nous vous recommandons APIYI (apiyi.com). La plateforme supporte toute la gamme des modèles Gemini, propose un format compatible OpenAI et le coût de migration est extrêmement faible.

Lecture complémentaire :

- Limites de débit de l'API Gemini : ai.google.dev/gemini-api/docs/rate-limits

- Mode de construction AI Studio : ai.google.dev/gemini-api/docs/aistudio-build-mode

- Guide d'utilisation des clés API : ai.google.dev/gemini-api/docs/api-key

📝 Auteur : Équipe technique APIYI | Spécialiste de l'intégration et de l'optimisation des API de grands modèles de langage.

🔗 Échanges techniques : Visitez APIYI (apiyi.com) pour obtenir de l'aide sur l'appel de toute la gamme des modèles Gemini.