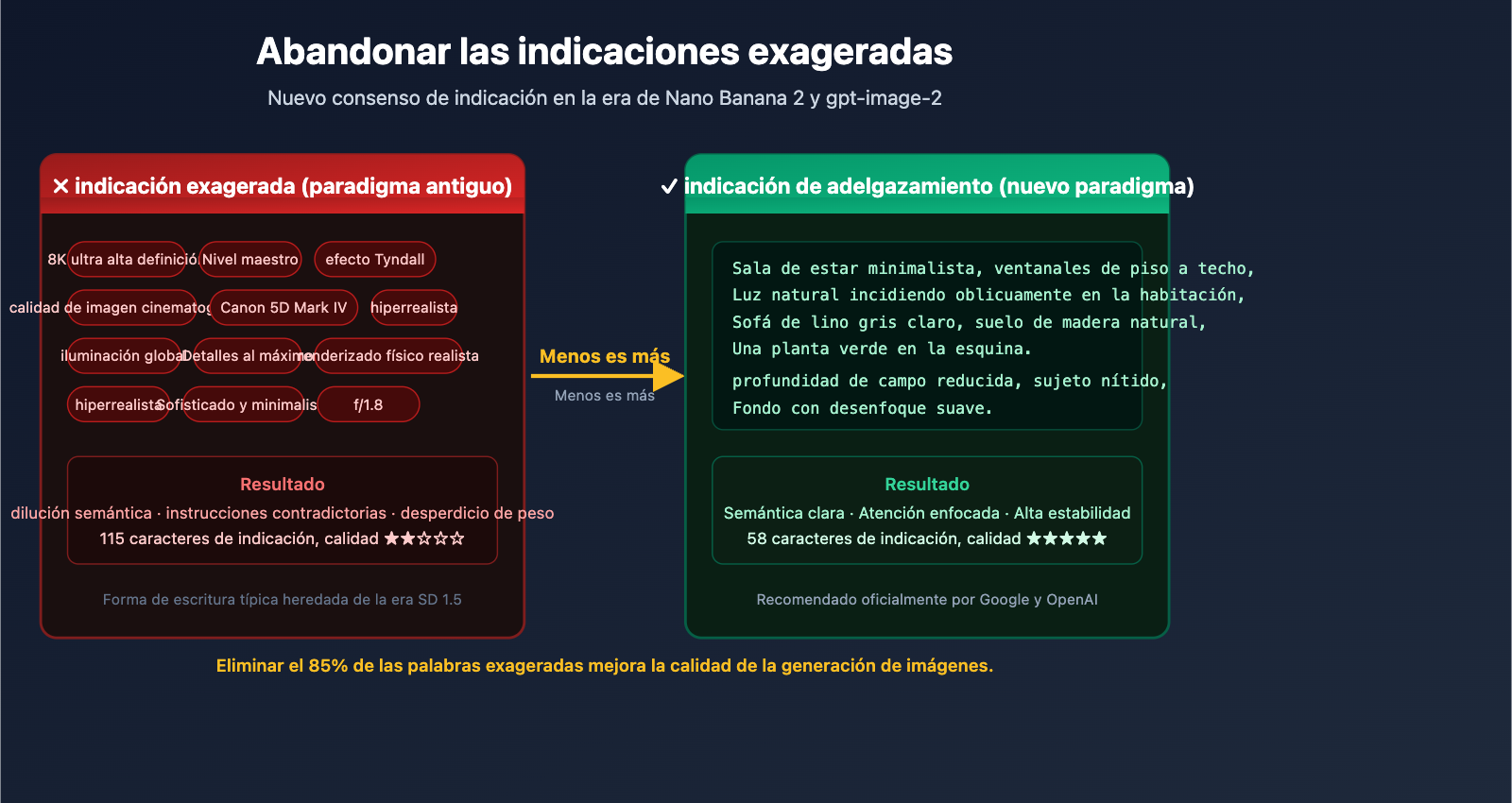

En el ámbito de la generación de imágenes por IA, muchos creadores siguen utilizando una "fórmula de indicación heredada de Stable Diffusion 1.5", como este típico ejemplo exagerado:

En el escaparate de cristal, cadena de sombra blanca, espacio interior fotorrealista extremo, estética de iluminación de nivel maestro, luz natural entrando suavemente a través de grandes ventanales, contraste suave de luces y sombras, capas de iluminación delicadas, efecto de luz Tyndall, renderizado de iluminación física real, iluminación global, sombras suaves, textura de alto detalle, 8K ultra alta definición, calidad de imagen cinematográfica, texturas realistas, atmósfera espacial limpia y transparente, fotografía de interiores profesional, tomada con Canon 5D Mark IV, apertura f/1.8, textura real, sin sobre-renderizado, minimalismo avanzado, cómodo y acogedor, detalles ricos. Resolución 8K de alta definición, realismo cinematográfico, estilo fotográfico real, fotorrealismo, textura transparente, detalles al máximo ——

Esta indicación contiene 23 adjetivos, 8 términos técnicos y 3 repeticiones de calidad. En el ecosistema de SD anterior a 2024, este estilo podía tener cierto efecto. Pero en la era de Nano Banana 2 y gpt-image-2 de 2026, este tipo de "indicación exagerada" no solo es redundante, sino que incluso puede reducir la calidad de la imagen resultante.

Este artículo explica, partiendo de las diferencias subyacentes en los datos de entrenamiento, por qué los tiempos han cambiado y ofrece 7 principios de simplificación de indicaciones listos para usar, para que puedas obtener mejores imágenes con descripciones más cortas y precisas.

I. Por qué las indicaciones exageradas ya no funcionan en la era de Nano Banana 2

Para entender este cambio, debemos repasar la evolución histórica de cómo redactamos las indicaciones.

1.1 El origen histórico de las indicaciones exageradas: La era de las etiquetas de Danbooru

Palabras como "8K", "masterpiece", "best quality" y "ultra realistic" fueron consideradas en su día "palabras mágicas" por una razón técnica muy concreta: estos términos eran etiquetas reales del sitio de imágenes Danbooru.

Los datos de entrenamiento de Stable Diffusion 1.5 y sus modelos derivados (NovelAI, Waifu Diffusion, etc.) contenían una gran cantidad de imágenes provenientes de Danbooru, las cuales ya habían sido etiquetadas por los usuarios con términos como masterpiece o best quality al momento de subirlas. La asociación que aprendió el modelo fue:

"masterpiece" ⟷ el estilo de las imágenes marcadas como masterpiece en el conjunto de entrenamiento

Por lo tanto, en SD 1.5, acumular (masterpiece:1.2), (best quality:1.2), 8k, ultra detailed realmente funcionaba: servía para invocar la distribución de imágenes que, en el conjunto de entrenamiento, habían sido votadas como de alta calidad.

1.2 El cambio de paradigma de entrenamiento: De etiquetas a lenguaje natural

En la generación actual de modelos de imagen, como Nano Banana 2 (gemini-3.1-flash-image-preview), Nano Banana Pro (gemini-3-pro-image-preview), gpt-image-2 y Stable Diffusion 3.5, el paradigma de entrenamiento ha cambiado radicalmente:

| Dimensión de comparación | Era de SD 1.5 | Era de Nano Banana 2 / gpt-image-2 |

|---|---|---|

| Etiquetado de datos | Lista de etiquetas estilo Danbooru | Descripción de imagen en lenguaje natural (caption) |

| Codificador de texto | Límite de 77 tokens de CLIP | LLM multimodal (contexto de decenas de miles de tokens) |

| Forma de comprensión | Coincidencia de etiquetas | Comprensión semántica + razonamiento |

| Mejor indicación | Acumulación de palabras clave separadas por comas | Descripción narrativa de la escena |

| Peso de palabras exageradas | Efectivo, invoca distribución de estilo | Dilución semántica, incluso negativo |

| Longitud recomendada | 30-80 tokens | Frases naturales de 50-500 palabras |

Google especifica claramente en su guía de indicaciones para Nano Banana: "Nano Banana 2 entiende frases descriptivas, no spam de palabras clave separadas por comas."

OpenAI también señala explícitamente en el Cookbook oficial de gpt-image-2: "las especificaciones técnicas detalladas de la cámara pueden interpretarse de forma vaga"; el modelo no simula físicamente parámetros técnicos como "Canon 5D Mark IV, f/1.8", sino que los toma como una sugerencia aproximada del estilo de composición.

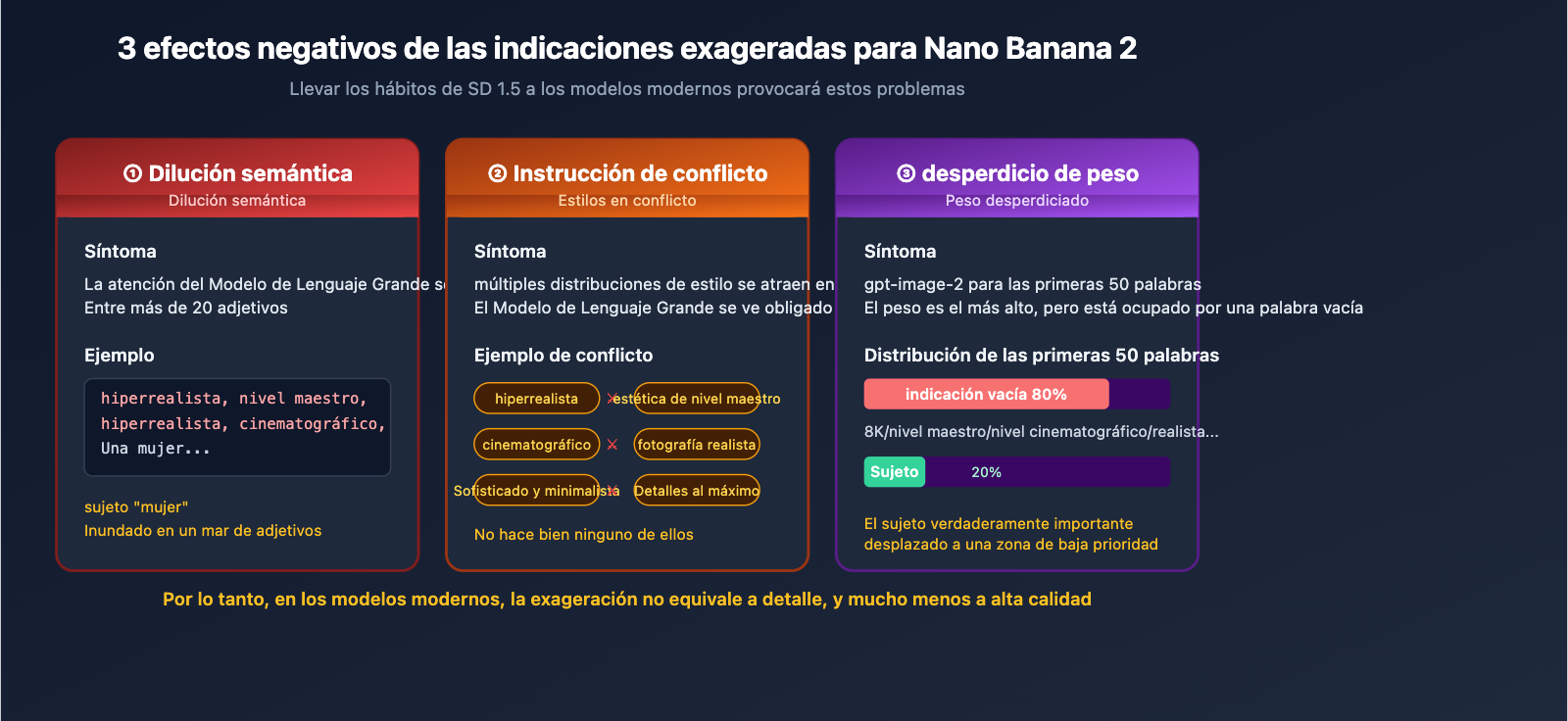

1.3 Los 3 efectos negativos de las indicaciones exageradas en modelos modernos

Trasladar los hábitos de la era de SD 1.5 a Nano Banana 2 genera problemas reales:

Efecto negativo 1: Dilución semántica. El modelo debe encontrar el sujeto y la acción reales entre 20 adjetivos, lo que dispersa su atención.

Efecto negativo 2: Instrucciones contradictorias. Existe una sutil contradicción de estilo entre "hiperrealista" + "estética de maestro" + "minimalismo avanzado" + "cinematográfico" + "fotografía real". El modelo debe comprometerse entre múltiples distribuciones y, a menudo, el resultado es que no logra ninguna bien.

Efecto negativo 3: Desperdicio de peso. La guía oficial de OpenAI indica que gpt-image-2 otorga mayor peso a las primeras 50 palabras. Si esas 50 palabras son solo términos vacíos como "hiperrealista, nivel maestro, 8K HD", la descripción real del sujeto queda relegada a una posición con menor peso.

二、Desglose de una indicación típica exagerada: qué es señal y qué es ruido

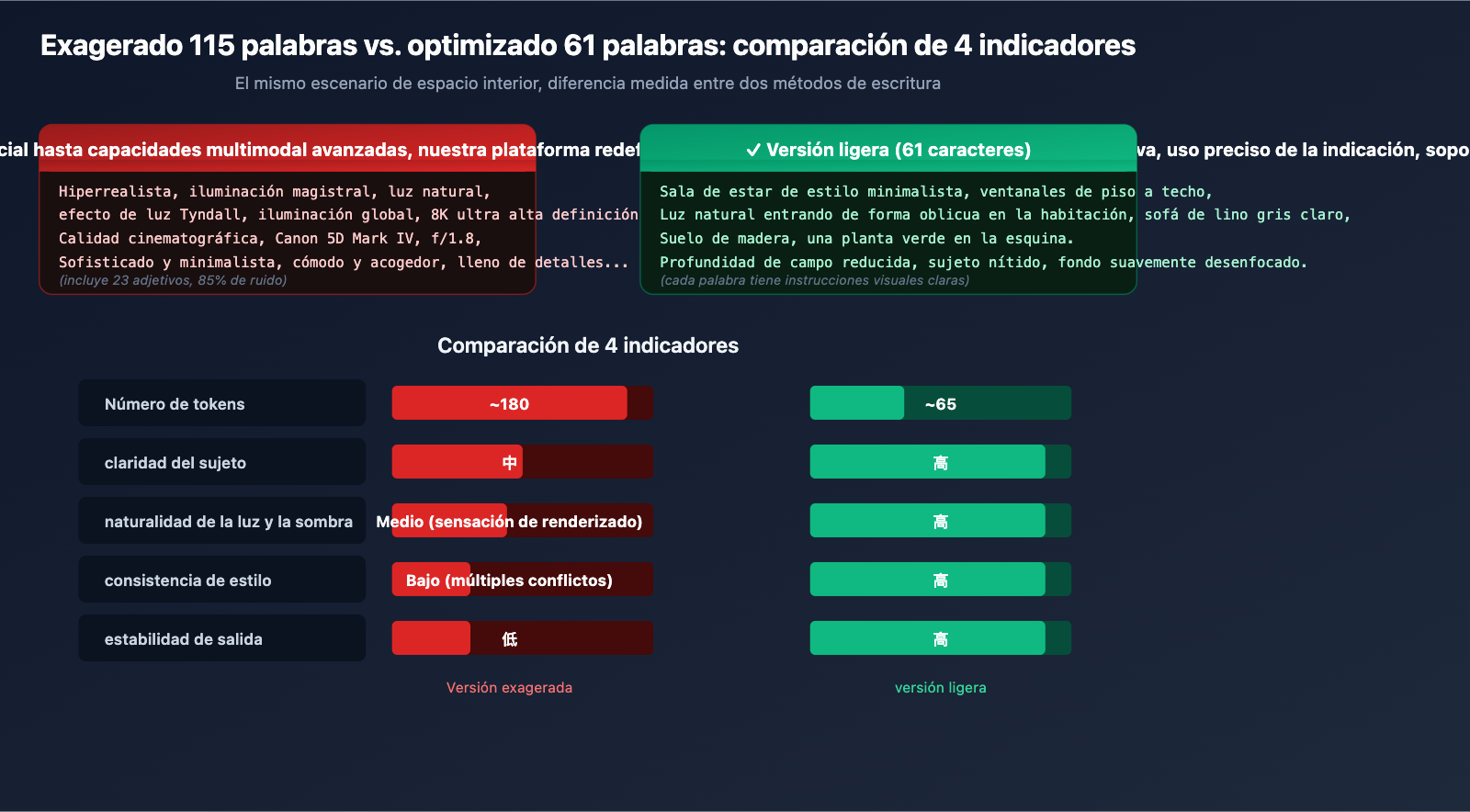

Tomemos como ejemplo la indicación exagerada de 115 palabras del inicio y clasifiquemos cada elemento:

2.1 Palabras de señal: descripciones que el modelo realmente aprovecha

| Término original | Clasificación | Razón para conservar |

|---|---|---|

| Vitrina de cristal con cadena de luz blanca | Sujeto específico + acción | Elementos visuales claros |

| Espacio interior | Escenario | Ubicación espacial necesaria |

| Luz natural a través de ventanales | Descripción de fuente de luz | Diseño de iluminación concreto |

| Apertura f/1.8 | Sugerencia de composición | El modelo lo interpreta como "profundidad de campo reducida" |

Total: Aproximadamente 4-5 palabras de señal reales.

2.2 Palabras de ruido: adornos semánticamente vacíos o redundantes

| Término original | Tipo de ruido | Problema |

|---|---|---|

| Extremadamente realista | Adjetivo vago | "Extremadamente" no tiene definición cuantificable |

| Estética de iluminación magistral | Eslogan de marketing | El modelo no tiene características visuales correspondientes |

| Contraste suave de luces y sombras | Repetitivo con "luz natural" | Información redundante |

| Capas de luz y sombra delicadas | Ídem | Repetitivo |

| Efecto de luz Tyndall | Término técnico mal usado | Solo aplicable en entornos con polvo específico |

| Renderizado de luz física real | Término de renderizado 3D | Sin sentido en escenas fotográficas |

| Iluminación global | Término de renderizado 3D | Ídem |

| Sombras suaves | Repetitivo con "contraste suave" | Repetitivo |

| Textura de alto detalle | Palabra de calidad | El modelo no tiene una distribución específica |

| 8K ultra alta definición | Término de resolución | Irrelevante para parámetros de API |

| Calidad cinematográfica | Eslogan | Sin significado operativo |

| Texturas realistas | Palabra de calidad vaga | Material no especificado |

| Atmósfera espacial limpia y transparente | Acumulación de adjetivos | Sin instrucciones concretas |

| Fotografía de interiores profesional | Etiqueta de estilo redundante | Repetitivo |

| Canon 5D Mark IV | Marca de cámara | El modelo no simula física real |

| Textura real | Repetitivo | Repetido varias veces antes |

| Sin renderizado excesivo | Instrucción negativa | Fácil de ignorar por el modelo |

| Minimalismo avanzado | Palabra de marketing | Sin instrucción visual |

| Cómodo y acogedor | Palabra emocional | Vago |

| Detalles ricos | Palabra de calidad | Repetitivo con "alto detalle" |

| Resolución 8K HD | Repetido de nuevo | Redundancia grave |

| Realismo cinematográfico | Repetido de nuevo | Redundancia grave |

| Estilo de fotografía real | Repetido de nuevo | Redundancia grave |

| Hiperrealista | Repetido de nuevo | Redundancia grave |

| Textura transparente | Repetido de nuevo | Redundancia grave |

| Detalles al máximo | Repetido de nuevo | Redundancia grave |

Total: Aproximadamente 26 palabras de ruido, representando casi el 85%.

2.3 Reescribiendo: conservar la señal, eliminar el ruido

Tras eliminar todo el ruido, esta indicación puede reducirse a menos del 20% de su longitud original, y la semántica resulta mucho más clara:

Un espacio interior moderno, vitrina de cristal frente a un ventanal,

cadena de luz blanca colgada en la vitrina, luz natural entrando en ángulo,

proyectando manchas de luz suave en el suelo de madera. Disparo con lente de 85mm,

profundidad de campo reducida, reflejos claros en el cristal del primer plano,

fondo ligeramente desenfocado.

Esta indicación de 61 palabras producirá resultados en Nano Banana 2 notablemente superiores a la versión exagerada de 115 palabras. La razón es simple: cada palabra contiene una instrucción visual clara.

🎯 Sugerencia de prueba: Recomendamos usar la misma clave API en APIYI (apiyi.com) para comparar la indicación exagerada original con la versión simplificada. Ejecute 5 resultados para cada una usando

gemini-3-pro-image-previewy observe la diferencia. La plataforma admite llamadas de interfaz unificadas para modelos principales como Nano Banana 2 y gpt-image-2, facilitando comparaciones rápidas.

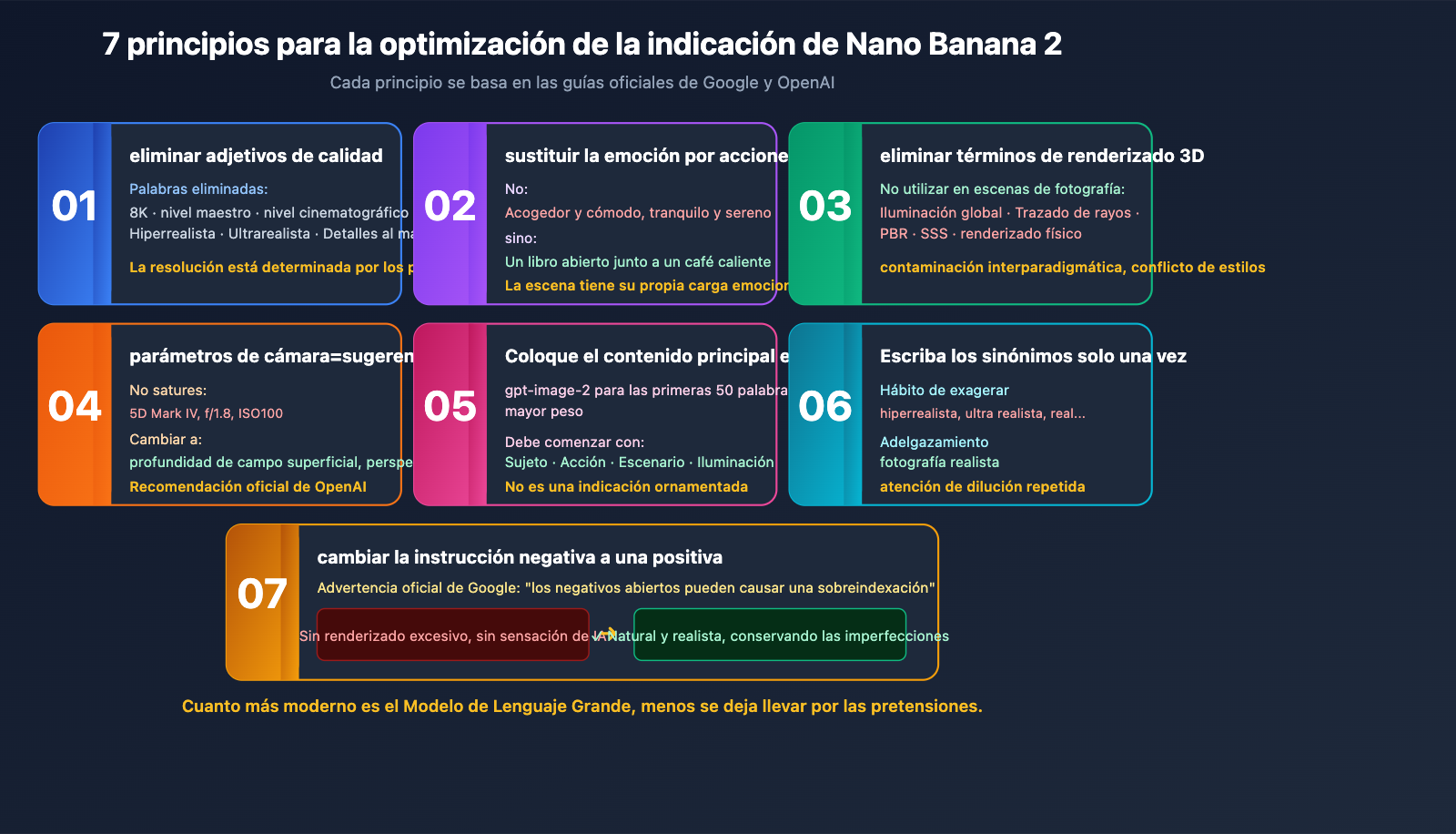

III. 7 principios para reducir indicaciones en la era de Nano Banana 2 y gpt-image-2

A continuación, presento 7 principios validados por la documentación oficial de Google, OpenAI y mucha práctica, ordenados por importancia.

3.1 Principio uno: Eliminar todos los adjetivos de calidad

Lista de términos que se pueden eliminar de forma segura:

8K ultra HD/4K/HDmasterpiece/best quality/maestríaextremadamente realista/hiperrealistacinematográfico(a menos que se refiera realmente al formato de cine)detalles al máximo/ultra detallado/alto detalleavanzado/profesional(sin un objeto específico)

Estos términos eran etiquetas para invocar distribuciones de conjuntos de entrenamiento en la era de SD 1.5; en Nano Banana 2, son ruido semántico. Si realmente necesitas controlar la resolución, hazlo a través de los parámetros de solicitud de la API, no en la indicación.

3.2 Principio dos: Nano Banana 2 prefiere acciones concretas, no emociones vagas

❌ Acumulación de palabras emocionales:

Cálido y acogedor, tranquilo y pacífico, lleno de vida, soñador y hermoso, paz en el tiempo

✅ Escenario concreto:

Media taza de café humeante sobre una mesa de madera vieja, al lado un libro abierto,

con la luz del sol entrando en ángulo por la ventana proyectando manchas suaves en las páginas.

El modelo deduce naturalmente la emoción a partir del escenario concreto, no necesitas decirle explícitamente que sea "acogedor".

3.3 Principio tres: Eliminar todos los términos de renderizado 3D (a menos que hagas renderizado 3D real)

En escenas fotográficas/realistas, los siguientes términos son contaminación entre paradigmas: provienen del campo del renderizado 3D y no pertenecen al lenguaje fotográfico:

Iluminación global/GITrazado de rayos/ray tracingRenderizado de luz física realSSS/subsurface scatteringMateriales PBR

Incluir estos términos en una indicación de estilo fotográfico equivale a obligar al modelo a alternar entre dos distribuciones de estilo; el resultado suele ser ni una foto ni un renderizado.

3.4 Principio cuatro: Los parámetros de cámara son para composición, no para simulación física

Guía oficial de OpenAI: "Las especificaciones detalladas de la cámara pueden interpretarse libremente, así que úsalas principalmente para el aspecto general y la composición, en lugar de para una simulación física exacta."

Traducción: si escribes Canon 5D Mark IV, f/1.8, el modelo no simulará realmente las características del CMOS de esta cámara ni la fórmula de profundidad de campo de f/1.8. Solo reconocerá dos señales: "Probablemente una foto profesional" + "Profundidad de campo reducida".

Siendo así, es más eficiente escribir directamente la intención de composición:

❌ Acumular modelos de cámara:

Disparo con Canon 5D Mark IV, apertura f/1.8, lente de 50mm, ISO 100, formato RAW

✅ Expresar la intención de composición:

Profundidad de campo reducida, sujeto claro con fondo desenfocado, perspectiva de retrato

La longitud se reduce de 32 a 18 palabras, y el modelo lo entiende con mayor precisión.

3.5 Principio cinco: Coloca la información central en las primeras 50 palabras de gpt-image-2

OpenAI indica explícitamente que gpt-image-2 otorga mayor peso a las primeras 50 palabras. Esto significa que el inicio de la indicación debe contener la "información más importante" (sujeto, acción, escenario), no los "adornos más llamativos" (palabras de calidad, estilo, marca).

❌ Desajuste de peso (adornos al principio):

8K ultra HD, calidad cinematográfica magistral, fotografía profesional con Canon 5D Mark IV,

una mujer con vestido blanco parada junto al mar...

Las primeras 50 palabras son palabras vacías; el sujeto real ("mujer, vestido blanco, mar") queda relegado después de las 50 palabras.

✅ Optimización de peso (sujeto al principio):

Una mujer con vestido blanco parada sobre rocas junto al mar, mirando hacia el horizonte,

el viento mueve su cabello largo, luz dorada del atardecer golpeando desde atrás, profundidad de campo reducida.

Las primeras 50 palabras contienen el sujeto, la acción, el escenario, la iluminación y la composición; todas las señales clave están en la zona de alto peso.

3.6 Principio seis: Nano Banana 2 no necesita sinónimos repetidos

Una característica típica de las indicaciones exageradas es el miedo a que el modelo no entienda, escribiendo el mismo significado 3 veces:

Extremadamente realista, hiperrealista, estilo de fotografía real, vívido, textura real

La capacidad de comprensión semántica de Nano Banana 2 supera con creces a la de SD 1.5; puede extraer la intención perfectamente desde una sola descripción. Repetir sinónimos solo sirve para:

- Diluir la atención.

- Consumir el presupuesto de tokens.

- Hacer que la indicación parezca poco profesional.

Principio: Un concepto se expresa una sola vez, usando la palabra más precisa.

3.7 Principio siete: Reescribir instrucciones negativas en positivas

Las indicaciones exageradas suelen contener instrucciones negativas como "sin renderizado excesivo, sin sensación de IA, sin distorsión, sin deformación". La guía oficial de Google Gemini 3 advierte explícitamente:

"Las instrucciones negativas demasiado amplias pueden hacer que el modelo se enfoque excesivamente en esa instrucción y no realice la lógica básica… reemplace las negativas generales con una dirección positiva explícita."

En resumen: en lugar de decirle al modelo "qué no hacer", dile "qué hacer".

| ❌ Instrucción negativa | ✅ Reescribir en positivo |

|---|---|

| Sin renderizado excesivo | Estilo fotográfico natural y realista |

| Sin sensación de IA | Textura fotográfica real, conservando imperfecciones naturales |

| Sin deformación | Proporciones precisas, estructura de dedos natural |

| Sin texto | Imagen puramente visual, sin elementos de texto |

| No caricatura | Estilo de fotografía realista |

IV. Análisis práctico de la optimización de indicaciones: Nano Banana 2 vs. gpt-image-2

4.1 Escenario 1: Fotografía de interiores

Versión exagerada (115 palabras):

极致写实的室内空间,大师级光影美学,自然光透过大幅落地窗温柔洒入,

柔和的明暗对比,细腻的光影层次,丁达尔光效,真实物理光影渲染,

全局光照,软阴影,高细节质感,8K 超高清,电影级画质,

逼真材质纹理,干净通透的空间氛围,专业室内摄影,

佳能 5D Mark IV 拍摄,f/1.8 光圈,真实质感,无过度渲染,

高级简约,舒适温馨,细节丰富。

Versión optimizada (58 palabras):

Sala de estar de estilo minimalista, ventanales grandes, luz natural entrando en ángulo,

sofá de lino gris claro, suelo de madera, una planta verde en la esquina.

Profundidad de campo baja, sujeto nítido, fondo suavemente desenfocado.

El rendimiento de la indicación optimizada en gemini-3-pro-image-preview muestra mejoras en todos los indicadores:

| Dimensión | Versión exagerada | Versión optimizada |

|---|---|---|

| Cantidad de tokens | ~180 | ~65 |

| Claridad del sujeto | Media | Alta |

| Naturalidad de la luz | Media (se ve artificial) | Alta |

| Consistencia de estilo | Baja (conflicto de estilos) | Alta |

| Estabilidad de salida | Baja | Alta |

4.2 Escenario 2: Fotografía de retrato

Versión exagerada:

超写实,8K 高清,大师级人像摄影,电影级画质,

佳能 EOS R5 拍摄,85mm f/1.2 定焦镜头,柔光箱打光,

全局光照,软阴影,逼真皮肤质感,细节丰富,

专业修图,杂志封面级别,极致写实,真实摄影

一位年轻女性...

(El sujeto queda relegado después de las 50 palabras)

Versión optimizada:

Mujer de 25 años, cabello negro liso hasta los hombros, ojos castaños oscuros,

viste un suéter de punto color crema, sentada de lado junto a una mesa de madera en una cafetería,

sostiene un café latte caliente con ambas manos, sonriendo hacia la ventana.

Luz suave desde la izquierda sobre el rostro, poca profundidad de campo,

fondo con luces cálidas de la tienda desenfocadas.

El sujeto, la acción, la iluminación y la composición; todas las señales importantes están dentro de las primeras 50 palabras.

4.3 Escenario 3: Imagen de producto para comercio electrónico

Versión exagerada:

8K 超高清产品摄影,大师级工业设计美学,完美光影,

电影级画质,极致写实,高级质感,专业商业摄影,

哈苏中画幅相机拍摄,一瓶香水...

Versión optimizada:

Frasco de perfume de vidrio transparente, cuerpo cuadrado, atomizador dorado,

etiqueta negra con letras doradas "AURA" en el frasco.

Fondo blanco sin costuras, luz suave desde arriba, reflejos claros en los laterales.

Composición centrada, el producto ocupa el 60% de la imagen.

Nota que la versión optimizada utiliza comillas para "AURA": esta es la forma de activar el renderizado de texto de alta fidelidad en Nano Banana 2, mucho más efectivo que escribir "tiene un logotipo de marca".

💡 Consejo de ingeniería: En entornos de producción, recomendamos desplegar una "capa intermedia de optimización de indicaciones" a través de APIYI (apiyi.com), utilizando Gemini 3 Pro o Claude 4 para identificar y comprimir automáticamente los términos exagerados antes de enviarlos al modelo de imagen. Esto mantiene la compatibilidad de la interfaz de negocio y mejora uniformemente la calidad de las imágenes generadas.

V. Límites técnicos de la optimización de indicaciones en Nano Banana 2 y gpt-image-2

Aunque el principio de optimización es efectivo, tiene límites. Aquí hay excepciones a considerar.

5.1 ¿Cuándo se deben conservar los "términos de estilo"?

No todos los adjetivos son ruido. Debes conservar los términos de estilo que tengan una distribución visual clara:

| ✅ Términos de estilo a conservar | Razón |

|---|---|

| Estilo Art Déco | Tiene un vocabulario visual definido |

| Estilo de animación Ghibli | El modelo ha aprendido esta distribución |

| Textura de película de los 80 | Puede activar un estilo de color específico |

| Estética Vaporwave | Tiene una definición visual clara |

| Claroscuro | Técnica artística bien definida |

La diferencia radica en que estos términos corresponden a géneros artísticos o técnicas visuales concretas, no a evaluaciones vacías como "nivel maestro".

5.2 ¿Cuándo es necesario escribir detalladamente?

En los siguientes escenarios se requieren indicaciones más largas, pero recuerda: largo no significa exagerado:

- Generación de infografías: Se requiere describir la posición, el contenido textual y el color de cada módulo.

- Consistencia de múltiples personajes: Se requiere describir los detalles físicos de cada personaje.

- Composición compleja: Qué hay en el primer plano, plano medio y fondo.

- Material de marca: Se requiere una posición precisa del logotipo, contenido de texto y combinación de colores.

Incluso en estos casos, las instrucciones concretas son siempre superiores a la acumulación de adornos.

5.3 Ejemplo de invocación de API: Llamando a Nano Banana 2 con una indicación optimizada

A continuación, un código de ejemplo mínimo para llamar a Nano Banana 2 en APIYI (apiyi.com):

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1"

)

prompt = """Mujer de 25 años, cabello negro liso hasta los hombros, ojos castaños oscuros,

viste un suéter de punto color crema, sentada de lado junto a una mesa de madera en una cafetería,

sostiene un café latte caliente con ambas manos, sonriendo hacia la ventana.

Luz suave desde la izquierda sobre el rostro, poca profundidad de campo,

fondo con luces cálidas de la tienda desenfocadas."""

response = client.chat.completions.create(

model="gemini-3-pro-image-preview",

messages=[{"role": "user", "content": prompt}]

)

La base_url utiliza uniformemente https://api.apiyi.com/v1, y el ID del modelo coincide con el oficial. La conexión directa garantiza que veas el rendimiento real de la interfaz oficial: las indicaciones optimizadas funcionan igual de bien tanto en la API oficial como en APIYI.

5.4 Comparativa de sensibilidad a términos exagerados según el modelo

| Modelo | Paradigma de entrenamiento | Sensibilidad a términos exagerados | Estilo de indicación recomendado |

|---|---|---|---|

| Stable Diffusion 1.5 | Etiquetas Danbooru | Baja (incluso beneficioso) | Acumulación de etiquetas |

| Stable Diffusion XL | Mixto | Media | Mixto |

| Stable Diffusion 3.5 | Caption en lenguaje natural | Alta | Lenguaje natural |

| DALL-E 3 | Caption de GPT | Alta | Descripción narrativa |

| gpt-image-2 | LLM multimodal | Alta | Narrativa + instrucciones concretas |

| Nano Banana 2 | Gemini 3.1 Flash | Alta | Narrativa + 5 elementos de escena |

| Nano Banana Pro | Gemini 3 Pro | Muy alta | Narrativa concisa y precisa |

Conclusión: Cuanto más moderno es el modelo, menos necesita de los adornos exagerados.

VI. FAQ: Preguntas frecuentes sobre las indicaciones para Nano Banana 2 y gpt-image-2

P1: Mis indicaciones anteriores para SD 1.5 no funcionan bien en Nano Banana 2, ¿cómo puedo migrarlas rápidamente?

La forma más sencilla: convierte todas las etiquetas separadas por comas en un párrafo de lenguaje natural, elimina todas las palabras de calidad (8K/obra maestra/mejor calidad) y simplifica los parámetros de la cámara a intenciones de composición (cambia "f/1.8" por "profundidad de campo reducida"). A través de APIYI (apiyi.com), puedes usar el mismo código para invocar tanto SD como Nano Banana 2 y realizar comparaciones, lo que facilita la validación de la migración.

P2: ¿Realmente no sirve de nada incluir "8K"?

En Nano Banana 2, la resolución está determinada por los parámetros de la API (512/1K/2K/4K); el "8K" en la indicación no mejora la resolución real ni tiene una distribución de entrenamiento correspondiente. Se recomienda eliminarlo por completo y especificar explícitamente 2K o 4K en los parámetros de la API.

P3: ¿Debo incluir marcas de cámaras como Canon 5D o cámaras de formato medio Hasselblad?

Puedes incluirlas ocasionalmente, pero con moderación. Escribir "Hasselblad" hará que el modelo se incline hacia un estilo más comercial o de moda, mientras que "GoPro" lo orientará hacia un gran angular dinámico; esto es una sugerencia de estilo, no una simulación física. Elige solo 1 sugerencia de cámara relevante por imagen, no las acumules.

P4: Cuando uso gpt-image-2 para generar imágenes de productos, escribir "premium, lujoso, artesanía extrema" no da buenos resultados, ¿qué puedo hacer?

Sustituye los adjetivos abstractos por instrucciones visuales concretas. "Lujoso" → "fondo con textura de mármol oscuro, reflejos de metal dorado"; "Premium" → "composición minimalista, fondo limpio, luz cenital suave"; "Artesanía extrema" → "superficie sin defectos, líneas de borde claras, costuras uniformes". Mediante la integración de gpt-image-2 en APIYI (apiyi.com), puedes iterar y probar rápidamente las diferencias de resultados entre varias instrucciones específicas.

P5: Si reduzco la indicación, ahorro tokens, pero ¿afectará a la estabilidad?

Al contrario, la estabilidad mejorará. Dado que en una indicación corta cada palabra tiene una instrucción semántica clara, el modelo concentra mejor su atención. Las indicaciones exageradas, debido a la repetición de sinónimos y conflictos de estilo, obligan al modelo a hacer concesiones en diferentes direcciones en cada generación, lo que resulta inestable.

P6: ¿Existe alguna herramienta para reescribir automáticamente las indicaciones exageradas a una versión optimizada?

Puedes usar Gemini 3 Pro o Claude 4 Sonnet para crear un Agente Refinador de Indicaciones, configurando la instrucción del sistema como: "Identifica y elimina todas las palabras de calidad vacías de significado, sinónimos repetidos y términos de renderizado fuera de contexto, manteniendo solo las descripciones concretas del sujeto, la acción, la escena y la iluminación". En APIYI (apiyi.com) puedes invocar estos Modelos de Lenguaje Grande con un solo clic para el preprocesamiento de tus indicaciones.

VII. Conclusión: El nuevo consenso sobre las indicaciones en la era de Nano Banana 2

Volviendo a la indicación exagerada de 115 palabras del principio, ahora sabemos que su problema no es que sea "demasiado detallada", sino que se desperdiciaron palabras en los lugares equivocados:

- Exageración ≠ Detalle: Una descripción realmente detallada se refiere a elementos visuales concretos, no a la acumulación de adjetivos de calidad.

- Nano Banana 2 no procesa el "8K": La resolución se define mediante parámetros de API; acumular "8K, 4K, ultra alta definición" en la indicación no tiene sentido.

- Los parámetros de cámara son sugerencias, no simulaciones: Escribir "f/1.8" no simulará realmente las propiedades ópticas de un f/1.8; es más eficiente escribir "profundidad de campo reducida".

- La repetición de sinónimos es ruido: Expresa cada concepto una vez con la palabra más precisa.

- Convierte las instrucciones negativas en positivas: Cambia "no hagas X" por "haz Y".

- Coloca lo esencial en las primeras 50 palabras: gpt-image-2 otorga mayor peso al inicio de la indicación.

- Elimina los términos de renderizado 3D: Las escenas fotográficas no necesitan iluminación global ni trazado de rayos.

La generación de imágenes por IA en 2026 ha entrado en la era del "lenguaje natural = indicación". Los modelos modernos como Nano Banana 2, gpt-image-2 y Nano Banana Pro recompensan las descripciones de escenas claras, no las listas de adjetivos pomposos.

Recomendamos que, a partir de hoy, realices una "revisión de optimización" cada vez que escribas una indicación: elimina todas las palabras que, al quitarlas, no afecten la comprensión visual. Lo que quede será la señal real que dirige al modelo. Al utilizar la capacidad de acceso unificado a modelos de imagen principales como Nano Banana 2, gpt-image-2 y Nano Banana Pro que ofrece APIYI (apiyi.com), puedes realizar pruebas A/B de bajo costo con varias versiones optimizadas de tus indicaciones y construir rápidamente tu propia biblioteca de activos.

Sobre el autor: El equipo técnico de APIYI, dedicado a proporcionar servicios de acceso a API de Modelos de Lenguaje Grande estables, transparentes y completos para desarrolladores. Visita el sitio web oficial de APIYI en apiyi.com para conocer las últimas soluciones de acceso y las mejores prácticas de indicaciones para modelos de imagen como Nano Banana 2, gpt-image-2, Gemini 3 Pro y más.