Nota del autor: Resumen del estado actual de GPT Image 2 a fecha de 17/04/2026: aún no se ha lanzado oficialmente, se encuentra en fase de pruebas beta en LM Arena, se han filtrado 3 modelos con nombre en clave y se esperan 5 mejoras clave que podrían superar a Nano Banana Pro.

«¿Ya salió GPT Image 2?» es la pregunta que más hemos escuchado en el mundo de la IA estas últimas dos semanas. A fecha de 17/04/2026, aquí tienes el resumen completo: La respuesta es «todavía no». OpenAI no ha lanzado públicamente gpt-image-2; el modelo se encuentra actualmente en fase de pruebas beta en LM Arena y en pruebas A/B internas de ChatGPT. Este artículo recopila los modelos con nombre en clave conocidos, las 5 capacidades reveladas, la ventana de lanzamiento prevista, la comparativa a ciegas con Nano Banana Pro y cómo los desarrolladores pueden prepararse para la integración de la API.

Valor principal: Entiende en 3 minutos el estado real de GPT Image 2, evita caer en titulares sensacionalistas y toma decisiones más precisas sobre la selección de modelos de imagen para los próximos 1 o 2 meses.

Resumen del estado de GPT Image 2

| Dimensión | Estado actual (17/04/2026) |

|---|---|

| Lanzamiento oficial | ❌ No lanzado, sin anuncios oficiales de OpenAI |

| Disponibilidad de API | ❌ No disponible, sin endpoint o alias gpt-image-2 |

| Versión actual | ✅ GPT Image 1.5 (lanzado en dic. 2025) sigue siendo la última pública |

| Formato de prueba | 🔬 Beta en LM Arena + pruebas A/B internas en ChatGPT |

| Ventana de lanzamiento | 📅 Finales de abril a mediados de mayo de 2026 |

La brecha entre los rumores y la realidad

Las redes sociales están inundadas de titulares como «GPT Image 2 ya está disponible» o «supera a Nano Banana Pro», pero la realidad es otra:

- No hay ninguna entrada para GPT Image 2 en la página de modelos de OpenAI.

- No hay ninguna ruta

gpt-image-2en la documentación de la API (platform.openai.com). - Los desarrolladores no pueden obtener acceso a la API a través de ningún canal oficial.

- La mayoría de los usuarios de ChatGPT no ven resultados de GPT Image 2.

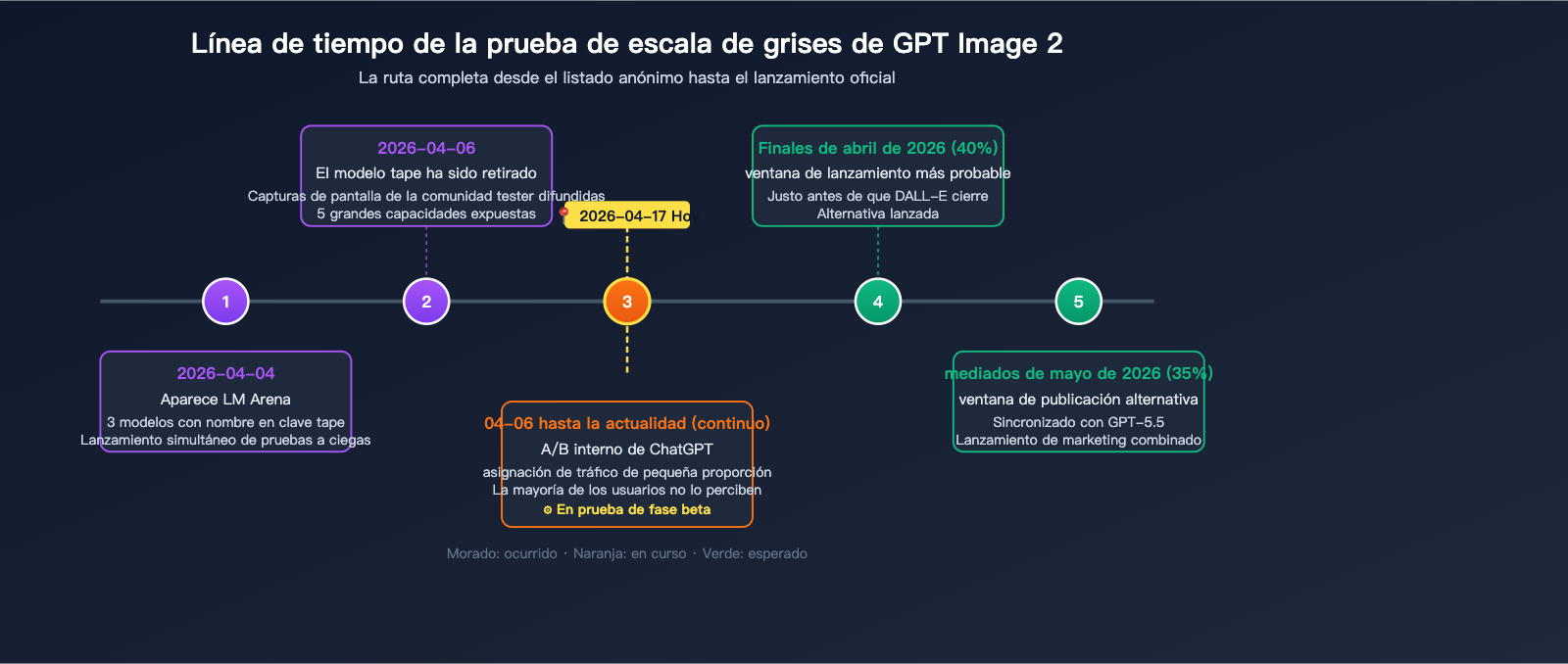

Entonces, ¿por qué se dice que ya se ha lanzado? Porque OpenAI incluyó brevemente 3 modelos anónimos en LM Arena, que la comunidad identificó como posibles versiones de GPT Image 2. Ese es el origen de la filtración de la «fase de pruebas beta».

Prueba de escala de grises de GPT Image 2: Revelación de tres modelos con nombre en clave

La serie "tape" en LM Arena

El 4 de abril de 2026, tres modelos anónimos aparecieron simultáneamente en la categoría de generación de imágenes de LM Arena, utilizando una convención de nombres basada en "cinta adhesiva" (tape):

| Nombre en clave | Fecha de aparición | Características supuestas | Estado actual |

|---|---|---|---|

packingtape-alpha |

04-04-2026 | Generación de imágenes general | Retirado |

maskingtape-alpha |

04-04-2026 | Optimización de renderizado de texto | Retirado |

gaffertape-alpha |

04-04-2026 | Renderizado de escenas complejas | Retirado |

Estos tres modelos fueron retirados de LM Arena pocas horas después de su aparición, pero los evaluadores de la comunidad ya habían capturado una gran cantidad de muestras mediante capturas de pantalla y grabaciones. El desarrollador Pieter Levels y la inversora Justine Moore fueron los primeros en identificar públicamente estos modelos.

Dos vías de filtración en escala de grises

| Vía | Usuarios alcanzados | Condiciones de activación |

|---|---|---|

| Prueba a ciegas en LM Arena | Todos los usuarios de Arena | Disponible brevemente durante unas horas |

| Prueba A/B en ChatGPT | Algunos usuarios Plus / Pro | Asignación aleatoria en segundo plano, sin identificador visible |

Algunos usuarios de ChatGPT informaron que, al usar GPT Image 1.5 para generar imágenes, ocasionalmente obtenían "resultados notablemente mejores" (renderizado de texto casi perfecto, sin tonos amarillentos). Esto se considera una prueba A/B de tráfico en línea realizada por OpenAI, redirigiendo una pequeña parte de las solicitudes hacia GPT Image 2 para evaluar su rendimiento real.

Sugerencia de observación: Si eres usuario de ChatGPT Plus/Pro, intenta generar imágenes que contengan texto complejo (como capturas de pantalla de interfaces, letreros o carteles) y observa la calidad del resultado. Cuando la calidad sea excepcionalmente alta, es posible que se trate de una creación de GPT Image 2. Una vez que la API esté abierta oficialmente, podrás integrarla y probarla rápidamente en la plataforma APIYI apiyi.com.

Prueba de escala de grises de GPT Image 2: Revelación de 5 mejoras de capacidad

Basado en las muestras recopiladas por los evaluadores de la comunidad durante la breve ventana en LM Arena, GPT Image 2 presenta 5 mejoras significativas en comparación con la versión 1.5:

Mejora 1: Renderizado de texto casi perfecto

La precisión del renderizado de texto en GPT Image 1.5 es de aproximadamente un 90-95%, con errores ocasionales en cadenas largas, etiquetas de interfaz o escenas con sellos/letreros. En la serie de modelos "tape", GPT Image 2 muestra una precisión cercana al 100%, logrando renderizar correctamente incluso títulos largos y complejos, como los de los carteles de NeurIPS.

Mejora 2: Eliminación del "tono amarillento"

El problema del "amarillamiento de toda la imagen" (conocido como yellow cast), que durante mucho tiempo fue una crítica hacia GPT Image 1.5, ha sido completamente eliminado en GPT Image 2. La fidelidad del color alcanza un nivel "indistinguible de una fotografía real".

Mejora 3: Realismo fotográfico

Los evaluadores de LM Arena compararon repetidamente el mismo conjunto de fotos reales; las imágenes generadas por GPT Image 2, como "selfie con Sam Altman" o "campus de Stanford", fueron confundidas con fotografías reales por más del 70% de las personas en pruebas a ciegas.

Mejora 4: Nuevo formato panorámico 16:9

La versión anterior solo admitía las proporciones 1:1, 3:2 y 2:3. GPT Image 2 añade soporte para el formato panorámico 16:9, ideal para portadas de video, diapositivas, banners web y otros escenarios.

Mejora 5: Conocimiento del mundo preciso

Al tratar con puntos de referencia específicos, marcas, controles de interfaz y detalles arquitectónicos, la precisión del "conocimiento del mundo" de GPT Image 2 ha mejorado drásticamente. Por ejemplo, al generar una "captura de pantalla de la página de inicio de YouTube", la posición de los botones, la combinación de colores y el logotipo se restauran casi 1:1.

| Dimensión de mejora | GPT Image 1.5 | GPT Image 2 (Escala de grises) | Grado de mejora |

|---|---|---|---|

| Renderizado de texto | 90-95% preciso | Cerca del 100% | Mejora doble en escenas clave |

| Fidelidad del color | Tono amarillento ocasional | Sin desviaciones de color | Salto de calidad |

| Realismo | Identificable como IA | Difícil de distinguir a ciegas | Tasa de error >70% |

| Relación de aspecto | 1:1, 3:2, 2:3 | Nuevo 16:9 | Mayor cobertura de escenarios |

| Conocimiento del mundo | General | Preciso en UI/lugares/marcas | Mejora significativa |

Nota sobre los datos: El gráfico anterior se basa en muestras de pruebas a ciegas públicas de LM Arena y capturas de pantalla de los evaluadores de la comunidad. Una vez que GPT Image 2 se lance oficialmente, podrá realizar pruebas reales a través de la plataforma APIYI apiyi.com.

Análisis de pruebas en escala de grises de GPT Image 2: Arquitectura y velocidad

Nueva arquitectura de inferencia de un solo paso

Según la validación cruzada de múltiples fuentes independientes, GPT Image 2 utiliza una "arquitectura completamente nueva" que difiere totalmente del pipeline de imágenes de GPT-4o:

| Dimensión | GPT Image 1.5 | GPT Image 2 |

|---|---|---|

| Método de inferencia | Dos etapas (Two-stage) | Un solo paso (Single-pass) |

| Latencia de extremo a extremo | 8-12 segundos | Esperada < 3 segundos |

| Base subyacente | Basado en el pipeline de GPT-4o | Nueva arquitectura independiente |

| Capacidad de concurrencia | Media | Mejora significativa |

La inferencia de un solo paso significa que el modelo completa la composición, la combinación de colores y el renderizado de detalles en un único cálculo hacia adelante, en lugar de generar primero un borrador de baja resolución para luego escalarlo. Esta arquitectura ofrece ventajas tanto en velocidad como en consistencia.

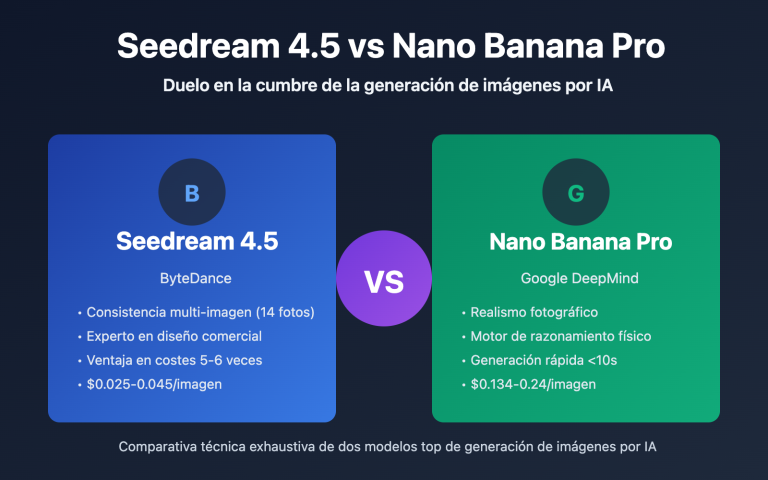

Comparativa a ciegas con Nano Banana Pro

En LM Arena han aparecido múltiples enfrentamientos a ciegas entre la serie "tape" y el Google Nano Banana Pro. Estas son las tasas de victoria resumidas por los evaluadores de la comunidad:

| Dimensión de comparación | Tasa de victoria de GPT Image 2 | Nota |

|---|---|---|

| Renderizado de texto | ~ 75% | Arrasa en escenas con cadenas largas |

| Realismo | ~ 65% | Detalles faciales más naturales |

| Conocimiento del mundo | ~ 60% | Puntos de referencia complejos más precisos |

| Composición creativa | ~ 50% | Ambos están muy igualados |

| Velocidad | ~ 55% | La serie "tape" es más rápida |

Observación de tendencias: Si los datos de la escala de grises se confirman, GPT Image 2 recuperará el primer puesto en el ranking general de modelos de imagen. En ese momento, la plataforma de agregación de modelos APIYI (apiyi.com) permitirá a los desarrolladores cambiar y comparar modelos con un solo clic, evitando la dependencia de un único proveedor.

Prueba beta de GPT Image 2: ¿Por qué este periodo de tiempo?

Tres factores que aceleran a OpenAI

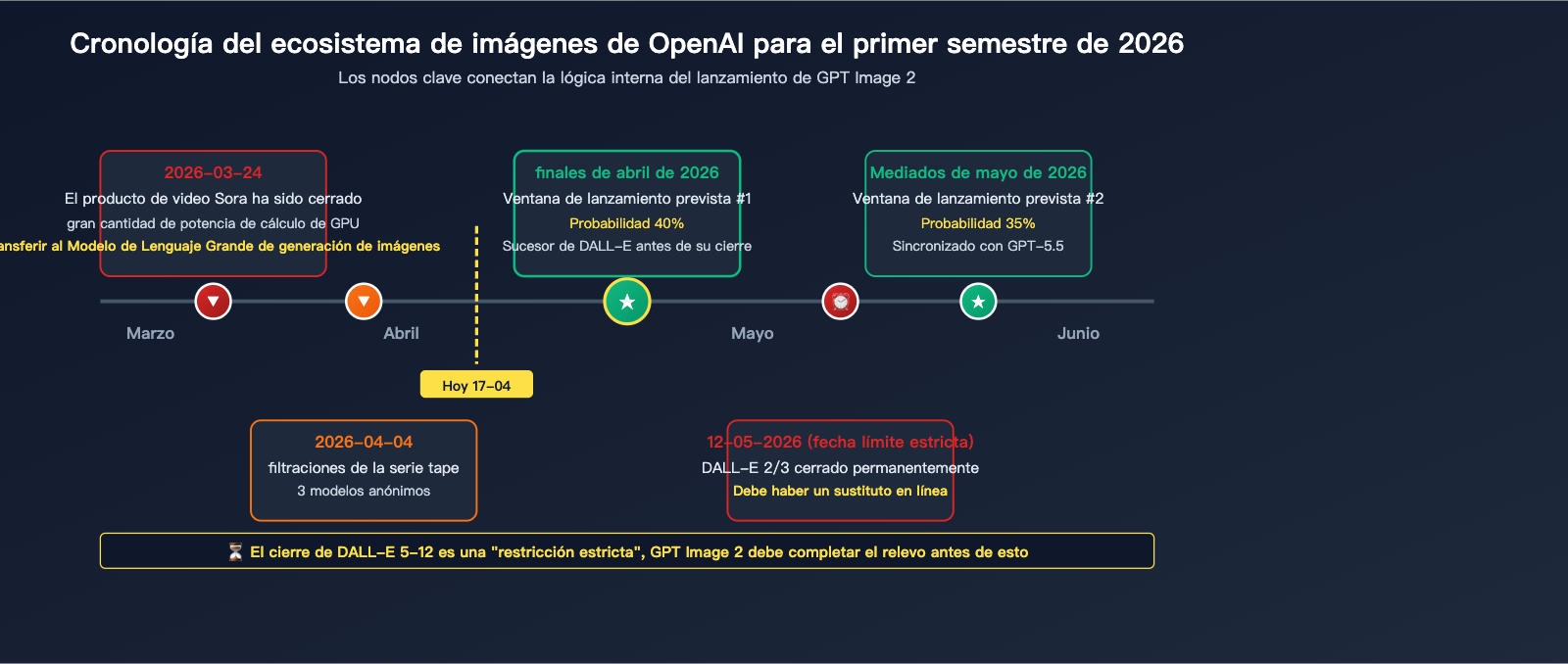

Factor 1: El cierre inminente de DALL-E (12-05-2026)

OpenAI ha anunciado que DALL-E 2/3 cerrará definitivamente el 12 de mayo de 2026. Antes de esa fecha, debe haber un sustituto disponible para evitar dificultades de migración a una gran cantidad de usuarios empresariales y desarrolladores. GPT Image 2 es el sucesor natural.

Factor 2: Liberación de potencia de cómputo tras el cierre de Sora (24-03-2026)

El producto de generación de video Sora fue retirado el 24 de marzo de 2026, liberando una gran cantidad de recursos de cómputo GPU. Se especula que esta capacidad se está utilizando para finalizar el entrenamiento y realizar la prueba beta a gran escala de GPT Image 2.

Factor 3: Presión competitiva

Google Nano Banana Pro ha ganado cuota de mercado en la generación de imágenes desde finales de 2025, y las ventajas de GPT Image 1.5 se han ido reduciendo o incluso superando. OpenAI necesita lanzar una versión más potente en la primera mitad de 2026 para consolidar su posición.

Periodo de lanzamiento esperado

Considerando los factores anteriores y el ritmo histórico de lanzamientos, la comunidad predice lo siguiente:

| Probabilidad | Periodo de lanzamiento | Razón |

|---|---|---|

| Alta (40%) | Finales de abril de 2026 | Antes del cierre de DALL-E |

| Media (35%) | Mediados de mayo de 2026 | Lanzamiento simultáneo con GPT-5.5 |

| Baja (20%) | Junio de 2026 | Problemas detectados en la prueba beta |

| Muy baja (5%) | Después del T3 de 2026 | Problemas críticos de arquitectura |

Prueba beta de GPT Image 2: Cómo prepararse como desarrollador

Preparación 1: Mantener el código de invocación de GPT Image 1.5

Al inicio del lanzamiento, los precios de la API suelen ser altos y las cuotas limitadas. Se recomienda mantener el código de integración actual de GPT Image 1.5 como alternativa (fallback):

import openai

import os

client = openai.OpenAI(

api_key=os.environ["API_KEY"],

base_url="https://vip.apiyi.com/v1"

)

response = client.images.generate(

model="gpt-image-1.5", # Versión pública actual

prompt="A futuristic city at sunset with neon signs",

size="1024x1024"

)

print(response.data[0].url)

Preparación 2: Abstraer la capa de invocación del modelo

Encapsula la llamada de generación de imágenes en un módulo independiente para facilitar el cambio a GPT Image 2 con una sola línea de código en el futuro:

class ImageGenerator:

"""Capa de abstracción para generación de imágenes con cambio rápido entre modelos"""

DEFAULT_MODEL = "gpt-image-1.5"

BACKUP_MODELS = ["gemini-3-pro-image-preview", "dall-e-3"]

def __init__(self, model: str = None):

self.model = model or self.DEFAULT_MODEL

self.client = openai.OpenAI(

api_key=os.environ["API_KEY"],

base_url="https://vip.apiyi.com/v1"

)

def generate(self, prompt: str, size: str = "1024x1024") -> str:

try:

resp = self.client.images.generate(

model=self.model, prompt=prompt, size=size

)

return resp.data[0].url

except Exception:

# Fallback automático a modelos de respaldo

for backup in self.BACKUP_MODELS:

try:

resp = self.client.images.generate(

model=backup, prompt=prompt, size=size

)

return resp.data[0].url

except Exception:

continue

raise

# Una vez que GPT Image 2 esté disponible, solo cambia el nombre del modelo

gen = ImageGenerator(model="gpt-image-2") # Migración en una línea

Preparación 3: Monitorear las noticias de lanzamiento

Puedes seguir las novedades sobre el lanzamiento de GPT Image 2 a través de estos canales:

| Canal | Tipo | Tiempo de aviso habitual |

|---|---|---|

| Blog oficial de OpenAI | Canal principal | Día del lanzamiento |

| Cuenta de X de Sam Altman | Anticipación | 1-2 días antes |

| Documentación de platform.openai.com | Indicador de disponibilidad API | Lanzamiento simultáneo |

| Tabla de clasificación LM Arena | Aparición del modelo | Varios días antes |

Consejo de acceso anticipado: Una vez que OpenAI lance oficialmente GPT Image 2, APIYI (apiyi.com) suele completar la integración en 24 horas y ofrecer cuotas de prueba, permitiendo a los desarrolladores experimentar con el nuevo modelo de inmediato sin gestionar la autenticación de la API de OpenAI ni las solicitudes de cuota.

Preguntas frecuentes

Q1: He visto comentarios diciendo que GPT Image 2 ya se ha lanzado, ¿es cierto?

No. A fecha de 17 de abril de 2026, OpenAI no ha realizado ningún anuncio oficial. Los rumores sobre un supuesto "lanzamiento" provienen de tres modelos anónimos de la serie "tape" que aparecieron brevemente en LM Arena antes de ser retirados, así como de un pequeño grupo de usuarios que tuvieron acceso durante pruebas A/B internas en ChatGPT. Todo esto son "filtraciones de pruebas beta", no un lanzamiento oficial.

Q2: ¿Puedo invocar GPT Image 2 a través de la API ahora mismo?

No. La documentación oficial de la API de OpenAI no incluye el ID de modelo gpt-image-2; cualquier canal que afirme que "ya se puede invocar GPT Image 2 vía API" está difundiendo información falsa. El modelo de imagen de OpenAI disponible actualmente sigue siendo GPT Image 1.5. Puedes seguir las últimas actualizaciones sobre el lanzamiento de modelos en APIYI apiyi.com para obtener acceso a la invocación del modelo tan pronto como esté disponible.

Q3: ¿Pueden los usuarios de ChatGPT utilizar GPT Image 2 durante las pruebas beta?

Es posible que algunos usuarios lo hayan "utilizado" sin saberlo. OpenAI realiza frecuentemente asignaciones de tráfico A/B dentro de ChatGPT, redirigiendo una pequeña proporción de solicitudes a nuevos modelos para evaluar su rendimiento real. En estos casos, el usuario sigue viendo la interfaz de GPT Image 1.5, pero la generación es realizada realmente por GPT Image 2. Si has notado que la calidad de las imágenes generadas en ChatGPT ha sido excepcionalmente buena últimamente, es posible que hayas sido asignado al grupo de prueba A/B.

Q4: ¿Son fiables las fechas de lanzamiento previstas?

Las predicciones tienen fundamento, pero no son absolutas. La comunidad basa sus pronósticos principales en tres factores determinantes: el cierre de DALL-E 2/3 programado para el 12-05-2026 (debe haber un sustituto), el cierre de Sora el 24-03-2026 para liberar capacidad de cómputo, y la presión competitiva de Nano Banana Pro. Se estima que la mayor probabilidad se sitúa entre finales de abril y mediados de mayo, aunque el ritmo real de OpenAI depende de los resultados de sus evaluaciones internas, por lo que existen variables.

Q5: ¿Será muy caro GPT Image 2 cuando se lance?

El precio inicial suele ser superior al de la versión 1.5 (siguiendo patrones históricos, podría ser entre un 30% y un 50% más alto), pero irá disminuyendo a medida que se optimice la capacidad de cómputo. Recomendamos realizar la invocación del modelo a través de plataformas de agregación como APIYI apiyi.com una vez que se lance oficialmente; esto permite disfrutar de una facturación unificada, pago por uso y la comodidad de no requerir recargas previas, evitando así la inmovilización de capital que supone la contratación directa a precios iniciales elevados.

Resumen

Estado real de GPT Image 2 a fecha de 17-04-2026:

- Sin lanzamiento oficial: No hay API ni anuncios oficiales; la versión pública más reciente sigue siendo GPT Image 1.5.

- En pruebas beta: Tres modelos con nombre en clave "tape" aparecieron brevemente en LM Arena, sumado a pruebas A/B internas en ChatGPT.

- 5 mejoras de capacidad: Avances integrales en renderizado de texto, color, realismo, relación de aspecto y conocimiento del mundo.

- Innovación arquitectónica: Cambio de un proceso de dos etapas a inferencia de un solo paso, con una mejora de velocidad estimada de hasta 3 veces.

- Ventana de expectativas: Mayor probabilidad de lanzamiento entre finales de abril y mediados de mayo, impulsado por la fecha de cierre de DALL-E.

Para los desarrolladores interesados en GPT Image 2, recomendamos mantener la integración actual con GPT Image 1.5, abstraer la capa de invocación del modelo con antelación y seguir de cerca los canales de comunicación oficiales.

Recomendamos utilizar plataformas de agregación de modelos como APIYI apiyi.com, que suelen completar la integración en las 24 horas posteriores al lanzamiento y ofrecen cuotas de prueba, ahorrándote el complejo proceso de solicitar cuotas individuales a OpenAI y permitiéndote obtener capacidad de invocación de GPT Image 2 de inmediato.

📚 Referencias

-

Página oficial de modelos de OpenAI: Verifique la lista de modelos disponibles actualmente.

- Enlace:

platform.openai.com/docs/models - Nota: A la fecha de redacción de este artículo, no existe ninguna entrada para gpt-image-2.

- Enlace:

-

Tabla de clasificación de LM Arena: Seguimiento en tiempo real de las evaluaciones de modelos de imagen.

- Enlace:

lmarena.ai/leaderboard - Nota: La serie de modelos tape ha sido retirada, pero los datos históricos siguen disponibles para consulta.

- Enlace:

-

Anuncio de cierre de DALL-E: Verifique la fecha límite del 12 de mayo de 2026.

- Enlace:

help.openai.com/en/articles - Nota: La fecha de cierre es un criterio clave para predecir la ventana de lanzamiento de GPT Image 2.

- Enlace:

-

Actualizaciones de modelos de APIYI: Acceso rápido para desarrolladores locales a nuevos modelos.

- Enlace:

help.apiyi.com - Nota: Incluye la documentación actual para la invocación de GPT Image 1.5 y los planes de integración futuros para GPT Image 2.

- Enlace:

Autor: Equipo técnico de APIYI

Intercambio técnico: Te invitamos a discutir tus expectativas y necesidades reales para GPT Image 2 en la sección de comentarios. Para más actualizaciones sobre modelos, visita el centro de documentación de APIYI en docs.apiyi.com.