Por solo $10 al mes, puedes acceder a tres modelos de codificación de código abierto de primer nivel: GLM-5, Kimi K2.5 y MiniMax M2.5. El plan OpenCode GO parece muy atractivo. Pero, ¿realmente vale la pena? ¿Son suficientes los límites? ¿Qué es más rentable comparado con el plan de codificación de Alibaba Cloud o una API genérica?

Valor central: Este artículo analizará el plan OpenCode GO desde cuatro dimensiones: límites, calidad del modelo, restricciones de uso y alternativas, para ayudarte a tomar una decisión en 5 minutos.

Vista rápida de la información central del plan OpenCode GO

¿Qué es OpenCode GO?

OpenCode es uno de los agentes de IA de código abierto de más rápido crecimiento en 2026, obteniendo 30K+ Stars en GitHub en un mes. Su característica central es el código abierto + soporte multi-modelo—puedes integrar más de 75 proveedores de LLM, incluyendo OpenAI, Anthropic, DeepSeek, entre otros.

OpenCode GO es un plan de suscripción de bajo costo de $10/mes lanzado oficialmente por OpenCode, actualmente en fase Beta. Está dirigido a desarrolladores globales, especialmente programadores que no quieren gastar mucho en Claude Max o ChatGPT Pro.

Resumen de parámetros del plan OpenCode GO

| Parámetro | Detalles |

|---|---|

| Tarifa mensual | $10/mes |

| Modelos incluidos | GLM-5, Kimi K2.5, MiniMax M2.5 |

| Límite de 5 horas | $12 en uso equivalente |

| Límite semanal | $30 en uso equivalente |

| Límite mensual | $60 en uso equivalente |

| Nodos del servidor | EE. UU., Europa, Singapur |

| Estado actual | En pruebas Beta |

| Política de cancelación | Cancelar en cualquier momento |

| Modelo gratuito | Big Pickle (200 solicitudes/5 horas) |

Hallazgo clave: Los límites de OpenCode GO no se calculan por número de solicitudes, sino por uso equivalente en dólares—$12 cada 5 horas, $30 semanales, $60 mensuales. Debido a los diferentes precios por unidad de los tres modelos, el número real de solicitudes disponibles varía enormemente.

Desglose de los límites reales de los tres modelos de OpenCode GO

Diferencias en los límites de cada modelo

Dado que OpenCode GO utiliza un sistema de facturación basado en "créditos en dólares", donde cada solicitud tiene un costo diferente según el modelo, la cantidad real de usos disponibles varía enormemente:

| Modelo | Límite por 5 horas | Límite semanal | Límite mensual | Capacidad de codificación |

|---|---|---|---|---|

| MiniMax M2.5 | ~20,000 solicitudes | ~50,000 solicitudes | ~100,000 solicitudes | SWE-Bench 80.2% |

| Kimi K2.5 | ~1,850 solicitudes | ~4,630 solicitudes | ~9,250 solicitudes | SWE-Bench 76.8% |

| GLM-5 | ~1,150 solicitudes | ~2,880 solicitudes | ~5,750 solicitudes | SWE-Bench 77.8% |

Punto clave: El costo por solicitud de MiniMax M2.5 es extremadamente bajo, por lo que su límite mensual alcanza las 100,000 solicitudes, lo cual es más que suficiente para la gran mayoría de desarrolladores. Sin embargo, GLM-5 solo ofrece 5,750 solicitudes al mes, lo que podría no ser suficiente para un uso intensivo.

Comparativa de capacidades de codificación de los tres modelos

| Dimensión de capacidad | GLM-5 | Kimi K2.5 | MiniMax M2.5 |

|---|---|---|---|

| SWE-Bench Verified | 77.8% | 76.8% | 80.2% |

| AIME Matemáticas | 84% | — | — |

| LiveCodeBench | — | 83.1% | — |

| Ventana de contexto | 202K | 256K | 205K |

| Parámetros | 744B (40B activos) | Arquitectura MoE | — |

| Especialidad | Razonamiento en chino | Desarrollo frontend | Codificación full-stack |

| Licencia | Pesos abiertos | Pesos abiertos | Pesos abiertos |

- MiniMax M2.5: Capacidad de codificación integral más fuerte (SWE-Bench 80.2%) y límites más generosos.

- Kimi K2.5: Ventajas únicas en LiveCodeBench y desarrollo frontend, con una ventana de contexto súper larga de 256K.

- GLM-5: Óptimo para escenarios de codificación en chino, con destacada capacidad de razonamiento matemático.

🎯 Recomendación de elección: Si tu actividad principal es escribir código, MiniMax M2.5 es la opción con mejor relación calidad-precio en OpenCode GO: tiene los límites más altos y la mejor capacidad de codificación. Si además deseas invocar estos modelos por separado a través de API para otros proyectos, puedes considerar el plan de pago por uso de APIYI (apiyi.com), que no tiene límites de uso.

Análisis de ventajas y desventajas de OpenCode GO

5 ventajas de OpenCode GO

1. El precio es realmente económico

Por $10 al mes obtienes tres modelos open-source punteros. Calculando un valor de uso equivalente a $60 mensuales, obtienes 6 veces el valor en invocaciones del modelo. Para desarrolladores individuales, este precio es muy atractivo.

2. Cambio libre entre tres modelos

Los tres modelos, GLM-5, Kimi K2.5 y MiniMax M2.5, tienen sus propias áreas de especialización, permitiéndote cambiar entre ellos según el tipo de tarea. A diferencia de Claude Max, que solo permite usar modelos de Anthropic.

3. Cobertura global de nodos

Nodos en Estados Unidos, Europa y Singapur, lo que garantiza una latencia controlable para usuarios internacionales.

4. Sin compromisos a largo plazo

Puedes cancelar en cualquier momento, sin quedar atrapado en pagos anuales o trimestrales.

5. Capa gratuita para probar

El modelo gratuito Big Pickle (200 solicitudes/5 horas) te permite probar antes de decidirte a pagar. Los comentarios de la comunidad indican que Big Pickle tiene un buen desempeño en revisión de código y generación de documentación.

4 desventajas de OpenCode GO

1. Sigue siendo una limitación del plan de codificación

Al igual que otros planes de codificación, los modelos de OpenCode GO solo pueden usarse dentro de OpenCode. No puedes usar esta clave para invocarlos en Dify, FastGPT o un backend personalizado.

2. Los límites de GLM-5 son ajustados

GLM-5 solo ofrece ~5,750 solicitudes al mes. Si eres un usuario intensivo de GLM-5, este cupo podría no ser suficiente.

3. Incertidumbre de la fase Beta

El paquete aún se encuentra en fase Beta, por lo que la lista de modelos, los límites y los precios podrían ajustarse.

4. No incluye modelos propietarios de primer nivel

No incluye modelos propietarios punteros como Claude Opus, GPT-5.4 o Gemini 2.5 Pro. Si tus tareas requieren capacidades de modelos de primer nivel, OpenCode GO podría no ser suficiente.

Matriz comparativa de planes de codificación

| Plan | Tarifa mensual | Modelos incluidos | Límite mensual | Restricciones de uso | ¿Para quién es? |

|---|---|---|---|---|---|

| OpenCode GO | $10 | GLM-5, K2.5, M2.5 | $60 en créditos | Solo en OpenCode | Usuarios de OpenCode |

| Alibaba Cloud Lite | $5.80 | Qwen3.5, GLM-5, M2.5, K2.5 | 18,000 solicitudes | Solo herramientas de codificación | Presupuesto muy ajustado |

| Alibaba Cloud Pro | $29 | Los mismos cuatro modelos | 90,000 solicitudes | Solo herramientas de codificación | Usuarios intensivos |

| GLM Coding Lite | $3 | GLM-4.7 | 120 solicitudes/5hr | Solo herramientas de codificación | Usuarios ocasionales de GLM |

| OpenAI Codex | $20 (Plus) | GPT-5.4 | 30-150 solicitudes/5hr | Sin restricciones | Necesita capacidades de GPT |

Análisis comparativo clave

OpenCode GO vs Alibaba Cloud Coding Plan

La versión Lite de Alibaba Cloud cuesta solo $5.80/mes e incluye un modelo adicional, Qwen3.5, por un precio más bajo. Sin embargo, las restricciones de Alibaba Cloud son más estrictas: prohíben explícitamente el uso en escenarios no interactivos. La ventaja de OpenCode GO radica en los $60 en créditos mensuales (especialmente el límite de 100,000 solicitudes para MiniMax M2.5) y la mejor experiencia TUI del propio OpenCode.

OpenCode GO vs API Genérico

Si solo usas IA dentro de herramientas de codificación, OpenCode GO a $10/mes es mucho más económico que el pago por uso: $60 en créditos podrían costar entre $30 y $60 a precios de mercado. Pero si necesitas invocar la API en múltiples escenarios (backend, Dify, automatización), entonces la API genérica es la elección correcta.

💡 Evaluación del escenario: Si eres un usuario fiel de OpenCode y solo usas IA para codificar, OpenCode GO es una buena oferta. Pero si también necesitas invocar modelos en otras herramientas o en el backend, te recomendamos usar una API genérica de pago por uso, como la de APIYI en apiyi.com, para acceder a modelos como DeepSeek V3.2 ($0.28/M) o MiniMax M2.5 ($0.29/M), sin restricciones de escenario.

¿Quién debería comprar OpenCode GO?

4 tipos de usuarios a los que les conviene

1. Usuario intensivo de OpenCode

Ya usas OpenCode como tu herramienta principal de codificación y envías más de 50 prompts al día. $10/mes es mucho más barato que el pago por uso.

2. Desarrollador independiente con presupuesto ajustado

Claude Max cuesta $100/mes y ChatGPT Pro $200/mes, lo cual es demasiado caro para un desarrollador individual. OpenCode GO a $10/mes es una opción de entrada.

3. Desarrollador que necesita comparar múltiples modelos

Quieres probar cuál modelo (GLM-5, Kimi K2.5, MiniMax M2.5) se adapta mejor a tu proyecto, y $10/mes es un costo bajo para experimentar.

4. Usuario internacional (fuera de China continental)

El despliegue de nodos globales de OpenCode GO (EE. UU./Europa/Singapur) es más amigable para desarrolladores en el extranjero.

3 tipos de usuarios a los que NO les conviene

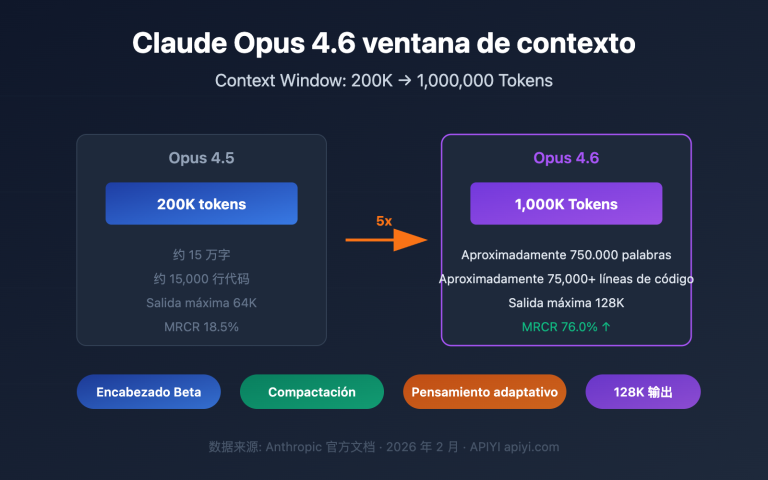

1. Usuario que necesita modelos propietarios de primer nivel

Si tus tareas requieren las capacidades de Claude Opus 4.6 o GPT-5.4, los modelos de código abierto de OpenCode GO podrían no ser suficientes.

2. Usuario que necesita invocar una API genérica

Si necesitas invocar la API en escenarios como Dify, FastGPT o un backend personalizado, la clave de OpenCode GO no es compatible.

3. Usuario que ya tiene otro plan de codificación

Si ya compraste un plan de codificación de Alibaba Cloud (especialmente la versión Lite de $5.80), los modelos que ofrece OpenCode GO se superponen mucho, por lo que no vale la pena suscribirse de nuevo.

🚀 Alternativa de API genérica: Si no solo usas IA dentro de OpenCode, te recomendamos el plan de pago por uso de APIYI en apiyi.com. Ofrece los mismos modelos (GLM-5, MiniMax M2.5, Kimi K2.5) sin restricciones de escenario, y una sola clave funciona en OpenCode, Cursor, Dify y backends personalizados.

Experiencia práctica con OpenCode GO

Experiencia de la interfaz TUI de OpenCode

La interfaz de terminal (TUI) de OpenCode ha sido calificada por la comunidad como "posiblemente la mejor interfaz de terminal entre los agentes de codificación de código abierto". Ofrece soporte para:

- TUI de terminal: Experiencia de línea de comandos similar a Claude Code

- Aplicación de escritorio: Compatible con Mac, Windows y Linux

- Extensión para IDE: Integración con editores como VS Code

- Acceso a 75+ Proveedores: No está vinculado a un único proveedor de modelos

Pasos para configurar OpenCode GO

- Visita opencode.ai/go para registrarte y suscribirte

- Ejecuta

/connecten la TUI de OpenCode - Selecciona OpenCode Go

- Comienza a usar los tres modelos para codificar

Una vez configurado, puedes alternar entre GLM-5, Kimi K2.5 y MiniMax M2.5 usando el selector de modelos.

Qué hacer cuando se agota el crédito

Cuando se agoten los créditos de GO, tienes tres opciones:

- Degradar al uso de modelos gratuitos: Big Pickle sigue disponible, ideal para revisiones de código simples

- Usar saldo Zen: Si tu cuenta tiene Zen Credits, activa la opción "Use balance" para seguir invocando modelos de pago con tu saldo

- Cambiar a un Proveedor de API genérico: Configura un proveedor de respaldo como APIYI en OpenCode, que se activará automáticamente al agotarse los créditos de GO

Técnicas para optimizar el uso del crédito de OpenCode GO

| Estrategia de optimización | Explicación | Efecto de ahorro |

|---|---|---|

| Priorizar M2.5 | Costo por invocación más bajo, el mismo crédito rinde 17 veces más | Ahorro ~94% |

| Usar Big Pickle para tareas simples | Usar el modelo gratuito para revisión de código, generación de documentación | Ahorro 100% |

| Usar GLM-5 solo para tareas complejas | Cambiar solo cuando se necesita razonamiento profundo | Consumo bajo demanda |

| Atención a la ventana de 5 horas | Distribuir el uso, evitar consumo concentrado | Uso uniforme |

Alternativa más flexible: Acceso a API genéricas

Si no quieres estar limitado por las restricciones de OpenCode GO, las API genéricas son otra opción.

Comparación de costos: API genérica vs OpenCode GO

Tomando un uso mensual de 10M tokens como ejemplo:

| Plan | Tarifa mensual | Modelos disponibles | Restricciones de uso | Estimación de costo mensual |

|---|---|---|---|---|

| OpenCode GO | $10 fijos | 3 modelos de código abierto | Solo en OpenCode | $10 |

| APIYI DeepSeek V3.2 | Pago por uso | Docenas de modelos | Sin restricciones | ~$3-7 |

| APIYI MiniMax M2.5 | Pago por uso | Docenas de modelos | Sin restricciones | ~$9 |

| APIYI GLM-5 | Pago por uso | Docenas de modelos | Sin restricciones | ~$34 |

Análisis: Si usas principalmente DeepSeek V3.2 o MiniMax M2.5, el pago por uso de una API genérica puede ser incluso más económico que $10/mes, y sin ninguna restricción de escenario.

Configurar una API genérica en OpenCode

OpenCode ya admite proveedores personalizados. Puedes usar directamente la API genérica de APIYI en OpenCode:

{

"provider": {

"openai": {

"apiKey": "sk-tu-clave-API-de-APIYI",

"baseURL": "https://api.apiyi.com/v1",

"model": "deepseek-v3.2"

}

}

}

De esta manera, disfrutas de la excelente experiencia TUI de OpenCode sin las limitaciones de crédito y escenario del plan GO.

💰 Optimización de costos: Estrategia recomendada: usa el Big Pickle gratuito de OpenCode GO para tareas simples y, al mismo tiempo, configura la API genérica de APIYI (apiyi.com) para tareas que requieran modelos más potentes. Usando ambos en combinación, el costo mensual puede mantenerse por debajo de $5.

Preguntas frecuentes

P1: ¿Cuánto uso real incluye el plan OpenCode GO de $10/mes?

OpenCode GO utiliza facturación en dólares equivalentes: $12 por cada 5 horas, $30 semanales, $60 mensuales. El número real de solicitudes depende del modelo que uses: con MiniMax M2.5 puedes alcanzar hasta 100,000 solicitudes mensuales, con GLM-5 unas 5,750 y con Kimi K2.5 unas 9,250. Para usuarios ligeros o moderados, el crédito de MiniMax M2.5 es prácticamente inagotable.

P2: ¿Puedo usar la clave de OpenCode GO en otras herramientas como Cursor o Dify?

No. Al igual que otros planes de codificación, la clave API de OpenCode GO solo se puede usar dentro de OpenCode. Si necesitas realizar llamadas en escenarios como Cursor, Dify o un backend personalizado, te recomendamos usar una API de pago por uso, como la que ofrece APIYI en apiyi.com.

P3: ¿Cuál debo elegir, OpenCode GO o el plan de codificación de Alibaba Cloud?

Si usas OpenCode como tu herramienta principal, elige OpenCode GO ($10/mes, con un crédito equivalente de $60 más generoso). Si utilizas múltiples herramientas de codificación (Cursor, Cline, etc.), el plan de codificación de Alibaba Cloud tiene mejor compatibilidad. Si tu presupuesto es muy limitado, Alibaba Cloud Lite a $5.80/mes es más económico.

P4: ¿Qué es el modelo gratuito Big Pickle? ¿Es bueno?

Big Pickle es un modelo gratuito proporcionado por OpenCode, con un contexto de 200K y un límite de salida de 128K. La comunidad especula que podría estar optimizado a partir de GLM-4.6. Los usuarios reportan un buen desempeño en revisión de código y generación de documentación, pero no iguala a los tres modelos del plan GO en tareas de codificación complejas. Su principal valor es la "prueba gratuita": puedes experimentar el flujo de trabajo de OpenCode antes de decidirte a pagar.

P5: Si no compro OpenCode GO, ¿cómo puedo usar modelos de alta calidad en OpenCode?

OpenCode admite la integración personalizada de más de 75 proveedores. Puedes configurar directamente una API genérica (como APIYI en apiyi.com) para usar modelos como DeepSeek V3.2, MiniMax M2.5 o GLM-5 dentro de OpenCode, sin las limitaciones de crédito del plan GO y con una facturación por uso más flexible.

Resumen: ¿Vale la pena comprar OpenCode GO?

Conclusión en una frase: OpenCode GO es un paquete bueno pero no esencial.

Condiciones para que valga la pena:

- Eres un usuario fiel de OpenCode, con un volumen de codificación diario de 50+ indicaciones

- Tu presupuesto es limitado ($10/mes) y no quieres gastar $100+ en Claude Max

- Solo usas la codificación con IA dentro de OpenCode, no necesitas llamar a la API en otros escenarios

- Quieres experimentar rápidamente con los tres modelos: GLM-5, Kimi K2.5 y MiniMax M2.5

Condiciones para que NO valga la pena:

- Necesitas llamar a los modelos en plataformas como Dify, FastGPT, etc.

- Necesitas las capacidades de primer nivel de Claude Opus o GPT-5.4

- Ya tienes el plan de codificación de Alibaba Cloud (alta superposición de modelos)

- Tu uso mensual promedio es bajo (el pago por uso de la API general puede ser más barato)

Nuestra recomendación: Para la mayoría de los desarrolladores, la API general + Proveedor personalizado de OpenCode es una solución más flexible. Al conectar modelos como DeepSeek V3.2 ($0.28/M), MiniMax M2.5 ($0.29/M) a través de APIYI (apiyi.com), puedes usarlos tanto en OpenCode como en cualquier otra herramienta o backend, sin límites de cuota ni restricciones de escenario.

Este artículo fue escrito por el equipo técnico de APIYI, basado en la documentación oficial de OpenCode y la experiencia de uso real. Para más comparaciones de herramientas de codificación con IA y tutoriales de conexión de modelos, visita el Centro de Ayuda de APIYI: help.apiyi.com