Muchos usuarios que utilizan la API de gpt-image-2 o el sitio web de ChatGPT para generar imágenes se enfrentan al mismo problema: aunque el modelo tiene una alta precisión en el reconocimiento de texto, las fuentes siempre terminan siendo esa tipografía sans-serif simple con "estética de ingeniero", carente de marca y diseño. Esta "estética austera" es especialmente notable al generar pósteres, portadas para redes sociales o imágenes promocionales de productos, haciendo que composiciones que de otro modo serían buenas parezcan baratas.

La raíz del problema no es una falta de capacidad del modelo, sino que la gran mayoría de las indicaciones de los usuarios solo describen "qué dibujar", pero no le dicen al modelo "cómo debe lucir la fuente". Este artículo, basado en el Cookbook oficial de OpenAI y en la experiencia de pruebas reales de varios proveedores de servicios de API, desglosa sistemáticamente el mecanismo de trabajo de las indicaciones de fuente para gpt-image-2. Proporcionamos 6 plantillas de descripción de fuentes reutilizables y, junto con ejemplos de invocación en la plataforma APIYI (apiyi.com), te ayudaremos a aprender en 5 minutos cómo escribir indicaciones para que las fuentes en tus imágenes tengan una estética real.

1. El mecanismo central de las indicaciones de fuente en gpt-image-2

1.1 ¿Por qué la fuente predeterminada siempre es una sans-serif simple?

Cuando no hay una descripción explícita de la fuente, gpt-image-2 genera la tipografía basándose en el "prior visual" más seguro de sus datos de entrenamiento. El resultado suele ser una sans-serif geométrica neutra (cercana al estilo de Inter o Helvetica), que garantiza la legibilidad pero sacrifica la expresión estilística.

La guía oficial de indicaciones de OpenAI señala claramente: el modelo solo renderizará los atributos visuales que tú restrinjas activamente; lo que no esté restringido, tomará los valores predeterminados. Es decir, si solo escribes "un póster sobre café", el modelo usará automáticamente la fuente más común; solo cuando escribes detalles como "fuente serif de exhibición dibujada a mano con trazos de pincel gruesos", el modelo activará el prior de fuente correspondiente.

Esta es la razón por la que, con el mismo tema y la misma longitud de indicación, la calidad de la imagen final puede variar drásticamente si se incluye o no una descripción de la fuente. Una vez que entiendes esto, la "fuente simple" deja de ser un defecto del modelo y pasa a ser un caso donde el usuario no describió la fuente como información central de la imagen.

Otro factor que a menudo se pasa por alto es la versión del modelo. La mayor mejora de gpt-image-2 respecto a la generación 1.5 radica en la capa de renderizado de texto, con soporte nativo para salida cercana a 4K y una capacidad significativamente mejorada para manejar texto pequeño, composición densa y mezcla de múltiples fuentes. Esto significa que el retorno de inversión de tu esfuerzo en las indicaciones de fuente es mayor en gpt-image-2, por lo que vale la pena dedicar más tiempo a perfeccionarlas.

1.2 Los cuatro elementos clave de las indicaciones de fuente en gpt-image-2

Al desglosar la "descripción de la fuente", gpt-image-2 responde en realidad a instrucciones en cuatro dimensiones independientes, todas necesarias:

| Elemento | Función | Ejemplo de descripción |

|---|---|---|

| Estilo de fuente (Style) | Determina la estructura del glifo y el carácter visual | bold sans-serif, condensed serif, hand-lettered display |

| Jerarquía de tamaño (Hierarchy) | Controla el contraste entre título/subtítulo/cuerpo | large headline, small body copy |

| Contraste de color (Contrast) | Determina la legibilidad entre la fuente y el fondo | high contrast white on navy |

| Diseño espacial (Placement) | Bloquea la posición y alineación del texto | centered at top, clean kerning |

🎯 Consejo práctico: Se recomienda que una indicación de fuente de alta calidad cubra estos cuatro elementos; la falta de cualquiera de ellos puede causar que la fuente se desvíe. Sugerimos probar versiones con y sin estos cuatro elementos en la plataforma APIYI (apiyi.com) para ver la diferencia de forma intuitiva.

1.3 Escritura con restricciones estrictas para texto literal

La guía image-gen-models-prompting-guide del Cookbook de OpenAI ofrece un truco clave: encierra la cadena de texto que debe aparecer en la imagen entre comillas o en mayúsculas, el modelo entenderá esta parte como una restricción estricta de "debe renderizarse literalmente, sin añadir ni omitir caracteres".

En pruebas comparativas, escribir the word coffee on a sign frente a a sign with the EXACT text "COFFEE" muestra una diferencia significativa en la probabilidad de errores ortográficos; la segunda opción garantiza casi totalmente la consistencia a nivel de carácter. Para nombres de marca difíciles de deletrear (como Schønne o APIYI), se recomienda separar los caracteres con espacios, por ejemplo "A P I Y I", para reducir aún más el riesgo de errores de posicionamiento de caracteres.

2. 6 métodos prácticos para escribir indicaciones de fuentes en gpt-image-2

Cada escenario requiere una estrategia de descripción de fuentes diferente. Los siguientes 6 métodos son plantillas de alta frecuencia y reutilizables, resumidas a partir de ejemplos oficiales de OpenAI, casos de prueba reales de fal.ai y bibliotecas de indicaciones de código abierto.

2.1 Método de descripción funcional: el enfoque más sólido

Describe las características de la forma de la letra utilizando terminología tipográfica. Este es el método más recomendado por OpenAI y el que tiene mayor tasa de éxito:

bold geometric sans-serif(sans-serif geométrica gruesa, ideal para marcas tecnológicas)condensed sans-serif with tight tracking(sans-serif condensada con espaciado estrecho, ideal para titulares de revistas)classic transitional serif with fine hairlines(serif de transición clásica con trazos finos, ideal para artículos de lujo o editoriales)rounded humanist sans-serif(sans-serif humanista redondeada, ideal para marcas infantiles o amigables)

2.2 Método de estilo y emoción: dale "personalidad" a la fuente

Utiliza movimientos artísticos o estilos de diseño en lugar de nombres de fuentes específicos para activar el conocimiento previo del modelo sobre todo el sistema estético:

minimalist Bauhaus sans-serifArt Deco display typography with metallic strokesbrutalist concrete typographyMemphis-style 80s display font with bold geometric shapes

La ventaja de este método es que la fuente no existe de forma aislada; el modelo combinará automáticamente colores, maquetación y elementos decorativos coherentes, logrando un lenguaje de diseño más unificado.

2.3 Método de escenario de época: recreación precisa de la estética nostálgica

Mediante la combinación de época y soporte, haz que la fuente parezca escaneada de impresiones reales de un periodo histórico específico:

1970s vinyl record cover psychedelic display font90s grunge zine handwritten typography with photocopy textureearly 2000s Y2K chrome bubble font1950s diner neon sign script lettering

Este método es especialmente útil para portadas con temas nostálgicos, retro o de cultura underground, superando en precisión al simple uso de retro font.

2.4 Método de atmósfera de marca: la opción preferida para uso comercial

Describe directamente la esencia visual del sector objetivo, permitiendo que el modelo se acerque automáticamente a los estándares tipográficos comerciales maduros:

editorial fashion magazine serif typography, Vogue styletech startup landing page typography, clean and confidentluxury skincare branding typography, refined and minimalcraft brewery label typography, hand-drawn rustic feel

🎯 Consejo CTA: La producción comercial exige una consistencia muy alta. Te recomendamos utilizar el servicio proxy de API de APIYI (apiyi.com) para encadenar varias imágenes de una misma marca usando la misma descripción de atmósfera, lo que garantiza que el lenguaje tipográfico sea uniforme en toda la identidad visual.

2.5 Método de material físico: haz que la fuente "exista en 3D"

Considera la fuente como un objeto físico del mundo real, no como una capa digital. Este es un uso avanzado destacado en los tutoriales de fal.ai:

plastic letter board with uneven letter spacing, one missing slotglowing neon tube letters with visible glass tubing and cablescut paper letters with soft drop shadows, layered cardboardchiseled marble inscription with deep shadow inside the cuts

Las fuentes generadas con este método incluyen iluminación, sombras y detalles de desgaste, con una textura que supera con creces a las letras planas.

2.6 Método de referencia por nombre de fuente: recreación precisa de tipos específicos

Aunque OpenAI no ha publicado una lista blanca de fuentes, en las pruebas se ha comprobado que los nombres de las fuentes más conocidas son reconocibles. Funcionan mejor como modificadores añadidos tras la descripción funcional:

clean sans-serif typography, Inter styleeditorial serif similar to Playfair Displaygeometric sans-serif inspired by Futurahumanist serif in the vein of Garamond

Ten en cuenta que este método es una sugerencia de estilo y no una recreación a nivel de carácter; el modelo no cargará realmente el archivo de la fuente, pero la sensación visual será muy cercana.

| Método de descripción | Escenario de aplicación | Tasa de éxito | Riqueza de estilo |

|---|---|---|---|

| Funcional | General, UI, corporativo | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Estilo y emoción | Pósteres, arte, marcas personales | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Escenario de época | Retro, nostalgia, temas culturales | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Atmósfera de marca | Comercial, e-commerce, publicidad | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Material físico | Escenas 3D, fotografía de producto | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Referencia de fuente | Recreación precisa, diseño | ⭐⭐⭐ | ⭐⭐⭐⭐ |

III. Implementación práctica de la API para indicaciones de fuentes en gpt-image-2

Una vez que comprendes cómo describir las fuentes, el siguiente paso es enviar estas indicaciones a la API de gpt-image-2. En esta sección, te presentamos el código de invocación más sencillo y la explicación de los parámetros clave.

3.1 Ejemplo de invocación mínima: cómo activar las indicaciones de fuentes

El siguiente código en Python utiliza el SDK de OpenAI para llamar a gpt-image-2. Basta con incluir la indicación de la fuente dentro del cuerpo del prompt para que surta efecto:

from openai import OpenAI

client = OpenAI(

api_key="your_api_key",

base_url="https://vip.apiyi.com/v1" # Dirección del servicio proxy de API de APIYI

)

response = client.images.generate(

model="gpt-image-2",

prompt='Coffee shop poster with EXACT text "MORNING BREW" '

'in 1950s diner neon sign script lettering, '

'centered at top, high contrast warm orange on deep teal',

quality="high",

size="1024x1536",

)

Ten en cuenta que el prompt incluye cinco dimensiones: "qué dibujar + texto literal + descripción de la fuente + contraste de color + posición". Esta es la estructura mínima necesaria para obtener imágenes de alta calidad.

3.2 Parámetros clave: el impacto de quality en la nitidez del texto

El parámetro quality de gpt-image-2 influye mucho más en el texto pequeño, la tipografía densa y la mezcla de fuentes que en la apariencia general de la imagen:

| Nivel de quality | Escenario de uso | Nitidez de la fuente | Velocidad de renderizado |

|---|---|---|---|

| low | Bocetos/vista previa rápida | Solo títulos grandes claros | Más rápido |

| medium | Pósteres comunes, portadas de redes sociales | Títulos + subtítulos claros | Medio |

| high | Múltiples fuentes, texto largo, infografías | Legibilidad a nivel de cuerpo de texto | Más lento |

🎯 Consejo de invocación de API: Cuando trabajes con mezclas de fuentes o textos de más de 50 caracteres, te recomendamos encarecidamente configurar

qualityenhigh. Nuestras pruebas en APIYI (apiyi.com) muestran una diferencia notable en la legibilidad del texto pequeño entremediumyhigh.

3.3 Uso de imágenes de referencia para mejorar la precisión de la fuente

gpt-image-2 permite subir hasta 16 imágenes de referencia (JPEG/PNG/WebP, hasta 30 MB cada una). Un uso avanzado es: utilizar una imagen de referencia que contenga la fuente deseada junto con la indicación "match the typography style of the reference image", lo cual puede mejorar significativamente la precisión en la reproducción de la fuente.

Esta combinación de "imagen de referencia + descripción de estilo" es casi obligatoria cuando generas imágenes de productos en serie o necesitas mantener la consistencia de la tipografía de una marca.

IV. 5 consejos avanzados para mejorar la estética de las fuentes en gpt-image-2

Una vez dominados los métodos básicos, estos 5 consejos elevarán tus fuentes de "aceptables" a "nivel profesional".

4.1 Establece una jerarquía visual clara con palabras clave de tamaño

No te limites a escribir una descripción de fuente que cubra toda la imagen. Los pósteres e infografías suelen contener de 2 a 3 niveles de texto, los cuales deben restringirse por separado:

large headline in bold condensed sans-serif, small body copy in light sans-serif, tiny disclaimer text in monospace at bottom

Dividir explícitamente la jerarquía evita que el modelo renderice todo el texto con el mismo tamaño, lo cual es una de las causas más comunes de una apariencia "amateur".

4.2 Los detalles de interletraje y alineación definen el profesionalismo

Al añadir descripciones de detalles tipográficos como clean kerning (interletraje limpio), tight tracking (seguimiento ajustado), generous letter spacing (espaciado generoso), flush left (alineado a la izquierda) o justified (justificado), el modelo activará un conocimiento previo de diseño de mayor calidad.

Por ejemplo, al actualizar bold sans-serif headline a bold condensed sans-serif headline with tight tracking and clean kerning, flush left aligned, obtendrás inmediatamente una sensación de maquetación profesional.

4.3 El contraste de color determina directamente la legibilidad

Por muy bonita que sea la fuente, si el color es incorrecto, no sirve de nada. Te sugerimos escribir explícitamente la relación de contraste entre el color de la fuente y el fondo:

white sans-serif on deep navy background, maximum contrastcream serif on dark olive background, high contrastneon yellow display font on charcoal background, electric contrast

🎯 Consejo de combinación de colores: Cuando el contraste de color es inferior a 4.5:1, el texto pequeño se volverá borroso; esta es una limitación física de gpt-image-2. Probar diferentes combinaciones de colores en APIYI (apiyi.com) es más eficiente que depurar repetidamente una sola imagen.

4.4 Método iterativo: cambia solo una variable a la vez

El Cookbook oficial de OpenAI enfatiza repetidamente: One revision per turn (una revisión por turno). Al modificar la fuente, cambia solo la descripción de la fuente; no cambies simultáneamente el color de fondo, la composición o el sujeto principal, de lo contrario no podrás determinar qué cambio fue el que funcionó.

El flujo correcto es fijar primero una versión de "indicación base" y luego iterar la fuente como única variable de 5 a 10 veces, cambiando solo 1 o 2 adjetivos de la fuente en cada versión.

4.5 Sustituye las descripciones dispersas por una "sección de especificaciones tipográficas" estructurada

El modelo responde mucho mejor a la información estructurada que a los adjetivos dispersos por todas partes. Recomendamos la siguiente plantilla:

Typography:

- Headline: EXACT text "MORNING BREW", bold condensed sans-serif,

large size, high contrast warm white on deep teal, centered top.

- Body: small humanist sans-serif, regular weight, two-line subtitle,

centered below headline with generous letter spacing.

- Tagline: tiny monospace text at bottom, light grey on teal.

Esta forma de escribir una "sección de especificaciones tipográficas" aparece tanto en fal.ai como en los ejemplos oficiales de OpenAI, y es el estándar de facto para la generación de imágenes de nivel comercial.

| Consejo avanzado | Problema que resuelve | Dificultad | Efecto de mejora |

|---|---|---|---|

| Palabras clave de jerarquía | Tamaño de fuente inconsistente | ⭐⭐ | Alto |

| Detalles de interletraje/alineación | Maquetación tosca | ⭐⭐⭐ | Alto |

| Contraste de color | Texto ilegible | ⭐⭐ | Muy alto |

| Iteración de una variable | Dirección de ajuste confusa | ⭐⭐⭐ | Medio |

| Sección de especificaciones | Descripción dispersa | ⭐⭐⭐⭐ | Muy alto |

V. Preguntas frecuentes (FAQ) sobre las indicaciones de fuentes en gpt-image-2

5.1 ¿Por qué las fuentes en mis imágenes generadas con gpt-image-2 siempre se ven simples?

En el 99% de los casos, es porque la indicación no incluye una descripción de la fuente. El modelo utiliza por defecto una fuente geométrica sans-serif por seguridad; debes restringirlo activamente usando uno de los 6 métodos de descripción mencionados en la segunda sección. Te sugerimos empezar combinando el método de descripción funcional con el de atmósfera de marca.

5.2 ¿Puedo especificar nombres de fuentes concretas como Helvetica o Inter?

Puedes usarlos como sugerencias de estilo, pero no activarán un renderizado preciso a nivel de archivo de fuente. OpenAI recomienda usar descripciones funcionales (como clean sans-serif typography, Inter style) en lugar de escribir el nombre de la fuente directamente. Si necesitas una precisión tipográfica extrema, te recomendamos usar el modo de imagen de referencia en APIYI apiyi.com para subir una muestra con la fuente objetivo.

5.3 ¿Cómo escribo indicaciones para fuentes en chino?

Las descripciones de fuentes en chino no son tan sensibles actualmente como en inglés, pero hay formas efectivas: Chinese black-bold typography (heiti), traditional Chinese seal script style o modern Chinese sans-serif similar to Source Han Sans. Además, asegúrate de encerrar el texto en chino entre comillas, por ejemplo "早安咖啡", de lo contrario, es probable que los caracteres chinos presenten errores.

5.4 ¿Qué hago si la fuente se desplaza durante las iteraciones?

OpenAI sugiere repetir el segmento completo de especificación de fuente en cada ronda de iteración, en lugar de solo decir "ajusta un poco más". Guarda la plantilla de especificación de fuente de la cuarta sección y pégala completa en cada iteración; esto puede reducir la tasa de desplazamiento de la fuente por debajo del 5%.

5.5 ¿Dónde puedo invocar la API de gpt-image-2 de forma estable?

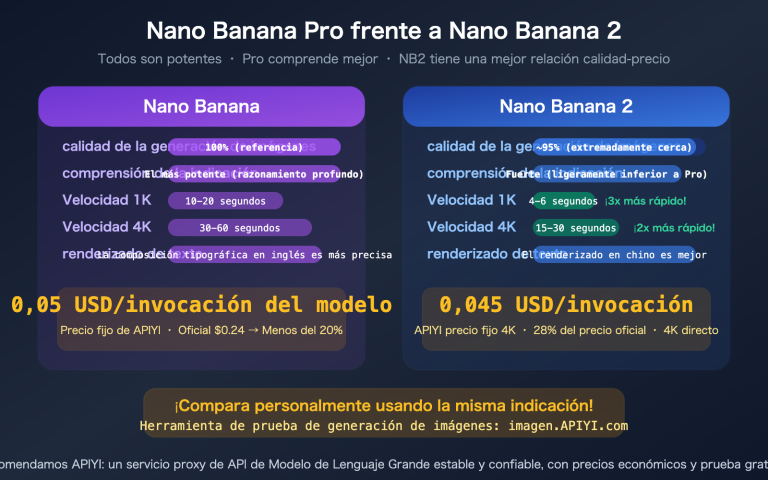

Los desarrolladores pueden invocar gpt-image-2 a través de plataformas de servicio proxy de API como APIYI apiyi.com, reemplazando la base_url por https://vip.apiyi.com/v1, sin necesidad de usar un proxy. Esta plataforma también admite una interfaz unificada para gpt-image-2 y otros modelos de imagen principales, lo que facilita la comparación horizontal de la capacidad de renderizado de fuentes entre diferentes modelos en un mismo proyecto.

5.6 ¿Es posible editar la fuente después de generar la imagen sin volver a crearla toda?

Sí. gpt-image-2 admite el modo de edición de imagen. Usa la imagen original como entrada y, en la indicación, describe solo los cambios relacionados con la fuente (por ejemplo, change the headline font to bold condensed serif, keep everything else identical). El modelo conservará la estructura principal y solo actualizará la capa de texto. Esta "edición tipográfica parcial" es muy eficiente al iterar diseños de marca.

5.7 Si la indicación de fuente es muy larga, ¿el modelo dejará de "leerla"?

gpt-image-2 tiene una tolerancia a las indicaciones largas mucho mayor que la generación anterior. Los segmentos de especificación de fuente estructurados (como la plantilla Typography: de la cuarta sección) generalmente no se truncan. Lo que realmente afecta el resultado no es la longitud, sino el ruido: evita acumular adjetivos estéticos ("hermoso", "impresionante", "de alta calidad") y reemplaza cada frase con atributos de fuente medibles; esto es mucho más eficiente.

5.8 Con la misma indicación de fuente, ¿por qué a veces el resultado es bueno y otras veces regular?

Existe una aleatoriedad razonable en la generación de gpt-image-2; una sola imagen no puede servir como criterio para juzgar la calidad de una indicación. El flujo de trabajo profesional consiste en ejecutar de 4 a 8 imágenes con la misma indicación y elegir la mejor. Si más de 5 de las 8 imágenes muestran una fuente estable, significa que la indicación es lo suficientemente robusta. Por eso recomendamos usar APIYI apiyi.com para llamadas por lotes; la eficiencia de depuración es un orden de magnitud mayor que la de la interfaz web de ChatGPT.

VI. Conclusión: El camino clave para que las fuentes en gpt-image-2 tengan una estética real

Volviendo a la pregunta inicial: ¿por qué las fuentes en gpt-image-2 siempre se ven simples y sin estética? La respuesta es: el modelo solo renderiza los atributos que tú restringes activamente. Una indicación tipográfica de nivel profesional debe cubrir simultáneamente cuatro elementos: estilo de fuente, jerarquía de tamaño, contraste de color y diseño espacial, además de usar comillas para fijar el texto, establecer el parámetro quality en high y, si es necesario, usar una imagen de referencia.

Los 6 métodos de descripción presentados en este artículo (descripción funcional, emoción del estilo, escenario de época, atmósfera de marca, material físico y nombre de fuente de referencia) cubren la gran mayoría de los escenarios comerciales. Sugerimos empezar con el método de descripción funcional, añadir gradualmente la emoción del estilo y la atmósfera de marca, y finalmente consolidarlo en un segmento de especificación de fuente estructurado como plantilla reutilizable para el equipo.

🎯 Próximo paso: Realiza una prueba comparativa usando los 6 métodos de descripción de este artículo con el mismo sujeto en APIYI apiyi.com. En 10 minutos verás intuitivamente la curva de mejora en la estética tipográfica. La plataforma admite la invocación unificada de gpt-image-2 y otros modelos, facilitando la iteración rápida de indicaciones.

La fuente no es una decoración de la imagen, es su alma. Dominar la escritura de indicaciones de fuentes para gpt-image-2 es, en esencia, extender la "ingeniería de indicaciones" desde el nivel de composición de la imagen hasta el nivel de diseño tipográfico. Este es el salto clave para que la generación de imágenes por IA pase de "ser aceptable" a ser "de nivel profesional".

Autor: Equipo técnico de APIYI

Plataforma compatible: APIYI apiyi.com, interfaz gpt-image-2